Kimi-K2 Thinking : comment l'essayer dès maintenant à l'aide de Truefoundry AI Gateway

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Version courte : Kimi-K2 Thinking (Moonshot AI) est un modèle de « réflexion » ouvert et sensible aux outils qui favorise le raisonnement en plusieurs étapes, l'orchestration d'outils à long terme et des fenêtres contextuelles massives. Sur Humanity's Last Exam (HLE) et plusieurs benchmarks d'agences, il publie les meilleurs chiffres de l'État (en particulier lorsque l'accès aux outils est activé), ce qui montre bien que la prochaine grande frontière en matière de LLM est réflexion + outils + contexte long, et pas seulement le nombre de paramètres bruts.

Utiliser Passerelle Truefoundry AI pour l'essayer dès maintenant.

Introduction — pourquoi les modèles « pensants » sont importants

Les benchmarks tels que MMLU, les tests de codage et les benchmarks de chat nous ont beaucoup appris, mais ils ne mesurent pas complètement le raisonnement en plusieurs étapes, l'orchestration des outils ou la planification à long terme. Une nouvelle classe de modèles de « pensée » entraîne explicitement ces capacités : le modèle doit associer un raisonnement interne étape par étape à des appels d'outils externes (recherche, interpréteurs de code, navigation sur le Web) et maintenir la cohérence pendant de nombreuses étapes séquentielles.

Kimi-K2 Thinking est un exemple phare de cette tendance. Il est conçu comme un système agentique : il raisonne, décide d'appeler des outils, ingère les résultats des outils et continue à raisonner, tout en gardant le contexte sur des centaines d'étapes. Le résultat : des gains substantiels par rapport à des critères de référence « réfléchissants » tels que HLE et BrowseComp.

Qu'est-ce que Kimi-K2 Thinking (courte visite technique)

Principaux points techniques de la carte modèle officielle :

- L'architecture : Mélange d'experts (MoE) avec environ 1 T de paramètres au total et environ 32 B de paramètres activés.

- Fenêtre contextuelle : Contexte de 256 000 jetons massif pour un raisonnement à long terme.

- Orchestration des outils : Une formation de bout en bout visant à associer la chaîne de pensée aux appels de fonctions/d'outils ; conçue pour survivre 200 à 300 appels d'outils consécutifs sans dérive.

- Quantification native INT4 : Formation axée sur la quantification pour prendre en charge l'inférence INT4 avec des accélérations significatives sans perte de précision signalée.

- Déploiement : API et piles d'inférence standard prises en charge (vLLM, etc.).

Ces éléments (échelle du MoE, contexte étendu, orchestration d'outils explicite et inférence efficace à faible bit) sont les éléments de base qui permettent à Kimi-K2 d'agir comme un agent plutôt que comme un transformateur conversationnel.

À propos de HLE (pourquoi cet indice de référence est important ici)

Le dernier examen de l'humanité (HLE) est destiné à être une référence de type examen très difficile qui met l'accent sur le véritable raisonnement, et non sur la recherche ou les raccourcis. Il contient des problèmes complexes, souvent en plusieurs étapes, dans les domaines des mathématiques, des sciences, de l'ingénierie et d'autres matières. Étant donné que les problèmes de HLE nécessitent généralement un raisonnement en plusieurs étapes et, dans certains cas, une recherche externe ou un calcul, il s'agit d'un excellent test de résistance pour les agents à long contexte capables d'utiliser des outils. Le développement de Kimi-K2 a mis l'accent sur le HLE et d'autres critères de référence des agences. La fiche modèle met en évidence le HLE comme l'une de ses principales cibles d'évaluation.

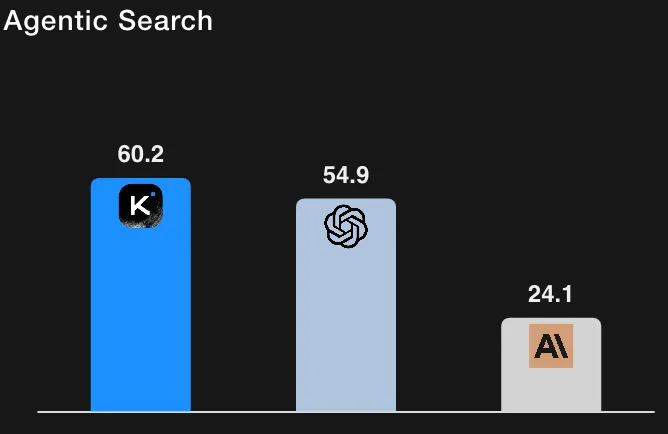

Comment fonctionne Kimi-K2 sur HLE et — les chiffres

Selon les résultats d'évaluation publiés par Moonshot AI :

Le dernier examen de l'humanité (texte uniquement) avec outils

Parcourir Comp

À titre de contexte, GPT-5 (élevé) à ~ 41,7 % sur HLE avec outils (leurs rediffusions internes) et Claude Sonnet 4,5 à ~ 32,0 % (mode réflexion). Les résultats de Kimi-K2 le placent donc en avance sur les niveaux de référence rapportés pour les exécutions HLE activées par des outils. (Tous les chiffres sont tirés du tableau d'évaluation et des notes de bas de page de Moonshot AI.)

Nuance importante : la fiche modèle documente soigneusement la manière dont l'accès aux outils, les paramètres des juges, les budgets symboliques et les limites de contexte ont été gérés ; les auteurs notent également que certains chiffres de référence ont été extraits de publications officielles tandis que d'autres ont été retestés en interne. En bref : ce sont des signaux forts, mais les lecteurs doivent noter qu'ils sont signalés par Moonshot AI et conditionnés au protocole d'évaluation détaillé décrit avec les résultats.

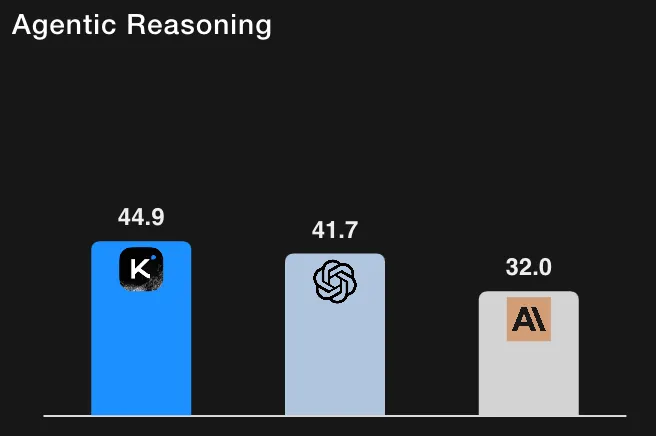

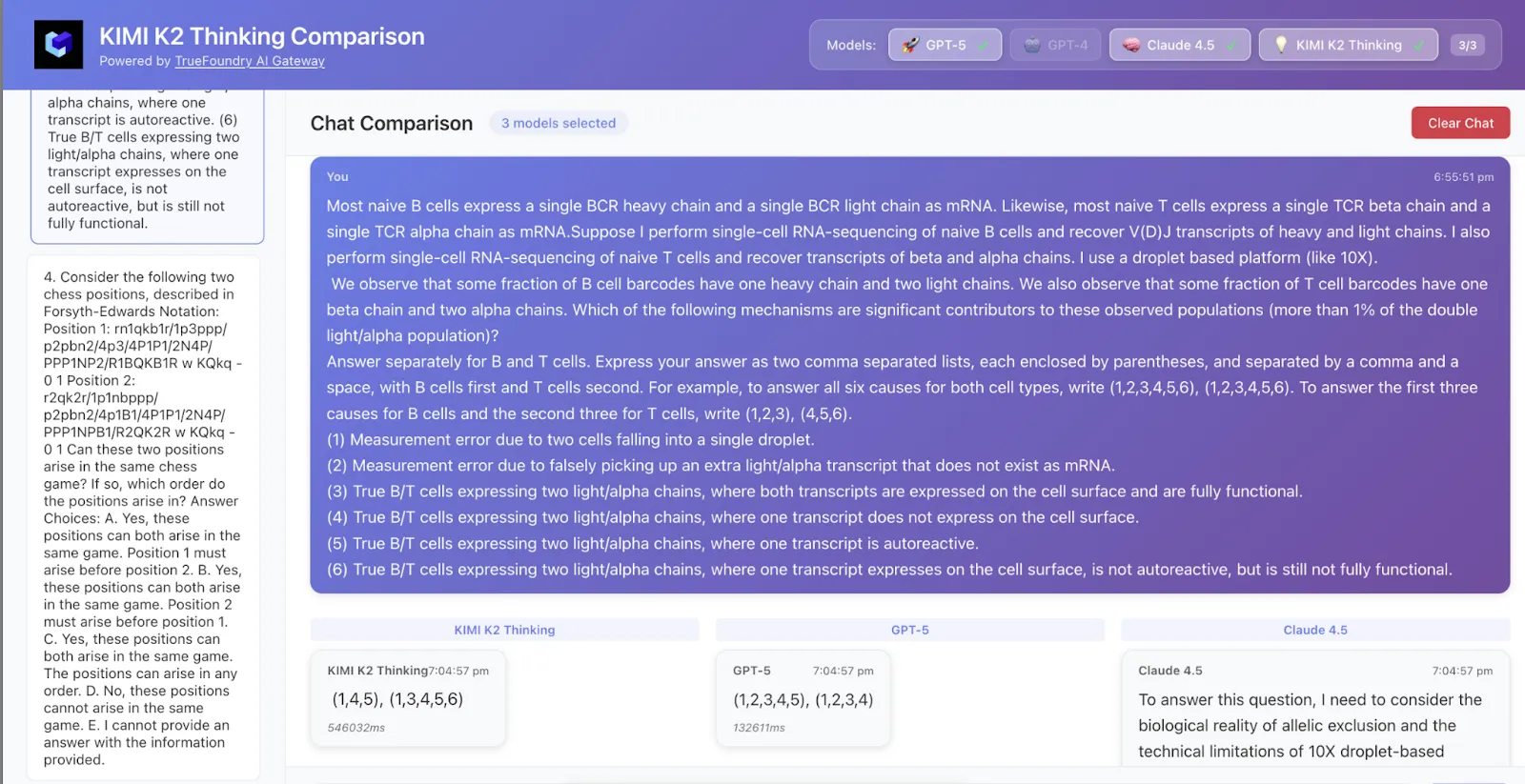

Ce que nous avons découvert dans notre analyse

Nous avons échantillonné 50 lignes de données à partir de HLE et voici les résultats

- Quelques exemples où Kimi K2 Thinking a surperformé d'autres modèles

Kimi K2 a obtenu à la fois la bonne réponse et la logique, tandis que GPT-5 n'a obtenu que la bonne réponse et Claude n'avait pas raison.

Pourquoi le saut de performance avec les outils est important

Kimi-K2 c'est à peu près doubler des performances HLE entre « no-tools » et « with-tools » (≈ 24 % → 45 %) démontrent un point crucial :

- De nombreuses questions HLE nécessitent une récupération/une vérification, un calcul systématique ou des informations externes en plusieurs étapes. Un modèle conçu pour planifier les appels à l'outil dans le cadre de sa chaîne de pensée bénéficiera davantage de l'accès aux outils que d'un modèle qui utilise les outils après coup.

- Contexte long et comportement agentique stable permettent à Kimi-K2 de conserver un état intermédiaire, de revoir les étapes de raisonnement passées et de gérer de nombreux résultats d'outils sans perdre en cohérence. Cela est très important lorsque les chaînes de raisonnement sont longues (style HLE).

- Mode lourd (déploiements de trajectoires parallèles + agrégation réfléchissante) augmente encore la robustesse et la qualité de la réponse finale sur ces questions difficiles.

En termes simples : les gains du HLE suggèrent que le problème central est comment un modèle raisonne et utilise des outils, pas seulement la taille brute du modèle.

Des plats pratiques à emporter

- Si votre charge de travail implique recherche en plusieurs étapes, raisonnement automatisé avec recherches sur le Web, tâches longues en plusieurs étapes ou flux de travail agentiques (automatisation des flux de travail, codage et validation autonomes, longues tâches d'investigation), un modèle axé sur la réflexion tel que Kimi-K2 mérite d'être testé.

- Pour les tâches conversationnelles ponctuelles ou les déploiements restreints sans accès à des outils externes, l'avantage se réduit : choisissez l'outillage et le modèle en fonction de vos besoins.

- La nature à poids ouvert et la quantification moderne permettent aux équipes d'expérimenter sans la friction de la boîte noire de certaines piles propriétaires.

- Bien que le déploiement de ce grand modèle soit hors de question pour de nombreuses personnes, vous pouvez l'expérimenter en utilisant Truefoundry en quelques clics.

Conclusion : essayez-le vous-même en utilisant TrueFoundry AI Gateway

Au-delà des points de référence, ce qui est le plus intéressant, c'est de constater à quel point ce type de capacité devient accessible. Vous n'avez pas à attendre des mois pour expérimenter — vous pouvez l'essayer vous-même. Passerelle TrueFoundry AI permet d'accéder directement à Kimi-K2 Thinking et à d'autres modèles de pointe, de les comparer à vos propres données ou de les intégrer dans des flux de travail.

Si vous souhaitez une aide plus personnalisée, réservez une démo — l'équipe peut vous expliquer les performances, les options de déploiement, les coûts et la manière d'évaluer ces modèles dans le cadre de vos tâches. Nous nous tenons au courant de l'évolution du marché et veillons à ce que de nouveaux modèles soient disponibles pour votre consommation le plus rapidement possible.

Conclusion : Kimi-K2 Thinking n'est pas un simple LLM comme les autres, c'est un aperçu visible de l'avenir des agents capables de raisonner : ouverts, efficaces, sensibles aux outils et adaptés à la résolution de problèmes en plusieurs étapes. Essayez-le, comparez-le en fonction de vos propres problèmes et découvrez à quel point l'orchestration des outils agentiques peut faire une différence sur des tâches réelles.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)