True ML Talks #10 - LLMS et GenAI avec le directeur de l'ingénierie @ Meta

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

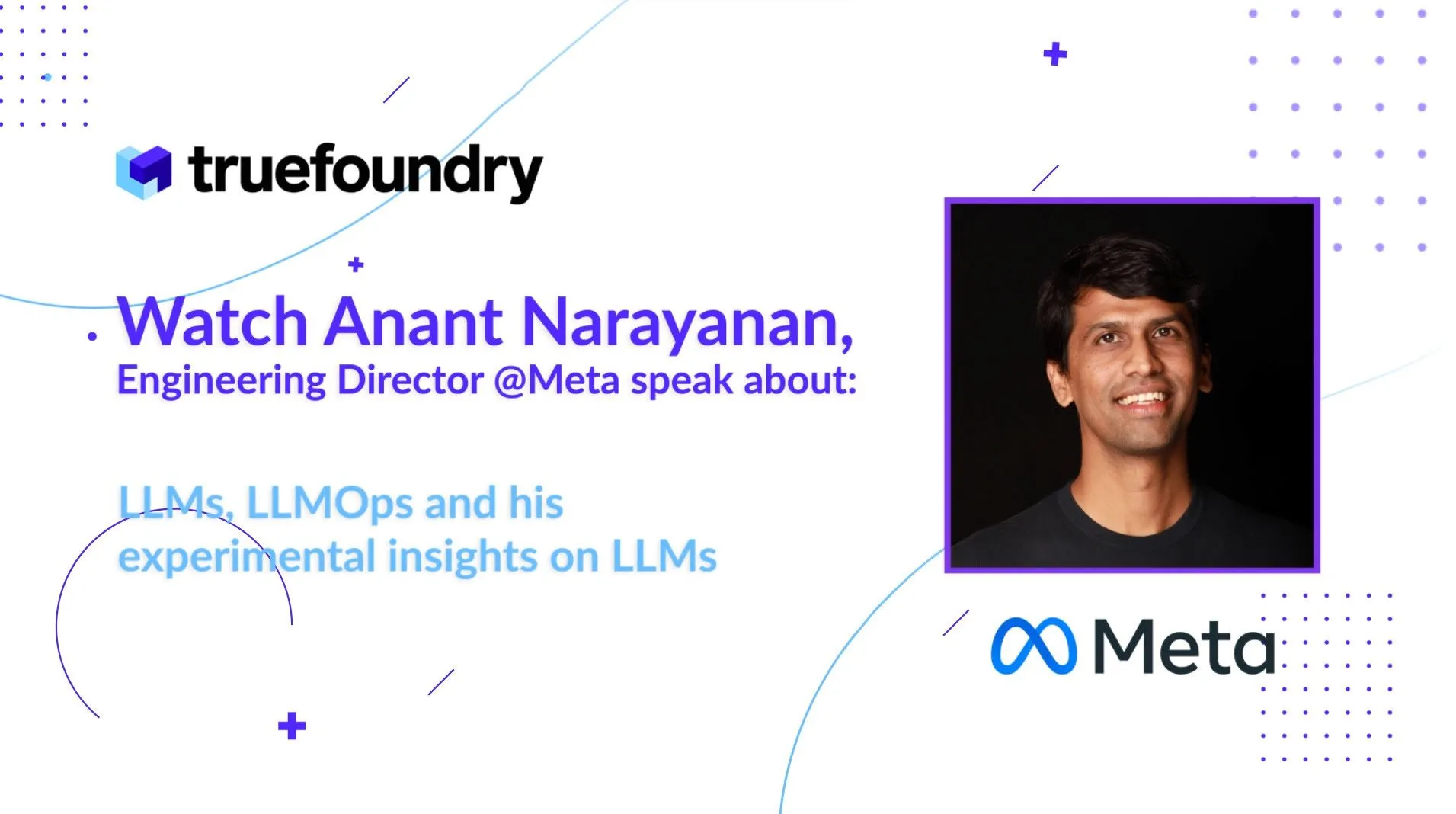

Nous sommes de retour avec un autre épisode de True ML Talks. Dans ce cadre, nous nous intéressons en profondeur aux LLM et à l'IA générative, et nous discutons avec Anant.

Anant est un leader en ingénierie. Actuellement directeur de l'ingénierie chez Meta, il travaille sur certaines expériences de produits liés aux lunettes intelligentes. Il a débuté en tant que contributeur open source et a occupé des postes clés au sein de startups et de géants de la technologie. Chez Mozilla, il a contribué à définir et à implémenter WebRTC, entre autres technologies de navigation. Il a également été l'un des premiers ingénieurs de Firebase et le premier ingénieur d'Ozlo.

📌

Nos conversations avec Anant porteront sur les aspects suivants :

- Réglage précis de la diffusion stable

- Création d'intégrations pour Hacker News

- Le débat sur la durabilité à long terme

- La nécessité d'améliorer le suivi des expériences et d'accéder à une documentation dans LLMOP

- La puissance et le potentiel des plugins OpenAI

- La puissance des modèles de langage dans le flux de restauration et l'adaptation des plugins

Anant nous a parlé à titre personnel et ses opinions ne représentent pas celles de l'organisation (Meta) à laquelle il est affilié.

Regardez l'épisode complet ci-dessous :

Principales observations des expériences d'Anant :

LoRa : une technique intrigante pour affiner de grands modèles de langage.

- Accessibilité de LoRa : Comparée à d'autres techniques comme Dreambooth, LoRa est plus accessible et implique l'ajout de quelques couches à un modèle pré-entraîné sans modifier ses poids.

- Rentabilité et simplicité : LoRa est rentable et peut être utilisé par des personnes non techniques via des plateformes telles que Google Colab. Sa simplicité permet une itération et une expérimentation rapides.

- Potentiel en termes de texte et d'image : Bien qu'initialement appliqué aux images, le potentiel de LoRa pour les tâches liées au texte est en cours d'exploration.

- L'avenir du réglage fin : La LoRa est préférée aux techniques traditionnelles en raison de sa rentabilité, de son accessibilité et de sa compatibilité avec les anciennes cartes graphiques.

Création d'intégrations pour Hacker News : défis et sélection de modèles

- Comprenez les principes fondamentaux : Choisissez les solutions appropriées en fonction de l'ampleur et des exigences du projet.

- Embrassages saisissants : Les intégrations sont des collections de nombres à virgule flottante, et leur stockage dans une base de données SQLite s'est avéré efficace.

- Sélection du modèle : Les bibliothèques d'intégration open source ont été préférées aux fournisseurs de cloud. Le grand modèle Instructor a été choisi sur la base d'analyses comparatives et de prototypage à l'aide du MTEB de Hugging Face.

- Commencez par les principes de base : Approfondissez votre compréhension de la solution choisie et concentrez-vous sur les exigences du projet plutôt que sur le battage publicitaire.

- Expansion en fonction des besoins évidents : La mise à l'échelle doit être effectuée lorsqu'elle correspond à une exigence claire.

Le débat sur la durabilité à long terme : grands modèles contre modèles plus petits et affinés

L'une des discussions importantes au sein de l'écosystème MLOps tourne autour de la durabilité à long terme des grands modèles généralisés par rapport à des modèles plus petits et affinés adaptés à des ensembles de données ou à des cas d'utilisation spécifiques. Ce débat tire parti d'un mémo divulgué qui suggère la banalisation potentielle des grands modèles linguistiques (LLM).

Le mémo divulgué, bien qu'il ne s'agisse pas d'une position officielle, indique un sentiment croissant selon lequel les LLM sont susceptibles de devenir plus accessibles et reproductibles. Ce développement a suscité de l'enthousiasme au sein de la communauté, en particulier parmi ceux qui ont une formation en open source. Les récents progrès ont facilité la réplication des LLM, répondant ainsi aux préoccupations précédentes concernant l'acquisition de données et les coûts de formation des modèles.

Des projets tels que RunwayML et le modèle de diffusion ont contribué à un mouvement open source, permettant la publication de modèles sur des plateformes telles que GitHub. Cela démocratise l'accès aux LLM, permettant aux amateurs et aux pirates informatiques d'explorer et d'expérimenter. Bien que tous les LLM ne soient pas open source, des options open source sous licence sont disponibles, ce qui favorise un large éventail de contributeurs.

Les avantages d'un développement ouvert et d'une participation généralisée sont soulignés, car ils empêchent la concentration du pouvoir entre les mains de quelques entités. De plus, le développement ouvert apporte transparence et sécurité, en tenant compte des facteurs mondiaux et de l'intérêt potentiel des États-nations.

Anticipant la banalisation des LLM, un parallèle est établi avec le paysage du cloud computing. Les utilisateurs auront la possibilité de choisir parmi différents fournisseurs, comme les options de services cloud telles qu'AWS, Azure et Google Compute. Cela permet une saine concurrence et une innovation au sein de l'écosystème.

Le débat porte également sur l'interaction entre les grands modèles et les modèles plus petits intégrés à l'appareil. Les deux types ont leur place dans l'écosystème MLOps, le calcul étant effectué à plusieurs couches. Alors que des tâches plus simples peuvent être exécutées efficacement sur les appareils, les tâches plus gourmandes en ressources peuvent être déchargées vers les serveurs. Le choix du déploiement dépend du cas d'utilisation spécifique, une approche hybride étant préconisée, plutôt que de favoriser un côté par rapport à l'autre.

Dans sa quête de durabilité à long terme, la communauté MLOps doit examiner attentivement le caractère pratique et les avantages des grands modèles par rapport aux modèles affinés. Trouver un équilibre et tirer parti des points forts de chaque approche façonnera l'avenir du développement et du déploiement de modèles d'IA, garantissant ainsi des progrès continus dans ce domaine.

📌

Comparaison des performances : modèles linguistiques volumineux et versions plus petites

Un autre aspect discuté au sein de la communauté MLOps est la comparaison des performances entre les grands modèles linguistiques et leurs homologues plus petits. Les grands modèles ont tendance à exceller dans des tâches telles que la création de blogs ou de poèmes, mettant en valeur leurs capacités impressionnantes. Cependant, les modèles plus petits ont souvent du mal à égaler leurs performances, en particulier lorsqu'il s'agit de petits ensembles de données.

Il est important d'examiner minutieusement les méthodes d'évaluation et les tests étayant de telles allégations afin de garantir des comparaisons précises. Tout en reconnaissant l'existence de cas d'utilisation et d'approches d'évaluation différents, il est essentiel de bien comprendre les limites et les différences de performance entre les grands et les petits modèles.

La nécessité d'améliorer le suivi des expériences et d'accéder à une documentation dans LLMOPs

À mesure que le domaine de l'apprentissage automatique progresse, l'importance d'un outillage robuste, y compris des frameworks MLOps, devient évidente. Cependant, avec l'essor des LLMOP (Large Language Model Operations), il existe un besoin spécifique d'outils personnalisés pour aider les développeurs travaillant avec des LLM. Dans cette discussion, l'accent est mis sur les leçons apprises et les recommandations pour le suivi des expériences et la documentation accessible dans LLMOP.

En réfléchissant au parcours d'apprentissage, il devient évident qu'une documentation appropriée des expériences est essentielle. Au départ, l'accent n'était pas mis sur la tenue d'un journal de formation ou d'un système de suivi structuré, ce qui a entraîné des difficultés lors des expériences. En particulier dans le cadre du projet de réglage de LoRa, la gestion de nombreux hyperparamètres est devenue fastidieuse sans une approche systématique pour suivre les valeurs et les sorties correspondantes.

Reconnaissant la valeur d'une documentation complète, la nécessité d'un journal de formation fiable ou d'un système de suivi intégré devient évidente. Malheureusement, les solutions facilement disponibles étaient rares, ce qui compliquait la recherche d'un outil adapté. Cependant, la découverte de Weights & Biases (wandb.ai), une start-up proposant des outils de suivi et de visualisation des expériences, s'est révélée bénéfique. En recommandant ces outils à d'autres, il est reconnu que leur intégration plus tôt dans le processus aurait pu améliorer la gestion des expériences.

En outre, l'importance d'une documentation accessible au sein de la communauté de l'apprentissage automatique est soulignée. Le manque d'informations sur les hyperparamètres et leurs effets a entravé la compréhension et l'optimisation des expériences.

Répondre aux problèmes de sécurité des données dans les MLOps : garantir la confidentialité et la confiance

La sécurité des données est une préoccupation majeure dans le domaine des MLOP, car elle soulève des questions et suscite des discussions au sein de la communauté. En explorant cette question cruciale, examinons l'approche adoptée par Open AI, ainsi que la perspective plus large de la confidentialité des données.

La position d'Open AI en matière de confidentialité des données est considérée comme raisonnable, en particulier pour les consommateurs utilisant des services tels que ChatGPT. Étant donné que ChatGPT est proposé en tant que produit gratuit, les utilisateurs trouvent de la valeur dans la plateforme, justifiant l'échange de leurs données pour améliorer les modèles. Cela est considéré comme un compromis équitable, les utilisateurs participant volontiers à leurs conversations pour améliorer le service, compte tenu de la nature gourmande en ressources de l'exploitation de telles plateformes.

Pour les abonnés de ChatGPT Plus qui paient des frais mensuels, la possibilité de refuser l'utilisation des données est disponible. Cependant, ce choix a pour conséquence la perte de l'historique des conversations. Cependant, compte tenu du prix abordable de l'abonnement et de l'immense valeur dérivée du service, les utilisateurs considèrent généralement ce compromis comme raisonnable. Ils se disent satisfaits de l'arrangement, sachant que leurs données contribuent à améliorer le modèle tout en subventionnant les coûts.

Les entreprises qui cherchent à tirer parti des modèles d'IA pour des cas d'utilisation spécifiques ont des exigences uniques en matière de sécurité des données. Open AI a déjà pris des mesures pour répondre à ces préoccupations par le biais de partenariats, tels que Secure Enclave de Microsoft Azure. Ces collaborations fournissent des environnements sécurisés dans lesquels les données restent sous le contrôle de l'entreprise. En outre, des partenariats tels que l'intégration d'Anthropic à AWS Bedrock offrent des enclaves sécurisées pour l'exécution de modèles cloud, apaisant ainsi les inquiétudes concernant la sortie des données sur site. Ces évolutions du secteur sont sur le point d'offrir des solutions adaptées aux entreprises axées sur la sécurité des données.

La résolution des problèmes de confidentialité et de sécurité des données nécessite les efforts collectifs d'entreprises telles qu'Open AI, Azure et d'autres acteurs majeurs. Par exemple, Google, grâce à ses capacités internes, est bien placé pour répondre efficacement à ces préoccupations. Il est important d'adopter une perspective équilibrée en matière de confidentialité des données, en reconnaissant que des entreprises réputées peuvent établir un climat de confiance avec leurs clients, qui peuvent être disposés à échanger une partie de la confidentialité contre la valeur apportée par les services d'IA.

La puissance et le potentiel des plugins OpenAI

Les plugins OpenAI constituent un développement révolutionnaire qui met en valeur la véritable puissance et le potentiel des modèles de langage d'IA. En plongeant dans le concept des plugins, il devient évident à quel point ils sont remarquables en ce qu'ils permettent d'interagir avec le modèle sans avoir besoin d'écrire du code. Au lieu de cela, l'accent est mis sur l'utilisation des compétences de communication en anglais pour enseigner efficacement le modèle. Cette prise de conscience peut être un moment époustouflant pour les développeurs comme pour les personnes non techniques.

Les plugins visent à fournir des instructions au modèle d'IA en anglais, en particulier en ce qui concerne les descriptions et les déclencheurs des API. En élaborant un document d'une page détaillant le schéma et les spécifications de l'API, les utilisateurs peuvent communiquer efficacement quand et comment déclencher leur plug-in. Cela souligne l'importance de solides compétences linguistiques en anglais pour exploiter les capacités de ChatGPT.

Cette approche innovante a conduit à des comparaisons avec des recherches antérieures, telles que l'article de Toolformer, mettant en évidence que des problèmes similaires ont été explorés dans le passé. Cependant, les modèles de langage d'OpenAI, en particulier le ChatGPT, présentent des avancées significatives en termes de qualité et de performances par rapport aux modèles open source existants.

La disparité de qualité provient principalement de la compétence du modèle linguistique de base en matière de tâches liées au codage. ChatGPT excelle dans la gestion des instructions liées au code, ce qui se traduit par sa capacité à envoyer et à utiliser efficacement les plugins. Il met en évidence le rôle essentiel de la compétence du modèle sous-jacent dans les tâches de codage lors de la mise en œuvre efficace des plugins.

Alors qu'OpenAI détient actuellement une avance importante en termes de qualité, il est essentiel de donner aux modèles open source le temps de rattraper leur retard. La communauté open source s'efforce en permanence de combler le fossé et d'améliorer les capacités de ses modèles. Le fait qu'OpenAI reconnaisse le potentiel des modèles open source et explore des pistes telles que les capacités multimodales est encourageant. La récente interview de Sam Altman avec Lex Friedman met en lumière le point de vue d'OpenAI, indiquant que l'accent est mis de plus en plus sur les facteurs de différenciation plutôt que sur une course aux paramètres.

À mesure que les modèles open source évoluent et atteignent le niveau de GPT-3.5 et 4, il est raisonnable de s'attendre à la disponibilité de fonctionnalités de plug-in dans les frameworks open source également. Les progrès dans ce domaine sont prometteurs pour l'avenir, où les modèles et plugins open source peuvent révolutionner la façon dont les développeurs interagissent avec les systèmes d'IA.

La puissance des modèles de langage dans le flux de restauration et l'adaptation des plugins

L'essor des modèles linguistiques, tels que le GPT d'OpenAI, a placé l'anglais au premier plan en tant que nouveau langage de programmation à bien des égards. L'utilisation de l'anglais pour enseigner les modèles d'IA et déclencher des plugins a ouvert de nouvelles possibilités aux développeurs.

En ce qui concerne les plugins, l'accent n'est pas mis sur la microgestion de leur utilisation, mais plutôt sur la manière de les utiliser efficacement. En fournissant des instructions sur l'utilisation des plugins, les développeurs permettent au modèle d'IA de déterminer les moments appropriés pour déclencher les plugins. Cependant, il est important de noter que l'implémentation actuelle présente des limites, telles que l'activation de trois plugins uniquement à la fois et des erreurs occasionnelles lors du déclenchement des plugins.

Néanmoins, la puissance des modèles linguistiques réside dans leur flux de reprise. Même lorsque le modèle ne comprend pas ou ne déclenche pas correctement un plugin au départ, l'expérience utilisateur reste positive. Contrairement aux assistants vocaux traditionnels comme Alexa, qui nécessitent des commandes explicites et précises, les modèles de langage tels que ChatGPT offrent une expérience différente.

Avec ChatGPT, si le modèle échoue, les utilisateurs peuvent fournir en toute confiance des instructions de suivi explicites pour corriger l'erreur. La compréhension et la réactivité du modèle créent un sentiment de confiance et de collaboration. Les utilisateurs ont le sentiment que leurs instructions seront prises en compte et suivies. La capacité de récupération des modèles linguistiques change la donne par rapport à celle des assistants de l'ancienne génération, ce qui a souvent entraîné de la frustration et de la déception.

La puissance des modèles de langage, en particulier lorsqu'ils sont combinés à des plugins, réside dans leur capacité à corriger les erreurs de manière fluide. Les utilisateurs apprécient la reconnaissance de la confusion par le modèle, ses excuses polies et sa volonté de corriger l'erreur. Ce niveau de récupération et d'adaptabilité est sans précédent dans les technologies d'assistance précédentes, malgré les progrès réalisés dans les systèmes de dialogue multitours.

L'architecture des modèles de langage permet un niveau de restauration phénoménal, ce qui en fait une plate-forme idéale pour l'intégration de plugins. L'intégration et la collaboration fluides entre les développeurs et le modèle améliorent l'expérience utilisateur globale. Alors que les développeurs explorent le potentiel des plugins au sein de cette architecture, les possibilités de créer des systèmes d'IA dynamiques et adaptables sont vastes.

Les modèles de langage servant de base aux interactions pilotées par l'IA, le flux de restauration et l'adaptation des plugins deviennent des éléments essentiels pour créer des systèmes avancés et conviviaux. La combinaison de la compréhension du langage naturel et de la réactivité positionne les modèles linguistiques comme des outils de transformation dans le paysage MLOps.

📌

Acheter des GPU pour les MLOP : défis et achats impulsifs

L'accès à des GPU hautes performances via des fournisseurs de cloud est frustrant pour les amateurs. La hiérarchisation des priorités des entreprises et les engagements à long terme constituent des défis.

L'accès au GPU basé sur le cloud prend du temps pour les amateurs qui ont besoin de peu de temps sur le GPU. La configuration d'un GPU personnel est un véritable défi, notamment en ce qui concerne la configuration manuelle et la gestion des dépendances.

Malgré la commodité des images GPU préconfigurées dans le cloud, Anant apprécie le contrôle et la fiabilité de son GPU personnel. Surmontant les défis, sa décision d'acheter un GPU dédié s'est révélée bénéfique pour les MLOps.

Rester informé : l'approche d'Anant Narayanan pour rester au fait des nouveaux développements

- Twitter : utilisez Twitter comme centre de connaissances pour les mises à jour liées à l'IA. Suivez les experts et les organisations de la communauté de l'IA pour découvrir rapidement les nouveaux développements et rester informés.

- Podcasts : écoutez les podcasts du secteur pour obtenir des informations précieuses. Les podcasts recommandés incluent « Stratechery » de Ben Thompson et « Dithering » co-animé par Ben Thompson et John Gruber. Ces podcasts couvrent un large éventail de sujets liés à la technologie, y compris les avancées de l'IA.

- Interactions hors ligne : participez à des événements et à des rassemblements en personne pour obtenir des informations et des points de vue précieux. Recherchez la liste complète des événements sur des plateformes telles que cerebralvalley.ai. Engagez-vous dans des interactions en face à face, participez à des hackathons et échangez des idées avec d'autres professionnels pour élargir vos connaissances et établir des liens significatifs.

Lisez nos précédents articles de la série True ML Talks :

Continuez à regarder le TrueML série youtube et en lisant le TrueML série de blogs.

True Foundry est un PaaS de déploiement de machine learning sur Kubernetes destiné à accélérer les flux de travail des développeurs tout en leur offrant une flexibilité totale dans les tests et le déploiement de modèles, tout en garantissant une sécurité et un contrôle complets à l'équipe Infra. Grâce à notre plateforme, nous permettons aux équipes de machine learning de déployer et surveiller des modèles en 15 minutes avec une fiabilité à 100 %, une évolutivité et la possibilité de revenir en arrière en quelques secondes, ce qui leur permet de réduire les coûts et de mettre les modèles en production plus rapidement, ce qui permet de réaliser une véritable valeur commerciale.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)