Les 5 meilleures alternatives à l'hélicoptère

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

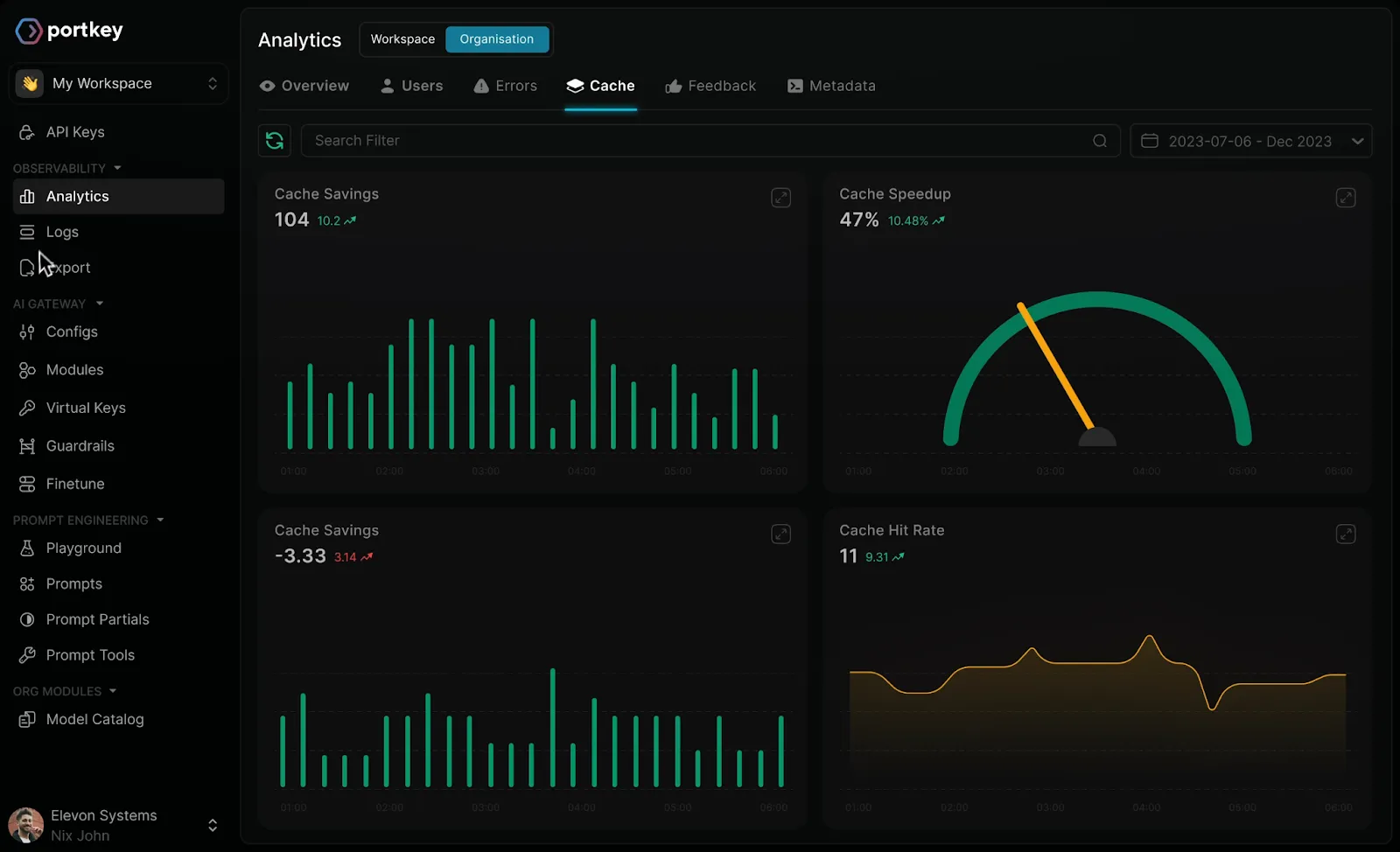

L'essor des grands modèles linguistiques a transformé la façon dont les équipes conçoivent des produits pilotés par l'IA, mais il a également introduit de nouveaux défis. Les développeurs doivent surveiller les performances des modèles, optimiser les coûts, affiner les instructions et garantir la fiabilité à grande échelle. La gestion de toutes ces pièces mobiles nécessite une visibilité et un contrôle sur chaque appel et réponse d'API.

Helicone est apparu pour résoudre exactement ce problème. Il fournit une plate-forme unifiée pour suivre, analyser et optimiser les requêtes adressées à des modèles de langage tels qu'OpenAI ou Anthropic, aidant ainsi les équipes à déboguer plus rapidement et à réduire les frais opérationnels.

Cependant, à mesure que les organisations évoluent, leurs exigences dépassent souvent celles proposées par Helicone. Certains ont besoin d'analyses plus approfondies, d'un déploiement sur site ou d'un contrôle renforcé de la confidentialité des données. D'autres recherchent des outils offrant une plus grande flexibilité ou une logique de routage avancée.

C'est là que des alternatives comme True Foundry entrez. Conçu pour les opérations d'IA d'entreprise, TrueFoundry Passerelle IA et Passerelle MCP offrez une visibilité complète, un routage multimodèle et une infrastructure axée sur la conformité, afin d'aider les équipes à adapter l'utilisation des modèles de manière sûre et efficace.

Dans ce guide, nous allons découvrir ce qu'est Helicone, comment il fonctionne, pourquoi les équipes recherchent des alternatives, et nous passerons en revue les 5 meilleures alternatives à Helicone pour vous aider à choisir la solution adaptée à votre infrastructure d'IA.

Qu'est-ce que Helicone ?

Helicone est une plateforme open source d'observabilité et de surveillance LLM conçue pour donner aux développeurs un contrôle et une visibilité complets sur leurs applications d'IA. Il s'agit d'une passerelle performante qui connecte votre application aux principaux fournisseurs de modèles linguistiques tels qu'OpenAI, Anthropic, Google Gemini, Together AI et bien d'autres, le tout via une interface unifiée unique.

Dans un écosystème d'IA en évolution rapide, la visibilité et la traçabilité sont essentielles. Helicone simplifie les opérations LLM en capturant automatiquement chaque détail d'une demande, qu'il s'agisse des invites et des réponses, de l'utilisation des jetons, de la latence et des coûts. Cette centralisation élimine la nécessité d'un suivi manuel sur plusieurs API et aide les équipes à détecter les problèmes, à améliorer les performances et à optimiser le comportement des modèles avec précision.

Principales caractéristiques d'Helicone

- Journalisation et analyse centralisées : Helicone enregistre toutes les interactions avec les API en temps réel, fournissant aux développeurs un tableau de bord unifié pour surveiller les performances, les coûts et la latence des différents fournisseurs de modèles.

- Routage intelligent et facturation directe : Grâce à son AI Gateway, Helicone achemine les demandes vers le modèle le plus adapté en fonction de paramètres de performance ou de coût. Il prend en charge la facturation directe, permettant d'accéder à plus de 100 modèles via une API sans aucune majoration.

- Outils de débogage et de traçage : Les développeurs peuvent suivre des flux de travail de modèles complexes en plusieurs étapes, visualiser les interactions et identifier instantanément les défaillances. Cette fonctionnalité est essentielle pour maintenir la fiabilité des systèmes d'IA de production.

- Déploiement sécurisé et flexible: Helicone propose à la fois un hébergement cloud et des options d'auto-hébergement via Helm Charts, conformément aux normes de conformité de niveau entreprise telles que SOC 2 et HIPAA.

Au-delà de ses fonctionnalités de base, Helicone a construit une solide communauté open source. Avec plus de 4 000 étoiles sur GitHub et des contributions de centaines de développeurs, il continue de croître rapidement. L'accent mis par la communauté sur la transparence et l'extensibilité en fait un choix fiable pour les ingénieurs en IA qui recherchent la fiabilité sans être dépendants d'un fournisseur.

Que votre objectif soit d'améliorer la fiabilité des modèles, de réduire les coûts opérationnels ou d'améliorer l'observabilité en temps réel de votre stack d'IA, Helicone fournit l'infrastructure nécessaire pour créer, surveiller et faire évoluer des applications intelligentes en toute confiance.

Comment fonctionne Helicone ?

Helicone fait office de passerelle API unifiée qui connecte votre application à plus de 100 fournisseurs de modèles linguistiques. En acheminant les demandes via Helicone, les développeurs peuvent simplifier les intégrations, améliorer l'observabilité et optimiser les performances des modèles sans modifications majeures du code.

Intégration fluide

L'intégration d'Helicone est simple. Les développeurs peuvent configurer leurs SDK OpenAI ou autres SDK LLM existants pour qu'ils pointent vers le point de terminaison de la passerelle d'Helicone :

const client = new OpenAI({

apiKey: process.env.HELICONE_API_KEY,

baseURL: "https://ai-gateway.helicone.ai"

});

Cette approche permet aux applications d'interagir avec plusieurs fournisseurs de LLM à l'aide d'une interface cohérente, ce qui réduit la complexité de la gestion des diverses API.

Observabilité complète

Helicone enregistre automatiquement des métadonnées détaillées pour chaque demande, ce qui donne aux développeurs un aperçu en temps réel de leurs flux de travail d'IA. Les données enregistrées incluent :

- Contenu rapide et réactif

- Utilisation des jetons et coûts associés

- Temps de réponse et latence des modèles

- Taux d'erreur et modèles de nouvelles tentatives

Toutes ces informations sont disponibles via un tableau de bord centralisé, permettant aux équipes de suivre les performances, d'identifier les goulots d'étranglement et d'analyser efficacement les tendances d'utilisation.

Routage et basculement intelligents

Helicone inclut un moteur de routage intelligent qui optimise la livraison des demandes. Les fonctionnalités clés sont les suivantes :

- Acheminement des demandes vers le modèle le plus adapté en fonction du coût, des performances et de la disponibilité

- Basculement automatique vers d'autres fournisseurs en cas d'erreur ou de panne

- Prise en charge de la facturation directe et des configurations Bring Your Own Keys (BYOK)

Ce système de routage garantit une fiabilité élevée et des performances constantes dans différents scénarios de déploiement.

Mise en cache Edge pour optimiser les performances

Pour réduire la latence et les coûts d'API, Helicone propose une mise en cache périphérique. Les réponses fréquemment demandées sont stockées en périphérie, ce qui permet de les récupérer plus rapidement et de minimiser les appels d'API redondants, ce qui améliore à la fois la vitesse et la rentabilité.

Options de déploiement flexibles

Helicone prend en charge les déploiements hébergés dans le cloud et les déploiements auto-hébergés :

- Hébergé dans le cloud : Géré par Helicone, offrant évolutivité et facilité d'utilisation

- Auto-hébergé : Déployable via les cartes Helm, offrant aux entreprises un contrôle total de l'infrastructure et des données

Les deux options de déploiement sont conformes aux normes d'entreprise, notamment SOC 2 et HIPAA, ce qui les rend adaptées aux environnements sécurisés et réglementés.

Pourquoi explorer les alternatives à Helicone ?

Helicone fournit une observabilité, un routage et une journalisation complets pour les applications LLM, mais il se peut qu'il ne réponde pas aux exigences spécifiques de chaque organisation. Les équipes envisagent souvent des alternatives pour remédier aux limites de flexibilité, de structure de coûts ou de fonctionnalités spécialisées, en particulier lors de l'évaluation des compromis abordés dans Helicone contre Portkey comparaisons.

L'une des raisons d'explorer des alternatives est la diversité et le contrôle des modèles. Helicone prend en charge plus de 100 modèles, mais certaines organisations peuvent avoir besoin d'intégrations natives avec des LLM de niche ou propriétaires qui ne sont pas entièrement pris en charge. D'autres solutions peuvent permettre une intégration plus facile avec ces modèles ou une logique de routage plus avancée.

Les principaux éléments à prendre en compte pour explorer des solutions de rechange sont notamment

- Prise en charge de modèles plus étendue : Accès à des modèles extérieurs à l'écosystème d'Helicone.

- Routage avancé : Contrôle granulaire de la distribution des demandes et du basculement.

- Flexibilité de déploiement : Auto-hébergement amélioré, déploiement multirégional ou stratégies de mise en cache personnalisées.

- Optimisation des coûts : Différents modèles de tarification ou efficacité améliorée pour une utilisation à volume élevé.

- Analyses améliorées : Tableaux de bord personnalisés, détection des anomalies en temps réel et alertes personnalisées.

La flexibilité de personnalisation et de déploiement constitue un autre facteur. Helicone prend en charge l'auto-hébergement via les graphiques Helm, mais certaines équipes ont besoin d'un contrôle plus approfondi des stratégies de mise en cache, des formats de journalisation ou des déploiements multirégionaux. Les considérations de coût et d'évolutivité guident également l'évaluation. Helicone propose une facturation directe, mais les entreprises confrontées à un volume de demandes élevé ou à des contraintes budgétaires strictes peuvent bénéficier d'outils qui optimisent davantage l'utilisation.

L'exploration des alternatives d'Helicone aide les entreprises à trouver des solutions mieux adaptées à leurs besoins techniques, à leurs objectifs opérationnels et à leurs considérations de coûts, tout en maintenant une observabilité et une fiabilité robustes du LLM.

Les 5 meilleures alternatives à l'hélicoptère

Helicone offre une observabilité et un routage puissants pour les applications LLM, mais il se peut qu'il ne réponde pas aux besoins spécifiques de chaque équipe. Les développeurs explorent souvent des alternatives pour gagner en flexibilité, améliorer les analyses ou intégrer des solutions spécialisées.

Les cinq plateformes suivantes proposent des options fiables pour la surveillance, le suivi et l'optimisation de grands modèles de langage, chacune présentant des atouts uniques adaptés à différents flux de travail.

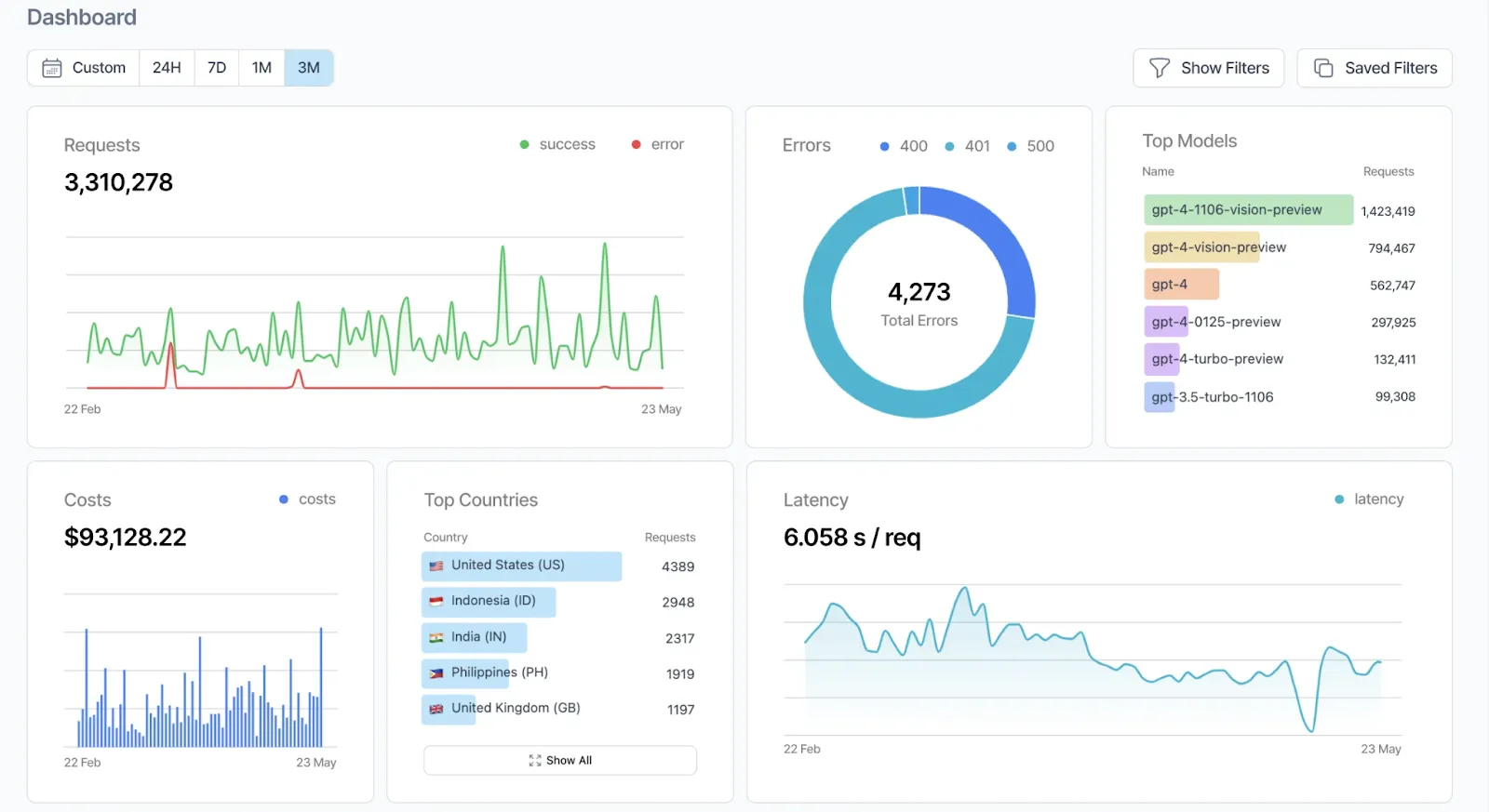

1. True Foundry

True Foundry fournit une infrastructure unifiée pour créer, déployer et gérer des applications d'IA à grande échelle. Il propose des outils pour orchestrer les agents d'IA, gérer les déploiements de modèles et garantir la sécurité et la conformité dans différents environnements.

Les principaux composants de la plateforme comprennent la passerelle AI, les serveurs MCP (Model Control Protocol) et les fonctionnalités de traçage, chacun étant conçu pour relever des défis spécifiques en matière de développement et de déploiement d'applications d'IA.

Principales caractéristiques de TrueFoundry

- Passerelle IA: Agit comme un plan de contrôle centralisé, permettant une communication sécurisée et efficace entre les applications et les modèles d'IA. Il prend en charge des fonctionnalités telles que les interfaces API unifiées, le contrôle d'accès, la limitation du débit et l'observabilité.

- Serveurs MCP: Facilitez l'interaction entre les agents d'IA et les outils ou services externes. TrueFoundry permet le déploiement de serveurs MCP dédiés pour gérer le trafic des agents, appliquer des politiques et adapter l'accès aux modèles.

- Traçage : Fournit une observabilité de bout en bout en suivant chaque étape, de la saisie de l'utilisateur à la réponse de l'agent. Cela inclut le suivi des instructions des utilisateurs, des messages système, des entrées d'outils, des appels LLM et des décisions relatives au flux de travail.

- Sécurité et conformité : Garantit la protection des données et la conformité aux normes telles que SOC 2, HIPAA et GDPR. Les fonctionnalités incluent le contrôle d'accès basé sur les rôles (RBAC), la journalisation des audits et les mesures de sécurité d'exécution.

- Flexibilité de déploiement : Prend en charge diverses options de déploiement, notamment les environnements sur site, de cloud privé virtuel (VPC), de cloud isolé, hybride ou public, offrant un contrôle complet des données et de l'infrastructure.

TrueFoundry est une plateforme d'entreprise de premier plan car elle unifie le déploiement, l'observabilité et la gouvernance de l'IA dans une seule solution évolutive. Ses fonctionnalités avancées, telles que la passerelle AI, les serveurs MCP et le traçage de bout en bout, offrent aux entreprises un contrôle, une sécurité et une transparence complets, ce qui en fait la solution idéale pour gérer des applications d'IA complexes à grande échelle.

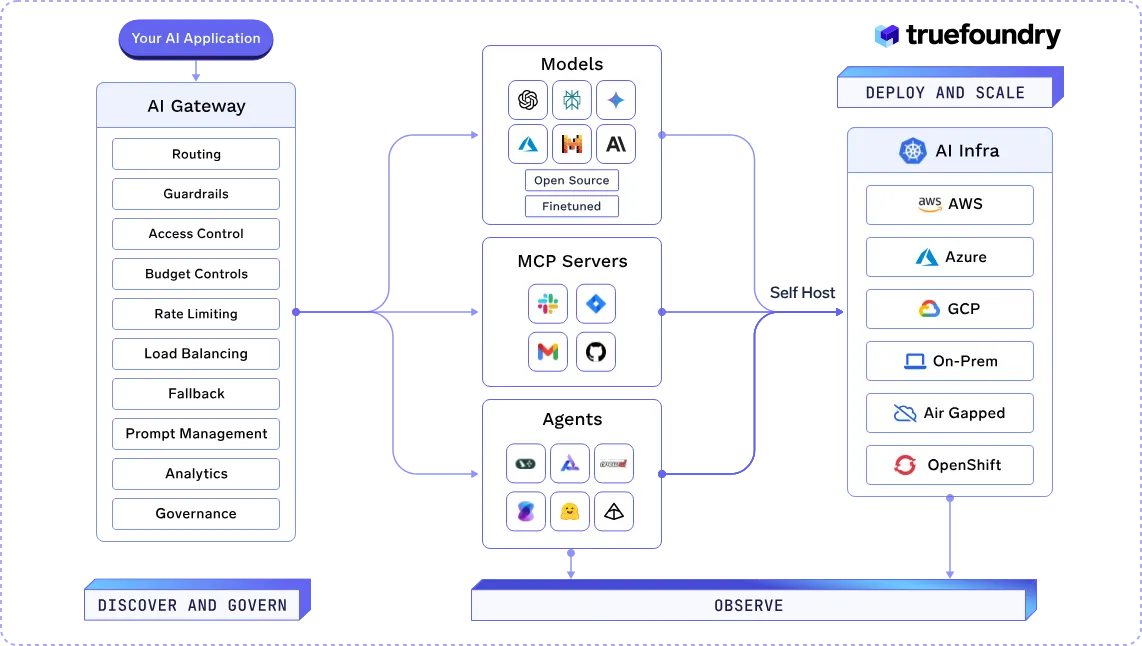

2. Clé de port

Portkey est une passerelle d'IA open source conçue pour rationaliser la façon dont les organisations interagissent avec plusieurs modèles linguistiques. Au lieu de gérer des API distinctes pour chaque fournisseur, les développeurs peuvent utiliser Portkey comme interface unique pour envoyer des requêtes, surveiller les performances et acheminer le trafic de manière efficace.

Cela simplifie les flux de travail et réduit les frais liés à l'intégration et à la maintenance simultanées de plusieurs modèles.

Au-delà de la connectivité de base, Portkey propose des fonctionnalités de routage intelligentes qui permettent de diriger automatiquement les demandes vers le modèle le plus adapté en fonction des performances, du coût ou de règles prédéfinies. Ceci est souvent discuté entre les équipes lors de la comparaison alternatives à Portkey. Il prend également en charge les mécanismes de repli et les nouvelles tentatives, garantissant ainsi la fiabilité même en cas de latence ou d'indisponibilité de certains terminaux. L'observabilité est intégrée à la plateforme, avec des mesures détaillées sur les taux de réussite des demandes, la latence et les modèles d'utilisation.

Caractéristiques principales :

- Accès API unifié à plusieurs modèles d'IA

- Mécanismes avancés de routage et de repli pour plus de fiabilité

- Observabilité complète des demandes, des performances et des coûts

Inconvénients :

- Configuration complexe pour des fonctionnalités avancées

- Utilisation intensive de ressources lors de l'exécution simultanée de plusieurs modèles

3. Traceloop (OpenLLMetry)

OpenLLmetry de Traceloop est un framework d'observabilité open source basé sur OpenTelemetry, conçu pour la surveillance et le débogage d'applications de grands modèles de langage. Il fournit des informations détaillées sur les interactions et les performances des modèles, facilitant ainsi un dépannage et une optimisation efficaces.

Caractéristiques principales :

- Intégration d'OpenTelemetry pour les pipelines d'observabilité existants

- Suivi distribué pour une analyse des flux de travail de bout en bout

- Collecte de métriques pour identifier les goulots d'étranglement et évaluer l'efficacité

Inconvénients :

- Nécessite une connaissance des concepts d'OpenTelemetry

- Tableaux de bord prêts à l'emploi limités ; une visualisation personnalisée est souvent nécessaire

4. Lang Smith

LangSmith, développé par la communauté LangChain, est une plateforme unifiée d'observabilité et d'évaluation pour les applications de modèles de langage de grande envergure. Il propose des outils pour suivre, surveiller et analyser les flux de travail d'IA, améliorant ainsi le débogage et l'optimisation des performances.

Caractéristiques principales :

- Suivi et surveillance des étapes du flux de travail de l'IA

- Outils d'évaluation pour garantir la qualité et la cohérence des résultats

- Intégration fluide avec les applications LangChain

Inconvénients :

- Principalement optimisé pour LangChain ; moins flexible pour les autres frameworks

- Courbe d'apprentissage pour les nouveaux utilisateurs

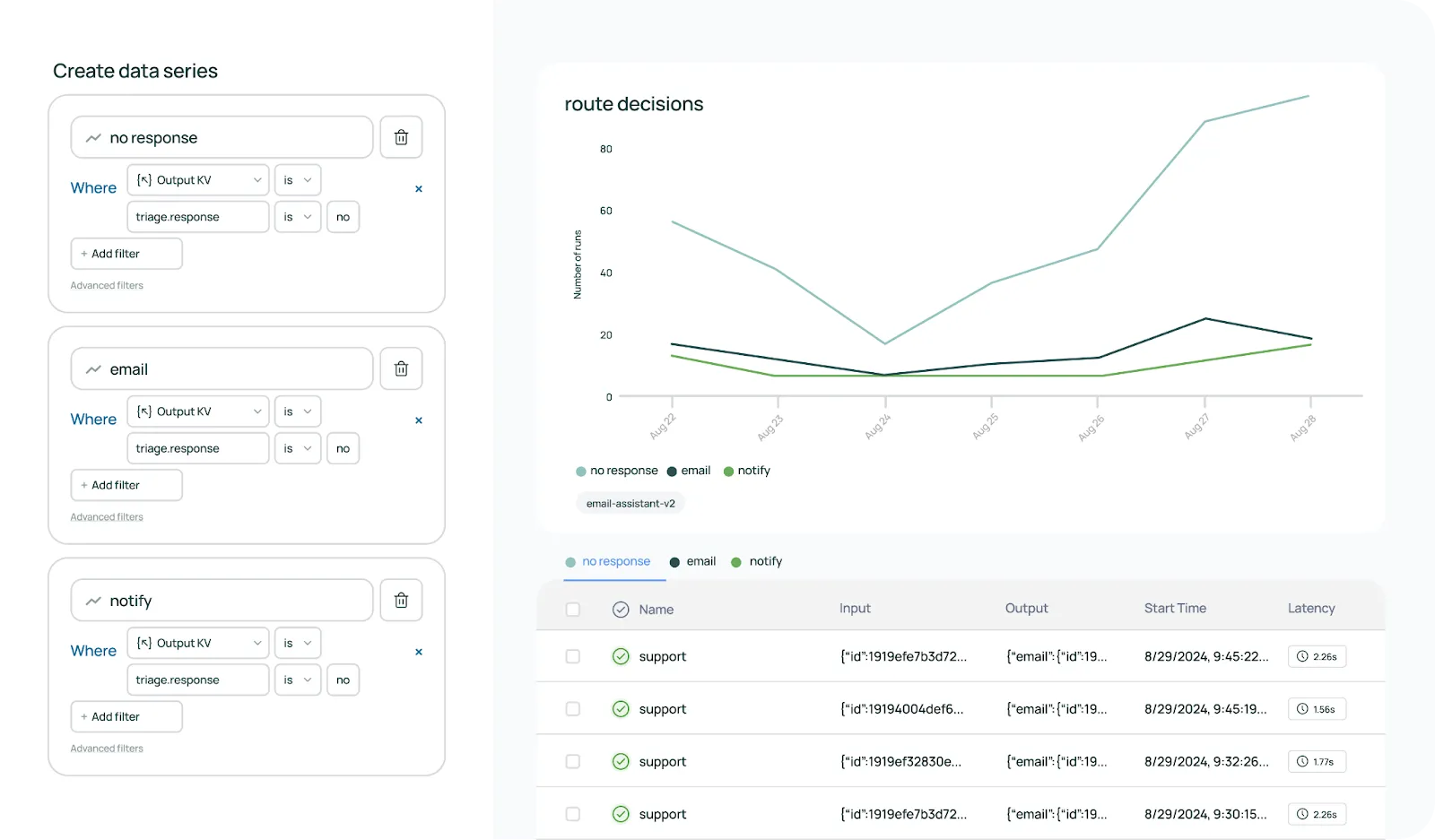

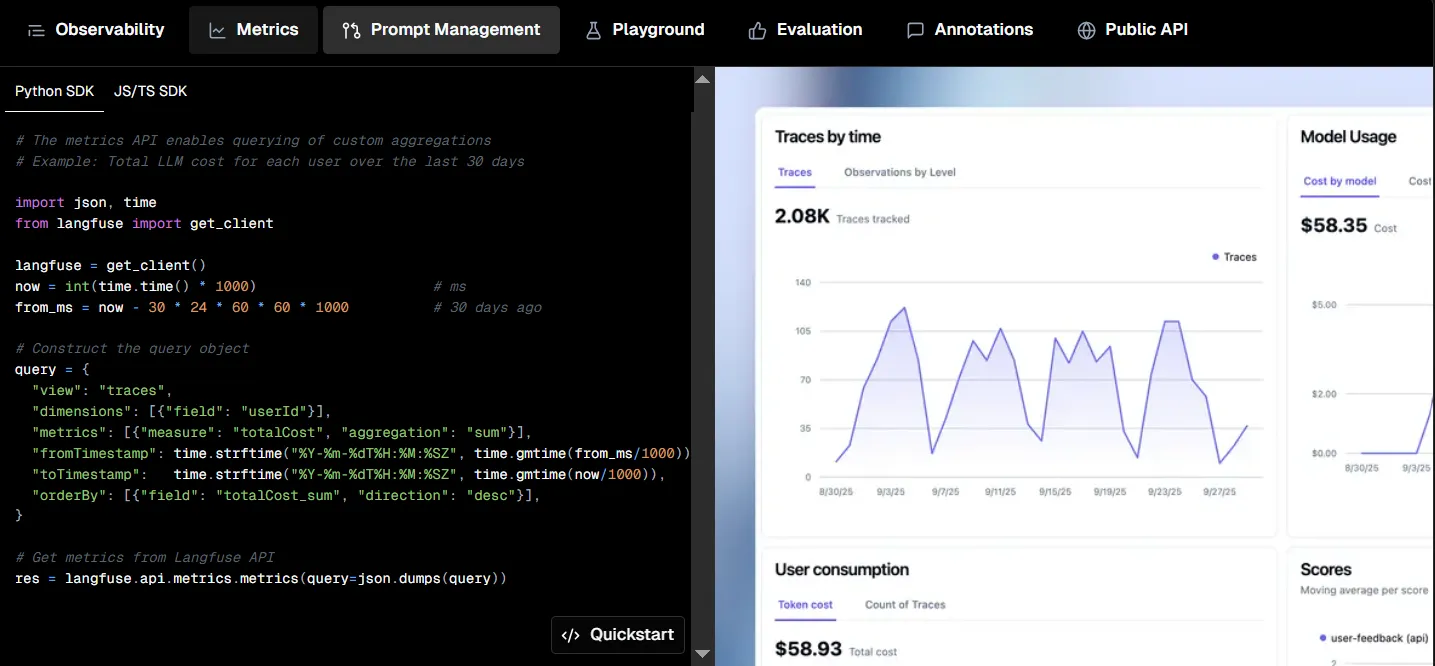

5. Langfuse

Langfuse est une plateforme open source axée sur l'observabilité et l'analyse pour les applications de grands modèles linguistiques. Il permet aux équipes de suivre, d'analyser et d'optimiser les flux de travail d'IA, en fournissant des informations détaillées sur les interactions et les performances des modèles.

Caractéristiques principales :

- Enregistrement des traces des entrées, des sorties et des étapes intermédiaires

- Outils d'analyse pour les mesures de performance, d'utilisation et de coûts

- Support collaboratif pour le débogage et l'optimisation en équipe

Inconvénients :

- Nécessite un auto-hébergement

- Visualisations intégrées limitées ; des outils externes peuvent être nécessaires

Conclusion

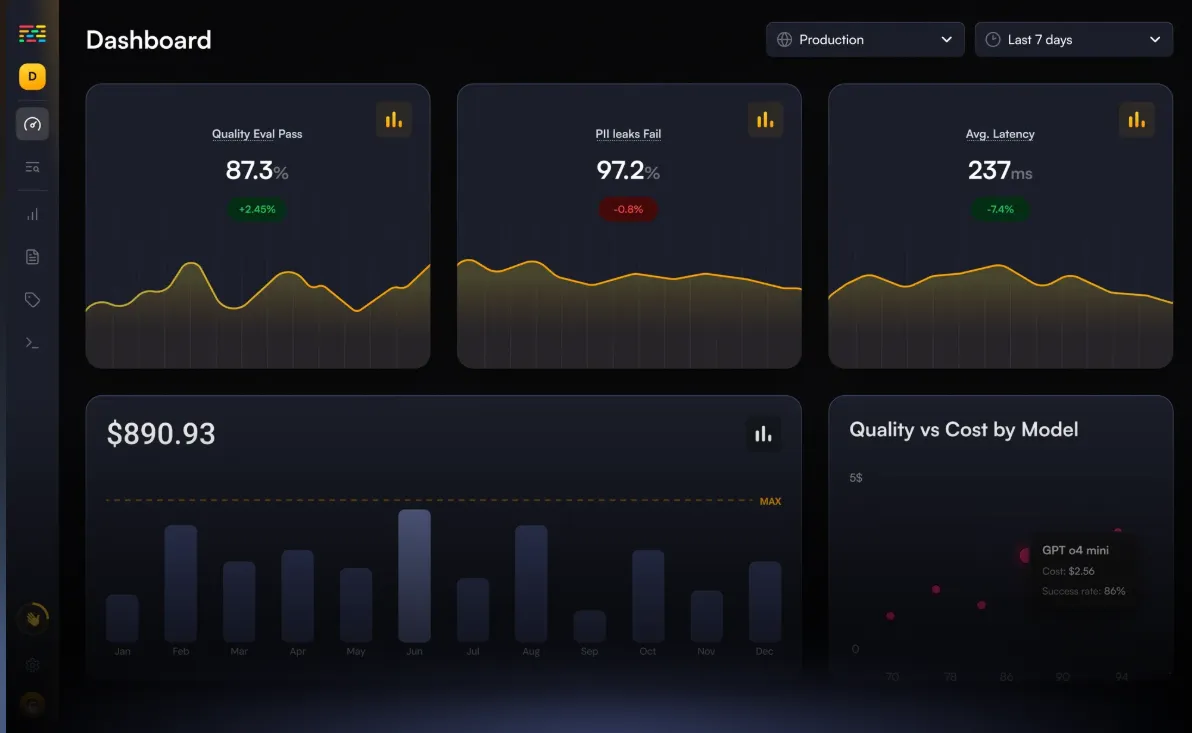

Helicone propose une puissante plateforme open source pour l'observabilité, le routage et l'analyse LLM, ce qui en fait un choix judicieux pour les équipes qui recherchent une surveillance complète des applications d'IA. Sa capacité à centraliser la journalisation, à suivre l'utilisation des jetons et à fournir des informations sur plusieurs fournisseurs de modèles simplifie les défis opérationnels liés à la création de systèmes fiables basés sur le LLM.

Cependant, à mesure que les applications d'IA deviennent de plus en plus complexes, les entreprises ont souvent besoin de solutions adaptées à des flux de travail, à des environnements de déploiement ou à des besoins d'intégration spécifiques. L'exploration des alternatives proposées par Helicone permet aux équipes de sélectionner des plateformes mieux adaptées à leurs exigences techniques et opérationnelles. TrueFoundry, par exemple, fournit une orchestration, un suivi et une gouvernance de niveau entreprise avec des fonctionnalités avancées d'AI Gateway et de serveur MCP, ce qui en fait la solution idéale pour les organisations qui accordent la priorité à la sécurité, à la conformité et à l'évolutivité.

Portkey excelle dans l'accès unifié aux API et le routage sur divers modèles, tandis que Traceloop offre une observabilité approfondie grâce au traçage basé sur OpenTelemetry. LangSmith propose une évaluation et un débogage spécialement conçus pour les applications LangChain, et Langfuse fournit une journalisation et des analyses détaillées pour une observabilité asynchrone.

Le choix de la bonne plateforme d'observabilité LLM dépend de facteurs tels que la flexibilité du déploiement, la prise en charge des modèles, la profondeur de surveillance et la rentabilité.

En évaluant les fonctionnalités, les points forts et les limites de chaque option, les équipes de développement peuvent mettre en œuvre des systèmes d'IA robustes, transparents et évolutifs qui garantissent les performances, la sécurité et la fiabilité des charges de travail de production réelles.

Questions fréquemment posées

Quelles sont les meilleures alternatives à Helicone ?

Les meilleures alternatives Helicone à l'échelle de l'entreprise incluent TrueFoundry, Portkey et Traceloop. Alors qu'Helicone se concentre sur une observabilité légère, TrueFoundry fournit une infrastructure unifiée avec une passerelle AI intégrée et des fonctionnalités de sécurité. D'autres options remarquables, telles que Langfuse et Lunary, proposent un traçage open source pour les équipes nécessitant des analyses approfondies et des outils d'évaluation spécialisés pour les applications de production.

Pourquoi quelqu'un quitterait-il Helicone ?

Les équipes changent souvent lorsque la surveillance de base des proxys n'est plus suffisante et qu'elles ont besoin d'une gouvernance de niveau professionnel. Helicone est souvent limitée par l'absence d'un RBAC robuste, d'une journalisation des audits et d'une prise en charge approfondie des flux de travail agentiques en plusieurs étapes. Le passage à une plateforme telle que TrueFoundry permet le déploiement au sein d'un VPC privé et fournit des politiques avancées de contrôle des coûts nécessaires à la gestion des systèmes d'IA à l'échelle de la production.

Existe-t-il des alternatives open source à Helicone ?

Oui, plusieurs alternatives open source importantes incluent Portkey, Langfuse et Traceloop. Ces plateformes permettent l'auto-hébergement et une intégration plus approfondie avec les pipelines OpenTelemetry existants. Pour les développeurs à la recherche d'un proxy simple basé sur Python, Litellm est un favori populaire de la communauté qui normalise les appels d'API sur des centaines de modèles sans les frais généraux et les risques liés aux données d'un fournisseur SaaS géré.

Helicone prend-il en charge le routage multimodèle ?

Oui, Helicone prend en charge le routage multimodèle de base et le basculement entre fournisseurs via son API unifiée. Cependant, il ne dispose pas de la logique de routage sophistiquée et sensible aux métadonnées que l'on retrouve dans les passerelles d'entreprise. Des plateformes telles que TrueFoundry étendent cette capacité en permettant aux équipes de définir des chaînes de repli complexes et des quotas au niveau de l'équipe, garantissant ainsi une haute disponibilité pour les fournisseurs de modèles commerciaux et auto-hébergés.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)