Du navigateur à l'invite : créer une infrastructure pour l'Internet des agences

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Les agents d'IA modifient la façon dont les humains interagissent avec le Web. Il y a deux ans, pour travailler en ligne, il fallait ouvrir un navigateur, accéder à des sites Web et effectuer des tâches manuellement. Aujourd'hui, les agents d'IA gèrent cela de manière autonome en fonction d'instructions en langage naturel.

Au lieu d'ouvrir Chrome pour réserver un vol, vous dites à un agent « Trouvez-moi le vol le moins cher pour Tokyo vendredi prochain », et il s'occupe de tout. Nous appelons ce passage d'une navigation pilotée par l'homme à une exécution pilotée par les commandes rapides internet agentique.

La plupart des organisations n'y sont pas prêtes. Étude 2025 de Deloitte a constaté que seulement 14 % disposent de solutions d'IA agentic prêtes à être mises en production. L'écart n'est pas un problème de capacité du modèle ; il s'agit d'un problème d'infrastructure.

Que signifie « navigateur à invite » ?

Les interactions Web traditionnelles suivent un schéma prévisible. Un humain ouvre un navigateur, accède à une URL, interprète visuellement la page et effectue des actions.

Prenons l'exemple d'un flux de travail d'entreprise classique. Vous ouvrez Salesforce et recherchez une fiche client. Vous consultez l'historique de leurs commandes, puis vous ouvrez Zendesk dans un autre onglet pour créer un ticket d'assistance. Vous copiez manuellement les informations entre les systèmes et vous ouvrez Slack pour avertir un collègue. Dix minutes passent. Quinze clics se produisent. Trois onglets du navigateur restent ouverts.

Exécution pilotée par la rapidité

Grâce à l'exécution rapide, vous tapez : « Créez un ticket d'assistance pour Acme Corp concernant son retard d'expédition et incluez ses trois dernières commandes ».

L'agent se connecte à Salesforce via MCP, récupère les données des clients, ouvre Zendesk via un autre serveur MCP, crée le ticket et remplit automatiquement tous les champs. Une seule invite remplace des dizaines de clics. Mais pour que cela fonctionne en production, il faut une infrastructure que les systèmes traditionnels ne fournissent pas.

Pourquoi les infrastructures traditionnelles ne sont pas à la hauteur

L'exécution d'agents d'IA à grande échelle impose des exigences que les systèmes existants n'ont jamais été conçus pour gérer.

Gestion des sessions et des états

L'automatisation traditionnelle des navigateurs fonctionne sans état : chaque exécution de script redémarre à zéro. Les agents exigent le contraire. Un agent d'IA effectuant un flux de travail en plusieurs étapes doit maintenir le contexte de plusieurs interactions avec le système, s'authentifier une seule fois et effectuer cette session via des dizaines d'appels d'outils.

Détection anti-bot

Tous les principaux sites Web déploient des mesures pour bloquer l'accès automatisé, notamment des défis CAPTCHA, la prise d'empreintes digitales du navigateur et l'analyse comportementale. Outils d'automatisation standard tels que Marionnettiste et dramaturge sont détectés immédiatement car ils laissent des signatures automatisées évidentes.

Complexité de l'orchestration des outils

Un agent IA appelle des API, interroge des bases de données, envoie des messages Slack, crée des tickets Jira et met à jour les enregistrements CRM. Chaque intégration nécessite généralement des flux d'authentification personnalisés, un formatage des requêtes/réponses, une gestion des erreurs et une logique de nouvelle tentative. Sans standardisation, les équipes consacrent 80 % de leur temps à la plomberie d'intégration.

Défis liés à l'observabilité

Lorsqu'un agent d'IA échoue, la cause peut être n'importe où. Le modèle a peut-être mal interprété la tâche. La mise en page de la page Web a peut-être changé. Une API a peut-être renvoyé une réponse inattendue. Un jeton d'authentification a peut-être expiré. Sans traçage de bout en bout, le débogage devient quasiment impossible.

MCP : le protocole standard pour la communication agent-outil

Anthropic a présenté le Protocole de contexte modèle (MCP) pour résoudre le problème d'intégration de l'outil. Au lieu d'écrire du code personnalisé pour chaque système, les développeurs intègrent des outils dans des serveurs MCP qui exposent les fonctionnalités via une interface JSON-RPC standardisée.

Comment fonctionne MCP

Lorsqu'un agent se connecte à un serveur MCP, il effectue une poignée de main de découverte. L'agent envoie une demande d'initialisation et le serveur répond en indiquant les fonctionnalités et la version du protocole. L'agent appelle ensuite tools/list pour découvrir les outils disponibles, et le serveur renvoie des schémas d'outils avec des paramètres et des descriptions.

L'agent apprend quels outils sont disponibles au moment de l'exécution, aucun codage en dur n'est requis. Les principaux fournisseurs d'IA, dont Anthropic, OpenAI et Microsoft, ont adopté MCP.

Cependant, MCP gère à lui seul la couche de protocole. Les systèmes de production ont besoin d'une infrastructure supplémentaire pour l'authentification, contrôles d'accès, limitation de débit, et journalisation des audits.

Le modèle de passerelle pour l'IA des agences de production

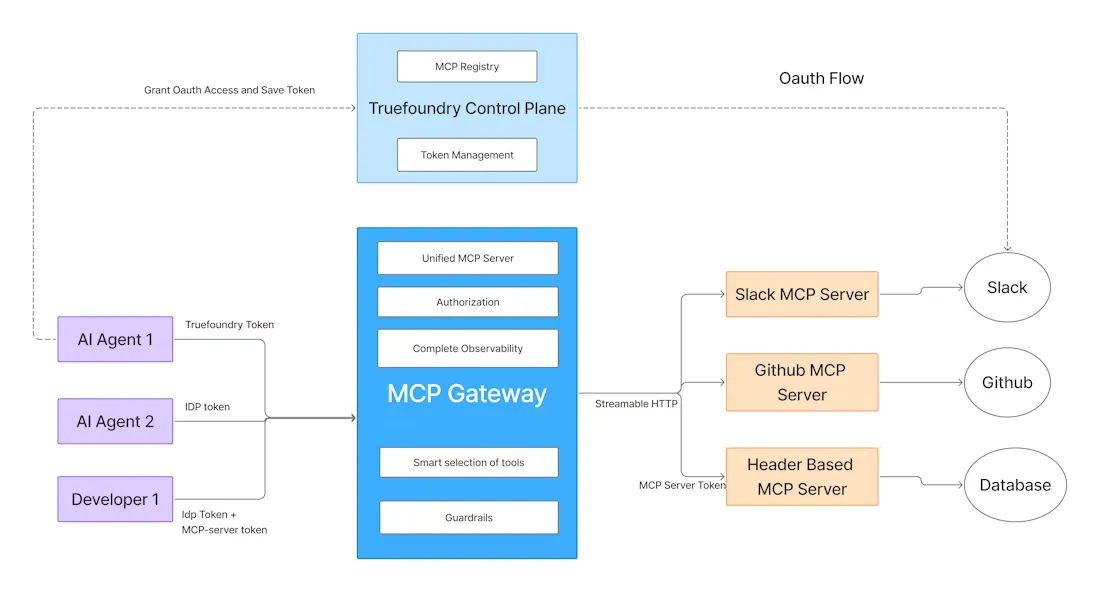

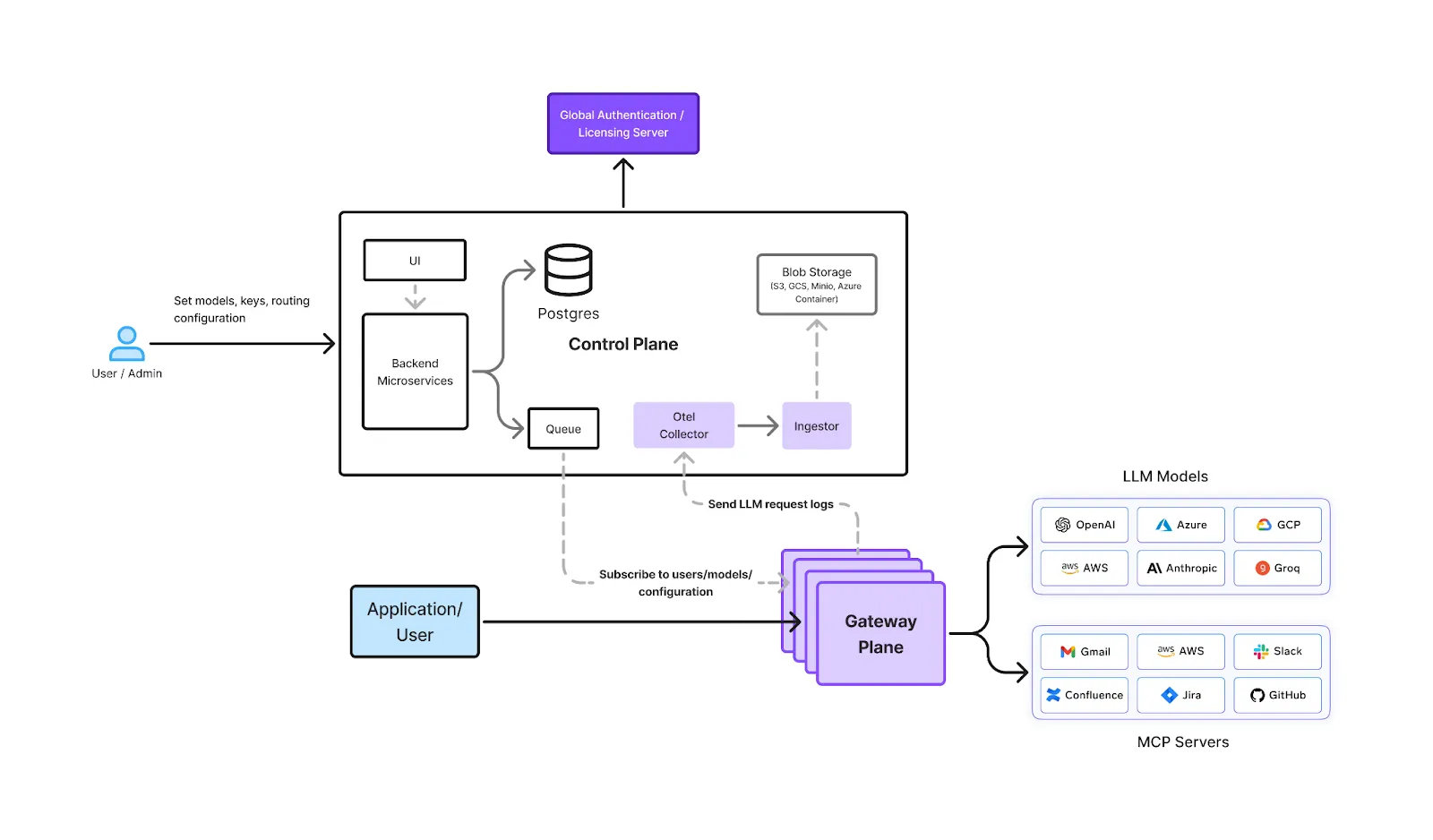

Les déploiements en production nécessitent une passerelle entre les agents d'IA et les outils backend. La passerelle fournit un plan de contrôle centralisé pour gérer toutes les interactions agent-outil.

Fonctionnalités de base de Gateway

Une passerelle correctement conçue gère l'authentification unifiée, dans laquelle les agents s'authentifient une seule fois et la passerelle gère toutes les informations d'identification du backend. Il fournit une application centralisée des politiques via les limites de débit, le RBAC et garde-corps. La passerelle garantit la fiabilité grâce à un basculement automatique, à de nouvelles tentatives avec un retard exponentiel et équilibrage de charge. Il offre également une observabilité via des traces complètes via OpenTelemetry et attribution des coûts par équipe.

Comment TrueFoundry permet une exécution rapide

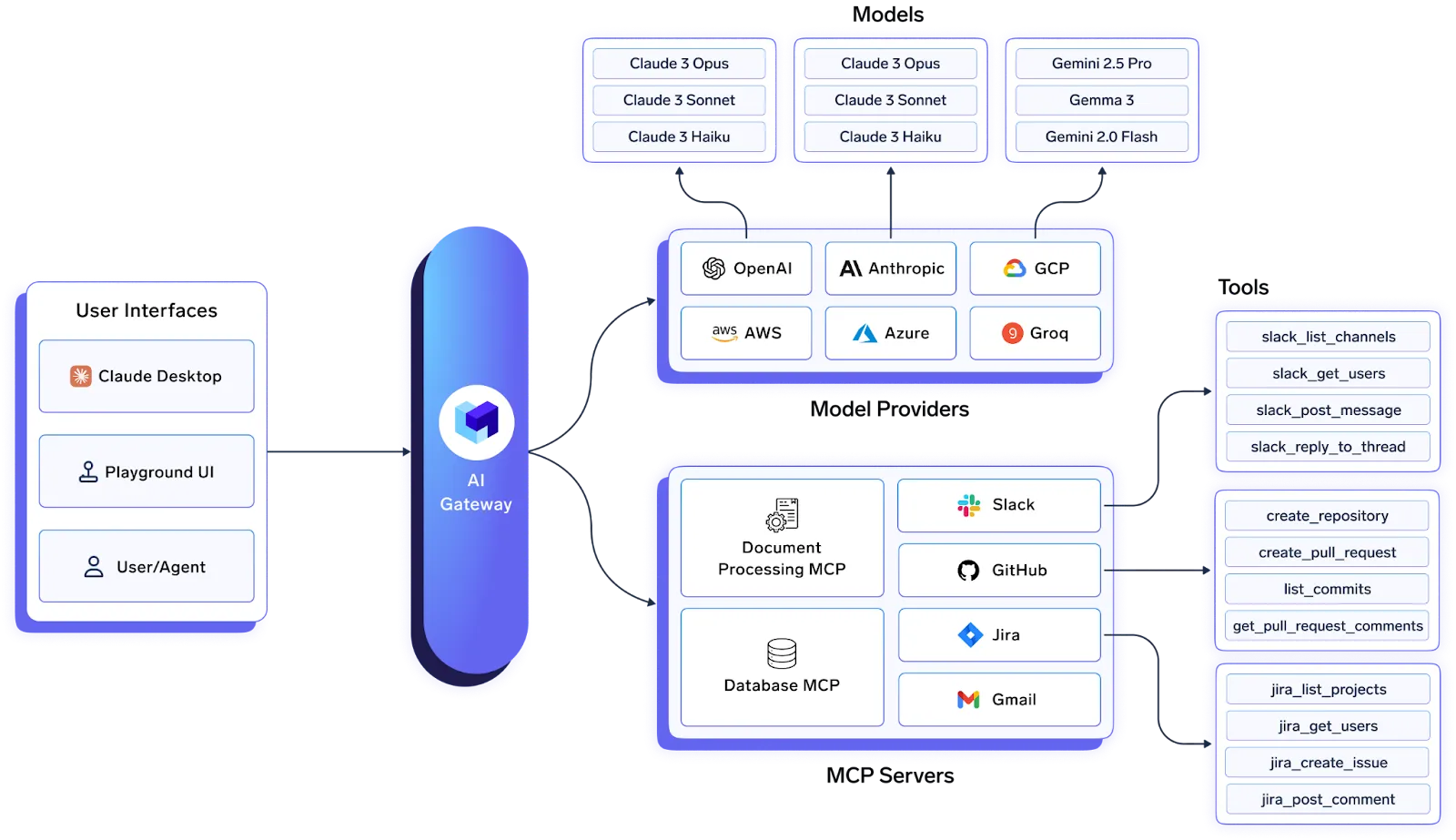

Passerelle IA de TrueFoundry fournit la couche d'infrastructure pour l'IA des agences de production. Il combine le routage LLM, la gestion des serveurs MCP et la gouvernance des agents dans un plan de contrôle unifié.

Registre MCP centralisé

Le Passerelle MCP propose un registre centralisé pour tous les serveurs MCP : outils internes, services tiers, applications hébergées dans le cloud ou sur site. Vous pouvez organiser les serveurs en groupes tels que dev-mcps, staging-mcps et prod-mcps avec des règles RBAC distinctes pour chaque environnement. Les agents s'authentifient une seule fois et découvrent automatiquement tous les outils disponibles. La passerelle stocke les informations d'identification dans son magasin secret et gère l'actualisation des jetons.

Intégrations prédéfinies

TrueFoundry intègre des serveurs MCP pour Slack, GitHub, Confluence, Sentry et Datadog. Vous pouvez également enregistrer des API internes personnalisées en quelques minutes. Consultez les Documentation sur les serveurs MCP pour les détails de mise en œuvre.

Aire de jeux AI Gateway

Le Aire de jeux AI Gateway permet aux développeurs de prototyper des flux de travail avant le déploiement. Vous pouvez ajouter des serveurs MCP, sélectionner des outils spécifiques, exécuter des instructions en langage naturel et observer chaque appel d'outil et chaque réponse en temps réel. Le terrain de jeu génère également des extraits de code prêts à être utilisés en production dans NodeJS, cURL, etc.

Observabilité d'entreprise

TrueFoundry intègre Traçage conforme à la télémétrie ouverte tout au long de la passerelle. Chaque demande comprend des informations détaillées au niveau de la demande avec des métadonnées de span, des traces d'exécution des agents étape par étape, des mesures de latence à P50, P95 et P99, ainsi que des ventilations des coûts avec attribution par équipe ou par application. La passerelle gère plus de 350 RPS sur un seul processeur virtuel avec une latence inférieure à 3 ms en traitant l'authentification et en limitant le débit en mémoire.

Sécurité et conformité

La plateforme fournit un RBAC au niveau de l'outil via Paramètres du contrôle d'accès, des garde-fous de validation des entrées/sorties pour une injection rapide, une PII et une toxicité, et OAuth 2.0 intégration avec Okta, Azure AD ou des IdP personnalisés. TrueFoundry prend en charge le déploiement dans des environnements VPC, sur site, isolés et multicloud tout en garantissant la conformité aux normes SOC 2, HIPAA et EU AI Act.

Le déficit d'infrastructure est réel

Gartner prédit plus de 40 % des projets d'IA agentic seront annulés d'ici 2027 parce que l'infrastructure n'est pas prête. Rapports IBM que 99 % des développeurs d'entreprise explorent les agents d'IA, mais que la plupart continuent d'intégrer l'IA à des systèmes jamais conçus pour une exécution autonome. Les équipes qui réussissent considèrent l'infrastructure comme un investissement de plateforme, et non comme une préoccupation spécifique au projet. Ils construisent d'abord le plan de contrôle, puis redimensionnent.

Conclusion

Le passage du navigateur à l'invite change fondamentalement la façon dont L'IA agentique en entreprise exécutera le travail sur tous les systèmes. Au lieu de cliquer sur les interfaces, les agents IA exécutent des flux de travail complexes basés sur des instructions en langage naturel.

La mise en place d'une infrastructure pour cette transition nécessite de résoudre des problèmes pour lesquels les systèmes traditionnels n'ont jamais été conçus. Vous avez besoin d'une gestion des sessions pour les flux de travail dynamiques, d'une orchestration d'outils sans code personnalisé, d'une observabilité pour les comportements non déterministes et de contrôles de sécurité pour les systèmes autonomes.

Passerelle IA de TrueFoundry répond à ces défis grâce à un plan de contrôle unifié combinant le routage LLM, Gestion des serveurs MCP, et la gouvernance des agents. Les équipes d'ingénierie peuvent passer des flux de travail pilotés par navigateur à une automatisation rapide sans avoir à reconstruire l'intégralité de leur infrastructure.

FAQs

1. Quelle est la différence entre l'automatisation du navigateur et la navigation agentique ?

Des outils tels que Puppeteer nécessitent des instructions explicites pour chaque action. La navigation agentique utilise l'IA pour interpréter les objectifs en langage naturel et déterminer les actions de manière autonome en fonction de la compréhension visuelle.

2. Pourquoi les agents d'IA ont-ils besoin d'une passerelle ?

Les connexions directes entraînent une prolifération des informations d'identification, une logique de nouvelle tentative dupliquée et aucune visibilité sur le comportement des agents. Une passerelle centralise l'authentification, applique les politiques et assure le suivi de chaque interaction.

3. Qu'est-ce que le MCP ?

Le protocole Model Context définit la manière dont les agents d'IA découvrent et invoquent des outils via une interface JSON-RPC cohérente. Les agents apprennent les outils disponibles au moment de l'exécution, sans intégrations codées en dur.

4. En quoi la passerelle MCP de TrueFoundry diffère-t-elle des intégrations personnalisées ?

TrueFoundry fournit des connecteurs prédéfinis, un registre unifié, un RBAC centralisé, une observabilité OpenTelemetry et un terrain de jeu interactif. La construction d'infrastructures équivalentes prend des mois.

5. Quels contrôles de sécurité sont nécessaires pour l'IA des agents de production ?

Les déploiements en production nécessitent un RBAC au niveau de l'outil, des barrières d'entrée pour une injection et des informations d'identification rapides, une validation des sorties, une intégration des IdP d'entreprise et une journalisation complète des audits.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)