Création de systèmes d'IA composés avec TrueFoundry et Mongo DB

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Le monde de l'intelligence artificielle (IA) évolue rapidement, dépassant les modèles isolés pour adopter des systèmes interconnectés qui résolvent de manière collaborative des problèmes complexes et multidimensionnels.A Système d'IA composé est défini comme un système qui aborde les tâches d'IA à l'aide de plusieurs composants interactifs, qui peuvent inclure divers modèles d'IA, des mécanismes de récupération de données et des outils externes. Ces composants fonctionnent en collaboration pour atteindre des objectifs spécifiques, ce qui permet une approche plus nuancée et plus efficace de la résolution des problèmes.

Voici des exemples courants de systèmes composés :

- Génération augmentée par récupération (RAG): Cette configuration combine un modèle génératif avec un composant de récupération pour produire des réponses fondées sur des sources de données spécifiques.

- Modèles enchaînés: plusieurs modèles sont connectés en séquence, la sortie d'un modèle servant d'entrée à un autre, améliorant ainsi la capacité globale du système.

Ce principe de conception, défendu par des institutions telles que le laboratoire Berkeley AI Research (BAIR), met l'accent sur l'importance de l'architecture des systèmes pour aborder les tâches complexes de l'IA. Plutôt que de s'appuyer uniquement sur de grands modèles monolithiques, les systèmes d'IA composés exploitent divers composants spécialisés pour améliorer les performances, la flexibilité et l'adaptabilité.

Passer à la pensée systémique

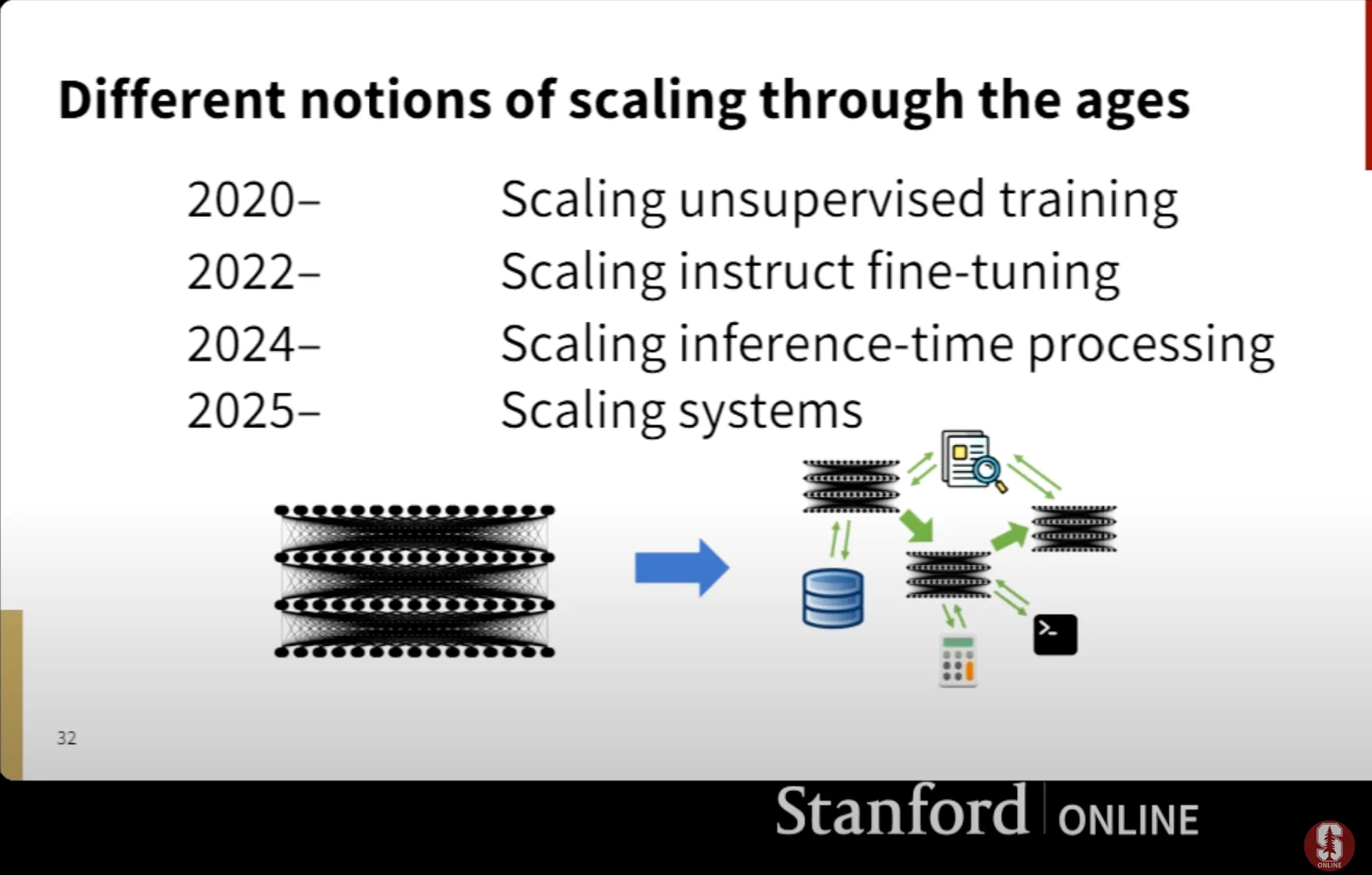

Un récent vidéo de Stanford a décrit l'évolution de la mise à l'échelle de l'IA à différentes époques, en mettant l'accent sur la façon dont l'accent est passé du développement centré sur les modèles à l'intégration au niveau du système

Développement de la formation non supervisée (2020—) - Cela a commencé avec la sortie de GPT-3, qui a démontré la puissance de la formation non supervisée à grande échelle. La formation non supervisée consiste à exposer les modèles à de grandes quantités de données non structurées, telles que du texte provenant d'Internet, afin de leur permettre de généraliser des modèles sans étiquettes de tâches spécifiques.

Scaling Instruct Fining (2022—) - Cette époque a été caractérisée par l'introduction d'applications telles que ChatGPT, qui utilisait réglage des instructions et des techniques de réglage. Le réglage précis des instructions implique la fourniture de paires d'entrées-sorties (par exemple, des ensembles de données questions-réponses) pour ajuster les modèles pré-entraînés pour des compétences spécifiques.

Mise à l'échelle du traitement des inférences (2024—) - Cela fait référence aux innovations visant à optimiser l'utilisation en temps réel des modèles d'IA lors de l'inférence. Il met l'accent sur l'amélioration de l'efficacité, des temps de réponse et de l'adaptabilité grâce au raisonnement en plusieurs étapes, à l'incitation à la « chaîne de pensée », à l'optimisation de la mémoire, etc.

Systèmes de mise à l'échelle (2025—) - Au-delà des grands modèles de langage (LLM) pour adopter des systèmes composés, passer de modèles autonomes à des systèmes intégrés combinant des modèles, des outils, des API et une infrastructure.

Difficultés liées à la création de systèmes d'IA composés ?

Difficultés liées à

Les systèmes d'IA composés nécessitent la capacité de basculer en toute fluidité entre les GPU, les processeurs et d'autres matériels spécialisés en fonction des besoins spécifiques de chaque composant. Par exemple, un modèle de vision peut exiger une accélération du processeur graphique, tandis qu'une requête de base de données peut dépendre de l'efficacité du processeur. Il est essentiel de déterminer les configurations de ressources optimales pour chaque charge de travail et d'adapter dynamiquement l'infrastructure à l'évolution des besoins. La surveillance et le réglage réguliers de l'infrastructure garantissent que le système fonctionne de manière efficace et rentable, même en cas d'évolution des charges de travail ou des exigences du modèle.

Pour garantir une évolutivité efficace des systèmes d'IA composés, il faut mettre en œuvre des mécanismes de dimensionnement automatique qui allouent dynamiquement les ressources en fonction des demandes de charge de travail. Cela implique de surveiller l'utilisation du système, telle que le processeur, le GPU, la mémoire et la bande passante réseau, afin de prévoir les changements et d'y répondre en temps réel.

Coûts prohibitifs

L'exécution simultanée de plusieurs modèles d'IA, en particulier en temps réel, entraîne des coûts de calcul, de stockage et de cloud élevés. Il est essentiel de mettre en place une infrastructure qui permet de détecter les inefficacités en matière de ressources et de permettre une commutation fluide entre les configurations. L'utilisation de stratégies telles que le calcul ponctuel, les GPU fractionnaires et la mise à l'échelle automatique garantit la rentabilité tout en maintenant des performances optimales.

Intégration à l'infrastructure existante

Les infrastructures modernes sont souvent composées d'architectures hautement distribuées, d'environnements multicloud et d'outils spécialisés adaptés à des flux de travail spécifiques. Ces configurations, bien qu'avancées, présentent des complexités lors de l'ajout de nouveaux composants d'IA qui doivent fonctionner harmonieusement au sein d'un écosystème déjà complexe.

Expérimentation plus rapide

L'accélération de l'expérimentation est essentielle au succès des systèmes d'IA composés, car elle permet aux équipes d'itérer rapidement, de tester de nouvelles idées et d'optimiser les performances.

L'architecture modulaire permet aux équipes d'échanger des modèles, d'ajuster des pipelines ou d'intégrer de nouveaux algorithmes avec un minimum de perturbations. Automatisation joue également un rôle important, avec des outils tels que les pipelines CI/CD garantissant un déploiement et des tests fluides des composants mis à jour.

Pourquoi utiliser TrueFoundry et MongoDB pour les applications d'IA composées ?

Lisez notre blog détaillé sur la façon d'intégrer TrueFoundry à MongoDB.

MongoDB

Accélérez la mise sur le marché avec Atlas MongoDB

La recherche vectorielle native de MongoDB les fonctionnalités simplifient la mise en œuvre de flux de travail sophistiqués de génération assistée par extraction (RAG) en intégrant la recherche vectorielle dans une base de données opérationnelle. Cela élimine le besoin de bases de données vectorielles distinctes, ce qui réduit la complexité de l'infrastructure et permet un déploiement plus rapide.

Réalisez des itérations rapidement avec flexibilité

Le modèle de données basé sur les documents de MongoDB est intrinsèquement flexible, ce qui le rend idéal pour stocker des types de données multimodaux tels que du texte, des images et des intégrations vectorielles. Les développeurs peuvent intégrer de nouveaux types de données sans interruption ni refonte du schéma, ce qui permet d'accélérer le réglage, l'optimisation et l'itération des applications basées sur GENAI.

Scalabilité et sécurité prêtes à l'emploi

MongoDB Atlas fournit une tolérance aux pannes de niveau entreprise, une mise à l'échelle horizontale et des fonctionnalités sécurisées par défaut telles que le cryptage interrogeable. Son architecture sans serveur entièrement gérée prend en charge une évolutivité élastique et une tarification basée sur la consommation, garantissant des opérations rentables, même pour les charges de travail les plus exigeantes.

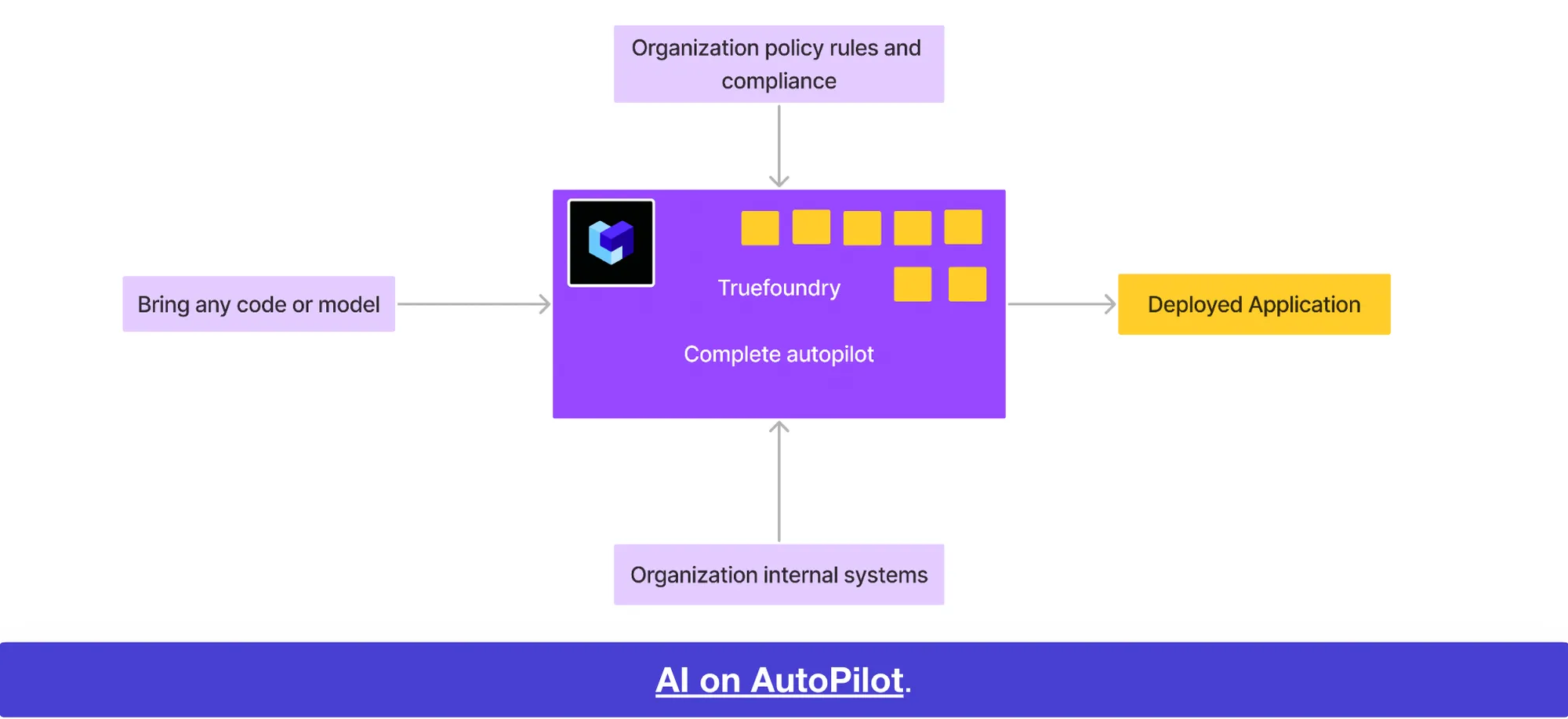

True Foundry

- Exécutez sur n'importe quel cloud, sur site ou hybride

TrueFoundry offre la flexibilité nécessaire pour déployer sur n'importe quel cloud, infrastructure sur site ou environnement hybride, en s'adaptant à vos besoins spécifiques. - Mise à l'échelle automatique ultrarapide et mise à l'échelle jusqu'à zéro

Adaptez automatiquement les ressources en cas de pics de demande et passez à zéro en cas d'inactivité, garantissant ainsi une rentabilité sans compromettre les performances. - Pilote automatique pour une optimisation pilotée par l'IA

Tirez parti des recommandations basées sur l'IA pour automatiser l'optimisation de l'infrastructure, améliorer les performances et réduire les frais opérationnels.

- Basculez entre n'importe quel matériel

Basculez facilement entre les GPU, les TPU, AWS Inferentia ou intégrez des accélérateurs personnalisés en une seule journée pour plus d'agilité matérielle. - Constructions Docker plus rapides

Optimisez les flux de travail de développement grâce à des versions accélérées de Docker, réduisant ainsi les temps d'itération et accélérant les déploiements. - Meilleures pratiques intégrées en matière d'ingénierie logicielle

Des fonctionnalités telles que les pipelines CI/CD, la gestion des secrets et les flux de travail de promotion garantissent des déploiements sécurisés, fiables et évolutifs. - Outils d'optimisation des coûts

Utilisez des GPU fractionnés, des instances ponctuelles et des mesures d'utilisation pour optimiser les coûts tout en optimisant l'efficacité des ressources. - Gestion complète du cycle de vie de l'IA

TrueFoundry simplifie l'ensemble du cycle de vie du développement de l'IA- Déploiement du modèle: flux de travail rationalisés pour déployer des modèles dans des environnements de production avec des configurations de ressources optimales.

- Réglage fin: fonctionnalités intégrées pour affiner efficacement les modèles pré-entraînés afin de les adapter à des tâches spécifiques.

- Passerelle IA: Accès centralisé à de nombreux modèles auto-hébergés et commerciaux avec authentification, surveillance et limitation de débit.

- Modèles de candidature: frameworks prêts à l'emploi pour créer des agents d'IA, des systèmes de récupération et des flux de travail personnalisés.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)