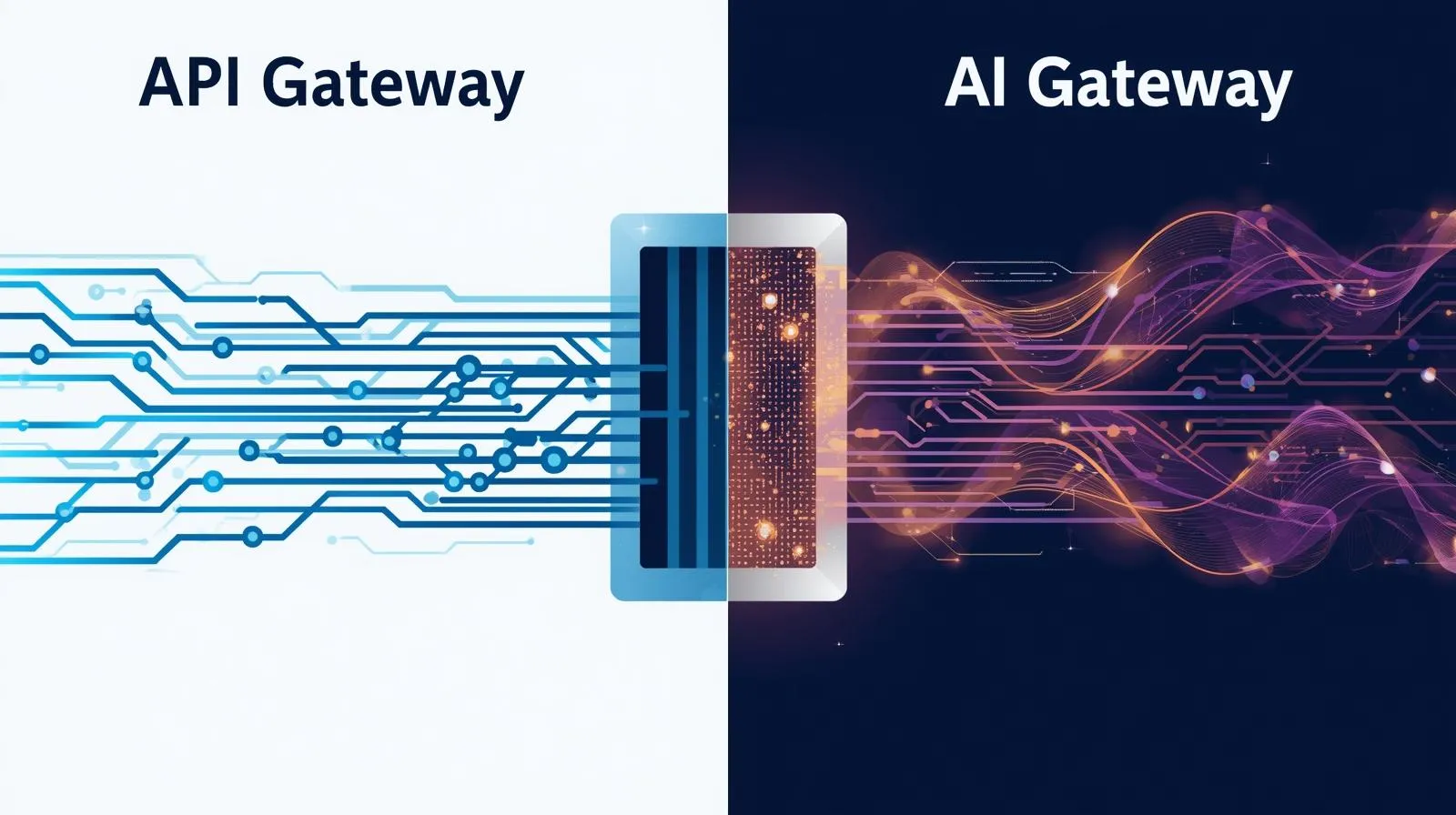

AI Gateway et API Gateway : les principales différences expliquées

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

L'adoption de l'IA en entreprise a atteint un point critique où les approches d'infrastructure traditionnelles ne suffisent plus. Bien que les passerelles API aient été utiles aux entreprises pour gérer les API REST et les microservices, l'émergence des charges de travail liées à l'IA, en particulier des modèles de langage volumineux, présente des défis uniques qui présentent des limites critiques. La tarification basée sur les jetons, la latence variable, le routage rapide complexe et les exigences de sécurité spécifiques à l'IA nécessitent une infrastructure spécialisée. Les organisations qui tentent d'acheminer le trafic d'IA via des passerelles API classiques se heurtent souvent à des goulots d'étranglement en termes de performances, à des dépassements de coûts et à des lacunes de conformité qui menacent leurs initiatives en matière d'IA. Comprendre quand tirer parti des passerelles IA par rapport aux passerelles API traditionnelles est devenu essentiel pour réussir le déploiement de l'IA en entreprise.

Qu'est-ce qu'AI Gateway ?

Un Passerelle IA est un composant d'infrastructure spécialisé conçu spécifiquement pour gérer les charges de travail liées à l'intelligence artificielle et à l'apprentissage automatique, en particulier les grands modèles de langage et les applications d'IA génératives. Contrairement aux passerelles API traditionnelles, les passerelles IA comprennent les caractéristiques uniques du trafic IA, notamment le traitement basé sur des jetons, les temps de réponse variables et les exigences de routage spécifiques au modèle.

Les fonctions de passerelle IA de base permettent de relever les défis spécifiques à l'IA grâce à un routage intelligent des modèles, un suivi des coûts au niveau des jetons et une gestion rapide. Les passerelles d'IA fournissent un accès unifié à plusieurs fournisseurs de LLM via des interfaces standardisées, permettant une commutation fluide entre les modèles OpenAI, Anthropic, Cohere et les modèles auto-hébergés. Au niveau de l'intégration, cela amène souvent les équipes à MCP contre API décisions, où les API exposent des points de terminaison fixes mais où MCP permet aux modèles et aux agents de découvrir de manière dynamique des outils et des fonctionnalités sur l'ensemble des systèmes. Les fonctionnalités avancées incluent la mise en cache sémantique pour les demandes similaires, le basculement automatique entre les fournisseurs de modèles et l'optimisation des coûts en temps réel basée sur les modèles d'utilisation des jetons.

Qu'est-ce qu'une passerelle API ?

.webp)

Une passerelle API sert de point d'entrée centralisé pour gérer, sécuriser et acheminer le trafic vers les services principaux dans les architectures distribuées. Agissant comme un proxy inverse, il se situe entre les applications clientes et les microservices, fournissant des fonctionnalités d'entreprise essentielles, notamment l'authentification, l'autorisation, la limitation du débit, l'équilibrage de charge et la transformation des requêtes/réponses.

Les principales fonctions de passerelle d'API incluent la gestion du trafic via un routage intelligent basé sur les chemins d'URL, les méthodes HTTP et les en-têtes. La passerelle gère des problèmes transversaux tels que la terminaison SSL, la limitation des requêtes et la mise en cache afin d'optimiser les performances. Les mécanismes d'authentification vérifient les informations d'identification des clients, tandis que les politiques d'autorisation garantissent un contrôle d'accès approprié. Les fonctionnalités de transformation des demandes et des réponses permettent la traduction de protocoles et la conversion de formats de données.

API Gateway contre AI Gateway

Popularité croissante d'AI Gateway

Le marché des passerelles d'IA connaît une croissance fulgurante en raison de l'adoption rapide par les entreprises de technologies d'IA génératives et des limites de l'infrastructure traditionnelle en matière de gestion des charges de travail spécifiques à l'IA.

La dynamique du marché et les investissements reflètent une demande sans précédent des entreprises. Selon une récente analyse du secteur, l'adoption des passerelles d'IA a augmenté de 400 % d'une année sur l'autre, les dépenses des entreprises en matière d'IA atteignant 50 milliards de dollars dans le monde. Les principaux fournisseurs de technologies, dont Microsoft, Google et AWS, ont lancé des services de passerelle d'IA dédiés, tandis que des fournisseurs spécialisés tels que TrueFoundry, LangChain et d'autres ont levé des fonds importants pour répondre aux besoins d'infrastructure d'IA des entreprises.

Les difficultés des entreprises favorisent l'adoption, car les organisations découvrent que les outils traditionnels de gestion des API ne sont pas adaptés aux charges de travail de l'IA. Les premiers utilisateurs de l'IA signalent fréquemment des dépassements de coûts supérieurs à 300 % des prévisions initiales lorsqu'ils acheminent le trafic d'IA via des passerelles classiques. Les problèmes de performances sont dus à des mécanismes de mise en cache inefficaces qui ne reconnaissent pas les instructions sémantiquement similaires, tandis que des failles de sécurité apparaissent en raison d'une protection inadéquate contre les attaques par injection rapide et d'un manque de surveillance de la conformité spécifique à l'IA.

Les pressions réglementaires et de conformité accélèrent l'adoption des passerelles d'IA dans les secteurs réglementés. La loi européenne sur l'IA, les nouveaux cadres de gouvernance de l'IA et les réglementations spécifiques au secteur nécessitent des pistes d'audit détaillées, une surveillance des biais et des fonctionnalités de filtrage de contenu que les passerelles API traditionnelles ne peuvent pas fournir. Les organisations de santé qui mettent en œuvre des applications d'IA ont besoin d'un traitement rapide conforme à la loi HIPAA, tandis que les services financiers nécessitent des fonctionnalités spécialisées de détection des fraudes et de transparence algorithmique.

La maturité technologique et l'innovation favorisent la sophistication des solutions. Les passerelles d'IA modernes offrent des fonctionnalités avancées, notamment la mise en cache sémantique qui réduit les coûts jusqu'à 70 %, le routage intelligent qui optimise les performances entre plusieurs fournisseurs de modèles et l'optimisation des coûts en temps réel qui empêche les dépassements de budget. Ces fonctionnalités répondent aux exigences des entreprises en matière de coûts prévisibles, de performances fiables et de gouvernance complète que l'infrastructure traditionnelle ne peut pas fournir.

La validation industrielle provient des implémentations du Fortune 500 démontrant un retour sur investissement mesurable. Les entreprises font état de réductions de coûts de 40 à 60 %, d'une amélioration des performances des applications d'IA et d'une meilleure posture de sécurité après la mise en œuvre de solutions de passerelle d'IA spécialisées.

Quand utiliser AI Gateway ?

Les organisations devraient envisager de mettre en œuvre des passerelles d'IA lorsque leurs initiatives en matière d'IA passent des phases expérimentales à des environnements de production où les exigences de l'entreprise deviennent critiques. Le point de transition se produit généralement lorsque les entreprises déploient plusieurs applications d'IA, intègrent différents fournisseurs de modèles ou sont confrontées à des pressions croissantes en matière de coûts et de conformité auxquelles l'infrastructure traditionnelle ne peut pas répondre efficacement.

Les environnements multimodèles constituent le cas d'utilisation le plus convaincant en matière d'adoption de passerelles IA. Lorsque les organisations font appel à plusieurs fournisseurs LLM, combinant OpenAI pour les tâches générales, Anthropic pour les applications critiques en matière de sécurité et des modèles auto-hébergés pour les données propriétaires, une passerelle d'IA devient essentielle pour une gestion unifiée. Les passerelles API traditionnelles sont confrontées à la complexité des décisions de routage basées sur les capacités des modèles, les limites de jetons et l'optimisation des coûts entre les différents fournisseurs. Les passerelles IA permettent de passer facilement d'un modèle à l'autre en fonction de mesures de performance en temps réel, de considérations de coûts et d'exigences spécifiques aux cas d'utilisation.

Les préoccupations liées au contrôle des coûts poussent de nombreuses organisations à opter pour des solutions de passerelle d'IA à mesure que l'utilisation de l'IA évolue dans l'ensemble de l'entreprise. Les organisations qui traitent des millions de jetons par mois découvrent souvent que leurs coûts d'IA dépassent les prévisions budgétaires. Les passerelles d'intelligence artificielle fournissent un suivi granulaire des coûts, des mécanismes de mise en cache intelligents qui reconnaissent les demandes sémantiquement similaires et un routage automatique vers des modèles rentables, le cas échéant. Ces fonctionnalités peuvent réduire les coûts d'infrastructure d'IA de 40 à 70 % tout en préservant les performances des applications et l'expérience utilisateur.

Les exigences de conformité réglementaire rendent les passerelles d'IA essentielles pour les organisations des secteurs réglementés. Les organisations de santé qui gèrent les données des patients, les institutions financières qui traitent des informations sensibles sur les clients et les agences gouvernementales qui gèrent des informations classifiées ont besoin de pistes d'audit spécialisées, de filtrage du contenu et de fonctionnalités de surveillance des biais. Les passerelles API traditionnelles ne disposent pas des fonctionnalités de gouvernance spécifiques à l'IA requises pour la conformité réglementaire, tandis que les passerelles IA fournissent des outils spécialement conçus pour une désinfection rapide, une surveillance des résultats et une journalisation complète des audits répondant aux exigences réglementaires.

Avez-vous vraiment besoin d'une passerelle IA ? Evaluons

Toutes les organisations n'ont pas besoin d'une passerelle d'IA dans l'immédiat, et une auto-évaluation honnête évite la complexité et les investissements inutiles en matière d'infrastructure. La décision dépend en fin de compte de la maturité, de l'envergure et des exigences spécifiques de votre entreprise en matière d'IA, plutôt que de suivre les tendances technologiques ou les recommandations des fournisseurs.

Commencez par des scénarios simples qui ne justifient peut-être pas un investissement dans une passerelle d'IA. Les organisations qui exécutent des applications d'IA uniques avec un seul fournisseur de modèles, traitent moins de 100 000 jetons par mois ou opèrent en phases pilotes peuvent souvent gérer efficacement grâce à des connexions API directes ou à des outils de gestion d'API légers. Les petites équipes qui expérimentent l'intégration de ChatGPT, la synthèse de documents de base ou la mise en œuvre de simples chatbots n'ont généralement pas besoin d'une infrastructure de passerelle spécialisée. De même, les organisations ayant des exigences de conformité minimales et des structures de coûts simples peuvent trouver des solutions traditionnelles adaptées à leurs besoins actuels.

Évaluez les indicateurs d'échelle et de complexité qui signalent la nécessité d'une passerelle IA. Les principaux déclencheurs incluent une consommation mensuelle de jetons supérieure à un million, l'utilisation par plusieurs fournisseurs de modèles, la mise en œuvre d'applications d'IA de production destinées à des clients externes ou les exigences en matière d'attribution détaillée des coûts entre les équipes et les projets. La complexité technique augmente considérablement lorsque les entreprises ont besoin d'un routage intelligent entre les modèles, d'une mise en cache sémantique pour optimiser les coûts ou de mécanismes de basculement automatisés pour des raisons de fiabilité. Ces scénarios apparaissent généralement au fur et à mesure que les initiatives d'IA passent de l'expérimentation à des opérations critiques pour l'entreprise.

Tenez compte des exigences de conformité et de gouvernance qui nécessitent souvent une infrastructure spécialisée. Les organisations des secteurs de la santé, de la finance, du gouvernement ou d'autres secteurs réglementés ont généralement besoin de pistes d'audit spécifiques à l'IA, de filtrage de contenu et de fonctionnalités de surveillance des biais que les passerelles API à usage général ne peuvent pas fournir. Même les applications d'IA apparemment simples deviennent complexes lorsqu'elles doivent satisfaire à la norme HIPAA, SOC 2 ou à d'autres cadres réglementaires. En outre, les organisations qui ont des exigences strictes en matière de souveraineté des données ou qui gèrent des propriétés intellectuelles sensibles ont souvent besoin des fonctionnalités de sécurité et de gouvernance avancées fournies par les passerelles d'IA spécialisées.

Évaluez la stratégie à long terme et les projections de croissance afin d'éviter des migrations d'infrastructures coûteuses ultérieurement. Les organisations qui envisagent une expansion significative de l'IA, anticipent les exigences de conformité réglementaires ou développent des produits basés sur l'IA pour des clients externes devraient envisager d'adopter une passerelle d'IA plus tôt dans leur parcours afin d'éviter la dette technique et les complexités de migration.

Solution de passerelle TrueFoundry AI

.webp)

TrueFoundry AI Gateway permet une gestion du trafic d'IA de niveau entreprise via une plateforme spécialement conçue pour relever les défis uniques des charges de travail d'IA de production. Traitant plus d'un million d'appels LLM par jour pour des organisations telles que NVIDIA, CVS Health et Siemens, la plateforme associe une architecture haute performance à des fonctionnalités complètes spécifiques à l'IA.

.webp)

Unified Model Access permet une intégration fluide avec plus de 1000 LLM via une interface API unique compatible avec OpenAI. La passerelle prend en charge des fournisseurs tiers, notamment OpenAI, Anthropic, Cohere et les plateformes cloud, ainsi que des modèles auto-hébergés et affinés grâce à la fonctionnalité « Ajouter à la passerelle » en un clic. Cette approche unifiée élimine la dépendance vis-à-vis des fournisseurs tout en permettant aux entreprises de tirer parti des meilleurs modèles pour des cas d'utilisation spécifiques sans modifier le code.

Les performances de niveau entreprise garantissent une latence minimale de moins de 5 ms grâce à une architecture optimisée pour les charges de travail de production. Construite sur le framework Hono pour une gestion ultrarapide des demandes, la passerelle passe de 250 RPS sur 1 CPU/1 Go de RAM à des milliers d'RPS grâce à une mise à l'échelle horizontale. L'absence d'appels externes sur le chemin de la demande et l'application en mémoire de toutes les politiques garantissent des temps de réponse inférieurs à la milliseconde pour les décisions d'authentification, d'autorisation et de routage.

Les fonctionnalités avancées de gestion du trafic incluent un équilibrage de charge intelligent avec des stratégies de routage basées sur le poids et la latence. La passerelle surveille en permanence les demandes par minute, les jetons par minute et les taux d'échec afin de maintenir une santé optimale du modèle. Le basculement automatique vers les modèles de sauvegarde garantit une disponibilité continue du service, tandis que la mise en cache sémantique réduit les coûts jusqu'à 70 % en reconnaissant les instructions similaires au lieu d'exiger des correspondances exactes.

Des fonctionnalités complètes de sécurité et de gouvernance fournissent un contrôle d'accès de niveau entreprise grâce à l'intégration RBAC avec les fournisseurs d'identité, notamment Okta et Azure AD. Une gestion précise des autorisations, une gestion centralisée des clés d'API et des pistes d'audit complètes répondent aux exigences de conformité réglementaire. Les garde-corps intégrés permettent de filtrer le contenu, de détecter les biais et de prévenir rapidement les injections, spécialement conçus pour les applications d'IA.

.webp)

La prise en charge de l'IA multimodale et agentique permet des flux de travail d'IA de nouvelle génération grâce à l'intégration native de la passerelle MCP (Model Context Protocol) pour l'orchestration des outils d'entreprise. La plateforme prend en charge les entrées de texte, d'image et audio tout en fournissant une infrastructure dédiée aux flux de travail des agents IA avec une sécurité et une observabilité de niveau entreprise.

Conclusion

Le choix entre les passerelles API et les passerelles IA représente une décision stratégique en matière d'infrastructure qui a un impact sur le succès des initiatives d'IA des entreprises. Alors que les passerelles API traditionnelles excellent dans la gestion des services Web classiques, les charges de travail d'IA exigent des fonctionnalités spécialisées que seules les passerelles d'IA spécialement conçues peuvent fournir. Les modèles de tarification basés sur des jetons, les modèles de latence variables, le traitement multimodal et les exigences de sécurité spécifiques à l'IA créent des incohérences fondamentales avec les architectures de passerelle traditionnelles. Les organisations qui reconnaissent ces différences à un stade précoce et mettent en œuvre des solutions de passerelle d'IA appropriées se positionnent pour garantir un succès durable en matière d'IA, en évitant les goulots d'étranglement en matière de performances, les dépassements de coûts et les lacunes de conformité qui affectent les initiatives d'IA fondées sur des bases d'infrastructure inadéquates.

Questions fréquemment posées

Qu'est-ce qu'une passerelle d'IA et d'API ?

Une passerelle API achemine et sécurise le trafic des services backend standard. Une passerelle d'IA est spécialisée dans la gestion des interactions entre les modèles d'IA, comme les LLM, l'optimisation des coûts et le routage intelligent des charges de travail d'IA. Ensemble, ils répondent à des besoins d'infrastructure différents mais complémentaires : les passerelles API gèrent le trafic général de vos services tandis que les passerelles IA gèrent la complexité spécifique aux interactions entre les modèles d'IA.

Quelle est la différence entre une passerelle IA et une passerelle API ?

Une passerelle API gère le trafic général des API pour les microservices, en gérant le routage et la sécurité. Une passerelle d'IA est toutefois conçue spécifiquement pour les charges de travail AI/ML telles que les LLM, la gestion des invites, des coûts et des interactions complexes entre modèles. Il est essentiel de comprendre la passerelle AI par rapport à la passerelle API pour optimiser les déploiements d'IA modernes.

L'API et l'IA sont-elles identiques ?

Non, l'API (interface de programmation d'applications) et l'IA (intelligence artificielle) sont distinctes. Une API est une interface de communication, tandis que l'IA est l'intelligence artificielle elle-même. En termes d'infrastructure, cette distinction est importante : une passerelle d'API expose et gère les API (y compris les API de modèles d'IA), tandis qu'une passerelle d'IA est une couche spécialisée conçue spécifiquement pour gérer la complexité de l'interaction avec les modèles d'IA, notamment les budgets de jetons, les modèles de repli et le contrôle rapide.

Une passerelle d'API peut-elle gérer les charges de travail liées à l'IA ?

Une passerelle d'API peut gérer les charges de travail de base de l'IA en raison de défis uniques tels que la tarification basée sur des jetons et le routage rapide complexe. Il ne dispose pas des fonctionnalités natives de l'IA nécessaires aux systèmes d'IA de production : il n'a aucun concept de facturation basée sur des jetons ou de limitation de débit, aucune mise en cache sémantique, aucune logique de repli multimodèle, aucun versionnage rapide et aucune observabilité spécifique au LLM. Au-delà du simple transfert de demandes à un fournisseur d'IA, une passerelle IA dédiée est l'outil idéal.

Les passerelles IA remplacent-elles les passerelles API ?

Les passerelles IA ne remplacent pas les passerelles API ; elles ont des objectifs distincts. Les passerelles API gèrent les API REST standard, tandis que les passerelles IA sont spécialisées dans les charges de travail AI/ML, telles que les LLM, en relevant des défis uniques tels que la tarification basée sur des jetons. Comprendre la différence entre une passerelle AI et une passerelle API vous permet de tirer parti des deux efficacement.

Une passerelle API peut-elle être utilisée comme passerelle IA ?

Alors qu'une passerelle API gère l'authentification de base et le routage du trafic, elle ne dispose pas d'informations spécifiques au LLM. Il ne peut pas suivre l'utilisation des jetons, gérer le basculement du fournisseur de modèles ou effectuer une mise en cache sémantique. Pour prendre en charge les applications d'IA de niveau production, vous avez besoin de l'orchestration et de l'observabilité spécialisées que seule une passerelle d'IA dédiée fournit.

Quand dois-je utiliser à la fois la passerelle AI et la passerelle API ?

Utilisez les deux lorsque vous exploitez un écosystème d'IA à l'échelle de la production. La passerelle API sert de défense périmétrique pour tous les services de l'entreprise, tandis que la passerelle IA se trouve derrière elle pour gérer les tâches spécifiques au LLM. Cette combinaison garantit une gestion sécurisée des accès tout en optimisant le routage des modèles, les coûts et l'observabilité pour vos équipes d'ingénierie.

Qu'est-ce qui convient le mieux aux applications d'IA : passerelle API ou passerelle IA ?

Une passerelle d'IA est nettement meilleure pour les applications d'IA, car elle est spécialement conçue pour relever les défis uniques des LLM. Il offre une prise en charge native du streaming, une limitation de débit tenant compte des jetons et un basculement automatique des modèles. Ces fonctionnalités garantissent une fiabilité accrue et des coûts inférieurs par rapport à l'utilisation d'une passerelle API générique non compatible avec l'IA.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)