Vercel AI Review 2026: Lo hemos probado para que no tengas que hacerlo tú

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Si navegas por Twitter o por foros de desarrolladores, Vercel AI parece ser el mecanismo predeterminado para crear aplicaciones de IA generativa. El uso del SDK de vercel/ai junto con Next.js permite a los equipos de ingeniería pasar de un directorio vacío a un chatbot en streaming en cuestión de minutos.

No cabe duda de que la experiencia del desarrollador (DX) está optimizada para una gratificación inmediata, lo que elimina las complejidades del análisis de secuencias y la administración del estado de la interfaz de usuario. Pero, ¿«fácil de empezar» equivale a «fácil de escalar»?

Para esta revisión de Vercel AI, probamos rigurosamente la plataforma más allá de la fase de prototipo, sometiéndola a flujos de trabajo de agencia, canalizaciones de RAG de alto rendimiento y estándares de cumplimiento de seguridad empresarial. Este análisis arquitectónico describe los aspectos más destacados de la plataforma, identifica los límites operativos específicos y explica por qué los equipos de escalado suelen hacer la transición a plataformas de orquestación dedicadas, como TrueFoundry.

.webp)

¿Qué es realmente la «IA de Vercel»?

La IA de Vercel se malinterpreta con frecuencia porque el marketing combina las herramientas del lado del cliente con la infraestructura subyacente. Desde un punto de vista arquitectónico, la IA de Vercel es una combinación del SDK de IA de código abierto y los entornos de ejecución Edge y Serverless patentados por Vercel.

El SDK gestiona la capa de abstracción, gestiona los protocolos de streaming, la contrapresión y el cambio de proveedor entre API como OpenAI o Anthropic. Sin embargo, el comportamiento del tiempo de ejecución está inextricablemente vinculado al modelo de alojamiento de Vercel. Cuando se implementan, estas rutas de API se ejecutan como Funciones de borde (aislamientos V8 ligeros) o Funciones sin servidor (contenedores efímeros de Node.js).

Esta distinción es fundamental porque dicta restricciones operativas. No está ejecutando un servidor persistente; está ejecutando instancias informáticas de corta duración y basadas en eventos que tienen límites estrictos en cuanto a la duración de la ejecución y la disponibilidad de memoria, independientemente de la complejidad de su cadena de razonamiento de LLM.

El «camino feliz»: donde brilla la IA de Vercel

Antes de analizar las limitaciones, es necesario validar dónde Vercel AI agrega un valor de ingeniería tangible. Durante las pruebas prácticas, la plataforma demostró su clara utilidad para patrones arquitectónicos específicos.

- Velocidad de interfaz: La implementación de interfaces de chat de transmisión con el enlace UseChat reduce significativamente el uso repetitivo. En nuestras pruebas internas, establecer una conexión entre un frontend de Next.js y un backend de OpenAI requirió menos de 20 líneas de código, por lo que se gestionó automáticamente la reconstrucción de respuestas por fragmentos.

- Tiempo hasta el primer byte (TTFB): La ejecución perimetral proporciona un TTFB agresivo. Dado que Edge Functions, que se ejecuta en la versión 8, aísla el arranque en milisegundos, elimina la penalización de inicio en frío del contenedor asociada a las funciones tradicionales sin servidor. Esto las hace ideales para tareas de inferencia ligeras y sin estado en las que la latencia baja es el KPI principal.

- Integración con Next.js: Para los equipos que ya están arraigados en el ecosistema de Next.js, la fricción de incorporación es prácticamente nula. El paquete ai se integra de forma nativa con el App Router, lo que elimina la necesidad de configurar la puerta de enlace Vercel por separado.

La prueba de esfuerzo: cuando la experiencia llega a sus límites

Cuando se pasa de los simples ciclos de solicitud-respuesta a tareas de razonamiento complejas, la IA de Vercel expone importantes limitaciones de infraestructura. Las siguientes limitaciones se documentaron durante nuestra evaluación comparativa de las cargas de trabajo con muchos agentes y RAG.

El límite de tiempo de espera para los flujos de trabajo de las agencias

Ejecutar agentes de investigación profundos o bucles de razonamiento de varios pasos supera rápidamente los estrictos límites de ejecución impuestos por la plataforma, que es donde Puerta de enlace Vercel AI frente a OpenRouter se vuelve importante para los equipos que evalúan alternativas escalables.

- Plan de pasatiempos: Las funciones sin servidor están estrictamente limitadas a 10 segundos.

- Plan Pro: El tiempo de espera predeterminado es 15 segundos, configurable hasta un máximo de 300 segundos (5 minutos).

Para un agente autónomo que necesita raspar un sitio web, analizar el DOM, consultar una base de datos vectorial y, a continuación, generar una respuesta en cadena de pensamiento, este período de 5 minutos suele ser insuficiente. En nuestras pruebas, los agentes que llevaban mucho tiempo funcionando terminaban con 504 errores de tiempo de espera de Gateway una vez que se alcanzaba el límite estricto.

Las funciones perimetrales son aún más restrictivas y imponen un límite estricto en el tiempo entre la solicitud y el primer byte de la respuesta. Si tu agente necesita mucho tiempo de reflexión antes de transmitir el primer token, la capa de proxy de la plataforma interrumpe la conexión.

.webp)

Arranques en frío en cargas de trabajo pesadas

Si bien las funciones perimetrales son rápidas, carecen de compatibilidad total con Node.js, lo que obliga a los equipos a utilizar funciones sin servidor estándar para operaciones que implican grandes dependencias o conexiones a bases de datos. La carga de plantillas de mensajes grandes, esquemas de validación (como Zod) o el establecimiento de conexiones SSL a una base de datos vectorial externa (por ejemplo, Pinecone o Weaviate) introduce una latencia significativa durante la inicialización.

Nuestros puntos de referencia indicaron que Serverless Functions que se conectaba a una instancia de AWS RDS experimentaba arranques en frío que iban desde 800 ms a 2,5 segundos. A diferencia de los servidores persistentes que mantienen grupos de conexiones, las funciones sin servidor deben restablecer con frecuencia los protocolos de enlace TCP/TLS en las nuevas invocaciones. Esto añade una latencia perceptible a la experiencia del usuario.

Dependencia arquitectónica de Edge Middleware

Vercel Edge Middleware utiliza un entorno de ejecución propietario (EdgeRuntime) en lugar del tiempo de ejecución estándar de Node.js. Si bien se adhiere a estándares web como fetch, carece de soporte para las API nativas de Node, como los complementos fs, net o C++.

En consecuencia, la lógica de enrutamiento o el middleware personalizado desarrollados específicamente para Vercel's Edge no son fáciles de transportar. La migración de esta lógica a un entorno contenerizado estándar (Docker) o a un proveedor de nube diferente (AWS Lambda) suele requerir una reescritura de la capa de puerta de enlace. Esto crea una dependencia arquitectónica en la que el costo de salir de la plataforma aumenta de forma lineal con la complejidad de la lógica del middleware implementada.

Revisión de las características de Vercel AI Gateway

El Vercel AI Gateway se posiciona con frecuencia como una solución integral de administración del tráfico. Evaluamos sus capacidades comparándolas con los requisitos de una puerta de enlace de API de nivel de producción.

Capacidades de almacenamiento en caché

La estrategia de almacenamiento en caché de Vercel se basa principalmente en encabezados HTTP y claves basadas en URL. Esto es insuficiente para las cargas de trabajo de LLM en las que las distintas solicitudes pueden ser semánticamente equivalentes. Cierto almacenamiento en caché semántico requiere incrustar el mensaje y realizar una búsqueda de similitud vectorial. Implementar esto en Vercel requiere ingeniería manual con una instancia de Vercel KV (Redis) independiente, lo que significa que las funciones avanzadas de Vercel Gateway, como el almacenamiento en caché semántico, no están listas para usar.

Observabilidad y métricas

El panel de control de Vercel está optimizado para datos vitales de la web (LCP, FID) en lugar de para métricas específicas de la IA. De forma predeterminada, no hay visibilidad sobre rendimiento del token, coste por usuario, o Desglose de la latencia de LLM.

Para obtener estos conocimientos, los equipos de ingeniería deben instrumentar plataformas de observabilidad de terceros, como Helicone o Langfuse. Si bien el SDK admite estas integraciones, representan más proveedores distintos que gestionar y pagar, en lugar de una capacidad nativa de la propia puerta de enlace.

¿Por qué TrueFoundry es una mejor alternativa para la producción?

TrueFoundry está diseñado para abordar las limitaciones de infraestructura inherentes a las arquitecturas sin servidor. Esta sección detalla cómo facilita la implementación de la IA a nivel de producción más allá de lo que normalmente cubre una reseña de Vercel AI.

Trabajadores asíncronos para agentes

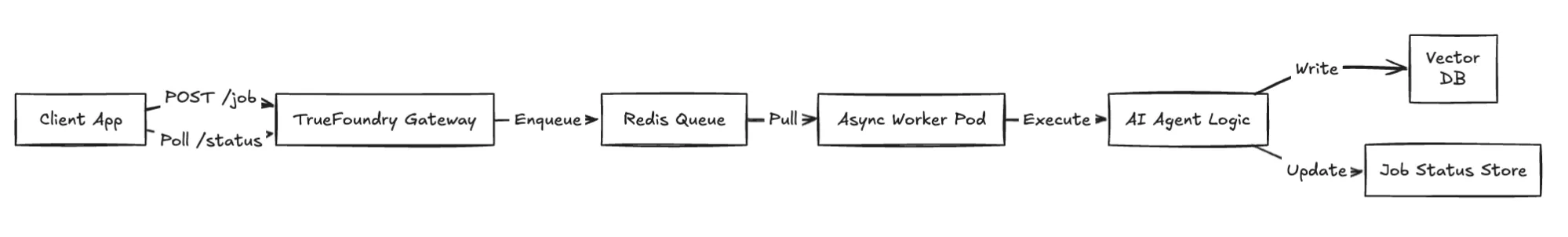

TrueFoundry desvincula la ejecución de tareas de larga duración del ciclo de solicitud/respuesta HTTP. Es compatible con los ejecutores de trabajos asincrónicos que funcionan sin los estrictos límites de tiempo de ejecución que se encuentran en los entornos sin servidor.

Esta arquitectura permite a los agentes realizar tareas extensas, como raspar cientos de páginas o procesar grandes conjuntos de datos, durante períodos de minutos u horas. Al utilizar Kubernetes Jobs o trabajadores en segundo plano, el sistema evita por completo 504 tiempos de espera. El cliente recibe un identificador de trabajo de inmediato y el trabajo se procesa de forma fiable en segundo plano mediante una arquitectura basada en colas.

Figura 2: Arquitectura asíncrona de TrueFoundry

Implementación de redes privadas y VPC

Los requisitos de seguridad en los entornos empresariales suelen exigir que los datos no atraviesen las redes públicas. TrueFoundry implementa pasarelas de IA directamente dentro de su propia VPC en la nube (AWS, GCP o Azure).

Esta configuración garantiza que las conexiones entre sus servicios de inferencia y sus almacenes de datos (como RDS o índices vectoriales privados) se dirijan a través de redes privadas internas de baja latencia (por ejemplo, AWS PrivateLink). Esto ayuda a cumplir con los estándares de seguridad empresarial de Vercel AI Gateway. Las cargas sensibles se procesan dentro de su perímetro de seguridad, lo que mitiga los riesgos de filtración de datos asociados a las redes periféricas de varios usuarios.

Control de costos con instancias puntuales

Vercel cobra una prima por la comodidad de la ejecución sin servidor (facturación basada en GB por hora). Por el contrario, TrueFoundry organiza las cargas de trabajo en la nube sin procesar, lo que permite utilizar instancias puntuales (AWS) o máquinas virtuales preemptibles (GCP).

Al aprovechar las flotas puntuales para cargas de trabajo de inferencia interrumpibles, los equipos pueden reducir los costos de procesamiento en aproximadamente 60% en comparación con los precios bajo demanda. Además, TrueFoundry administra el ciclo de vida de estas instancias y gestiona las interrupciones de forma eficiente para mantener la disponibilidad del servicio.

Comparación de Vercel AI con TrueFoundry

La siguiente tabla contrasta las características operativas de ambas plataformas para las cargas de trabajo de producción y resume las revisiones más comunes de las pasarelas de inteligencia artificial de Vercel.

¿Cuándo expulsarse de Vercel y pasar a TrueFoundry?

Vercel es una opción óptima para el desarrollo de frontend y la creación rápida de prototipos de IA. Sin embargo, las cargas de trabajo de IA de nivel de producción a menudo requieren un mayor control sobre los costos y la infraestructura del que permite el modelo sin servidor.

TrueFoundry proporciona una plataforma diseñada específicamente para ejecutar backends de IA a escala, eliminando los tiempos de espera, las estructuras de facturación opacas y las dependencias de tiempo de ejecución específicas de la plataforma.

Si su equipo busca simplificar la infraestructura de IA y, al mismo tiempo, reducir la sobrecarga operativa, conecta con el equipo de TrueFoundry para evaluar cómo la plataforma puede satisfacer sus requisitos de producción específicos.

Preguntas frecuentes

¿Vercel AI es seguro?

Vercel AI utiliza el cifrado estándar para los datos en tránsito y en reposo. Sin embargo, al ser una plataforma SaaS multiusuario, es posible que no cumpla los estrictos requisitos de residencia o aislamiento de datos (VPC de un solo inquilino) que exigen los sectores altamente regulados, en comparación con una solución autohospedada en TrueFoundry.

¿Vercel es digno de confianza?

Sí, Vercel es una empresa de tecnología Serie D de buena reputación que aloja las principales propiedades web. En una reseña sobre la inteligencia artificial de Vercel, las preocupaciones sobre la «confianza» suelen referirse al «riesgo de plataforma» (el riesgo estratégico de basarse en un ecosistema propietario) y no a problemas de seguridad o integridad empresarial.

¿Cuáles son las desventajas de Vercel?

Las principales desventajas técnicas destacadas en las revisiones de Vercel AI son los estrictos tiempos de espera de ejecución (máximo 5 minutos), el límite de cuerpo de solicitud de 4,5 MB, la imposibilidad de adjuntar GPU para el alojamiento de modelos personalizados y la posibilidad de que se generen costos de escalado complejos.

¿Cuánto cuesta Vercel AI?

El Vercel AI SDK es de código abierto. Los costos de infraestructura están relacionados con el plan de hospedaje de Vercel: el plan Pro comienza en 20 USD por usuario al mes, pero se aplican cargos por duración de las funciones y transferencia de datos en función del uso. Gracias a estos medidores de uso, los costes de las aplicaciones de IA de gran volumen pueden aumentar rápidamente.

¿Cuándo no usar Vercel?

Evite usar Vercel AI Gateway si su aplicación requiere agentes autónomos de larga duración (>5 minutos), procesamiento de archivos binarios de gran tamaño (>4,5 MB), alojamiento de modelos de código abierto personalizados en GPU o un aislamiento estricto de redes privadas (VPC).

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)