Alternativas a la IA de Vercel: 8 mejores opciones que puedes probar en 2026

![8 Vercel AI Alternatives and Competitors for 2026 [Ranked]](https://cdn.prod.website-files.com/6295808d44499cde2ba36c71/69a877c7e93c05705b362d65_ci.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Vercel revolucionó la configuración inicial para la integración de la IA. Su SDK de IA reduce el trabajo repetitivo necesario para conectar una interfaz de Next.js a la API de OpenAI, y el Edge Runtime gestiona la infraestructura de streaming a la perfección. Para la creación de prototipos, los contenedores B2C o las herramientas internas de bajo tráfico, el ecosistema de Vercel sigue siendo una opción de primer nivel.

Sin embargo, la arquitectura de Vercel está optimizada para entrega de interfaz, no operaciones de aprendizaje automático. A medida que las aplicaciones pasan de la fase de producción de prototipos a la producción a gran escala, los equipos de ingeniería suelen encontrarse con límites arquitectónicos: el escalamiento de los costes depende de la duración de las funciones, la complejidad de implementar modelos personalizados y ajustados (por ejemplo, Llama 3 o Mistral) dentro de una VPC privada y la necesidad de controlar minuciosamente la pila de inferencias.

TrueFoundry se ha convertido en la opción principal para los equipos de ingeniería que requieren una experiencia de desarrollador (DX) similar a la de Vercel aplicada a su propia infraestructura de nube. Este informe evalúa ocho alternativas en función de la propiedad de la infraestructura, la flexibilidad del modelo y la economía de la unidad.

¿Por qué los equipos migran desde Vercel AI?

La migración para dejar de usar Vercel AI generalmente se debe a tres requisitos arquitectónicos u operativos específicos que surgen a escala.

1. La restricción de la integración de las API

El SDK de IA de Vercel está diseñado principalmente para encadenar las solicitudes de interfaz a API de terceros, como OpenAI o Anthropic. Esta arquitectura funciona bien para los modelos generalistas, pero crea fricciones cuando los equipos necesitan implementar modelos optimizados y autohospedados. Cambiar una llamada GPT-4 externa por un modelo de 7 B parámetros que se ejecute en una GPU T4 normalmente requiere rediseñar la lógica del backend, ya que va más allá del simple empaquetado de API.

2. Privacidad de datos y cumplimiento de VPC

Las industrias reguladas (tecnología financiera, atención médica) a menudo operan bajo mandatos estrictos con respecto a la residencia de datos. Las políticas de seguridad empresarial exigen con frecuencia que la inferencia se realice dentro de una VPC (nube privada virtual) privada donde el cliente controle estrictamente la entrada y salida de datos. Si bien Vercel ofrece medidas de seguridad sólidas, funciona como una PaaS multiusuario. Muchas empresas prefieren (o se les exige) ser propietarias de toda la pila informática dentro de sus propias cuentas de AWS o GCP.

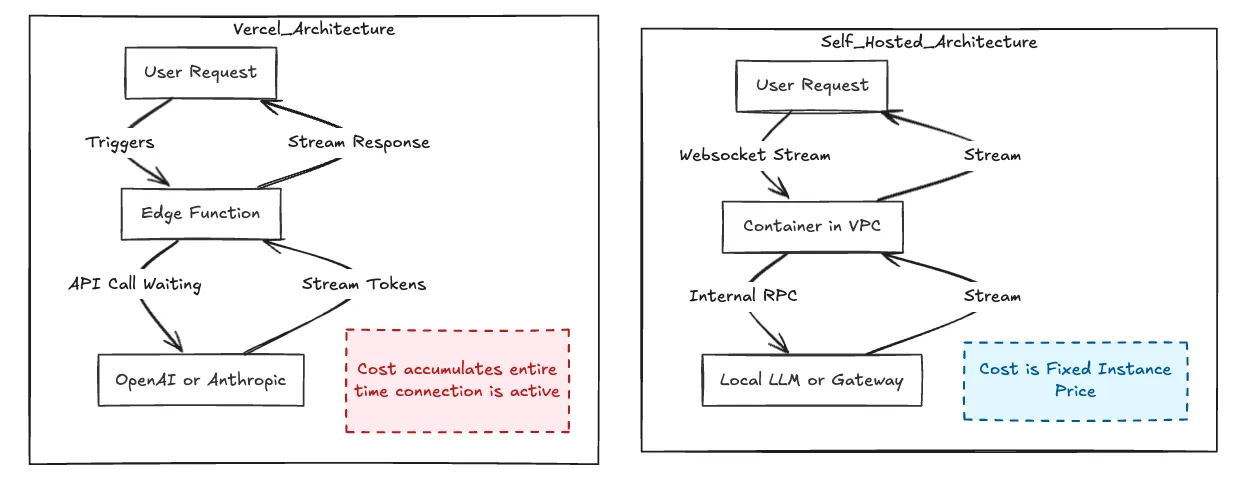

3. El modelo de costos de «duración de la función»

Los precios de Vercel Serverless Function se basan en gran medida en GB-segundos (asignación de memoria × duración).

- Aplicación web estándar: Una solicitud tarda 200 ms.

- Aplicación LLM: Una transmisión puede tardar entre 20 y 40 segundos.

El impacto en los costos:

Ejecutar una aplicación de IA de alto tráfico en un modelo sin servidor significa pagar por el tiempo de procesamiento mientras el servidor simplemente «espera» a que el LLM genere tokens. A gran escala, este modelo de facturación puede generar costos significativamente más altos en comparación con un servicio en contenedores que se ejecuta en instancias de costo fijo.

¿Cómo evaluamos estas alternativas?

Priorizamos las restricciones de ingeniería por encima de las afirmaciones de marketing. Las siguientes alternativas se puntuaron en función de cuatro criterios técnicos:

- Agnosticismo modelo y autoalojamiento: La plataforma debe admitir la implementación de modelos arbitrarios (Hugging Face weights, contenedores Docker) y la implementación en una VPC propiedad del cliente.

- Seguridad empresarial y cumplimiento: Soporte para controles de cumplimiento de SOC2, RBAC (control de acceso basado en roles) e implementaciones aisladas.

- Observabilidad: La capacidad de rastrear distintos pasos en una canalización de RAG y registrar las latencias (TTFT: Time To First Token).

- Flexibilidad del marco: La herramienta debe funcionar de forma independiente del ecosistema Next.js y ser compatible con los backends de Python (FastAPI/Flask) o Go.

Las 8 mejores alternativas de Vercel AI

1. True Foundry

Ideal para: Equipos que buscan la propiedad total de la infraestructura sin la complejidad de Kubernetes.

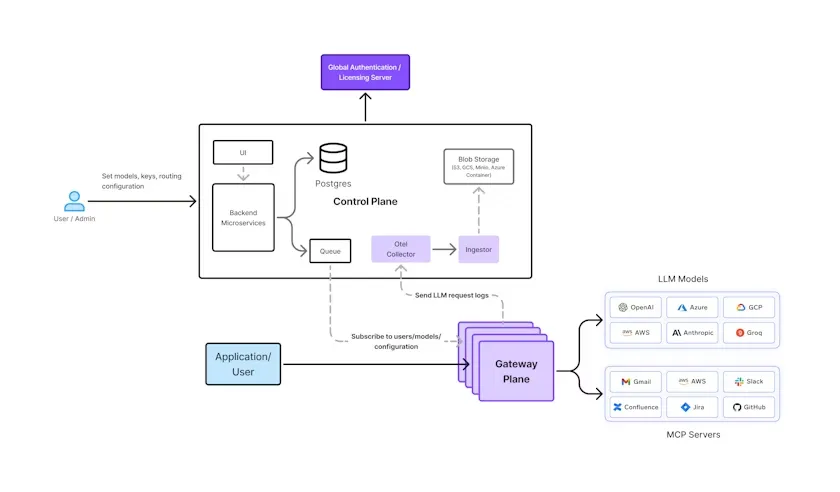

True Foundry funciona como una plataforma de aprendizaje automático como servicio (MLPaaS) que se instala directamente en la nube existente (AWS, GCP, Azure). A diferencia de Vercel, que abstrae la infraestructura para priorizar la velocidad de la interfaz, TrueFoundry abstrae la complejidad de Kubernetes y, al mismo tiempo, conserva el control total sobre la computación subyacente. Disocia el «cerebro» (inferencia/entrenamiento del modelo) de la «interfaz de usuario», lo que permite a los equipos implementar modelos de código abierto ajustados junto con la lógica de sus aplicaciones dentro de su propio perímetro de seguridad.

Características principales

- Registro e implementación de modelos: Despliegue con un solo clic de los modelos Hugging Face, estandarizando el empaquetado de pesas y contenedores Docker. Configura automáticamente los controladores CUDA y las solicitudes de recursos.

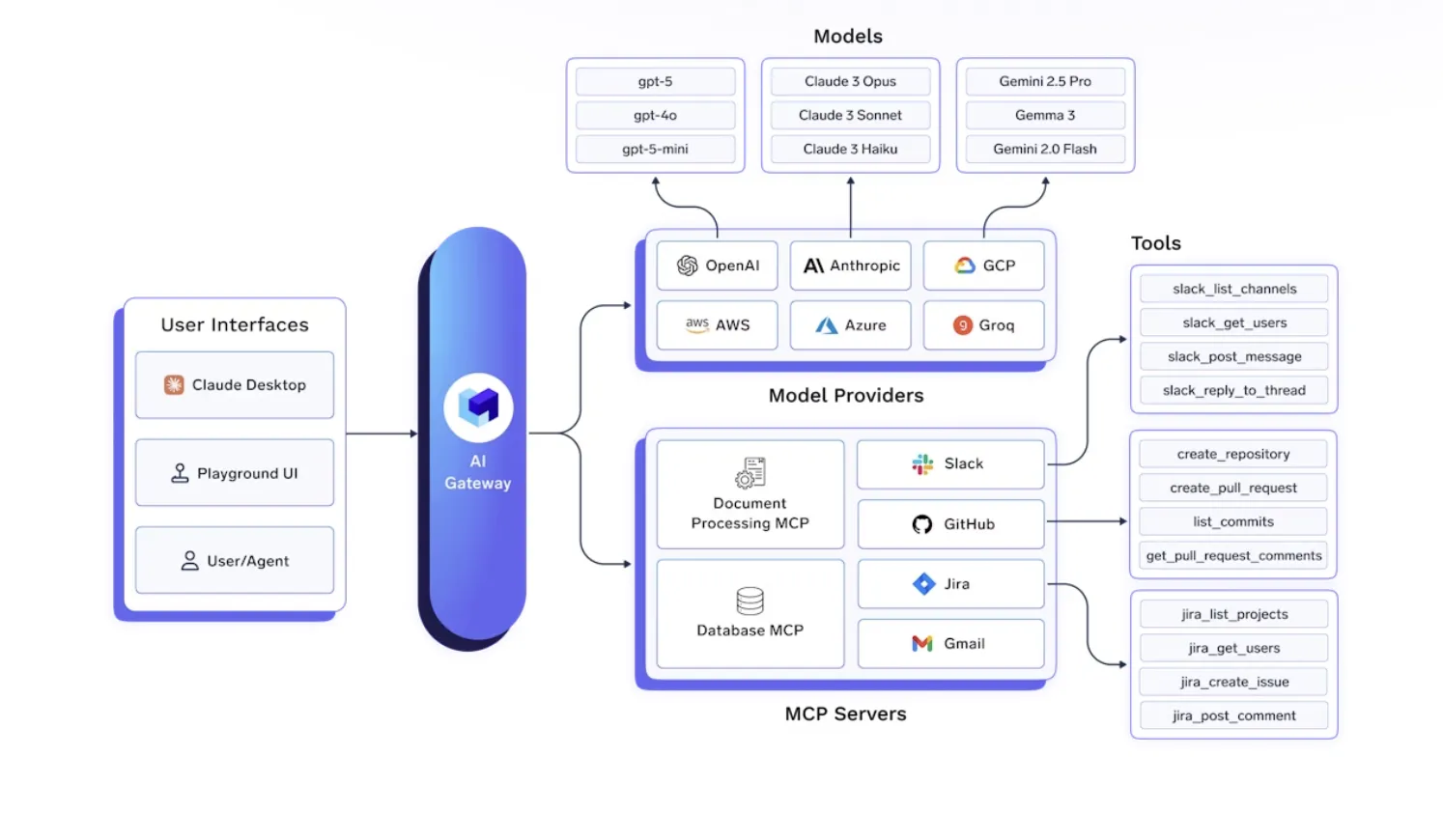

- Puerta de enlace LLM: Una capa de enrutamiento centralizada que normaliza las API de todos los proveedores (OpenAI, Azure, LLM locales). Gestiona la conmutación por error, los reintentos y el almacenamiento en caché.

- Panel de control de FinOps: Proporciona una visibilidad granular de los costos de inferencia y utilización de la GPU. Los usuarios pueden establecer límites presupuestarios por proyecto, lo cual es fundamental para Finops para IA.

- Trabajos de ajuste: Soporte nativo para la orquestación de LoRa/QLora para ajustar los trabajos con sus propios datos.

¿Por qué TrueFoundry?

TrueFoundry aborda la economía unitaria de escalar la IA. Al implementar servidores de inferencia en instancias reservadas o puntuales dentro de su VPC, los equipos pueden eliminar el aumento en la transferencia de datos y en el tiempo de ejecución sin servidor. Como los pesos del modelo y los datos son suyos, se agiliza el cumplimiento de los requisitos de soberanía de los datos (RGPD, HIPAA).

Fijación

- Plan para desarrolladores: Gratis para desarrolladores individuales y equipos pequeños.

- Plan Pro: Tarifa de administración basada en el uso (a partir de aproximadamente 0,03 USD/hora/vCPU).

- Empresa: Descuentos por volumen personalizados y garantías de SLA.

- Nota: Los usuarios pagan directamente a su proveedor de nube por los costos de procesamiento sin procesar.

2. Portkey

Ideal para: Equipos que desean una sensación de «sin servidor» con una mayor confiabilidad y capacidad de observación.

Portkey actúa como middleware entre la aplicación y los proveedores de modelos. Si bien no gestiona la infraestructura de GPU subyacente como TrueFoundry, refuerza las aplicaciones de IA basadas en API para la producción mediante un enrutamiento avanzado.

Características principales

- Puerta de enlace de IA: Firma de API unificada para más de 200 LLM con equilibrio de carga y respaldo.

- Observabilidad: Captura las métricas de latencia (P99, TTFT) y el costo por solicitud.

- Gestión rápida: Un CMS con control de versiones para las indicaciones.

Pros y contras

- Ventajas: Integración rápida; núcleo de código abierto disponible.

- Contras: Es estrictamente una capa intermedia: no aloja modelos personalizados ni administra la infraestructura de GPU.

3. LangChain y LangSmith

Ideal para: Flujos de trabajo de agencia complejos y lógica de aplicaciones.

Cadena LANG es un marco de orquestación, y Lang Smith es su plataforma complementaria para el rastreo. Se trata menos de un competidor de alojamiento que de una alternativa de capa lógica.

Características principales

- Rastreo profundo: Visualiza toda la cadena (Retrieval, LLM, Parser).

- Evaluación: Ejecute pruebas de regresión según las indicaciones de los «Golden Datasets».

Pros y contras

- Ventajas: Esencial para depurar agentes complejos.

- Contras: Curva de aprendizaje alta; la biblioteca añade una sobrecarga de abstracción en comparación con las llamadas a la API sin procesar.

4. Índice Llama

Ideal para: Canalizaciones RAG (generación aumentada de recuperación) avanzadas.

Índice Llama se centra específicamente en la ingesta y recuperación de datos. Es el componente de referencia para la parte de «contexto» de la pila, ya que ofrece un manejo de datos más profundo que las integraciones vectoriales básicas de Vercel.

Características principales

- Conectores de datos: Ingiera desde más de 100 fuentes (Notion, SQL, Discord).

- Indexación avanzada: Soporta índices jerárquicos y búsquedas híbridas.

Pros y contras

- Ventajas: Optimizado para el manejo de datos estructurados y no estructurados.

- Contras: No es una plataforma de servicio para modelos; requiere la integración con un proveedor de procesamiento.

5. Haystack de Deepset

Ideal para: Canalizaciones de búsqueda y control de calidad centradas en Python.

A diferencia del ecosistema centrado en JavaScript de Vercel, Pajar está basado en Python, lo que lo convierte en una opción estándar para los equipos de ciencia de datos que crean canalizaciones de PNL.

Características principales

- Tuberías modulares: Flujos de trabajo definidos como gráficos acíclicos dirigidos (DAG).

- Nube Deepset: Plataforma gestionada para implementar estas canalizaciones.

Pros y contras

- Ventajas: Nativo de Python; modular; sólido soporte empresarial.

- Contras: Mayor barrera de entrada para los desarrolladores de frontend acostumbrados a TypeScript.

6. Litell M

Ideal para: Administración de servidores proxy DIY.

Litell M es un servidor proxy ligero y de código abierto que estandariza los formatos de E/S según el esquema OpenAI. Es una alternativa autohospedada al enrutamiento del Vercel AI SDK.

Características principales

- Interfaz unificada: Llama a Bedrock, Azure y HuggingFace con cargas de chat estándar.

- Presupuestación: Establezca presupuestos por clave de API.

Pros y contras

- Ventajas: Baja latencia; sin dependencia de un proveedor.

- Contras: Autogestionado; requiere que te encargues del alojamiento y el escalado del proxy.

7. Pesos y sesgos (W&B)

Ideal para: Modele las métricas de capacitación y la pronta evaluación de ingeniería.

Pesos y sesgos se usa durante el desarrollo del modelo o la estrategia rápida (LLMOP), en lugar de durante el despliegue de la aplicación final.

Características principales

- Seguimiento de experimentos: Registra los hiperparámetros y las curvas de pérdida para ajustarlos con precisión.

- Indicaciones de W&B: Analiza el rendimiento rápido.

Pros y contras

- Ventajas: El estándar del sector para las métricas de aprendizaje automático.

- Contras: No es una plataforma de alojamiento: se integra con plataformas como TrueFoundry para la implementación.

8. Opciones nativas de la nube (AWS Bedrock/Azure OpenAI)

Ideal para: Equipos con un mandato de adquisición en una sola nube.

Los principales proveedores de nube ofrecen servicios gestionados para consumir modelos a través de API sin gestionar servidores, lo que mantiene los datos dentro de los límites de los contratos de nube. AWS Bedrock y Azure OpenAI permiten a los usuarios consumir modelos a través de una API sin administrar servidores, dentro del límite de cumplimiento de un contrato de nube existente.

Características principales

- Conectividad privada: Acceso a través de PrivateLink/puntos finales privados.

- Rendimiento aprovisionado: Capacidad de reserva (TPM) para garantizar la latencia.

Pros y contras

- Ventajas: Facturación consolidada y altos estándares de cumplimiento.

- Contras: La dependencia de un proveedor; la interfaz de usuario y la experiencia de usuario suelen ser menos intuitivas que las de las empresas emergentes especializadas.

Resumen: Selección de la arquitectura correcta

Para seleccionar la arquitectura correcta para 2026, asigne las principales restricciones de su equipo a las soluciones recomendadas a continuación.

Conclusión

Vercel es una plataforma de lanzamiento eficaz para la funcionalidad de la IA, pero su capa de abstracción puede convertirse en una limitación a medida que aumentan los requisitos técnicos. 2026 se definirá por la propiedad de la infraestructura. A medida que las funciones de la IA pasan de ser «útiles» a convertirse en un producto básico, es fundamental poder controlar el tiempo de ejecución de las inferencias, gestionar los costes de la GPU directamente y proteger los datos dentro de un límite privado.

La puerta de enlace de IA de TrueFoundry cierra la brecha entre la experiencia de los desarrolladores de Vercel y el rigor operativo requerido para la IA de producción. Proporciona a los equipos de ingeniería de plataformas los controles necesarios sin sacrificar la agilidad que esperan los desarrolladores de interfaces.

¿Está preparado para trasladar sus cargas de trabajo de IA a un entorno de nube seguro y de alto rendimiento? Reserva una demostración hoy para ver cómo TrueFoundry le brinda un control total sobre su pila de producción.

Preguntas frecuentes

¿Quiénes son los competidores de Vercel?

En general, los competidores de Vercel incluyen Netlify, AWS Amplify y Cloudflare Pages. En el ámbito de la infraestructura de inteligencia artificial, los principales competidores son TrueFoundry (que ofrece un control total de las pilas y el backend), AWS Bedrock (para los modelos gestionados) y Portkey (para las capacidades de puerta de enlace de API).

¿Hay algo mejor que Vercel?

Para sitios web sencillos y aplicaciones B2C, Vercel es una buena elección. Sin embargo, para los equipos que crean productos que priorizan la IA y requieren una implementación de modelos personalizados, ajustes o un cumplimiento estricto de las VPC, TrueFoundry suele ser la alternativa preferida, ya que elimina los costos generales del modelo sin servidor de Vercel.

¿Cloudflare es mejor que Vercel?

Cloudflare (específicamente Cloudflare Workers AI) ofrece una latencia más baja y unos costes informáticos competitivos para la inferencia perimetral. Sin embargo, la experiencia de desarrollador de Cloudflare está menos integrada con marcos como Next.js en comparación con Vercel. Para una orquestación de IA de nivel empresarial que va más allá de las simples funciones periféricas, TrueFoundry ofrece una suite de administración más completa que ambas.

¿Cómo apoyan las alternativas de Vercel a las aplicaciones empresariales?

Pasar de los pequeños proyectos a las aplicaciones empresariales implica más que alojar sitios estáticos en un nivel gratuito. Si bien la mayoría de las alternativas de Vercel se centran en la interfaz, TrueFoundry proporciona una plataforma en la nube con una gestión de la infraestructura empresarial. Ofrecemos redes privadas y de alta disponibilidad dentro de su ecosistema de AWS o la nube de Google para una infraestructura escalable.

¿Qué plataformas de implementación brindan el mejor soporte para los servicios en segundo plano?

TrueFoundry es la elección perfecta para administrar servicios web complejos y trabajadores en segundo plano. A diferencia de otras, nuestras plataformas de implementación incluyen funciones sobresalientes, como la automatización y el soporte de backend para máquinas virtuales. Los usuarios pueden vincular fácilmente su repositorio de GitHub a través de Git para activar la CI en entornos de nube seguros diseñados para sus necesidades específicas.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)