LangChain vs LangGraph: ¿Cuál es mejor para usted?

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Cuando se trata de crear aplicaciones basadas en modelos de lenguaje de gran tamaño (LLM), los desarrolladores ahora tienen más opciones que nunca. Dos de los marcos más comentados son LangChain y LangGraph. Si bien ambos tienen como objetivo simplificar el proceso de conectar los LLM con herramientas, datos y flujos de trabajo, adoptan enfoques muy diferentes. LangChain se ha convertido rápidamente en una de las bibliotecas más populares para crear aplicaciones impulsadas por la inteligencia artificial, ya que ofrece un amplio ecosistema de integraciones y abstracciones. Por otro lado, LangGraph, creada sobre Langchain, se centra en sistemas con estado similares a los de los agentes, y utiliza un modelo de ejecución basado en gráficos para gestionar el razonamiento complejo y las interacciones de varios pasos.

Si estás intentando decidir entre LangChain y LangGraph, es importante entender sus puntos fuertes, limitaciones y casos de uso ideales. Esta comparación le ayudará a evaluar qué marco se adapta mejor a su proyecto, ya sea que esté creando aplicaciones de LLM sencillas, agentes de IA robustos o soluciones empresariales escalables.

¿Qué es LangChain?

Cadena LANG es un marco de código abierto para diseñar aplicaciones de IA impulsadas por LLM. Ofrece a los desarrolladores una biblioteca de componentes modulares en Python y JavaScript que conectan los modelos de lenguaje con herramientas y fuentes de datos externas, a la vez que ofrece una interfaz coherente para la cadena de tareas, la administración rápida y el manejo de la memoria.

LangChain actúa como un puente entre las capacidades de LLM sin procesar y la funcionalidad del mundo real. Ayuda a los desarrolladores a crear flujos de trabajo denominados «cadenas», en los que cada paso implica generar texto, consultar una base de datos, recuperar documentos o invocar API externas, todo ello en una secuencia lógica. Esta estructura modular no solo acelera la creación de prototipos, sino que también promueve la claridad y la reutilización, lo que resulta útil si estás creando chatbots, resumiendo documentos, generando contenido o automatizando flujos de trabajo

Lanzado originalmente en octubre de 2022, LangChain evolucionó rápidamente hasta convertirse en un proyecto dinámico impulsado por la comunidad. Desde entonces, cientos de integraciones de herramientas y proveedores de modelos lo han adoptado, lo que permite cambiar fácilmente entre OpenAI, Hugging Face, Anthropic e IBM watsonx, entre otros. LangChain ofrece una forma elegante y estructurada de convertir los modelos lingüísticos en aplicaciones prácticas. Abstrae la complejidad, amplifica la flexibilidad y agiliza el desarrollo, lo que lo convierte en la opción ideal para los equipos que crean sistemas capaces basados en la LLM.

Funcionalidad principal de LangChain

LangChain está diseñado para simplificar la creación de aplicaciones impulsadas por LLM con flujos de trabajo lineales y paso a paso. Sus funcionalidades principales incluyen:

- Encadenamiento rápido: Combine varias indicaciones en una secuencia, de forma que el resultado de un paso pase al siguiente.

- Administración de memoria: Conserve el contexto a corto plazo, como el historial de conversaciones, mediante componentes de memoria modular.

- Integración de documentos y datos: Cargue, divida y recupere información de archivos PDF, páginas web y bases de datos vectoriales.

- Integración de LLM y API: Conéctese sin problemas a múltiples proveedores de LLM, API y herramientas externas.

- Prototipado rápido: Ensamble cadenas rápidamente para realizar pruebas y experimentos sin una configuración compleja.

- Administración del flujo de trabajo: Admite la ramificación simple y la ejecución secuencial de tareas, ideal para resumir, responder preguntas o generar contenido.

¿Qué es LangGraph?

Gráfico de largo es un marco de código abierto del equipo de LangChain que ayuda a los desarrolladores a crear flujos de trabajo de agentes de IA más inteligentes y adaptables. En lugar de ejecutar las tareas en línea recta como en una cadena tradicional, LangGraph las organiza en un gráfico, donde cada «nodo» representa una tarea y los «bordes» definen cómo se conectan esas tareas. Este diseño permite crear flujos que pueden ramificarse, repetirse y mantener el estado, lo que brinda a los agentes la flexibilidad necesaria para gestionar escenarios más complejos.

Una de las principales fortalezas de LangGraph es que apoya a los agentes que conocen el estado desde hace mucho tiempo. Si un agente detecta un error o necesita hacer una pausa, puede continuar exactamente donde lo dejó. También puedes incorporar puntos de control humanos para que una persona pueda revisar o ajustar una acción antes de que el agente avance. Además, LangGraph puede recordar las interacciones pasadas y el contexto a lo largo del tiempo, lo cual es esencial para crear agentes que aprendan y se adapten.

También viene con sólidas características de producción. Los desarrolladores pueden supervisar los flujos de trabajo con herramientas como LangSmith, que proporcionan una depuración visual, registros detallados y una visibilidad total de la forma en que un agente toma decisiones. LangGraph puede ejecutarse localmente o implementarse en plataformas administradas como LangGraph Platform y Studio. LangGraph está diseñado para ofrecer confiabilidad, flexibilidad y transparencia, lo que lo convierte en una opción sólida para sistemas de IA complejos que van más allá de la simple automatización paso a paso.

Funcionalidad principal de LangGraph

LangGraph está diseñado para flujos de trabajo dinámicos, con estado y de múltiples agentes, y ofrece funciones que van más allá de la ejecución lineal de tareas. Sus funcionalidades principales incluyen:

- Administración del flujo de trabajo basada en gráficos: Cree flujos de trabajo complejos con bucles, bifurcaciones y revisión de estados anteriores.

- Administración explícita del estado: Control total sobre el estado del flujo de trabajo, lo que permite procesos de larga duración, reintentos y seguimiento de decisiones en varios pasos.

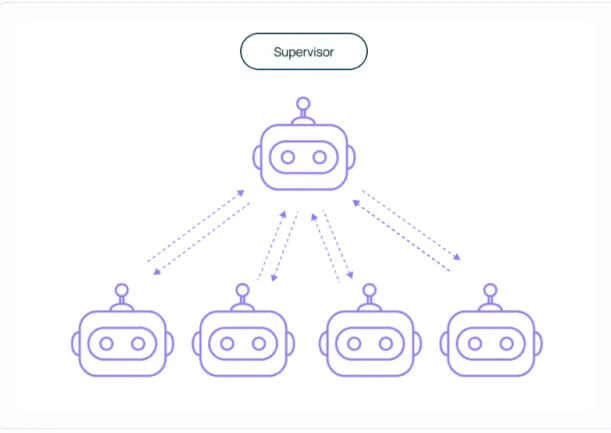

- Orquestación de múltiples agentes: Coordine varios agentes de IA, cada uno con funciones especializadas, dentro de un único flujo de trabajo conectado.

- Ejecución adaptativa: Gestione entradas dinámicas, rutas condicionales y escenarios alternativos sin interrumpir el flujo.

- Integración y monitoreo: Herramientas como LangGraph Studio y LangSmith permiten la depuración, el registro y la visualización en tiempo real de los flujos de trabajo de los agentes.

- Manejo de tareas resiliente: Soporta la recuperación de errores, los reintentos y los puntos de control para aplicaciones sólidas y listas para la producción.

Ahora que hemos cubierto los conceptos básicos de LangGraph y LangChain. Profundicemos en la diferencia entre LangChain y LangGraph.

LangChain frente a LangGraph

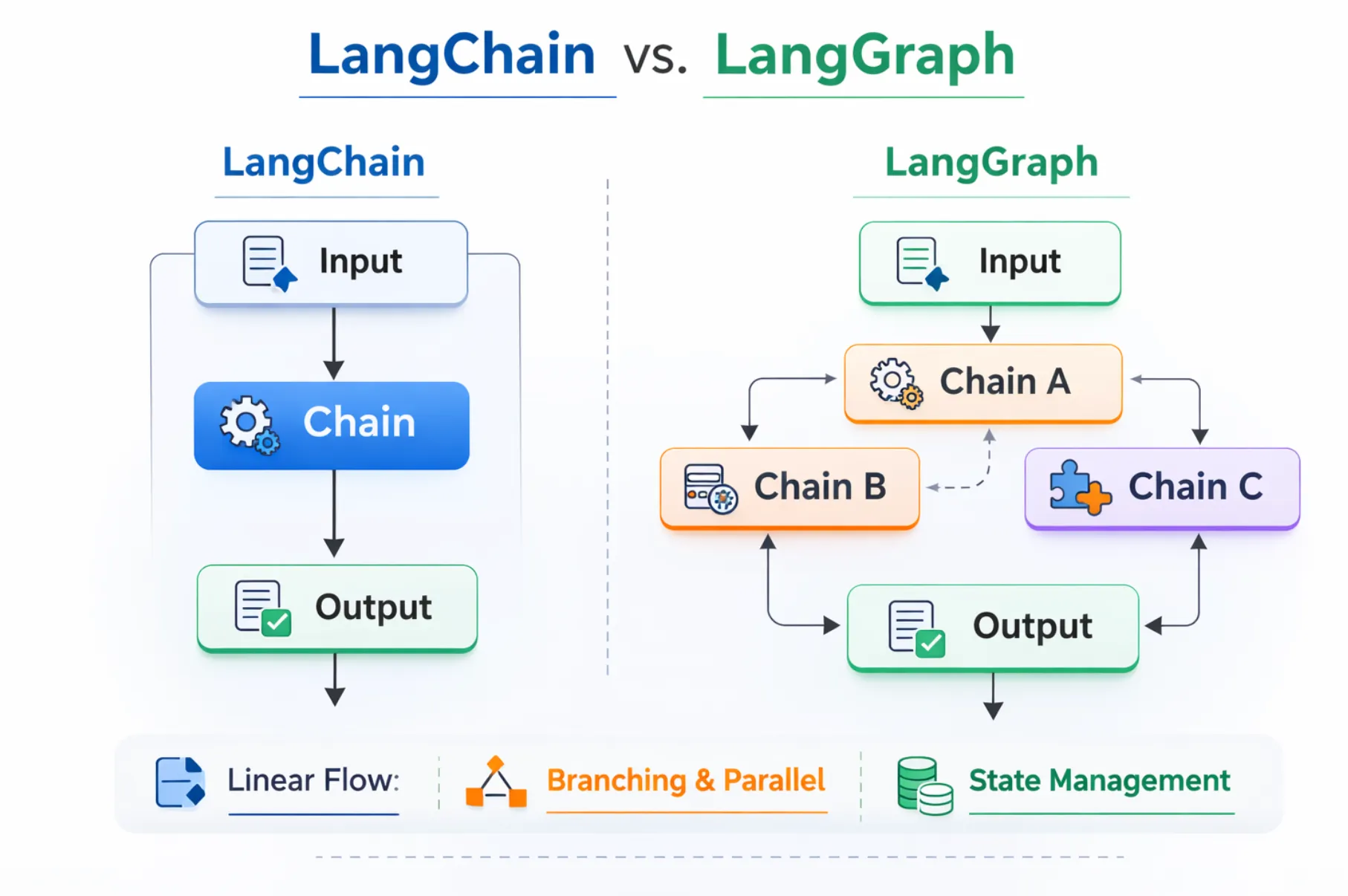

LangChain está diseñado para hacer que los flujos de trabajo complejos impulsados por LLM parezcan simples e intuitivos. Se destaca cuando las tareas siguen un patrón secuencial y predecible, recopilan datos, resumen, responden preguntas, etc. Su diseño modular ofrece componentes básicos listos para usar, como cadenas, memoria, agentes y herramientas, lo que agiliza la creación de prototipos y facilita la codificación. Si quieres crear rápidamente un flujo de trabajo que siga una ruta conocida, LangChain es tu mejor opción.

Por otro lado, LangGraph le brinda potencia y flexibilidad cuando las cosas comienzan a interrumpirse o se interrumpen. En lugar de secuencias lineales, diseñas flujos de trabajo basados en gráficos con nodos, bordes, estados explícitos, reintentos, lógica ramificada e incluso puntos de control interconectados por humanos. Destaca cuando la aplicación necesita adaptarse, retroceder, repetir o recordar un contexto de larga duración, pensar en agentes de varias etapas, árboles de decisiones complejos o asistentes virtuales que necesitan razonar a lo largo del tiempo.

Explicación de la comparación de funciones clave

flujo de trabajo

- Cadena LANG: Funciona mejor con secuencias lineales o DAG (gráficos acíclicos dirigidos) simples. Ideal para tareas paso a paso en las que el resultado de un paso repercute directamente en el siguiente.

- Gráfico de LangGraph: Diseñado para flujos de trabajo completos basados en gráficos, que admiten bucles, bifurcaciones y revisión de estados anteriores. Perfecto para procesos adaptativos o iterativos.

Administración estatal

- Cadena LANG: Gestiona el estado de forma implícita, lo que significa que la memoria o el contexto se mantienen mediante módulos integrados, pero el seguimiento complejo del estado en varios pasos puede ser limitado.

- Gráfico de LangGraph: Proporciona un control explícito sobre el estado, lo que permite a los desarrolladores gestionar con precisión los flujos de trabajo prolongados, los reintentos y las interacciones entre varios agentes.

Facilidad de uso

- Cadena LANG: Sencillo y fácil de usar para desarrolladores, lo que lo hace ideal para la creación rápida de prototipos y una configuración rápida.

- Gráfico de LangGraph: Más complejo debido a su arquitectura basada en gráficos, que requiere una planificación cuidadosa, pero ofrece una mayor flexibilidad para los flujos de trabajo dinámicos.

Complejidad

- Cadena LANG: Adecuado para tuberías sencillas y directas de ramificación. Una configuración mínima mantiene el desarrollo limpio y fácil de mantener.

- Gráfico de LangGraph: Diseñado para gestionar bucles, reintentos, coordinación de múltiples agentes y procesos avanzados de toma de decisiones. Ideal para aplicaciones complejas que requieren una lógica adaptativa.

Producción

- Cadena LANG: Un ecosistema sólido con integraciones para múltiples LLM, bases de datos vectoriales y herramientas de terceros. Excelente para un despliegue y una experimentación rápidos.

- Gráfico de LangGraph: Proporciona prototipado visual y supervisión a través de su plataforma, que incluye herramientas como LangGraph Studio y LangSmith, lo que facilita la depuración y el seguimiento de los flujos de trabajo de los agentes en producción.

¿Cuándo usar LangChain?

LangChain es mejor cuando su proceso avanza paso a paso sin ramificaciones frecuentes, bucles o una administración de estados compleja.

Flujos de trabajo simples y lineales

LangChain es ideal para tareas que siguen una secuencia clara sin ramificaciones complejas. Por ejemplo, traducir textos o resumir documentos en un solo paso.

desde langchain.chat_models importar ChatOpenAI

desde langchain.prompts importar ChatPromptTemplate

prompt = chatPromptTemplate.from_template («Resume este texto: {text}»)

modelo = ChatOpenAI ()

cadena = mensaje | modelo

output = chain.invoke ({"text»: «LangChain simplifica el trabajo con LLM."})

imprimir (salida)

Prototipado rápido

La biblioteca de conectores prediseñados de Langchain (LLM, bases de datos, API) permite a los desarrolladores ensamblar y probar flujos de trabajo rápidamente. Útil para proyectos de prueba de concepto o iteraciones rápidas.

Memoria a corto plazo y experimentación

Con los módulos de memoria integrados, LangChain puede retener el contexto temporalmente. Esto resulta útil para los experimentos de chat, las pruebas de investigación o las instrucciones de varios pasos que no requieren un estado prolongado.

desde langchain.memory importar ConversationBufferMemory

desde langchain.chains importar ConversationChain

desde langchain.llms importar OpenAI

memoria = ConversationBufferMemory ()

conversación = cadena de conversación (LLM=openAI (), memoria=memoria)

conversation.run («Explique LangChain para principiantes»).

conversation.run («Haga un resumen de una línea de su explicación»).

Aplicaciones centradas y fáciles de mantener

Para las aplicaciones que no necesitan bucles, lógica adaptativa ni orquestación de múltiples agentes, LangChain mantiene los flujos de trabajo sencillos, modulares y fáciles de administrar.

desde langchain.chains importar SimpleSequentialChain, LLMChain

desde langchain.prompts importar PromptTemplate

desde langchain.llms importar OpenAI

llm = OpenAI ()

prompt = promptTemplate (Template="Traducir al francés: {text}», input_variables= ["text"])

cadena = llmChain (llm=llm, prompt=prompt)

seq_chain = SimpleSequentialChain (cadenas = [cadena])

print (seq_chain.run («Hola, ¿cómo estás?»))

Elija LangChain cuando se centre en crear flujos de trabajo de LLM claros, estructurados y bien integrados con una configuración mínima y la máxima flexibilidad.

¿Cuándo usar LangGraph?

LangGraph es ideal para flujos de trabajo dinámicos y adaptables en los que se requiere el seguimiento del estado, la bifurcación o la orquestación de varios agentes. Es el más adecuado para los agentes de IA y los sistemas complejos que necesitan revisar los pasos, gestionar rutas alternativas o mantener el contexto a lo largo del tiempo.

Flujos de trabajo adaptables con bucles y ramificaciones

Utilice LangGraph cuando su proceso necesite cambiar de dirección, volver a intentar pasos o gestionar decisiones en varias etapas.

desde langgraph importar StateGraph

def process_input (estado):

input_data = estado ["entrada"]

result = input_data.upper () # transformación simple

return {"result»: resultado, «input»: input_data}

grafo = stateGraph ()

graph.add_node («procesador», process_input)

graph.add_edge («processor», «processor») # bucle inverso para volver a intentarlo

output = graph.run ({"input»: «hola mundo"})

imprimir (salida)

Procesos con estado y de larga duración

LangGraph proporciona una administración de estado explícita, lo que lo hace perfecto para los flujos de trabajo que deben preservar el contexto durante varios pasos o sesiones.

def agent_step (estado):

state ["history"] .append (state ["input"])

return {"history»: state ["history"], «input»: state ["next_input"]}

grafo = stateGraph ()

graph.add_node («agente», agent_step)

result = graph.run ({"history»: [], «input»: «Paso 1", «next_input»: «Paso 2"})

imprimir (resultado)

Orquestación de múltiples agentes

Langgraph coordina varios agentes de IA con funciones especializadas en un único flujo de trabajo. Repetir pasos, bifurcar y volver a intentarlo mientras se mantiene un estado uniforme.

def agent1 (estado):

return {"message»: «Agent1 procesado» + state ["data"]}

def agent2 (estado):

return {"message»: «Agent2 confirmado» + state ["message"]}

grafo = stateGraph ()

graph.add_node («A1", agente1)

graph.add_node («A2", agente2)

graph.add_edge («A1", «A2")

output = graph.run ({"data»: «información de la tarea"})

imprimir (salida)

Monitorización del nivel de producción

LangGraph se integra con LangSmith y LangGraph Studio para proporcionar registro, depuración y supervisión en tiempo real de los flujos de trabajo de los agentes. Perfecto para aplicaciones complejas en las que la transparencia y la gestión de errores son importantes.

Utilice LangGraph cuando su aplicación requiera flujos de trabajo dinámicos, con estado y adaptables. Se destaca en sistemas con múltiples agentes, en la orquestación de inteligencia artificial y en procesos en los que la memoria, el contexto y la lógica de ramificación son fundamentales.

LangChain vs LangGraph: ¿cuál es mejor?

Tanto LangChain como LangGraph son herramientas excelentes, pero resuelven problemas diferentes. Decidir qué es lo mejor para usted depende de la complejidad de sus flujos de trabajo y del tipo de control que necesita sobre ellos.

Cuándo LangChain podría ser la mejor opción

LangChain es perfecto si su aplicación sigue un proceso claro y paso a paso. Funciona bien cuando el flujo de trabajo es predecible, sin ramificaciones ni bucles frecuentes. Por ejemplo, puedes usar LangChain para:

- Cree un chatbot que responda a las preguntas mediante un único ciclo de respuesta rápida

- Crear una herramienta de resumen o generación de contenido

- Implemente la generación aumentada de recuperación (RAG) para una búsqueda rápida de información

Sus principales puntos fuertes son la velocidad, la simplicidad y una amplia biblioteca de integraciones. Esto hace que LangChain sea especialmente atractivo para la creación de prototipos, los proyectos pequeños y medianos y el uso educativo, donde hacer que algo funcione rápidamente es más importante que gestionar casos extremos o ramificaciones complejas.

Cuando LangGraph se destaca

LangGraph brilla en situaciones en las que la aplicación debe adaptarse, retroceder o ejecutarse durante un período más largo mientras realiza un seguimiento del estado. Está diseñado para flujos de trabajo similares a los de un agente que pueden:

- Recorra los pasos hasta que se cumpla una condición

- Haga una pausa y reanude exactamente donde lo dejaron

- Utilice puntos de control humanos para la verificación o los ajustes

Esto convierte a LangGraph en la opción más sólida para sistemas con múltiples agentes, toma de decisiones complejas e implementaciones de nivel de producción en las que la flexibilidad y la resiliencia son fundamentales.

Cómo decidir

Si aún no estás seguro, ten en cuenta estos puntos de referencia:

- Complejidad del flujo: Si es principalmente lineal, comience con LangChain. Si tiene bucles, ramificaciones y lógica adaptativa, opta por LangGraph.

- Requisitos estatales: Si solo necesita memoria a corto plazo para una sola ejecución, LangChain servirá. Si necesitas un estado persistente y controlable, LangGraph es mejor.

- Planes a largo plazo: Si su aplicación puede convertirse en un sistema más complejo más adelante, LangGraph puede ahorrarle un paso de migración.

Diablillo:

LangChain es la opción rápida y accesible para flujos de trabajo simples o moderadamente complejos. LangGraph es la opción sólida y flexible para sistemas de IA dinámicos y de alta complejidad. Ambos forman parte del mismo ecosistema, por lo que puede empezar con uno y hacer la transición al otro si sus necesidades cambian. Tu elección debe estar en consonancia con el alcance actual de tu proyecto y tus objetivos de escalabilidad futuros.

Casos de uso reales de LangChain y LangGraph

Diferentes empresas utilizan LangChain o LangGraph en función de la complejidad y el tipo de flujo de trabajo que necesitan. Por lo general, LangChain se elige para tareas lineales y paso a paso, mientras que LangGraph gestiona procesos dinámicos, con estados y con múltiples agentes.

Por qué las pasarelas de IA son importantes para los usuarios de Langchain/LangGraph

Cuando construyes con LangChain o LangGraph, estás creando potentes flujos de trabajo impulsados por LLM. Sin embargo, lograr que funcionen de manera confiable, rentable y segura en la producción requiere algo más que una simple orquestación. Aquí es donde un Puerta de enlace de IA entra. Actúa como la capa de control entre la aplicación y los modelos que utiliza, lo que garantiza un enrutamiento fluido, un seguimiento de los costos, una administración rápida y la seguridad.

Crear un flujo de trabajo en LangChain o LangGraph es solo el primer paso. Una vez que se pasa a la producción, administrar el aspecto operativo del uso del LLM se vuelve tan importante como diseñar el flujo de trabajo en sí. Una puerta de enlace de inteligencia artificial actúa como una capa de control y le ayuda a dirigir las solicitudes al modelo más adecuado, supervisar el rendimiento y mantener sus aplicaciones funcionando sin problemas.

Sin esta capa, es fácil encontrarse con problemas como la latencia impredecible, el aumento de los costos o el uso rápido e inconsistente en diferentes partes del sistema. Las pasarelas de IA brindan la visibilidad y el control necesarios para mantener el rendimiento, optimizar los gastos y mantener seguros los puntos finales de LLM.

Cómo complementa TrueFoundry a LangChain y LangGraph

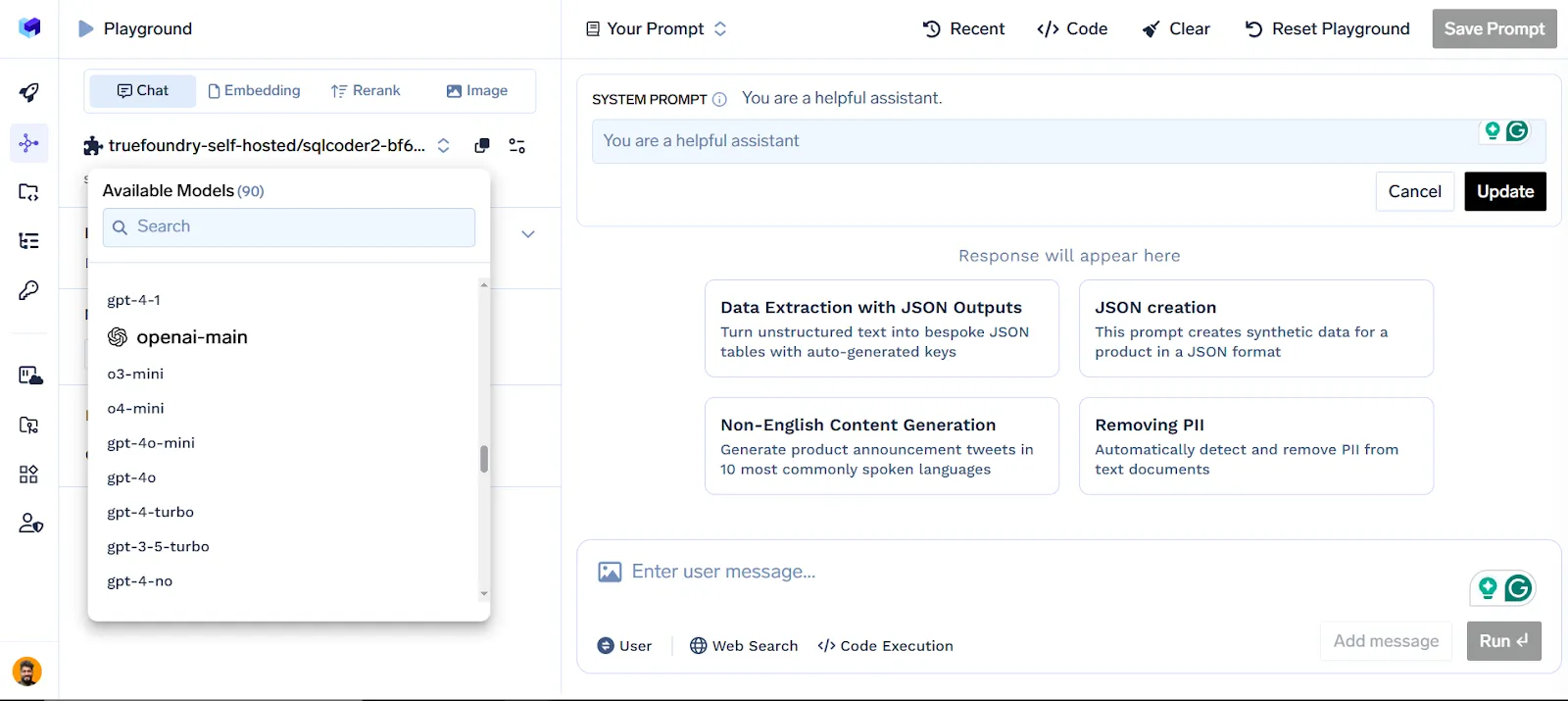

TrueFoundry AI Gateway amplía las capacidades de sus flujos de trabajo de LLM al ofrecer:

Administración centralizada de LLM: Conecte y administre varios proveedores de modelos, como OpenAI, Anthropic y Hugging Face, desde un panel de control.

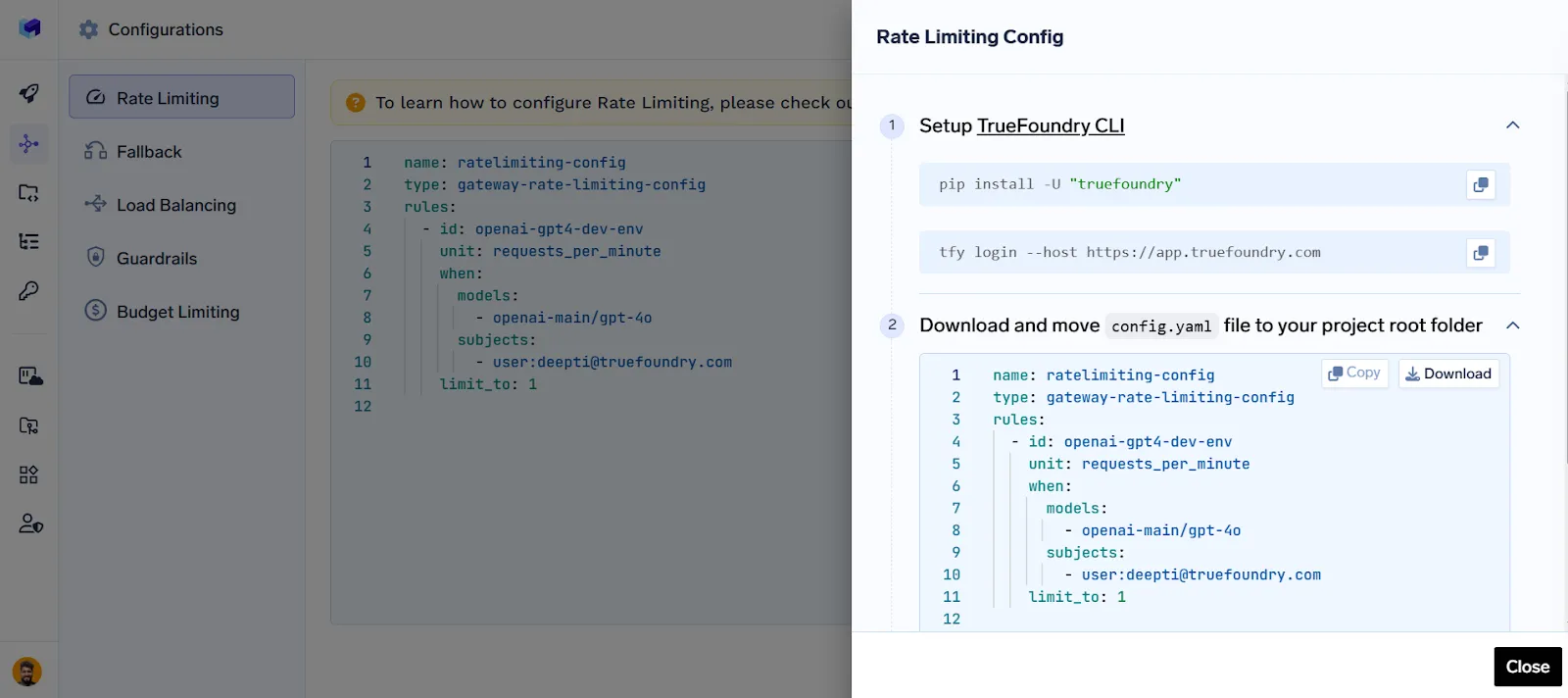

Enrutamiento, limitación de velocidad, respaldo, barandas y equilibrio de carga: Optimice el flujo de solicitudes, controle el uso, garantice la seguridad de los resultados, cambie a copias de seguridad en caso de error y equilibre el tráfico entre los modelos.

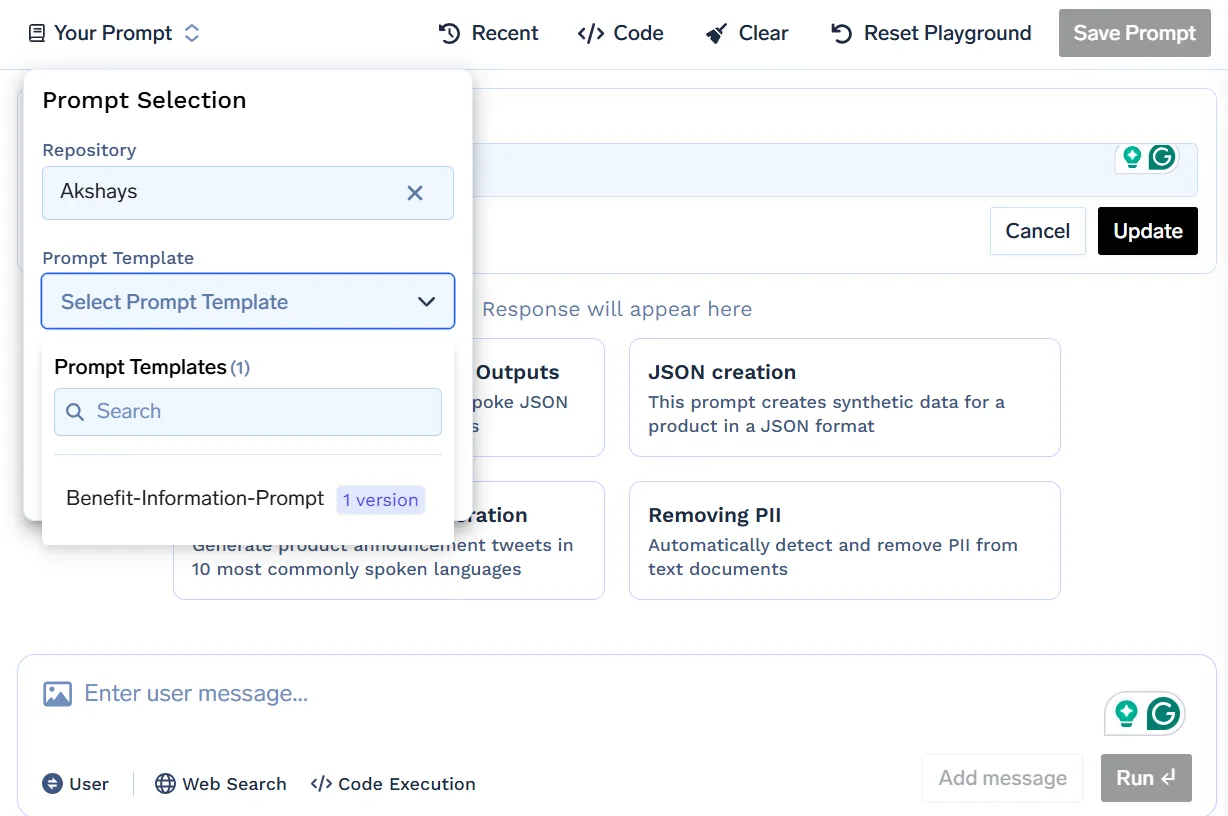

Gestión rápida: Indicaciones de versión, prueba y reversión sin interrupciones en su sistema activo.

Observabilidad, rastreo y depuración: Supervise la latencia, el uso de los tokens y las tasas de error en tiempo real, y haga un seguimiento de cada solicitud a lo largo de su flujo de trabajo para facilitar la depuración y la optimización.

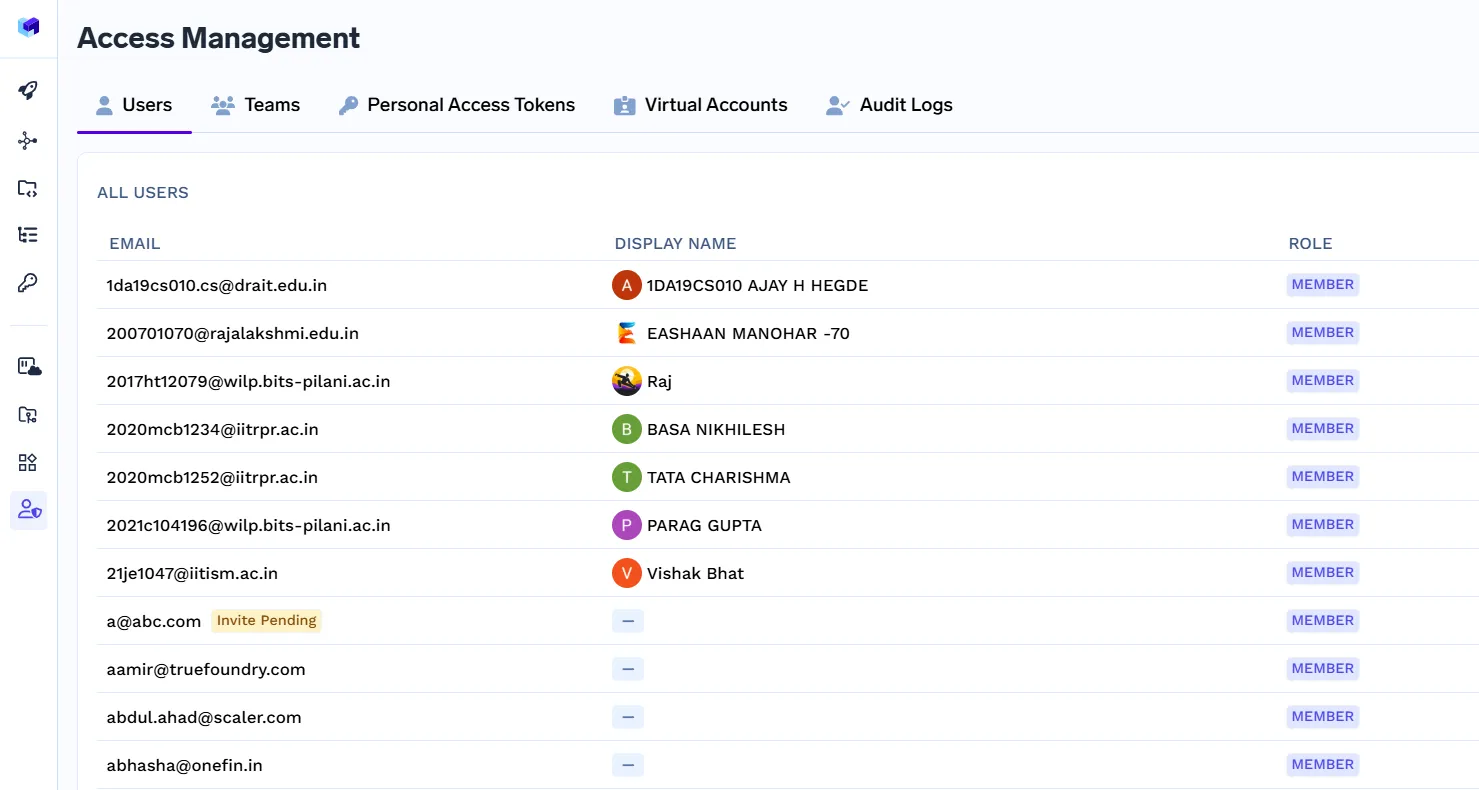

Control de acceso, RBAC y cumplimiento: Defina quién puede acceder a los recursos mediante el control de acceso basado en funciones y mantenga seguridad de IA de nivel empresarial y gobernanza.

Por qué se destaca TrueFoundry

True Foundry admite más de 250 LLM listos para usar, lo que le brinda la máxima flexibilidad. Está diseñado para ofrecer un rendimiento de nivel de producción y ofrece almacenamiento en caché, limitación de velocidad y análisis avanzados. Ya sea que esté ejecutando una secuencia de LangChain simple o una red compleja de agentes de LangGraph, se integra a la perfección.

Con funciones de cumplimiento, gobierno de datos y seguridad listas para la empresa, TrueFoundry garantiza que sus flujos de trabajo de LLM no solo sean funcionales, sino también sólidos, escalables y seguros.

Conclusión

Tanto LangChain como LangGraph son herramientas poderosas para crear aplicaciones impulsadas por LLM, cada una de las cuales sobresale en diferentes escenarios. LangChain es ideal para flujos de trabajo lineales más simples que se benefician de la creación rápida de prototipos y de amplias integraciones, mientras que LangGraph está diseñado para sistemas de agentes complejos, adaptables y con buen estado. La elección del más adecuado depende de la complejidad del proyecto y de los objetivos a largo plazo. Independientemente de su elección, combinar estos marcos con TrueFoundry como su puerta de enlace de inteligencia artificial garantiza que sus flujos de trabajo sean seguros, eficientes y listos para la producción. Con la combinación adecuada, puede pasar del concepto a soluciones de IA sólidas y escalables con confianza.

Preguntas frecuentes

¿LangGraph reemplazará a LangChain?

No. LangGraph y LangChain tienen diferentes propósitos. LangChain está optimizado para flujos de trabajo de LLM lineales y paso a paso y para la creación rápida de prototipos, mientras que LangGraph está diseñado para flujos de trabajo dinámicos, con múltiples agentes y con estados. Cada uno tiene su nicho y uno no reemplaza al otro; pueden complementarse en sistemas complejos.

¿Podemos usar LangGraph sin LangChain?

Sí. LangGraph puede funcionar de forma independiente para gestionar los flujos de trabajo basados en gráficos, los sistemas multiagente y los procesos con estado. Si bien los componentes de LangChain se pueden integrar para determinadas tareas, no se necesita LangChain para crear o ejecutar aplicaciones en LangGraph, lo que lo hace flexible para flujos de trabajo complejos sin dependencias lineales.

¿LangGraph es propiedad de LangChain?

No. LangGraph está desarrollado por la misma organización detrás de LangChain, pero es un marco independiente. Se centra en la orquestación basada en gráficos y en los flujos de trabajo con múltiples agentes. Si bien comparten algunas integraciones y filosofías de diseño, LangGraph se administra de forma independiente y tiene sus propias herramientas, como LangGraph Studio y LangSmith.

¿Necesito aprender LangChain antes de LangGraph?

No necesariamente. Puede empezar directamente con LangGraph, especialmente si su aplicación requiere flujos de trabajo complejos, bucles u orquestación de varios agentes. Sin embargo, estar familiarizado con LangChain puede ayudar a comprender los componentes modulares de LLM, el encadenamiento rápido y los flujos de trabajo básicos, lo que puede acelerar el aprendizaje de LangGraph para configuraciones híbridas.

¿Cuáles son las limitaciones de LangGraph?

La complejidad de LangGraph puede ser una limitación para proyectos sencillos. Tiene una curva de aprendizaje más pronunciada que la de LangChain, y los flujos de trabajo más pequeños pueden estar sobrediseñados utilizando su estructura de gráficos. Además, su orquestación multiagente requiere una gestión del estado, una planificación y una supervisión cuidadosas, lo que la hace menos idónea para la creación rápida de prototipos.

¿LangGraph es un superconjunto de LangChain?

No. LangGraph no es un superconjunto de LangChain. Si bien admite flujos de trabajo avanzados que LangChain no puede gestionar de manera eficiente, no incluye automáticamente todas las utilidades de flujo de trabajo lineal ni los conectores prediseñados de LangChain. Son marcos complementarios, cada uno optimizado para tipos de flujo de trabajo y casos de uso específicos.

¿Cuál es la diferencia entre la memoria LangGraph y la memoria LangChain?

La memoria LangChain es implícita y modular, por lo general para la retención de contexto a corto plazo, como el historial de chat. Por otro lado, la memoria de LangGraph es explícita, lo que brinda a los desarrolladores un control total sobre el seguimiento del estado, el contexto de varios agentes y los flujos de trabajo prolongados. La memoria LangGraph es mejor para sistemas complejos y adaptables, mientras que la memoria LangChain se adapta a tareas lineales y más sencillas.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)