Kong frente a Portkey: ¿Qué puerta de enlace de IA funciona para la infraestructura de LLM empresarial?

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

A medida que los grandes modelos lingüísticos pasan de la experimentación a la producción, los equipos se están replanteando la forma en que se debe gestionar, proteger y observar el tráfico de IA. Lo que antes parecía una simple integración de API, ahora implica solicitudes, tokens, enrutamiento de modelos, reintentos, seguimiento de costos y problemas de confiabilidad para los que la infraestructura de aplicaciones tradicional nunca se diseñó.

Muchos equipos de ingeniería comienzan este viaje ampliando las puertas de enlace de API conocidas, como Kong, aprovechando los patrones de enrutamiento, autenticación y limitación de velocidad existentes. A medida que crece el uso de la LLM, las pasarelas nativas de la IA, como Portkey entra en escena, ofreciendo abstracciones adaptadas a las indicaciones, los modelos y la observabilidad a nivel de fichas.

Ambos enfoques tienen como objetivo resolver problemas reales, pero provienen de puntos de partida fundamentalmente diferentes. Kong se basa en la gestión de microservicios y API HTTP, mientras que Portkey está diseñado específicamente para los flujos de trabajo de aplicaciones de LLM. Las diferencias entre estas filosofías se vuelven cada vez más importantes a medida que los sistemas de IA se expanden entre equipos, entornos y casos de uso de producción.

En este artículo, comparamos Kong y Portkey en cuanto a arquitectura, observabilidad, gobierno y preparación empresarial. Analizaremos dónde encaja mejor cada herramienta, dónde comienzan a aparecer limitaciones y qué plataformas deben considerar los equipos a medida que la IA se convierte en una parte fundamental de su infraestructura.

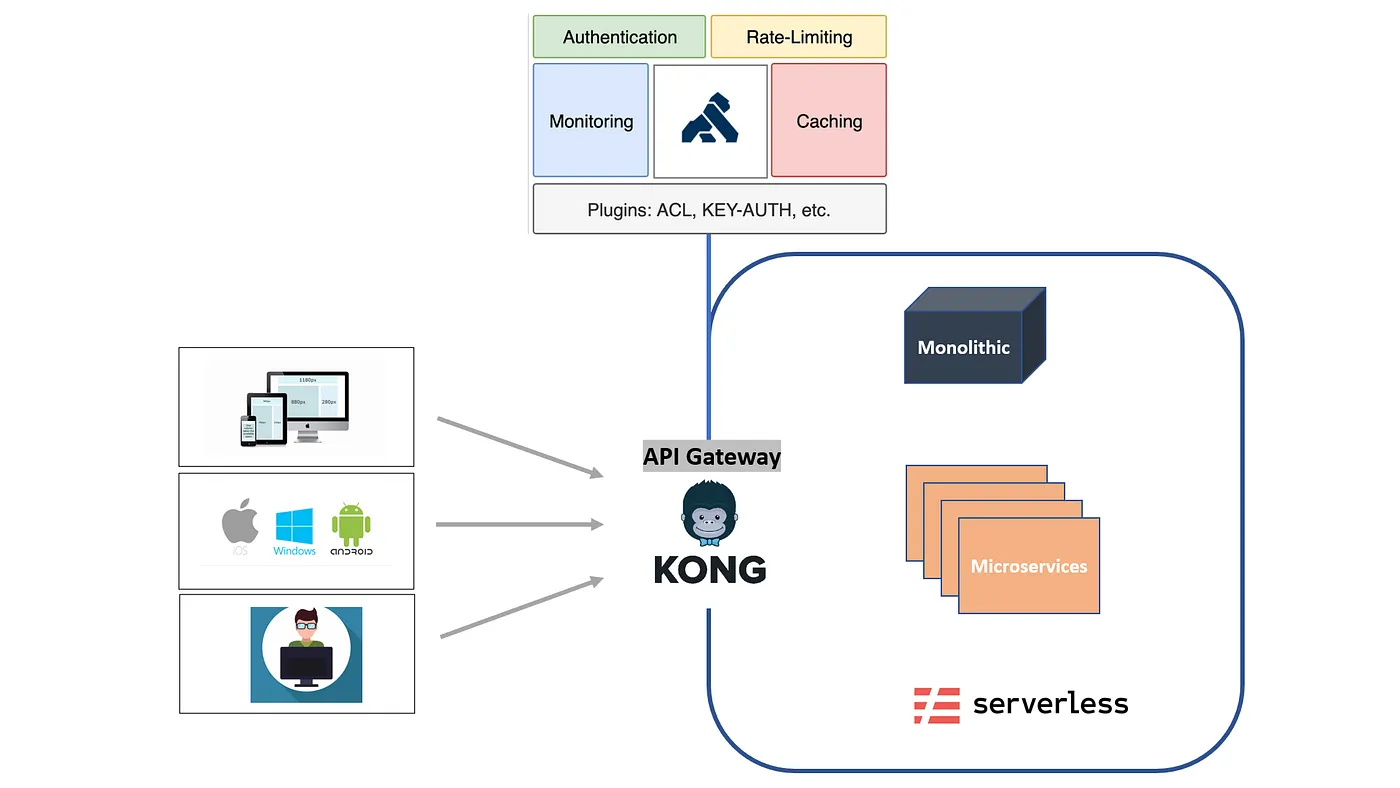

¿Qué es Kong?

Kong es una puerta de enlace de API ampliamente adoptada creada para administrar, proteger y enrutar el tráfico HTTP entre microservicios. Se utiliza habitualmente como capa de entrada en las arquitecturas basadas en Kubernetes y es conocida por su capacidad de gestionar cuestiones como la autenticación, la limitación de velocidad, el enrutamiento del tráfico y la observabilidad a nivel de solicitud.

Desde un punto de vista arquitectónico, Kong está optimizado para Sistemas que priorizan las API. Sus abstracciones principales giran en torno a los puntos finales, los servicios, las rutas y los complementos, lo que la convierte en una opción perfecta para los entornos tradicionales de backend y microservicios, en los que las solicitudes no tienen estado, son predecibles y uniformes.

Donde Kong funciona bien

- Gestión avanzada del tráfico de API: Soporte sólido para la autenticación, la limitación, los reintentos y el equilibrio de carga

- Implementaciones nativas de Kubernetes: Funciona bien como capa de entrada o puerta de enlace en pilas nativas de la nube

- Ecosistema de complementos ampliable: Los equipos pueden personalizar el comportamiento mediante complementos y middleware

- Familiaridad operativa: Los equipos de plataforma a menudo ya utilizan Kong para cargas de trabajo que no son de IA

Uso de Kong para cargas de trabajo de LLM

A medida que los equipos introducen los LLM, Kong suele ser el primera herramienta reutilizada para gestionar el tráfico de IA: tratar las llamadas de LLM como un punto final de API más. Esto funciona inicialmente para:

- Centralización del acceso a las API de modelos

- Aplicación de límites tarifarios básicos

- Aplicación de claves de autenticación y API

Sin embargo, el tráfico de LLM introduce propiedades que no se asignan claramente a las API tradicionales.

Limitaciones para los casos de uso de IA y LLM

- No hay una comprensión nativa de las indicaciones o los símbolos: Las solicitudes son bloques JSON opacos

- Falta de observabilidad a nivel de token: Los códigos de latencia y estado están visibles, pero el uso y el costo del token no

- Sin enrutamiento ni retrocesos compatibles con el modelo: Las reglas de tráfico se basan en API, no tienen en cuenta el modelo o la carga de trabajo

- Primitivas limitadas de gobernanza de la IA: No hay conceptos integrados para el control rápido, las políticas de modelo o la atribución de uso entre los equipos

A medida que el uso de la IA va más allá de la simple experimentación, estas brechas se hacen cada vez más visibles, especialmente en entornos con varios equipos o sensibles a los costos.

¿Qué es Portkey?

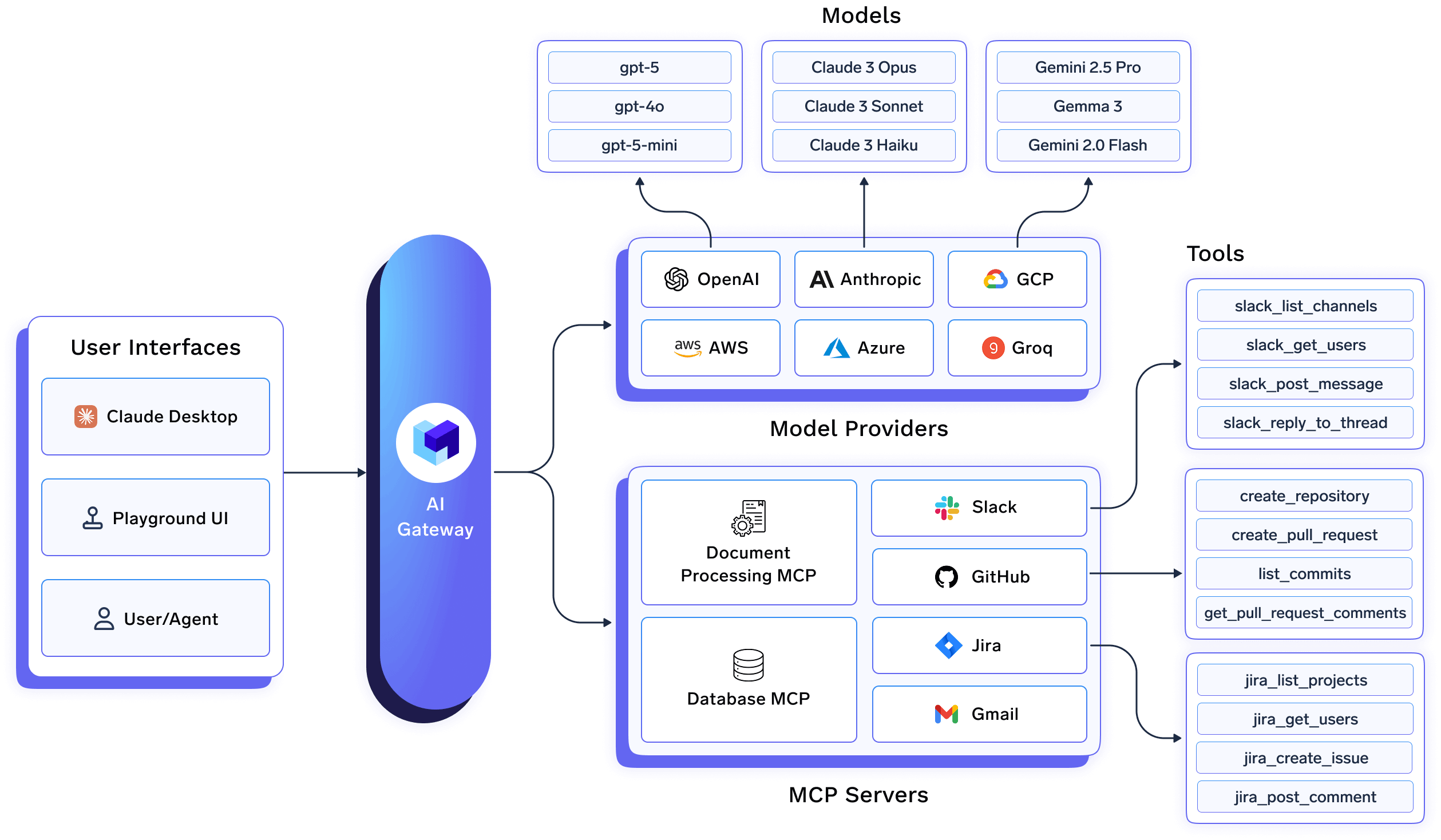

Portkey es una puerta de enlace nativa de IA diseñada específicamente para aplicaciones basadas en modelos de lenguaje de gran tamaño. En lugar de tratar las llamadas de LLM como solicitudes de API genéricas, Portkey introduce abstracciones que se alinean con el funcionamiento real de las aplicaciones de IA: solicitudes, modelos, tokens y proveedores.

En esencia, Portkey actúa como una capa intermedia entre las aplicaciones de IA y varios proveedores de LLM. Permite a los desarrolladores cambiar de modelo, enrutar el tráfico y observar el uso sin vincular estrechamente el código de la aplicación a la API de un proveedor específico.

Dónde funciona bien Portkey

- Abstracción del modelo: Las aplicaciones pueden enrutar las solicitudes entre varios proveedores de LLM a través de una única interfaz

- Enrutamiento rápido: El tráfico se puede enrutar según el modelo, la lógica alternativa o la disponibilidad del proveedor

- Observabilidad a nivel de token: Visibilidad de la entrada/salida de los tokens, la latencia y el uso del modelo

- Experiencia centrada en el desarrollador: SDKs y paneles sencillos optimizados para aplicaciones de LLM

Cómo mejora Portkey con respecto a las pasarelas de API tradicionales

En comparación con las pasarelas de API como Kong, Portkey es Diseñado para ser compatible con LLM. Entiende que:

- El costo depende de los tokens, no de las solicitudes

- La confiabilidad implica reintentos, retrocesos y cambios de modelo

- La observabilidad debe incluir detalles de ejecución inmediata

Esto convierte a Portkey en una opción sólida para los equipos que crean e iteran aplicaciones impulsadas por LLM, especialmente en entornos de producción en etapas iniciales o intermedias.

Donde Portkey empieza a quedarse corto

A medida que el uso de la LLM se expande en los equipos y entornos, surgen algunas limitaciones:

- Enfoque a nivel de aplicación: Optimizado principalmente para aplicaciones individuales, no para plataformas de IA de toda la organización

- Gobernanza de infraestructura limitada: No administra la implementación, el aislamiento del entorno ni las políticas de infranivel

- Restricciones empresariales: Las implementaciones locales y aisladas y los estrictos requisitos de residencia de datos no son objetivos fundamentales del diseño

- Atribución parcial de costos: El uso de los tokens es visible, pero vincular los costos a los equipos, los entornos o las unidades de negocio puede ser un desafío

Estas restricciones se vuelven importantes cuando la IA pasa de ser una función de la aplicación a una capacidad empresarial compartida.

Comparación arquitectónica: Kong vs Portkey

Mientras Kong y Portkey ambos pueden situarse frente a las cargas de trabajo de la IA, ya que se basan en suposiciones arquitectónicas muy diferentes. Comprender esta diferencia es fundamental para que los equipos de plataformas decidan cómo ampliar la IA más allá de una sola aplicación.

Cuándo usar Kong frente a Portkey

Cuando Kong tiene sentido

Kong es una buena elección si:

- El uso de la IA es mínimo o experimental

- Ya ejecutas Kong como tu puerta de enlace de API principal

- Las llamadas de LLM se tratan como cualquier otra API de terceros

- No necesita una observabilidad a nivel de token ni una gobernanza específica de la IA

En esta configuración, Kong funciona como extensión temporal de la infraestructura API existente.

Cuando Portkey tiene sentido

Portkey se adapta bien cuando:

- Estás construyendo Aplicaciones centradas en LLM

- La abstracción de modelos y el cambio de proveedor son importantes

- Quiere una visibilidad a nivel de token sin un trabajo pesado de infraestructura

- La IA es propiedad de un un solo equipo o producto

Portkey brilla en el capa de aplicación, especialmente para los equipos de productos de IA que cambian rápidamente.

Dónde Kong y Portkey se quedan cortos para la IA empresarial

Ambos Kong y Portkey abordan los desafíos reales de la IA, pero lo hacen en capas diferentes y, en última instancia, limitadas. Estas limitaciones se hacen evidentes a medida que la IA pasa de ser una función única de la aplicación a una capacidad empresarial compartida abarcando varios equipos, entornos y límites reglamentarios.

La gobernanza de la IA va más allá de la gestión del tráfico

Kong está diseñado para controlar las solicitudes de API, no el comportamiento de la IA. Las solicitudes, los tokens, la selección de modelos y la ejecución de los agentes son opacos para la puerta de enlace.

Portkey introduce controles compatibles con la LLM, pero la gobernanza se mantiene en gran medida ámbito de aplicación.

Sin embargo, los equipos de IA empresarial necesitan respuestas a preguntas como:

- ¿Qué equipos pueden acceder a qué modelos y en qué entornos?

- ¿Qué indicaciones, agentes o herramientas están aprobados para su uso en producción?

- ¿Cómo se aplican las políticas de manera uniforme en docenas de servicios y equipos?

Ni Kong ni Portkey ofrecen gobernanza de la IA en toda la organización como una capacidad de primera clase.

El control de costos requiere la atribución a nivel de infraestructura

Los costos de la IA se basan en una combinación de:

- Uso de tokens

- Selección de modelos

- Solicitud de simultaneidad

- Infraestructura de tiempo de ejecución subyacente

Kong no tiene visibilidad sobre estos factores de costes específicos de la IA.

Portkey expone las métricas a nivel de token, pero la atribución de costos se vuelve cada vez más difícil a medida que el uso abarca varios equipos, aplicaciones y entornos.

Sin la atribución a nivel de infraestructura, los equipos de plataforma y finanzas tienen dificultades para responder a una pregunta básica: ¿quién gasta qué y por qué?

El aislamiento del entorno no es negociable en la producción

Los sistemas de IA de producción exigen una separación estricta entre:

- Entornos de desarrollo, puesta en escena y producción

- Cargas de trabajo internas y externas

- Datos regulados y no regulados

Kong no se creó teniendo en cuenta el aislamiento del entorno de IA.

Portkey optimiza los flujos de trabajo de las aplicaciones en lugar de imponer límites estrictos del entorno.

Para las empresas de sectores regulados, esta falta de aislamiento se convierte rápidamente en un obstáculo para la implementación.

El cumplimiento y la residencia de datos no se pueden consolidar

Las implementaciones de IA empresarial deben cumplir requisitos como:

- GDPR

- SOC 2

- GUITARRA

- Residencia de datos regionales y ejecución aislada

Estas restricciones deben cumplirse en la capa de infraestructura, no está integrado en el código de la aplicación ni es gestionado manualmente por los equipos.

Kong trata el tráfico de IA como solicitudes HTTP genéricas.

Portkey asume que el uso a nivel de aplicación es prioritario para la nube.

Ninguno de los enfoques está diseñado para despliegues de IA que priorizan el cumplimiento.

Los sistemas modernos de IA van más allá de las indicaciones

La IA en producción ya no se limita a las llamadas sincrónicas de respuesta rápida. Los sistemas del mundo real incluyen:

- Agentes de larga trayectoria

- Llamadas y orquestación de herramientas

- Trabajos en segundo plano e inferencia por lotes

- Flujos de trabajo con estado y de varios pasos

Las puertas de enlace que se centran únicamente en el tráfico de la API o en el enrutamiento rápido no controlan la ciclo de vida completo de las cargas de trabajo de IA.

La realidad empresarial

A medida que la adopción de la IA madura, las empresas convergen en la misma conclusión: Las pasarelas por sí solas no son suficientes. La ejecución de la IA en producción requiere una capa de infraestructura que unifique acceso, implementación, observabilidad, gobernanza y cumplimiento. Esta es la razón por la que las organizaciones eventualmente van más allá de las pasarelas de API y las pasarelas de aplicaciones de LLM hacia Plataformas de infraestructura nativas de IA creadas para la escala empresarial

TrueFoundry: una mejor alternativa para las plataformas de IA empresariales

Las limitaciones de Kong y Portkey provienen de la misma causa raíz: ambos fueron diseñados para resolver problemas a nivel de puerta de enlace, no problemas de infraestructura de IA empresarial.

A medida que la IA se convierte en una capacidad compartida y crítica para la producción, las empresas necesitan algo más que enrutar el tráfico o abstraer rápidamente. Necesitan una plataforma que trate Gobernanza, despliegue, observabilidad y seguridad de la IA como problemas de infraestructura de primera clase. Aquí es donde True Foundry se distingue.

TrueFoundry se basa en la idea de que las cargas de trabajo de IA deben gestionarse como cualquier otro sistema de producción crítico, pero con Primitivas nativas de la IA. En lugar de operar solo en la ruta de solicitud, TrueFoundry funciona como plano de control de IA unificado.

A un alto nivel, TrueFoundry reúne:

- Un Puerta de enlace de IA para modelos, agentes y herramientas

- UN plataforma de despliegue para servicios de IA y trabajos por lotes

- Gobernanza y aplicación de políticas a nivel de infraestructura

- Observabilidad unificada en todos los tokens, modelos y comportamiento en tiempo de ejecución

- Seguridad, cumplimiento y aislamiento de nivel empresarial

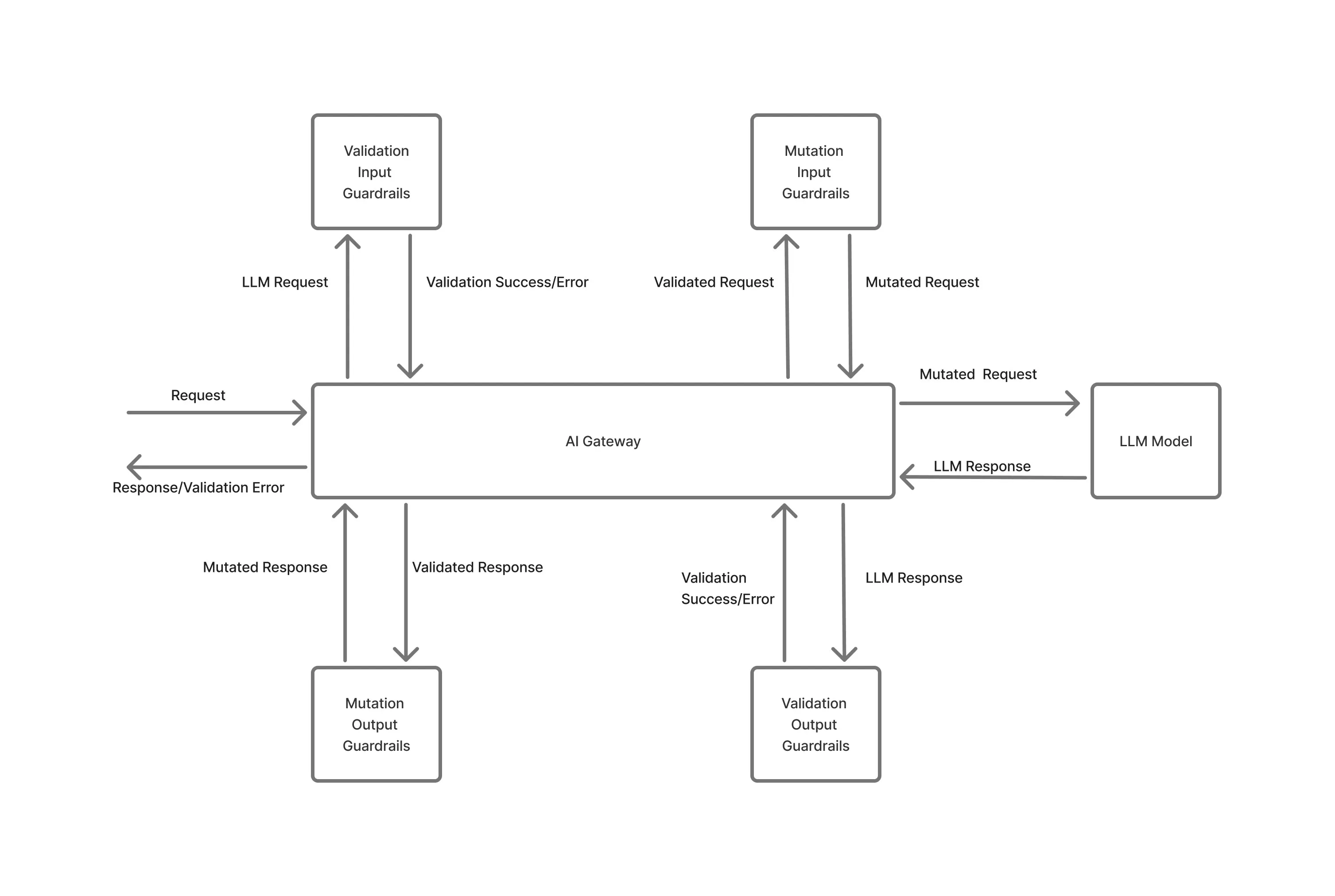

TrueFoundry como plano de control de IA

En muchas pilas de IA, el uso de la LLM se trata como un problema de integración de API: las solicitudes se enrutan, autentican y registran, pero todo lo que supera el límite de solicitudes se deja en manos de las aplicaciones individuales. TrueFoundry adopta un enfoque diferente al tratar las cargas de trabajo, los servicios, los trabajos y los agentes de la IA como objetos de infraestructura con límites de ciclo de vida, propiedad y operaciones.

En lugar de solo decidir ya sea se debe permitir una solicitud, controla TrueFoundry dónde se ejecutan los sistemas de IA, cómo se ejecutan y bajo qué restricciones, desde la implementación hasta el tiempo de ejecución. Este cambio del enrutamiento de solicitudes al control del ciclo de vida es lo que permite una gobernanza uniforme a medida que aumenta el uso de la IA.

Concretamente, esto se manifiesta en varias dimensiones críticas.

Aplicación de políticas a nivel ambiental

En arquitecturas centradas en pasarelas, políticas de acceso suelen estar integradas en el código de la aplicación, la configuración del SDK o las reglas de puerta de enlace por servicio. Esto se vuelve frágil rápidamente a medida que se multiplican los equipos, los servicios y los entornos.

TrueFoundry aplica las políticas de acceso y uso en nivel de espacio de trabajo y entorno. Los modelos, los agentes y las herramientas se aplican a entornos como el desarrollo, la puesta en escena y la producción, y los permisos y los controles se aplican de manera uniforme en todas las cargas de trabajo implementadas en ese entorno.

Porque las políticas están vinculadas a los entornos y no a las aplicaciones individuales:

- Los clientes mal configurados no pueden eludir las restricciones de producción

- Los nuevos servicios heredan las políticas correctas de forma predeterminada

- La gobernanza se mantiene estable incluso cuando cambian los equipos y las bases de código

Barreras de uso impuestas durante el tiempo de ejecución

Los sistemas de IA fallan en la producción no porque una sola solicitud no sea válida, sino porque el uso se acumula de forma inesperada debido a picos de concurrencia, tormentas de reintentos o cargas de trabajo en segundo plano que se ejecutan a gran escala.

TrueFoundry impone el uso barandas en el momento de la ejecución, con visibilidad del comportamiento de las cargas de trabajo en tiempo de ejecución. Los límites de simultaneidad, las restricciones de rendimiento y los límites de uso se aplican de forma centralizada en todos los servicios y trabajos que comparten modelos o infraestructuras subyacentes.

Porque estos límites se aplican en la capa de plataforma:

- Las barandillas se aplican de manera uniforme en todos los clientes y servicios

- Las cargas de trabajo incontroladas se pueden contener incluso si fallan las comprobaciones del lado de la aplicación

- Los picos de costos se evitan antes de que se propaguen entre los equipos

Esto es fundamentalmente diferente de los controles del lado del cliente o del nivel del SDK, que asumen que las aplicaciones se comportan de forma correcta e independiente.

Aislamiento en la capa de implementación

TrueFoundry impone el aislamiento en el capa de implementación y entorno, no solo previa solicitud de admisión. Los servicios de IA, los trabajos por lotes y los flujos de trabajo de los agentes se implementan como cargas de trabajo aisladas en entornos definidos, y el acceso, las políticas y los recursos se distribuyen por entorno.

Estas cargas de trabajo se ejecutan como despliegues y trabajos separados con procesos de ejecución y dominios de error independientes, en lugar de compartir un único contexto de ejecución plano detrás de una puerta de enlace. Como resultado:

- Las fallas en un servicio o trabajo no afectan automáticamente a los demás

- Las cargas de trabajo que no son de producción están aisladas de la producción de forma predeterminada

- La contención de recursos y la propagación de errores están contenidas

Las puertas de enlace LLM a nivel de aplicación, que funcionan principalmente en la ruta de solicitud, no controlan la ejecución del tiempo de ejecución ni el estado de la infraestructura. Como resultado, no pueden ofrecer este nivel de despliegue y aislamiento del entorno, un problema que se hace cada vez más visible a medida que las cargas de trabajo de la IA se expanden entre los equipos y los entornos de producción.

Observabilidad y costo en la capa correcta

Las métricas a nivel de token son útiles, pero insuficientes una vez que las cargas de trabajo de IA abarcan servicios de larga duración, trabajos en segundo plano y flujos de trabajo de agentes. En los sistemas de producción, el coste y el rendimiento se derivan de la interacción entre:

- Uso de tokens y selección de modelos

- Simultaneidad de la solicitud y duración de la ejecución

- Consumo de recursos en tiempo de ejecución

- Entorno y propiedad del equipo

TrueFoundry correlaciona estas señales en la capa de plataforma, lo que permite a los equipos razonar sobre el comportamiento de la IA de la misma manera que lo hacen sobre otros sistemas de producción:por entorno, servicio y propietario, no mediante llamadas a la API individuales.

Diseñado para despliegues regulados y privados

Muchas implementaciones de IA empresarial funcionan con restricciones que las pasarelas a nivel de aplicación asumen implícitamente, entre las que se incluyen:

- Ejecución dentro de VPC privadas o entornos locales

- Requisitos de residencia de datos relacionados con la geografía o la regulación

- Configuraciones de red restringidas o aisladas

El plano de control de TrueFoundry está diseñado para funcionar en todos estos modelos de implementación, lo que garantiza que la gobernanza, el aislamiento y la observabilidad permanezcan consistentes independientemente de dónde se ejecute la inferencia. Como resultado, las propiedades de cumplimiento, como los límites de los datos y la auditabilidad, se aplican como parte de la propia infraestructura, en lugar de añadirse más adelante mediante la lógica de las aplicaciones o los controles de procesos.

Conclusión

Tanto Kong como Portkey resuelven problemas importantes en diferentes etapas de la adopción de la IA. Kong amplía los patrones conocidos de pasarela de API al tráfico de IA, mientras que Portkey introduce abstracciones nativas de la LLM que facilitan la creación y el funcionamiento de aplicaciones impulsadas por la IA.

Sin embargo, a medida que la IA se convierte en una capacidad compartida y crítica para la producción, las empresas se enfrentan rápidamente a desafíos que van más allá del enrutamiento de solicitudes o la gestión rápida. La gobernanza, la atribución de costos, el aislamiento del entorno y el cumplimiento requieren controles a nivel de infraestructura, no solo en la puerta de enlace.

Esta es la razón por la que muchas organizaciones van más allá de las pasarelas de aplicaciones de API y LLM y optan por plataformas de infraestructura nativas de la IA, como True Foundry, que están diseñados para ejecutar, gobernar y escalar los sistemas de IA de manera confiable en todos los equipos y entornos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)