Las 6 mejores alternativas de AWS SageMaker en 2026

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

When it comes to building, training, and deploying machine learning models at scale, Amazon SageMaker has long been a go-to platform. But in 2026, the MLOps landscape has evolved—and let’s be honest, SageMaker isn’t always the perfect fit for every team or use case. Maybe it's the cost, perhaps it's the learning curve, or maybe you just want something more flexible. Whatever the reason, exploring alternatives can open up new possibilities. So if you're wondering what other tools are out there that can rival or even outperform SageMaker, you’re in the right place. Let’s dive into your top options.

What is SageMaker?

Amazon SageMaker is a fully managed service from AWS that helps developers and data scientists build, train, and deploy machine learning (ML) models quickly and at scale. It was introduced to simplify the often messy, time-consuming ML pipeline and make it more accessible—even for teams without deep ML or DevOps expertise. Think of SageMaker as a one-stop shop for all things ML. It takes care of the heavy lifting involved in model development—from spinning up infrastructure to managing experiments, training at scale, deploying APIs, and even monitoring models in production. Whether you're working on a simple classification task or deploying a massive deep learning model, SageMaker offers a modular, plug-and-play approach to get you from idea to production.

Here’s a quick rundown of what it includes:

- Integrated Jupyter notebooks to explore data and build models.

- Built-in algorithms for common ML tasks (regression, classification, clustering, etc.).

- Support for custom models using popular frameworks like TensorFlow, PyTorch, and Scikit-learn.

- Training jobs that can scale across multiple GPUs and instances.

- Automatic model tuning (hyperparameter optimization).

- Model hosting with built-in endpoint creation and scaling.

- Monitoring tools to track performance, drift, and logs in production.

How Does SageMaker Work?

Alright, so now that we know what SageMaker is, let’s talk about how it actually works behind the scenes. At its core, SageMaker simplifies the machine learning lifecycle by breaking it down into three main stages: Build, Train, and Deploy—with plenty of helpful features tucked into each.

Build

It all starts in the "build" phase. SageMaker gives you a bunch of tools to prep your data, explore it, and build your models. You can launch Jupyter notebooks directly from the SageMaker console (no local setup needed), and connect them to data stored in S3. Whether you’re using built-in algorithms or writing your own in TensorFlow, PyTorch, or Scikit-learn, you get a fully managed environment ready to go.

It also supports integration with SageMaker Data Wrangler, which helps clean and transform data with a low-code interface. Basically, the build phase is your ML playground—minus the setup headaches.

Train

Once your model code is ready, it’s time to train it. Here’s where SageMaker really shines. You can run training jobs on powerful, scalable compute instances—CPU or GPU—without provisioning anything manually. You define your job configuration (like instance type and count), kick off the training, and SageMaker handles the rest.

Even cooler? SageMaker supports automated model tuning, where it tests different hyperparameters for you to find the best-performing model. It’s like having a mini data science assistant that runs experiments in parallel.

Deploy

After training, you’ll want to serve your model somewhere, right? SageMaker lets you deploy your model as a real-time endpoint with a few clicks or lines of code. It automatically provisions the infrastructure, sets up an HTTPS API endpoint, and even scales it based on traffic. You can also deploy models for batch inference or use multi-model endpoints if you’re serving many models cost-effectively.

On top of that, SageMaker brings in tools like Model Monitor for drift detection, Clarify for fairness and explainability, and Debugger for insights during training.

The Bigger Picture

SageMaker is like an ML pipeline in a box. But it’s a big box—great for enterprise use, but potentially overkill for smaller, nimble teams that want more control, flexibility, or budget efficiency.

Why Explore SageMaker Alternatives?

While SageMaker is undoubtedly powerful, it’s not always the best fit for everyone. In 2026, the MLOps space is more diverse than ever, and many teams are actively exploring alternatives, and for good reason.

Cost and Complexity

SageMaker can get expensive quickly, especially when you start using its more advanced features or need to scale across multiple models and environments. It also has a steep learning curve for those not already familiar with AWS. If your team is small or budget-conscious, this might be a dealbreaker.

Vendor Lock-In

SageMaker is tightly integrated with AWS services. While this works great if you're all-in on AWS, it can create challenges if you're working in a multi-cloud setup or want to maintain flexibility. Alternatives often offer better portability and open standards.

Customization and Control

Some users find SageMaker a bit too opinionated. You may want more granular control over infrastructure, custom workflows, or model-serving strategies. Many open-source or hybrid platforms give you that freedom—without the overhead.

Community and Ecosystem

Tools like MLflow, BentoML, and Seldon Core benefit from strong open-source communities, frequent updates, and plug-and-play components that can fit into nearly any tech stack. They’re also often easier to extend or integrate with tools you’re already using.

Lightweight and Dev-Friendly

Developers and MLOps teams today often prefer tools that are lightweight, modular, and container-native. SageMaker, by contrast, is more monolithic, which can slow things down in agile environments.

Top 6 Sagemaker Alternatives

Now that we’ve covered why SageMaker might not always be the perfect fit, let’s explore some solid alternatives. Whether you're looking for something more lightweight, open-source, cloud-agnostic, or just easier on the budget—there’s a tool out there for you. These six platforms stand out in 2026 for their flexibility, speed, and real-world usability. Each one brings something unique to the table depending on your team’s size, skillset, and workflow. Let’s break them down one by one.

1. TrueFoundry

TrueFoundry is a modern MLOps platform designed to make ML deployment fast, developer-friendly, and cloud-agnostic. It focuses on taking your models from notebook to production in under 15 minutes—without the complexities of traditional DevOps. Built with a Kubernetes-native foundation, it abstracts away infrastructure headaches while offering complete flexibility. It works well across cloud providers and can even be deployed on-prem, making it a great fit for startups, growing ML teams, or AI-first products. If you're tired of wrestling with SageMaker's layers, TrueFoundry feels refreshingly straightforward.

Features and Pricing

TrueFoundry offers automated model deployment, autoscaling, monitoring, versioning, and CI/CD integrations. It supports popular ML tools like MLflow, Prometheus, and Grafana out of the box. Its Bring-Your-Own-Container approach means you can serve models however you prefer—no lock-in. Pricing is usage-based and tailored for different business sizes, with flexible plans for startups, scale-ups, and enterprises. While it’s not entirely open-source, it’s transparent, developer-focused, and much easier to adopt than enterprise-heavy platforms.

Why it’s a good SageMaker alternative

- Faster time to production with simplified deployment pipelines (no heavy AWS setup).

- Cloud-agnostic infrastructure—run on any cloud or on-prem, unlike SageMaker’s AWS-only model.

- Built-in observability with integrated metrics and logging dashboards (no manual setup).

- Native CI/CD and multi-tenant support, ideal for scaling ML across teams or clients.

- Minimal boilerplate—great for engineering teams that want speed without complexity.

Challenges

While TrueFoundry simplifies much of the MLOps stack, it still requires some familiarity with Docker and Kubernetes concepts, especially during initial setup. It’s a newer player compared to SageMaker, so the community and third-party integrations are still growing. Teams looking for a completely out-of-the-box solution might need a little time to adapt.

2. BentoML

BentoML is an open-source framework that makes it super easy to package, ship, and deploy machine learning models as APIs. It’s lightweight, Pythonic, and designed for developers who want fine-grained control over how their models are served. With BentoML, you can turn any trained model—from frameworks like PyTorch, TensorFlow, or XGBoost—into a production-ready REST or gRPC service in just a few lines of code. It’s perfect for teams looking to self-manage their model-serving infrastructure without the overhead of heavyweight platforms.

Features and Pricing

BentoML offers a flexible and modular approach to model serving with features like model versioning, custom Docker container generation, and multi-model support. It integrates with a range of backends (like Triton, TorchServe, and ONNX Runtime) and plays well with CI/CD pipelines and orchestration tools like Kubernetes. Since it’s open-source, you can use it completely free—though BentoML’s parent company, BentoML.ai, offers enterprise support and managed services for teams that need scale and reliability.

Why it’s a good SageMaker alternative

- Fully open-source with no vendor lock-in—deploy anywhere, anytime.

- Built for developers who want full control over how models are containerized and served.

- Native support for REST and gRPC APIs, making it easy to integrate into modern apps.

- Framework-agnostic—you can serve models from TensorFlow, PyTorch, HuggingFace, and more.

- Lightweight and fast, with the ability to build custom inference logic and runtime environments.

Challenges

BentoML is powerful, but it assumes some DevOps familiarity—especially when scaling with Kubernetes or integrating into production workflows. There's no managed UI or built-in model training pipeline, so it's focused purely on serving. That’s great for flexibility but may require more manual setup if you’re not already DevOps-savvy.

3. Vertex AI

Vertex AI is Google Cloud’s end-to-end machine learning platform that brings together all the tools you need to build, train, deploy, and manage ML models at scale. It's deeply integrated into the Google Cloud ecosystem and designed to streamline workflows across data engineering, modeling, and MLOps. With native support for AutoML and custom training, Vertex AI works for both no-code users and experienced data scientists. It’s especially appealing if you’re already working within GCP or leveraging tools like BigQuery and Dataflow.

Features and Pricing

Vertex AI offers everything from AutoML to custom model training, hyperparameter tuning, managed notebooks, pipelines, and scalable model deployment endpoints. It supports popular ML frameworks and has built-in MLOps tooling for model registry, monitoring, and version control. Pricing is usage-based and modular—you pay for computing, storage, training, and prediction services separately. While it’s powerful, costs can stack up depending on how many services you leverage.

Why it’s a good SageMaker alternative

- Seamless integration with other GCP services like BigQuery, Dataflow, and Looker.

- Offers both AutoML (for ease) and full custom model support (for flexibility).

- Built-in model monitoring, versioning, and explainability features out of the box.

- Vertex Pipelines help automate complex ML workflows using Kubeflow or TFX.

- Fully managed and scalable—no need to manage infrastructure manually.

Challenges

Vertex AI is ideal for GCP users, but not as friendly if you're multi-cloud or outside Google's ecosystem. Its pricing model can be complex, and the learning curve can feel steep for newcomers unfamiliar with Google Cloud services. While it’s robust, it can feel overwhelming for smaller teams or solo practitioners.

Also explore: Top 6 Vertex AI Alternatives

4. Databricks

Databricks ML is a powerful machine learning platform built on top of the Databricks Lakehouse. It provides everything teams need to develop, train, track, deploy, and monitor models at scale. With deep integrations across the data and ML stack, Databricks ML is ideal for organizations looking for a single platform that unifies data engineering, analytics, and machine learning workflows.

Features and Pricing

Databricks ML includes built-in AutoML, experiment tracking via MLflow, scalable distributed training with Apache Spark, managed feature stores, and real-time model serving. The platform supports popular ML frameworks like TensorFlow, PyTorch, XGBoost, and scikit-learn. It runs on AWS, Azure, and GCP, offering flexible deployment options. Pricing is usage-based and tailored to compute and collaboration needs, with specific tiers for enterprise users.

Why it’s a good SageMaker alternative

- Unified platform for data, analytics, and ML

- Native MLflow integration for tracking and model management

- Real-time model serving with enterprise-grade SLAs

Multi-cloud support with scalable distributed compute

Challenges

Databricks ML is geared toward mid to large-sized teams with mature data workflows. It’s not ideal for teams looking for a lightweight or standalone ML serving tool, and it assumes some familiarity with the Databricks ecosystem.

5. Seldon Core

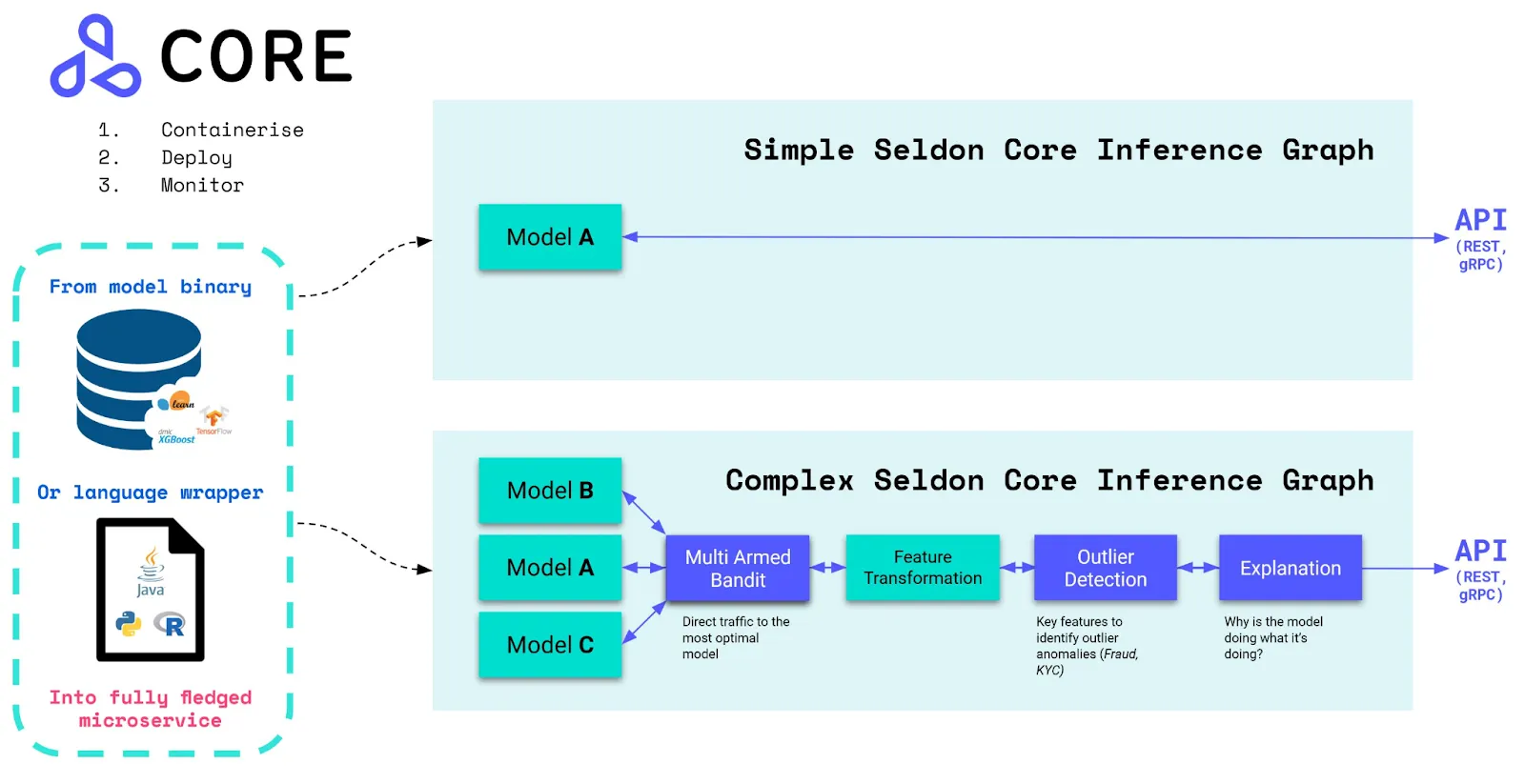

Seldon Core is an open-source MLOps platform designed for deploying, scaling, and monitoring machine learning models on Kubernetes. It’s framework-agnostic and built for teams that want to run models in production with full control over infrastructure. Seldon doesn’t try to be everything—it focuses specifically on model inference and serving and does that exceptionally well. If you’re running on Kubernetes and want a production-grade, open-source solution, Seldon Core is a strong contender.

Features and Pricing

Seldon Core supports multi-model deployments, canary rollouts, A/B testing, and request logging—all baked into its Kubernetes-native design. It works with models built in any framework and can wrap them in pre/post-processing logic using custom Python code. It also integrates easily with MLflow, Prometheus, and Grafana for observability. Being open-source, it’s completely free to use, and there’s also Seldon Deploy, a paid enterprise version with a UI, RBAC, and advanced governance tools.

Why it’s a good SageMaker alternative

- Full Kubernetes-native design—ideal for teams already using containers and orchestration.

- Patrones de implementación potentes, como las pruebas canarias y las implementaciones clandestinas.

- Ligero, modular y totalmente de código abierto, sin costos ocultos.

- Funciona en las nubes y en las instalaciones, sin depender de un proveedor.

- Fácil integración con herramientas de monitoreo y herramientas de ciclo de vida de aprendizaje automático como MLFlow.

Desafíos

Seldon Core es genial si ya tienes una configuración de Kubernetes, pero si no estás familiarizado con K8s, puede resultar un poco intimidante. No ofrece modelos de entrenamiento ni entornos portátiles, por lo que es mejor usarlo como parte de una pila de MLOps más grande que como una solución independiente.

6. MLFlow

MLFlow es una de las plataformas de código abierto más adoptadas para gestionar todo el ciclo de vida del aprendizaje automático. Desarrollado por Databricks, está diseñado para funcionar con cualquier biblioteca de aprendizaje automático, cualquier idioma y en cualquier nube. MLFlow le ayuda a realizar un seguimiento de los experimentos, empaquetar modelos, gestionar un registro de modelos y publicar modelos con facilidad. Es altamente modular, por lo que puede usar solo las piezas que necesita o integrarlas en una pila de mLOps más grande.

Características y precios

MLFlow incluye cuatro componentes principales: el seguimiento (para el registro de experimentos), los proyectos (para empaquetar el código), los modelos (para el empaquetado y la implementación) y el registro de modelos (para la administración del ciclo de vida). Es compatible con muchos marcos, incluidos TensorFlow, PyTorch, Scikit-learn y XGBoost. MLFlow es gratuito y de código abierto, con una comunidad masiva y una sólida documentación. Databricks también ofrece una versión totalmente gestionada con funciones de colaboración avanzadas para equipos empresariales.

Por qué es una buena alternativa a SageMaker

- Totalmente de código abierto e independiente de la nube: impleméntelo donde quiera.

- Seguimiento sencillo de experimentos y reproducibilidad listos para usar.

- Funciona con cualquier marco o entorno de ML: Python, R, Java, etc.

- Model Registry le permite administrar las etapas del modelo (preparación, producción, archivado) con facilidad.

- Fácil de integrar en las canalizaciones o herramientas existentes, como Airflow, Docker o Kubernetes.

Desafíos

MLFlow se centra más en el seguimiento de experimentos y la gestión del ciclo de vida de los modelos que en la implementación completa. Si bien ofrece un servicio basado en modelos, es relativamente básico y, a menudo, requiere combinarlo con otras herramientas (como Seldon o BenToML) para obtener inferencias de nivel de producción. Los principiantes también pueden necesitar algo de tiempo de configuración para aprovechar al máximo sus componentes.

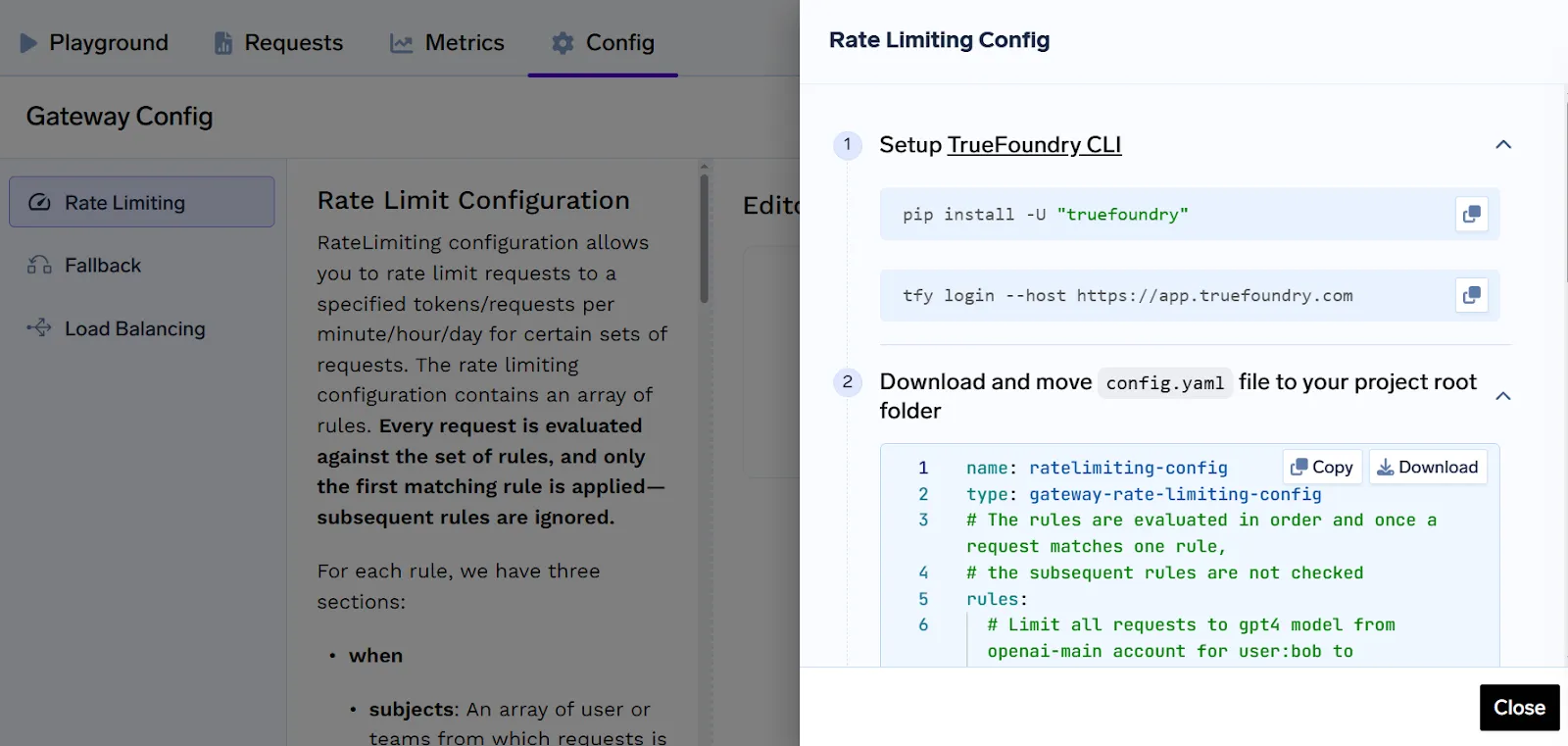

TrueFoundry logra el equilibrio

Si bien cada una de las alternativas enumeradas anteriormente aporta puntos fuertes específicos (Vertex AI para el aprendizaje automático completo, MLFlow para el seguimiento de experimentos, Seldon Core para el servicio de modelos y BentoML para el empaquetado), TrueFoundry es la única plataforma que combina estas capacidades en una solución MLOps única y fácil de usar para los desarrolladores diseñada para escalar. Combina la flexibilidad de las herramientas abiertas con la estructura de una plataforma de nivel empresarial, lo que la hace especialmente adecuada para equipos con movimientos rápidos que desean velocidad y control.

Por qué TrueFoundry está ganando terreno rápidamente

- Diseñado para la escala: TrueFoundry gestiona cargas de trabajo de inferencia de LLM que superan los 100 000 RPS con grupos de GPU distribuidas y escalado automático.

- Diseño nativo de LLM: Más de 250 LLM preintegrados con soporte para modelos vLLM, TGI y personalizados.

- Puerta de enlace unificada: Una única capa de API para enrutar el tráfico entre modelos propietarios y de código abierto, con limitación de velocidad, respaldo y creación de plantillas rápidas.

- Preparado para la empresa: Implementaciones multinube compatibles con SOC2 con control de acceso detallado y flujos de trabajo de GitOps.

Entre todas las alternativas de SageMaker enumeradas, ya se trate de las capacidades completas de Vertex AI, el seguimiento de experimentos de MLFlow o la flexibilidad de servicio de BenToML, TrueFoundry destaca como la plataforma mLOPS más equilibrada que prioriza la producción. Ofrece una infraestructura nativa de Kubernetes que simplifica la implementación, el escalado y la administración de los modelos de aprendizaje automático. Con soporte nativo para más de 250 LLM de código abierto y propietarios, TrueFoundry también lidera la adopción de GenAI. Ofrece capacidades avanzadas como optimización de la latencia, gestión rápida, limitación de velocidad y una pasarela de LLM multinube, todo integrado y listo para la producción.

Alternativas de AWS Sagemaker: configuración del límite de velocidad de TrueFoundry

A diferencia de las plataformas que se centran en etapas aisladas del ciclo de vida del aprendizaje automático, TrueFoundry proporciona una orquestación integral, desde el entrenamiento del modelo hasta la implementación y la supervisión. Ofrece un control detallado de la infraestructura, la observabilidad y el cumplimiento, al tiempo que optimiza la experiencia de los desarrolladores mediante los flujos de trabajo de GitOps y un enfoque centrado en las API. Para los equipos que desean avanzar con rapidez sin comprometer la fiabilidad o la flexibilidad, TrueFoundry es más que un simple sustituto de SageMaker. Es una solución moderna de MLOps diseñada para ofrecer escalabilidad y velocidad.

Conclusión

El panorama de los MLOP en 2026 ofrece más flexibilidad e innovación que nunca. Si bien Amazon SageMaker sigue siendo una herramienta poderosa, no es una solución única para todos, especialmente para los equipos que buscan velocidad, simplicidad o un mayor control sobre sus flujos de trabajo de aprendizaje automático. Ya sea que se decante por soluciones de código abierto como BentoML y Seldon Core, busque una sólida orquestación de procesos con Valohai o se adentre en el ecosistema de Google con Vertex AI, hay una alternativa sólida para cada necesidad.

Dicho esto, TrueFoundry se está convirtiendo rápidamente en una opción destacada, especialmente para los equipos que desean la potencia de SageMaker sin el bloqueo, el costo o la complejidad. Es rápido, fácil de usar para los desarrolladores y está diseñado para escalar. Cuando evalúes tus opciones, considera qué es lo que más le importa a tu equipo: la velocidad de implementación, la flexibilidad, la adaptación al ecosistema o la rentabilidad. La herramienta adecuada no se basa solo en las funciones, sino también en la que te ayuda a ofrecer productos de aprendizaje automático impactantes con menos problemas.

Preguntas frecuentes

¿Cuál es la alternativa a SageMaker?

Si bien las plataformas como Databricks y Vertex AI son comunes, TrueFoundry es la mejor alternativa a Sagemaker para los equipos que buscan flexibilidad y control de costos. A diferencia del ecosistema exclusivo de AWS de SageMaker, TrueFoundry es independiente de la nube, lo que le permite realizar la implementación en clústeres de Kubernetes locales, de AWS, GCP o de Azure. Simplifica el ciclo de vida de los MLOps, desde el portátil hasta la producción en cuestión de minutos, lo que ofrece una mejor experiencia para los desarrolladores y reduce significativamente los costos sin la dependencia de un proveedor asociada a SageMaker.

¿Cuál es el equivalente de Google a SageMaker?

El equivalente directo de Google Cloud es Vertex AI, que ofrece servicios de aprendizaje automático gestionados similares. Sin embargo, si quieres evitar quedarte atrapado en el ecosistema de Google, TrueFoundry es una excelente opción entre nubes. Funciona perfectamente en Google Kubernetes Engine (GKE) y, al mismo tiempo, conserva la capacidad de migrar a otras nubes. TrueFoundry proporciona un plano de control unificado para sus modelos, lo que le brinda la potencia de la IA de Vertex con la libertad de una infraestructura abierta.

¿Cuál es el equivalente de Microsoft a SageMaker?

La contraparte de Microsoft de Sagemaker es Azure Machine Learning (Azure ML). Si bien se integra bien con los servicios de Azure, lo restringe a su infraestructura. TrueFoundry es una alternativa flexible que funciona sobre Azure Kubernetes Service (AKS), pero no está limitada por él. Esto permite a las empresas aprovechar la potencia informática de Azure y, al mismo tiempo, mantener una pila de MLOps neutra en la nube, lo que garantiza la estandarización de los flujos de trabajo y la gobernanza en cualquier entorno que elijan.

¿Amazon Rekognition es mejor que SageMaker?

Depende de tus necesidades. Amazon Rekognition es una API SaaS lista para usar para el análisis de imágenes, mientras que SageMaker es una plataforma para crear y entrenar modelos personalizados. Si necesita la personalización de SageMaker pero la encuentra demasiado compleja, TrueFoundry es el punto intermedio ideal. Le permite implementar y administrar fácilmente modelos de visión artificial personalizados o de código abierto, y ofrece la flexibilidad del desarrollo personalizado con la simplicidad de un servicio administrado.

¿SageMaker es solo Jupyter?

No, SageMaker es una suite completa para el entrenamiento y la implementación, aunque depende en gran medida de Jupyter para el desarrollo. Sin embargo, su integración con ordenadores portátiles a menudo puede resultar complicada para los flujos de trabajo de producción. TrueFoundry mejora esto al cerrar sin problemas la brecha entre la experimentación y la producción. Permite a los desarrolladores iniciar trabajos de formación e implementar modelos directamente desde sus entornos preferidos (incluidos los ordenadores portátiles), lo que automatiza la transición a Kubernetes sin la pesada sobrecarga de DevOps que suele requerir SageMaker.

¿SageMaker compite con OpenAI?

No directamente. OpenAI proporciona modelos propietarios, mientras que SageMaker es una plataforma de infraestructura para crear y alojar modelos. Sin embargo, las empresas suelen elegir entre utilizar las API de OpenAI y alojar modelos de código abierto en SageMaker. TrueFoundry unifica esta elección al actuar como una plataforma integral en la que puede administrar las claves de API de OpenAI a través de una puerta de enlace segura y aloje modelos privados de código abierto en su propia infraestructura, lo que le brinda lo mejor de ambos mundos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)