LLM en la empresa: casos de uso, adopción y desafíos

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Los modelos de grandes lenguajes (LLM) han ido más allá de los chatbots experimentales y las demostraciones públicas; ahora impulsan los flujos de trabajo de misión crítica dentro de la empresa. Desde la automatización de la búsqueda interna de conocimientos hasta la generación de informes, la mejora de la atención al cliente y la garantía del cumplimiento, los LLM están transformando el funcionamiento de las empresas modernas. Sin embargo, implementar los LLM en entornos empresariales no es tan sencillo como conectarse a una API. Exige gobernanza, observabilidad, protección de la privacidad e infraestructura personalizada. Esta guía explora el panorama cambiante de las LLM empresariales y abarca los desafíos clave, los modelos de implementación, la supervisión de las mejores prácticas y cómo plataformas como TrueFoundry permiten la adopción segura y escalable de las LLM en todos los sectores.

¿Qué son los LLMs empresariales?

El revuelo en torno a las LLM ha provocado una ola de adopción, pero para las empresas, el verdadero desafío no es generar respuestas llamativas. Implementa estos modelos de forma inteligente y responsable. Un verdadero LLM empresarial no consiste solo en ChatGPT con un envoltorio empresarial. Es un sistema basado en sus datos de propiedad exclusiva, optimizado para sus flujos de trabajo e implementado teniendo en cuenta sus requisitos de cumplimiento, costos y control.

La mayoría de los LLM públicos están capacitados en datos abiertos de Internet. Esto los hace poderosos en el razonamiento del lenguaje general, pero poco confiables cuando se aplican a contextos específicos de la empresa, especialmente cuando la precisión, la trazabilidad y la seguridad son importantes. Por ejemplo, una empresa de servicios financieros no puede permitirse hechos alucinantes, avisos imprecisos de responsabilidad o respuestas impredecibles. Lo que necesitan es un modelo que tenga en cuenta el dominio, que sea auditable y que se pueda implementar detrás de firewalls. Esto suele ir acompañado de la generación aumentada por recuperación (RAG) para que pueda razonar sobre los documentos internos y no solo sobre lo que se le ha enseñado previamente.

Los LLM empresariales se están convirtiendo en copilotos internos. Los equipos legales los utilizan para redactar contratos, los equipos de recursos humanos para responder a las consultas de los empleados, los desarrolladores para acelerar el código y los equipos de soporte para resumir y resolver los tickets con mayor rapidez. Sin embargo, estos resultados solo son posibles si el LLM está bien integrado, supervisado durante la producción y alineado con los límites de datos de la organización.

Este cambio también señala una evolución filosófica. Estamos pasando de tratar los LLM como cajas negras mágicas a verlos como sistemas modulares de IA, en los que la orquestación, la fundamentación, la observabilidad y los circuitos de retroalimentación importan tanto como el propio modelo base.

Implementación exitosa LLM en empresa no se trata solo de la capacidad de la IA. Tienen que ver con el apalancamiento empresarial. Y eso requiere pensar mucho más allá del modelo y pensar en la arquitectura, la infraestructura y la confianza organizacional de las que depende.

Desafíos de las LLM empresariales

Si bien el potencial de las LLM empresariales es enorme, implementarlas en un entorno empresarial real conlleva desafíos críticos que las organizaciones deben abordar desde el primer día.

Privacidad y seguridad de los datos: Los LLM empresariales suelen operar con datos internos confidenciales, contratos, registros de clientes, código fuente y datos financieros. Esto plantea serias preocupaciones en relación con la filtración de datos, el acceso no autorizado y el incumplimiento de las normativas. Sin controles de acceso estrictos, cifrado y desinfección inmediata, los resultados del LLM pueden exponer involuntariamente información confidencial.

Alucinaciones y confiabilidad: Los LLM tienden a generar respuestas seguras pero incorrectas, también conocidas como alucinaciones. En un entorno empresarial, esto puede provocar errores operativos, riesgos legales y pérdida de confianza. Esto hace que basar el modelo en documentos internos a través de procesos RAG sea esencial para garantizar la precisión de los hechos.

Inyección rápida y entradas contradictorias: Las empresas deben protegerse contra las indicaciones maliciosas o manipuladoras que eluden los filtros o extraen datos no deseados. Sin una validación adecuada de los datos de entrada y sin las garantías adecuadas, los modelos pueden convertirse en vectores de ingeniería social o de filtración de información.

Gastos generales de costos e infraestructura: La ejecución de modelos grandes en GPU a escala implica altos costos de inferencia. Aquí es donde Inferencia de LLM la estrategia se vuelve crítica, porque las opciones de tamaño del modelo, lotes y hardware determinan directamente la latencia empresarial y la rentabilidad. Las empresas deben gestionar la latencia, el rendimiento y la escalabilidad y, al mismo tiempo, mantener los gastos en la nube bajo control. Es fundamental elegir el tamaño de modelo correcto y optimizar el procesamiento por lotes, el almacenamiento en caché y la cuantificación.

Supervisión y control de versiones: A diferencia del software tradicional, el comportamiento de LLM puede variar sutilmente con el tiempo. Las empresas necesitan herramientas para hacer un seguimiento de las solicitudes, los resultados, la calidad de las respuestas y las tendencias de uso. La falta de observabilidad puede provocar un uso indebido del modelo, un rendimiento inferior o el incumplimiento de los SLA.

Complejidad de la evaluación: La evaluación de los LLM no es trivial. Requiere puntos de referencia personalizados, ciclos de retroalimentación y métricas específicas para cada tarea, como la relevancia, la coherencia y la factibilidad.

Cada uno de estos desafíos necesita un enfoque estructurado para mitigar el riesgo y permitir la escalabilidad. Sin ellos, las iniciativas de LLM permanecen estancadas en el modo prototipo y nunca alcanzan la verdadera madurez empresarial.

Implementaciones de LLM empresariales

Las empresas de todos los sectores van más allá de la experimentación y comienzan a implementar LLM en entornos de producción. Estas implementaciones se centran en casos de uso interno de alto impacto que pueden ofrecer un ROI cuantificable y, al mismo tiempo, minimizar los riesgos.

Recuperación de conocimientos y búsqueda interna

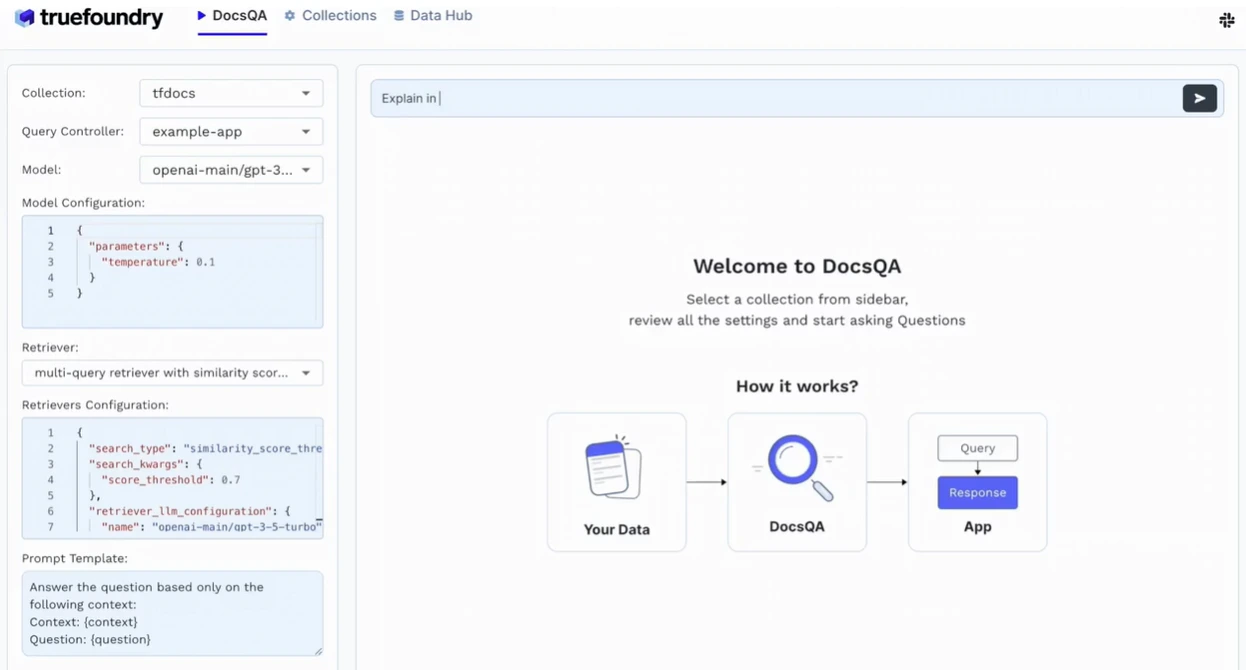

Una de las aplicaciones más comunes es la búsqueda empresarial. Al combinar los LLM con sistemas de recuperación, como las bases de datos vectoriales, las empresas permiten a los empleados consultar la documentación interna utilizando un lenguaje natural. Esto mejora el acceso al conocimiento para los equipos de recursos humanos, legales, de cumplimiento y de TI.

Automatización de la atención al cliente

Las empresas están integrando los LLM en los flujos de trabajo de atención al cliente. Los modelos ayudan a resumir los tickets, generar correos electrónicos y determinar las intenciones. Cuando se combinan con los datos de soporte históricos, los LLM pueden reducir significativamente los tiempos de respuesta y mejorar la satisfacción del cliente.

Resumen y clasificación de documentos

Los LLM se utilizan para analizar y resumir informes, contratos o transcripciones extensos. Las empresas de los sectores legal, financiero y sanitario se benefician del procesamiento automatizado de documentos, lo que reduce el tiempo de revisión manual y acelera la toma de decisiones.

Productividad de los desarrolladores

Los equipos técnicos implementan LLM centrados en el código para acelerar el desarrollo de software. Los copilotos internos sugieren fragmentos de código, identifican errores y generan documentación basada en repositorios internos. Esto aumenta la velocidad de ingeniería sin comprometer la seguridad.

Asistentes de dominio específico

Algunas organizaciones están creando asistentes basados en LLM adaptados a flujos de trabajo específicos. Por ejemplo, las compañías de seguros utilizan modelos especializados en datos de siniestros para detectar anomalías o rellenar formularios previamente. Las empresas consultoras utilizan los LLM para preparar informes de investigación basados en sus bases de datos patentadas.

Algunos ejemplos del mundo real incluyen el uso interno de StarCoder por parte de VMware para la ingeniería, el Enterprise LLM Workspace del Ejército de los EE. UU. para el acceso a la documentación y la plataforma de búsqueda empresarial basada en la inteligencia artificial de Glean.

Lo que une las implementaciones exitosas no es solo el modelo, sino la integración con los datos, las herramientas y las prácticas de gobierno internos. Estas no son soluciones estándar. Son sistemas personalizados diseñados específicamente para lograr un impacto empresarial.

Implementaciones de LLM locales frente a implementaciones de LLM en la nube en empresas

Una de las decisiones arquitectónicas más importantes para cualquier iniciativa de LLM empresarial es dónde implementar el modelo. Tanto las implementaciones locales como las basadas en la nube ofrecen distintas ventajas, según las prioridades, las restricciones y el entorno normativo de la organización.

Implementación local

Las empresas con una gestión de datos estricta, como las del sector sanitario, financiero o gubernamental, suelen optar por las implementaciones locales. Estas garantizan el control total de los datos confidenciales, lo que permite cumplir con las políticas internas y las normativas externas. Las configuraciones locales también reducen la dependencia de infraestructuras de terceros y permiten ajustar el rendimiento a nivel de hardware. Sin embargo, requieren una inversión significativa en GPU, experiencia en DevOps y mantenimiento continuo. Las actualizaciones, los parches y el escalado de los modelos se convierten en responsabilidades internas, lo que puede ralentizar la innovación si no se cuenta con los recursos adecuados.

Implementación en la nube

Los LLM basados en la nube son más rápidos de adoptar y más fáciles de escalar. Proveedores como OpenAI, AWS Bedrock, Google Cloud y Azure ofrecen API administradas con acceso instantáneo a modelos vanguardistas. Estos servicios reducen la carga operativa y aceleran el tiempo de obtención de valor, especialmente durante las primeras etapas de la experimentación. Sin embargo, vienen acompañados de preocupaciones en torno a la privacidad de los datos, la dependencia de un proveedor y los costos recurrentes. Para muchas empresas, enviar datos privados a terminales externos no es fácil, a menos que se apliquen políticas estrictas de cifrado, anonimización y acceso.

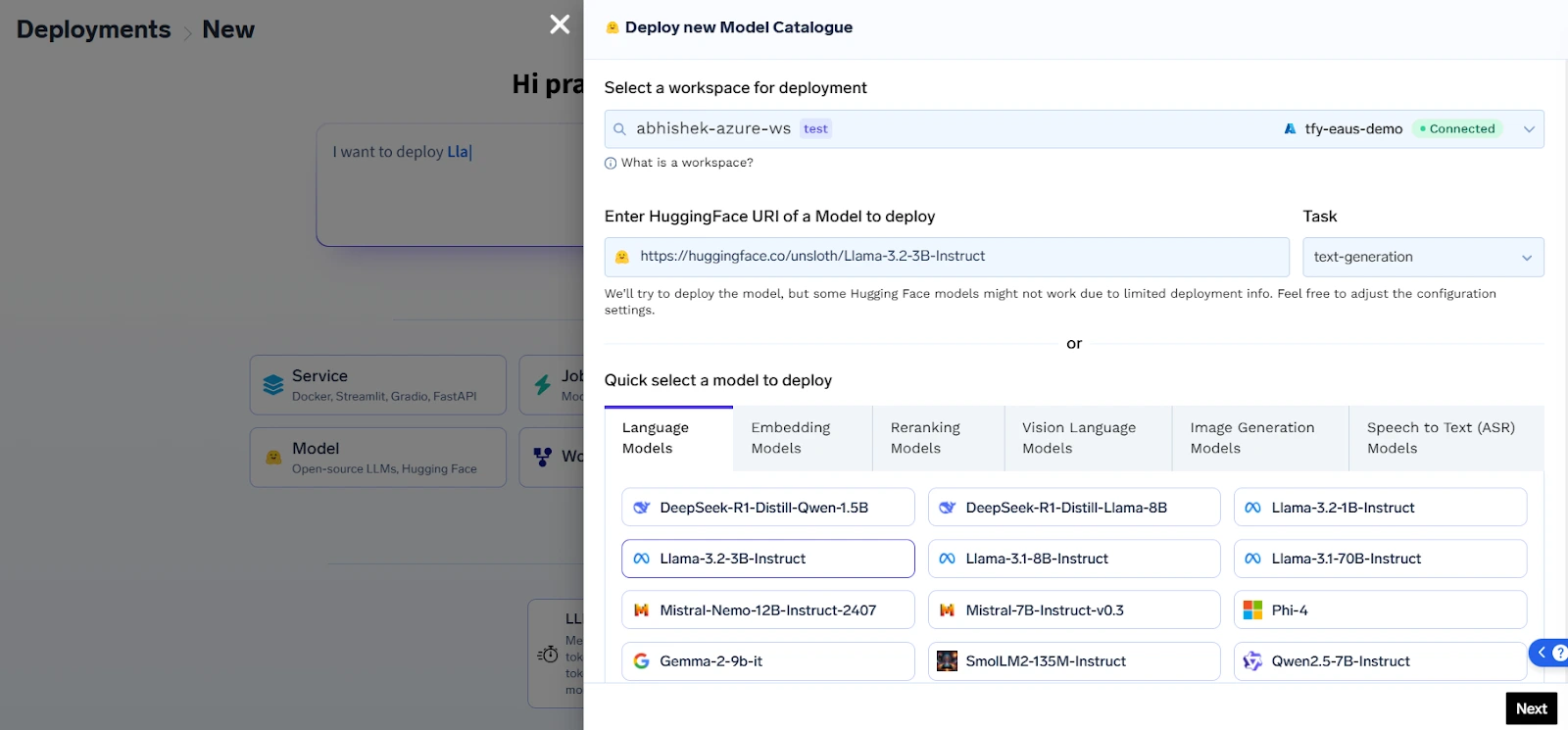

Soluciones híbridas y de VPC

Una tendencia creciente es la implementación híbrida, en la que la inferencia se ejecuta en un entorno de nube privada virtual (VPC). Esto equilibra la flexibilidad de la nube con la seguridad de una infraestructura aislada. Plataformas como TrueFoundry y Hugging Face admiten el alojamiento privado de modelos de código abierto en entornos controlados por la empresa, lo que ofrece lo mejor de ambos mundos.

Elegir el modelo de implementación correcto no es solo una decisión técnica. Afecta directamente al cumplimiento, el rendimiento y los costos a largo plazo. Las empresas deben evaluar sus casos de uso, su tolerancia al riesgo y la madurez de la infraestructura antes de comprometerse con una ruta.

Monitoreo y observabilidad en LLM empresariales

La supervisión de los LLM en entornos empresariales es fundamentalmente diferente de la supervisión de los modelos tradicionales de aprendizaje automático. Los LLM son probabilísticos, no deterministas y muy sensibles al contexto. Sin una observabilidad adecuada, su comportamiento puede desviarse silenciosamente, generar resultados incorrectos o introducir riesgos, sin ningún indicio de fallo en el sistema.

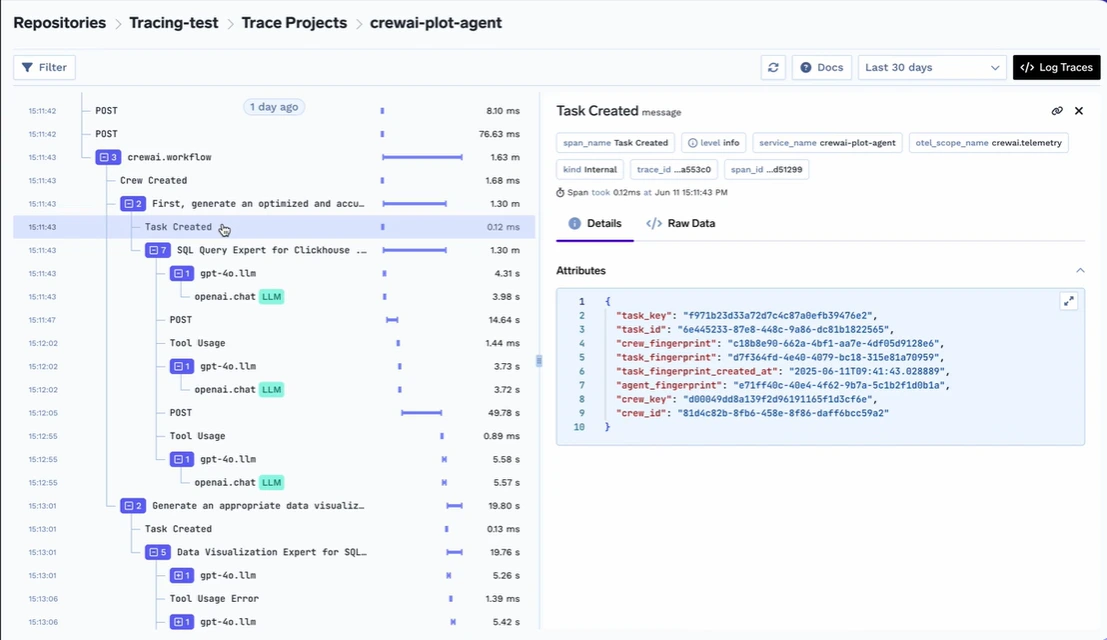

Rastreo y control de versiones rápidos: Las empresas deben realizar un seguimiento de cada interacción entre los usuarios y el LLM, incluida la estructura exacta de las solicitudes, los mensajes del sistema y la ventana de contexto. La observabilidad comienza con la trazabilidad total. El registro de las plantillas de indicaciones, las versiones de los modelos, los ajustes de temperatura y los pares de entrada-salida permite a los equipos reproducir y analizar los resultados más adelante.

Evaluación de los resultados y fundamentación: Es crucial monitorear la precisión fáctica y la relevancia de las respuestas del LLM. Las empresas deberían implementar controles automáticos para detectar alucinaciones, por ejemplo, validando los resultados comparándolos con documentos internos conocidos o obligando a citar las fuentes mediante procedimientos RAG. La evaluación de los resultados mediante rúbricas de puntuación como la utilidad, la corrección y la integridad añade estructura a la supervisión.

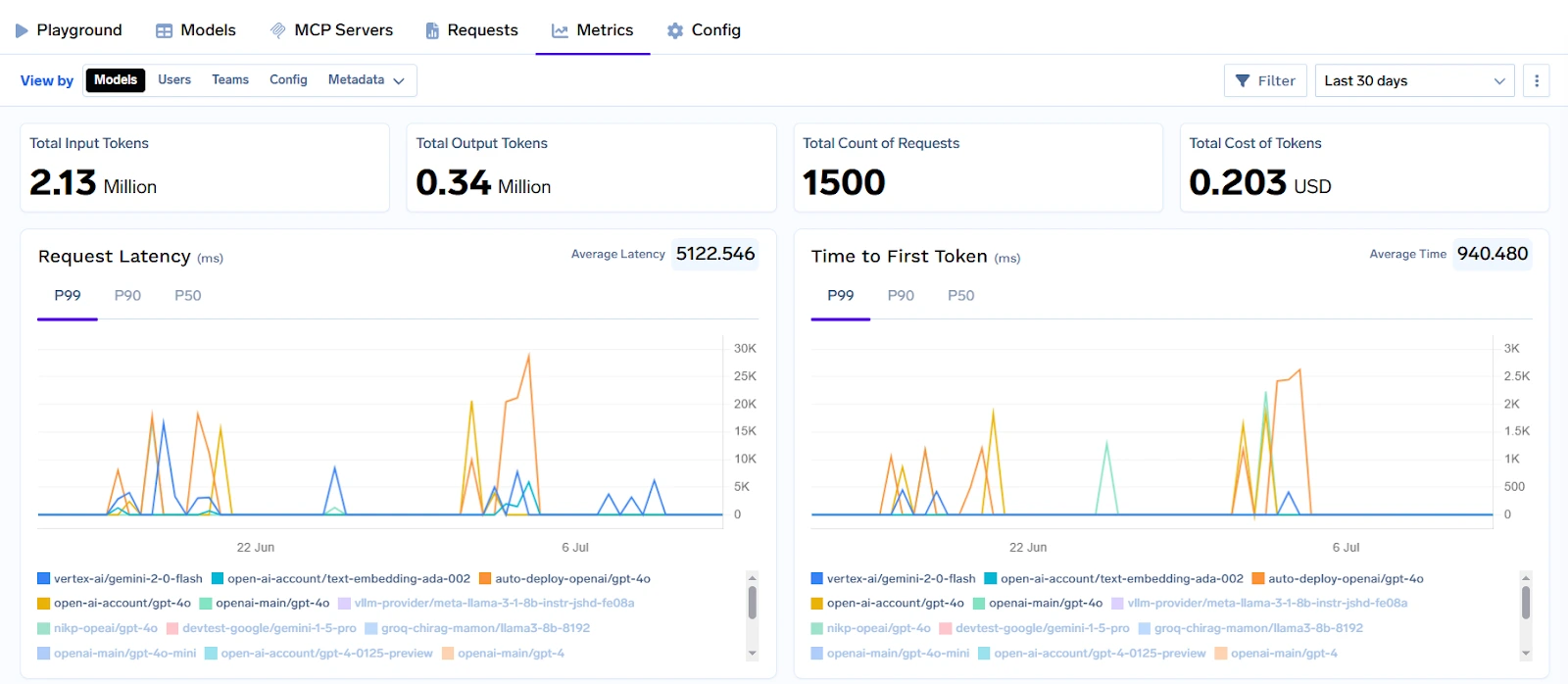

Latencia y uso de tokens: Si bien las métricas de infraestructura se manejan en otros lugares, la observabilidad en la capa LLM incluye el seguimiento del tamaño de entrada del token, la longitud de salida y el consumo total de tokens. Estas métricas afectan directamente al tiempo y al costo de respuesta. Los picos de fichas pueden indicar problemas de ingeniería rápidos o un uso indebido.

Detección de salidas dañinas o inseguras: Los LLM pueden generar un lenguaje sesgado, ofensivo o que no cumpla con las normas si las barreras de protección fallan. Las empresas deben supervisar los resultados para detectar términos delicados, violaciones de tono o filtraciones de datos mediante clasificadores o comparadores de patrones. Las pruebas contradictorias y de equipo en rojo pueden revelar puntos ciegos.

Integración de Feedback Loop: Los comentarios de los usuarios son fundamentales. Las empresas deben captar las correcciones, las señales de insatisfacción y las calificaciones. Estas señales contribuyen a un rápido refinamiento, a las actualizaciones de los RAG y al ajuste de los modelos.

Sin una observabilidad específica, los LLM se comportan como cajas negras. Con una supervisión adecuada, se convierten en sistemas transparentes en los que las empresas pueden confiar, auditar y mejorar continuamente.

El enfoque de TrueFoundry para las LLM empresariales

TrueFoundry está diseñado específicamente para ayudar a las empresas a implementar, administrar y escalar las aplicaciones de LLM con el control, la seguridad y el rendimiento que exigen los entornos de producción. A diferencia de las plataformas de IA genéricas, TrueFoundry se centra en una infraestructura de IA modular de nivel de producción que se adapta al entorno de nube, local o híbrido de una empresa.

El núcleo de su oferta es una capa de infraestructura de IA nativa de Kubernetes que permite a los equipos implementar LLM propietarios y de código abierto, como LLama, Mistral, Falcon y GPT-J, con un control total sobre el alojamiento, las redes y la seguridad. Esto garantiza que los datos empresariales confidenciales permanezcan dentro de los límites de la organización, ya sea que se desplieguen en una nube privada o en un centro de datos local.

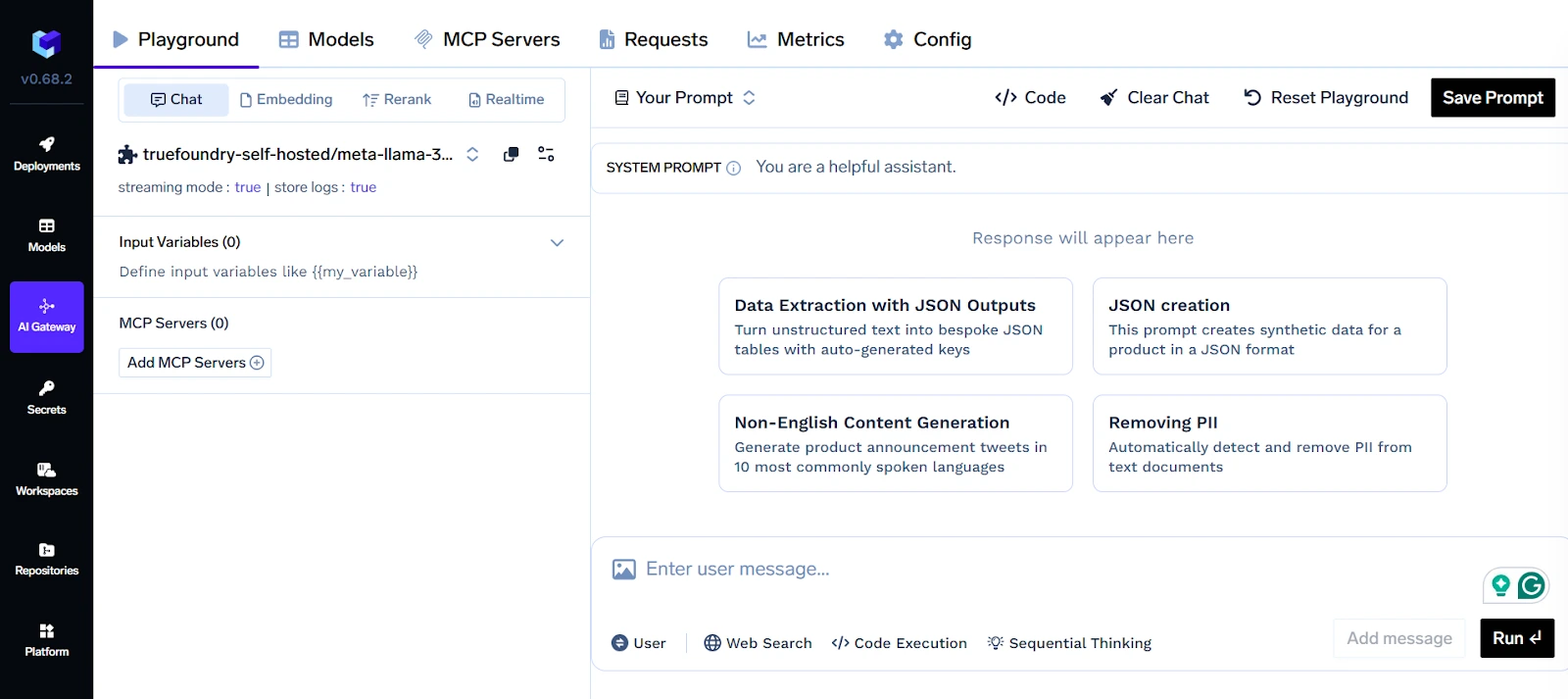

Para las empresas que utilizan varios proveedores de LLM (por ejemplo, OpenAI, Anthropic, Cohere), TrueFoundry ofrece una pasarela de LLM unificada. Esta capa de abstracción permite a los equipos cambiar de proveedor o enrutar el tráfico de forma inteligente en función del costo, la latencia o las necesidades de cumplimiento. También admite estrategias alternativas y multimodelo, que son esenciales para la confiabilidad en los entornos de producción.

Para garantizar la confianza y la observabilidad, TrueFoundry proporciona una supervisión y un análisis profundos a nivel de rapidez y respuesta, y funciona como una capa central junto con la empresa. Herramientas de observabilidad de LLM. Las empresas pueden hacer un seguimiento de las indicaciones que se utilizan, el comportamiento de los modelos a lo largo del tiempo y la latencia o el coste asociados a cada solicitud. Esto es fundamental para la depuración, las auditorías de cumplimiento y el ajuste del rendimiento.

TrueFoundry también admite RAG (Retrieval-Augmented Generation) de forma inmediata, lo que permite a las empresas basar las respuestas de LLM en su conocimiento interno. Se integra con tiendas vectoriales populares, como Weaviate, Pinecone y Qdrant, lo que permite obtener respuestas precisas y adaptadas al contexto sin necesidad de volver a capacitar a los modelos básicos.

Las empresas también pueden aprovechar el control de versiones rápido, el seguimiento del uso de los tokens y el ajuste de las canalizaciones con entornos de espacio aislado seguros. Los controles de acceso, la administración de las claves de API y los registros de auditoría garantizan una seguridad y una gobernanza de nivel empresarial. TrueFoundry permite la transparencia y el control de los costos mediante la facturación granular, la limitación de tarifas y las cuotas de uso, lo que brinda a los equipos de ingeniería y finanzas una visibilidad total del uso de la LLM a gran escala.

Con TrueFoundry, las empresas no solo implementan LLM, sino que las ponen en funcionamiento. La plataforma cierra la brecha entre la experimentación y la producción, lo que permite crear aplicaciones basadas en LLM confiables, escalables y que cumplan con las normas.

Tendencias futuras en las LLM empresariales

A medida que madura la adopción empresarial de las LLM, el enfoque pasa del acceso a la optimización, la orquestación y la escala. Una de las tendencias más importantes es el auge de modelos de código abierto pequeños y eficientes. Modelos como Mistral, Phi-3 y DBRX muestran que el tamaño ya no es el único indicador de calidad. Las empresas están ajustando cada vez más estos modelos más pequeños para satisfacer las necesidades específicas de las tareas y, al mismo tiempo, reducir los costos y la latencia.

Otra tendencia emergente es el cambio hacia los sistemas de agencia, en los que los LLM no solo responden a las indicaciones, sino que actúan como agentes autónomos que planifican, razonan y ejecutan tareas en múltiples sistemas. Esto permite flujos de trabajo empresariales más complejos, como la incorporación, el procesamiento de documentos en varios pasos y el análisis automatizado.

También estamos viendo una profunda integración con los gráficos de conocimiento y las bases de datos empresariales. En lugar de confiar únicamente en las incrustaciones y los almacenes vectoriales, las organizaciones están conectando los LLM con fuentes de conocimiento estructuradas para ofrecer resultados más fundamentados, auditables y rastreables.

Por último, las herramientas de gobernanza y cumplimiento dejarán de ser negociables. A medida que los LLM ejecuten más flujos de trabajo críticos para la empresa, las empresas exigirán un control riguroso sobre las solicitudes, los resultados y los permisos de los usuarios.

Estas tendencias apuntan a un futuro en el que las LLM se conviertan en una infraestructura fundamental: segura, componible y profundamente integrada en las operaciones empresariales.

Conclusión

Los LLM empresariales ya no son experimentales; se están convirtiendo rápidamente en una parte fundamental de la infraestructura empresarial moderna. Sin embargo, aprovechar todo su potencial requiere algo más que el acceso a modelos potentes. Exige la arquitectura, la estrategia de implementación, los sistemas de monitoreo y los marcos de gobierno correctos. Con plataformas como TrueFoundry, las empresas pueden ir más allá de los prototipos y crear aplicaciones LLM seguras, escalables y basadas en el ROI. A medida que el ecosistema evolucione, los ganadores serán aquellos que traten los LLM no como herramientas mágicas, sino como sistemas gestionados profundamente integrados, observados constantemente y alineados con los resultados empresariales.

Preguntas frecuentes

¿Qué es un LLM empresarial?

Un LLM empresarial es un modelo lingüístico de gran tamaño optimizado para entornos corporativos, que prioriza la seguridad de los datos, la escalabilidad y la integración con los sistemas internos. A diferencia de los modelos de uso general, un LLM para empresas está diseñado para funcionar en la nube privada de la empresa o en la infraestructura local, garantizando que los datos confidenciales permanezcan protegidos. Estos modelos se suelen utilizar para impulsar herramientas especializadas, como las bases de conocimiento internas y los flujos de trabajo automatizados.

¿Cómo crear LLM empresariales?

Para crear una LLM empresarial, las organizaciones deben ir más allá de las simples llamadas a la API y establecer una canalización de nivel de producción. Esto implica configurar una infraestructura sólida para el alojamiento de modelos, implementar la generación aumentada por recuperación (RAG) para basar el modelo en datos privados y crear una puerta de enlace de inteligencia artificial para una administración centralizada. TrueFoundry agiliza este proceso al proporcionar las herramientas de MLOps necesarias para implementar y escalar estos modelos, manteniendo al mismo tiempo una gobernanza total.

¿Cuáles son algunos casos de uso de LLM empresarial?

Los casos de uso habituales de LLM empresarial incluyen la creación de motores de búsqueda basados en RAG para documentos propietarios, la automatización del análisis de contratos complejos y la implementación de agentes de IA para el soporte técnico. Al aprovechar la LLM en las empresas, las empresas pueden reducir significativamente el tiempo de procesamiento manual y, al mismo tiempo, aumentar la precisión de la recuperación de la información interna.

¿Qué son los puntos de referencia de LLM empresarial?

Los puntos de referencia estándar a menudo no capturan los requisitos de un entorno de producción. Para un LLM empresarial, los puntos de referencia fundamentales incluyen la latencia inferencial, la rentabilidad simbólica y las métricas de «fidelidad» en las canalizaciones de RAG para garantizar que no se produzcan alucinaciones. La supervisión de estos puntos de referencia permite a los equipos evaluar si un modelo específico cumple con los estándares de rendimiento y confiabilidad requeridos para las aplicaciones orientadas al cliente o de misión crítica.

¿Cómo elegir la solución LLM empresarial adecuada?

La elección del LLM empresarial adecuado para crear requiere equilibrar el rendimiento del modelo con los requisitos de soberanía de los datos. Muchas organizaciones utilizan una combinación de modelos propietarios para el razonamiento complejo y modelos de código abierto para tareas de gran volumen que afectan a la privacidad. Una plataforma flexible como TrueFoundry permite evitar la dependencia de un proveedor al proporcionar una interfaz unificada para cambiar entre diferentes modelos en función de las necesidades específicas de costo y seguridad de cada proyecto.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)