La pregunta de 360 000 dólares sobre la economía de los modelos lingüísticos grandes

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

El propósito de este artículo es educar al lector sobre cómo funcionan los precios de los modelos de lenguaje grande (LLM). Esto está motivado por nuestras conversaciones con varias empresas que utilizan los LLM con fines comerciales. En estas conversaciones nos dimos cuenta de que la economía de la LLM a menudo se malinterpreta, lo que deja un enorme margen de optimización.

¿Te das cuenta de que haciendo el la misma tarea puede llevar 3500$ con un modelo o 1 260 000$ con otro? Esto se produce a costa de la diferencia en el rendimiento, pero deja mucho espacio a la mitad para pensar en cuál es la compensación entre costo y rendimiento. ¿La tarea es tal que puedo usar algo que sea más barato?

Hemos descubierto que, una y otra vez, las empresas sobrestiman o subestiman su gasto en modelos lingüísticos de gran tamaño. En este caso, trataremos de entender el coste que supone utilizar algunos de los modelos lingüísticos más populares y entender cómo funcionan sus precios.

ℹ️

El propósito de este blog no es educar al lector sobre los LLM o sus actuaciones. Este es un blog intensivo en matemáticas centrado en entender los precios de los LLM. Para simplificar, no compararíamos el rendimiento entre estos modelos.

Resumiendo Wikipedia

El muestra para el análisis de precios

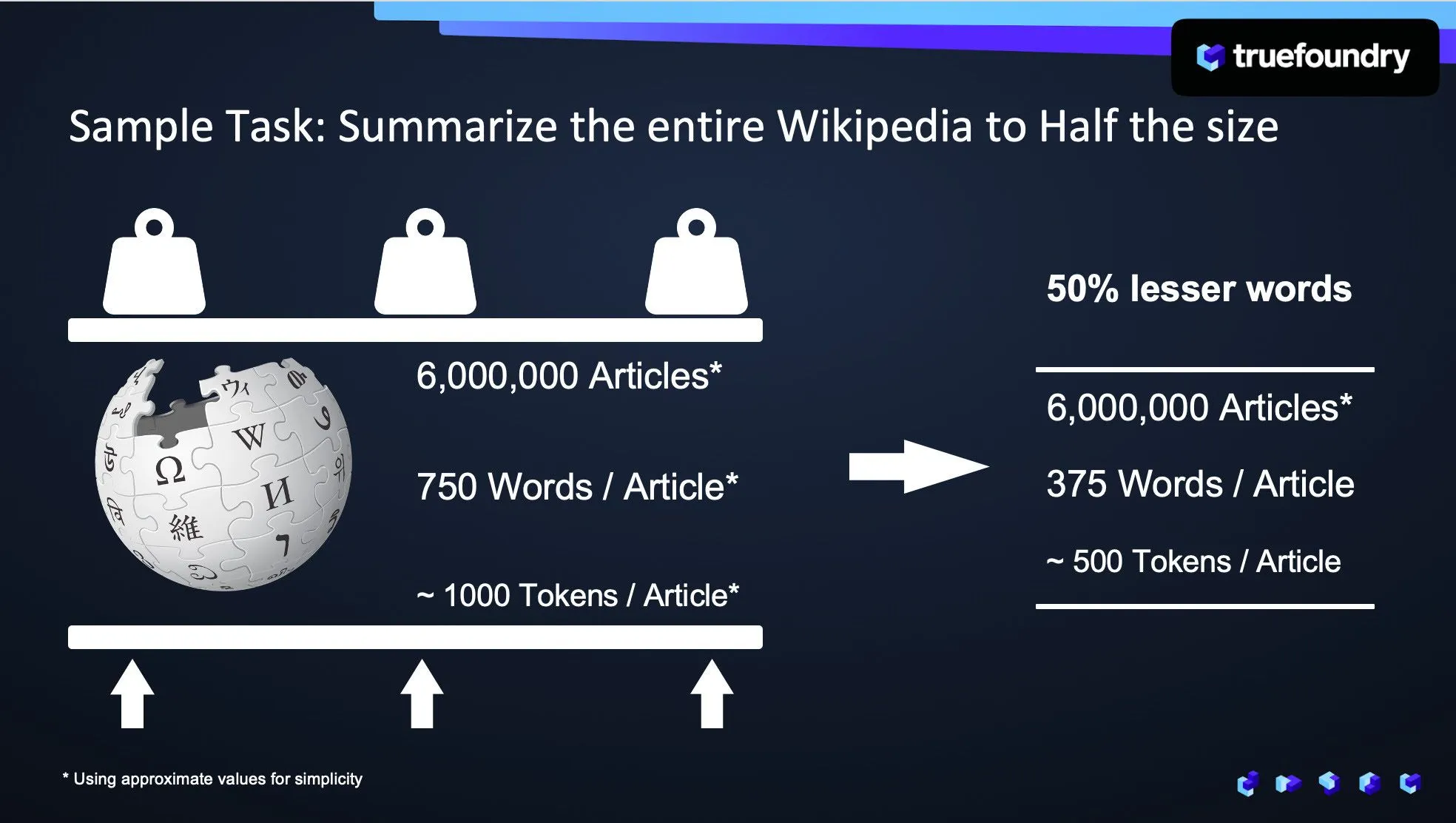

Para entender cómo funcionan los precios de los LLM, compararíamos el costo incurrido en la misma tarea, es decir, resumir Wikipedia con la mitad de su tamaño.

Detalles del tamaño de la tarea

Usaríamos algunas aproximaciones para simplificar los cálculos y hacerlos más fáciles de entender

Tamaño del corpus de Wikipedia

- ~ 6 millones de artículos en total

- ~ 750 palabras por artículo

- ~ 1000 fichas por artículo

❓

Fichas son subpartes de palabras que no dependen precisamente del principio o el final de las palabras. Es la unidad en la que las API de OpenAI dividen la entrada en fichas antes de que se procesen. Los símbolos pueden incluir espacios al final e incluso subpalabras.

El tamaño esperado de la salida resumida

Para esta tarea, asumimos que cada artículo se está comprimiendo a la mitad de su tamaño para simplificar. Por lo tanto, los resultados que esperamos serán los siguientes:

- ~6 millones de artículos

- ~375 palabras por artículo resumido

- ~500 fichas por artículo

Comprensión de los costos

Comparar lo que costaría usar diferentes modelos para esta tarea

Palancas de precios en OpenAI/API de terceros

OpenAI y otras API de terceros suelen cobrar en función de dos palancas: si quieres inferir el uso de sus API

Coste de entrada

Este costo depende de la cantidad de tokens (explicados anteriormente) que se pasen como contexto/indicación/instrucción a la API.

Coste de producción

El costo se basa en la cantidad de tokens que la API devuelve como respuesta.

En el caso de una tarea como la de resumir, dado que es necesario pasar al modelo todo el documento o extracto que se va a resumir, la cantidad de fichas que forman parte del mensaje puede llegar a ser significativa y, por lo tanto, el costo de los insumos.

Base del costo incurrido con los modelos autohospedados

Con los modelos autohospedados, el usuario debe administrar o aprovisionar la máquina necesaria para ejecutar el modelo. Si bien puede incluir el costo de administrar estos recursos, el precio es relativamente fácil de entender, ya que se basa únicamente en el costo de funcionamiento de la máquina (por lo general, lo que cobran los proveedores de la nube, a menos que tenga su propio clúster local)

Costo de la máquina

Costo de aprovisionamiento de la máquina requerida para ejecutar o alojar el modelo. Dado que la mayoría de estos modelos más grandes son más grandes que lo que se puede ejecutar en un portátil o en un único dispositivo local, lo más común es utilizar un proveedor de nube para estas máquinas.

Los proveedores de nube ofrecen estas instancias, aunque los usuarios pueden tener problemas de disponibilidad de GPU, ya que estos modelos requieren GPU.

Costos de las instancias de AWS

Costos de Google Cloud Instance

Costos de las instancias de Microsoft Azure

Instancias puntuales

Los proveedores de nube ofrecen su capacidad sobrante a un costo entre un 40 y un 90% más económico que las instancias bajo demanda

Comparación del costo de los diferentes modelos

GPT 4: longitud de contexto de 8K

Costos unitarios

Fórmula de costo

Costo = No. De fichas (por cada 1000 artículos) x número de artículos (en miles) x coste unitario (por millón de fichas)

Costo de la entrada

1000 (tokens/artículo) X 6000 000 (artículos) X 30$ (/millón de fichas) = 180.000 dólares

Coste de producción

0,5 K (tokens/artículo) X 6.000 K (artículos) X 60$ (/millón de fichas) = 180.000 dólares

Coste total

Costo de entrada + costo de salida

= 360.000$

GPT 4: longitud de contexto de 32 K

Costos unitarios

Costo de entrada (/Mn de tokens) Costo de salida (/Mn de tokens) $60 $120

Fórmula de costo

Costo = No. De fichas (por cada 1000 artículos) x número de artículos (en miles) x coste unitario (por millón de fichas)

Costo de la entrada

1000 (tokens/artículo) X 6000 000 (artículos) X 60$ (/Mn de fichas) = 360.000 dólares

Coste de producción

0,5 K (tokens/artículo) X 6.000 K (artículos) X 120$ (/millón de fichas) = 360.000 dólares

Coste total

Costo de entrada + costo de salida

= 720.000$

Claude antrópico V1

Costos unitarios

Fórmula de costo

Costo = número de fichas (por 1000 artículos) x número de artículos (en miles) x costo unitario (por millón de fichas)

Costo de la entrada

1000 (tokens/artículo) X 6.000 (artículos) X 11$ (/millón de fichas) = 66.000 dólares

Coste de producción

0,5 K (tokens/artículo) X 6.000 K (artículos) X 60$ (/millón de fichas) = 96.000 dólares

Coste total

Costo de entrada + costo de salida

= 162.000$

InstructGP - Da Vinci

Costos unitarios

Fórmula de costo

Costo = No. De fichas (por cada 1000 artículos) x número de artículos (en miles) x coste unitario (por millón de fichas)

Costo de la entrada

1000 (tokens/artículo) X 6000 000 (artículos) X 20$ (/Mn de fichas) = 120.000 dólares

Coste de producción

0,5 K (tokens/artículo) X 6.000 K (artículos) X 20$ (/Mn de fichas) = 60.000 dólares

Coste total

Costo de entrada + costo de salida

= 180.000$

Curie

Costos unitarios

Fórmula de costo

Costo = No. De fichas (por cada 1000 artículos) x número de artículos (en miles) x coste unitario (por millón de fichas)

Costo de la entrada

1000 (tokens/artículo) X 6000 000 (artículos) X 2$ (/millón de fichas) = 12.000 dólares

Coste de producción

0,5 K (tokens/artículo) X 6.000 K (artículos) X 60$ (/millón de fichas) = 6.000 dólares

Coste total

Costo de entrada + costo de salida

= 18.000$

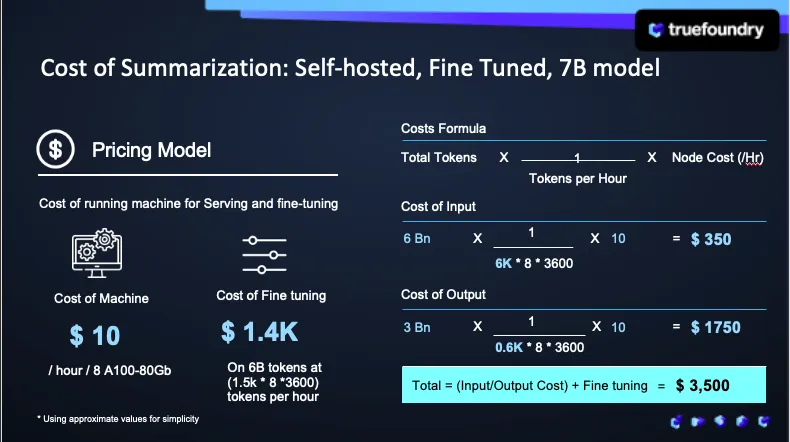

Modelo 7B autohospedado

Costos unitarios

Costo de funcionamiento de la máquina (/hora para Spot A100-80 Gb) 10$

Fórmula de costo

Costo = número de fichas (por 1000 artículos) x número de artículos (en miles) x costo unitario (por millón de fichas)

Costo de la entrada

1000 (tokens/artículo) X 6000 000 (artículos) X 30$ (/millón de fichas) = 180.000 dólares

Coste de producción

0,5 K (tokens/artículo) X 6.000 K (artículos) X 60$ (/millón de fichas) = 180.000 dólares

Coste total

Costo de entrada + costo de salida

= 360.000$

Modelos de ajuste fino

En la mayoría de los casos de uso, las empresas las necesitan para ajustar modelos específicos para sus propios datos y para tareas particulares. Varias empresas han informado de que los modelos de código abierto perfeccionados están a la altura o, a veces, incluso son mejores que las API de terceros, como OpenAI, para una tarea específica.

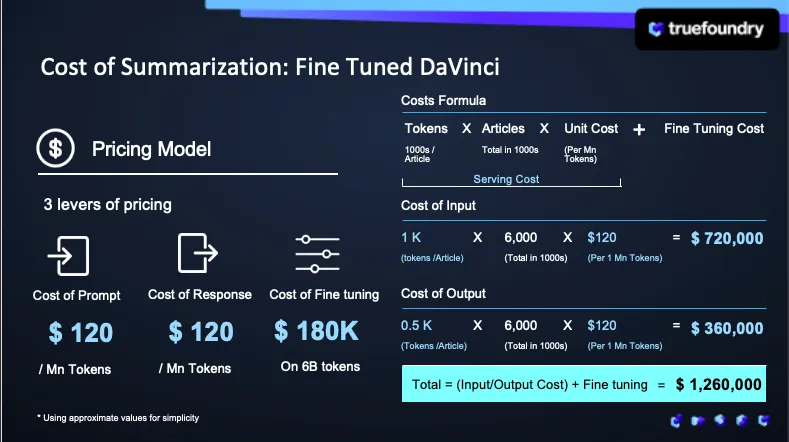

DaVinci afinado

Coste total

Costo de entrada + costo de salida

= 1.260.000 dólares

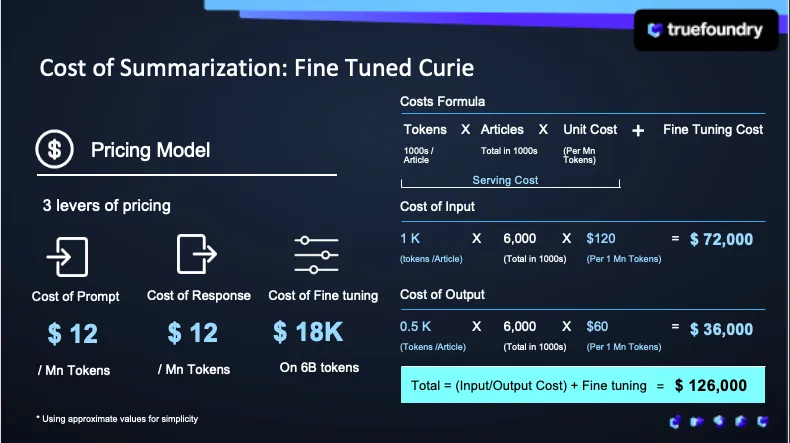

Curie afinado

Coste total

Costo de entrada + costo de salida

= 126.000$

Modelo 7B autohospedado, ajustado con precisión

Coste total

Costo de entrada + costo de salida

= 126.000$

Poniéndolo todo junto

Aspectos a tener en cuenta en los precios:

- Los modelos DaVinci y Curie son aproximadamente 7 veces más caros si los estás ajustando según tu caso de uso

- El costo aumenta con un aumento de la ventana de contexto de aproximadamente el doble

- El costo de usar el modelo aumenta con un aumento en el número de parámetros del modelo

Efecto del ajuste fino en el rendimiento

Usamos el siguiente punto de referencia para analizar el efecto del ajuste fino de los modelos en el rendimiento de los modelos. Es interesante observar que:

- Los modelos con parámetros más bajos también pueden funcionar mejor que los modelos más grandes cuando se ajustan a un caso de uso en particular.

- Es posible ahorrar costos de manera significativa sin dañar demasiado el rendimiento si se establece el equilibrio correcto entre costo y rendimiento.

Tipo de tarea Best 6B/7B OOTB Model Few-ShotMoveLM 7B Zero-Shot GPT-3.5 Turbo Zero-Shot GPT-3.5 Turbo Few-Shot GPT-4 Few-Shot Relevancia: conjunto de datos interno0,330,930,840,920,95Extracción: salida estructurada para consultas0.380,980,220.720.380.73Razonamiento: activación personalizada0,620,930.870.880.90.88Clasificación: dominio de la consulta del usuario0,210,790.60.730.70.76 Extracción: salida estructurada de la escritura de entidades0,830,870,90,890,890,89

Qué estamos haciendo

¡TrueFoundry cree que el futuro de los LLM es la coexistencia de los LLM comerciales y de código abierto dentro de la misma aplicación!

Creemos en un estado de aplicaciones en el que las tareas más sencillas se gestionen mediante LLM livianos de código abierto, mientras que las tareas más complejas o las que requieren capacidades distintas (por ejemplo, búsqueda web, llamadas a API, etc.), que solo ofrecen los LLM comerciales de código cerrado, se les pueden delegar.

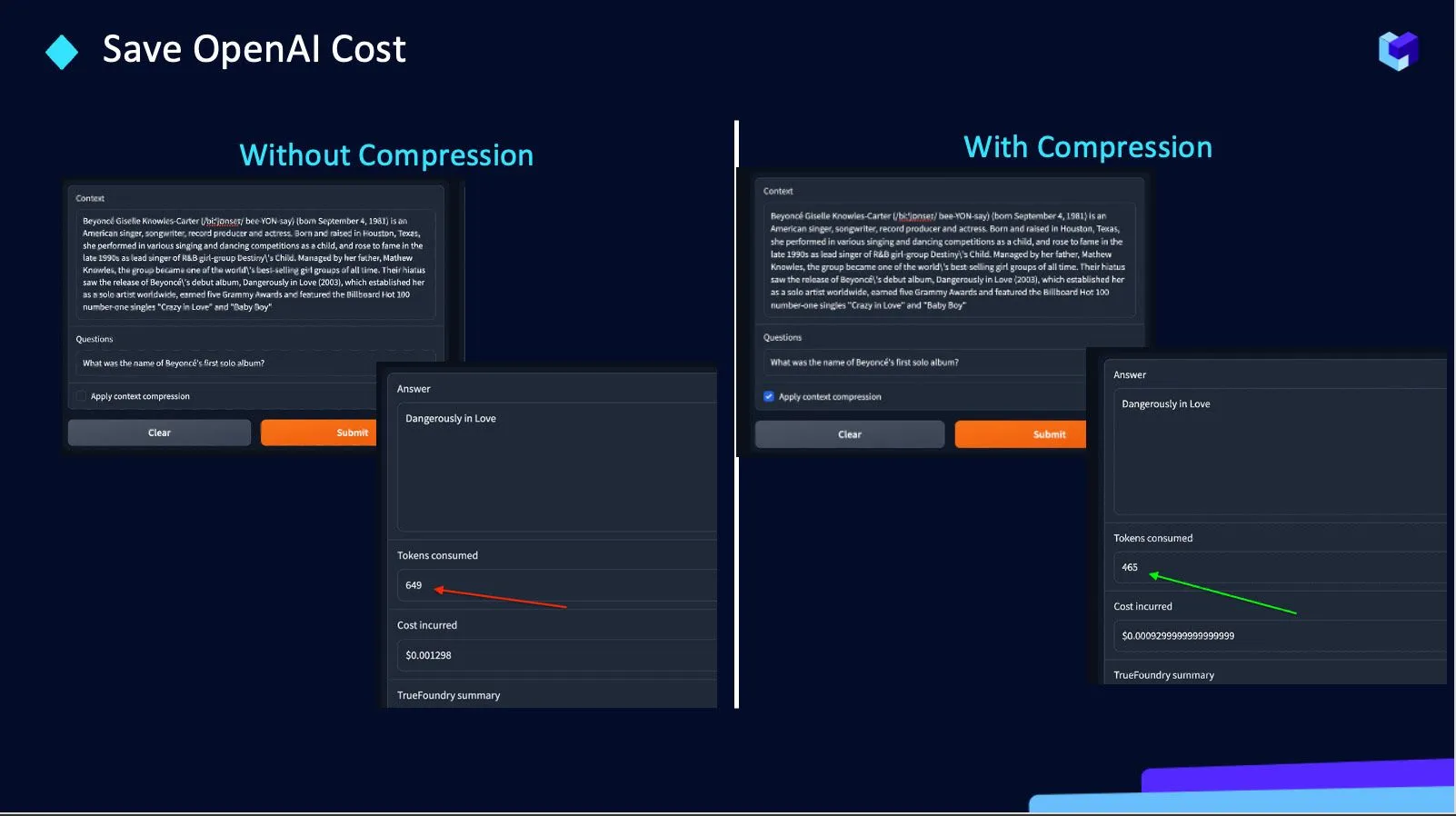

Si está utilizando OpenAI

Ayudamos a reducir la cantidad de tokens enviados a las API de OpenAI. Por eso decidimos trabajar en esto porque:

- Nos dimos cuenta de que más de la mitad del costo consistía en procesar los tokens contextuales y de aviso.

- No todas las palabras son necesarias. Los LLM son excelentes para trabajar con oraciones incompletas.

Por lo tanto True Foundry está creando una API de compresión para ahorre el costo de OpenAI en un ~ 30%.

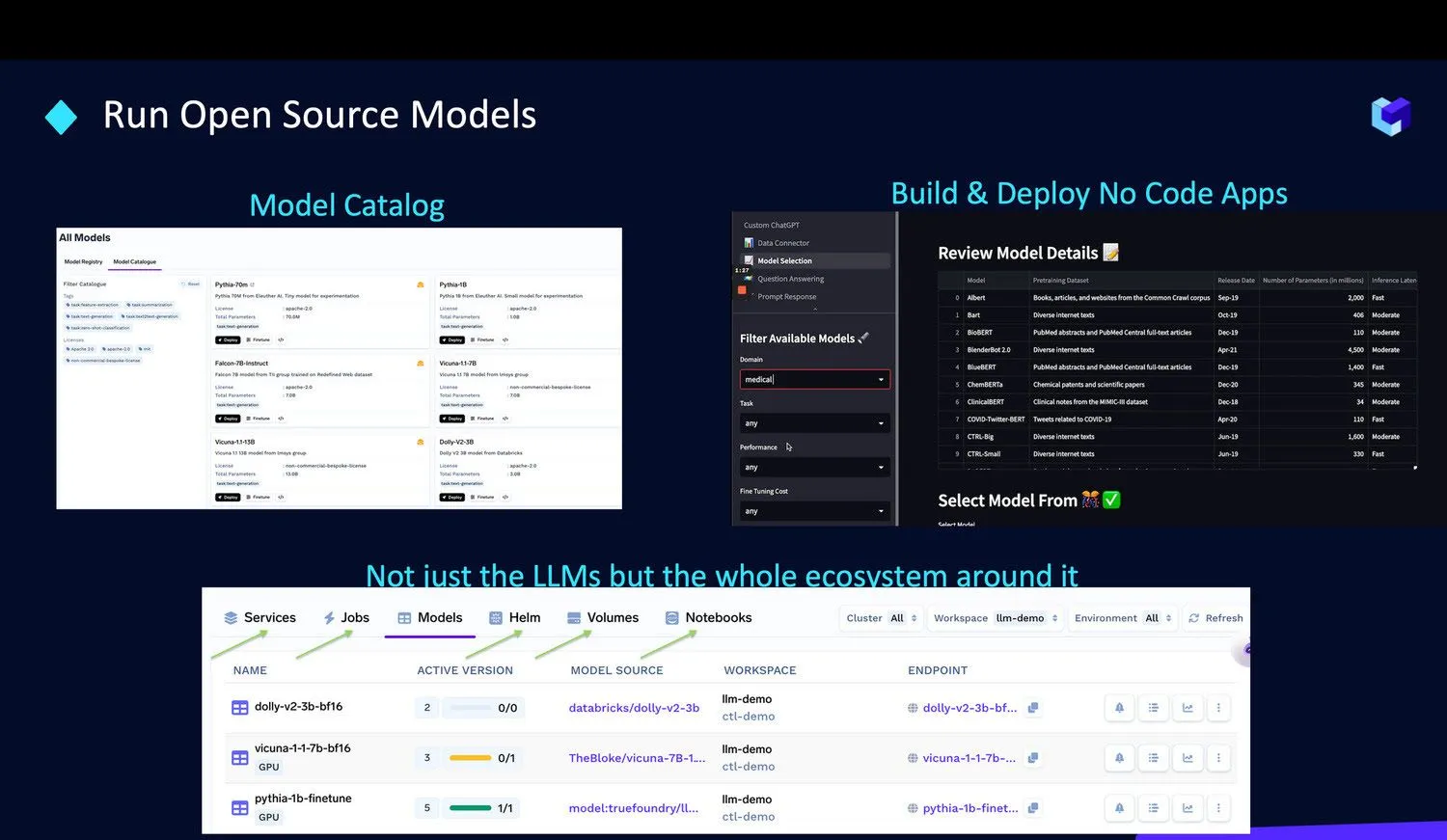

Si quieres usar LLMs de código abierto

Simplificamos la ejecución de estos modelos dentro de su propia infraestructura a través de nuestras siguientes ofertas:

- Catálogo de modelos: De LLM de código abierto, optimizados para la inferencia y el ajuste fino.

- API integradas: Estas se pueden cambiar directamente por las API de HuggingFace y OpenAI que ya ejecutas en tus aplicaciones.

- Optimización de costos: Across cloud en K8s al aprovechar sus créditos o su presupuesto en la nube.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)