Cursor Security: guía completa sobre los riesgos, el flujo de datos y las mejores prácticas

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Probablemente no pienses mucho en el cursor, pero puede afectar a tu seguridad digital más de lo que crees. Cada vez que haces clic en un enlace o escribes información, el cursor interactúa con los sitios web y las aplicaciones, y esto puede generar riesgos si no tienes cuidado. Esta guía está diseñada para los equipos de DevSecOps, los ingenieros de seguridad y los desarrolladores que necesitan tener una idea clara de lo que ocurre con su código: qué es la seguridad del cursor, cómo funciona Cursor, los tipos de datos que maneja, las vulnerabilidades pasadas, los principales riesgos y las mejores prácticas para usarlo de forma segura.

.webp)

¿Qué es la seguridad del cursor y por qué es importante?

Los IDE basados en inteligencia artificial han evolucionado rápidamente, pasando de ser herramientas «útiles» a una infraestructura de desarrollo básica, a menudo más rápido de lo que los equipos de seguridad pueden adaptarse. Cursor, de Anysphere, es un ejemplo destacado: un editor basado en VS Code con una profunda integración con la IA que puede generar, refactorizar e incluso ejecutar código o acciones externas.

El cursor ya no es un nicho. A mediados de 2025, los informes destacaban su rápido crecimiento, situando sus ingresos en torno a los 500 millones de dólares en ARR [Fuente]. El propio Cursor afirma que lo utilizan «decenas de miles de empresas», y sus clientes mencionan públicamente en su publicación de lanzamiento empresarial [Fuente]. El CEO de NVIDIA también ha reconocido públicamente el uso generalizado de herramientas de codificación de IA, incluida Cursor, en NVIDIA. [Fuente] Este crecimiento ha sido en gran medida orgánico, impulsado por la adopción viral, las comunidades de desarrolladores y un generoso modelo freemium.

Lo que hace que Cursor sea único es su enfoque: ya no solo escribes código manualmente, sino que diriges a un agente de IA que lee, escribe y ejecuta código por ti, una tendencia que a menudo se denomina «codificación de vibraciones».

Sin embargo, la integración de la IA de la agencia en el IDE presenta nuevos desafíos de seguridad. A diferencia de los editores tradicionales, Cursor funciona en un entorno semiautónomo conectado a la nube en el que el código interactúa continuamente con sistemas externos.

Para las empresas, estos riesgos son importantes. Con la adopción a gran escala y las vulnerabilidades emergentes, como las vulnerabilidades del CVE-2025, es esencial comprender cómo Cursor gestiona la seguridad.

Anatomía del cursor: comprensión de la superficie de ataque

Antes de profundizar en la infraestructura de seguridad de los cursores, es importante entender el motor de cursores. Cursor no es solo un IDE estático; es un conjunto de agentes con alta autonomía que trabajan juntos. En términos de seguridad, cada función de Cursor representa una «pregunta» de seguridad, que también es una posible exposición. Así es como las principales capacidades de Cursor se traducen en una superficie de ataque.

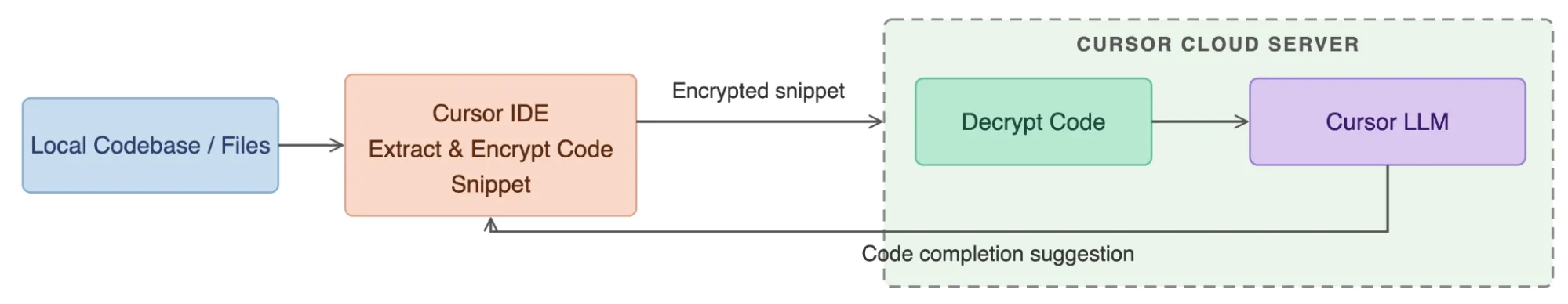

1. Autocompletar código

El cursor predice el código en línea a medida que escribes. Los fragmentos pequeños del archivo activo se cifran y se envían a los servidores de Cursor, donde un LLM personalizado genera terminaciones en menos de un segundo.

Riesgo de seguridad: Para las organizaciones, esto requiere una retención de datos absoluta (ZDR), lo que garantiza que millones de consultas por segundo se procesen solo en la memoria y nunca se escriban en registros permanentes. Cualquier error podría exponer código confidencial.

2. Asistente de chat

Cursor puede colaborar para crear funciones o corregir errores. Utiliza el razonamiento de una agencia para buscar en tu base de código indexada y combinar fragmentos para crear instrucciones enriquecidas para el modelo de IA.

Riesgo de seguridad: A pesar de las mejoras con respecto a la IA basada en fragmentos, es posible la inyección inmediata indirecta. Las instrucciones malintencionadas ocultas en bibliotecas, archivos README o comentarios de terceros podían «envenenar» al agente y hacer que ejecutara tareas no autorizadas o filtrara la lógica interna a una URL externa.

3. Modo de edición en línea (Cmd+K)

El cursor refactoriza bloques de código específicos de una manera quirúrgica y precisa. El código y las instrucciones seleccionados se envían al modelo, que devuelve una diferencia que se aplica directamente al archivo.

Riesgo de seguridad: La rápida refactorización de la IA puede introducir sutiles fallos de seguridad, especialmente cuando los revisores están cansados. Algunos ejemplos son las entradas no validadas, los secretos codificados o los errores lógicos provocados por la IA. Los desarrolladores deben inspeccionar cuidadosamente las ediciones antes de aceptarlas.

.webp)

4. Revisión automática del código con BugBot

BugBot revisa las Pull Requests y sugiere soluciones, que requieren acceso de lectura/escritura a tus repositorios privados de GitHub.

Riesgo de seguridad: Su canalización de CI/CD ahora depende parcialmente de la infraestructura de nube de Cursor. BugBot debe tratarse como una entidad privilegiada y sus permisos deben tener un alcance estricto para minimizar el riesgo.

5. Agentes en segundo plano

Cursor transfiere las tareas de larga duración a los agentes en segundo plano, como la ejecución de conjuntos de pruebas completos en máquinas virtuales aisladas basadas en Ubuntu en la nube AWS de Cursor.

Riesgo de seguridad: Esto introduce la ejecución remota de código en el modelo de amenazas. El aislamiento de los inquilinos de la nube y la seguridad de las máquinas virtuales son fundamentales porque el código propietario se traslada de la máquina local a los entornos de nube gestionados por Cursor.

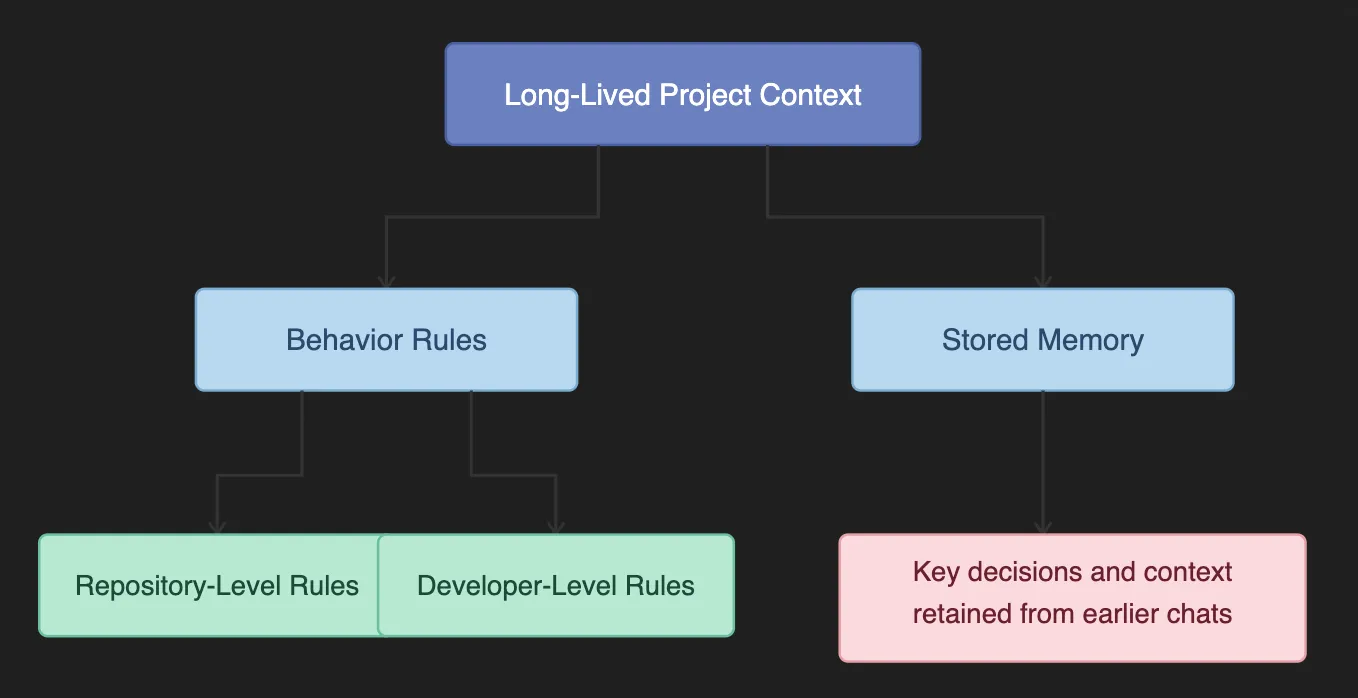

6. Comportamiento persistente

El cursor recuerda las guías de estilo específicas del proyecto y las decisiones arquitectónicas anteriores. Inserta instrucciones de archivos.cursorrules y «memorias» en el contexto de cada solicitud.

Riesgo de seguridad: Un archivo.cursorrules comprometido en un repositorio compartido podría inyectar sesgos persistentes e invisibles en la IA. Por ejemplo, los atacantes podrían obligar a la IA a utilizar de forma sistemática una biblioteca malintencionada para cifrar los IDE del equipo.

7. Inteligencia de base de código

El cursor puede «entender» y buscar en todo tu proyecto en función del significado semántico, no solo de las palabras clave. Utiliza la sincronización de Merkle Tree para asignar el código a las incrustaciones almacenadas en una base de datos vectorial remota (Turbopuffer).

Riesgo de seguridad: La lógica o los secretos confidenciales (como los archivos.env) podrían vectorizarse involuntariamente si no se excluyen con .cursorignore. Esto expone la información crítica al almacenamiento remoto.

Ahora que comprende las capacidades y la superficie de ataque de Cursor, el siguiente paso es examinar a dónde van sus datos, cómo se procesan y la infraestructura de varios niveles que Cursor utiliza para mantener su código seguro.

¿Cómo maneja Cursor tu código?

Cursor se integra perfectamente con su IDE, lo que lleva la automatización impulsada por la IA a su flujo de trabajo de desarrollo. Si bien esto permite la velocidad y la flexibilidad, muchos desarrolladores tratan su IDE como una caja negra.

Si es un CISO, ingeniero de seguridad o desarrollador sénior de IA, surge una pregunta clave:

«¿A dónde va exactamente mi código?»

Cursor aborda este problema mediante una arquitectura de tres niveles que crea una cadena de custodia clara: desde su máquina local, pasando por la orquestación en la nube de Cursor, hasta la inferencia de IA, y viceversa:

- Nivel 1: Cliente (máquina local)

- Nivel 2: Backend de cursores (puerta de enlace)

- Nivel 3: subprocesadores LLM de terceros

.webp)

Nivel 1: Cliente (su máquina local)

El cliente Cursor, una bifurcación de VS Code, mantiene sus datos más confidenciales anclados localmente y realiza todo el preprocesamiento crítico antes de que algo salga de su entorno. Indexa el código, crea incrustaciones locales, mantiene un árbol Merkle de valores hash de archivos y realiza búsquedas semánticas para seleccionar solo los fragmentos relevantes para enviarlos a la nube. Cursor también respeta las reglas .cursorignore e .gitignore, y filtra los archivos confidenciales, los secretos o la información de identificación personal.

Desde el punto de vista de la seguridad, esto garantiza la minimización de los datos, ya que solo un subconjunto reducido de código sale de la máquina y el filtrado previo a la transmisión, lo que convierte al cliente en el límite más fuerte para proteger el código fuente.

Nivel 2: Backend de cursores (puerta de enlace)

El backend de Cursor actúa como una capa de orquestación segura, ya que reúne las instrucciones de IA sin almacenar el código fuente. Alojado principalmente en AWS, este «Cursor Gateway» combina las consultas de los usuarios con los fragmentos seleccionados en el cliente y las instrucciones persistentes del proyecto (como .cursorrules). Se aplica ingeniería rápida, la lógica de enrutamiento y los controles de seguridad, e incluso las claves de API proporcionadas por los usuarios se utilizan para la gobernanza.

En el modo de privacidad, todo el código se procesa en la memoria sin ningún registro de retención y no se almacena a largo plazo. La puerta de enlace representa el último límite controlado por Cursor antes de que los datos lleguen a proveedores de LLM externos.

Nivel 3: subprocesadores LLM de terceros

La inferencia se produce a través de proveedores de LLM de terceros, como OpenAI, Anthropic o Google. Estos modelos reciben el mensaje final ensamblado, lo procesan y transmiten el resultado al cliente a través del backend.

Para los clientes empresariales, los acuerdos de retención cero de datos (ZDR) garantizan que el código no se almacene más allá del período de inferencia, que no se utilicen instrucciones para la capacitación y que no se produzca una retención secundaria. La selección de los proveedores que cumplan las normas y el cumplimiento de las garantías contractuales son fundamentales para mantener la seguridad y el cumplimiento de las normas empresariales.

.webp)

¿Cómo maneja el cursor los diferentes tipos de datos?

El cursor interactúa con varios tipos de datos, cada uno de los cuales fluye a través de diferentes niveles y conlleva consideraciones de seguridad únicas. La siguiente tabla resume los tipos de datos clave, sus niveles principales, los ejemplos y las notas de seguridad.

¿Cuáles son los riesgos de seguridad de Cursor?

Las capacidades de inteligencia artificial de Cursor brindan una potente automatización, pero también presentan nuevos desafíos de seguridad. A continuación, eche un vistazo a los siete principales riesgos de seguridad de Cursor:

1. Ejecución inmediata maliciosa

Los atacantes pueden crear instrucciones diseñadas para engañar a la IA de Cursor para que ejecute comandos no deseados o modifique archivos de proyectos críticos. Dado que estas acciones pueden ejecutarse directamente en tu terminal o sistema de archivos, su explotación puede provocar la corrupción del código o incluso comprometer totalmente el entorno.

2. Contaminación del contexto entre proyectos

Cursor utiliza el contexto del proyecto y de la conversación para mejorar las sugerencias de la IA. Si este contexto está contaminado, por ejemplo, con fragmentos o instrucciones engañosos, puede trasladarse a otros proyectos. Esto puede introducir errores lógicos, vulnerabilidades de seguridad o la filtración accidental de información confidencial.

3. Archivos de reglas comprometidos

Los archivos de reglas rigen el comportamiento de los agentes de Cursor, incluidos los desencadenadores y los parámetros de ejecución. Un archivo de reglas alterado puede ocultar instrucciones malintencionadas y conceder a los atacantes un acceso persistente o la posibilidad de ejecutar código arbitrario cada vez que se carga el archivo.

4. El agente se ejecuta automáticamente sin supervisión

El modo de ejecución automática permite a los agentes ejecutar comandos sin la aprobación humana. Si bien es práctico, elimina los pasos críticos de revisión, lo que aumenta el riesgo de que los scripts no seguros se ejecuten desapercibidos y puedan introducir malware o comprometer el entorno de desarrollo.

5. Exposición de credenciales

Los resultados generados por la IA pueden incluir accidentalmente claves de API, tokens de autenticación o credenciales de inicio de sesión. Si estos secretos quedan expuestos en los registros, el control de versiones o los entornos compartidos, los atacantes podrían obtener acceso directo a los sistemas y datos confidenciales.

6. Ejecución de dependencias malintencionadas

Cursor puede instalar paquetes automáticamente como parte de los flujos de trabajo de IA. Los paquetes maliciosos o comprometidos de los registros públicos pueden contener scripts confusos que filtran datos, implementan malware o ejecutan comandos no autorizados durante la instalación.

7. Colisiones de espacios de nombres y suplantación de agentes

Cuando varios agentes comparten el mismo espacio de nombres, un actor malintencionado puede crear un agente falsificado que suplanta a uno de confianza. Esto puede secuestrar el sistema de agentes de Cursor, lo que permite a los atacantes ejecutar comandos no autorizados o filtrar información confidencial.

.webp)

Exploits del mundo real: Curxecute y McPoison

En 2025, los investigadores identificaron dos vulnerabilidades de alto perfil en la forma en que Cursor gestiona los servidores MCP, lo que puso de relieve los riesgos reales de la IA de agencia en los IDE.

CurxCute

El primero, CurXecute (CVE-2025-54135), demostró los peligros de la inyección inmediata indirecta. Los investigadores descubrieron que Cursor permitía crear ciertos archivos dentro de un espacio de trabajo sin necesidad de la aprobación del usuario.

Esto significaba que un atacante podía crear un mensaje malintencionado, como una notificación de Slack supervisada por el agente de IA, que engañaría a la IA para que escribiera un archivo .cursor/mcp.json dañino. Como las versiones anteriores de Cursor no solicitaban confirmación al crear nuevos archivos, este defecto podía aprovecharse para ejecutar código a distancia (RCE) simplemente enviando un mensaje de texto.

McPoison

La segunda vulnerabilidad, McPoison (CVE-2025-54136), aprovechó una falla de validación de confianza en Manejo del servidor MCP por parte del cursor aprobaciones. En versiones anteriores, una vez que se aprobaba un servidor, Cursor confiaba en ese servidor indefinidamente. Un atacante podía enviar inicialmente una configuración benigna a un repositorio compartido y esperar a que se aprobara.

Más adelante, podrían reemplazar silenciosamente el comando por una carga maliciosa, como un shell inverso. Como el nombre del servidor permanecía inalterado, Cursor no volvía a solicitar la aprobación del usuario, lo que permitía la ejecución sigilosa de comandos malintencionados.

En conjunto, estas vulnerabilidades subrayan la importancia de los flujos de trabajo de aprobación estrictos, la supervisión de los archivos de configuración y el mantenimiento de las versiones actualizadas de los IDE habilitados para IA.

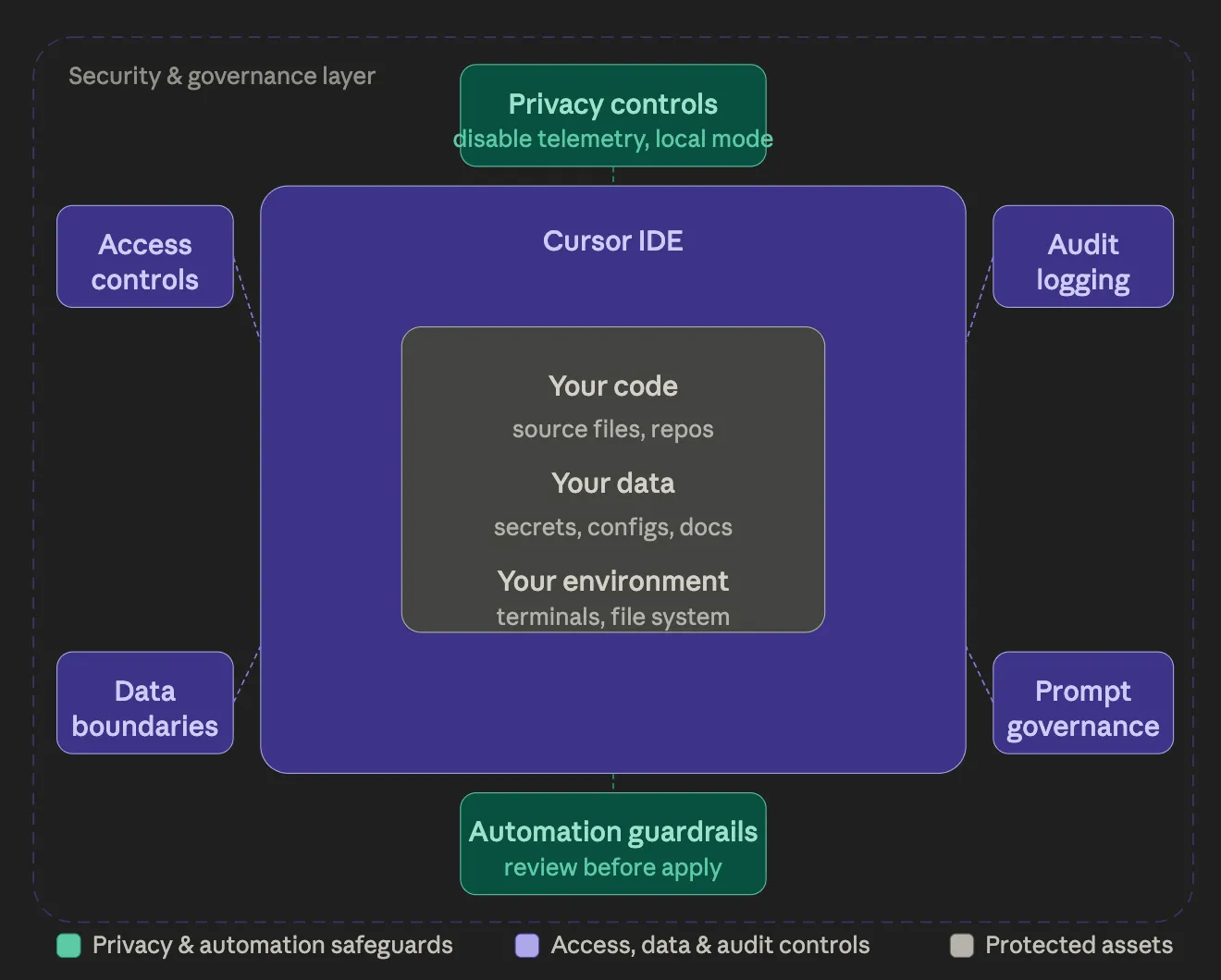

Mejores prácticas con cursores

Proteger el cursor significa superponer los controles para evitar que los errores, las sugerencias engañosas o el comportamiento inesperado se conviertan en incidentes. Cada capa añade supervisión humana, limita las acciones autónomas y mejora la visibilidad. Aquí, eche un vistazo:

Nivel 1: Fortalecimiento inmediato del IDE (desarrolladores individuales)

Estos son los pasos esenciales que todo desarrollador debe implementar desde el primer día:

- Desactiva Terminal Auto-Run. La ejecución automática puede resultar práctica, pero evita la pausa en la que se pueden detectar errores. Todos los comandos sugeridos por la IA deberían requerir una revisión explícita antes de ejecutarse para evitar acciones destructivas accidentales.

- Habilite el modo de privacidad. Esto garantiza que el código no se conserve fuera de la sesión local. El modo de privacidad mantiene la experiencia del usuario al tiempo que reduce significativamente la exposición del código confidencial.

- Proteja los archivos de puntos y las credenciales. Muchas filtraciones del mundo real provienen de archivos.env, claves SSH y otros archivos de configuración almacenados en la máquina local. Al habilitar la protección de archivos de puntos, se garantiza que los agentes de IA nunca accedan a estos archivos.

Si los equipos implementan estos tres pasos fundamentales, mitigan los riesgos individuales más obvios.

Nivel 2: Barandas a nivel de proyecto (valores predeterminados del equipo)

Una vez que varios desarrolladores de un equipo utilizan Cursor, la coherencia y las prácticas aplicables se vuelven esenciales:

- Utilice siempre un archivo.cursorignore. Todos los repositorios deben excluir explícitamente los archivos confidenciales, la PII o los datos del entorno de la indexación, las incrustaciones y las indicaciones de la IA. Esto evita que el material confidencial salga de la máquina local.

- Trate .cursorrules como código de producción. Los archivos de reglas definen el comportamiento persistente de la IA e influyen en las decisiones del proyecto. Exija una segunda opinión antes de fusionar cualquier cambio y considérelo más como una política que como una preferencia personal.

- Implemente una configuración coherente del proyecto. La estandarización evita las filtraciones accidentales, garantiza un comportamiento reproducible de la IA y reduce el riesgo de contaminación lógica o del contexto en todos los proyectos.

- Usa el control de versiones con diligencia. Realiza un seguimiento de todos los cambios en Git o en un sistema similar para que las ediciones sugeridas por la IA puedan revertirse si es necesario.

Nivel 3: Controles empresariales (gobierno centralizado con una puerta de enlace de inteligencia artificial)

A cierta escala, no basta con confiar en «configure esto correctamente». Controles centralizados, como un Puerta de enlace de IA son necesarios para la visibilidad, el enrutamiento y las barandillas aplicables.

Pon algo en el medio

Una vez que Cursor se usa en todos los equipos, necesitas un lugar central para ver y controlar lo que hacen los agentes. El patrón más simple consiste en dirigir el tráfico de modelos y herramientas a través de una capa de puerta de enlace, en lugar de permitir que cada portátil se comunique directamente con los proveedores y Servidores MCP.

Por ejemplo, Puerta de enlace de IA TrueFoundry está diseñado como un proxy entre las aplicaciones y los proveedores de LLM, y también puede ubicarse entre las aplicaciones y los servidores MCP, de modo que los equipos pueden estandarizar el enrutamiento y agregar la gobernanza en un solo lugar. En la práctica, esto brinda a los equipos de seguridad un punto de control limpio para aspectos como la observabilidad de las solicitudes, la aplicación de políticas y las barreras que validan o transforman las solicitudes y respuestas.

Esto es importante porque la mayoría de las herramientas de AppSec (SAST/DAST/SCA) solo ven el código una vez escrito. Una puerta de enlace le permite ver el uso de la IA mientras está en marcha, que es donde suelen empezar la inyección rápida, el uso inseguro de las herramientas y las infracciones de las políticas.

Límite importante: Este punto de control controla el tráfico de modelos y herramientas, pero no impide automáticamente las acciones locales (como ejecutar comandos de terminal) a menos que el entorno y la configuración impongan esas restricciones por separado.

Estandarice las políticas de identidad y datos: Si Cursor se usa ampliamente, debería estar cubierto por las mismas reglas que otras herramientas de desarrollo. El inicio de sesión único, la configuración coherente y las políticas de cero retención de datos reducen las conjeturas y facilitan las auditorías.

En esta etapa, Cursor deja de ser «solo un editor» y pasa a formar parte de su infraestructura de desarrollo.

Conclusión

El cursor se siente poderoso porque elimina la fricción, y ese es su propósito. Pero la fricción existe por una razón, especialmente cuando se trata de ejecutar comandos o administrar dependencias. Los equipos que utilizan Cursor de forma segura no luchan contra esta fricción ni confían ciegamente en la IA. Dejan que la IA se encargue de pensar y redactar, mientras que los humanos siguen siendo responsables de la aprobación y la rendición de cuentas.

El modelo mental es simple y efectivo: la IA puede sugerir, pero los humanos deciden.

A medida que las herramientas de desarrollo se vuelvan más agenciales, el éxito no pertenecerá a quienes se muevan más rápido a cualquier precio. Pertenecerá a los equipos que actúen con rapidez e intención, equilibrando la velocidad con la supervisión deliberada y la seguridad.

Proteja y controle sus flujos de trabajo de IA con TrueFoundry AI Gateway. Reserva una demostración.

Preguntas frecuentes

¿Es Cursor un riesgo para la seguridad?

Cursor presenta riesgos de seguridad como la inyección inmediata, la ejecución automática de los agentes y la exposición a través de integraciones de terceros. Los riesgos son reales pero manejables cuando se aplican los controles, la configuración de privacidad y la supervisión humana adecuados. Los equipos empresariales deben tratar a Cursor como parte de su infraestructura de seguridad.

¿Cursor es seguro para la privacidad?

El cursor puede proteger la privacidad si el modo de privacidad está habilitado. A cierta escala, no basta con confiar en «configure esto correctamente». Controles centralizados, como Puerta de enlace de IA son necesarios para la visibilidad, el enrutamiento y las barreras de protección aplicables. Los archivos confidenciales están protegidos y se utilizan reglas como.cursorignore. Sin estas medidas, los fragmentos de código podrían salir del entorno local, lo que podría exponer información confidencial o confidencial.

¿Cursor rastrea la IP?

El cursor puede registrar una telemetría mínima, que podría incluir identificadores de red como direcciones IP para diagnósticos o análisis. Las políticas de privacidad empresarial y el modo de privacidad ayudan a limitar la exposición, pero los usuarios deben suponer que algunos metadatos a nivel de red pueden estar visibles para los proveedores de servicios

¿Es seguro el modo de privacidad del cursor?

El modo de privacidad es eficaz para reducir la retención del código fuera de la sesión local y minimizar la exposición a los servidores de IA. Si bien refuerza la privacidad, su combinación con la protección de archivos por puntos, .cursorignore y las integraciones controladas garantiza una seguridad integral para los proyectos delicados.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)