Comprensión de los complementos de ChatGPT

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

ChatGPT es un poderoso modelo de lenguaje que puede entender y responder a las entradas de los usuarios. Tiene muchas funciones útiles integradas, pero a veces los usuarios necesitan funciones adicionales que no están disponibles de fábrica. Ahí es donde entran en juego los complementos.

Los plugins son complementos que amplían las capacidades de ChatGPT. Permiten a los usuarios acceder a información actualizada, ejecutar cálculos o interactuar con servicios de terceros en respuesta a la solicitud de un usuario. Por ejemplo, un complemento podría añadir la capacidad de buscar información en un sitio web específico o integrarse con el software CRM de un usuario.

O un complemento de calendario para ChatGPT podría funcionar al permitir a los usuarios programar eventos y recordatorios directamente en la interfaz de chat. Por ejemplo, un usuario puede escribir «programar una reunión con John el viernes a las 2 p. m.» y ChatGPT puede reconocer la intención y comunicarse con el complemento de calendario para crear el evento.

0:00 /1×

El complemento Instacart ChatGPT en acción

El complemento Instacart para ChatGPT es un complemento existente que permite a los usuarios añadir cómodamente ingredientes de recetas a su carrito de Instacart sin salir de la interfaz de chat. Por ejemplo, si un usuario pregunta «¿Qué ingredientes necesito para hacer lasaña?» , ChatGPT puede proporcionar una lista de los ingredientes necesarios para la lasaña y ofrecer añadirlos al carrito de Instacart del usuario. Luego, el usuario puede confirmar el pedido con un simple clic y el complemento Instacart añadirá automáticamente todos los ingredientes necesarios a su carrito.

¿Cómo funcionan los plugins?

Para crear un complemento, los desarrolladores pueden hacer que una API esté disponible a través de su sitio web y crear un archivo de manifiesto que describa la API de forma estandarizada. A continuación, ChatGPT puede leer estos archivos y permitir que los modelos de IA se comuniquen con la API especificada por el desarrollador. Un plugin típico incluye:

- API,

- un esquema de formato JSON o YAML de OpenAPI para la API,

- archivo de manifiesto del complemento en formato JSON.

ChatGPT usará el archivo de manifiesto y el esquema de OpenAPI para entender qué hace el complemento y cómo interactuar con él. Luego, cuando el usuario pregunte a ChatGPT, determinará si necesita interactuar con algún complemento activo para completar la solicitud y llamará a los puntos finales pertinentes para atender las solicitudes de los usuarios. Al igual que ocurre con las solicitudes en otros modelos de lenguaje, querrás probar varias indicaciones y descripciones en el manifiesto y el esquema de la API para ver qué es lo que funciona mejor.

OpenAI proporciona código para un complemento de ejemplo que puede buscar en una base de datos vectorial como Pinecone y devolver documentos relevantes. Al responder a las instrucciones de los usuarios, ChatGPT puede usar este complemento para agregar sus conocimientos consultando los documentos relevantes. Por ejemplo, dentro de una organización, es posible que ChatGPT necesite consultar documentos internos de la empresa para responder a preguntas relacionadas con la empresa.

Para este complemento de recuperación de documentos, el archivo de manifiesto denominado ai-plugin.json tendrá un aspecto parecido a esto:

Observe cómo hay campos como descripción_para_modelo y descripción_para_humano. El descripción_para_modelo attribute te da la libertad de instruir al modelo sobre cómo usar tu complemento en general. En general, el modelo de lenguaje detrás de ChatGPT es altamente capaz de entender el lenguaje natural y seguir instrucciones. Por lo tanto, este es un buen lugar para incluir instrucciones generales sobre lo que hace tu complemento y cómo el modelo debe usarlo correctamente.

Implementación de un complemento

Implementaremos el complemento de recuperación anterior en TrueFoundry y lo conectaremos con ChatGPT. El complemento puede buscar en bases de datos vectoriales como Pinecone y devolver documentos relevantes.

💡

Ten en cuenta que necesitarás acceso al complemento ChatGPT para crear un complemento. Puedes solicitar el acceso a uno aquí.

Clona el repositorio de Github

Para implementar esta aplicación, necesitará clonar este repositorio. Esto es obligatorio, ya que eventualmente tendremos que actualizar el esquema de OpenAPI y el manifiesto con las siguientes URL de la aplicación de complementos implementada.

Configuración de la base de datos vectorial: Pinecone

Piña es una base de datos vectorial gestionada creada para acelerar, escalar y enviar antes a la producción. Para usar Pinecone como su proveedor de bases de datos vectoriales, primero obtenga una clave de API de registrarse para obtener una cuenta. Puedes acceder a tu clave de API desde la sección «Claves de API» de la barra lateral de tu panel de control. Pinecone también admite la búsqueda híbrida y, en el momento de escribir este artículo, es el único almacén de datos que admite los vectores dispersos de SPLADE de forma nativa.

Se puede encontrar un tutorial completo de Jupyter Notebook para conocer la versión Pinecone del complemento de recuperación aquí. También hay un tutorial en vídeo aquí.

La aplicación creará un índice de Pinecone automáticamente cuando la ejecutes por primera vez. Simplemente elija un nombre para su índice y configúrelo como variable de entorno mientras implementa la aplicación.

Implementación de la aplicación en TrueFoundry

Ahora vamos a implementar la aplicación en TrueFoundry.

- Crea una cuenta gratuita con True Foundry y cree un nuevo espacio de trabajo con un nombre único.

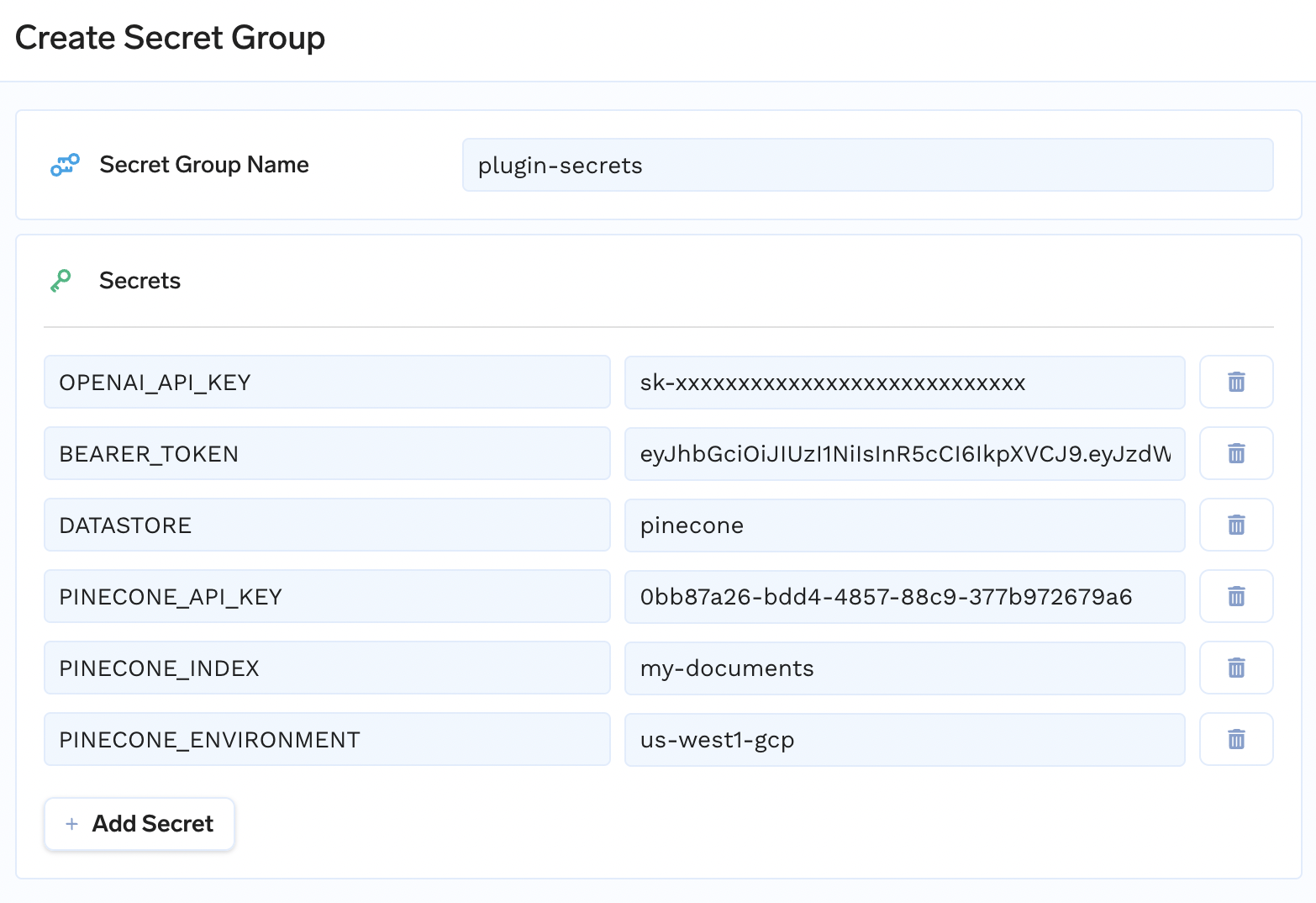

2. Al utilizar la base de datos vectorial Pinecone, necesitará las siguientes variables de entorno. El token del portador se utilizará para autenticar las solicitudes en los puntos finales.

NameRequiredDescriptionDatastoreYesNombre de almacén de datos, configúralo en PineconeBearer_TokenYesTu token secreto para autenticar las solicitudes a la APIOpenAI_API_KEYYesTu clave de API de OpenAI para generar incrustaciones con el modelo text-embedding-ada-002 Pinecone_api_keyYesTu clave de API de Pinecone, que se encuentra en la consola de PineconePinecone_EnvironmentYesYour Pinecone_EnvironmentYesTu clave de API de Pinecone entorno de cono, que se encuentra en la consola de Pinecone, por ejemplo, us-west1-gcp, us-east-1-aws, etc.pinecone_indexyesEl nombre de índice de Pinecone que ha elegido. Nota: El nombre del índice debe constar de caracteres alfanuméricos en minúscula o «-»

Ir a TrueFoundry consola de secretos. Crea un nuevo grupo secreto y cree secretos para usar variables de entorno.

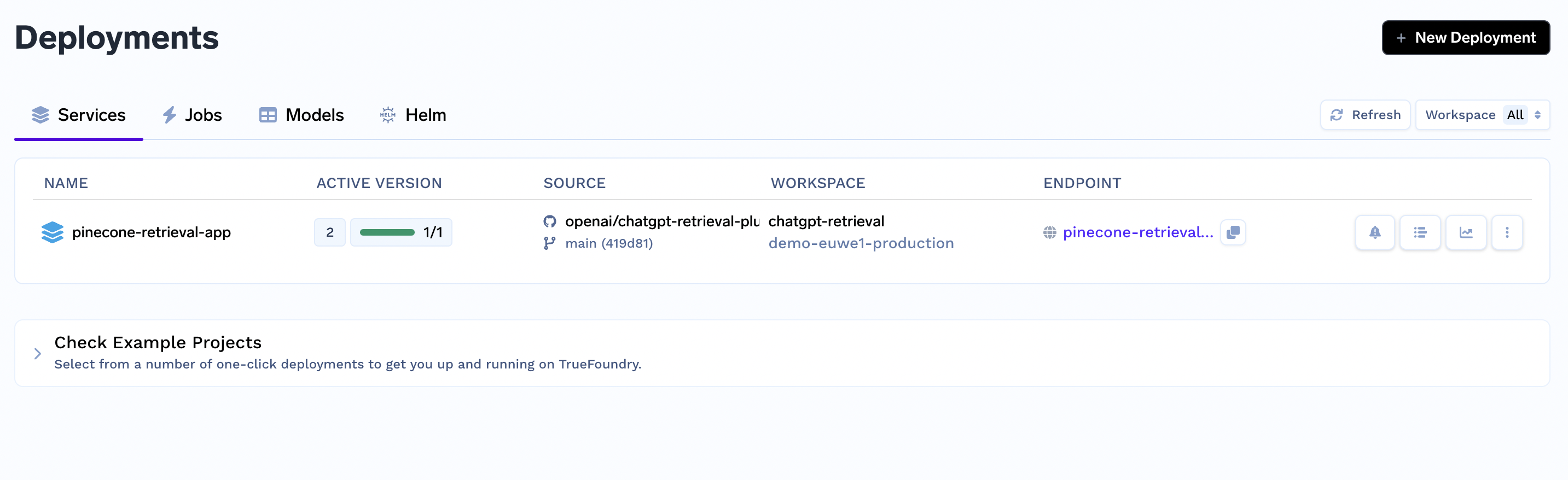

3. Ve al consola de despliegue. Crea un nuevo servicio en tu espacio de trabajo.

4. En el formulario de creación de servicios, establece la fuente en la URL del repositorio que acabas de clonar y la compilación en DockerFile.

5. En el formulario, defina el puerto en 8080 y elija un punto final adecuado para su servicio:

6. Agregue las variables de entorno y configúrelas en los secretos que acaba de crear.

7. Implemente y su complemento, la aplicación web y el punto final deberían aparecer en el pestaña de despliegues. Usaremos el punto final generado aquí para registrar el complemento en OpenAI y usarlo con ChatGPT:

8. Ve a tu repositorio de Github y actualiza la URL de la aplicación tanto en el esquema de OpenAPI como en el manifiesto que se encuentran en el . /conocido carpeta. Una vez actualizada, puedes editar la implementación en TrueFoundry hasta la última confirmación y volver a implementarla desde la pestaña de despliegues.

Probando el complemento

Una vez que hayas creado la API, el archivo de manifiesto y la especificación de OpenAPI para tu API, ya estás listo para conectar el complemento a través de la interfaz de usuario de ChatGPT.

Para el Interfaz de usuario de ChatGPT, primero selecciona «Desarrolla tu propio complemento» para configurarlo y luego «Instalar un complemento no verificado» para instalarlo tú mismo.

En primer lugar, tendrás que proporcionar el punto final a tu servicio de API. Puedes obtenerlo en TrueFoudry pestaña de despliegues. En segundo lugar, tendrás que proporcionar el token de portador que se utiliza para autenticar las solicitudes de API. Una vez hecho esto, el plugin debería estar listo para usarse con ChatGPT (¡solo para ti, ya que no está verificado!).

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)