Revisión de Amazon SageMaker: características, precios, ventajas y desventajas (+ mejor alternativa)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Amazon SageMaker se ha convertido de hecho en el sistema operativo predeterminado para el aprendizaje automático dentro del perímetro de AWS. Lanzado en 2017, prometía industrializar lo que entonces era un ecosistema fragmentado de scripts personalizados y aprovisionamiento manual de servidores. Al resumir la configuración subyacente de EC2 y la organización de contenedores, permitió a las organizaciones estandarizar sus procesos de aprendizaje automático.

Sin embargo, estamos en 2026 y la propuesta de valor de un servicio gestionado de código cerrado y una sola nube está siendo objeto de escrutinio. Las quejas que recibimos de los equipos de ingeniería son consistentes: modelos de precios opacos que provocan sorpresas a fin de mes, curvas de aprendizaje pronunciadas para quienes no son nativos de AWS y una arquitectura «amurallada» que penaliza las estrategias de nube múltiple.

Esta revisión técnica considera SageMaker no como un folleto de marketing, sino como una pieza de infraestructura. Examinamos la economía de la unidad, la fricción operativa y las desventajas arquitectónicas basándonos en los datos de G2, Gartner Peer Insights y en la experiencia operativa directa. También evaluaremos si los planos de control desacoplados, como True Foundry ofrecen un camino viable para evitar la dependencia de un solo proveedor.

¿Qué es Amazon SageMaker?

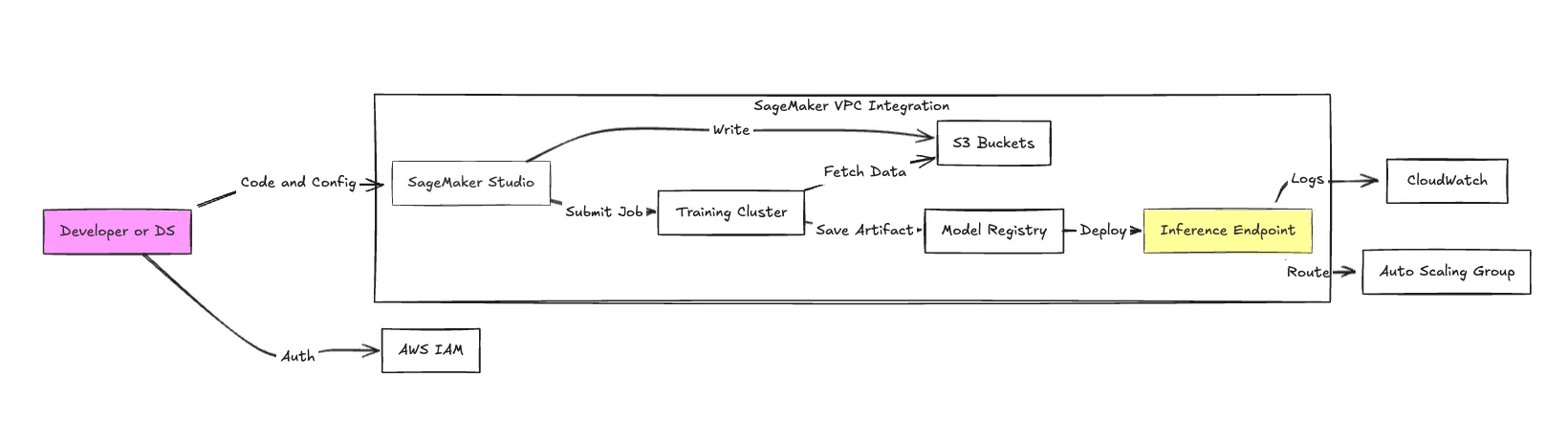

En esencia, Amazon SageMaker es un paquete de servicios gestionados que abarca la informática (EC2), el almacenamiento (S3/EBS) y la orquestación de contenedores (EKS/ECS) de AWS. Proporciona un entorno de desarrollo (IDE) integrado de extremo a extremo y un plano de control para el ciclo de vida del aprendizaje automático.

Las actualizaciones recientes, como el «Unified Studio» y la integración con Data Lakehouses, intentan cerrar la brecha entre la ingeniería de datos y las operaciones de aprendizaje automático. Sin embargo, para el ingeniero de plataformas, SageMaker es básicamente un conjunto de API patentadas que se utilizan para proporcionar procesamiento efímero para el entrenamiento y procesamiento persistente para la inferencia.

Público objetivo:

- Equipos de ciencia de datos empresariales: Organizaciones que requieren un cumplimiento estricto de IAM y un aislamiento de VPC.

- Ingenieros de ML: Equipos que necesitan una infraestructura gestionada sin gestionar directamente los manifiestos de Kubernetes.

Alcance operativo:

- Desarrollo de modelos personalizados: Experimentación basada en cuadernos (JupyterLab).

- Orquestación del entrenamiento: Capacitación distribuida en clústeres de alto rendimiento (instancias P4/P5).

- Servicio de inferencia: Implementación de terminales para procesamiento en tiempo real (REST) o por lotes.

- Gobernanza de MLOps: Registro de modelos, seguimiento de linajes y detección de derivas.

Características principales de Amazon SageMaker

SageMaker es un monolito. Si bien ofrece docenas de subservicios, los siguientes componentes constituyen el conjunto operativo principal.

Entornos de desarrollo y SageMaker Studio

Studio es un IDE basado en la web basado en JupyterLab. Si bien centraliza el acceso, introduce latencia. La puesta en marcha de una aplicación «KernelGateway» puede tardar varios minutos. Crea una capa de abstracción sobre la instancia EC2 subyacente, lo que simplifica el acceso pero complica la utilización de los recursos del sistema local para la depuración.

Entrenamiento de modelos e HyperPod

SageMaker permite el entrenamiento distribuido entre clústeres. HyperPod de SageMaker es la característica más destacada aquí, diseñada para resistir las fallas de hardware durante los trabajos de capacitación de LLM de larga duración. Detecta y reemplaza automáticamente las instancias defectuosas, algo fundamental cuando se alquilan costosos clústeres de GPU, en los que un fallo de un solo nodo puede hacer perder días de tiempo de procesamiento.

Implementación e inferencia de modelos

SageMaker ofrece inferencia en tiempo real, inferencia sin servidor e inferencia asincrónica.

- En tiempo real: Puntos finales persistentes (siempre en ejecución). Son buenos para una latencia baja (menos de 100 ms) y son malos para el costo si disminuye la utilización.

- Pruebas en la sombra: Permite dirigir un porcentaje del tráfico a una nueva versión del modelo para validar el rendimiento sin afectar a los usuarios.

- Sin servidor: Es útil para el tráfico intermitente, pero sufre «arranques en frío» (a menudo de 5 a 10 segundos), lo que lo hace inutilizable para aplicaciones sensibles a la latencia.

Piloto automático de SageMaker

Una solución de AutoML que recorre algoritmos en iteración para encontrar el mejor modelo. Si bien es útil para la creación rápida de prototipos con datos tabulares, los ingenieros experimentados suelen encontrar que el código generado es difícil de refactorizar u optimizar para tener en cuenta las restricciones de inferencia de producción.

Herramientas mLOps (canalizaciones, registro, monitoreo)

Esta es la capa de «pegamento». SageMaker Pipelines es un servicio de CI/CD específico para el aprendizaje automático. Se integra perfectamente con el Model Registry (control de versiones) y con el Model Monitor (detección de desviaciones). La contrapartida es la fuerte combinación de proveedores: la migración de un SageMaker Pipeline a Flujo de aire o Flujos de trabajo de Argo normalmente requiere una reescritura completa.

Preparación de datos (Data Wrangler, Feature Store)

Data Wrangler proporciona una interfaz de usuario para la limpieza de datos y genera código python. La Feature Store actúa como un repositorio centralizado de funciones. Tenga en cuenta que el Feature Store cuenta con el respaldo de Glue y DynamoDB, lo que significa que las lecturas de alto rendimiento pueden generar importantes costos secundarios para la base de datos.

Precios de Amazon SageMaker

El precio es el punto de fricción más común. SageMaker se basa en un modelo basado en el consumo, con un margen sobre los precios sin procesar de EC2. No hay comisiones iniciales, pero la previsibilidad de los costes es baja debido a la gran cantidad de vectores facturables.

Modelo de precios

Se le facturará por:

- Calcular: Cargos por segundo para las instancias de entrenamiento e inferencia.

- Almacenamiento: Cargos de 1 GB al mes por los volúmenes de EBS adjuntos a las instancias (que con frecuencia se pasan por alto).

- Procesamiento de datos: GB cobra por la entrada y salida de datos del servicio.

- Metadatos: Costos asociados con el almacenamiento de métricas y registros en CloudWatch.

Componentes de costos y ejemplos reales

1. Instancias de portátiles:

Una instancia de portátil mediana estándar ml.t3. cuesta aproximadamente **0,05 dólares/hora**. Sin embargo, los desarrolladores suelen dejarlas funcionando de un día para otro. Un equipo de 10 desarrolladores que deja las instancias encendidas durante un mes se traduce en unos 360$ de «desperdicio», sin incluir los costes de almacenamiento.

2. Puntos finales de inferencia (el asesino silencioso del presupuesto):

La inferencia es donde los costos se disparan. A diferencia de la formación (que finaliza), los terminales funcionan 24 horas al día, 7 días a la semana.

- Instancia: ml.g5.xlarge (NVIDIA A10G).

- Coste: ~1,40 dólares/hora (us-east-1).

- Coste mensual: ~1.008 $ por instancia.

- Redundancia: La producción requiere al menos 2 instancias para lograr una alta disponibilidad.

- Total: aproximadamente 2.016 dólares/mes por modelo.

3. Instancias puntuales y de capacitación:

Managed Spot Training puede ofrecer hasta un 90% de descuento en comparación con las tarifas bajo demanda. Sin embargo, AWS puede reemplazar (interrumpir) las instancias puntuales en cualquier momento. Si su lógica de puntos de control de entrenamiento no es sólida, perderá el progreso.

Escenario del mundo real:

Una empresa emergente de tamaño mediano que esté capacitando un LLM personalizado y que aloje 5 modelos en producción puede recibir fácilmente facturas que superen los 25 000$ al mes. Según Precios de AWS, los cargos por procesamiento de datos para funciones como Data Wrangler comienzan en 0,14 USD por nodo por hora, lo que aumenta de forma lineal con el volumen de datos.

Reseñas de Amazon SageMaker: lo que dicen los usuarios

Analizamos los comentarios de G2, Gartner Peer Insights y los foros de desarrolladores para identificar el consenso.

Calificaciones generales

- G2: 4.2/5 (Basado en la adopción empresarial).

- Capterra: 4,5/5 (se inclina hacia los talleres con gran cantidad de AWS).

Ventajas (lo que les encanta a los usuarios)

Los usuarios aprecian la naturaleza de «cumplimiento integral» de la plataforma.

- Infraestructura gestionada: «La capacidad de poner en marcha un clúster de entrenamiento distribuido sin tocar los manifiestos de Kubernetes es la razón principal por la que nos quedamos», señala un ingeniero sénior de ML de G2.

- Seguridad: La integración perfecta con las funciones de IAM y los puntos finales de la VPC satisface los estrictos requisitos de InfoSec.

- Tienda de funciones: La administración centralizada de funciones reduce la filtración de datos entre el entrenamiento y la inferencia.

Contras (quejas comunes)

El sentimiento negativo se centra en la experiencia del desarrollador (DX) y en la opacidad de la facturación.

- Choques de facturación: Un tema común en las reseñas es «recursos para zombis». Los usuarios eliminan un punto final, pero olvidan los volúmenes de EBS adjuntos o los aceleradores de inferencia elásticos, que siguen facturando indefinidamente.

- Complejidad de depuración: «Cuando un trabajo de formación falla con un 'AlgorithmError' opaco, depurar los registros de los contenedores subyacentes en CloudWatch es más difícil que depurar un contenedor local», menciona un usuario de PeerSpot.

- Bloqueo de AWS: La migración de un modelo entrenado y registrado en SageMaker a una nube diferente (por ejemplo, GCP o local) es técnicamente difícil porque los artefactos del modelo suelen estar empaquetados en formatos específicos de SageMaker.

Nota sobre «SageMaker Gateway»: A menudo hay confusión con respecto a este término. Hace referencia a la integración de Amazon API Gateway con los puntos de enlace de SageMaker para exponer los modelos como API REST públicas. Si bien es potente, introduce otro nivel de latencia y coste (API Gateway cobra por millón de solicitudes) que los desarrolladores deben gestionar.

¿Merece la pena Amazon SageMaker?

La decisión depende de la filosofía arquitectónica y la elasticidad del presupuesto de su organización.

Cuando SageMaker tiene sentido:

- Centralidad en AWS: Sus datos residen en S3, su autenticación es IAM y tiene un gasto comprometido significativo (EDP) con AWS.

- Cumplimiento: Necesita cumplir con FedRAMP, HIPAA o SOC2 de inmediato y carece de los recursos para crear una plataforma compatible con Kubernetes sin procesar.

- ML tradicional: Su enfoque principal son los flujos de trabajo de regresión, clasificación o XGBoost/Scikit-learn en los que destacan los contenedores prediseñados de SageMaker.

Cuándo considerar las alternativas:

- Enfoque GenAi/LLM: SageMaker se creó para el aprendizaje automático tradicional. Si bien es compatible con los LLM, el flujo de trabajo de los desarrolladores parece modernizado.

- Requisitos de nube múltiple: Si necesitas ejecutar inferencias en GCP (para ver la disponibilidad de TPU) o de forma local (para garantizar la soberanía de los datos), SageMaker no es un buen método.

- Control de costos: Necesita maximizar la utilización de la GPU y no puede permitirse la «prima de servicio gestionado» (normalmente entre un 20 y un 30% más que la EC2 sin procesar).

- Control de Kubernetes: Quieres despliegues estándar de Kubernetes que se puedan depurar con kubectl, en lugar de APIs propietarias.

TrueFoundry: una mejor alternativa a Amazon SageMaker

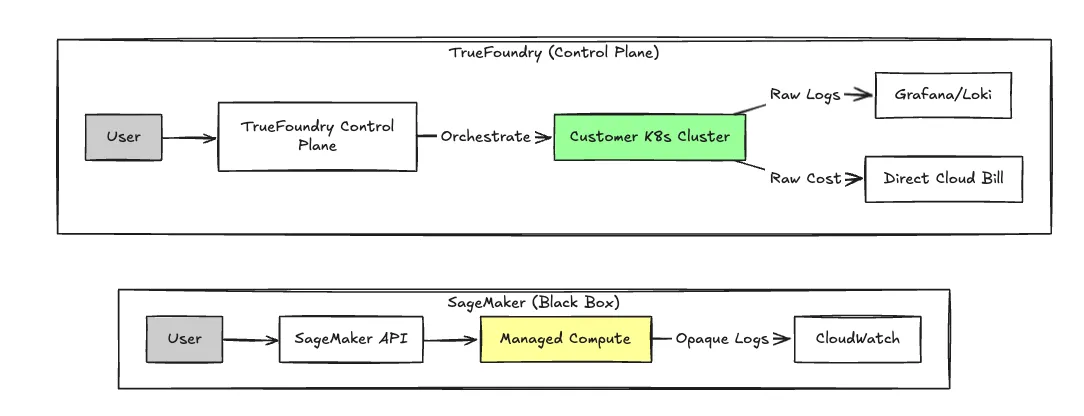

Para los equipos que consideran que SageMaker es demasiado rígido o caro, True Foundry opera en una arquitectura fundamentalmente diferente. Es un plano de control que se encuentra en la parte superior de su propia cuenta en la nube (AWS, GCP, Azure), en lugar de un servicio gestionado en forma de caja negra.

Este enfoque de «traiga su propia nube» (BYOC) permite a TrueFoundry organizar el procesamiento dentro de su VPC. Obtienes la experiencia de desarrollador de una plataforma gestionada como Heroku, pero la economía unitaria subyacente de las instancias EC2/GKE/AKS sin procesar.

Comparación: TrueFoundry frente a Amazon SageMaker

Comparación de arquitecturas

La diferencia fundamental es dónde se lleva a cabo la computación. En SageMaker, usted alquila las capacidades informáticas de la plataforma. En TrueFoundry, la plataforma organiza sus funciones informáticas.

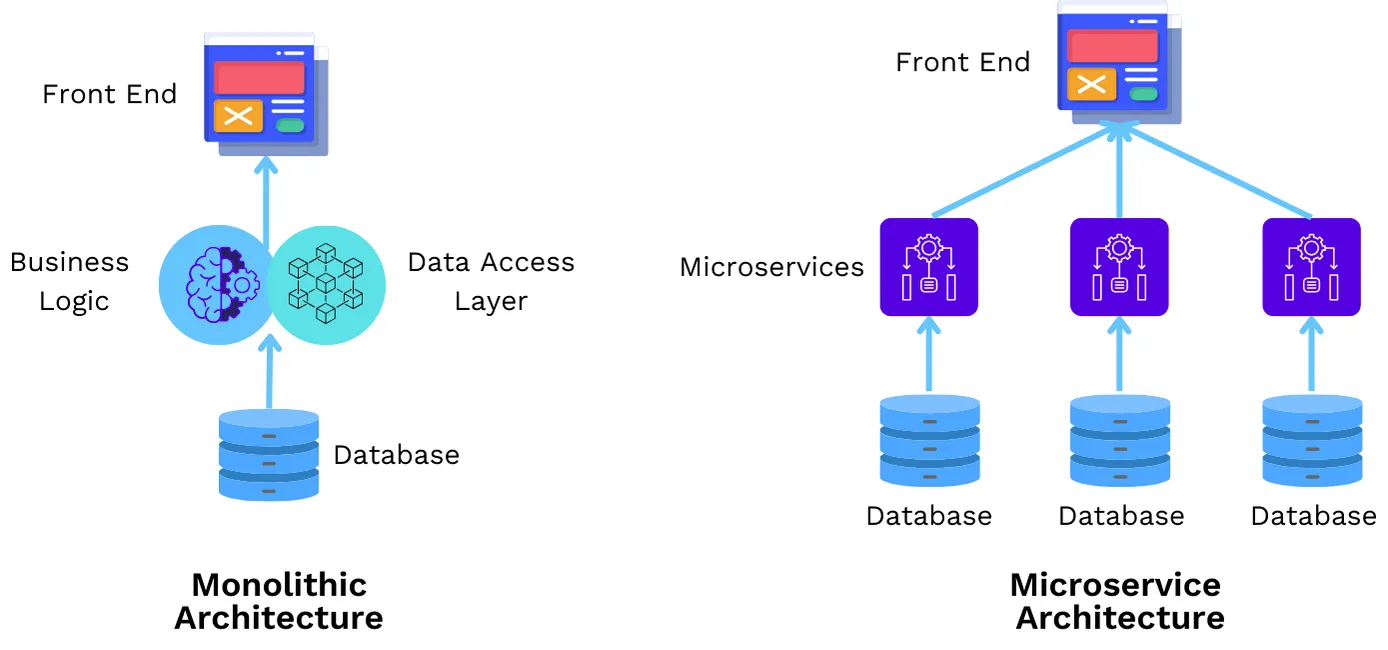

Cómo Whatfix logró ciclos de lanzamiento 6 veces más rápidos y flexibilidad de implementación global

Whatfix, que prestaba servicios a más de 80 empresas de la lista Fortune 500, necesitaba modernizar su ciclo de vida de lanzamiento en diversos entornos locales y en la nube. Al adoptar TrueFoundry para administrar sus microservicios basados en Kubernetes, eliminaron la fricción de las implementaciones monolíticas. Esta transición redujo el tiempo de implementación local de tres meses a solo dos semanas.

Whatfix logró un ciclo de lanzamiento 6 veces más corto, lo que permitió a un pequeño equipo de DevOps apoyar a más de 150 desarrolladores con un único panel de control para la administración de múltiples clústeres.

Lea la historia completa: Caso práctico de migración e implementación local de Whatfix Kubernetes

Veredicto final

Amazon SageMaker es un conjunto de herramientas sólido de nivel empresarial. Si su organización está vinculada legal o técnicamente a AWS y cuenta con un equipo de DevOps dedicado a gestionar las complejidades de facturación y configuración, se trata de una opción estándar y segura.

Sin embargo, para los equipos que crean aplicaciones GenAI modernas en las que la escasez de GPU y la economía de las unidades representan riesgos existenciales, el «impuesto AWS» es difícil de justificar.

TrueFoundry ofrece la evolución lógica: la usabilidad de un servicio gestionado con la libertad económica y arquitectónica de ser propietario de su infraestructura. Si necesitas implementar un LLM en AWS y GCP para encontrar las GPU más baratas, o si simplemente quieres un panel que hable el lenguaje de los desarrolladores y no de los contables, TrueFoundry es la mejor opción arquitectónica.

Reserve una demostración con TrueFoundry para ver cómo puede reducir los costos de inferencia en un 40% y, al mismo tiempo, recuperar el control de su infraestructura.

Preguntas frecuentes

¿Qué convierte a TrueFoundry en una alternativa ideal a Amazon SageMaker?

TrueFoundry es la alternativa ideal a AWS SageMaker porque proporciona un control total de la infraestructura sin los precios de caja negra. A diferencia de un servicio típico totalmente gestionado, permite a los científicos de datos alojar modelos de aprendizaje automático mediante PyTorch o TensorFlow con un mínimo esfuerzo. El Puerta de enlace de IA TrueFoundry elimina el pesado trabajo de la orquestación y, al mismo tiempo, proporciona la escalabilidad requerida para la IA generativa.

¿Qué tan bueno es Amazon SageMaker?

SageMaker es técnicamente maduro y fiable para el aprendizaje automático tradicional. Destaca en cuanto a seguridad y cumplimiento, pero tiene una mala puntuación en cuanto a usabilidad, experiencia de depuración y transparencia de costes en comparación con las plataformas MLOps modernas.

¿SageMaker es mejor que Databricks?

Depende de los datos. Databricks (plataforma unificada de análisis de datos) es superior para las cargas de trabajo con alto contenido de Spark y el aprendizaje automático basado en la ingeniería de datos. Por lo general, se prefiere SageMaker para tareas de inferencia y aprendizaje profundo en las que los datos ya están preparados en S3.

¿SageMaker se usa ampliamente?

Sí, tiene la mayor cuota de mercado entre los servicios de aprendizaje automático en la nube pública simplemente debido al dominio de AWS. Sin embargo, la cuota de mercado está cambiando a medida que la «independencia de la nube» se ha convertido en una prioridad para GenAI Stacks.

¿SageMaker compite con OpenAI?

No. OpenAI proporciona modelos como servicio (API). SageMaker proporciona la infraestructura necesaria para entrenar y alojar sus propios modelos (incluidas las alternativas de código abierto a OpenAI, como Llama 3 o Mistral).

¿SageMaker es mejor que Azure ML?

Son funcionalmente similares. Por lo general, se considera que Azure ML tiene una interfaz de usuario más intuitiva y una mejor integración con VS Code, mientras que SageMaker ofrece un control más detallado de la infraestructura de bajo nivel para los usuarios avanzados.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)