¿Qué son las barandillas de IA?

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

En las empresas actuales impulsadas por la IA, sólidas Seguridad de la IA medidas y Cumplimiento de LLM son fundamentales. A medida que las empresas integran modelos lingüísticos extensos (LLM) potentes en los flujos de trabajo empresariales, necesitan mecanismos para mantener estos modelos «en consonancia» con las reglas organizativas. Los sistemas de protección basados en la IA cumplen esta función, de forma análoga a las barreras existentes en la carretera, ya que garantizan que cada interacción con la IA refleje los estándares, las políticas y los valores de la empresa. Las barandillas funcionan comprobando o transformando automáticamente las indicaciones y respuestas de la LLM para hacer cumplir las políticas de seguridad, privacidad y contenido. La puerta de enlace de IA de TrueFoundry incorpora estas barreras en el centro de la canalización de la IA, validando las solicitudes y respuestas para garantizar la seguridad, la calidad y el cumplimiento. Este artículo ofrece una descripción técnica general de las barreras de protección de la IA en el contexto de una pasarela de inteligencia artificial. Definimos qué son las barandillas, explicamos cómo funcionan, destacamos sus componentes esenciales y describimos cómo las organizaciones pueden implementarlas.

¿Qué son las barandillas de IA?

Barandas de IA son controles y filtros basados en reglas que se colocan alrededor de los sistemas de IA generativa para hacer cumplir las políticas empresariales. Las barreras ayudan a garantizar que una herramienta de inteligencia artificial «funcione en consonancia con los estándares, las políticas y los valores de la organización». En la práctica, esto significa que las barreras pueden enmascarar o eliminar datos confidenciales (por motivos de privacidad de los datos), bloquear temas no permitidos (para cumplir con el contenido) o validar los formatos de salida (para garantizar la calidad).

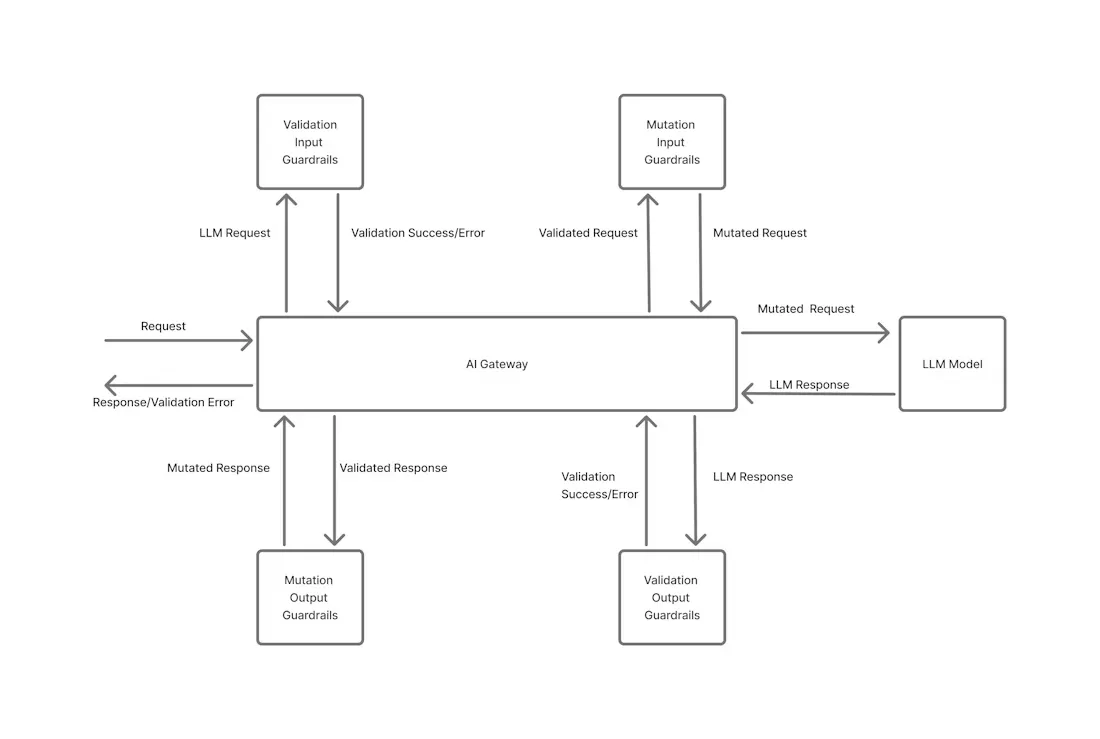

En un Puerta de enlace de IA (como True Foundry), las barreras se aplican en dos puntos: antes de enviar una solicitud a un LLM (barandas de entrada) y después de que se devuelva una respuesta (barandas de salida). Al interceptar ambos extremos de la interacción del LLM, las barreras garantizan que cada aviso y cada respuesta se ajusten a las reglas empresariales.

Ejemplos de barandas de IA en acción:

- Barandas de entrada

- Redacción de PII: Detecta y elimina automáticamente información confidencial como direcciones de correo electrónico, números de teléfono o números de tarjetas de crédito antes de enviar la solicitud a la modelo. (p. ej., «El número de mi tarjeta es 4532-XXXX-XXXX-1234» → «El número de mi tarjeta es [ELIMINADO]»).

- Prevención inmediata de la inyección: Bloquee instrucciones malintencionadas o fuera de alcance, como «Ignorar todas las reglas anteriores» o «Exportar todos los datos de entrenamiento».Filtrado de temas: Evita que los usuarios consulten dominios restringidos (por ejemplo, consejos médicos o financieros) rechazando las solicitudes que contengan palabras clave o intenciones prohibidas.

- Barandas de salida

- Toxicidad y moderación del contenido: Usa integraciones como Moderación de OpenAI o Seguridad del contenido de Azure para bloquear las publicaciones que contengan discursos de odio, material explícito o texto que infrinja las políticas.

- Prevención de fugas de datos: Detecte si las respuestas del modelo incluyen PII o datos internos (por ejemplo, identificadores de clientes o nombres de proyectos confidenciales) y redáctelos o bloquéelos.

Validación de respuestas: Asegúrese de que la salida del modelo se adhiera al formato requerido, por ejemplo, garantizando el cumplimiento del esquema JSON para las respuestas estructuradas en las API de producción. - Controles de alucinaciones: Utilice una lógica de validación personalizada para detectar incoherencias fácticas (por ejemplo, verificar las entidades con nombre o las URL antes de devolverlas a los usuarios).

En resumen, las barreras de la IA son la aplicación técnica de las políticas de gobierno de la IA, garantizando que «cada solicitud y respuesta cumpla con los estándares de seguridad, calidad y cumplimiento de la organización».

¿Cómo funcionan las barandillas de IA?

True Foundry AI Gateway aplica barreras de protección tanto en la entrada como en la salida de cada llamada de LLM. Las barandillas de entrada funcionan delante de un mensaje llega al modelo y realiza tareas como enmascarar datos personales o filtrar contenido prohibido. Las barandillas de salida funcionan después el modelo responde comprobando si hay contenido no seguro o no permitido (y, si lo desea, corrigiéndolo).

Cada regla de barandilla puede funcionar de dos modos: validar (bloquear) o mudar (modificar). En el modo de validación, cualquier infracción detectada hace que la solicitud o la respuesta se bloquee con un error, lo que exige estrictamente el cumplimiento. En el modo de mutación, la barrera modifica automáticamente el contenido para eliminar o transformar el problema (por ejemplo, borrando un número de teléfono o sustituyendo una palabra prohibida). Este enfoque en dos etapas (entrada/salida) y en dos modos (validar/mutar) garantiza que ningún dato confidencial o que no cumpla con las normas pase a través del sistema.

El diagrama anterior ilustra cómo cada mensaje pasa por los filtros de entrada antes de llegar al modelo y por los filtros de salida después de la respuesta, lo que proporciona una red de seguridad en ambos lados de la interacción de la IA.

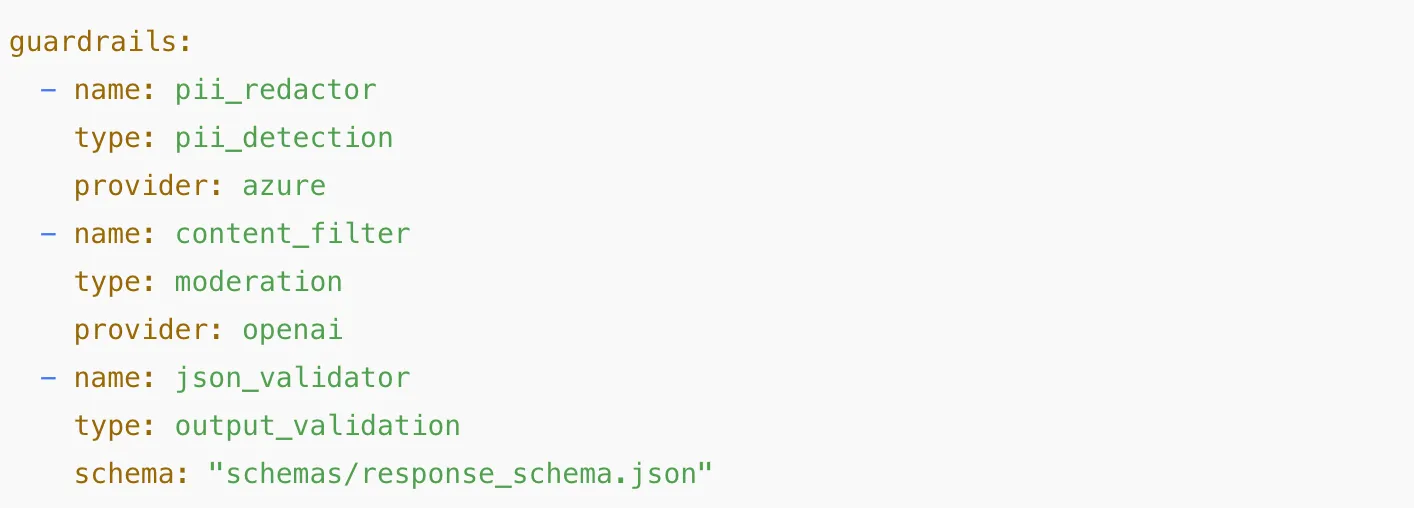

Integración y configuración de barandas en TrueFoundry AI Gateway

True Foundry Puerta de enlace de IA proporciona una capa de control unificada donde las empresas pueden definir, integrar y gestionar barandas en todas las interacciones de LLM, sin modificar la lógica de la aplicación. Las barreras se pueden configurar de forma declarativa mediante YAML, las API o la consola TrueFoundry, lo que permite a los equipos aplicar políticas coherentes en varios proveedores de IA (como OpenAI, Anthropic o Azure OpenAI).

Arquitectura de integración

En un nivel alto, las barandillas están integradas en el Capa Gateway, interceptando el tráfico entre las aplicaciones y los LLM subyacentes.

- Tubería de entrada: Cada solicitud pasa por una cadena configurable de barreras de preprocesamiento, como la redacción de PII, el filtrado de contenido o la validación de esquemas, antes de enviarse al modelo.

- Tubería de salida: De manera similar, las respuestas del modelo se procesan posteriormente mediante barreras de protección de salida (como filtros de toxicidad, validadores de JSON o detección de alucinaciones) antes de volver al usuario o consumidor de la API.

- Extensibilidad: TrueFoundry permite la integración con servicios de moderación de terceros (p. ej., la API de moderación de OpenAI, Azure Content Safety) y barandas personalizadas basadas en Python para reglas específicas de dominio (por ejemplo, comprobaciones de políticas internas o lógica de enmascaramiento de datos).

Esta arquitectura garantiza Seguridad y cumplimiento de la IA mientras se mantiene baja latencia mediante la ejecución en paralelo y el almacenamiento en caché de los resultados de las barandillas.

Configuración de barandilla

Los desarrolladores y los equipos de plataformas pueden configurar las barandillas en varios ámbitos:

Barandas globales: Políticas de toda la organización que se aplican a todos los modelos y puntos finales (por ejemplo, la redacción de PII o los temas no permitidos).

Barandas a nivel de modelo: Configuraciones específicas por proveedor de LLM (por ejemplo, usar la detección de PII de Azure con GPT-4 pero con OpenAI Moderation para Claude).

Barandas a nivel de ruta: Control detallado en las rutas de la API, lo que permite que diferentes puntos finales apliquen diferentes reglas de validación o cumplimiento.

Un ejemplo de configuración simple podría tener este aspecto:

Beneficios de las barandillas a nivel de puerta de enlace

- Gobierno centralizado: Visibilidad y administración unificadas de todas las políticas de guardarraíles desde una única consola.

- Aplicación independiente del proveedor: Las barandillas funcionan de manera uniforme en varias API de LLM.

- Cumplimiento a escala: Permite Cumplimiento de LLM incrustando comprobaciones directamente en el flujo de invocación del modelo.

- Velocidad del desarrollador: Los equipos pueden implementar nuevos modelos de forma segura sin tener que volver a escribir la lógica de validación.

Con AI Gateway de TrueFoundry, las organizaciones pueden integrar las barandillas como parte nativa de su infraestructura de IA, garantizando una solidez Seguridad de la IA, protección de datos, y alineación regulatoria—todo ello manteniendo un alto rendimiento y flexibilidad.

Desafíos comunes sin barandas

Sin barreras, las implementaciones empresariales de LLM se enfrentan a graves riesgos. Los modelos de IA generativa pueden producir salidas impredecibles o inseguras que exponen a las organizaciones a daños legales, reputacionales y operativos. Por ejemplo, un chatbot de IA sin filtros podría revelar inadvertidamente información personal de un usuario o utilizar lenguaje blasfemo o sesgado, lo que erosionaría la confianza de los clientes y podría infringir normativas como el RGPD o la HIPAA. En ámbitos delicados (por ejemplo, la atención médica o las finanzas), incluso una sola respuesta alucinante podría tener consecuencias desastrosas. La falta de controles en tiempo real también significa que los problemas solo se detectan después de la implementación (por ejemplo, si los usuarios no están satisfechos o si se someten a revisiones de auditoría), lo que resulta mucho más caro que detectarlos a tiempo.

En la práctica, la ausencia de barreras provoca infracciones de seguridad (filtraciones de datos), infracciones del cumplimiento (consejos ilegales o información errónea), daños a la marca (respuestas ofensivas o inconsistentes) y un comportamiento impredecible de las aplicaciones. En resumen, sin barreras para hacer cumplir la seguridad y el cumplimiento de la IA, las empresas corren el riesgo de cometer errores costosos y perder el control sobre sus sistemas de IA.

Componentes clave de las barandillas de IA eficaces

Las barandillas eficaces de IA combinan varios elementos técnicos para cubrir diferentes áreas de riesgo. Un sistema sólido normalmente incluye:

(1) Motor de reglas — un conjunto ordenado de reglas de políticas que coinciden con el usuario, el modelo o el contexto, lo que garantiza que solo se active la primera regla aplicable

(2) PII y filtros de datos — detectores integrados o externos que reconocen y redactan información personal y confidencial (correos electrónicos, números de seguro social, tarjetas de crédito, etc.) tanto en las entradas como en las salidas

(3) Clasificadores de contenido — filtros semánticos que comprueban si hay temas no permitidos (consejos médicos, discursos de odio, blasfemias, etc.) o alucinaciones en función de una taxonomía de riesgos

(4) Filtros de palabras clave personalizados — listas de bloqueo de palabras o frases específicas de la empresa que pueden transformar o bloquear términos particulares en tiempo real y,

(5) Acciones de transformación — la capacidad de rechazar el contenido (validarlo) o sanearlo automáticamente (mutarlo) según la política.

En La plataforma de TrueFoundry, estos componentes se implementan como»integraciones de barandillas» (por ejemplo, un enlace a la API de moderación de OpenAI) que el Gateway invoca según sea necesario. Cada vez que se aplica una regla, el sistema registra el evento (qué se comprobó y cómo se gestionó) para su auditoría y análisis. Combinadas, estas funciones crean un marco de seguridad integral: las entradas se depuran previamente antes de que lleguen al LLM y las salidas se comprueban antes de que lleguen al usuario. En términos de McKinsey, un sistema de protección eficaz incluye «comprobadores» para detectar los problemas y «correctores» para solucionarlos, exactamente la función que desempeñan los filtros de entrada/salida y la lógica de transformación de TrueFoundry.

Barreras de la IA frente a la gobernanza de la IA

Es importante distinguir las barandillas de la gobernanza. Gobernanza de la IA se refiere a los marcos, políticas, funciones y procedimientos de supervisión de alto nivel que definen qué es aceptable y por qué — por ejemplo, la política de privacidad de datos de una empresa o las directrices éticas de IA. La gobernanza garantiza que las iniciativas de IA tengan una responsabilidad clara y se alineen con los estándares legales y éticos. Las barandillas, por el contrario, son las mecanismos técnicos de aplicación que implementan esas políticas en tiempo real en cada solicitud de IA. En otras palabras, la gobernanza establece la reglas de circulación, y las barandillas son las barreras y los sensores que evitan que el vehículo de IA se desvíe de su rumbo. Tener una gobernanza sin barreras significa que las políticas solo existen sobre el papel; tener barreras sin gobernanza significa que no hay una guía clara sobre qué hacer cumplir. En la práctica, la gestión eficaz de los riesgos de la IA utiliza ambas cosas: gobierno estratégico define los objetivos (por ejemplo, «no revelar nunca la PII», «no dar consejo médico»), y barandas (en el Puerta de enlace de IA) aplica automáticamente esas reglas en cada interacción de LLM. Como señala un analista, las organizaciones necesitan que tanto la gobernanza como las barreras técnicas de la IA trabajen juntas para escalar la IA de forma segura.

Implementación de barreras de inteligencia artificial en las organizaciones

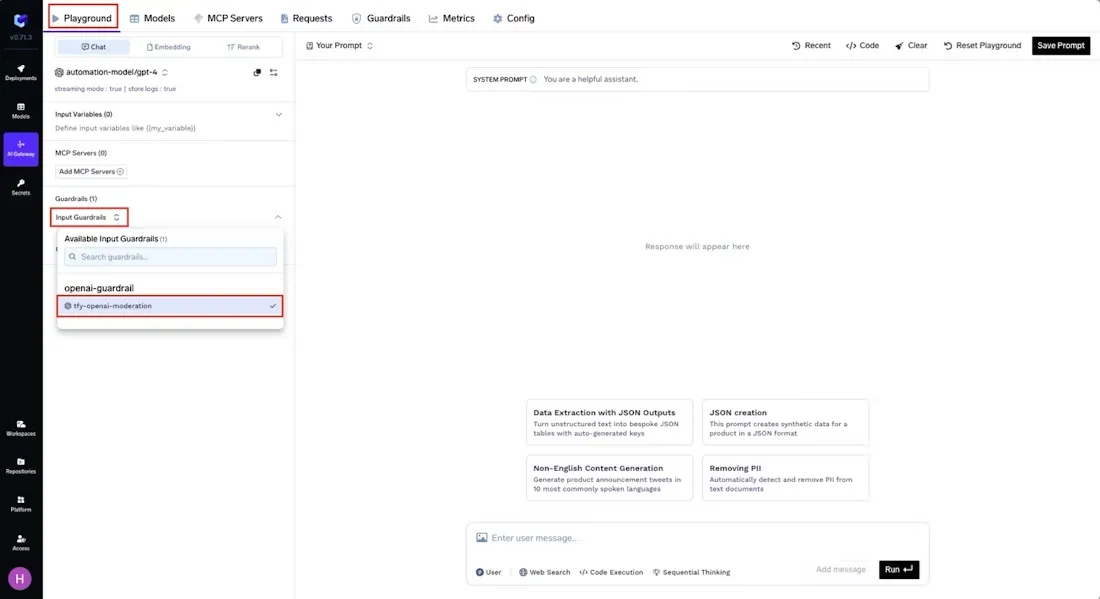

La puerta de enlace de IA de TrueFoundry hace que sea práctico implementar barreras de protección en una organización. Por lo general, los administradores comienzan por crear un Grupo Guardrails en la interfaz de usuario de Gateway (un contenedor con administradores y usuarios definidos) para realizar integraciones de políticas. Dentro de ese grupo, agregan productos específicos integraciones de barandillas (por ejemplo, la API de moderación de OpenAI para el filtrado de contenido) rellenando el formulario de configuración del proveedor.

Una vez definidas las integraciones, los equipos pueden probarlas de forma inmediata utilizando El patio de recreo de TrueFoundry. Por ejemplo, se puede aplicar una barandilla de entrada y enviar un mensaje que no sea seguro; el Playground demostrará que la barandilla bloquea o desinfecta el contenido según lo esperado.

En el código de producción, los desarrolladores pueden aplicar barandas por solicitud añadiendo el encabezado X-TFY-GUARDRAILS con el conjunto de reglas elegido. Esto permite a las aplicaciones especificar dinámicamente qué filtros aplicar llamada por llamada.

Para las políticas de toda la empresa, TrueFoundry admite configuraciones de barandillas a nivel de puerta de enlace: un administrador crea una configuración de YAML en la pestaña de configuración de AI Gateway especificando las reglas con las condiciones de cuándo y enumerando los input_guardrails y output_guardrails que se deben aplicar. Solo se usa la primera regla coincidente por solicitud.

Definir barreras a nivel de puerta de enlace es lo mejor para la aplicación en toda la organización, de modo que cada solicitud de IA se verifique automáticamente de acuerdo con los estándares de cumplimiento de la empresa. De este modo, AI Gateway centraliza la gestión y la auditoría de las barreras, lo que elimina la necesidad de instrumentar cada aplicación por separado.

El futuro de las barandillas de IA

El panorama de las barandillas está evolucionando rápidamente junto con las capacidades y regulaciones de la IA. Los investigadores abogan por las arquitecturas de barandilla multicapa: por ejemplo, una capa principal de «control» de entrada/salida podría complementarse con una capa de base de conocimientos que utilice comprobaciones aumentadas por la recuperación para verificar la precisión de los hechos. Las organizaciones también están experimentando con barreras de protección inteligentes, que utilizan agentes de inteligencia artificial para supervisar y corregir continuamente los resultados de los modelos en tiempo real. En cuanto a las herramientas, está surgiendo un ecosistema cada vez mayor de marcos de código abierto. El kit de herramientas NeMo Guardrails de NVIDIA, la biblioteca Guardrails de LangChain y otros proporcionan motores de reglas programables para los LLM. Los proveedores de servicios en la nube también ofrecen filtros de moderación y seguridad integrados para sus servicios de inteligencia artificial. Mientras tanto, una normativa más estricta (como la propuesta de ley de inteligencia artificial de la UE) impulsará la demanda de soluciones de protección llave en mano que puedan demostrar el cumplimiento de la LLM en tiempo real. En general, cabe esperar que las barreras de protección se integren aún más en el ciclo de vida del desarrollo de la IA (incorporando detectores avanzados de PNL, políticas adaptadas al contexto y registros de auditoría verificables) para que los despliegues empresariales de inteligencia artificial sigan siendo potentes y seguros.

Conclusión

Barandas de IA son esenciales para convertir los LLM avanzados de experimentos impredecibles en herramientas empresariales confiables y compatibles. Al intercalar cada solicitud de IA entre las comprobaciones de entrada y salida, La puerta de enlace de IA de TrueFoundry permite a las organizaciones aplicar automáticamente la privacidad de los datos, los estándares de contenido y los requisitos reglamentarios. La clave es combinar filtros flexibles y basados en políticas (para enmascarar la información de identificación personal, moderar temas, etc.) con la aplicación en tiempo real (validar o mutar acciones) y un registro exhaustivo. Para los directores de tecnología informática y los arquitectos de inteligencia artificial, incorporar barreras significa aprovechar el potencial de la IA generativa sin sacrificar la confianza ni la seguridad. En el contexto empresarial, las sólidas barreras de protección a nivel de puerta de enlace son la base de una IA responsable: permiten a las empresas innovar con confianza con los LLM, sabiendo que cada respuesta ha sido examinada teniendo en cuenta sus normas de seguridad, calidad y cumplimiento.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)