Prévention du verrouillage des fournisseurs grâce à la passerelle IA de TrueFoundry

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Présentation

À mesure que les entreprises développent leurs initiatives d'IA, l'un des plus grands risques architecturaux auxquels elles sont confrontées est verrouillage du fournisseur—étant trop étroitement lié à un seul fournisseur de modèles ou à une seule plateforme cloud. Dans l'écosystème de l'IA en évolution rapide, où de nouveaux modèles de base et de nouvelles API apparaissent presque chaque semaine, cette dépendance peut rapidement limiter l'innovation et la flexibilité. Les équipes qui s'engagent tôt dans un écosystème se retrouvent souvent dans l'incapacité d'adopter des modèles plus récents, meilleurs ou plus rentables sans réécrire une grande partie de leur stack. Empêcher le verrouillage n'est donc pas seulement une question d'approvisionnement, c'est une défi de conception technique de base.

Le risque de dépendance vis-à-vis d'un fournisseur est une préoccupation majeure lors de la conception de systèmes d'IA d'entreprise. Si vos applications d'IA sont étroitement couplées aux API d'un seul fournisseur, vous pourriez avoir du mal à vous adapter lorsque les besoins en matière de technologie, de tarification ou de conformité évoluent. Une passerelle de modèles d'IA résout ce problème en agissant comme une couche d'abstraction entre vos applications et plusieurs fournisseurs de modèles. En pratique, cela signifie que votre code communique avec l'interface unifiée de la passerelle plutôt qu'avec chaque fournisseur directement. La passerelle achemine et traduit ensuite les requêtes vers le modèle sous-jacent optimal (OpenAI, Anthropic, Gemini, un LLama auto-hébergé, etc.) sans que le code de votre application ne nécessite de modifications spécifiques au fournisseur. TrueFoundry Passerelle IA illustre cette approche : elle propose une API unique compatible avec OpenAI pour accéder Plus de 1000 LLM et modèles de vision, tout en renforçant la sécurité, la gouvernance et l'observabilité de l'entreprise. De par sa conception, True Foundry empêche le verrouillage : vous conservez un contrôle total sur le déploiement et les formats de données, et le code de votre application reste indépendant des fournisseurs.

Comprendre la dépendance vis-à-vis des fournisseurs dans les systèmes d'IA

Le verrouillage par un fournisseur se produit lorsque votre système est tellement lié à un fournisseur qu'il est peu pratique ou coûteux de passer à un autre. En AI/ML, cela signifie souvent écrire du code directement sur le SDK ou l'API d'un fournisseur. Bien que l'utilisation d'un seul fournisseur (par exemple OpenAI) puisse être simple au début, cela crée de dangereuses dépendances. Par exemple, si votre intégration utilise les appels d'API propriétaires d'OpenAI, vous aurez du mal à effectuer la migration si le service d'OpenAI n'est pas disponible, change de conditions ou si un nouveau modèle (tel que Gemini de Google ou un modèle open source de pointe) devient supérieur.

L'équipe TrueFoundry le souligne « Piège à l'enfermement des fournisseurs »: une intégration codée en dur vous oblige à vous dépêcher chaque fois que les fournisseurs modifient leurs prix, rendent leurs modèles obsolètes ou interrompent leur maintenance. Plus généralement, le verrouillage se traduit par des coûts de changement élevés, qu'ils soient techniques (réécriture de code pour de nouvelles API), contractuels (rupture d'engagements à long terme), liés aux processus (reconversion des équipes) ou formats de données (transfert de données propriétaires).

Pour évaluer le risque de verrouillage d'un logiciel, il faut se poser les questions suivantes : Pouvons-nous facilement changer de fournisseur si nécessaire ? et Sommes-nous contraints d'utiliser des SDK ou des formats de données propriétaires ? Comme le note Progress Software, le verrouillage est moins une question de commodité initiale que de flexibilité à long terme. Vous devriez considérer le lock-in comme n'importe quelle dette technique : planifiez votre architecture de manière à garder les options ouvertes. En pratique, cela signifie favoriser les standards ouverts (par exemple, l'API OpenAI, les données Parquet), les déploiements conteneurisés et les couches d'abstraction (comme les passerelles) qui permettent aux composants sous-jacents de s'échanger. La passerelle IA de TrueFoundry garantit que le code de l'application ne contient jamais d'appels spécifiques au fournisseur, de sorte que vous ne serez pas bloqué sur un seul fournisseur d'IA.

Qu'est-ce qu'une passerelle de modèles d'IA ?

Un Passerelle de modèles d'IA (également appelée passerelle LLM ou AI) est une couche intermédiaire qui se trouve entre votre application et un certain nombre de fournisseurs de modèles d'IA. Il fonctionne comme un contrôleur du trafic aérien ou un traducteur : votre application envoie une seule demande d'API à la passerelle, qui décide de l'instance de modèle ou du fournisseur à utiliser. La passerelle normalise ensuite les formats d'entrée/sortie et gère la sécurité et le routage en coulisse. Grâce à cette interface unifiée, vous n'écrivez jamais de code spécifique au modèle dans votre application.

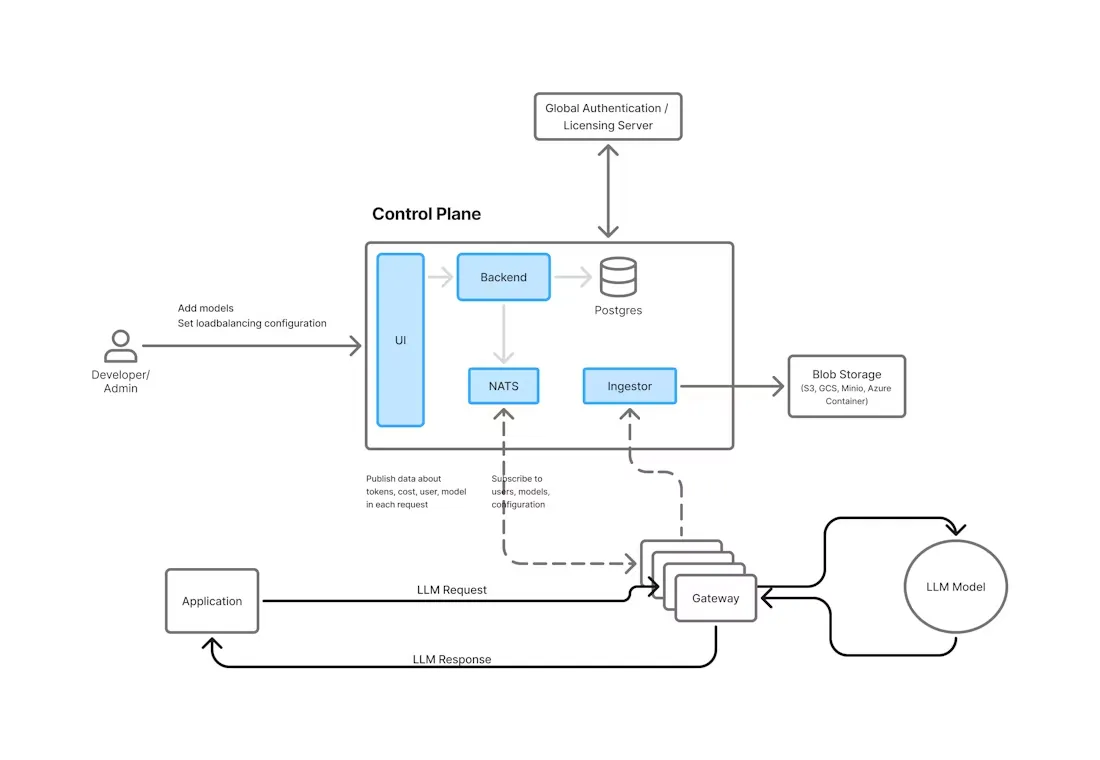

Figure : architecture TrueFoundry AI Gateway (couche proxy entre les applications et plusieurs fournisseurs LLM).

Par exemple, La passerelle de TrueFoundry accepte les demandes dans un format compatible avec OpenAI; il peut ensuite acheminer la requête vers OpenAI, Anthropic, un modèle auto-hébergé ou tout autre fournisseur intégré sans modifier votre code.

Essentiellement, une passerelle d'IA permet l'abstraction des modèles, l'application des politiques et l'orchestration multimodèle en un seul endroit. Il ajoute également des fonctionnalités d'entreprise (telles que le RBAC, les limites de taux, le contrôle des coûts et la journalisation des audits) en plus de chaque demande, traitant les modèles d'IA comme des services gérés. En découplant l'application des API spécifiques au fournisseur, les passerelles réduisent considérablement la charge d'ingénierie lorsque vous travaillez avec plusieurs LLM.

Comment les passerelles de modèles d'IA aident à prévenir la dépendance vis-à-vis des fournisseurs

Passerelles IA empêcher le verrouillage en extraction des informations sur le fournisseur. Comme votre application communique uniquement avec l'API unifiée de la passerelle, vous ne codez jamais en dur des points de terminaison spécifiques à un fournisseur. Par exemple, La passerelle de TrueFoundry prend en charge tous Compatible avec OpenAI model, donc si vous écrivez votre code à l'aide de l'API de style OpenAI de TrueFoundry, vous pouvez basculer entre OpenAI, Azure OpenAI, Anthropic ou vos propres modèles en modifiant la configuration. Aucune réécriture de code n'est requise. Ce découplage est essentiel.

True Foundry utilise délibérément le format standard de l'API OpenAI pour toutes les demandes, ce qui signifie que vous pouvez continuer à utiliser le SDK OpenAI ou les bibliothèques clientes habituels. Vous envoyez simplement des demandes à la passerelle de TrueFoundry plutôt que directement à un fournisseur. Sous le capot, la passerelle traduit ces appels en appels d'API du fournisseur appropriés, selon les besoins.

TrueFoundry évite également d'introduire son propre SDK personnalisé. Au lieu de cela, les développeurs utilisent les outils et les SDK existants comme avant, qu'il s'agisse d'OpenAI ou d'un autre client open source, et les pointent vers le point de terminaison de la passerelle. En fait, aucun nouveau « verrouillage » n'est créé à l'aide de TrueFoundry, car vous n'avez jamais à « adhérer » à une interface propriétaire. De plus, les formats de données et les journaux de TrueFoundry sont tous conformes à des normes ouvertes : par exemple, les journaux sont stockés dans Apache Parquet sur S3 géré par le client, et les métriques utilisent OpenTelemetry. Cela signifie que vous pouvez exporter et analyser les données à l'aide de l'outil de votre choix, évitant ainsi tout enchevêtrement entre fournisseurs de données. Bref, en agissant en tant que traducteur et plan de contrôle, Les passerelles d'IA telles que TrueFoundry vous permettent d'échanger des fournisseurs de modèles, de déplacer des charges de travail vers un autre environnement ou même d'héberger vous-même des modèles sans réécrire le code de l'application.

Aperçu de l'architecture : comment ça marche

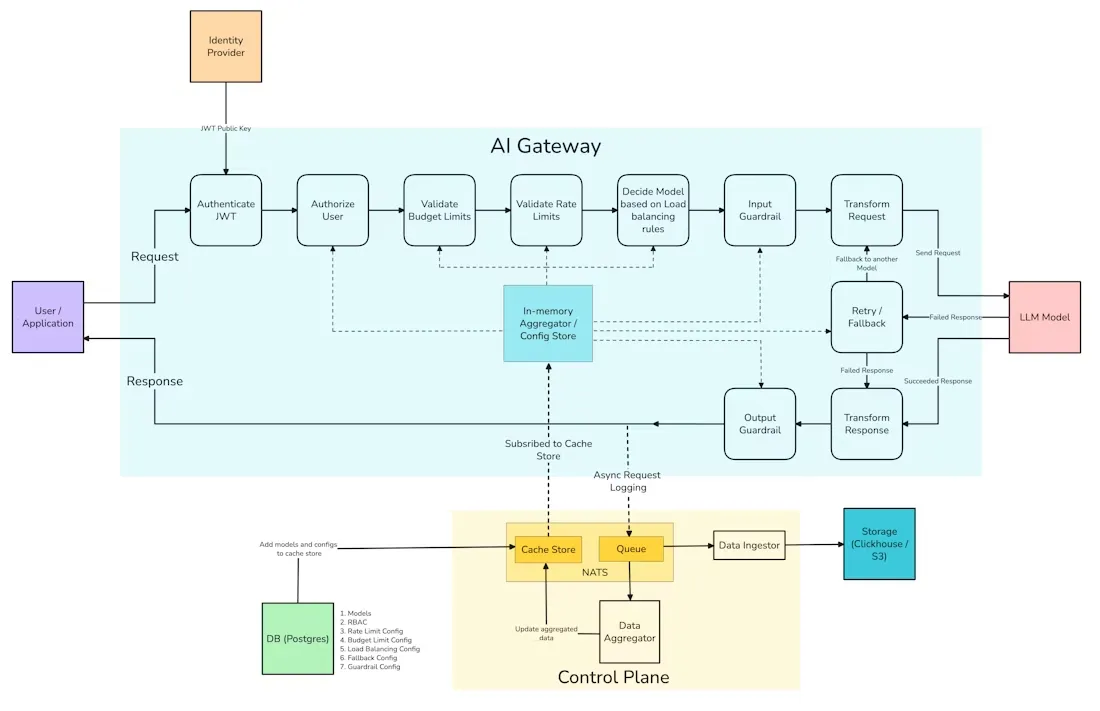

TrueFoundry Passerelle IA est conçu pour offrir une haute disponibilité et une latence minimale tout en appliquant des politiques à grande échelle. Son cœur est une scission plan de contrôle/plan de données architecture. En substance, le plan de contrôle (un service central) gère la configuration, les modèles, les utilisateurs et les politiques, tandis que des modules de passerelle légers traitent les demandes d'inférence. Ces pods de passerelle sont écrits dans un framework hautes performances piloté par les événements (Hono) et sont Lié au processeur pour plus d'efficacité.

Lorsqu'une demande arrive, la passerelle exécute tous contrôles en mémoire : il valide votre jeton JWT et vos autorisations, applique des limites de débit ou des plafonds budgétaires et détermine le modèle à utiliser. Il est important de noter que la demande entre dans le format JSON standard compatible avec OpenAI. La passerelle utilise ensuite ses règles de routage configurées pour sélectionner un fournisseur de modèle (par exemple, le plus rapide ou le moins cher). Un intégré adaptateur component traduit la demande dans le format spécifique attendu par l'API de ce fournisseur. Par exemple, si le modèle choisi est sur AWS Bedrock ou Anthropic, la passerelle convertit la demande de style OpenAI de manière appropriée. Cela signifie que le code de votre application ne change jamais, même si les différents fournisseurs peuvent s'attendre à des paramètres différents.

Une fois que le modèle répond, la passerelle renvoie la sortie à votre application. Simultanément, il enregistre de manière asynchrone la demande et la réponse (jetons, latence, coût, etc.) dans un magasin central. Ces journaux sont transférés vers le backend d'analyse de votre propre cloud (TrueFoundry les écrit sous forme de Parquet dans S3 ou dans un magasin compatible S3). En bref, la conception de TrueFoundry garantit pas d'appels externes sont nécessaires dans le chemin de la demande (à l'exception de la mise en cache), toutes les décisions politiques sont en mémoire et les journaux des demandes sont découplés et durables. Le résultat est une passerelle d'IA qui ajoute uniquement ~3 à 5 ms de frais généraux par appel, même en cas de centaines de demandes par seconde. Son déploiement en cluster sur Kubernetes (via des graphiques Helm) vous donne la liberté de l'exécuter n'importe où (cloud public, centre de données privé ou périphérie) sans modifier la couche applicative.

Figure : Architecture à haute disponibilité de la passerelle IA de TrueFoundry (plan de contrôle et modules de passerelle).

En interne, TrueFoundry utilise une base de données centrale (par exemple PostgreSQL) et une file de messages NATS pour la distribution de la configuration. Tous les pods de passerelle s'abonnent à des mises à jour en temps réel (utilisateurs, modèles, quotas, métriques) via NATS, de sorte que les modifications de politique se propagent instantanément. Si aucun fournisseur principal n'est disponible, la passerelle peut automatiquement réessayer ou basculer vers un modèle de secours. Ce module, Design natif de Kubernetes , associée à une approche basée sur les API, garantit que vous n'êtes jamais bloqué dans l'infrastructure de TrueFoundry. Vous obtenez les manifestes et les tableaux de bord, et vous conservez un contrôle total sur les détails du déploiement.

Avantages de l'utilisation de passerelles de modèles d'IA

1. Agnosticisme et flexibilité vis-à-vis des fournisseurs : De par sa conception, une passerelle d'IA rend votre stack d'IA indépendant des fournisseurs. L'API unifiée de TrueFoundry vous permet de vous connecter facilement à n'importe quel Endpoint compatible OpenAI ou plus de 1000 LLM et modèles de vision pris en charge. Vous pouvez changer de modèle sous-jacent (par exemple GPT, Claude, LLama, Mistral, Gemini, etc.) sans toucher au code de votre application, ce qui constitue une défense directe contre le verrouillage.

2. Interface unifiée et support multimodèle : Un point de terminaison de passerelle remplace de nombreuses API fournisseurs. Cela simplifie le développement (une intégration à gérer) et permet une orchestration multimodèle intelligente. Vous bénéficiez de fonctionnalités telles que le routage intelligent (envoyez des demandes vers le modèle le plus rapide ou le moins cher) et la gestion automatique des solutions de secours.

3. Contrôles d'entreprise: Les passerelles répondent de manière native aux besoins des entreprises. La passerelle de TrueFoundry applique l'authentification (clés API, OAuth, etc.), le RBAC affiné, la limitation du débit et les garde-fous de contenu à chaque appel. Il capture également les journaux d'audit à des fins de conformité. Ces garanties s'appliquent de manière uniforme à tous les modèles et fournisseurs, contrairement aux intégrations personnalisées.

4. Gestion des coûts et de l'utilisation : Étant donné que les passerelles IA voient chaque demande, elles peuvent suivre l'utilisation des jetons et les budgets. TrueFoundry permet de suivre les coûts en temps réel et de plafonner les budgets par équipe ou par modèle, ce qui permet d'éviter des frais excessifs. Ce contrôle centralisé des coûts est bien plus facile que de percer des trous dans la console de chaque fournisseur.

5. Observabilité et normes ouvertes: La journalisation et la télémétrie centrées sur la passerelle offrent une visibilité inégalée sur les charges de travail de l'IA. Les journaux de TrueFoundry sont conformes à l'OTEL et dans des formats ouverts. Vous pouvez donc les acheminer vers n'importe quel outil d'observabilité (par exemple Datadog, Grafana). Parce que les données résident dans vos propres compartiments S3 en tant que Parquet, vous propre vos analyses ; cela évite tout verrouillage caché des données.

6. Évolutivité et fiabilité : Une passerelle bien conçue réduit les frais généraux. Les benchmarks de TrueFoundry ne montrent qu'une latence supplémentaire d'environ 3 à 4 ms à environ 250 RPS sur un seul cœur de processeur. La passerelle évolue horizontalement et sa conception (aucun point de défaillance unique dans le chemin de la demande) garantit une haute disponibilité. En résumé, vous bénéficiez d'une fiabilité de niveau professionnel sans sacrifier les performances.

7. Intégration de l'écosystème : TrueFoundry expose un 100 % piloté par API plateforme. Vous pouvez l'intégrer à CI/CD (GitOps), utiliser leur fournisseur Terraform ou leurs diagrammes Helm, et vous connecter à des outils externes. Par exemple, les résultats ou les métriques de TrueFoundry peuvent être intégrés au SIEM ou aux outils de gouvernance via OpenTelemetry. Cette ouverture signifie que vous conservez le choix de votre outillage.

Meilleures pratiques en matière de prévention de la dépendance vis-à-vis des fournisseurs

Pour vous prémunir contre le verrouillage, appliquez les principes suivants :

- Logique d'application de découplage : Interagissez toujours avec les modèles par le biais d'une abstraction (comme une passerelle d'IA) plutôt que d'appeler directement les API des fournisseurs. Cela empêche le code spécifique au fournisseur d'entrer en ligne de compte dans votre logique métier.

- Utilisez des standards ouverts : Privilégiez les fournisseurs et les plateformes qui utilisent des protocoles/formats ouverts. L'utilisation par TrueFoundry de la spécification de l'API OpenAI et des formats de données standard (Parquet, OTel) en est un exemple. De cette façon, vous pouvez passer à de nouveaux outils ou fournisseurs sans avoir à vous heurter à des obstacles liés à la propriété.

- Conteneurisation et auto-hébergement : Déployez votre stack d'IA sur des infrastructures communes (par exemple Kubernetes) afin de pouvoir le déplacer entre les clouds ou sur site. TrueFoundry fournit des manifestes Kubernetes, ce qui vous permet de contrôler totalement le déploiement.

- Préservez la portabilité des données : Stockez les modèles et les journaux dans des formats neutres sous votre contrôle. TrueFoundry garantit que les journaux sont acheminés vers le stockage géré par le client et prend même en charge l'hébergement de vos propres serveurs modèles (serveurs MCP) derrière la passerelle.

- Planifiez les voies de migration : Testez régulièrement les composants mobiles. La philosophie de TrueFoundry facilite explicitement la migration : votre code reste le même et les spécifications de déploiement sont ouvertes.

- Évaluez les licences et les prix : Évitez les modèles de fournisseurs qui pénalisent les sorties. La tarification basée sur le siège de TrueFoundry (plutôt que des frais par utilisation) est conçue pour que vous ne soyez pas surpris par les variations de coûts lors de la mise à l'échelle.

- Documentez et limitez les extensions spécifiques aux fournisseurs : Si vous devez utiliser des fonctionnalités réservées aux fournisseurs, isolez-les afin que le système central reste général. Idéalement, réduisez-les au fil du temps.

En adoptant ces habitudes (abstraction, standardisation et contrôle), vous réduisez considérablement le risque de verrouillage.

Comparaison : Gateway et intégration directe des API

Comme le montre le tableau, l'intégration directe peut être la plus simple pour une petite validation de concept à modèle unique, mais elle devient rapidement fragile en production. La passerelle IA de TrueFoundry introduit un coût de performance minime et prévisible (quelques millisecondes seulement) en échange de gains massifs en termes de flexibilité et de contrôle. Dans la plupart des scénarios d'entreprise, ce compromis en vaut la peine pour éviter la dépendance vis-à-vis des fournisseurs et pour bénéficier de fonctionnalités de niveau professionnel prêtes à l'emploi.

Évaluation des passerelles de modèles d'IA pour prévenir le verrouillage des fournisseurs

Lorsque vous choisissez une passerelle d'IA (ou toute autre plateforme d'IA), tenez compte des facteurs de verrouillage suivants :

- Support multifournisseur : La solution prend-elle en charge tous les principaux fournisseurs de LLM et autorise-t-elle les modèles auto-hébergés ? La passerelle de TrueFoundry s'intègre à des centaines de modèles et vous permet d'ajouter facilement des modèles compatibles avec OpenAI. Une passerelle étroite signifie plus de verrouillage.

- API et SDK ouverts : Existe-t-il un SDK propriétaire ou pouvez-vous utiliser des bibliothèques conformes aux normes de l'industrie ? La compatibilité de TrueFoundry avec l'API OpenAI vous permet d'utiliser les SDK existants tels quels. Évitez les outils qui forcent la fermeture du SDK.

- Portabilité des données : Pouvez-vous exporter vos journaux, vos données de modèle et vos métriques dans des formats ouverts ? TrueFoundry écrit des journaux sous forme de parquet dans votre S3 et utilise OpenTelemetry pour les métriques. Les passerelles qui bloquent les données dans des bases de données propriétaires augmentent le risque de verrouillage.

- Liberté de déploiement : Êtes-vous lié à une seule région cloud ou pouvez-vous fonctionner sur site ? TrueFoundry propose à la fois des options SaaS et des options auto-hébergées sur n'importe quel environnement Kubernetes. Une passerelle qui fonctionne uniquement dans le cloud du fournisseur crée une dépendance à long terme.

- Modèle de tarification : La structure des coûts pénalise-t-elle la croissance ou les mutations ? La tarification basée sur le siège de TrueFoundry est conçue pour vous permettre de rester productif sans frais d'échelle surprenants. Examinez l'évolution des prix d'un fournisseur en cas d'expansion ou de migration.

- Intégration de l'écosystème : La passerelle peut-elle fonctionner avec votre chaîne d'outils existante (CI/CD, surveillance, sécurité) ? TrueFoundry possède des API, un support GitOps et des connecteurs pour les frameworks ML les plus courants (LangChain, etc.). Si une passerelle vous oblige à adopter un tout nouveau flux de travail, c'est un signal d'alarme.

En bref, recherchez des conceptions modulaires ouvertes (comme les modules à plan partagé et basés sur des plugins de TrueFoundry), des données portables et une visibilité complète sur le fonctionnement du système. L'approche de TrueFoundry, modulaire, native de Kubernetes et utilisant des standards ouverts, coche ces cases pour minimiser le verrouillage. Leur philosophie est claire : « zéro dépendance vis-à-vis des fournisseurs » afin que vous puissiez migrer ou faire évoluer votre stack d'IA selon vos propres conditions.

Conclusion

Le verrouillage des fournisseurs est un coût caché du développement de l'IA qui peut exposer les entreprises à des hausses de prix, à des pannes et à la stagnation. L'utilisation d'une passerelle de modèles d'IA est l'un des moyens les plus efficaces d'éviter ces pièges. En canalisant toutes les demandes de modèles via une interface unifiée et agnostique, les passerelles éliminent les dépendances codées en dur vis-à-vis d'un fournisseur unique. La passerelle IA de TrueFoundry incarne cette approche : elle dissocie votre application des API LLM spécifiques, adopte des normes ouvertes et vous garantit le contrôle total de l'infrastructure et des données. Il en résulte une plus grande agilité : vous pouvez évaluer de nouveaux modèles, transférer les charges de travail entre les clouds ou déployer sur site sans avoir à réécrire le code de base.

En bref, considérez une passerelle d'IA comme une police d'assurance contre le lock-in. TrueFoundry la mise en œuvre va encore plus loin en offrant des fonctionnalités de niveau entreprise (RBAC, observabilité, contrôle des coûts) et une portabilité ouverte, afin que vos systèmes d'IA restent flexibles, évolutifs et évolutifs.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)