Intégration de TrueFoundry à Braintrust

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Observabilité LLM complète : Braintrust et TrueFoundry AI Gateway

Alors que les entreprises s'efforcent de déployer des applications basées sur l'IA, le défi cesse rapidement de se poser : « Pouvons-nous appeler un LLM ? » et devient « Pouvons-nous exploiter ce système en toute confiance ? » Une fois que vous disposez de plusieurs fournisseurs, de plusieurs versions de modèles, d'agents d'appel, d'outils et d'une logique métier intégrée à chaque demande, les véritables risques apparaissent au niveau de la production : augmentation des dépenses sans attribution claire, régressions de latence difficiles à identifier et changements de qualité ressentis par les utilisateurs avant qu'ils ne soient prouvés par les données.

C'est là que l'association entre TrueFoundry AI Gateway et Braintrust s'inscrit naturellement. Passerelle TrueFoundry AI est la couche proxy entre vos applications et vos fournisseurs de modèles, conçue pour fournir aux équipes une interface unifiée avec une gouvernance et une observabilité de niveau entreprise. Confiance intellectuelle est une plateforme d'observabilité conçue pour aider les équipes à suivre, évaluer et itérer le comportement réel du LLM au fil du temps. Ensemble, ils créent une boucle pratique : acheminez tout le trafic des modèles via un point de contrôle unique, exportez automatiquement des traces riches et utilisez ces traces pour améliorer la qualité et la fiabilité grâce à des preuves plutôt qu'à des conjectures.

Note d'information sur TrueFoundry AI Gateway

Passerelle TrueFoundry AI est la couche proxy qui se trouve entre vos applications et les fournisseurs LLM et les serveurs MCP. Il s'agit d'une plateforme professionnelle qui permet aux utilisateurs d'accéder à plus de 1000 LLM à l'aide d'une interface unifiée tout en veillant à l'observabilité et à la gouvernance. L'AI Gateway est conforme à OpenTelemetry et prend en charge l'exportation de traces OTEL, ce qui signifie que vous pouvez diffuser des traces au niveau des requêtes vers un backend d'observabilité externe ou d'ingénierie LLM sans modifier les chemins de code de votre application.

Note d'information sur Braintrust

Confiance intellectuelle prend en charge son utilisation comme backend OpenTelemetry : vous acheminez les traces vers Braintrust, vous vous authentifiez à l'aide d'une clé API et vous associez un « parent » (comme un projet ou une expérience) pour que les traces soient placées dans le bon périmètre organisationnel. Une fois que les traces sont dans Braintrust, elles deviennent le support des flux de travail d'ingénierie quotidiens : étudier les modèles de latence et de défaillance, comprendre l'utilisation des jetons et les inducteurs de coûts, et exécuter des évaluations qui quantifient la qualité de la sortie au fil du temps plutôt que de se fier à des commentaires anecdotiques.

Mieux ensemble : une intégration fluide pour une meilleure visibilité de la production et une itération plus rapide

Le véritable effet de levier se produit lorsque la passerelle devient la source unique de vérité pour la télémétrie et que Braintrust devient l'endroit où cette télémétrie se transforme en informations d'ingénierie. L'exportation OTEL étant activée dans TrueFoundry AI Gateway, chaque demande LLM qui passe par la passerelle peut automatiquement produire une trace qui capture le contexte critique (métadonnées de la demande, sélection du modèle/fournisseur et calendrier) sans instrumentation personnalisée dans chaque service. Braintrust ingérant ces traces, vous pouvez passer de « nous pensons que cette modification rapide a aidé » à « nous pouvons prouver l'impact sur le trafic réel et détecter les régressions à un stade précoce ».

Comment fonctionne l'intégration de Braintrust et TrueFoundry

À un niveau élevé, votre application envoie du trafic LLM à TrueFoundry AI Gateway, qui transmet la demande au fournisseur de modèles sélectionné. En parallèle, la passerelle émet des traces OpenTelemetry pour ces interactions et les exporte vers un backend compatible OTEL. Braintrust expose un chemin d'ingestion compatible OTEL qui accepte ces traces lorsque vous fournissez une authentification et une portée parent (projet ou expérience).

Cela signifie que vous configurez l'exportation une fois sur la couche passerelle, puis le flux de trace devient un actif partagé entre les équipes, utile pour le débogage, l'attribution des dépenses, le suivi des performances et l'évaluation de la qualité, sans avoir à moderniser chaque application qui appelle un LLM.

Commencez : exportez des traces OTEL depuis TrueFoundry AI Gateway vers Braintrust

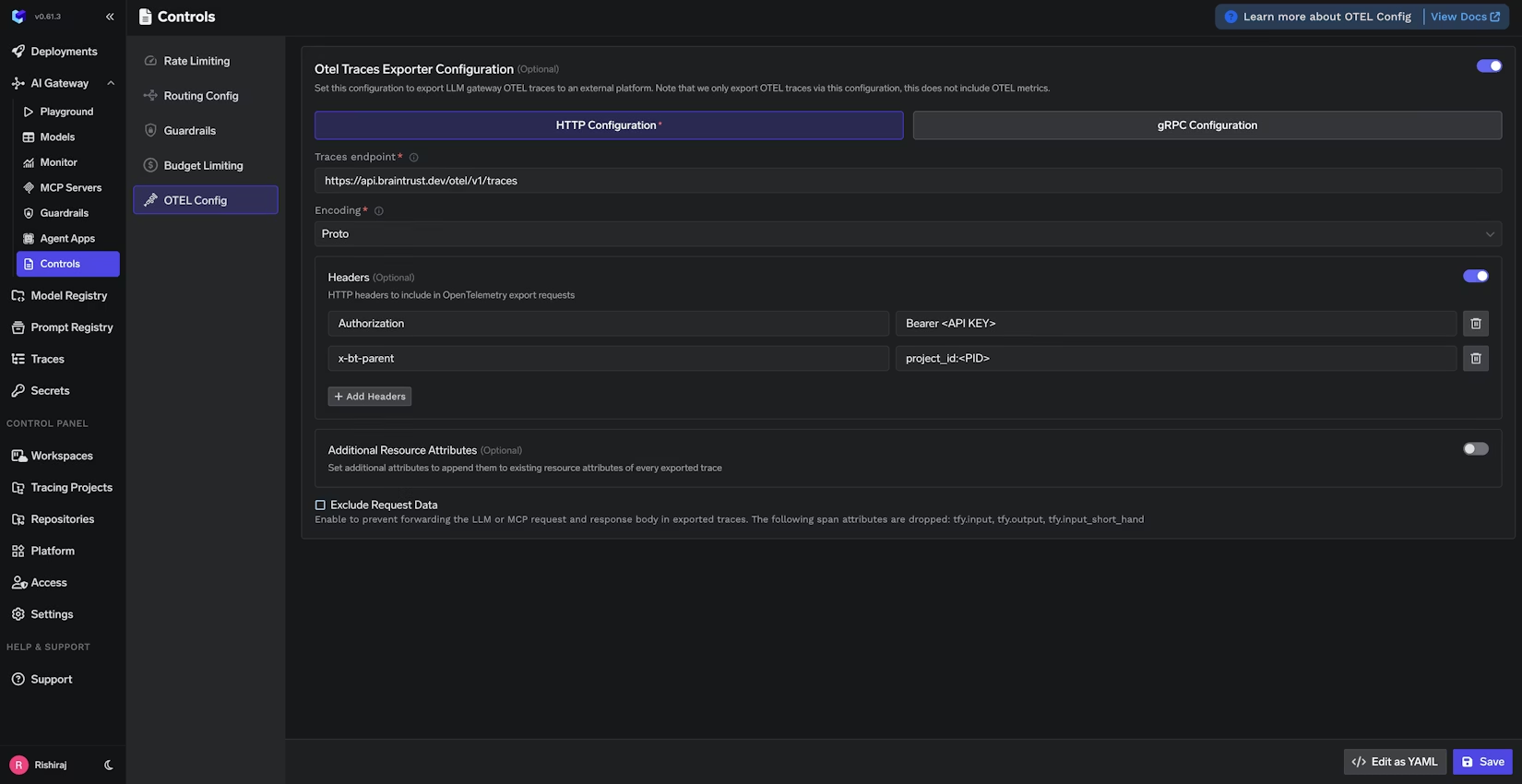

Pour le câbler, vous allez configurer l'export OpenTelemetry d'AI Gateway pour qu'il pointe vers le point de terminaison d'ingestion de traces de Braintrust. La passerelle AI de TrueFoundry propose l'exportation de traces OTEL en tant que fonctionnalité de premier ordre, y compris des options d'exportation HTTP/gRPC et la prise en charge de la transmission des en-têtes personnalisés nécessaires à votre backend. Docs ici

Dans votre tableau de bord TrueFoundry, ouvrez la configuration AI Gateway OTEL et activez l'exportation de traces. Configurez ensuite le point de terminaison Braintrust Traces comme suit :

https://api.braintrust.dev/otel/v1/traces

Pour l'authentification et le routage, ajoutez un Autorisation en-tête à l'aide de votre clé d'API Braintrust, et ajoutez le x-bt-parent en-tête pour spécifier le projet Braintrust où les traces doivent atterrir, par exemple :

x-bt-parent : identifiant du projet : <YOUR_PROJECT_ID>

Braintrust et TrueFoundry documentent tous deux ce concept « parent », et TrueFoundry indique également que vous pouvez utiliser d'autres préfixes tels que nom_projet : ou identifiant de l'expérience : en fonction de la manière dont vous souhaitez organiser les traces.

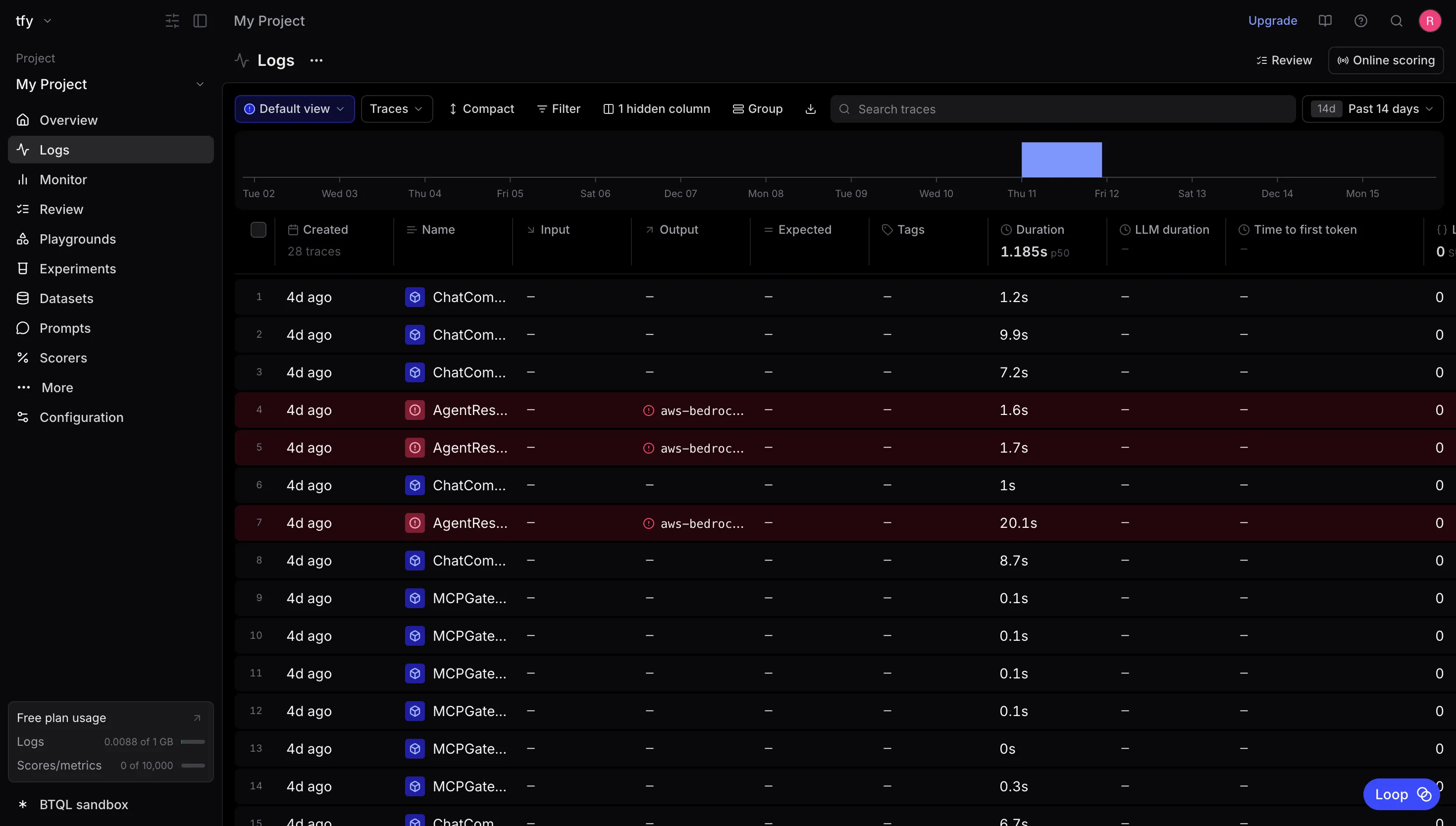

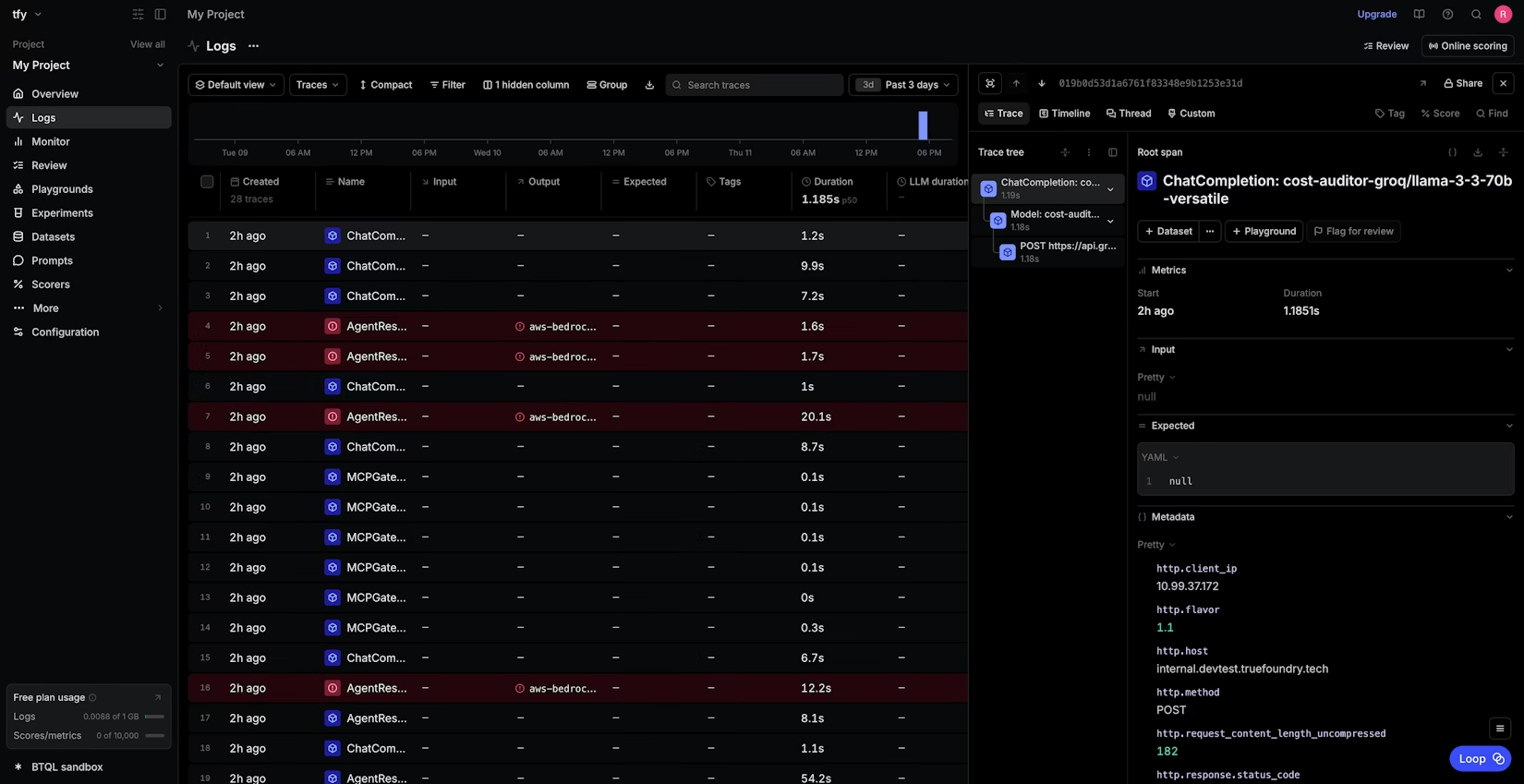

Après avoir enregistré la configuration, toutes les requêtes LLM acheminées via TrueFoundry AI Gateway commenceront à exporter des traces automatiquement, et vous pourrez les consulter dans Braintrust sous les journaux de votre projet.

Conclusion

Les systèmes LLM de production sont intrinsèquement dynamiques : les fournisseurs changent, les instructions évoluent, les graphiques des agents s'agrandissent et le comportement des utilisateurs change. Les équipes qui gagnent ne sont pas celles qui ne cassent jamais rien, mais celles qui peuvent voir ce qui s'est passé rapidement, mesurer l'impact en toute confiance et itérer en toute sécurité.

TrueFoundry AI Gateway fournit un point de contrôle centralisé et une exportation télémétrique basée sur des normes. Braintrust transforme cette télémétrie en un flux de travail d'ingénierie pour le suivi, l'évaluation et l'amélioration continue.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)