TrueFoundry et Cerebras annoncent un partenariat stratégique

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Les entreprises s'efforcent d'opérationnaliser l'IA, mais le trajet entre la validation de concept et la production se trouve souvent coincé entre deux extrêmes : performance brute et discipline opérationnelle. D'une part, vous avez besoin d'une infrastructure capable de gérer les exigences d'échelle et de latence des applications d'IA modernes. D'autre part, vous avez besoin de gouvernance, de sécurité et de contrôles des coûts pour assurer la viabilité de l'entreprise.

Le nouveau partenariat entre Systèmes cérébraux et True Foundry comble cette lacune. Ensemble, ils fournissent une plateforme permettant aux entreprises d'exécuter les modèles les plus avancés du monde à une vitesse sans précédent, tout en garantissant l'observabilité, la gouvernance et la flexibilité.

Cerebras : redéfinir l'inférence de l'IA à grande échelle

Cerebras s'est fait connaître pour avoir repoussé les limites du matériel d'IA et de l'inférence. Grâce à sa technologie Wafer Scale et Inférence cérébrale service, les entreprises obtiennent :

- Vitesse fulgurante : Inférence à des milliers de jetons par seconde, permettant des agents en temps réel, des copilotes de code et des expériences d'IA interactives.

- Éventail des modèles : Prise en charge des principaux LLM actuels, notamment Llama 3.1/3.3, Mistral, Qwen, et même des modèles de raisonnement tels que GPT-OSS-120B.

- Évolutivité : Une feuille de route pour gérer 40 millions de jetons par seconde d'ici fin 2025 via des clusters CS-3 distribués dans le monde entier.

- Efficacité : Coût par requête inférieur à celui d'une infrastructure basée sur le GPU, ce qui rend le déploiement à grande échelle économiquement réalisable.

Pour les entreprises, cela signifie la capacité à enfin livrer produits d'IA à faible latence, des agents conversationnels à la synthèse en temps réel, sans être entravé par le matériel.

Passerelle TrueFoundry AI : gouvernance, flexibilité et fiabilité

Pendant que Cerebras résout le performance problème, TrueFoundry résout le problème opérationnel un. C'est Passerelle IA fait office de plan de contrôle pour l'utilisation de l'IA en entreprise :

- Accès unifié : Une API unique compatible avec OpenAI permettant de se connecter à des milliers de modèles, qu'ils soient hébergés par Cerebras, un autre fournisseur ou sur site.

- Gouvernance et sécurité : Authentification centralisée, RBAC, journaux d'audit et contrôle d'accès précis.

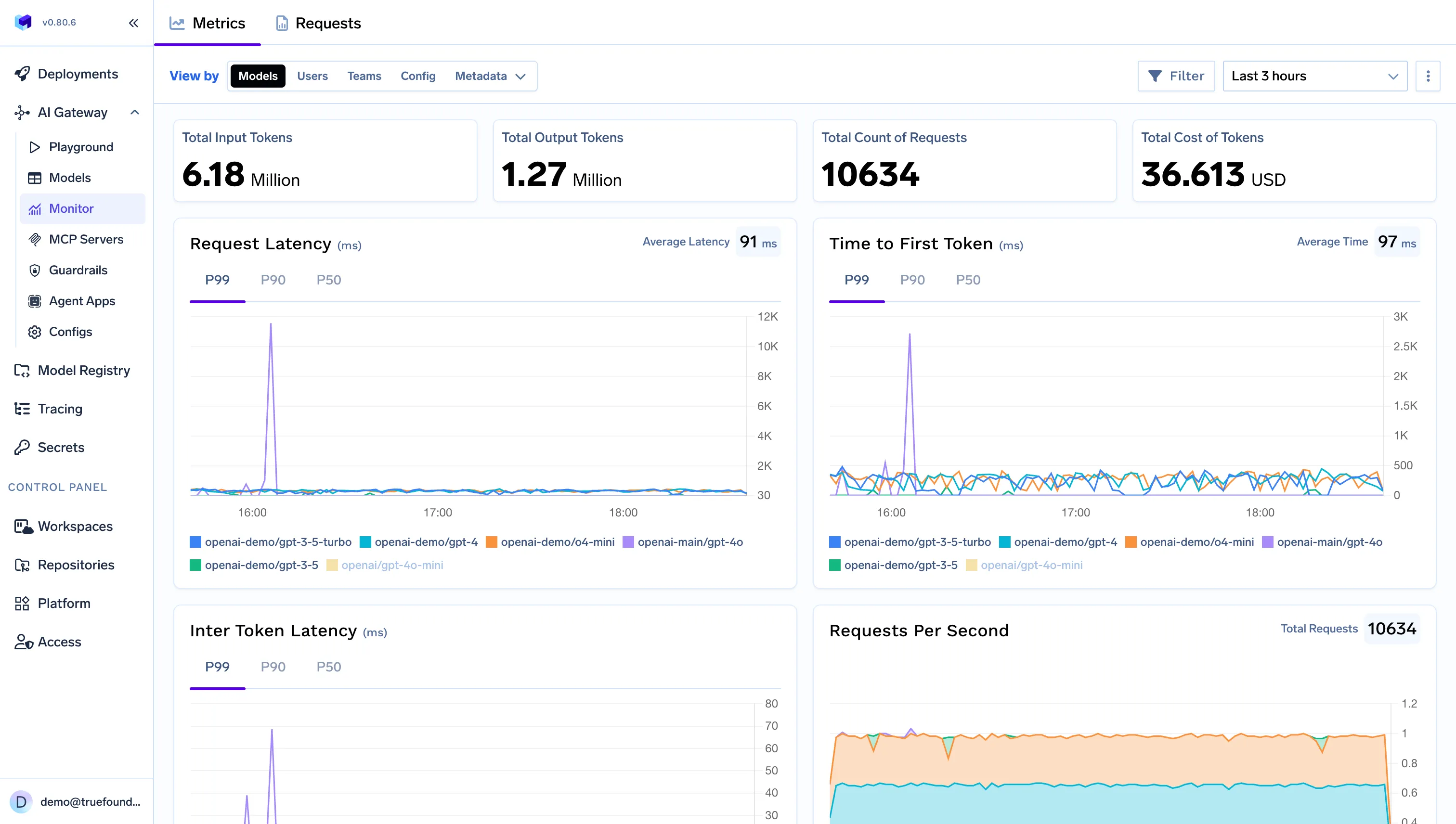

- Observabilité : Des analyses détaillées sur la latence, l'utilisation des jetons, les erreurs et les dépenses, permettant une optimisation basée sur les données.

- Fiabilité : Un routage intelligent, des politiques de repli et un équilibrage de charge pour garantir la disponibilité et les performances même en cas de dégradation d'un fournisseur.

- Flexibilité de déploiement : SaaS, VPC ou sur site, y compris des environnements isolés pour les secteurs hautement réglementés.

En bref, TrueFoundry permet aux entreprises d'étendre l'utilisation de l'IA de manière sûre, visible et prévisible.

Ce que le partenariat permet de débloquer

L'association de Cerebras et TrueFoundry crée un solution complète pour le déploiement de l'IA en entreprise :

- Haute performance + contrôle élevé

Les entreprises n'ont plus à choisir entre une inférence rapide et une gouvernance stricte. Ils obtiennent les deux : Cerebras pour la vitesse, TrueFoundry pour le contrôle. - Adoption fluide par les développeurs

Grâce aux API de style OpenAI de TrueFoundry, les développeurs peuvent intégrer l'inférence de Cerebras avec un minimum de modifications de code, et même passer d'un fournisseur à un autre si nécessaire. - Une flexibilité à l'épreuve du temps

TrueFoundry réduit la dépendance vis-à-vis des fournisseurs. Les entreprises peuvent acheminer les charges de travail entre Cerebras, des modèles open source ou d'autres fournisseurs, en fonction des coûts, de la latence ou des besoins de conformité. - Déploiements prêts à être mis en conformité

Les secteurs réglementés peuvent adopter les performances de pointe de Cerebras dans les configurations VPC ou sur site, sans sacrifier la souveraineté des données. - Temps de rentabilisation accéléré

Une fois l'infrastructure et la gouvernance résolues, les équipes peuvent se concentrer sur créer des produits alimentés par l'IA—des chatbots destinés aux clients, des moteurs de personnalisation, des assistants de santé — plutôt que la plomberie des bâtiments.

Pourquoi c'est important

Ce partenariat marque un changement dans la façon dont les entreprises abordent l'IA. Il ne suffit plus d'exécuter des tests de performance dans des laboratoires ou de mener des projets pilotes au sein d'équipes isolées. Les entreprises ont besoin de :

- Vitesse pour prendre en charge les applications d'IA interactives en temps réel.

- Sûreté pour répondre aux contraintes de conformité et de coûts.

- Flexibilité pour s'adapter à l'évolution des modèles, des fournisseurs et des besoins commerciaux.

Cerebras × TrueFoundry répond à ces trois critères.

Le partenariat Cerebras-TrueFoundry représente bien plus qu'une simple intégration, c'est un plan directeur pour prochaine phase de l'adoption de l'IA en entreprise. En combinant Les performances d'inférence sans précédent de Cerebras avec La passerelle IA de TrueFoundry pour la gouvernance et le contrôle, les entreprises peuvent enfin exécuter des charges de travail d'IA qui sont non seulement puissantes, mais également prêtes pour la production.

Pour les entreprises qui souhaitent intégrer l'IA à des prototypes et à des flux de travail critiques, cette collaboration permet de débloquer la pièce manquante : une plateforme rapide, gouvernée et pérenne.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)