Intégration de TrueFoundry AI Gateway à Last9

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

À mesure que l'IA générative entre dans les parcours utilisateurs critiques, la recherche, l'assistance, l'aide à la décision et l'automatisation, la tolérance à la fiabilité du « meilleur effort » disparaît. Les équipes chargées de la plateforme et du SRE ont désormais besoin du même niveau d'observabilité pour le trafic LLM que celui qu'elles attendent déjà des microservices principaux :

- Quelle est la latence de bout en bout pour chaque chemin de requête ?

- Quels modèles, locataires ou régions génèrent des budgets d'erreur ?

- Comment corréler le comportement du LLM avec le reste de la pile ?

L'intégration entre Passerelle TrueFoundry AI et Les 9 derniers répond exactement à ce problème. En exportant les traces d'OpenTelemetry (OTEL) depuis la passerelle vers Last9, les équipes bénéficient d'une observabilité approfondie et rentable de l'ensemble du trafic LLM, sans réécrire les applications ni disperser les SDK entre les services.

Cet article explique :

- Ce que Last9 et TrueFoundry AI Gateway fournissent

- Comment fonctionne l'intégration au niveau architectural

- Une vue pratique, étape par étape, de la configuration

- Les avantages concrets pour les équipes SRE, plateforme et IA

Last9 : L'observabilité est conçue pour les systèmes à haute cardinalité

Les 9 derniers est une plateforme d'observabilité moderne axée sur la gestion de la télémétrie à haute performance pour les journaux, les métriques et les traces. Il est conçu spécifiquement pour les environnements où la cardinalité et l'échelle ne sont pas négociables

Les principales fonctionnalités pertinentes pour les charges de travail LLM sont les suivantes :

- Gestion de cardinalité élevée : Last9 peut ingérer et interroger des données télémétriques associées à des dimensions détaillées telles que l'utilisateur, le locataire, l'itinéraire, le fournisseur, le modèle et la version rapide, sans perte de performances ni pénalités financières.

- Télémétrie unifiée : les journaux, les métriques et les traces sont regroupés sur une seule plateforme, ce qui permet aux équipes de passer facilement d'une violation du SLO ou d'un pic de latence à la trace et à la durée exactes qui en sont la cause.

- Conception native d'OpenTelemetry : Last9 est construit autour d'OTEL, ce qui facilite l'intégration de tout composant parlant OTEL.

Cela fait Les 9 derniers une solution idéale pour les entreprises qui normalisent l'OTEL dans l'ensemble de leur infrastructure et qui souhaitent intégrer l'observabilité LLM à cette même stratégie.

TrueFoundry AI Gateway : plan de contrôle unifié pour le trafic LLM

Passerelle TrueFoundry AI agit comme une couche proxy entre les applications et les fournisseurs LLM ou les serveurs MCP. Il fournit une interface unifiée compatible avec OpenAI à des centaines de modèles tout en centralisant la gouvernance, la sécurité, le routage et l'observabilité.

Les fonctionnalités de base incluent :

- Accès aux API unifié pour plus de 250 modèles et fournisseurs

- Routage à faible latence et équilibrage de charge sophistiqué

- Sécurité de l'entreprise : RBAC, journalisation des audits, contrôles des quotas et des coûts

- Observabilité native avec enregistrement des requêtes/réponses, métriques et traces

Surtout, AI Gateway peut exporter les traces OTEL vers des systèmes externes, de sorte que votre télémétrie LLM fasse partie de la même structure d'observabilité que le reste de votre infrastructure.

Présentation de l'intégration : comment TrueFoundry et Last9 fonctionnent ensemble

À un niveau élevé, l'intégration est simple :

- Les applications envoient tout le trafic LLM à TrueFoundry AI Gateway plutôt que directement aux fournisseurs de modèles.

- AI Gateway achemine la demande vers le modèle configuré (OpenAI, Claude, Gemini, auto-hébergé, etc.), en appliquant le routage, les limites de débit et les garde-fous selon les besoins.

- Pour chaque demande, AI Gateway émet des traces OpenTelemetry qui capturent les spans pour la gestion de la passerelle, les appels de modèles sortants, les opérations MCP, etc.

- Ces traces OTEL sont exportées via HTTP vers le point de terminaison OTLP de Last9.

- Dans Last9, les traces sont visualisées dans l'interface utilisateur de Traces, avec des cartes thermiques de durée, des listes de traces détaillées et des données au niveau de la période pour

passerelle tfy-llmservice.

Aucune modification de code n'a été apportée à la logique de l'application. Une fois l'exportateur OTEL de la passerelle configuré, chaque demande LLM devient automatiquement observable dans Last9.

Prérequis

Pour activer l'intégration, vous aurez besoin des éléments suivants :

- Compte TrueFoundry avec AI Gateway configuré et au moins un fournisseur de modèles configuré. Vous pouvez suivre le Gateway Guide de démarrage rapide dans la documentation TrueFoundry.

- Compte Last9 avec accès au tableau de bord Last9.

Une fois ceux-ci en place, le reste de la configuration se fait entièrement via les interfaces utilisateur respectives.

Guide d'intégration étape par étape

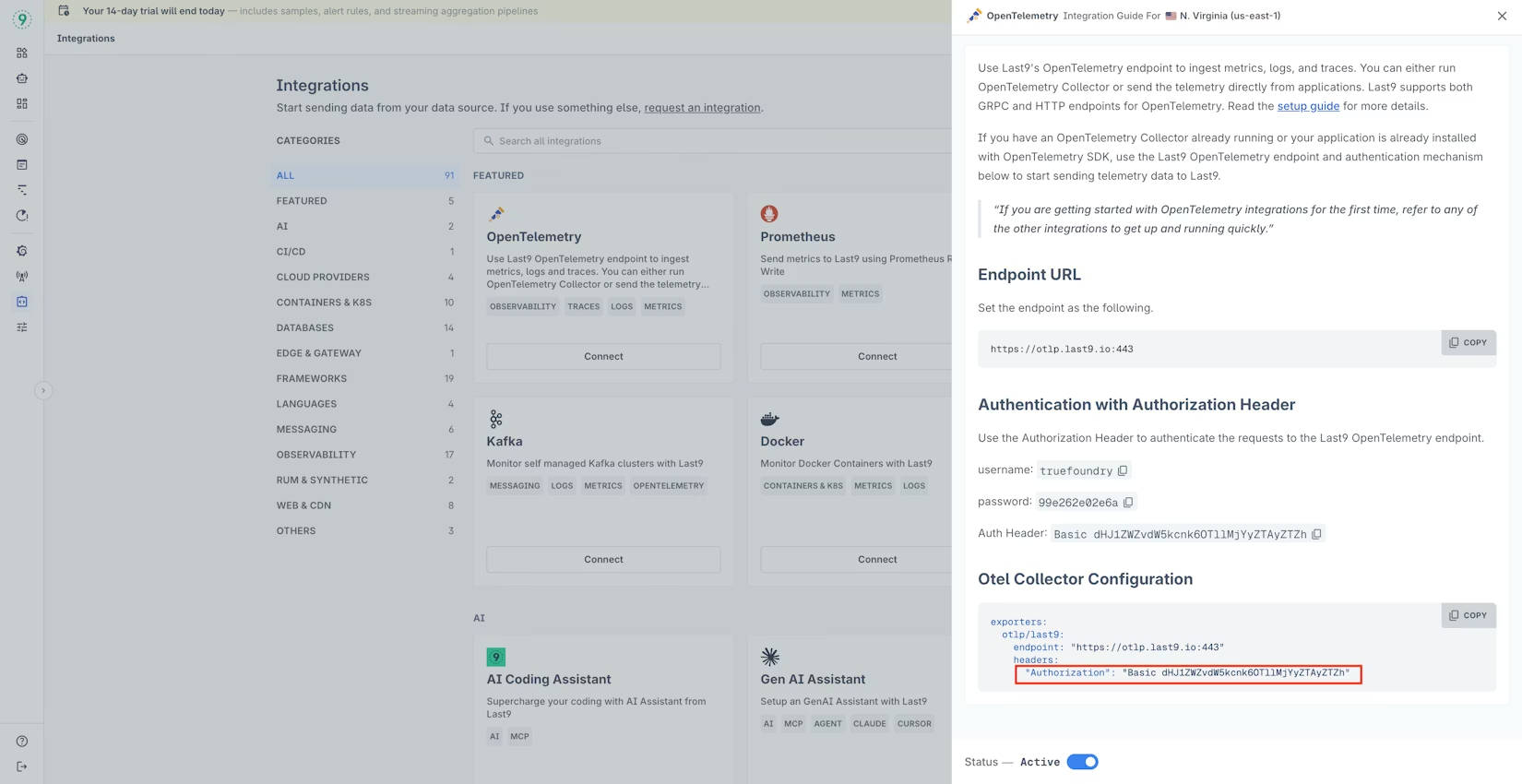

1. Récupérez l'en-tête d'autorisation Last9

Depuis le tableau de bord Last9 :

- Connectez-vous à Last9.

- Accédez à Intégrations dans la barre latérale gauche.

- Cliquez sur Connecter sur la carte d'intégration OpenTelemetry.

- Dans le guide d'intégration, recherchez « Authentification avec en-tête d'autorisation ».

- Copiez la valeur d'en-tête Auth fournie, qui est déjà formatée, par exemple :

De base DHJ1ZWZVDW5KCNK6...

Cet en-tête sera transmis directement de TrueFoundry à Last9 pour l'authentification OTEL.

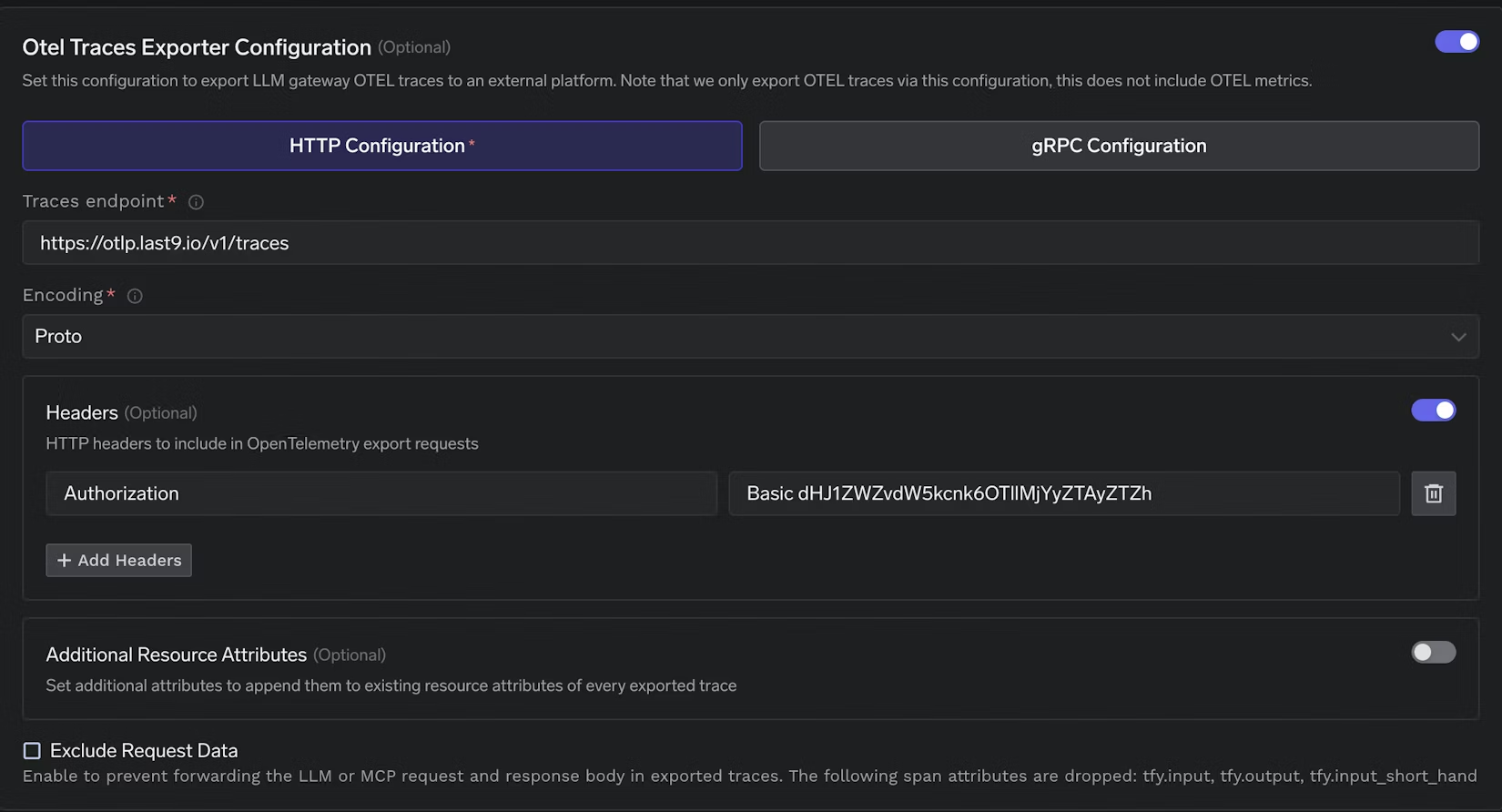

2. Configurer l'exportation OTEL dans TrueFoundry AI Gateway

Dans la console TrueFoundry :

- Accédez à AI Gateway → Contrôles → OTEL Config.

- Activez le bouton de configuration de l'exportateur Otel Traces.

- Sélectionnez l'onglet Configuration HTTP.

3. Définissez le dernier point de terminaison OTLP des 9 derniers

Dans Configuration HTTP, indiquez les valeurs suivantes :

- Traces le point final

https://otlp.last9.io/v1/traces- Encodage

Proto

Il s'agit du point de terminaison d'ingestion OTLP de Last9 pour les traces.

4. Ajouter l'en-tête d'autorisation requise

Dans le même écran de configuration, cliquez sur « + Ajouter des en-têtes » et ajoutez : Collez l'en-tête d'authentification exactement tel qu'il a été copié depuis l'interface utilisateur Last9 (par exemple, Basic DHJ1ZWZVDW5KCNK6...). Aucune mise en forme supplémentaire n'est requise.

5. Enregistrez la configuration

Cliquez sur Enregistrer pour appliquer les paramètres d'exportation de l'OTEL. À partir de ce moment, toutes les traces LLM de la passerelle TrueFoundry AI seront exportées vers Last9.

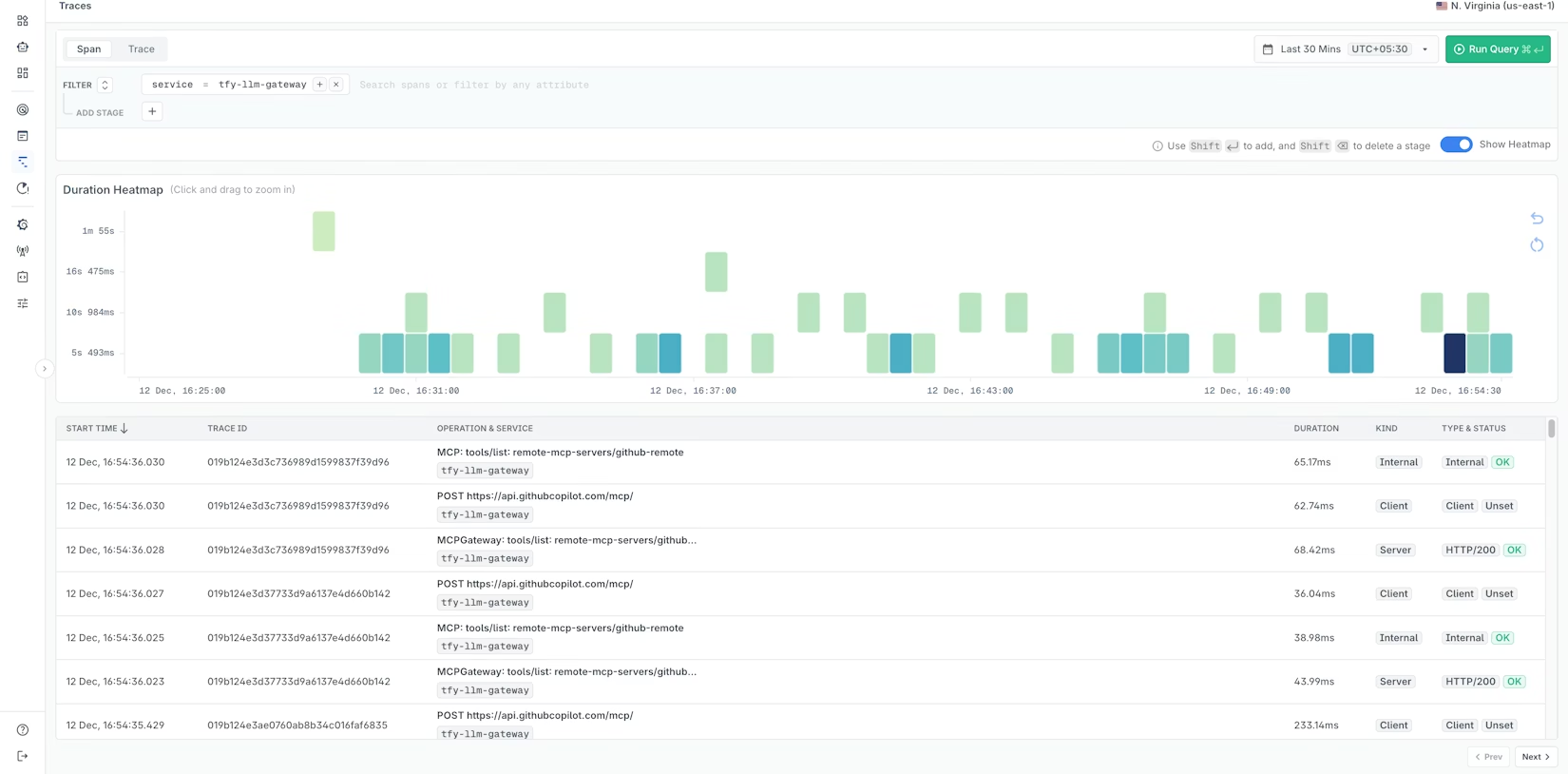

6. Afficher les traces LLM dans Last9

Une fois que le trafic LLM passe par la passerelle, ouvrez le tableau de bord Last9 :

- Accédez à la section Traces.

- Filtrer par nom de service :

passerelle tfy-llm- Explorez :

- Carte thermique de la durée : visualisez les tendances de latence et les valeurs aberrantes au fil du temps.

- Détails des traces : consultez les traces individuelles avec les noms des opérations, les durées et les codes d'état.

- Informations sur les spans : inspectez les spans pour les appels HTTP, les opérations MCP et les requêtes LLM sous-jacentes.

Cela vous donne une vue de bout en bout de la façon dont le Gateway et les fournisseurs en aval se comportent dans des conditions de production réelles.

Configuration avancée : enrichissement des traces avec des attributs de ressources

La configuration OTEL de TrueFoundry prend en charge des attributs de ressources supplémentaires, ce qui vous permet d'associer des métadonnées personnalisées à chaque trace exportée. Ceci est particulièrement puissant lorsqu'il est combiné aux capacités de haute cardinalité de Last9.

Les attributs typiques que vous souhaiterez peut-être ajouter sont les suivants :

env=prod,env=mise en scèneregion=us-est-1,region=eu-ouest-1team=platform,team=searchtenant_id=entreprise-client-a

Dans Last9, ces attributs peuvent être utilisés pour :

- Comparez les taux de latence ou d'erreur entre les régions et les environnements

- Isolez les incidents ayant un impact sur un locataire ou une surface de produit spécifique

- Créez des tableaux de bord par équipe ou unité commerciale sans dupliquer la télémétrie

En planifiant votre stratégie attributaire à l'avance, vous pouvez accéder à des requêtes plus riches et à une analyse plus rapide des causes premières par la suite.

Ce que cette intégration apporte à vos équipes

Pour le SRE et l'ingénierie des plateformes

- Visibilité de niveau production sur le trafic LLM : identifiez les pics de latence, les points d'erreur et la saturation en temps réel, avec un contexte de suivi complet pour chaque événement.

- Réponse plus rapide aux incidents : passez d'un SLO défaillant à la trace et à l'étendue précises qui en sont la cause, qu'il s'agisse d'un service en amont, d'un fournisseur de modèles spécifique ou d'un itinéraire mal configuré.

- Outils cohérents : maintenez l'observabilité LLM dans les mêmes flux de travail et tableaux de bord basés sur Otel que vous utilisez pour le reste de vos microservices.

Pour les équipes d'IA et d'application

- Expérimentez en toute sécurité avec des modèles et des instructions : déployez de nouvelles versions de modèles, de nouvelles règles de routage ou des stratégies rapides via TrueFoundry, et observez l'impact directement dans les traces et les cartes thermiques de Last9.

- Sensibilisation aux performances et aux coûts : corrélez les interactions lentes ou défaillantes avec des itinéraires, des locataires ou des modèles spécifiques, et intégrez ces informations aux politiques de routage et de mise en cache de la passerelle.

- Séparation plus claire des préoccupations : les développeurs se concentrent sur la logique des applications et le comportement des agents ; Gateway et Last9 gèrent conjointement le routage, la gouvernance et l'observabilité.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)