The Messy Middle : survivre à la transition d'un SVI basé sur des règles vers des systèmes agentiques

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

1. Le problème de la transition : pourquoi les anciens systèmes échouent et pourquoi les LLM ne sont pas « encore là »

Depuis des décennies, les entreprises s'appuient sur systèmes de réponse vocale interactive (IVR) basés sur des règles pour gérer les appels des clients. Ces systèmes ont été conçus pour être efficaces : rediriger les appelants dans les menus, reconnaître une poignée de mots clés et les rediriger vers la bonne équipe ou le bon script. À petite échelle, cela a fonctionné. Mais dans une entreprise qui gère des centaines de millions d'appels par an, ces limites deviennent terriblement claires. Les clients ne suivent pas les scripts. Ils parlent dans un langage naturel, fluide et imprévisible, parfois émotif, parfois technique, parfois impatient. Les systèmes basés sur des règles n'ont tout simplement pas été conçus pour gérer des demandes aussi diverses.

Le résultat ? Taux d'abandon d'appels élevés, clients frustrés et atteinte importante à la marque. Les entreprises qui tentent d'intégrer les conversations humaines dans des arbres de décision rigides se retrouvent avec des temps de résolution plus longs, des taux de transfert d'agents plus élevés et des coûts opérationnels en hausse. Pire encore, l'expérience client en pâtit, ce qui se répercute directement sur la fidélisation et les revenus. Les analyses du secteur ont indiqué qu'en 2021, la note Csat globale du IVR en libre-service était de 75 %, et que la note globale de IVR Navigation n'était que de 53 % ! [lien]

Contrairement aux systèmes basés sur des règles, Systèmes Agentic basés sur LLM peut analyser l'intention, s'adapter au contexte et répondre dans un langage naturel semblable à celui d'un humain. En théorie, ils peuvent gérer la fluidité de conversations réelles à grande échelle. Ils représentent le changement tant attendu : il ne s'agit pas seulement d'automatiser le routage des appels, mais aussi d'impliquer les clients d'une manière personnalisée et empathique.

Mais le problème est: les LLM prêts à l'emploi ne sont pas formés aux processus opérationnels spécifiques au secteur des grandes entreprises, et ils ne sont pas non plus renforcés pour répondre aux normes professionnelles en matière de confidentialité, de fiabilité et de déploiement des données. Malgré leurs promesses, les LLM actuels présentent toujours des modes de défaillance qui inquiètent les DSI et les responsables de la conformité. Ils peuvent « halluciner » les réponses, mal interpréter les questions sensibles à la réglementation ou changer de ton d'une interaction à l'autre. La fiabilité, la cohérence et la conformité, des éléments non négociables pour une équipe de service client du Fortune 500, ne peuvent pas encore être garanties.

Cela laisse les entreprises bloquées dans le problème de transition: L'ancien système pouvait techniquement gérer le volume d'appels, mais cela se traduit par un grand nombre de clients insatisfaits en raison de cas d'utilisation mal pris en charge et des attentes croissantes des utilisateurs modernes. Dans le même temps, les nouveaux systèmes, bien que mieux adaptés aux besoins actuels des utilisateurs, ne sont pas encore suffisamment fiables pour remplacer complètement les anciens.

Pour les leaders technologiques, ce moment est marqué par une tension délicate : s'appuyer trop sur les systèmes existants et risquer de susciter un mécontentement croissant des clients ; adopter des LLM trop rapidement et risquer des erreurs coûteuses qui érodent la confiance.

2. Pourquoi les entreprises ne peuvent pas attendre : le coût de l'inaction et l'urgence de l'adoption de l'IA

Pour de nombreux dirigeants, le choix le plus sûr peut sembler être en attendant que les LLM « arrivent à maturité ». Mais dans la pratique, ce n'est pas une option. Les pressions concurrentielles sont trop fortes et le coût de l'inaction est élevé.

Tout d'abord, les attentes des clients ont évolué de manière irréversible. Les consommateurs interagissent quotidiennement avec des chatbots, des assistants intelligents et des moteurs de recommandation alimentés par l'IA. Lorsqu'ils font appel à une entreprise d'un milliard de dollars, ils attendent le même niveau de fluidité, de personnalisation et de réactivité de leurs expériences IVR. Offrir moins semble dépassé. Dans des secteurs tels que la banque, l'assurance et les télécommunications, cet écart n'est pas seulement gênant, il suffit à pousser les clients vers des concurrents qui investissent déjà dans l'IA.

Deuxièmement, l'économie des centres d'appels est brutale. Manipulation 500 millions d'appels par an avec des agents humains uniquement, c'est impossible. Même des gains d'efficacité supplémentaires se traduisent par des dizaines de millions d'économies par an. Ne pas adopter l'IA dès maintenant ne signifie pas simplement rester à la traîne, cela signifie également bloquer des structures de coûts inutiles qui érodent les marges.

Troisièmement, les concurrents se déplacent. Dans tous les secteurs, nous voyons déjà des leaders du marché expérimenter une expérience client basée sur l'IA. Certains peuvent trébucher, mais le signal envoyé aux clients et aux investisseurs est clair : l'innovation est en train de se produire et les marques leaders grâce à l'IA vont se démarquer. Le fait de rester sur la touche risque non seulement de perdre des clients, mais également de nuire à votre réputation en tant que personne « lente à adopter ».

Enfin, il y a courbe d'apprentissage organisationnelle. Déployer l'IA de manière responsable dans un environnement du Fortune 500 prend du temps : aligner les équipes juridiques, former le personnel, intégrer les systèmes existants, mettre en place des cadres d'observabilité. Ces fonctionnalités ne peuvent pas être activées du jour au lendemain. Même si les LLM deviennent totalement fiables demain, les entreprises qui n'ont pas encore réussi à adopter l'IA auront des années de retard.

Bref, les entreprises ne peuvent pas se permettre d'attendre. Les risques liés à l'inaction (hausse des coûts, perte de clients, baisse de compétitivité) l'emportent largement sur les risques d'une adoption gérée avec soin. Le défi n'est pas de savoir s'il faut adopter, mais comment adopter de manière responsable pendant une période difficile.

3. Cas d'utilisation réel : trouver un équilibre entre les LLM et les systèmes basés sur des règles

Reconnaissant que ni les IVR basés sur des règles ni les solutions standard alimentées par le LLM ne pouvaient à eux seuls répondre aux besoins d'une entreprise du Fortune 500, TrueFoundry a travaillé avec l'une des plus grandes chaînes de pharmacies des États-Unis pour concevoir un agent Voice AI hybride. L'objectif était ambitieux : reproduire l'efficacité d'un pharmacien humain qualifié lors de millions d'appels de routine portant sur l'état des ordonnances, les renouvellements, les informations sur les magasins, les contrôles d'inventaire et autres besoins quotidiens des clients.

Au cœur de ce design se trouve un approche d'optimisation hybride: combinaison des efficacité des systèmes déterministes basés sur des règles avec le flexibilité des conversations pilotées par l'IA. Les requêtes courantes et répétitives, telles que la vérification des heures d'ouverture des magasins ou les recharges prêtes à être ramassées, sont acheminées via traitement rapide basé sur des règles. Cela gère 90 à 95 % des demandes de routine, en évitant les appels LLM inutiles, en réduisant la latence et en abaissant les coûts de calcul.

Lorsqu'un client présente une demande plus complexe ou ambiguë, système de routage intelligent prend le relais. En utilisant classificateurs de reconnaissance d'intention qui prend également en compte le contexte d'arrière-plan, ajouté automatiquement à la demande du client lors d'une conversation précédente, le gestionnaire d'intentions détermine si la demande peut être résolue par des règles ou doit être transmise à un flux conversationnel alimenté par LLM. Cela garantit le juste équilibre : des réponses prévisibles lorsque la précision est importante et des interactions naturelles où la flexibilité est essentielle.

Pour des interactions nuancées, comme le remplissage, l'accélération et l'annulation des flux, nous avons créé des agents conversationnels en utilisant LangGraph. Ces agents s'intègrent aux systèmes backend via appel d'outils, leur permettant de traiter en toute sécurité les demandes de recharge en temps réel. Les clients peuvent demander naturellement (« Pouvez-vous accélérer ma recharge ? ») , et le système interprète l'intention tout en exécutant les actions de backend nécessaires.

Pour conserver une atmosphère humaine même pendant les opérations de backend, nous avons mis en œuvre réponses au texte de remplissage (« Veuillez patienter un moment pendant que je récupère vos coordonnées »). Ces touches subtiles renforcent la confiance des clients en donnant au système une impression de réactivité plutôt que de robotique.

La solution étant destinée aux pharmacies, la précision de l'interprétation des ordonnances n'était pas négociable. Nous avons intégré modèles de synthèse vocale spécifiques à l'industrie adapté au vocabulaire pharmaceutique, garantissant une reconnaissance correcte des noms de médicaments complexes. Cela réduit considérablement les erreurs de transcription qui pourraient autrement frustrer les clients ou mettre en danger la sécurité des patients.

Toutes les interactions LLM sont canalisées via un service de passerelle soutenu par un service de gestion rapide. Cela permet une gestion centralisée des instructions et des garanties réponses cohérentes et préconfigurées conformes à la fois aux exigences réglementaires et à la voix de la marque. Les mises à jour peuvent être déployées rapidement sans toucher à des dizaines de services, ce qui permet de maintenir la souplesse du système tout en garantissant la conformité.

Pour garantir l'expérience client, l'agent Voice AI inclut analyse des sentiments en temps réel. Si de la frustration ou de l'insatisfaction est détectée, comme des réponses négatives répétées ou une augmentation de l'intensité émotionnelle, le système peut déclencher une escalade vers un agent humain. Cela garantit que les situations sensibles sont traitées avec empathie, évitant ainsi que les expériences négatives des clients ne s'enveniment.

Surveillance des performances est géré par Analytics AI, un service d'agence conçu pour analyser les événements provenant de l'ensemble du système. Il améliore le fonctionnement de l'entreprise en :

- Évaluation des tendances des sentiments dans des millions de conversations pour détecter les clients frustrés ou insatisfaits.

- Génération automatique de requêtes SQL dans tous les domaines d'activité (opérations pharmaceutiques, inventaire, indicateurs des centres d'appels).

- Requêtes de routage intelligemment vers le bon ensemble de données pour effectuer une analyse spécifique à une catégorie.

- Mesurer les performances en matière de niveau de service, en mettant en évidence les points faibles ou les goulots d'étranglement émergents.

Cela permet de boucler la boucle entre la technologie et les affaires, en fournissant à la fois de la transparence et des informations exploitables.

Le système est déjà utilisé dans environ 2 000 des 10 000 magasins, au service de milliers de clients chaque jour. Le modèle hybride garantit l'évolutivité sans compromettre la confiance : les LLM améliorent les interactions avec les clients lorsque cela est nécessaire, tandis que les règles garantissent fiabilité et rapidité dans la majorité des cas. Les premiers déploiements montrent des améliorations significatives en termes d'efficacité, de résolution des appels et de satisfaction client.

Bref, le design hybride n'est pas un compromis, c'est un pont stratégique. Elle permet aux entreprises d'adopter l'IA de manière responsable dès aujourd'hui, tout en ouvrant la voie à un avenir où les LLM pourraient assumer une part encore plus importante de la charge.

4. Les compromis : transparence en matière de complexité et de maintenance

Si l'approche hybride de l'IA vocale résout le problème de transition, elle introduit également son propre ensemble de compromis. Pour les entreprises qui gèrent des centaines de millions d'appels clients, ces compromis ne sont pas des détails mineurs : ils influent sur le coût total de possession, l'état de préparation de l'organisation et la durabilité à long terme.

1. Complexité architecturale accrue

Dans un système purement basé sur des règles, la logique est déterministe et relativement simple à tracer. Dans un système LLM pur, l'architecture pourrait, en théorie, être simplifiée pour inclure un moteur conversationnel et des intégrations de backend. UNE Un système hybride nécessite toutefois les deux. Cela implique de maintenir des infrastructures parallèles :

- Des flux déterministes pour la grande majorité des requêtes courantes.

- Des flux pilotés par l'IA pour des interactions nuancées et à forte valeur ajoutée.

- Une couche de routage intelligente qui décide du chemin à activer.

L'avantage est la flexibilité et la résilience, mais le compromis est un architecture plus complexe qui nécessite des équipes interfonctionnelles pour concevoir, surveiller et ajuster en permanence.

2. Charge de maintenance plus élevée

Les IVR traditionnels nécessitent des mises à jour de script occasionnelles. En revanche, un système hybride nécessite maintenance continue sur plusieurs fronts:

- Reconversion des classificateurs : Préserver la précision des modèles de routage à mesure que de nouveaux modèles d'appels apparaissent.

- Modèles spécifiques à un domaine : Maintien de moteurs de synthèse vocale adaptés au vocabulaire pharmaceutique ou à d'autres besoins de l'industrie.

- Surveillance des canalisations : S'assurer que les outils de surveillance capturent les bons événements et fournissent des informations exploitables.

Cela introduit de nouveaux rythmes de maintenance plus proches de gestion du cycle de vie des produits logiciels par rapport au support téléphonique traditionnel.

3. Rapport coût-efficacité par rapport à l'équilibre des performances

Alors que les voies rapides basées sur des règles restent 90 à 95 % des appels à intention simple et ciblée sont efficaces, l'hybride entraîne toujours des coûts liés à :

- Exécution de LLM pour des flux complexes.

- Exploiter des infrastructures doubles.

- Investir dans des systèmes de surveillance et d'analyse spécialisés.

Les entreprises doivent déterminer si amélioration de l'expérience client justifie le coût supplémentaire. Dans de nombreux cas, c'est le cas, mais le calcul du retour sur investissement dépend des marges du secteur, risques réglementaires, et les attentes des clients.

4. La complexité de la gouvernance et de la conformité

Les entreprises, en particulier dans les secteurs de la santé, de la banque et de l'assurance, doivent appliquer une stricte conformité. Un système hybride introduit davantage de pièces mobiles :

- Les réponses basées sur des règles garantissent la conformité dès la conception.

- Les flux basés sur LLM nécessitent garde-corps, audit et surveillance en temps réel pour des hallucinations ou un langage non conforme à la marque.

- Le routage intelligent doit faire ses preuves explicabilité: pourquoi un appel donné a-t-il été envoyé à un LLM plutôt qu'à une règle ?

Cela augmente la complexité de la gouvernance mais offre également une opportunité : le système hybride peut être instrumenté pour une plus grande transparence plutôt que l'une ou l'autre approche prise isolément.

5. Changement de compétences organisationnelles

Enfin, l'adoption hybride nécessite de nouvelles compétences. Les entreprises ont besoin non seulement de concepteurs IVR, mais également de :

- Scientifiques des données pour les classificateurs de routage.

- Des ingénieurs rapides pour les flux LLM.

- Des équipes opérationnelles basées sur l'IA pour gérer la surveillance en temps réel, l'analyse des sentiments et les déclencheurs d'escalade.

Ce transfert de talents est une considération non négligeable pour les entreprises dont les équipes informatiques des centres d'appels sont déjà en place.

L'essentiel

L'approche hybride de l'IA vocale ne consiste pas à « configurer et oublier ». Il s'agit d'un système vivant qui exige une conception minutieuse, une surveillance continue et des investissements organisationnels. La récompense est un pont résilient qui permet aux entreprises de tirer parti de l'IA sans sacrifier la fiabilité. Mais le compromis est réel : une complexité accrue, une maintenance accrue et des besoins de gouvernance continus.

Pour les dirigeants qui prennent des décisions aujourd'hui, il est essentiel de reconnaître ouvertement ces compromis pour renforcer la confiance entre les parties prenantes techniques, opérationnelles et de conformité.

5. Perspectives d'avenir — Équilibrer les courbes de l'ancien et du nouveau

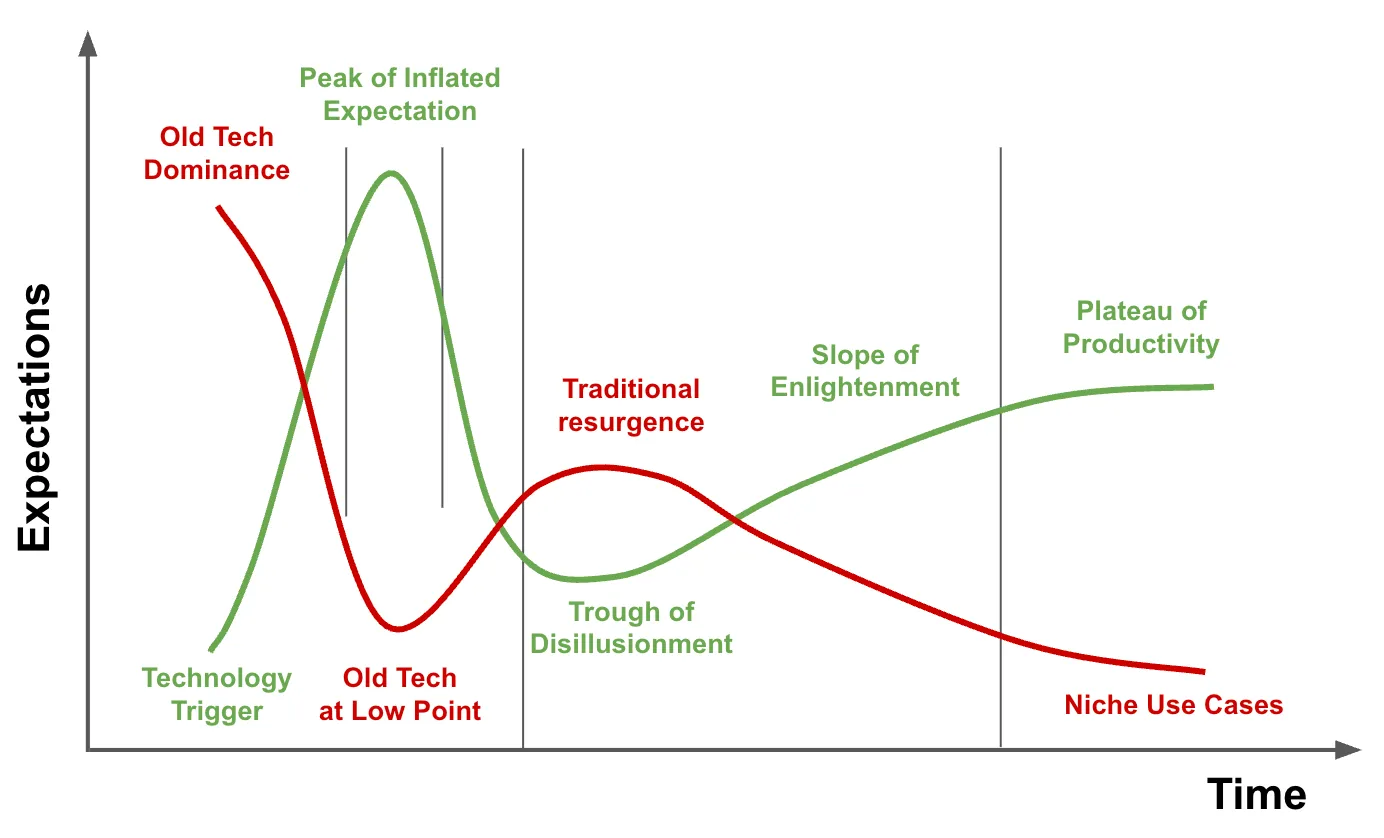

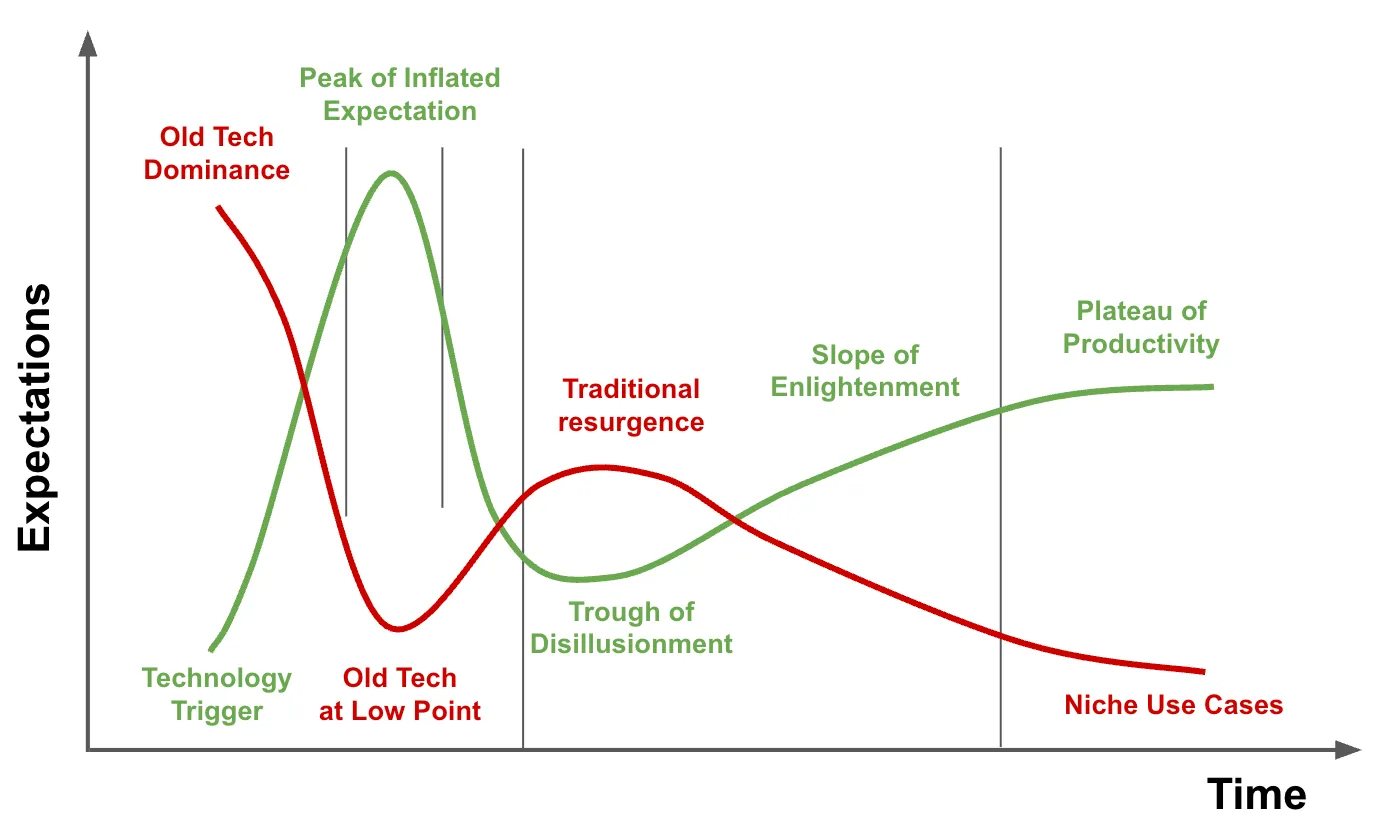

L'évolution des technologies d'interaction avec les clients ne suit pas une ligne droite, elle suit des cycles. Les nouvelles innovations sont très prometteuses, connaissent des revers inévitables et finissent par trouver leur place dans la boîte à outils de l'entreprise. Dans le même temps, les technologies traditionnelles ne disparaissent pas tout simplement; ils corrigent, stabilisent et continuent de créer de la valeur dans des créneaux où leurs atouts sont inégalés.

Une façon d'y penser est de étendre le cycle Hype de Gartner, qui montre comment les nouvelles technologies passent du stade de « déclencheur de l'innovation » au « pic des attentes exagérées », au « creux de la désillusion » et, finalement, au « plateau de productivité ». À côté de cette courbe, on peut dessiner une image miroir : la courbe de « survie » technologique traditionnelle.

- Au plus fort des attentes exagérées :

Lorsque l'engouement pour les nouvelles technologies augmente, l'ancienne est prématurément déclarée obsolète. Dans notre espace, cela se passe avec IVR basés sur des règles. Le battage médiatique autour de l'IA conversationnelle a donné l'impression que les flux d'appels déterministes ne sont déjà pas pertinents, même s'ils restent très efficaces pour des tâches prévisibles et répétitives. - Au creux de la désillusion :

À mesure que les limites de la nouvelle technologie deviennent évidentes (coûts élevés, écarts de fiabilité, risques de conformité), les systèmes traditionnels connaissent souvent une résurgence. Les entreprises redécouvrent la stabilité et la prévisibilité des systèmes basés sur des règles, en appréciant leur rentabilité et précision. Au cours de cette phase, les organisations s'appuient davantage sur les hybrides pour stabiliser leurs opérations tout en continuant à expérimenter l'IA. - Au plateau de productivité :

Finalement, la nouvelle technologie arrive à maturité, ses cas d'utilisation sont bien compris et les cadres de déploiement la rendent sûre et évolutive. À ce stade, le l'ancienne technologie ne disparaît pas, mais il devient très des cas d'utilisation spécifiques et incontestés. Pour l'IVR, cela signifie que les règles resteront le meilleur outil lorsque la conformité exige un contrôle absolu de la formulation, ou lorsque le coût d'une mauvaise interprétation, même mineure, est inacceptable.

Figure 1 : Cycle d'engouement pour les nouvelles technologies et résistance des anciennes technologies

Où en sommes-nous aujourd'hui

Selon la plupart des indicateurs, Les agents vocaux pilotés par l'IA approchent toujours du pic des attentes exagérées. Les entreprises sont enthousiasmées par leur potentiel de transformation, mais elles commencent également à prendre conscience de leur fragilité à grande échelle. La vérité est que nous sommes toujours dans processus visant à trouver le bon équilibre: où l'IA améliore l'expérience et où les règles fournissent des garde-fous.

Cet équilibre n'est pas un compromis ; c'est un pont stratégique traversant les courbes. En adoptant dès maintenant des approches hybrides, les entreprises se positionnent de manière à tirer parti des avantages de l'innovation en matière d'IA sans renoncer à la fiabilité de systèmes éprouvés. Au fil du temps, à mesure que l'IA atteindra son plateau de productivité, le rôle de l'IVR traditionnel diminuera, mais il ne disparaîtra jamais : il persistera dans ces des contextes de niche critiques où la prévisibilité reste reine.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)