Alternatives à l'IA robotique : les 6 meilleurs outils que vous pouvez envisager en 2026

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Aujourd'hui, créer des IA ne se limite pas à déterminer le modèle que vous souhaitez utiliser.

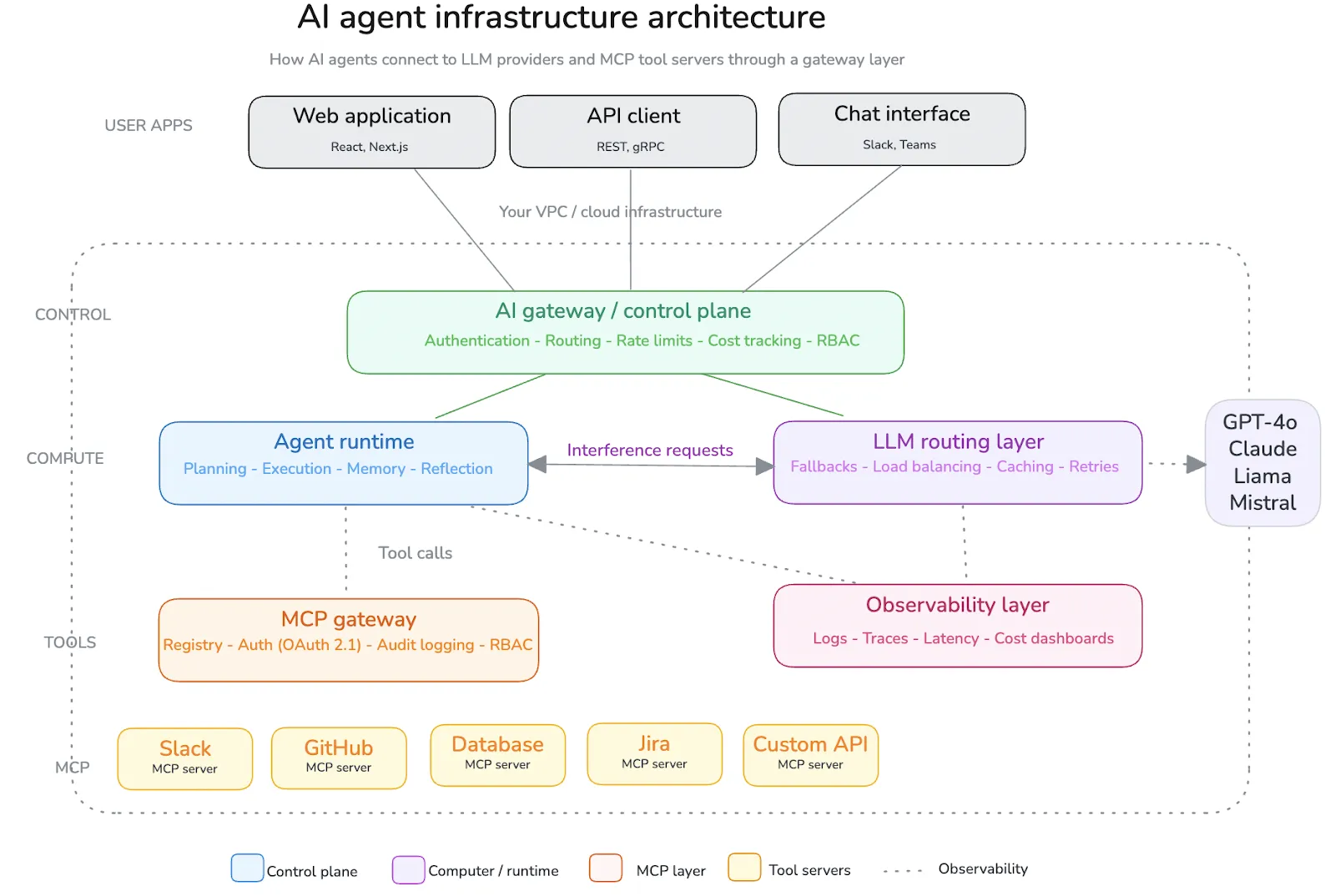

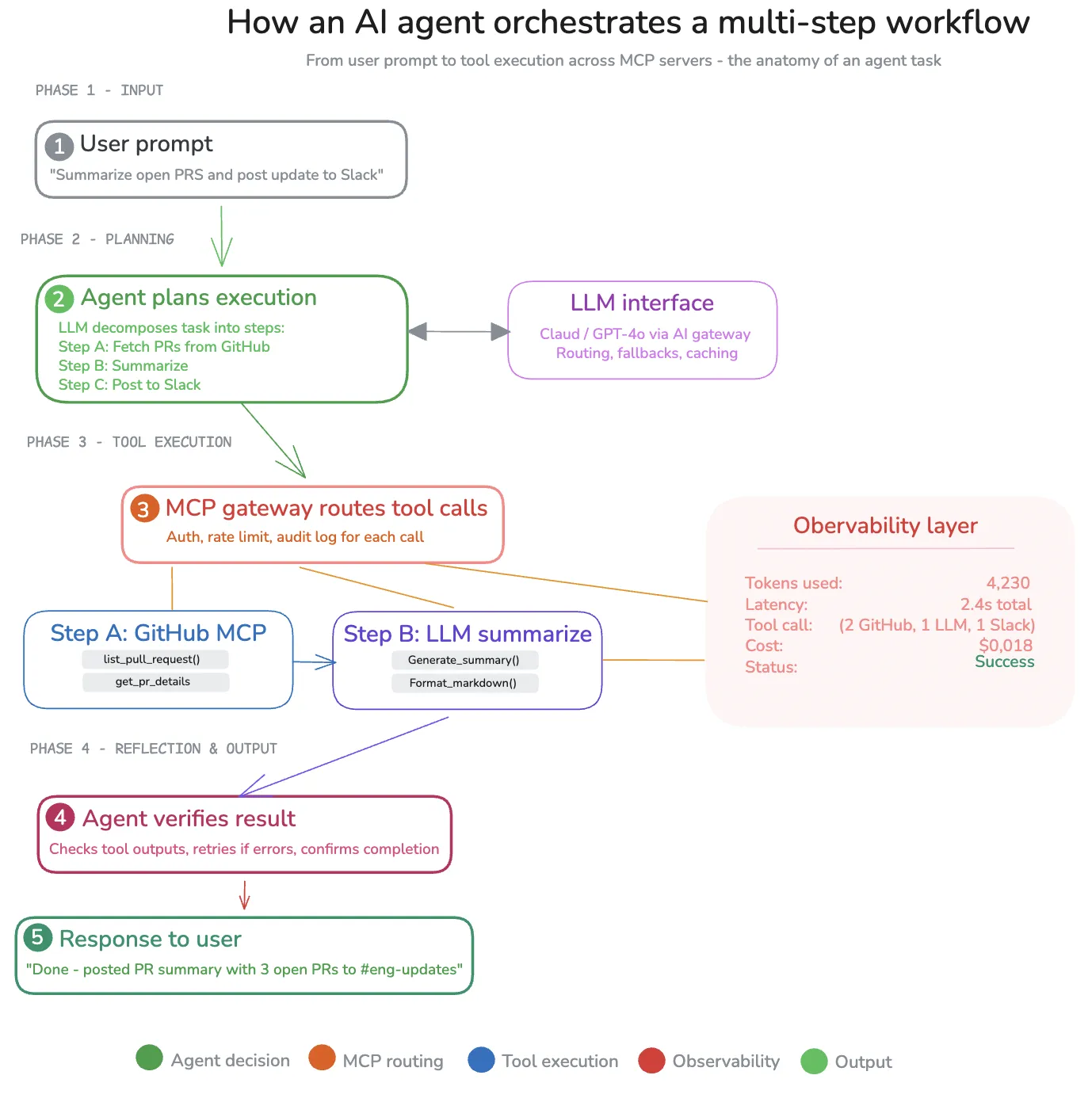

La création d'agents d'IA comporte plusieurs éléments, à savoir la connexion aux différents outils, la gestion des accès, le suivi de l'utilisation et la prévention des pannes une fois en production ; c'est là que les équipes tirent parti de services tels que MCP, et des exemples plus récents seraient Obot AI.

Obot AI fournit un cadre open source structuré pour aider les équipes à gérer leur infrastructure MCP (Model Context Protocol) ; cela est efficace pour la gouvernance des outils.

Cependant, au fur et à mesure que les équipes passent à la production, leurs exigences augmentent souvent, notamment en termes d'observabilité accrue, de capacité à travailler avec plusieurs modèles ou de contrôler le déploiement et la sécurité du modèle.

C'est généralement à ce moment-là que les équipes commencent à explorer Obot AI alternatives. Dans ce guide, nous allons passer en revue les meilleures options en 2026, afin que vous puissiez trouver celle qui correspond le mieux à votre infrastructure technologique.

Qu'est-ce qu'Obot AI ?

Obot AI, anciennement connu sous le nom d'Acorn Labs, fournit une plate-forme open source permettant aux entreprises de gérer leurs systèmes basés sur le protocole MCP (Model Context Protocol).

Les fonctionnalités de base d'Obot AI sont les suivantes :

- Hébergement MCP

- Registre MCP

- Passerelle MCP

- Client de chat conforme à la norme MCP

La passerelle MCP fait office de point de contrôle centralisé où les équipes informatiques peuvent intégrer, gérer et surveiller les serveurs MCP à l'aide d'une interface utilisateur administrative (UI) moderne ou via un flux de travail basé sur Gitops, y compris en maintenant une piste d'audit complète de chaque action entreprise en relation avec un serveur MCP.

Obot AI peut être déployé pour s'auto-héberger sur Docker ou Kubernetes, ce qui permet aux utilisateurs de conserver un contrôle et une souveraineté complets sur leurs données et leur infrastructure.

Pourquoi les équipes recherchent-elles des alternatives à l'IA robotisée ?

Bien qu'Obot AI constitue une base solide pour la gestion des serveurs MCP, les équipes qui souhaitent utiliser plus largement leur infrastructure d'IA présentent des limites.

- Concentration étroite sur le MCP — Conçu strictement pour la gouvernance de MCP. Si une organisation souhaite exécuter des fonctions de service et de mise en mémoire tampon de modèles, de réglage ou de gestion des invites, ou des LLMOP complets, un fournisseur distinct doit être recherché.

- Pas de serveur de modèle intégré ni de couche d'inférence — Les connexions aux outils sont gérées par Obot ; toutefois, les modèles eux-mêmes sont gérés par une pile distincte qui n'a pas encore été créée et qui gérera l'emplacement des instances LLM, la manière dont l'inférence est acheminée et la gestion du calcul GPU.

- Déploiement de Kubernetes — L'option de déploiement idéale pour les équipes qui disposent d'une infrastructure cloud native ; cela pourrait constituer un obstacle important pour les organisations qui ne disposent pas des ressources ou de l'expertise en ingénierie de plateforme requises.

- Visibilité limitée et capacités de gestion des coûts — Bien que la journalisation des audits existe, il n'existe pas (1) [Attribution des coûts] (2) [Tableau de bord de latence] ou (3) de niveau approprié [Surveillance de la production], qui sont présents dans les passerelles IA dédiées.

Critères d'évaluation

Comment avons-nous évalué ces alternatives à l'IA robotique ?

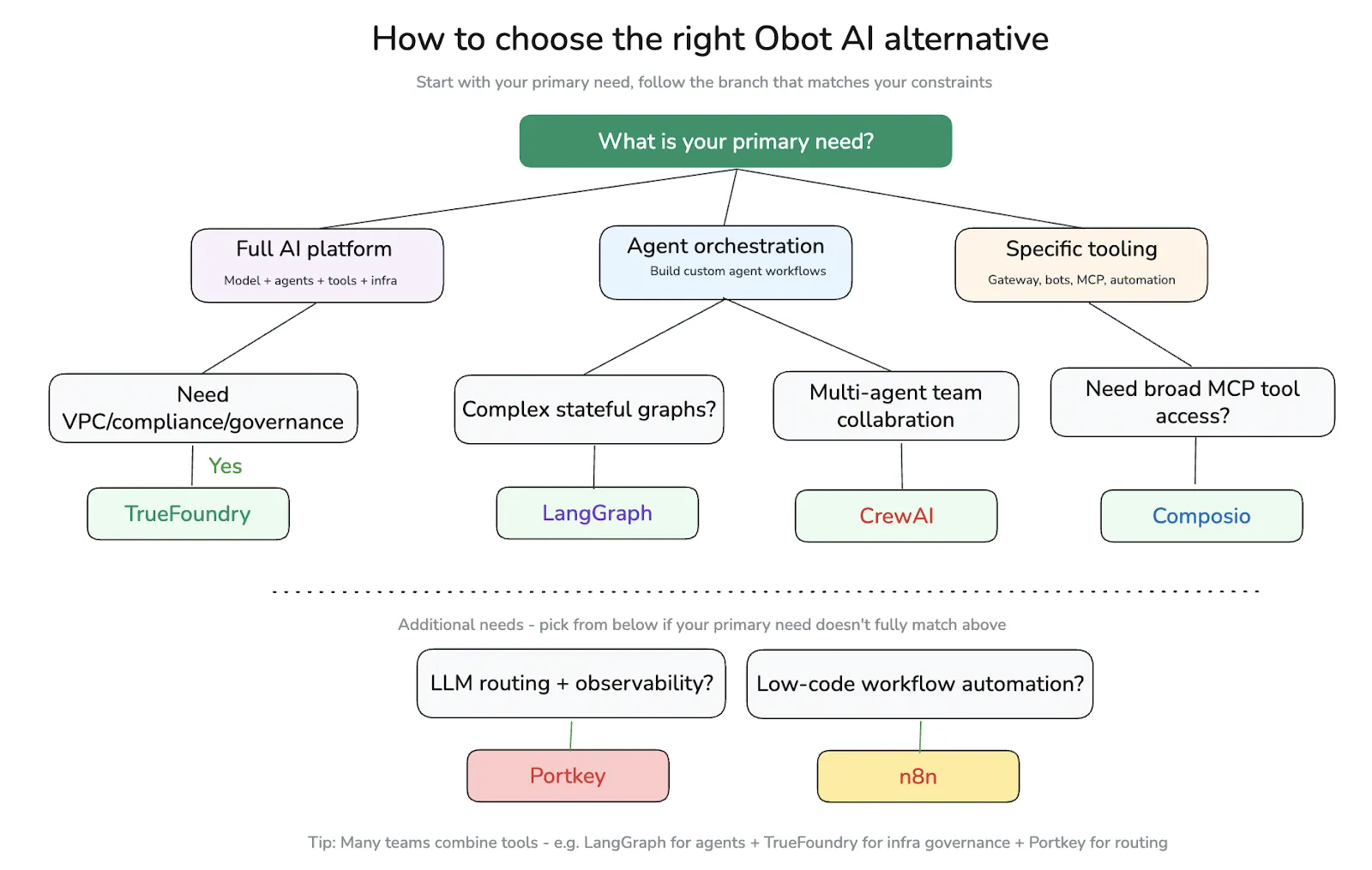

Les alternatives à l'IA robotique ne tentent pas toutes de résoudre le même problème ; par exemple, certaines peuvent se concentrer uniquement sur le MCP tandis que d'autres examinent l'infrastructure d'IA dans un sens plus global.

Nous avons évalué chacune des solutions alternatives en fonction de plusieurs aspects pratiques :

- Agents MCP et AI : La solution fournit-elle un support natif pour MCP ou s'intégre-t-elle uniquement aux MCP ?

- Propriété de l'infrastructure : Avez-vous la possibilité d'exécuter la solution dans votre propre cloud privé virtuel (VPC) ou la solution est-elle uniquement proposée sous forme de logiciel en tant que service (SaaS) ?

- Flexibilité du modèle : La solution prend-elle en charge à la fois les modèles auto-hébergés et les modèles basés sur les fournisseurs ?

- Observabilité et gouvernance : La solution fournit-elle des politiques robustes de contrôle d'accès basé sur les rôles (RBAC), des audits et un suivi des coûts pour garantir une utilisation fiable de la solution en production ?

- Expérience des développeurs : À quelle vitesse une équipe de développement peut-elle passer d'une idée à une solution fonctionnelle ?

Aucune solution alternative n'est clairement gagnante lorsqu'elle est évaluée dans tous ces domaines, et c'est l'objectif général de l'évaluation.

Les alternatives à Obot AI en un coup d'œil :

Les meilleures alternatives à l'IA robotique en 2026

1. TrueFoundry : idéal pour les équipes d'IA d'entreprise qui ont besoin d'un contrôle complet

TrueFoundry est une plateforme d'IA fournie sous forme de charges de travail gérées par Kubernetes sur site ou sous forme de services cloud au sein de votre VPC sur les trois principales plateformes cloud (AWS/Azure/GCP).

TrueFoundry aborde tous les aspects de la gestion et du contrôle du cycle de vie de l'IA, tels que le déploiement de modèles, le routage des inférences vers ceux-ci, l'orchestration des agents, la gestion des déploiements multicloud, via un plan de contrôle unique.

Reconnu pour son exhaustivité par Gartner dans son guide du marché 2025 pour les passerelles d'intelligence artificielle et son récent conseil d'administration en Caroline du Nord, TrueFoundry assure la gouvernance des modèles, des agents, des outils et des ressources de calcul, tandis qu'Obot assure uniquement la gouvernance des agents hébergés et des demandes transmises.

La plateforme a été adoptée par des entreprises telles que Siemens Healthineers, Resmed, Automation Anywhere et NVIDIA.

Caractéristiques principales :

- Accédez à la passerelle unifiée AI : API compatible OpenAI (plus de 250 LLM utilisant une LLM open source ou propriétaire) ; routage intelligent, basculement, équilibrage de charge et budgétisation des jetons via une API unique pour les LLM

- Serveurs MCP virtuels : Combinez les outils de plusieurs serveurs MCP en un seul point de terminaison organisé avec un filtrage au niveau des outils. Authentification centralisée (OAuth2, PAT, VAT), RBAC et journalisation des audits gérés par la passerelle AI

- Passerelle MCP avec registre centralisé : Serveurs MCP enregistrés publics et auto-hébergés disponibles via AI Gateway Control Plane ; provisionnement de jetons OAuth utilisateur par utilisateur et fonctionnalité d'actualisation automatique des jetons ; prise en charge des fournisseurs d'identité fédérés (IDP) tels qu'Okta et Azure AD

- Orchestration conviviale pour les agents : Indépendant du framework ; compatible avec les cadres d'agents personnalisés, LangGraph, CrewAI et AutoGen ; intégré à Playground pour tester les invites par rapport aux outils MCP avec diffusion en temps réel des données de boucle agentique

- Observabilité intégrée : Latence, utilisation des jetons, attribution des coûts, tableaux de bord spécifiques à l'équipe et enregistrement complet des demandes/réponses des clients sans aucun sidecar

- Gestion rapide du cycle de vie : Versionnage des invites gérées par ai, prise en charge multiversion des invites gérées par AI et intégration CI/CD avec CLI/API.

Idéal pour :

Organisations d'ingénierie de plateformes, entreprises à la recherche d'une plateforme d'IA gouvernée neutre pour le cloud (et pas simplement une passerelle MCP) avec un contrôle total des modèles, des agents, des outils et de l'infrastructure (idéale pour ceux qui transforment 1 ou 2 cas d'utilisation du LLM).

Les organisations qui passent de cas d'utilisation limités à des implémentations de LLM étendues ont généralement du mal à bien comprendre la taille de leur environnement actuel, ce à quoi ressemblera l'avenir et comment planifier l'évolutivité sur le long terme.

2. LangGraph (par LangChain)

LangGraph est un framework qui offre un moyen open source de créer des graphiques orientés de flux de travail d'agents en plusieurs étapes avec état. LangGraph s'appuie sur LangChain en ajoutant des fonctionnalités telles que la gestion explicite des états, les cycles et les modèles homme-in-the-loop.

Caractéristiques principales :

- Méthode basée sur des graphes pour créer des services complexes avec prise en charge des branches, des cycles, du routage conditionnel et du traitement parallèle

- Une plateforme de déploiement géré (auto-hébergée ou gérée par LangGraph)

- Compatible avec tous les fournisseurs de modèles (y compris Claude, OpenAI, Gemini, Bedrock, Open Source)

Avantages :

- Plateforme flexible pour créer des agents complexes en plusieurs étapes avec licence MIT

- Écosystème robuste avec d'autres outils (LangChain, LangSmith, LangServe)

Inconvénients :

- Framework au lieu d'une plate-forme ; nécessite une conception initiale du schéma d'état ; ne fournit pas de service de modèle par défaut, de passerelle MCP ou d'orchestration de calcul

Idéal pour :

Les équipes d'ingénierie créent des flux de travail d'agents complexes et dynamiques prêts à gérer leur infrastructure.

3. IA de l'équipage

CrewAI est un framework Python conçu pour collaborer avec des équipes d'agents d'IA en leur permettant d'effectuer des tâches en fonction des rôles qui leur sont assignés dans le cadre d'objectifs et de méthodes de délégation spécifiés.

Principales caractéristiques :

- Définition des rôles des agents avec des objectifs, des antécédents et des outils attribués à chaque rôle. Cela permet de modéliser les tâches en tant qu'équipes dotées de compétences spécialisées.

- Offre un contrôle unifié des agents grâce à la plateforme CrewAI Enterprise AMP. Cette plateforme inclut une fonction de traçage en temps réel, un contrôle d'accès basé sur les rôles (RBAC) et une gestion des déploiements dans le cloud ou sur site.

- CrewAI Studio est un outil d'édition graphique sans code qui permet à l'utilisateur de créer des agents sans avoir besoin de savoir programmer.

Avantages :

- Agents collaboratifs faciles à modéliser : La création d'équipes d'agents à l'aide de l'API est le moyen le plus convivial de créer un prototype fonctionnel d'équipe multi-agents en moins d'une journée.

- Prototypage rapide : Le noyau de CrewAI est open source et peut donc être utilisé indépendamment de tout autre framework (par exemple, LangChain).

Inconvénients :

- Observabilité limitée : La couche d'abstraction de CrewAI peut parfois sembler moins intuitive que la couche d'abstraction de LangGraph, ce qui rend le diagnostic des défaillances des agents fastidieux. La maturité de l'observabilité et du suivi des coûts au sein de l'écosystème CrewAI est également moindre qu'avec LangSmith.

- Coût de CrewAI Enterprise : Le coût d'utilisation de CrewAI Enterprise (AMP) est d'environ 99$ par mois, bien qu'une consultation plus approfondie puisse fournir une tarification précise.

Idéal pour :

CrewAI est un excellent outil de collaboration multi-agents pour les équipes intéressées par le développement rapide de flux de travail multi-agents via des méthodes sans code.

4. Composio

Composio, en tant que passerelle MCP gérée et plateforme d'intégration d'outils, dispose de plus de 500 outils prédéfinis pour se connecter à vos agents d'IA (et est approuvé par l'entreprise). La passerelle MCP universelle de la société a été lancée en août 2025 pour prendre en charge plus de 100 000 développeurs et éliminer le besoin de nombreux serveurs MCP distincts en permettant une seule installation à la place.

Caractéristiques principales :

- Plus de 500 intégrations MCP gérées (y compris Slack, GitHub, Salesforce, Google Workspace, Notion, Jira, etc.) avec OAuth unifié et actualisation automatique des jetons

- Agnosticisme du cadre : Supporte LangChain, CrewAI, le SDK OpenAI Agents, Claude Code, Cursor, etc.

- Routage des outils basé sur l'IA : Comprend l'intention, sélectionne les outils, envoie des paramètres : pas besoin de rechercher manuellement les documents de l'API.

- Options d'hébergement dans le cloud ou d'installation privée/auto-hébergée

Avantages :

- Le plus grand catalogue d'outils préfabriqués (réduction du temps d'intégration de plusieurs semaines à moins de 5 minutes)

- Une expérience de développeur axée sur le développeur : Connexion API en une ligne par outil et modèles de recettes complets.

Inconvénients :

- Le SaaS géré par défaut signifie moins de contrôle de l'infrastructure que les options d'auto-hébergement comme Obot

- La qualité des connecteurs peut varier : une expansion rapide signifie que certaines de leurs intégrations sont moins testées.

- La tarification n'est pas très claire (basée sur le nombre de fois qu'un outil a été appelé) ; la tarification pour les entreprises nécessite de contacter directement le service commercial de Composio.

Idéal pour :

Les équipes de développement créent des agents qui ont besoin d'un accès rapide à un grand nombre d'outils MCP sans les délais associés au développement d'intégrations personnalisées, lorsque la rapidité d'intégration est essentielle.

5. Clé de port

Portkey est une plate-forme fiable et observable qui peut aider à gérer les coûts liés à l'utilisation d'un système de gestion de l'apprentissage à grande échelle (édition). Son objectif principal est donc de fournir une « passerelle vers plus de 1 600 lois, dans plus de 40 entreprises différentes, chacune avec un délai inférieur à une milliseconde » lors de la génération de nouveaux contenus pour les ressources d'entreprise à grande échelle.

Caractéristiques principales :

- Génération intelligente d'itinéraires : prend en charge les fonctionnalités de nouvelle tentative automatique, les fonctionnalités de mise en cache sémantique, les opérations d'équilibrage de charge, les fonctionnalités de disjoncteur et les options de secours multimodèles

- Répond à toutes les normes de sécurité applicables, comme suit : SOC 2 - Type 2 ; ISO 27001 ; GDPR ; HIPAA ; les méthodes supplémentaires de sécurisation du contrôle d'accès incluent l'utilisation d'un contrôle d'accès basé sur les rôles, l'utilisation de l'authentification unique sur SCIM et la gestion des journaux d'audit.

- La passerelle Portkey sert de référentiel centralisé pour stocker toutes les données pertinentes sur chacune de ses nombreuses applications.

Avantages :

- Hautes performances, compactes et efficaces par rapport aux systèmes traditionnels de type existant et qui ont fait leurs preuves auprès des grandes entreprises.

- Solution de passerelle open source avec une version basée sur le cloud ou une solution gérée dans le cloud.

Inconvénients :

- Portkey est strictement un produit de passerelle qui ne prend pas en charge les modèles hébergés par les développeurs ou l'infrastructure de calcul ; les capacités MCP sont limitées par rapport à d'autres passerelles MCP dédiées (par exemple, Composio, TrueFoundry).

Idéal pour :

Portkey est plus utile pour les ingénieurs qui ont déjà construit leur structure organisationnelle, leurs processus et qui disposent d'un vaste réseau utilisé pour acheminer les documents, surveiller l'utilisation et développer des modèles de coûts.

6. 8n

n8n est un outil d'automatisation des flux de travail open source (OS) doté de fonctionnalités d'agent IA natives intégrées et d'un support MCP bidirectionnel, connectant les deux méthodes d'automatisation traditionnelles : webhooks, API et bases de données aux flux de travail d'agents alimentés par LLM via Visual Builder.

Caractéristiques principales :

- Un concepteur de flux de travail visuel qui permet de connecter plus de 500 nœuds d'intégration (à la fois automatisation déterministe et agent) pour une transition fluide entre les deux types d'automatisations.

- Un nœud AI Agent qui fournit des fonctionnalités d'agent d'IA natives en appelant d'autres outils, qui inclut également de la mémoire (deux manières de la stocker), en utilisant Redis ou une simple base de données, ainsi que la prise en charge de différents modèles utilisant OpenAI (et Anthropic) dans le nœud d'agent AI.

- Contrôle humain dans la boucle (nécessite une approbation humaine explicite) permettant aux agents d'exécuter tout outil à fort impact (ajouté en janvier 2026).

Avantages :

- Niveau de difficulté le plus faible pour les personnes qui ne sont pas des ingénieurs en machine learning pour créer des automatisations à l'aide de l'IA.

- D'excellentes options auto-hébergées avec une communauté open source florissante (pour la documentation et les ressources du système d'exploitation) et un contrat de licence équitable.

Inconvénients :

- Non conçu spécifiquement pour fonctionner avec l'IA, aucune mémoire utilisée pour gérer un agent ne fonctionnera que pendant chaque exécution du flux de travail, sauf si les données sont stockées ailleurs.

- Ne possède pas les niveaux de gouvernance, de contrôle d'accès basé sur les rôles (RBAC), de maîtrise des coûts ou de fonctionnalités de conformité d'entreprise intégrés aux solutions logicielles d'IA dédiées.

- Des plafonds de performance limités sont présents lorsque de nombreuses charges de travail à volume élevé et urgentes utilisent des agents.

Idéal pour :

Si votre équipe travaille dans un domaine lié aux opérations ou à l'automatisation et cherche à compléter ses solutions d'automatisation existantes avec des fonctionnalités alimentées par des agents d'IA sans disposer d'une solution complète basée sur le ML.

Comment choisir la bonne alternative à l'IA robotique

Le choix de la meilleure alternative à l'IA robotique nécessite une attention particulière pour répondre aux besoins de votre équipe

Votre équipe ne bénéficiera pas du même remplacement de l'IA robotisée en raison des différences de taille de votre équipe, de la quantité d'infrastructure que vous souhaitez gérer et de la tâche/fonction que vous souhaitez effectuer en premier.

Recommandations basées sur des scénarios :

- Créer des agents de recherche en plusieurs étapes qui ont besoin d'appeler des outils pour fonctionner ? Utilisez LangGraph et Portkey ou sélectionnez TrueFoundry comme solution d'automatisation tout-en-un.

- Vous avez besoin de contrôles automatisés/d'un accès réglementaire VPC au serveur MCP avec de nombreux membres de l'équipe ? Concevez avec TrueFoundry en plaçant des serveurs MCP virtuels dans le VPC avec un RBAC central.

- Êtes-vous en train d'ajouter de l'intelligence artificielle à votre style Zapier existant ? Utilisez n8n pour l'ajouter à votre flux de travail actuel.

- Vous avez besoin d'un VPC et de pistes d'audit de la part de votre équipe de conformité pour tout ou partie de l'ensemble des systèmes installés ? Choisissez TrueFoundry comme option de déploiement.

Questions fréquemment posées

Question : À quoi sert l'IA d'Obot ?

- Conçu principalement pour gérer l'infrastructure basée sur le protocole MCP (Model Context Protocol), en particulier la manière dont les agents d'IA interagissent et se connectent à des systèmes et outils externes.

- Assure la gestion de l'authentification des utilisateurs pour les agents IA, le routage des demandes via un registre centralisé et la journalisation des audits pour toutes les interactions agent-système.

- Fonctionne comme une couche de gouvernance (contrôle) pour les agents d'IA qui interagissent avec des systèmes et des outils externes, et non comme un système d'exploitation d'IA complet ou une plateforme d'IA de bout en bout.

Question : Pourquoi les équipes recherchent-elles des alternatives à l'IA robotisée ?

- Leurs besoins dépassent la portée d'une couche de gouvernance MCP : ils nécessitent la diffusion de modèles, le routage par inférence, le suivi des coûts et le déploiement de la production à l'échelle de l'entreprise.

- Ils ont besoin d'accéder à des fonctionnalités d'entreprise matures et fréquemment mises à jour sans attendre un cycle de publication préliminaire.

Ils préfèrent une plateforme unifiée qui consolide les modèles, les agents, les outils et l'automatisation opérationnelle au sein d'un système unique, plutôt que de gérer plusieurs couches indépendantes.

Question : Quelles sont les meilleures plateformes d'agents d'IA en 2026 ?

La plateforme d'agent d'intelligence artificielle (IA) la mieux adaptée à vos besoins en 2026 dépendra de la ou des parts que vous devrez posséder :

True Foundry - Il s'agit de la plateforme préférée des grandes organisations pour contrôler la gouvernance du modèle de bout en bout. TrueFoundry propose tous les composants de la pile de gouvernance des modèles de bout en bout, notamment : la diffusion des modèles, l'orchestration des agents, la gestion des outils MCP et le contrôle de l'infrastructure pour la diffusion des modèles.

Si vous avez besoin d'une plateforme qui assure la conformité au niveau de la production, l'attribution des coûts des modèles par département ou équipe et une gouvernance au niveau évolutif entre de nombreux départements ou équipes, TrueFoundry est la meilleure plateforme.

LangGraph - Il s'agit du cadre de choix pour les équipes d'ingénierie qui créent des applications complexes et dynamiques basées sur des agents avec des branchements personnalisés, des cycles et/ou des flux de travail intégrés à l'humain.

IA de l'équipage - Il s'agit de la meilleure plateforme pour concevoir des systèmes de collaboration entre plusieurs agents avec délégation basée sur les rôles et coordination des tâches.

Composio - Il s'agit de la meilleure plateforme lorsqu'il est plus important d'accéder rapidement à plus de 500 intégrations d'outils multiplateformes gérés (MCP) que de posséder l'infrastructure.

Si vous recherchez une plateforme qui possède la plus grande superficie pour vous fournir une solution de gouvernance, de contrôle des coûts et de conformité pour plusieurs départements ou équipes, TrueFoundry serait de loin la meilleure option.

Question : Comment les outils d'agent d'IA se comparent-ils aux outils d'automatisation traditionnels ?

Un agent d'IA diffère grandement des applications d'automatisation traditionnelles ou existantes (par exemple, N8n/Zapier) en ce sens que ces applications s'exécutent sur une base très déterministe (c'est-à-dire que la même structure de code produit le même résultat à chaque fois).

Ils sont généralement appropriés pour des tâches très bien définies (c'est-à-dire garanties), telles que la synchronisation des données, l'envoi de notifications et l'exécution de travaux planifiés.

D'autre part, les agents d'IA utilisent une prise de décision pilotée par la LLM, en sélectionnant dynamiquement des outils en fonction des exigences de l'environnement immédiat et en effectuant un raisonnement en plusieurs étapes, ce qui donne à l'agent IA une certaine marge de manœuvre pour déterminer sa prochaine tâche.

Question : Que devez-vous rechercher dans une plateforme d'orchestration d'IA ?

Gestion des modèles : La possibilité d'utiliser une variété de grands modèles de langage (LLM) proposés par des fournisseurs de cloud tiers (OpenAI, Anthropic, open source) et d'héberger des modèles auto-hébergés (non cloud).

Options de déploiement : Options pour exécuter des charges de travail d'IA dans un cloud privé virtuel (VPC), sur site ou dans un environnement isolé afin de garantir la confidentialité des données.

Observabilité : La possibilité de surveiller la latence, d'attribuer un coût symbolique pour chaque LLM et de fournir des analyses d'utilisation par équipe.

Gestion des outils et des agents : Possibilité de gérer de manière centralisée l'enregistrement et l'audit des connexions de données entre les modèles, les outils et les agents.

Conformité RBAC : La possibilité de créer un accès basé sur les rôles et d'appliquer les normes de conformité à la norme SOC 2 et les pistes d'audit d'entreprise à toutes les personnes ayant accès au jeu d'outils.

Expérience des développeurs : La rapidité avec laquelle les développeurs peuvent écrire, tester et déployer leur code en production, la qualité du SDK et des frameworks pris en charge par le SDK

La principale différence est de savoir si vous développez une application ou si vous prenez en charge une couche d'infrastructure. Les plateformes telles que TrueFoundry sont principalement destinées aux équipes de plateforme pour gérer les modèles, les agents et les outils de plusieurs unités commerciales lors de la transition de l'IA de l'expérimentation à la production.

Conclusion

Si vous recherchez une solution open source pour l'hébergement et la gestion des serveurs MCP par votre équipe, Obot devrait toujours figurer parmi les meilleurs concurrents. Mais à mesure que l'entreprise passe des essais d'IA à la production et au déploiement de solutions basées sur l'IA à grande échelle, vous constaterez que la plupart des équipes ont besoin de fonctionnalités supplémentaires au-delà de l'hébergement et de la gouvernance de leurs modèles

C'est là que TrueFoundry occupe une position unique puisqu'il est le seul fournisseur de cette liste à avoir réussi à fusionner la gouvernance du MCP avec l'équivalent de la gestion de l'ensemble du cycle de vie de l'IA, depuis le déploiement de modèles, la mise en place d'une passerelle AI connectée fournissant un routage intelligent, le stockage des registres d'agents, la fourniture de tableaux de bord d'observabilité et l'exécution native du VPC, le tout sans vous lier à un seul fournisseur de cloud.

Si votre équipe envisage d'utiliser des alternatives à l'IA d'Obot et a besoin d'une plateforme pour développer son utilisation de l'IA auprès de plusieurs équipes et communautés d'utilisateurs, nous vous recommandons de demander une démonstration des produits TrueFoundry et un aperçu de la manière dont ils soutiennent votre infrastructure technologique.

FAQs

1. Quelle est la différence entre une passerelle MCP et une passerelle AI ?

Une passerelle MCP est destinée à gérer la façon dont les agents d'IA interagissent avec des outils extérieurs à leur système via le protocole Model Context. La passerelle AI se situe à un niveau supérieur, où les demandes sont gérées pour plusieurs modèles. La passerelle est chargée de faire appliquer les politiques, ainsi que de surveiller la latence, l'utilisation et les coûts. Dans un environnement de production, les deux passerelles devront fonctionner ensemble. C'est là que TrueFoundry est utile, car il réunit les passerelles MCP et AI sur une seule plateforme.

2. Ai-je besoin à la fois d'une infrastructure MCP et d'une infrastructure LLM pour exécuter des agents d'IA en production ?

Oui, un environnement de production pour les agents d'IA nécessitera à la fois une infrastructure MCP et une infrastructure LLM. MCP gérera la manière dont les agents d'IA interagissent avec des outils extérieurs à leur système. LLM gérera la façon dont les agents IA sont hébergés. Obot AI est un outil conçu pour MCP, mais un environnement de production nécessitera à la fois MCP et LLM. TrueFoundry réunit MCP et LLM sur une seule plateforme, ce qui simplifie considérablement la gestion des environnements de production pour les agents d'IA.

3. Quand une équipe doit-elle aller au-delà de l'IA robotisée ?

Une équipe devra s'éloigner de l'IA robotisée lorsque ses besoins vont au-delà du MCP. C'est à ce moment qu'ils doivent passer à un environnement de production. C'est à ce moment-là qu'ils doivent travailler avec plusieurs modèles, suivre leurs coûts et avoir une meilleure vue de leurs agents d'IA. La nécessité d'un environnement de production apparaîtra lorsque l'IA sera utilisée par de nombreuses équipes. À ce stade, il est compliqué de gérer différents outils pour différents niveaux. À ce stade, une équipe aura besoin d'une plateforme telle que TrueFoundry, où le MCP et l'IA peuvent être gérés sur une seule plateforme.

4. Quelles sont les principales fonctionnalités que vous souhaiteriez trouver dans une alternative à Obot AI ?

Lorsque vous souhaitez choisir des alternatives à Obot AI, vous devez vous assurer de choisir celles qui possèdent les fonctionnalités requises pour être prêtes à la production. Cela signifie que vous souhaitez qu'ils prennent en charge plusieurs modèles, à la fois hébergés et auto-hébergés. Vous souhaitez également qu'ils aient une bonne observabilité grâce à des fonctionnalités telles que la latence et l'utilisation des jetons. De plus, vous souhaitez qu'ils disposent de bonnes fonctionnalités de sécurité telles que le RBAC et les pistes d'audit. Enfin, vous souhaitez qu'ils prennent en charge le déploiement dans des environnements VPC ou sur site. Une autre caractéristique importante est l'expérience du développeur, notamment en ce qui concerne la rapidité avec laquelle vous souhaitez passer du prototype à la production. TrueFoundry est souvent pris en compte à cet égard car il prend en charge ces fonctionnalités à la fois au niveau du MCP et du modèle.

5. Les outils MCP tels qu'Obot AI peuvent-ils prendre en charge la surveillance au niveau de la production et le contrôle des coûts ?

Les outils MCP tels qu'Obot AI ont été conçus principalement dans le but de gérer les outils eux-mêmes. Ils n'ont pas été conçus dans le but de soutenir la surveillance au niveau de la production. Bien qu'ils prennent en charge des fonctionnalités telles que les pistes d'audit, ils ne disposent pas de fonctionnalités telles que le contrôle des coûts au niveau des jetons ou la possibilité de surveiller les performances des modèles et des agents. C'est la raison pour laquelle vous devriez utiliser TrueFoundry car il prend en charge la surveillance au niveau de la production.

6. Quelle est la meilleure façon de commencer avec l'infrastructure des agents d'IA en 2026 ?

La façon la plus simple de démarrer varie en fonction du niveau de développement. Par exemple, les équipes qui continuent d'expérimenter avec des agents souhaiteront peut-être utiliser un framework ou un outil de flux de travail pour créer des cas d'utilisation initiaux. Cependant, à mesure que le niveau de complexité augmente, les équipes souhaiteront peut-être ajouter des systèmes MCP pour faciliter la gestion de l'accès aux outils, puis une infrastructure pour gérer le routage et la surveillance. Cependant, il pourrait éventuellement devenir difficile de gérer ces couches séparément, d'où la nécessité d'utiliser un système plus unifié. TrueFoundry permet d'y parvenir facilement en supportant à la fois l'expérimentation et l'infrastructure dans le même environnement.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)