MCP et API : quelle est la différence ?

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Les systèmes d'IA évoluent rapidement, mais les faire fonctionner de manière fluide avec des outils et des données du monde réel reste un obstacle majeur. Le Model Context Protocol (MCP) est une nouvelle norme qui promet de rendre l'intégration de l'IA plus fluide et plus sécurisée en donnant aux modèles un accès structuré à des données et à des services externes.

Cela vous semble familier ?

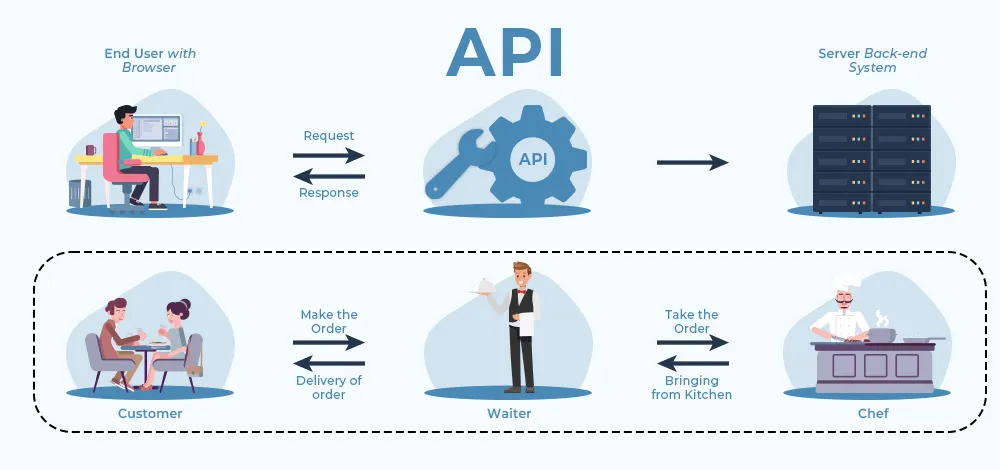

En effet, les API font quelque chose de similaire depuis des décennies, constituant l'épine dorsale de la façon dont les systèmes logiciels communiquent entre eux. À première vue, le MCP et les API peuvent sembler être deux versions d'une même idée. Mais en réalité, ils agissent à différents niveaux et résolvent des problèmes différents.

Dans cet article, nous expliquerons ce qu'est réellement le MCP, comment il se compare aux API, où chacun se distingue et ce que tout cela signifie pour les développeurs, les entreprises et l'avenir de l'intégration de l'IA.

Qu'est-ce que le Model Context Protocol (MCP) ?

Interface standard qui permet aux modèles d'IA d'accéder de manière dynamique aux outils et aux données et de les orchestrer pour des flux de travail sécurisés et contextuels.

Le Model Context Protocol (MCP) est une norme ouverte qui permet aux modèles d'IA de se connecter à des outils, des sources de données et des services externes de manière sécurisée et structurée. Au lieu de coder en dur des intégrations ou de s'appuyer sur des connecteurs personnalisés, MCP définit un protocole cohérent pour échanger le contexte entre un modèle et son environnement.

Cela permet aux développeurs d'étendre plus facilement les fonctionnalités des modèles, de garantir un accès sécurisé aux données sensibles et de normaliser la manière dont l'IA interagit avec les systèmes externes.

Principales caractéristiques du MCP

Communication normalisée: MCP établit un protocole ouvert et standardisé pour communiquer le contexte entre les modèles d'IA et d'autres outils externes. Cela élimine le besoin de gérer le paysage désordonné des connecteurs propriétaires et des intégrations codées en dur. Tous les outils, sources de données ou services communiquent entre eux au moyen d'un langage commun. Cela réduit considérablement les efforts d'ingénierie nécessaires pour intégrer l'IA à d'autres outils d'entreprise. La passerelle MCP de TrueFoundry sert de point de terminaison unique permettant aux agents d'appeler n'importe quel serveur MCP enregistré, qu'il s'agisse d'une API interne, d'un service cloud ou d'une intégration prédéfinie telle que Slack, Confluence ou Datadog.

Sécurité et gouvernance: MCP permet un accès contrôlé et autorisé à tous les outils et services. Avec la mise en œuvre de TrueFoundry, cela inclut une identité fédérée avec les IdP d'entreprise tels qu'Okta ou Azure AD, OAuth 2.0 avec découverte dynamique de jetons et un contrôle d'accès basé sur les rôles (RBAC) par serveur MCP ou par outil. Un agent ne peut appeler que les outils pour lesquels l'accès lui a été explicitement accordé. Par conséquent, un agent privilégié ne peut pas agir en tant que « superutilisateur » dans l'ensemble de votre environnement d'outils d'entreprise. En outre, toutes les activités sont enregistrées dans un journal d'audit, ce qui rend les flux de travail basés sur MCP intrinsèquement conviviaux pour les secteurs fortement réglementés tels que la santé ou la finance.

Extensibilité: MCP a été conçu pour permettre de connecter facilement de nouveaux outils ou de nouvelles sources de données sans avoir à modifier le modèle sous-jacent ou le code de l'application. Dans TrueFoundry, cela signifie que vous pouvez utiliser des serveurs MCP prédéfinis prêts à l'emploi pour les plateformes d'entreprise les plus populaires, ou vous pouvez facilement intégrer n'importe quel service interne (une API REST propriétaire, une application héritée ou une base de données personnalisée) en tant que serveur MCP en quelques minutes. Une fois enregistré, il est immédiatement détectable et appelable par n'importe quel agent.

Découverte unifiée: Un registre de serveurs MCP unifié permet aux agents (et aux développeurs) de découvrir tous les outils et services disponibles. Au lieu de devoir coder en dur les outils qu'un agent peut utiliser, nous pouvons désormais tirer parti du registre unifié pour exposer à l'agent au moment de l'exécution le catalogue complet des serveurs MCP en ligne autorisés.

Observabilité: tous les appels au serveur MCP, les appels aux outils et les décisions des agents sont désormais traçables de bout en bout. TrueFoundry capture des données télémétriques détaillées (latence, erreurs, utilisation, coût) qui peuvent être filtrées par utilisateur, outil, équipe ou environnement. Cela transforme efficacement ce qui était traditionnellement une boîte noire (qu'a fait l'agent ?) en une activité entièrement vérifiable et déboguable.

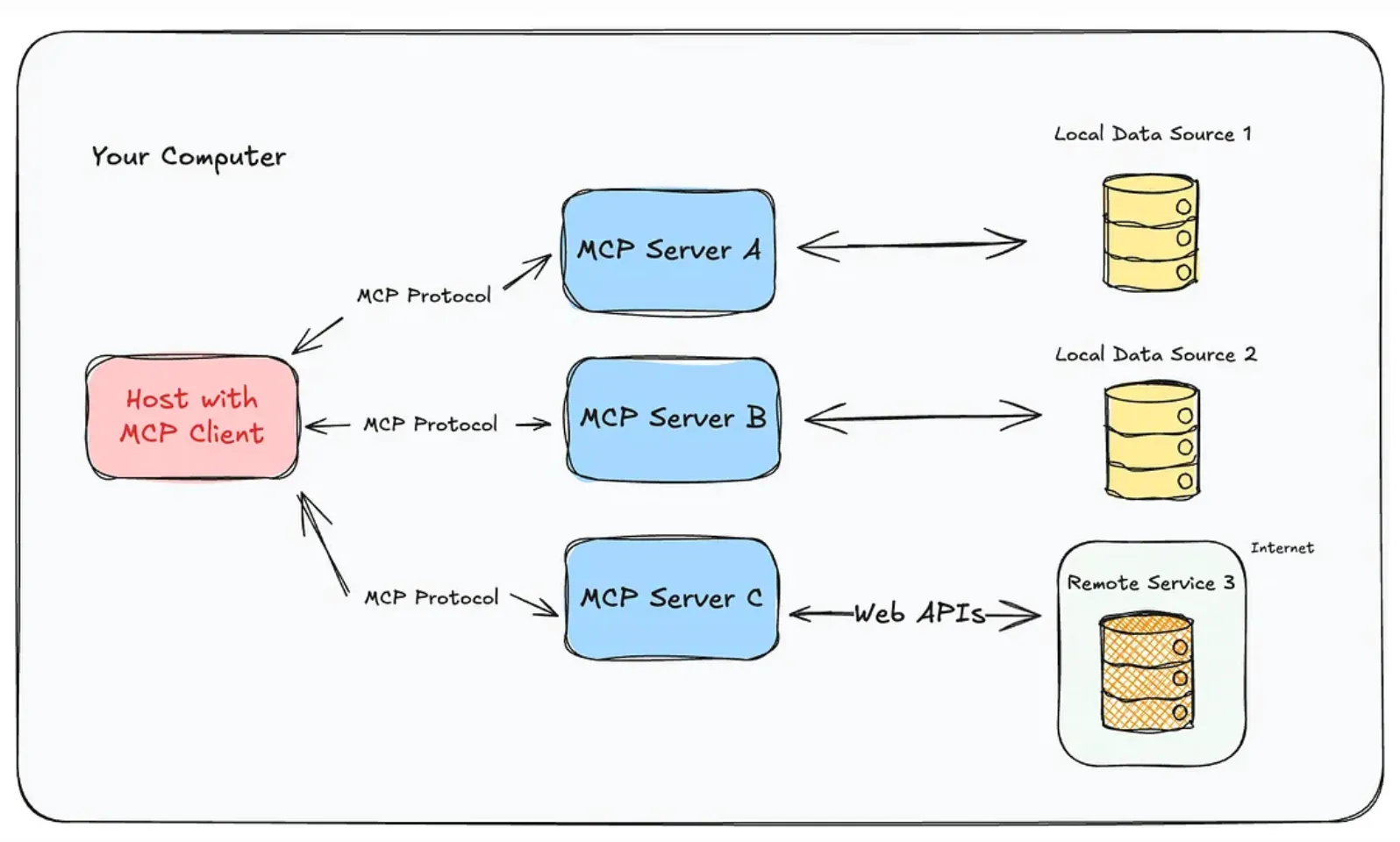

Comment fonctionne le MCP ?

L'architecture de MCP est conçue pour trouver un équilibre entre flexibilité et contrôles de sécurité stricts. Il suit une conception en couches qui sépare le modèle, les services externes et le canal de communication. Cette séparation garantit des responsabilités claires, réduit la complexité et facilite la mise à l'échelle ou l'extension du système sans interrompre les flux de travail existants.

- Couche client : Le modèle ou l'agent d'IA qui initie les demandes.

- Couche serveur: outils externes, API ou bases de données fournissant des données ou des fonctionnalités.

- Couche de transport : Canal de communication, souvent basé sur JSON-RPC, qui garantit un échange de messages structuré et fiable.

- Contrôles des autorisations : Règles qui régissent ce à quoi le modèle peut accéder, protégeant les ressources sensibles ou privées.

Cette approche en couches garantit que les modèles peuvent interagir avec des environnements externes tout en restant sécurisés, évolutifs et faciles à étendre.

Qu'est-ce que l'interface de programmation d'applications (API) ?

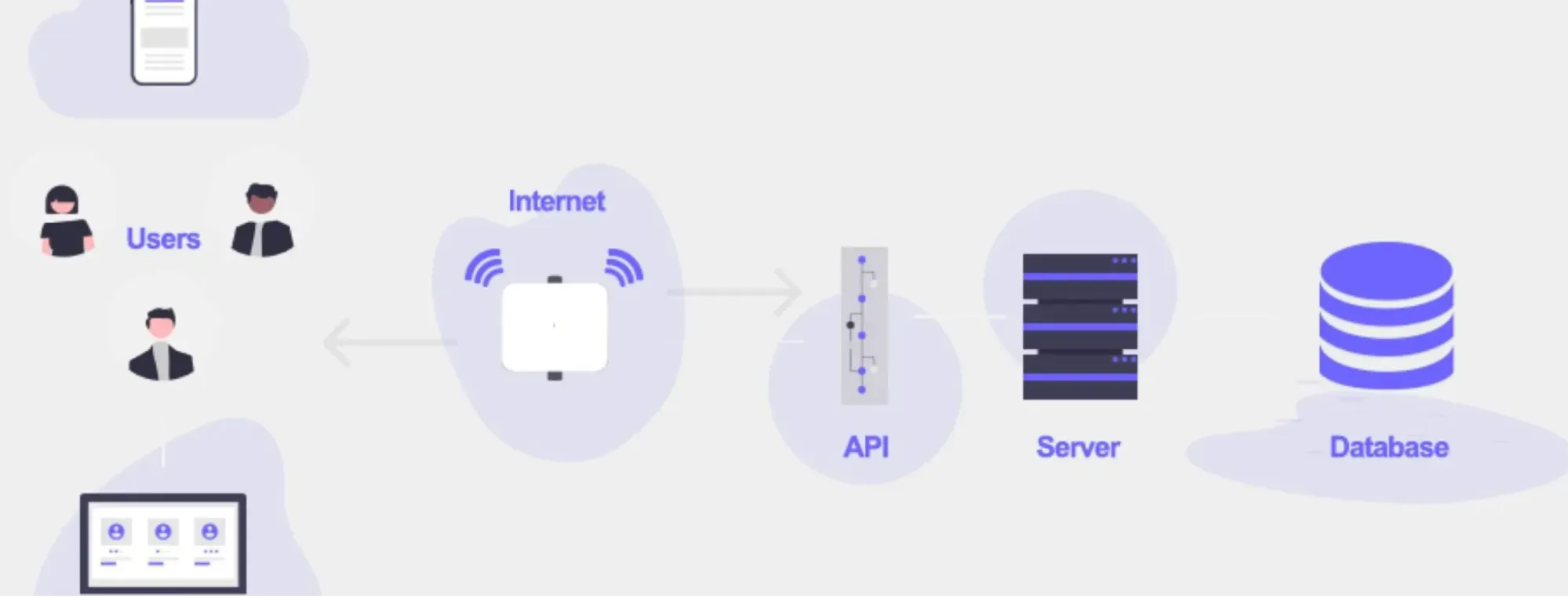

Une interface de programmation d'applications (API) est un ensemble défini de règles qui permet à deux applications logicielles de communiquer entre elles. Au lieu d'accéder directement au code ou à la base de données d'un système, les développeurs utilisent des API pour demander des services ou des données spécifiques de manière structurée et fiable.

Les API constituent l'épine dorsale du développement logiciel moderne et alimentent tout, des applications mobiles aux plateformes Web en passant par les intégrations d'entreprise.

Principales fonctionnalités de l'API

- Accès standardisé: fournit un moyen cohérent d'interagir avec les composants logiciels sans exposer la logique interne.

- Réutilisabilité: permet aux développeurs de créer une seule fois et de réutiliser la même API dans plusieurs applications ou services.

- Interopérabilité: Permet à divers systèmes, souvent basés sur des technologies différentes, de fonctionner ensemble de manière fluide.

Comment fonctionne l'API ?

L'architecture API est développée dans le but de faciliter la communication entre deux ou plusieurs systèmes tout en garantissant la fiabilité et la sécurité du processus. La plupart des API modernes utilisent les protocoles REST ou GraphQL. Cependant, les principes sous-jacents restent les mêmes dans les deux cas. Par conséquent, voici une description des concepts clés utilisés dans l'architecture des API :

- Cliente: application qui envoie une requête au serveur. Dans ce cas, le client peut être une application mobile demandant le solde du compte d'un utilisateur. Dans le monde moderne, où l'utilisation de l'IA est de plus en plus courante, le client pourrait être l'agent d'IA demandant l'utilisation d'un outil pour effectuer une action donnée. Dans tous les cas, c'est le client qui envoie la demande. Par conséquent, le client ne reçoit aucune information non demandée.

- Serveur: Un serveur est celui qui reçoit la demande du client et envoie une réponse. Dans le cas de l'IA d'entreprise, le serveur est le serveur MCP. MCP est le serveur standardisé utilisé comme enveloppe autour de l'API interne ou de l'outil. Par conséquent, c'est le serveur qui envoie la réponse une fois la demande traitée.

- Points finaux: il s'agit des URL définies que le client utilise pour accéder au serveur. Par conséquent, les points de terminaison définissent les fonctions que le serveur est capable de gérer.

- Protocoles: Les protocoles de communication tels que HTTP ou WebSockets définissent les normes de communication pour le transfert de données. Le protocole HTTP est à la base de la plupart des API REST, où la requête se compose d'une méthode (GET, POST, PUT, DELETE), d'en-têtes et d'un corps facultatif, et la réponse se compose d'un code d'état et d'un corps. Les WebSockets fournissent une connexion permanente pour les communications en temps réel, telles que la sortie d'un agent ou la transcription de l'IA vocale. D'autres protocoles tels que Server-Sent Events (SSE) gagnent également du terrain, en particulier dans l'architecture MCP, où le serveur doit envoyer des mises à jour au client sans les frais liés à une connexion WebSocket.

- Authentification et autorisation: Au cœur de toutes les communications API se trouve le mécanisme de sécurité qui contrôle ce que les utilisateurs sont autorisés à accéder à l'API et ce qu'ils peuvent en faire. Les formes d'authentification et d'autorisation les plus courantes incluent l'utilisation d'une clé API, OAuth 2.0 ou JWT.

- Cycle demande-réponse: le modèle demande-réponse d'une API est l'endroit où le client envoie une demande via le protocole, qui est reçue par le serveur sur le point de terminaison. La demande est ensuite reçue et traitée par le serveur, où elle est vérifiée, la logique est exécutée et la réponse est renvoyée dans le format souhaité, tel que JSON ou XML. Le modèle demande-réponse est sans état dans le cas de l'architecture REST, ce qui signifie que la demande est autonome et que le serveur ne stocke pas l'état de la demande ou du client.

- Limitation et régulation du débit: les API disposent de leurs propres mécanismes de sécurité qui limitent le nombre de requêtes envoyées par un client. Ils limitent l'utilisation abusive de leurs ressources et les coûts de ces ressources. Dans le contexte de la passerelle AI, la limitation de débit inclut des limites basées sur des jetons. Dans le cas de la passerelle TrueFoundry AI, la limitation de débit inclut les limites du nombre de jetons qu'un utilisateur ou une application peut utiliser quotidiennement.

Cette structure rend les API flexibles, évolutives et essentielles à la création d'écosystèmes connectés

Quelle est la différence entre MCP et API ?

Le MCP et les API sont tous deux conçus pour connecter des systèmes, mais ils abordent l'intégration sous des angles très différents. MCP vise à fournir aux modèles d'IA un moyen sécurisé et standardisé d'accéder à des outils et à des données externes, tandis que les API sont conçues pour permettre aux applications de communiquer entre elles à l'aide de requêtes et de réponses définies.

Au moment de choisir entre les deux, il est important de les comparer sur des aspects tels que l'architecture, l'évolutivité, la sécurité et l'expérience des développeurs.

Le tableau ci-dessous met en évidence dix différences clés :

MCP permet aux modèles d'IA d'accéder aux outils et aux données en toute sécurité, tandis que les API connectent les applications logicielles de manière fiable. Comprendre leurs différences vous permet de choisir la bonne intégration pour chaque scénario. Ensemble, ils peuvent se compléter pour créer des systèmes évolutifs, sécurisés et efficaces.

Comparaison de l'architecture de base

Il est essentiel de comprendre la différence fondamentale entre les architectures API et MCP pour créer des systèmes évolutifs, sécurisés et efficaces. Bien que les deux visent à faciliter la communication entre les composants, leurs philosophies de conception et leurs implémentations techniques diffèrent considérablement.

MCP (Model Context Protocol)

Le MCP est conçu pour les flux de travail pilotés par l'IA et le LLM, permettant aux modèles d'interagir de manière sécurisée et efficace avec des outils externes, des sources de données et des services de manière structurée et standardisée. Son architecture multicouche, modulaire et contextuelle en fait la solution idéale pour les agents d'IA autonomes d'aujourd'hui, les applications d'entreprise en temps réel et les tâches de raisonnement en plusieurs étapes.

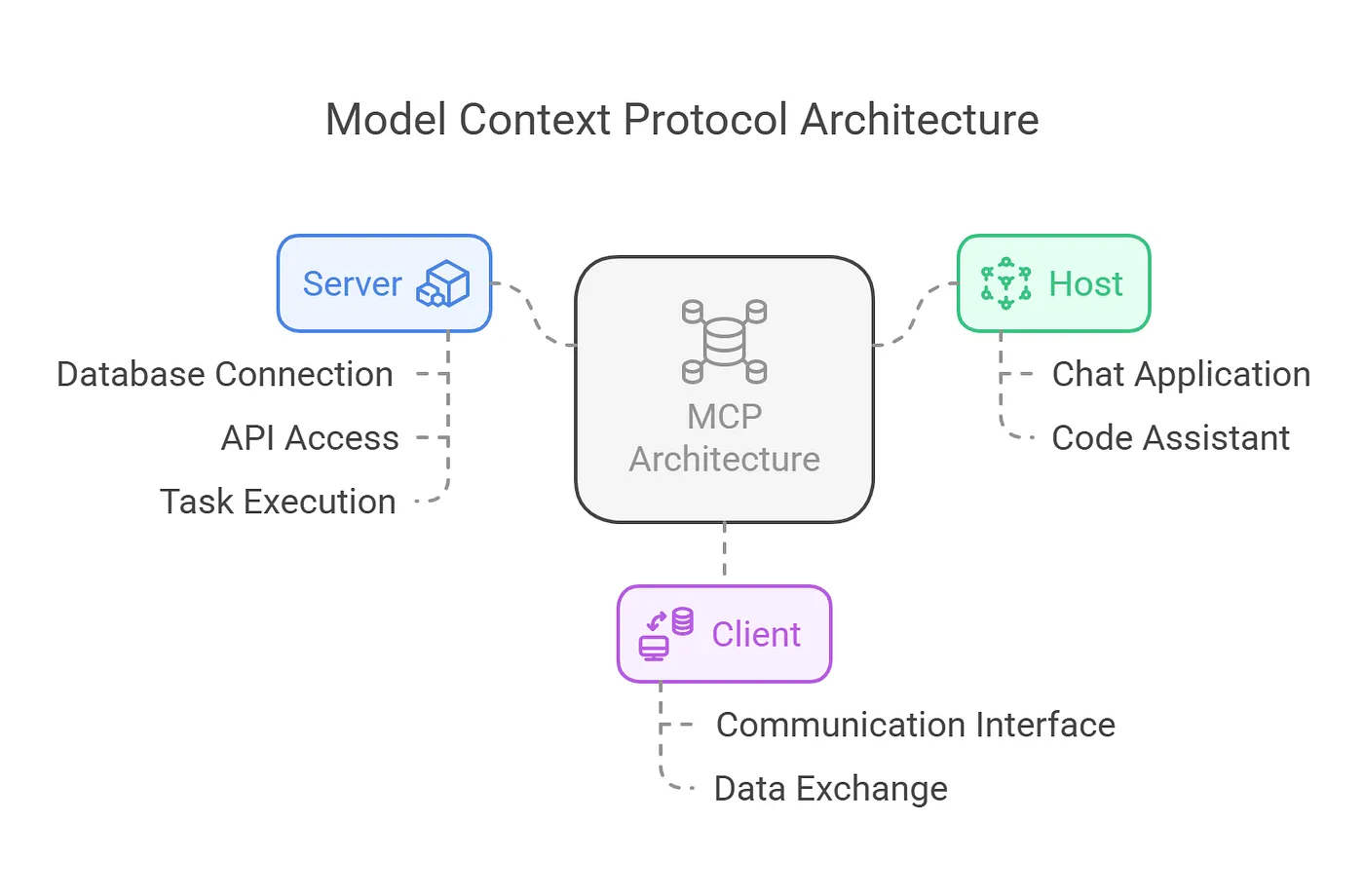

Composantes clés :

- Couche client : Les modèles ou agents d'IA initient des demandes, interprètent les fonctionnalités des outils et déterminent les flux d'exécution. Les clients gèrent le contexte local et génèrent des requêtes structurées compatibles avec les schémas de serveur. Cela permet de prendre des décisions adaptatives en temps réel, ce qui est crucial pour les assistants IA autonomes et les agents IA d'entreprise.

- Couche serveur : Expose des outils, des ensembles de données ou des services avec des schémas lisibles par machine. Les serveurs permettent la découverte dynamique des fonctionnalités, ce qui permet aux modèles de s'adapter sans modifier le code. Cela est essentiel pour les déploiements d'IA dans le cloud hybride et l'orchestration à la demande de plusieurs API ou services.

- Couche de transport et de contrôle d'accès : La communication s'effectue via JSON-RPC, HTTP ou les transports stdio. Les hôtes appliquent des contrôles d'autorisation stricts, isolent les sessions et contrôlent les autorisations. Cela garantit un traitement sécurisé des données sensibles ou réglementées, réduisant ainsi les risques liés aux flux de travail d'IA de niveau entreprise.

- Schéma et registre des capacités : MCP utilise des schémas structurés pour définir les entrées, les sorties et les contraintes des outils. Cela permet aux LLM de raisonner sur l'utilisation des outils en toute sécurité, en garantissant la conformité, des actions autonomes sécurisées et des flux de travail en plusieurs étapes efficaces dans les applications d'IA modernes.

API (interface de programmation d'applications)

Les API sont conçues pour l'intégration d'applications à des fins générales, en mettant l'accent sur les modèles de demande-réponse prévisibles, l'évolutivité et l'interopérabilité entre divers systèmes. Ils restent la pierre angulaire des logiciels d'entreprise, des services cloud et des applications Web, fournissant une connectivité fiable pour les flux de travail traditionnels et modernes pilotés par l'IA.

Composantes clés :

- Couche client : Les applications ou les services lancent des requêtes vers les terminaux des serveurs, en gérant les jetons d'authentification, les limites de débit, les nouvelles tentatives et la mise en cache locale. Cela garantit des performances et une fiabilité robustes dans les environnements d'entreprise ou cloud à volume élevé.

- Couche serveur : Héberge des terminaux et définit des contrats de ressources ou d'action. Les serveurs gèrent l'analyse des demandes, la validation des données, le traitement et le formatage des réponses, renvoyant généralement des charges utiles JSON, XML ou spécifiques au protocole. Cette couche prend en charge des flux de travail prévisibles et standardisés essentiels pour les systèmes critiques.

- Points de terminaison et protocoles : REST, GraphQL, SOAP ou WebSockets régissent la communication et prennent en charge les opérations synchrones ou asynchrones. Les terminaux structurés fournissent des modèles d'accès cohérents, permettant une intégration fluide avec les systèmes existants, les plateformes SaaS et les applications cloud natives.

- Couche de sécurité et de gouvernance : Met en œuvre les clés d'API, OAuth, l'authentification JWT, la limitation et les politiques CORS. La journalisation et la limitation du débit garantissent la conformité, l'auditabilité et la protection contre les abus, ce qui est de plus en plus important dans les secteurs réglementés et les déploiements multicloud

Analyse des cas d'utilisation

Dans les applications du monde réel, l'API et le MCP jouent des rôles différents mais complémentaires. MCP permet aux modèles d'IA d'interagir de manière dynamique avec plusieurs outils et ensembles de données, tandis que les API fournissent une connectivité standardisée et fiable entre les systèmes logiciels. Comprendre leurs applications pratiques aide les organisations à choisir la bonne stratégie d'intégration.

-les applications mondiales, les MCP et les API jouent des rôles différents mais complémentaires. MCP permet aux modèles d'IA d'interagir de manière dynamique avec plusieurs outils et ensembles de données, tandis que les API fournissent une connectivité standardisée et fiable entre les systèmes logiciels. Comprendre leurs applications pratiques aide les organisations à choisir la bonne stratégie d'intégration.

Le MCP est idéal pour les flux de travail d'IA dynamiques et sensibles au contexte, tandis que les API excellent dans l'intégration logicielle structurée et prévisible. En tirant parti des deux, les entreprises peuvent créer des systèmes dans lesquels les modèles d'IA utilisent intelligemment les données et les services pilotés par les API pour fournir des solutions plus intelligentes en temps réel.

Sécurité et gouvernance

La sécurité et la gouvernance sont des considérations essentielles à la fois pour le MCP et les API, mais elles répondent à des défis différents en fonction de leur conception et de leurs cas d'utilisation.

Le MCP (Model Context Protocol) se concentre sur les interactions sécurisées entre les modèles d'IA. Son architecture inclut des contrôles d'accès gérés par l'hôte, une isolation des sessions et une sécurité au niveau du transport. MCP permet aux hôtes de définir les outils, les ensembles de données ou les services auxquels un modèle peut accéder, réduisant ainsi le risque d'actions non autorisées ou de fuites de données. Les descriptions d'outils basées sur des schémas aident les modèles à comprendre les contraintes d'entrée/sortie, évitant ainsi les abus accidentels ou les attaques par injection. La journalisation et l'audit des interactions entre les modèles et les outils permettent de suivre la gouvernance et la conformité dans les environnements d'entreprise. Le modèle de sécurité de MCP est particulièrement adapté aux applications d'IA agentiques où les LLM exécutent des flux de travail en plusieurs étapes sur des sources de données sensibles.

La sécurité et la gouvernance des API mettent l'accent sur la protection et la standardisation au niveau des applications. Les API mettent en œuvre des mécanismes d'authentification et d'autorisation tels que les clés d'API, les jetons OAuth et JWT, ainsi que la limitation et la limitation du débit pour éviter les abus ou les surcharges. Les politiques de journalisation, de surveillance et de gestion des versions garantissent la conformité, la traçabilité et la rétrocompatibilité entre les systèmes. Les entreprises peuvent appliquer des politiques de gouvernance au niveau de la passerelle API, en contrôlant qui peut accéder à quels terminaux et dans quelles conditions.

MCP donne la priorité à la sécurité contextuelle et spécifique à l'IA, tandis que les API fournissent une sécurité et une gouvernance des applications étendues et standardisées. L'utilisation combinée des deux permet aux entreprises de maintenir une sécurité robuste sur les flux de travail pilotés par l'IA et les intégrations logicielles traditionnelles.

Expérience pour les développeurs

L'expérience des développeurs joue un rôle crucial dans l'adoption et la productivité du MCP et des API. Le MCP (Model Context Protocol) est conçu pour rationaliser l'intégration des modèles d'IA avec des outils externes, en proposant des SDK, des serveurs de référence et des bibliothèques clientes dans plusieurs langages de programmation.

Les développeurs peuvent configurer rapidement des hôtes et des serveurs, définir des schémas d'outils et connecter des LLM à des services sans devoir recourir à un code standard complet. Ses fonctionnalités structurées de transport JSON-RPC, de validation de schéma et de découverte dynamique réduisent les erreurs et simplifient le débogage dans les flux de travail d'IA complexes.

MCP :

- SDK et implémentations de référence dans plusieurs langues

- Découverte dynamique d'outils et validation de schémas pour les LLM

- Gestion des erreurs intégrée et prise en charge du débogage pour les flux de travail d'IA

Les API, en revanche, offrent un écosystème mature pour l'intégration logicielle générale. Les développeurs bénéficient de spécifications standardisées telles qu'OpenAPI/Swagger, des bibliothèques clientes et des passerelles API qui simplifient l'authentification, la gestion des versions et la surveillance. Des contrats de terminaux clairs et une documentation complète rendent l'intégration et la maintenance prévisibles. Les outils de test, de simulation et de surveillance des API améliorent la productivité des développeurs tout en garantissant la stabilité et la sécurité des intégrations.

API :

- Spécifications normalisées (OpenAPI/Swagger) et contrats de terminaux

- Bibliothèques clientes, passerelles et outils de surveillance pour une intégration fluide

- Une documentation complète et des cadres de test pour la fiabilité

Dans l'ensemble, MCP optimise le développement axé sur l'IA, facilitant ainsi l'orchestration de plusieurs outils, tandis que les API fournissent un support robuste et standardisé aux développeurs pour les applications logicielles générales.

Performances et évolutivité

Les performances et l'évolutivité sont essentielles à la fois pour le MCP et les API, mais leurs objectifs de conception diffèrent en raison de leurs cas d'utilisation cibles

Communication à faible latence

Le MCP est optimisé pour les flux de travail pilotés par l'IA, permettant des interactions à faible latence entre les clients LLM et plusieurs serveurs d'outils à l'aide de JSON-RPC via HTTP ou stdio. Les schémas structurés réduisent les frais de traitement, garantissant des réponses rapides aux tâches d'IA en plusieurs étapes. Les API, quant à elles, s'appuient sur REST, GraphQL ou WebSockets, fournissant une latence prévisible pour les requêtes générales des applications. Bien que les API soient très fiables, elles peuvent ne pas s'adapter de manière dynamique à des flux de travail d'IA complexes et multi-outils en temps réel.

Mise à l'échelle horizontale et simultanéité

MCP prend en charge la mise à l'échelle horizontale via plusieurs instances de serveur gérant des demandes de modèle simultanées. L'isolation des sessions évite les conflits de flux de travail et garantit des performances constantes. Les API évoluent également horizontalement sur les serveurs distribués et l'infrastructure cloud, gérant de grands volumes de demandes clients grâce à l'équilibrage de charge, à la mise en cache et à la limitation. Alors que la mise à l'échelle des API est mature et bien comprise, la mise à l'échelle MCP se concentre spécifiquement sur les opérations d'IA parallèles avec un accès dynamique aux outils.

Efficacité et optimisation des flux de travail

La conception basée sur des schémas de MCP permet aux modèles d'IA de raisonner sur les capacités des outils et d'exécuter des tâches efficacement, en minimisant les calculs redondants et la récupération de données. Les API gagnent en efficacité grâce à des points de terminaison optimisés, à des stratégies de mise en cache et à des outils de surveillance qui garantissent le débit et la fiabilité. Contrairement au MCP, l'efficacité des API est centrée sur des modèles de demande-réponse prévisibles et généraux plutôt que sur un raisonnement dynamique basé sur l'IA.

MCP garantit des opérations à faible latence et optimisées pour l'IA, tandis que les API fournissent des performances évolutives et robustes pour les communications logicielles traditionnelles, excellant dans leurs domaines respectifs.

MCP ou API : quand utiliser chacun d'entre eux ?

Le choix entre le MCP et les API dépend du flux de travail, des besoins des applications et du niveau d'intégration de l'IA requis :

Utilisez MCP lorsque :

- Vous avez besoin de flux de travail d'IA dynamiques et contextuels qui peuvent accéder à plusieurs outils ou sources de données en temps réel.

- Les LLM ou les agents IA doivent raisonner, orchestrer et s'adapter à l'évolution des entrées sans scripts prédéfinis.

- La sécurité, l'isolation des sessions et la gouvernance pour les opérations d'IA autonomes sont essentielles.

- Vous créez des systèmes d'IA agentiques, des assistants intelligents ou des pipelines de prise de décision en plusieurs étapes.

Utilisez les API lorsque :

- Vous avez besoin d'une intégration prévisible et fiable entre les applications ou les services traditionnels.

- Les flux de travail impliquent des modèles de demande-réponse structurés et prédéfinis plutôt qu'un raisonnement dynamique basé sur l'IA.

- L'évolutivité, la surveillance et la conformité des systèmes logiciels d'entreprise sont des priorités.

- Vous connectez des systèmes existants, des plateformes SaaS ou des services cloud qui exposent les terminaux à des fins de données ou d'actions.

Quel est le lien entre le MCP et l'API ?

Le MCP et les API sont des technologies complémentaires qui fonctionnent souvent ensemble dans les écosystèmes modernes d'IA et de logiciels. Alors que les API fournissent des points de terminaison stables et standardisés pour accéder aux services, aux bases de données et aux applications, MCP permet aux modèles et aux agents d'IA de découvrir, de raisonner et d'orchestrer ces outils de manière dynamique en temps réel.

MCP utilise essentiellement les API comme interface sous-jacente, ajoutant la prise en compte du contexte, la prise de décision adaptative et l'orchestration des flux de travail en plusieurs étapes en plus des fonctionnalités prévisibles fournies par les API.

Cette combinaison permet aux entreprises de créer des systèmes dans lesquels les modèles d'IA peuvent interagir intelligemment avec les services pilotés par API, garantissant à la fois flexibilité et fiabilité.

En 2026, ces architectures hybrides MCP-API deviendront de plus en plus standard dans l'IA d'entreprise, prenant en charge les agents autonomes, les flux de travail sécurisés et la prise de décisions en temps réel sans compromettre l'interopérabilité ou les performances.

L'avenir du MCP et des API

Alors que l'IA continue d'évoluer, le MCP et les API façonnent la façon dont les systèmes intelligents interagissent avec les outils et les données. Comprendre leurs rôles futurs aide les organisations à créer des flux de travail adaptatifs, sécurisés et efficaces pilotés par l'IA.

MCP en tant qu'interface d'IA standardisée : Le MCP évolue en tant qu'interface universelle indépendante du modèle, parfois appelée « USB-C pour l'IA ». Il permet aux agents d'IA de se connecter de manière fluide à un large éventail d'applications et de services sans avoir besoin d'intégrations personnalisées et codées en dur pour chaque outil.

Découverte et utilisation dynamiques des outils : Contrairement aux API traditionnelles, qui nécessitent des points de terminaison prédéfinis et un codage manuel pour chaque interaction, MCP permet aux modèles d'IA de découvrir et d'interagir avec de nouveaux outils de manière dynamique. Cela rend les flux de travail d'IA plus adaptatifs et capables de répondre à l'évolution des besoins de l'entreprise en temps réel.

De l'accès aux données aux actions contrôlées : Alors que les API fournissent principalement des données brutes et structurées pour des systèmes fiables, MCP permet aux agents d'IA d'exécuter des tâches en toute sécurité, d'interpréter des réponses complexes et de gérer des commentaires d'erreur riches et structurés. Cela permet des opérations d'IA plus sûres et plus autonomes dans les environnements d'entreprise.

Architecture hybride — API encapsulées : Le MCP ne remplace pas les API ; au contraire, il les complète en agissant comme une couche qui rend les données et les services pilotés par les API utilisables pour l'IA. Les API continuent de gérer des terminaux fiables et standardisés, tandis que MCP ajoute des fonctionnalités d'intelligence, de prise en compte du contexte et d'orchestration.

Expansion rapide de l'écosystème : L'écosystème MCP se développe rapidement, avec des centaines de serveurs et de services développés par la communauté qui permettent aux modèles d'IA d'interagir avec des applications et des outils du monde réel. Cela accélère l'adoption de l'IA agentique, permettant des flux de travail plus intelligents et autonomes qui combinent un raisonnement en temps réel avec un accès aux données sécurisé et fiable.

Conclusion

Le MCP et les API jouent des rôles distincts mais complémentaires dans les écosystèmes logiciels et d'IA modernes. MCP excelle dans les flux de travail contextuels pilotés par l'IA, permettant aux LLM d'accéder de manière dynamique à de multiples outils et ensembles de données tout en maintenant des interactions sécurisées et structurées.

Les API fournissent une communication robuste et standardisée entre les applications, les microservices et les plateformes externes, garantissant ainsi des performances et une évolutivité prévisibles. Comprendre les différences en termes d'architecture, de cas d'utilisation, de sécurité, d'expérience des développeurs et de performances permet aux entreprises de choisir la bonne stratégie d'intégration.

En combinant les capacités centrées sur l'IA de MCP avec la connectivité polyvalente des API, les équipes peuvent créer des systèmes intelligents, efficaces et sécurisés qui répondent à la fois aux besoins de l'IA et des logiciels traditionnels.

Questions fréquemment posées

Quand utiliser le MCP par rapport à l'API ?

Utilisez les API traditionnelles pour établir des connexions fixes, codées par le développeur, entre les systèmes logiciels. Choisissez MCP lorsque vous permettez aux agents IA d'interagir de manière dynamique avec plusieurs outils. MCP est idéal pour les environnements de production dans lesquels les modèles doivent découvrir des ressources et récupérer du contexte sans configurer manuellement les terminaux pour chaque nouvelle intégration.

Le MCP remplacera-t-il l'API ?

Non, MCP fonctionne comme un wrapper standardisé plutôt que comme un substitut aux API traditionnelles. Il résume les points de terminaison d'API existants dans un schéma lisible par machine que les LLM peuvent comprendre. En utilisant conjointement le MCP et l'API, les entreprises tirent parti de leur infrastructure existante tout en la rendant accessible aux agents d'IA autonomes via une interface universelle.

Quand le MCP est-il meilleur que l'API ?

Dans le contexte du MCP par rapport à l'API, le MCP convient mieux aux flux de travail agentiques nécessitant une orchestration multi-outils. Il excelle lorsque les modèles d'IA doivent choisir entre différentes sources de données de manière dynamique. L'utilisation d'une passerelle centralisée telle que TrueFoundry pour gérer ces connexions MCP fournit la gouvernance, la sécurité et l'audit qui font défaut aux intégrations d'API de base.

Est-ce que MCP est la même chose qu'une API ?

Non, le MCP et les API ne sont pas identiques. Les API fournissent des points de terminaison fixes et standardisés pour l'intégration logicielle, tandis que le MCP est conçu pour les flux de travail AI/LLM, permettant la découverte dynamique d'outils, une orchestration contextuelle et un raisonnement structuré. MCP utilise souvent des API comme interfaces sous-jacentes, mais ajoute de l'intelligence, de l'adaptabilité et une exécution sécurisée en plusieurs étapes.

Le MCP est-il plus rapide que l'API ?

Le MCP n'est pas intrinsèquement plus rapide que les API pour le transfert de données brutes. Il est plutôt optimisé pour les flux de travail d'IA, réduisant ainsi les frais liés au raisonnement en plusieurs étapes et à l'orchestration des outils. Les API fournissent une latence prévisible pour les requêtes standard, tandis que MCP donne la priorité aux interactions dynamiques et à la prise de décisions contextuelles, améliorant ainsi l'efficacité des tâches complexes pilotées par l'IA.

Comment convertir une API en serveur MCP ?

Pour convertir une API en serveur MCP, définissez des schémas lisibles par machine pour les points de terminaison, les entrées et les sorties de l'API. Implémentez une couche serveur exposant ces outils via les protocoles de transport de MCP (JSON-RPC/HTTP). Ajoutez des contrôles d'accès, une isolation de session et des métadonnées pour le raisonnement de l'IA, permettant ainsi aux LLM de découvrir et d'utiliser l'API de manière dynamique en toute sécurité.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)