Langfuse vs Portkey : principales différences et fonctionnalités

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Une application LLM de production échoue d'une manière qui mettrait mal à l'aise les ingénieurs logiciels traditionnels. Votre chatbot commence à halluciner des informations sur les produits, votre système RAG renvoie des documents non pertinents ou votre assistant IA commence à effectuer des appels d'API coûteux en boucle. Contrairement aux serveurs Web qui tombent en panne de manière visible ou aux bases de données qui émettent des messages d'erreur clairs, les défaillances LLM apparaissent souvent comme une dégradation subtile de la qualité de réponse qui peut persister pendant des heures avant que quiconque ne s'en aperçoive.

Ce défi fondamental en matière d'observabilité concerne toutes les organisations qui utilisent l'IA en production. Contrairement aux logiciels traditionnels, dans lesquels vous pouvez suivre chaque requête de base de données et chaque appel d'API, les applications LLM fonctionnent dans une boîte noire où une seule invite utilisateur peut déclencher des dizaines d'appels de modèle, des opérations de récupération complexes et des chaînes de raisonnement en plusieurs étapes. En cas de problème, les équipes se retrouvent à déboguer dans le noir.

Le marché de l'observabilité LLM a répondu avec des dizaines de solutions, mais deux plateformes sont devenues très populaires ces derniers temps : Langfuse, le chouchou de l'open source avec 15,5 000 étoiles GitHub, et Portkey, la plateforme complète traitant plus de 2,5 billions de jetons. Chacune adopte une approche fondamentalement différente pour résoudre le même problème critique : comment voyez-vous ce que fait réellement votre IA ?

Qu'est-ce que Langfuse ?

Langfuse est une plateforme d'observabilité et d'analyse open source pour les applications alimentées par LLM. Il vous permet de suivre les demandes, les réponses, les coûts et les commentaires des utilisateurs en un seul endroit. Avec Langfuse, les équipes peuvent mieux comprendre, déboguer et optimiser leurs flux de travail d'IA.

Langfuse est devenu le choix incontournable pour les équipes qui souhaitent une observabilité LLM complète sans dépendance vis-à-vis d'un fournisseur. Construite par une équipe berlinoise après avoir utilisé Y Combinator, la plateforme a attiré plus de 40 000 utilisateurs actifs et a levé 4,5 millions de dollars de financement, ce qui est impressionnant pour un projet open source.

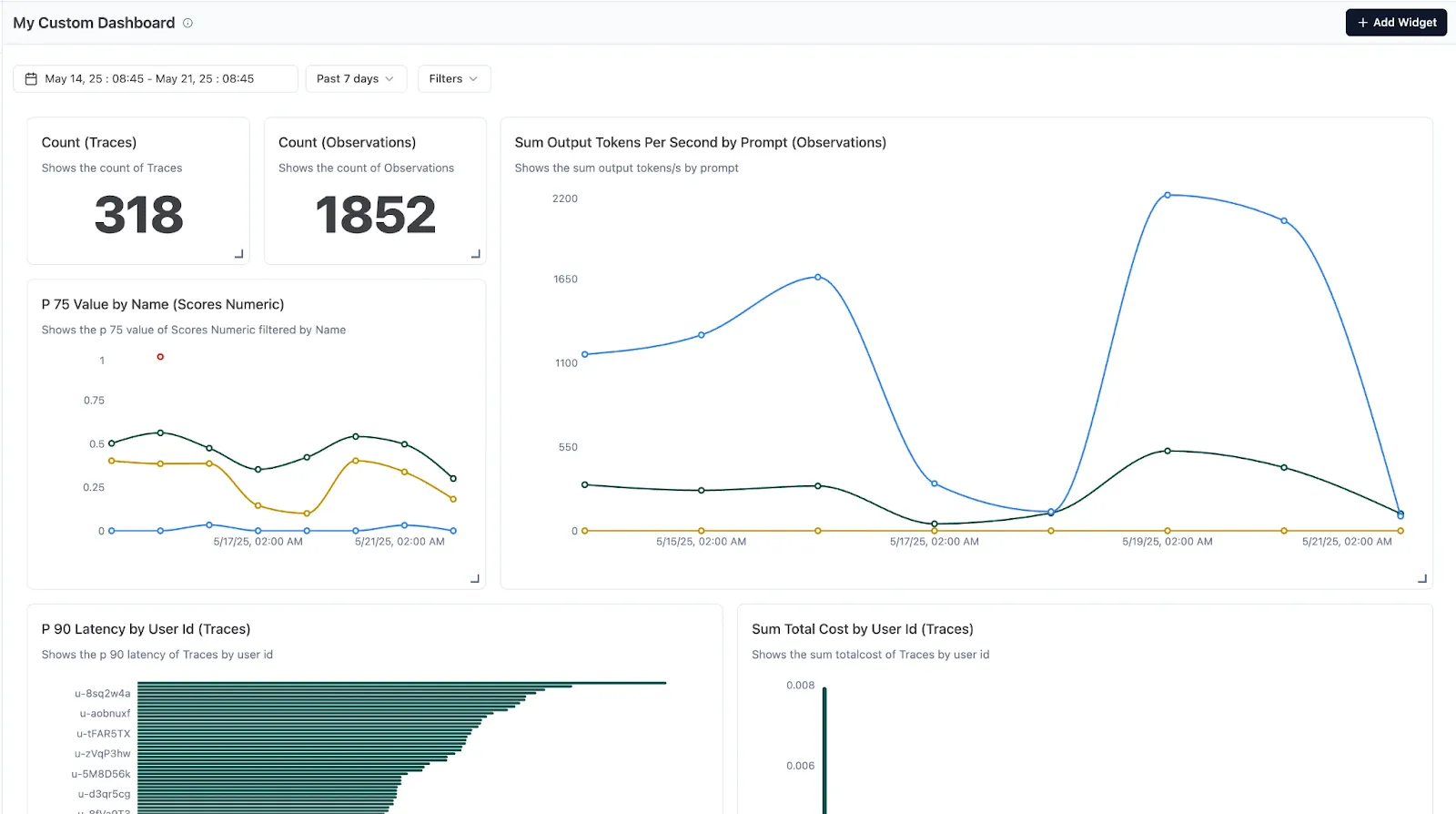

Architecture de traçabilité avancée

Le système de traçage hiérarchique de Langfuse crée une carte complète de chaque interaction au sein de votre pile d'applications LLM. Chaque trace représente une session utilisateur ou un flux de travail complet, avec des intervalles imbriqués capturant des opérations individuelles telles que les appels de modèles, les extractions, les exécutions de fonctions et les transformations de données. Cette structure arborescente reflète le flux d'exécution réel d'applications d'IA complexes.

Une architecture technique évolutive

La nouvelle architecture basée sur Clickhouse de Langfuse est conçue dans un souci de performance et d'évolutivité. Elle permet un traitement beaucoup plus rapide de la plupart des requêtes et gère plus d'un milliard de lignes et des dizaines de gigaoctets de données par serveur et par seconde. Cela permet aux entreprises clientes telles que Twilio et Khan Academy d'exécuter des charges de travail de production à grande échelle, Khan Academy étant déployée auprès de plus de 100 utilisateurs répartis sur 7 produits et 4 équipes d'infrastructure.

Sécurité de niveau professionnel

Pour un projet open source, Langfuse prend la sécurité très au sérieux. Ils ont obtenu les certifications SOC 2 Type II et ISO 27001, la conformité HIPAA étant disponible pour les applications de santé. La plateforme prend en charge à la fois les déploiements dans le cloud et les déploiements auto-hébergés, donnant aux entreprises soucieuses de leur sécurité un contrôle total sur leurs données.

L'avantage de l'open source

Ce qui distingue Langfuse, c'est son engagement en faveur de l'ouverture. L'intégralité de la base de code est disponible sur GitHub, les API d'exportation de données ne sont soumises à aucune restriction et il n'existe aucune barrière artificielle entre les niveaux gratuits et payants. Cette philosophie trouve un écho fort auprès des équipes d'ingénieurs qui ont été épuisées par la dépendance vis-à-vis des fournisseurs.

La communauté a réagi avec enthousiasme. La documentation inclut des intégrations pour tous les principaux frameworks LLM : LangChain, LLamaIndex, OpenAI SDK, Anthropic SDK et des dizaines d'autres. Les connecteurs fournis par la communauté gèrent les cas extrêmes que les plateformes propriétaires ignorent souvent.

Les limites du monde réel

Malgré ses atouts, Langfuse fait face à des défis qui apparaissent à grande échelle. La courbe d'apprentissage est abrupte. Les équipes déclarent avoir passé des semaines à comprendre l'ensemble des fonctionnalités avant d'en percevoir la valeur. L'interface peut sembler écrasante pour les cas d'utilisation simples où les équipes souhaitent simplement suivre les coûts et les performances de base.

Les besoins en ressources augmentent rapidement avec l'utilisation. Bien que les spécifications minimales semblent raisonnables, les déploiements de production nécessitent souvent beaucoup plus de mémoire et de calcul que ce qui est annoncé. L'exigence ClickHouse, bien que puissante, ajoute une complexité opérationnelle que toutes les équipes ne souhaitent pas gérer.

Plus important encore, Langfuse est purement une plateforme d'observabilité. Les équipes ont besoin de solutions distinctes pour le routage LLM, la gestion des solutions de secours, la limitation des débits et le contrôle des coûts. Cela fonctionne bien pour les organisations dotées d'équipes d'infrastructure solides, mais pose des problèmes d'intégration pour les autres.

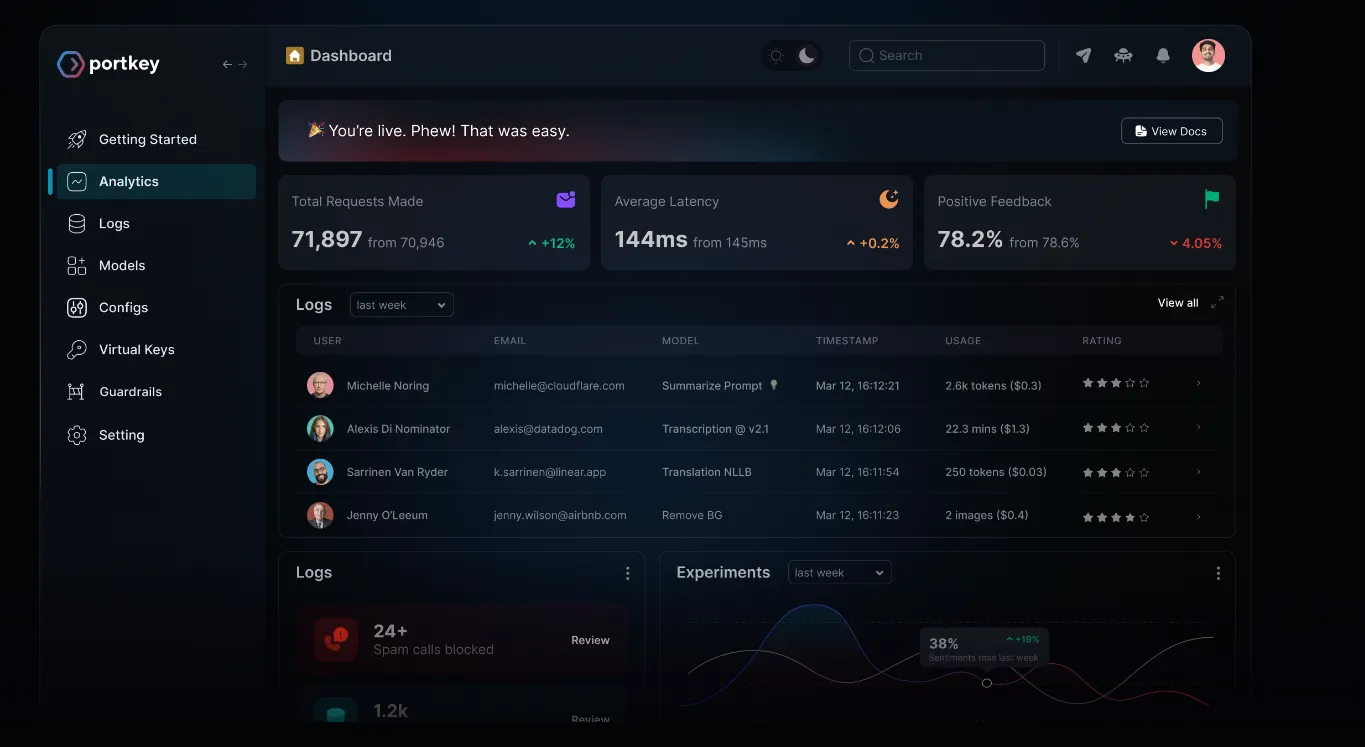

Qu'est-ce que Portkey ?

Portkey est une plateforme qui permet de gérer et d'optimiser l'utilisation du LLM chez différents fournisseurs. Il propose des fonctionnalités telles que la mise en cache, le repli, la limitation du débit et l'observabilité pour rendre les applications d'IA plus fiables et plus rentables. Les équipes utilisent Portkey pour rationaliser leur infrastructure d'IA et évoluer en toute confiance.

Portkey a créé une plate-forme d'infrastructure d'IA complète qui va bien au-delà de l'observabilité et s'étend au domaine des opérations LLM de production. Au service de plus de 650 organisations et traitant plus de 2,5 billions de jetons, Portkey se positionne comme une solution pour les équipes d'IA des entreprises.

Couverture complète des fonctionnalités

Contrairement aux plateformes d'observabilité pure, Portkey fournit l'ensemble des fonctionnalités d'infrastructure LLM (une infrastructure AI Gateway complète). L'approche axée sur la configuration de la plateforme permet aux équipes de définir une logique de routage complexe, des stratégies de repli et des politiques de gouvernance sans modifier le code. Cela intéresse les organisations qui ont besoin d'opérations LLM sophistiquées mais qui ne disposent pas des ressources d'ingénierie nécessaires pour tout créer à partir de zéro.

Conception axée sur l'entreprise

L'orientation commerciale de Portkey se reflète dans ses certifications de conformité complètes : SOC 2 Type II, ISO 27001, HIPAA et GDPR. La plateforme prend en charge des modèles de déploiement allant du SaaS aux installations sur site entièrement ventilées.

Le contrôle d'accès basé sur les rôles s'intègre aux fournisseurs d'identité d'entreprise, la journalisation des audits répond aux exigences réglementaires et la plateforme fournit une attribution détaillée des coûts entre les équipes, les projets et les centres de coûts. Ces fonctionnalités sont extrêmement importantes pour les grandes organisations où l'utilisation du LLM peut rapidement devenir ingouvernable.

Vérification de la réalité des performances

C'est là que l'approche globale de Portkey révèle ses coûts. Une analyse comparative indépendante montre que Portkey fonctionne nettement plus lentement que les passerelles spécialisées, avec une latence de 228 % supérieure à celle de Kong AI Gateway lors de tests standardisés. Même les affirmations de Portkey concernant une latence supplémentaire de 20 à 40 ms peuvent devenir problématiques pour les applications sensibles à la latence.

La baisse des performances provient de l'architecture riche en fonctionnalités de Portkey. Chaque demande passe par plusieurs niveaux : logique de routage, évaluation des garde-fous, gestion rapide, collecte de l'observabilité et calcul des coûts. Bien que chaque fonctionnalité apporte une valeur ajoutée, elles génèrent collectivement des frais généraux importants.

La consommation de ressources reflète cette complexité. Les déploiements de clés de port de production nécessitent beaucoup plus de calcul et de mémoire que les solutions de passerelle pures. Les équipes signalent des difficultés à optimiser les performances des applications haut débit.

Complexité des prix

Le modèle de tarification de Portkey reflète sa nature globale mais pose des problèmes de prévisibilité. La plateforme propose plusieurs niveaux :

- Démarreur: 49$ par mois pour les fonctionnalités de base

- Production: Tarification basée sur l'utilisation avec divers modules complémentaires

- Entreprise: tarification personnalisée avec accès à toutes les fonctionnalités

Le modèle basé sur l'utilisation peut créer des surprises budgétaires à grande échelle, ce qui pousse de nombreuses organisations à envisager alternatives à portkey. Contrairement à la simple tarification par demande, les coûts de Portkey varient en fonction de l'utilisation des fonctionnalités, des périodes de conservation des données et des exigences de conformité. Les équipes signalent des difficultés à prévoir les coûts mensuels, en particulier pendant les phases de développement où les schémas de trafic sont imprévisibles.

L'accent mis par la plateforme sur l'orchestration des API externes limite également la flexibilité. Les organisations qui souhaitent déployer des modèles auto-hébergés ou implémenter une logique de routage personnalisée peuvent être limitées par les décisions d'architecture de Portkey.

Langfuse et Portkey : principales différences

Lorsque l'on compare Langfuse et Portkey, les principales différences se situent au niveau de l'objectif et de la portée. Langfuse est conçu comme une couche d'observabilité et d'évaluation open source, fournissant aux développeurs des informations détaillées sur les instructions, les coûts et les performances des modèles.

Portkey, quant à elle, se positionne comme une passerelle d'IA complète, combinant l'observabilité à des fonctionnalités avancées telles que le routage multimodèle, la mise en cache, les garde-corps et la gouvernance. Langfuse est essentiellement axé sur la transparence et le débogage, tandis que Portkey est axé sur la fiabilité et l'évolutivité des charges de travail de production.

Voici les principales différences entre les deux plateformes :

Langfuse et Portkey apportent tous deux des atouts uniques au développement du LLM. Langfuse convient parfaitement aux équipes qui souhaitent une observabilité open source, une évaluation détaillée et un contrôle complet de leurs flux de travail. Portkey, en revanche, est le meilleur choix pour les organisations axées sur l'évolutivité, la fiabilité et la gestion d'une infrastructure multimodèle au niveau de la production.

Langfuse vs Portkey : quand utiliser Portkey

Portkey est conçu pour les équipes qui vont au-delà de l'expérimentation et passent à la production avec des LLM. Il sert de passerelle d'IA universelle, de couche d'observabilité et d'outil de gouvernance, ce qui en fait la solution idéale lorsque la fiabilité, l'évolutivité et la flexibilité multifournisseurs sont importantes.

Accès multimodèle et multifournisseur : Si votre application doit fonctionner sur plusieurs LLM (OpenAI, Anthropic, Cohere, Mistral ou modèles open source), l'API unifiée de Portkey supprime le verrouillage du fournisseur. Vous pouvez échanger ou router entre plus de 250 modèles sans avoir à réécrire le code, ce qui est essentiel pour la résilience et l'optimisation des performances.

Fiabilité à grande échelle : Pour les charges de travail de production, Portkey propose des nouvelles tentatives automatiques, un basculement, des disjoncteurs et un routage conditionnel. Ces fonctionnalités garantissent une disponibilité et des performances constantes, même en cas de trafic intense ou lorsqu'un fournisseur connaît des pics de latence.

Optimisation des coûts et de la latence : La mise en cache simple et sémantique intégrée réduit les demandes redondantes, réduit les coûts d'inférence et accélère les réponses. Cela est particulièrement utile pour les applications qui font l'objet de requêtes répétées ou de bases d'utilisateurs très fréquentées.

Sécurité et gouvernance : Portkey gère les informations d'identification de l'API via des clés virtuelles, applique des limites de débit et applique les contrôles budgétaires. Il comprend également plus de 50 garde-corps pour filtrer les sorties dangereuses ou non conformes, ce qui le rend prêt pour les entreprises.

Flux de travail agentiques et complexes : Lors de la création d'agents d'IA ou de systèmes multi-agents, Portkey fournit la couche d'orchestration qui gère le routage, l'observabilité et les garde-fous entre les agents, garantissant ainsi la stabilité des flux de travail à mesure qu'ils évoluent.

Utilisez Portkey lorsque vous devez faire évoluer les applications LLM de manière fiable, optimiser les coûts, gérer plusieurs fournisseurs et appliquer une gouvernance de niveau entreprise, le tout à partir d'un seul plan de contrôle.

Langfuse vs Portkey : quand utiliser Langfuse

Langfuse est conçu pour les équipes qui souhaitent avoir une visibilité approfondie sur le comportement de leurs applications LLM. Il s'agit d'une plateforme d'observabilité et d'évaluation open source, idéale lorsque le débogage, la surveillance et l'amélioration des performances des modèles sont des priorités absolues.

Traçage et observabilité : Utilisez Langfuse lorsque vous avez besoin de traces détaillées de chaque interaction, des invites, des réponses, des appels d'outils, des nouvelles tentatives et de la latence. Il aide les développeurs à suivre le parcours complet d'une demande, ce qui facilite l'identification des goulots d'étranglement ou des erreurs dans les flux de travail LLM complexes.

Gestion et expérimentation rapides : Si votre application repose largement sur une ingénierie rapide, Langfuse est d'une valeur inestimable. Il prend en charge la gestion des versions, les tests sur le terrain de jeu et les expériences rapides côte à côte. Il est ainsi plus facile d'itérer rapidement tout en gardant une trace de ce qui fonctionne le mieux.

Boucles d'évaluation et de rétroaction : Langfuse est livré avec des pipelines d'évaluation intégrés, allant de la notation automatisée LLM-as-a-Judge à l'étiquetage manuel et aux ensembles de données structurés. Utilisez-le lorsque vous souhaitez mesurer systématiquement la précision, la fiabilité ou la satisfaction des utilisateurs.

Open-Source et auto-hébergable : Si votre équipe attache de l'importance à la transparence et au contrôle, Langfuse est entièrement open source et peut être auto-hébergé. Cela le rend particulièrement intéressant pour les startups et les entreprises ayant des exigences strictes en matière de gouvernance des données.

Débogage et amélioration continue : Langfuse excelle lorsque vous vous concentrez sur l'amélioration de la qualité plutôt que sur la simple mise à l'échelle. Il agit comme une « boîte noire » pour votre système d'IA, vous aidant à comprendre les défaillances, à affiner les instructions et à proposer de meilleures expériences. Optez pour Langfuse lorsque vous avez besoin d'informations détaillées, d'évaluations et de flexibilité open source pour améliorer en permanence vos applications LLM.

TrueFoundry : capacité d'entreprise complète

Le paysage de l'infrastructure LLM est aujourd'hui fragmenté : les équipes jonglent souvent avec des outils distincts pour l'observabilité, les passerelles et le déploiement de modèles, ce qui entraîne des compromis en termes de performances et de fonctionnalités. TrueFoundry résout ce problème en proposant un plateforme unifiée qui combine rapidité, fonctionnalités professionnelles et optimisation des coûts.

À la base, TrueFoundry atteint latence inférieure à 3 ms tout en offrant des fonctionnalités complètes de passerelle et d'observabilité. Conçu pour les entreprises de A à Z, il gère l'authentification, l'autorisation et la limitation de débit en mémoire, garantissant ainsi des performances même lorsque les agents effectuent des centaines d'appels d'outils par conversation. Le routage intelligent améliore encore l'efficacité en sélectionnant dynamiquement le meilleur modèle pour chaque demande en fonction des besoins en termes de coûts, de performances et de conformité.

La plateforme prend également en charge modèles de déploiement flexibles(cloud native, sur site, isolée ou hybride), soutenue par les certifications SOC 2 Type 2 et HIPAA. Sa conception native de Kubernetes garantit une intégration fluide à l'infrastructure de l'entreprise.

Sur le plan des coûts, TrueFoundry va au-delà du simple changement de fournisseur avec mise en cache sémantique, la mise à l'échelle automatique et la gestion des ressources tenant compte du trafic, qui aident les entreprises à réduire leurs coûts tout en préservant leur fiabilité.

L'un des principaux facteurs de différenciation est sa excellence des modèles auto-hébergés. TrueFoundry prend en charge les principaux frameworks de service, l'optimisation des GPU et les API unifiées pour les modèles cloud et sur site. Cela permet aux entreprises de déployer des modèles propriétaires en toute sécurité, de réduire la dépendance vis-à-vis des fournisseurs et de répondre aux exigences de souveraineté des données, le tout au sein d'une seule plateforme rationalisée.

Conclusion

Le choix entre Langfuse et Portkey dépend des capacités techniques et des exigences de performance de votre organisation. Langfuse excelle pour les équipes qui accordent la priorité à la flexibilité de l'open source et peuvent gérer la complexité opérationnelle. Portkey convient aux organisations qui ont besoin de fonctionnalités LLMOPS complètes, en acceptant des compromis entre performances et richesse des fonctionnalités.

TrueFoundry élimine ce choix fondamental en proposant moins de 3 ms latence associée à une observabilité de niveau entreprise, au déploiement de modèles unifiés et à une gouvernance complète. Plutôt que de forcer les équipes à utiliser des infrastructures multi-outils complexes, l'architecture unifiée de TrueFoundry fournit les performances, la sécurité et la profondeur opérationnelle requises pour les déploiements d'IA critiques. Alors que les capacités d'IA se banalisent rapidement, l'infrastructure qui permet un déploiement fiable, observable et rentable devient le véritable facteur de différenciation.

Questions fréquemment posées

Quelle est la différence entre Langfuse et Portkey ?

Si l'on compare Langfuse à Portkey, la principale différence réside dans leur orientation fonctionnelle : Langfuse est une plateforme spécialisée d'observabilité et de traçage, tandis que Portkey est principalement une passerelle d'IA. Langfuse excelle dans le débogage des sorties LLM complexes grâce à des cadres de traçage et d'évaluation approfondis, tandis que Portkey donne la priorité à la fiabilité du système grâce à des solutions de secours automatisées, à l'équilibrage de charge et à la gestion des fournisseurs pour garantir une haute disponibilité.

Qu'est-ce qui fait de TrueFoundry une alternative idéale à Langfuse contre Portkey ?

TrueFoundry constitue une alternative complète à Langfuse par rapport à Portkey en unifiant l'observabilité et la gestion de l'infrastructure au sein d'un seul plan de contrôle. Contrairement aux proxys autonomes ou aux outils de suivi, TrueFoundry se déploie de manière native dans votre VPC privé, garantissant ainsi que les données sensibles ne quittent jamais votre périmètre. Il fournit les fonctionnalités de traçage et d'évaluation de Langfuse ainsi que le routage haute performance de Portkey, tout en gérant l'orchestration GPU sous-jacente.

Quelle plateforme convient le mieux à l'IA agentique : Langfuse ou Portkey ?

Lors de l'évaluation de Langfuse par rapport à Portkey pour les flux de travail des agences, Langfuse est souvent préféré pour visualiser des « chaînes de pensée » en plusieurs étapes, tandis que Portkey est choisi pour empêcher les défaillances des agents en cas de panne des fournisseurs. TrueFoundry améliore ces architectures agentiques en fournissant une prise en charge native du protocole MCP (Model Context Protocol), permettant aux agents d'interagir en toute sécurité avec les outils internes. Cela fournit un environnement plus sécurisé permettant aux agents de raisonner et d'exécuter des tâches grâce à une sécurité et une gouvernance des coûts centralisées.

Langfuse ou Portkey sont-ils meilleurs pour le suivi des coûts ?

Ni l'un ni l'autre n'est entièrement dédié à la gestion des coûts. Langfuse estime les coûts en fonction de l'utilisation des jetons, tandis que Portkey fournit des analyses d'utilisation des passerelles. Pour une gouvernance des coûts et une budgétisation robustes, des outils dédiés tels que AI Cost Board sont recommandés, offrant des informations détaillées, des rapports et une détection des anomalies pour gérer efficacement les dépenses opérationnelles du LLM.

Puis-je héberger moi-même Langfuse ?

Oui, Langfuse est open source et prend en charge l'auto-hébergement, ce qui donne un contrôle total sur le déploiement, la sécurité et la configuration. Portkey, en revanche, est avant tout un service géré avec des options d'entreprise, ce qui signifie que l'auto-hébergement nécessite des licences d'entreprise ou des solutions de contournement. TrueFoundry prend en charge le déploiement privé de manière native, combinant le contrôle auto-hébergé avec la fiabilité de l'entreprise.

Qu'est-ce qui convient le mieux aux flux de travail d'évaluation ?

Langfuse excelle dans les flux de travail d'évaluation, offrant un traçage au niveau des jetons, une notation des résultats et des pipelines de débogage. Portkey se concentre sur la fiabilité opérationnelle, le routage et les mécanismes de secours, ce qui le rend moins adapté à une évaluation approfondie. TrueFoundry répond à ces deux besoins en fournissant une observabilité et une évaluation complètes avec un déploiement haute performance et une gestion automatisée des flux de travail basés sur l'IA.

Comment Langfuse et Portkey gèrent-ils les modèles multi-fournisseurs ?

Portkey gère le routage multifournisseur en automatisant l'équilibrage de charge, les basculements et la sélection des fournisseurs. Langfuse, quant à lui, suit les sorties et les performances sur plusieurs modèles mais n'orchestre pas le routage. TrueFoundry combine les deux, en surveillant les sorties LLM tout en distribuant intelligemment les demandes entre les fournisseurs pour plus d'efficacité et de fiabilité.

TrueFoundry peut-il réduire la latence par rapport à Langfuse ou Portkey ?

Oui TrueFoundry intègre des moteurs d'inférence optimisés, une orchestration GPU et un routage intelligent pour minimiser les temps de réponse. Contrairement à Langfuse, qui se concentre sur l'observabilité, et à Portkey, qui garantit la fiabilité, TrueFoundry équilibre vitesse, évolutivité et surveillance, fournissant des réponses d'IA à faible latence dans les environnements de production.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)