Sécurité de l'IA d'entreprise avec MCP Gateway et Runtime Guardrails

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Nous avons organisé un webinaire avec l'équipe de Réseaux Palo Alto avec plus de 400 personnes venant de différentes régions et fonctions. Notre objectif à True Foundry a toujours été de créer une infrastructure prenant en charge votre stack GenAI et nous avons décidé de faire de la sécurité notre prochaine étape. Dans ce blog, nous résumons tous les facteurs clés importants dont nous avons discuté et appris au cours du webinaire et nous les résumons à certains facteurs clés qui vous aideront à prendre des décisions concernant la mise à l'échelle des initiatives d'IA au sein de votre entreprise. Il s'agit d'une lecture rapide de 6 à 7 minutes et constitue également un guide pratique sur la sécurité de l'IA que vous pouvez partager avec les responsables de la sécurité, les équipes de plateforme et les créateurs d'IA.

Des paquets aux invites : le nouveau périmètre est le contexte et l'identité

La sécurité traditionnelle partait du principe que si un adversaire ne pouvait pas passer votre pare-feu, il ne pourrait pas accéder à vos données sensibles. Aujourd'hui, un ingénieur peut coller des extraits de code source dans un chat pour « corriger un bogue » et accéder directement à une adresse IP sensible, sans toucher à aucun pare-feu. Dans ce monde, le contexte et l'identité deviennent les nouveaux périmètres : qui pose la question, que demandent-ils et quelles données et quels outils sont intégrés dans ce contexte ?

Il s'agit d'un changement fondamental du modèle de menace. Au lieu de bloquer les ports ou de renforcer uniquement les terminaux, nous devons sécuriser interface linguistique aux systèmes et aux données, et à tout ce que le langage peut faire faire faire au système.

Pourquoi la sécurité de l'IA est-elle différente aujourd'hui ?

Quatre modes d'échec apparaissent en premier pour la plupart des équipes :

- Injection rapide et altération du contexte. Les instructions masquées peuvent être intégrées dans des tickets d'assistance, des pages SharePoint, de longs historiques de discussion ou des documents récupérés et traitées comme un contexte valide.

- Fuite de données (exfiltration): du texte sensible peut apparaître dans les invites ou les sorties, notamment des informations personnelles, des secrets, des plans internes et même des artefacts de formation.

- Contenu toxique/non conforme à la marque : Des générations qui ne respectent pas la politique de l'entreprise ou les directives de la marque.

- Hallucinations confiantes : Des affirmations plausibles mais fausses qui sous-tendent de véritables décisions.

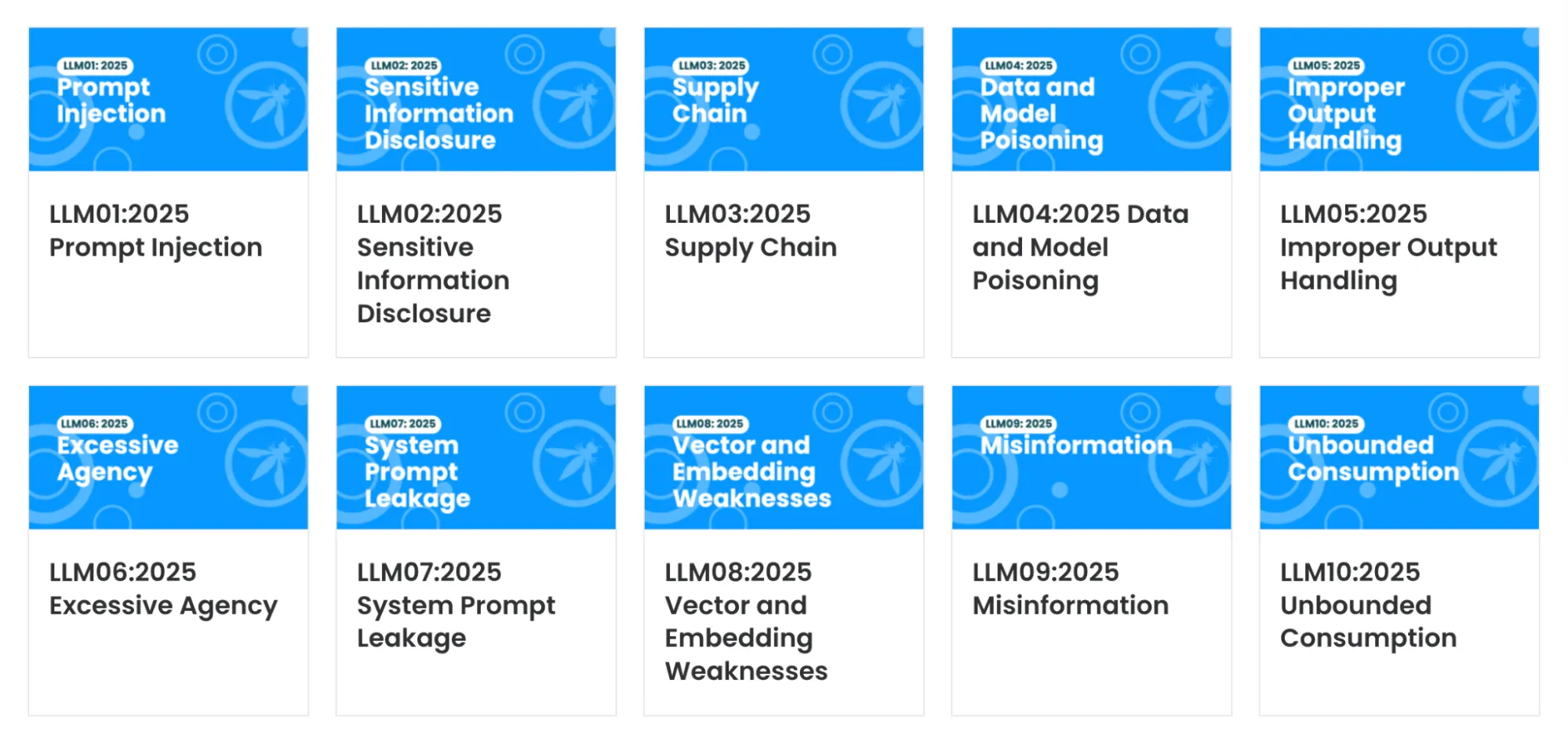

Si vous souhaitez en savoir plus, le Top 10 de l'OWASP en matière d'IA est une carte solide. Dans la pratique, nous avons constaté que la plupart des programmes commencent dans ces quatre domaines.

Ce que les participants nous ont raconté en direct

Nous avons effectué des sondages rapides au cours de la session. La principale préoccupation, de loin, était la fuite/exfiltration de données, suivie d'une injection rapide et d'un manque d'observabilité du comportement du modèle et de l'agent. Cela correspond à ce que nous constatons dans les déploiements en entreprise : si vous sécurisez d'abord les entrées et les sorties, puis que vous assurez la traçabilité de chaque interaction, vous avez en grande partie couvert ce qui est nécessaire pour la sécurité de l'IA

Les cinq piliers d'une adoption sécurisée de l'IA

Voici la courte liste de contrôle que nous avons constatée dans tous les secteurs :

- Authentification et contrôle d'accès : Ne regroupez pas tout derrière une seule clé de modèle partagée. Préservez l'identité des utilisateurs/des services de bout en bout. Faites pivoter les touches. Évitez les jetons partagés.

- Garde-corps d'entrée : Détectez les injections rapides, la falsification du contexte et les sources non fiables avant qu'elles n'atteignent le modèle.

- Garde-corps de sortie : Bloquez les fuites d'informations personnelles, les fuites de données sensibles et les textes toxiques ou non conformes à la marque. Appliquez le principe « ne répondez que si vous vous basez sur des sources approuvées » pour les flux de travail réglementés.

- Observabilité totale : Suivez chaque demande : identité de l'utilisateur, appels aux outils, choix du modèle, paramètres, coûts et décisions relatives à la protection. Plus besoin d'utiliser des ombres.

- Contrôle des coûts et disjoncteurs : Les agents peuvent sortir en spirale. Imposez des budgets par utilisateur et par application, une détection de boucle et des disjoncteurs durs. Réduisez le rayon d'explosion de « une seule mauvaise invite ».

- Contrôles de la chaîne d'approvisionnement : N'utilisez que des modèles et des connecteurs auxquels vous faites confiance. L'open source n'est pas automatiquement sûr. Vérifiez ce que vous extrayez avant qu'il ne soit exécuté dans prod.

Pourquoi MCP augmente les enjeux

Désormais, les LLM ne sont plus seulement discussion—ils peuvent agir. Grâce au Model Context Protocol (MCP), les agents découvrent des outils et exécutent des actions sur GitHub, Jira, Slack, les API cloud, les systèmes internes, etc. Cela fait du MCP un formidable accélérateur pour la productivité des développeurs et une nouvelle catégorie de risques. Un agent mal défini peut fermer 500 tickets du jour au lendemain, exfiltrer des données ou supprimer une succursale à la suite d'une instruction sournoise survenue lors d'une étape de récupération.

Vous pouvez maintenant voir comment on passe d'une « mauvaise réponse » à une « action non autorisée ». Les outils multiplient à la fois la valeur et les risques. Des modifications doivent donc être apportées pour les adapter.

Quels sont les points à prendre en compte dans une passerelle IA

Lorsque MCP entre en scène, augmentez votre niveau de référence dans les domaines suivants :

- Authentification et autorisation pour les serveurs MCP (qui êtes-vous, que pouvez-vous faire).

- Contrôle d'accès granulaire (outil et niveau de fonctionnement).

- Garde-corps (politiques d'entrée/sortie et d'utilisation des outils).

- Observabilité (trace, attribut, audit).

- Limitation de débit et quotas (disjoncteurs de boucle par utilisateur/application).

- Sécurité de la chaîne d'approvisionnement (serveurs approuvés, artefacts signés, versions épinglées).

Examinons en profondeur certains facteurs dont on parle moins.

- Garde-corps sur la voie de circulation :

La passerelle se situe entre les agents et les outils/modèles et applique des barrières à la fois en entrée et en sortie. Vous pouvez définir les politiques par utilisateur, par application, par modèle, par équipe ou via des métadonnées. Contrôles typiques :- Entrée : injection rapide, escalade des rôles lors de longues conversations, URL/code malveillants dans le contexte récupéré.

- Sortie : masquage DLP (SSNS/cartes/jetons), politiques de toxicité et de sujet, vérifications de mise à la terre pour une réponse régulée

- Entrée : injection rapide, escalade des rôles lors de longues conversations, URL/code malveillants dans le contexte récupéré.

- Observabilité : trace, attribut, audit :

Sans registres d'attribution et de décisions, vous ne pouvez pas enquêter ni prouver l'application de la loi. La passerelle IA émet des traces de bout en bout (identité, métadonnées rapides, paramètres du modèle, chaque appel d'outil avec paramètres/résultats, accès/décisions relatives aux règles de sauvegarde et coûts). Utilisez les tableaux de bord pour répondre aux questions suivantes :- Quel agent utilise code_executor : charge de travail valide ou invite malveillante ?

- Pourquoi la latence d'ask_bot est-elle passée à 20 : ralentissement de l'API ou boucle récursive ?

- Pourquoi un outil consomme-t-il 80 % des appels ? Est-il essentiel pour l'entreprise ou simplement trop privilégié ?

- Limitation des débits et budgets : conception de disjoncteurs :

Les agents peuvent monter en spirale. Traitez les budgets et les QPS comme des contrôles de sécurité :- Quotas par utilisateur/application/outil et limites par minute pour limiter le rayon d'explosion.

- Détection de boucle pour déclencher un disjoncteur sur des motifs répétitifs.

- Des plafonds plus stricts pour les services sensibles (paiements, données clients).

- Intégrité de la chaîne d'approvisionnement pour le MCP et les modèles :

Si vous ne contrôlez pas les serveurs, un « Slack MCP » peut être un package malveillant qui envoie discrètement des journaux de discussion. Les mises à jour automatiques peuvent extraire des versions altérées. La solution en matière de gouvernance est un registre vérifié et organisé, des versions épinglées et des artefacts signés, ainsi que la numérisation des modèles et des analyses par équipes avant la production.

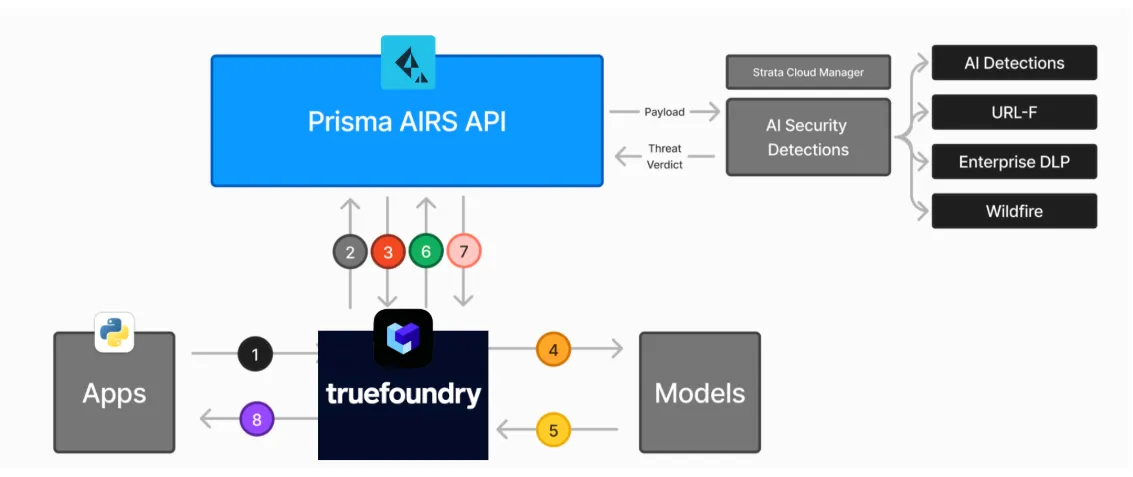

Comment TrueFoundry et Palo Alto vous aident à sécuriser votre infrastructure GenAI

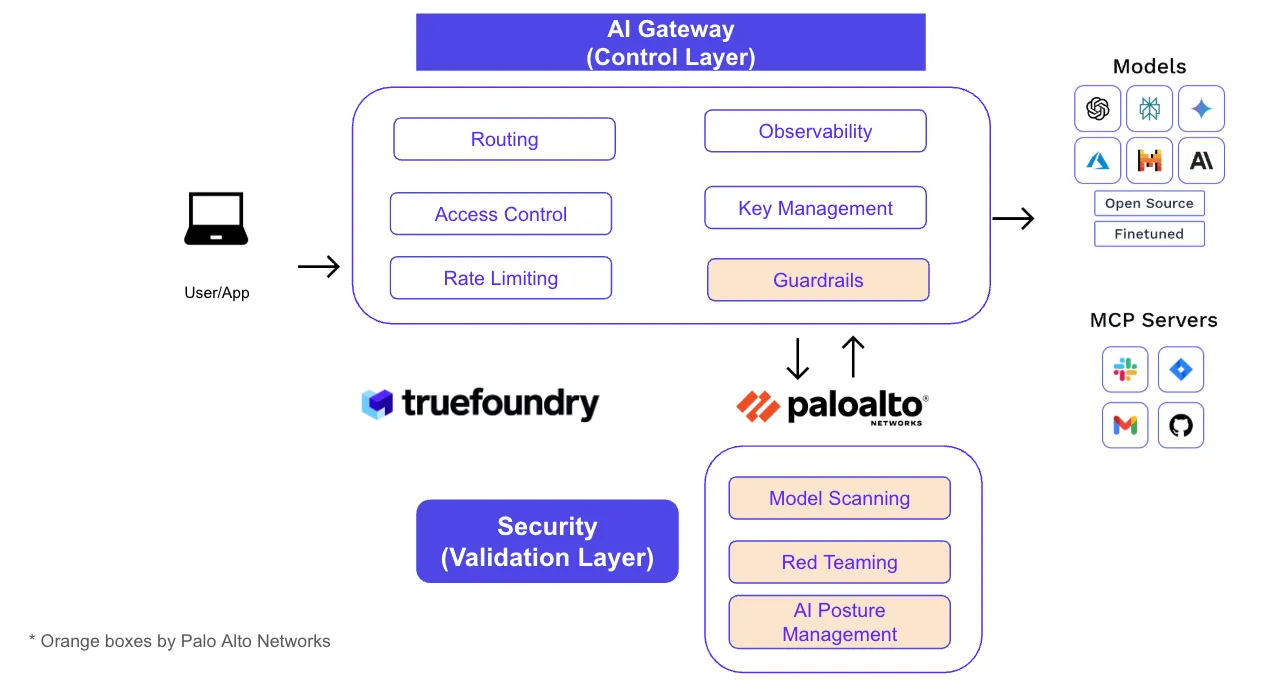

Les agents sont particulièrement utiles lorsqu'ils peuvent appeler des outils pour effectuer un véritable travail. MCP normalise la façon dont les agents découvrent et invoquent ces outils. Mais le pouvoir exige le contrôle. Notre modèle recommandé est un modèle à deux couches :

- Passerelle AI (couche de contrôle): le lieu central pour le routage, le contrôle d'accès, la limitation du débit, la gestion des clés, l'observabilité et les garde-fous. Il s'agit de la couche proxy unique par laquelle transite tout le trafic agent/modèle/outil. C'est également là que vous centralisez les modes d'authentification du serveur MCP : No Auth (démo), Header/Bearer et OAuth (Slack/Github/Atlassian), afin que chaque équipe ne résolve pas l'authentification encore et encore.

- Sécurité (couche de validation): Inspection du temps d'exécution, gestion de la posture de l'IA, numérisation de modèles et red teaming, fournis via Palo Alto Networks Prisma AIRS, intégré en ligne à la passerelle.

Mais pourquoi séparer le contrôle et la validation ?

Le fait de centraliser le contrôle offre aux équipes de la plateforme une expérience de développement exceptionnelle (point de terminaison unique, SDK unifiés, intégration en libre-service). Le fait de placer la validation dans sa propre couche fournit aux équipes de sécurité des informations et des preuves approfondies (verdicts de sécurité, masquage DLP, inspection des URL et des codes et contrôles de posture) sans bloquer la vitesse des développeurs.

Autorisation à trois niveaux

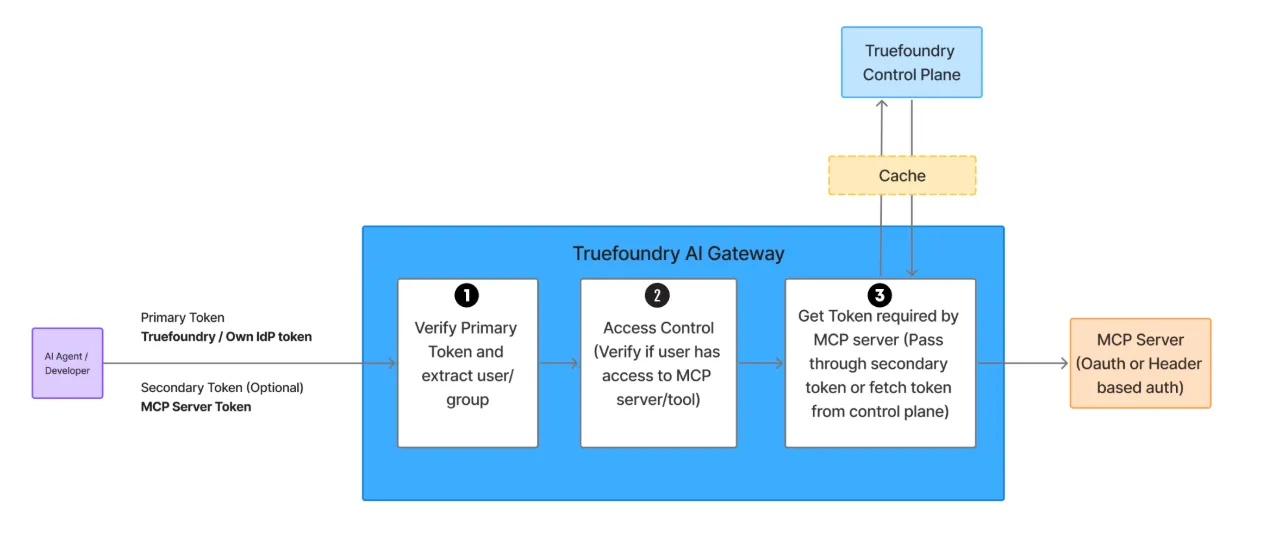

Notre directeur technique Abhishek présente un modèle simple pour Autorisation MCP dans la passerelle IA de TrueFoundry :

- Qui es-tu ? La passerelle vérifie l'identité humaine ou de service (par exemple, via votre jeton IdP) à l'entrée.

- Que peux-tu faire ? La passerelle applique la politique au serveur MCP et à l'outil/à l'opération spécifiques (« lire les PR »/« commenter les PR », mais « aucune suppression de branche »).

- Comment le prouver en aval ? La passerelle effectue la traduction des jetons exactement selon les attentes du serveur cible (passage à Slack/GitHub OAuth ou à un jeton d'en-tête de courte durée).

Ce modèle « AuthN/Z à 3 couches » supprime les secrets ponctuels, conserve l'attribution et empêche les robots trop privilégiés de causer des dommages irréversibles.

Exemple : un agent de révision des relations publiques peut répertorier les relations publiques et laisser des commentaires, mais la politique de passerelle AI refuse branches.delete même si une invite essaie de « supprimer également le principal après le résumé ». Le refus et l'identité de la tentative sont enregistrés.

Serveurs MCP virtuels

Nous avons également abordé ce que sont les serveurs MCP virtuels. En bref, ne remettez pas aux agents l'intégralité des catalogues JIRA/Github/Confluence. Composez un MCP virtuel qui expose exactement ce dont le flux de travail a besoin, par exemple : JIRA.create_issue, GitHub.create_PR et Confluence.search_docs en tant que point de terminaison MCP d'ingénierie unique. Vous obtenez des instructions plus claires, des approbations plus rapides et un rayon d'explosion plus petit par conception.

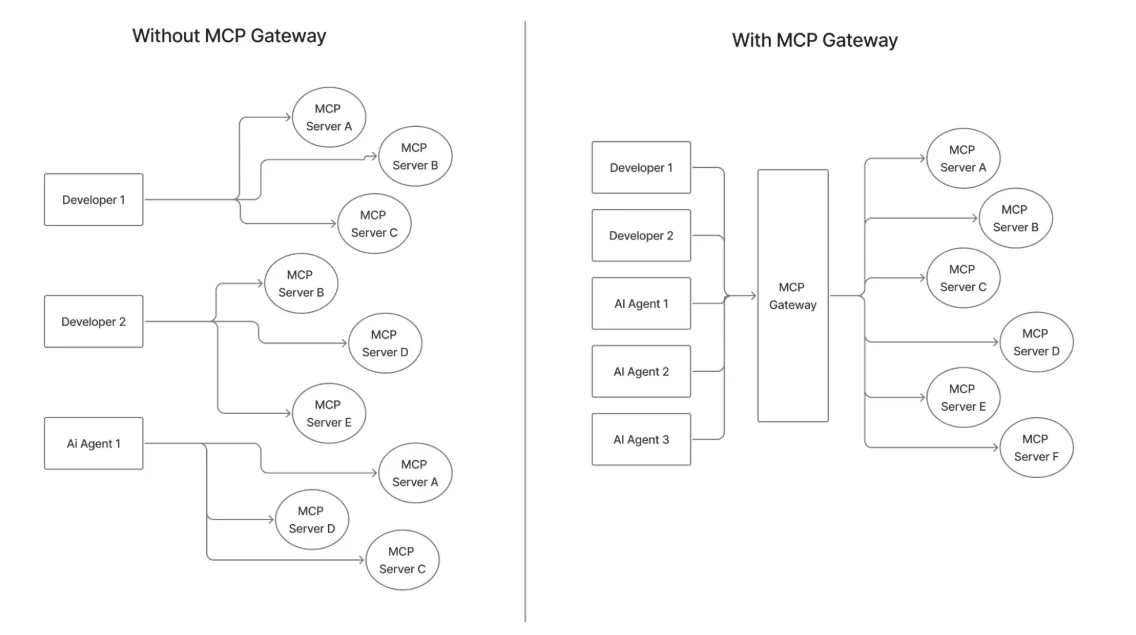

Ce que vous offre la passerelle MCP

Un bien conçu Passerelle MCP agit comme un central téléphonique sensible aux politiques entre les agents et les outils :

- Un seul endroit pour la découverte et le contrôle d'accès : Enregistrez les serveurs MCP une seule fois. Renforcez qui peut voir quels outils.

- Autorisations au niveau des outils et registres organisés : Présentez uniquement la surface d'outil autorisée par application ou par équipe.

- Sélection intelligente des outils : Ne transmettez pas un millier d'outils dans un seul contexte rapide.

- Limites tarifaires et quotas mondiaux : Limiter les boucles et les coûts incontrôlables.

- Traçage unifié entre les outils et les modèles : Attribuez chaque action à une identité humaine ou de service, avec des preuves de la politique qui a été appliquée et où.

Si vous comparez « aucune passerelle MCP » à « avec passerelle MCP », la différence est flagrante : moins de connexions sur mesure, des flux d'authentification centralisés, une gestion centralisée des informations d'identification, des pistes d'audit de niveau entreprise et un catalogue de serveurs approuvé au lieu d'une multitude de scripts non gérés.

Comment Palo Alto Prisma AIRS renforce les garde-corps au sein de la couche passerelle

- Sécurité de l'exécution : Inspectez les instructions et les sorties pour détecter une injection rapide, des URL ou des codes malveillants, du contenu toxique, des menaces spécifiques à un agent, etc. Appliquez les politiques DLP et le masquage en temps réel.

- Gestion de la posture de sécurité de l'IA (AI-SPM) : Détectez rapidement les erreurs de configuration et appliquez les meilleures pratiques pour les services de modèles et d'agents.

- Teaming rouge: Testez les flux de travail natifs de l'IA et mesurez l'efficacité des politiques.

- Numérisation de modèles: détectez les vulnérabilités dans les fichiers modèles eux-mêmes (désérialisation, portes dérobées, logiciels malveillants).

- Sécurité des agents: Surveillez les utilisations abusives des outils et les problèmes de communication entre les agents.

Vous pouvez ajuster les profils de sécurité par application pour équilibrer la latence et la protection, et toutes les décisions sont enregistrées à des fins d'audit.

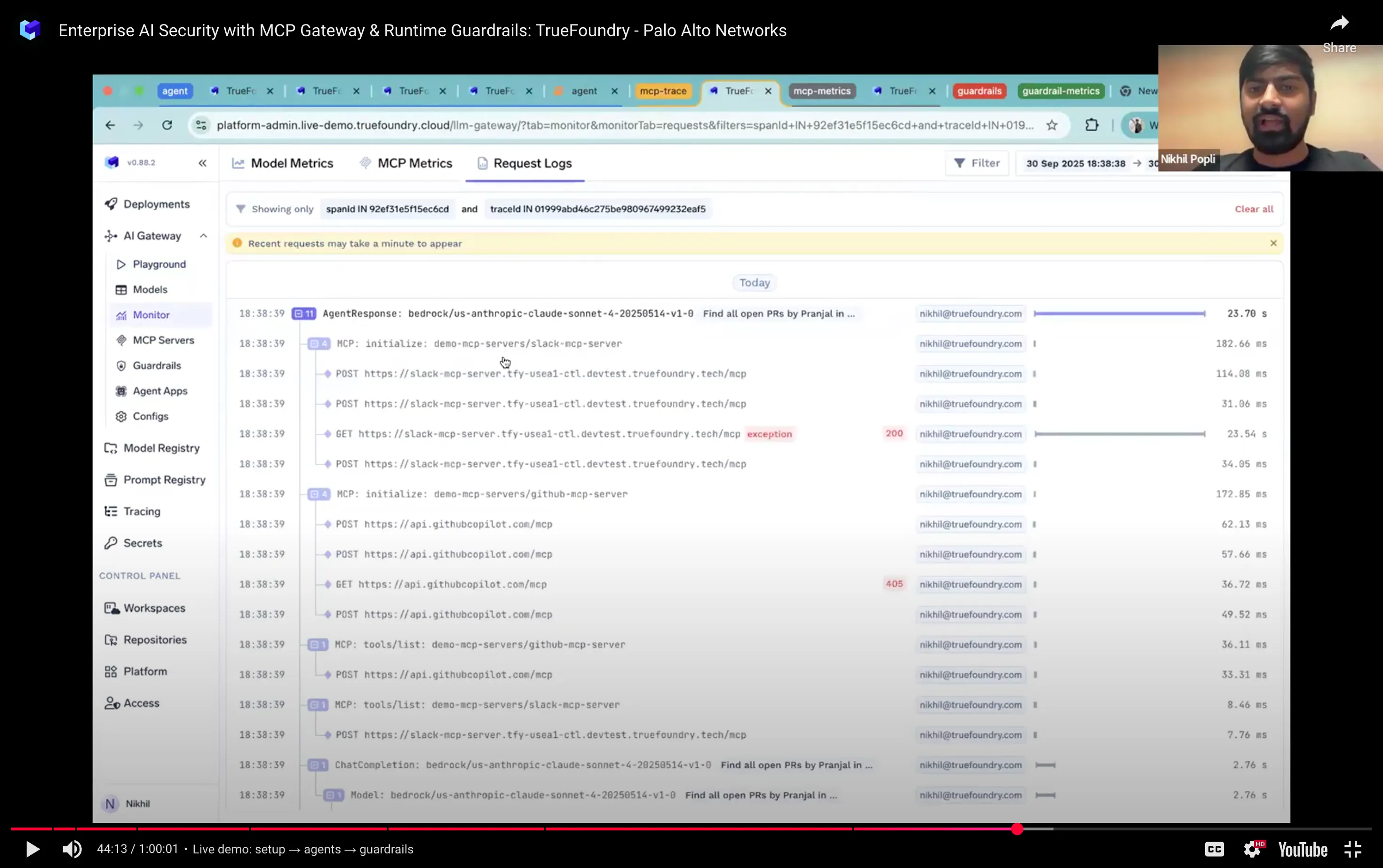

Un coup d'œil à la démo

Nous avons présenté un agent qui répertorie les pull requests ouvertes pour un coéquipier et les encourage sur Slack. Le tracé montre chaque étape (appels à l'outil, raisonnement du modèle, chronométrage) et les décisions prises en cours de route. Le tableau de bord met en évidence les outils qui consomment le plus d'appels, les pics de latence et tout comportement semblable à une boucle. C'est la différence entre espérant un agent est en sécurité et il sait que c'est le cas. Vous pouvez le regarder sur le lien youtube, que nous avons joint plus loin dans le blog.

Questions auxquelles nous avons répondu en direct

« Pourquoi ne pas simplement utiliser une passerelle API normale ? »

Parce que les charges de travail liées à l'IA ajoutent de nouvelles exigences : traduction de jetons par outil, RBAC au niveau de l'outil, barrières d'entrée/sortie, audit et traçabilité complets et routage intelligent des outils. Une passerelle classique ne connaît rien des invites, des traces ou de la sémantique des modèles/outils.

« Pouvons-nous surveiller les outils existants tels que ChatGPT ou les IDE cloud ? »

Si l'outil vous permet de définir un proxy ou un point de terminaison de modèle personnalisé, acheminez-le via la passerelle et appliquez-y des garde-fous et une observabilité. S'il n'expose pas ce contrôle, vous ne pouvez pas ajouter une inspection transparente au milieu.

« Comment éviter les ajustements préjudiciables ? »

Surveillez vos données : excluez les informations personnelles et les secrets. Validez la provenance de tout modèle de base que vous ingérez. Scannez les fichiers modèles pour détecter les comportements cachés avant de vous entraîner.

« Les développeurs bénéficient-ils de SDK ? »

Les clients MCP standard fonctionnent prêts à l'emploi. Prisma AIRS expose un serveur et un SDK, et la passerelle fournit des extraits de code copier-coller pour Python/TypeScript et les frameworks d'agents courants.

Visionnez la session complète

Si vous l'avez manquée, ou si vous souhaitez que vos équipes chargées de la plateforme et de la sécurité prennent le temps de rattraper leur retard, voici l'enregistrement :

YouTube : https://youtu.be/hWNV2v3C8SA

Essayez-le et discutez avec nous

Nous proposons un essai d'un mois du Passerelle MCP—disponible en tant que SaaS ou auto-hébergé. Si vous souhaitez passer en revue l'architecture en 30 minutes afin de calibrer les coûts, la latence et les profils de garde-corps, nous sommes là pour vous aider. Vous obtiendrez :

- Configuration et intégration gratuites

- Une chaîne Slack/Teams privée pour l'assistance

- Accès à des tableaux de bord d'observabilité et à des profils de garde-corps adaptés à vos applications

Un grand merci à l'équipe de Palo Alto Networks pour nous avoir rejoints et pour avoir fait avancer l'état de la sécurité de l'IA.

Questions fréquemment posées

Qu'est-ce que la sécurité de l'IA en entreprise ?

La sécurité de l'IA d'entreprise est le cadre multicouche de protocoles, d'outils et de politiques conçu pour protéger les modèles d'IA et les données d'entreprise contre des menaces spécialisées telles que l'injection rapide et l'exfiltration de données. Cela implique la mise en œuvre de contrôles d'accès stricts et d'une surveillance en temps réel pour garantir la sécurité et la conformité des interactions avec les modèles. TrueFoundry centralise ces exigences dans un plan de contrôle unique, permettant aux entreprises de gérer la sécurité sur différents modèles et systèmes internes sans augmenter la complexité architecturale.

Pourquoi la sécurité de l'IA est-elle importante pour les entreprises ?

Le maintien de la sécurité de l'IA d'entreprise est essentiel pour empêcher l'exposition accidentelle de données personnelles sensibles et de propriété intellectuelle à des fournisseurs de modèles externes. En l'absence d'une couche de sécurité dédiée, les organisations risquent de ne pas respecter les réglementations et de s'exposer à des attaques contradictoires susceptibles de compromettre les agents autonomes. TrueFoundry répond à ces préoccupations en déployant l'intégralité de la pile d'IA au sein de votre VPC privé, en veillant à ce que la résidence des données soit maintenue et que chaque appel d'outil soit entièrement auditable et régi.

Comment les garde-fous d'exécution de la passerelle MCP contribuent-ils à la sécurité de l'IA en entreprise ?

Dans le cadre d'une stratégie globale de sécurité de l'IA d'entreprise, les garde-corps d'exécution de la passerelle MCP agissent comme une couche de défense proactive qui inspecte chaque interaction en temps réel. Ces barrières suppriment automatiquement les informations sensibles et bloquent les entrées malveillantes avant qu'elles n'atteignent le modèle ou les systèmes backend internes. La passerelle de TrueFoundry utilise ces garde-fous pour appliquer des autorisations précises sur l'utilisation des outils, fournissant ainsi une couche de protection dynamique qui garantit que les agents opèrent dans des limites prédéfinies et sécurisées.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)