Intégration de Coralogix à TrueFoundry AI Gateway

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Alors que les équipes passent des expériences d'IA aux applications de production, un thème revient partout : l'observabilité n'est pas négociable. Il ne suffit plus de savoir si une demande a réussi ou échoué. Tu dois comprendre pourquoi un modèle s'est comporté d'une certaine manière, quelles instructions ou quels outils étaient impliqués et comment cela a un impact sur les coûts, la latence et l'expérience utilisateur.

C'est exactement ce que l'intégration entre Passerelle TrueFoundry AI et Coralogix est conçu pour. TrueFoundry AI Gateway offre aux équipes un plan de contrôle unique pour les LLM et les agents, quels que soient les fournisseurs et les environnements, avec routage, limitation du débit, garde-corps, nouvelles tentatives et contrôles des coûts sur le chemin de la demande. Coralogix est une plateforme d'observabilité complète qui unifie les journaux, les métriques, les traces et les données de sécurité, avec des analyses en temps réel qui facilitent l'investigation des problèmes et le suivi des performances à grande échelle.

Ensemble, ils vous offrent une observabilité de bout en bout de l'IA : qu'il s'agisse d'une demande utilisateur entrant dans la passerelle, des appels de modèles et d'outils qui se produisent en aval, des traces et des mesures intégrées aux tableaux de bord et aux alertes.

Pourquoi choisir Coralogix et TrueFoundry

Les systèmes d'IA modernes ne sont plus « un seul modèle et un seul point de terminaison ». Les déploiements réels concernent plusieurs fournisseurs de modèles, des modèles locaux et hébergés, des systèmes de récupération, des appels d'outils et des frameworks d'agents. Ils s'appliquent également au développement, à la mise en scène et à la production, souvent dans plusieurs régions, et la même expérience utilisateur peut concerner plusieurs services et dépendances.

Cette complexité fait que la surveillance traditionnelle s'effondre rapidement. Si vous n'avez que des journaux éparpillés, vous finissez par deviner : le ralentissement a-t-il été causé par le fournisseur du modèle, la récupération, l'exécution de l'outil ou votre propre service ? Si une version entraînait une augmentation de l'utilisation des jetons, quel itinéraire ou quelle fonctionnalité a introduit le changement ? Lorsque des incidents de production se produisent, vous devez être en mesure de passer d'un symptôme au chemin de demande exact en quelques minutes.

La solution la plus simple consiste à traiter le trafic d'IA comme un trafic d'applications de premier ordre, avec des traces indiquant le cycle de vie complet des demandes et des métadonnées qui vous permettent de filtrer par modèle, itinéraire, environnement, latence et résultats.

La puissance de la passerelle TrueFoundry AI

TrueFoundry AI Gateway se trouve devant le trafic de votre LLM et de vos agents en tant que couche gouvernée unique. Il centralise l'accès aux modèles entre les fournisseurs et les déploiements, applique des règles de routage, des limites de débit et des garde-fous, et fournit des contrôles au niveau des demandes qui aident les équipes à exploiter l'IA de manière fiable en production. Le principal avantage est la cohérence : chaque demande suit le même chemin contrôlé, et la passerelle devient l'endroit naturel pour instrumenter et exporter la télémétrie à des fins d'observabilité.

Coralogix pour l'observabilité de la production

Coralogix est conçu pour ingérer de gros volumes de télémétrie et les rendre explorables en temps réel. Lorsque les traces sont disponibles dans le même système que vos journaux et vos métriques, les enquêtes deviennent plus rapides et plus fiables. Au lieu d'essayer de reconstituer une histoire à partir de journaux distribués, vous pouvez suivre la trace, identifier le goulot d'étranglement et le corréler aux indicateurs de l'infrastructure ou au comportement de dépendance.

Mieux ensemble : observabilité de bout en bout de l'IA avec OpenTelemetry

L'intégration est basée sur OpenTelemetry, qui permet de maintenir les normes et de faciliter la maintenance. TrueFoundry AI Gateway analyse les requêtes LLM et les requêtes des agents à l'aide d'OpenTelemetry et exporte les traces vers Coralogix via gRPC, avec de riches métadonnées associées à chaque trace (telles que le modèle, l'itinéraire, les identifiants d'application/de sous-système, la latence et l'état). Coralogix ingère et analyse ensuite ces données afin que vos équipes puissent créer des tableaux de bord, définir des alertes et étudier des demandes spécifiques de bout en bout.

Coralogix prend en charge la réception de traces compatibles avec OpenTelemetry via son point de terminaison d'entrée via gRPC, ce qui en fait une intégration directe entre l'exportateur et la plateforme plutôt qu'un pipeline personnalisé que vous devez gérer.

Comment fonctionne l'intégration

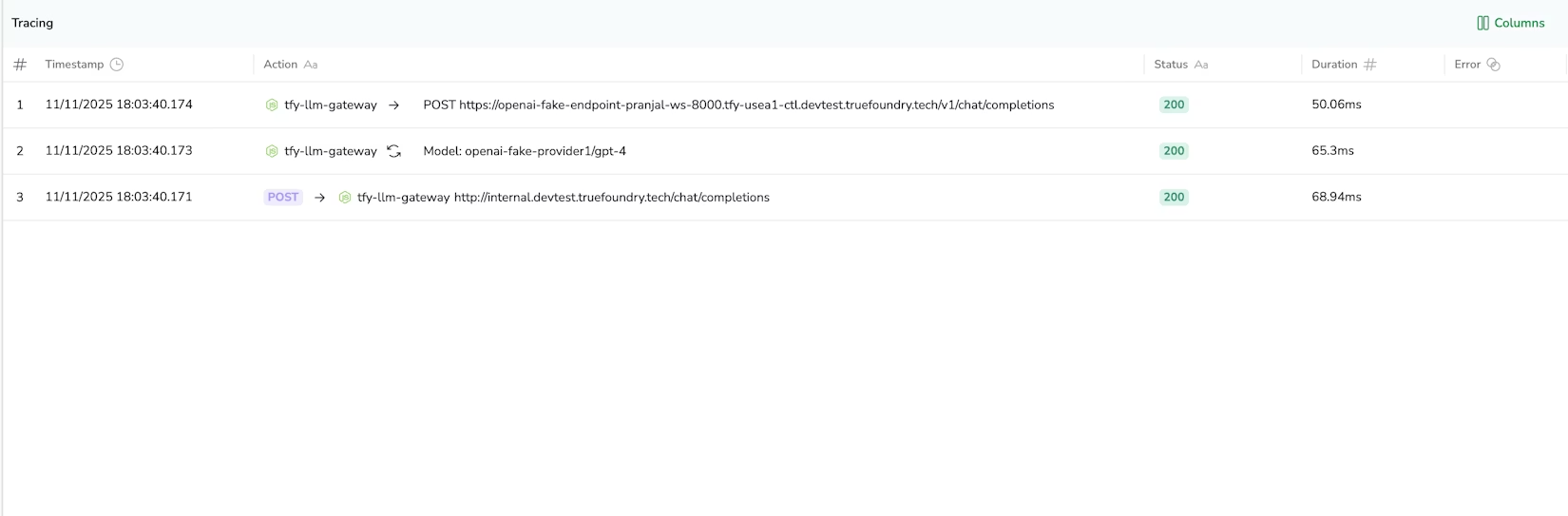

À un niveau élevé, une demande utilisateur atteint TrueFoundry AI Gateway, la passerelle crée des spans OpenTelemetry pour la demande et l'activité du modèle/outil en aval, et l'exportateur envoie ces spans au point de terminaison d'ingestion OpenTelemetry de Coralogix via gRPC. Les traces arrivent dans Coralogix déjà structurées, ce qui permet à vos équipes de filtrer par application et par sous-système, d'explorer une demande spécifique et de détecter rapidement les latences, les erreurs ou les comportements inattendus.

Étape par étape : Configuration de Coralogix avec TrueFoundry AI Gateway

Dans Coralogix, collectez le point de terminaison OpenTelemetry gRPC de votre région, votre clé d'API Coralogix, et décidez candidature et sous-système noms que vous souhaitez utiliser pour organiser les traces. Le choix de noms descriptifs stables est utile ultérieurement lorsque vous créez des requêtes et des tableaux de bord, car vous pouvez filtrer proprement vos traces AI Gateway en fonction de ces étiquettes.

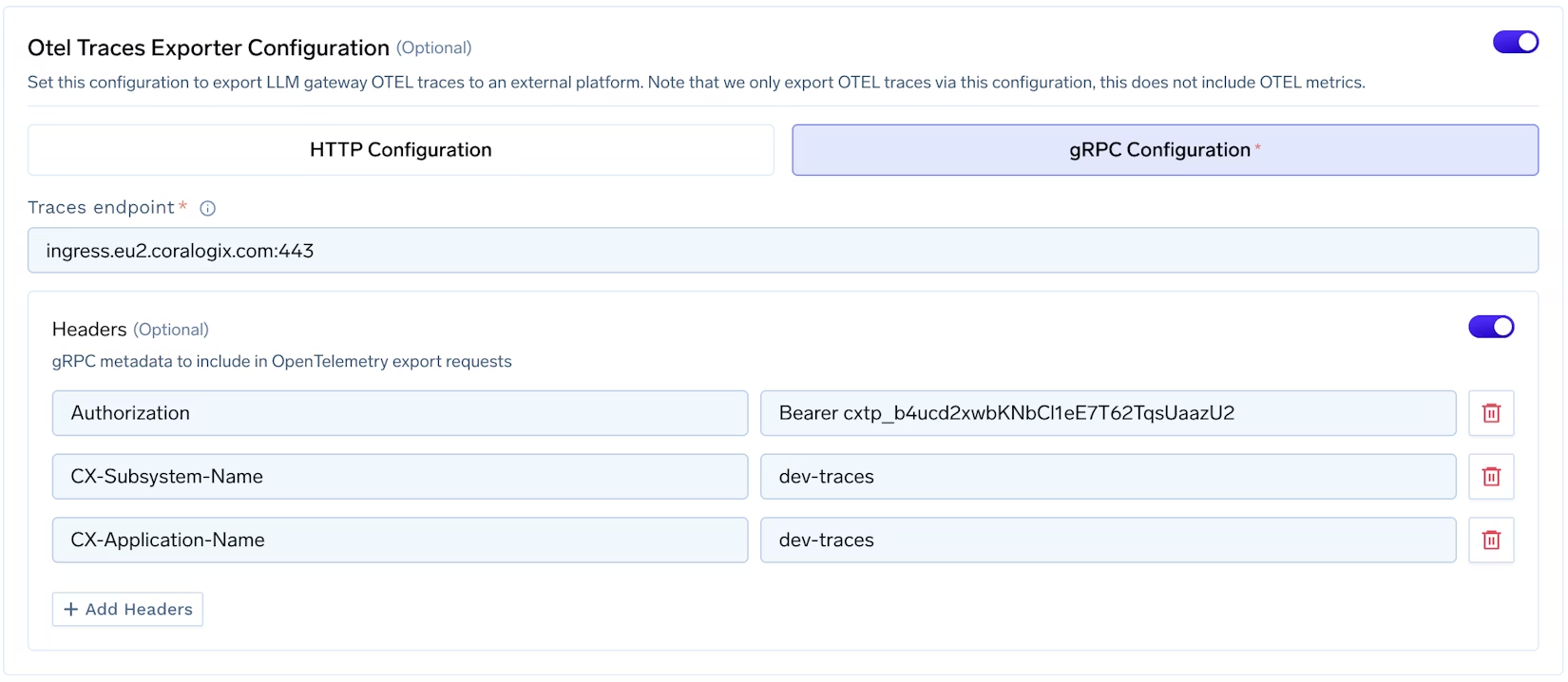

Dans le tableau de bord TrueFoundry AI Gateway, ouvrez la configuration OTEL pour la passerelle et activez l'exportateur de traces. Définissez le protocole sur gRPC et configurez le point de terminaison pour qu'il pointe vers le point de terminaison d'ingestion Coralogix OpenTelemetry correspondant à la région de votre compte. Une fois cela enregistré, la passerelle commencera à exporter les traces pour les demandes LLM et les agents via le chemin d'exportation configuré.

Coralogix attend des en-têtes qui authentifient à la fois la demande et aident à attribuer des traces à la bonne application et au bon sous-système. Dans la configuration de l'exportateur AI Gateway OTEL, définissez des en-têtes qui incluent votre clé API ainsi que les identifiants d'application/de sous-système que vous avez choisis. Une configuration typique ressemble à ceci :

Autorisation : Titulaire <coralogix-api-key>

Nom de l'application CX : <application-name>

Nom du sous-système CX : <subsystem-name>

Une fois la configuration en place, envoyez le trafic de test via la passerelle (par exemple, quelques discussions terminées ou l'exécution d'un agent). Dans TrueFoundry, vérifiez que des traces sont créées pour les demandes, puis passez à Coralogix et ouvrez l'expérience de suivi. Filtrez en fonction des noms des applications/sous-systèmes que vous avez configurés et vérifiez que vous pouvez voir les intervalles correspondant à l'activité d'AI Gateway, y compris des attributs tels que l'itinéraire, le modèle, la latence et l'état.

Ce que font les équipes une fois que les traces circulent

Grâce aux traces de passerelle dans Coralogix, les équipes peuvent mesurer la latence entre les itinéraires et les modèles d'une manière réellement exploitable en production. Au lieu d'un seul numéro de « latence de l'API », vous pouvez voir comment les différents modèles se comportent en cas de charge, quelles routes sont en régression et si les défaillances sont liées à un fournisseur ou à une dépendance spécifique. Comme les traces sont naturellement corrélées au reste de votre télémétrie, vous pouvez également associer la latence de l'IA à l'infrastructure sous-jacente ou aux problèmes de service en aval.

Les problèmes de coûts liés à l'IA se manifestent souvent par une augmentation soudaine de l'utilisation de jetons, des conversations plus longues ou une augmentation de la fréquence des appels liée à une nouvelle fonctionnalité ou à une nouvelle version. Grâce aux métadonnées enregistrées au niveau des demandes, les équipes peuvent identifier les itinéraires ou les locataires à l'origine des changements d'utilisation et définir des alertes lorsque le comportement des coûts change de manière inattendue. Ces informations deviennent encore plus utiles lorsqu'elles sont associées à des contrôles d'AI Gateway tels que les règles de routage, les limites de débit et les budgets, car l'observabilité peut directement entraîner des mesures correctives.

Les agents se sentent « lents » ou « mal » pour de nombreuses raisons : délais d'utilisation des outils, problèmes de récupération, régressions rapides ou changements de modèle/fournisseur. Les traces permettent aux équipes de suivre la demande tout au long de la chaîne d'appels, d'explorer la période la plus lente et d'identifier si le goulot d'étranglement provient du modèle, d'un outil, d'une extraction ou de votre propre logique d'application. C'est la différence entre deviner et savoir.

Créez des tableaux de bord et des alertes spécifiques à l'IA

Une fois que vous disposez de traces structurées, il devient facile de créer des tableaux de bord qui reflètent la manière dont l'IA est réellement utilisée dans votre produit : trafic des passerelles par itinéraire et modèle, tendances en matière de taux d'erreur et de délais d'attente par fournisseur, percentiles de latence pour les principaux parcours des utilisateurs et alertes qui se déclenchent lorsqu'un seul fournisseur ou itinéraire commence à se dégrader. Cela permet de répondre plus rapidement aux incidents et de réduire le risque opérationnel lié à la livraison rapide de fonctionnalités d'IA.

Choisir la bonne région Coralogix

Pour des raisons de performances et de conformité, il est important d'exporter les traces vers le terminal Coralogix qui correspond à la région de votre compte. Coralogix fournit un point de terminaison d'entrée compatible avec OpenTelemetry (via gRPC), et le point de terminaison régional approprié dépend de l'endroit où votre compte Coralogix est hébergé. (Coralogix)

Conclusion

Les applications d'IA deviennent rapidement critiques, et la barre en matière de fiabilité, de performance et de contrôle des coûts ne cesse de monter. L'intégration de TrueFoundry AI Gateway et de Coralogix offre aux équipes un moyen pratique et basé sur des normes d'obtenir une visibilité de bout en bout sur le trafic d'IA. Vous centralisez le contrôle des requêtes LLM et des agents dans la passerelle, et vous centralisez l'observabilité dans Coralogix grâce à des traces en temps réel qui facilitent considérablement la surveillance et le débogage.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)