Les meilleurs outils de sécurité du code IA pour les entreprises en 2026 : examinés et comparés

.webp)

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

Voici un scénario qui vous semble probablement familier. Un développeur de votre équipe demande à Claude Code de remanier un module d'authentification. En quelques minutes, l'agent a lu la base de code, appelé un serveur MCP pour vérifier le schéma de la base de données, exécuté quelques commandes shell et ouvert une pull request. Quarante-cinq minutes de travail, réalisées en trois.

Ça a l'air génial. Mais personne n'a revu ce que l'agent a réellement fait en cours de route. Personne n'a vérifié ce qui était envoyé au fournisseur LLM, à quels serveurs MCP il était connecté, ou si le code généré introduisait une injection SQL que la version d'origine ne comportait pas.

Ce n'est pas une hypothèse. Le rapport de sécurité du code GenAI 2025 de Veracode a testé plus de 100 LLM sur 80 tâches de codage organisées et a révélé que L'IA a introduit des failles de sécurité dans 45 % des cas. L'enquête menée par Aikido Security en 2026 auprès de 450 développeurs et responsables de la sécurité dresse un tableau similaire : une organisation sur cinq a signalé un incident de sécurité grave lié à un code généré par l'IA.

Les outils écrivent de mieux en mieux du code. Ils ne s'améliorent pas pour écrire du code sécurisé.

Et honnêtement, le code lui-même n'est que la moitié du problème. Claude Code, Cursor et Copilot fonctionnent désormais avec des privilèges de niveau développeur. Ils exécutent des commandes shell, lisent les fichiers d'environnement et se connectent à des API internes via des serveurs MCP que la plupart des équipes de sécurité n'ont jamais examinés. Une connexion MCP compromise et vous obtenez une exfiltration d'informations d'identification qu'aucun scanner statique ne pourra détecter, car la vulnérabilité n'a jamais été présente dans le code. C'était dans le flux de travail.

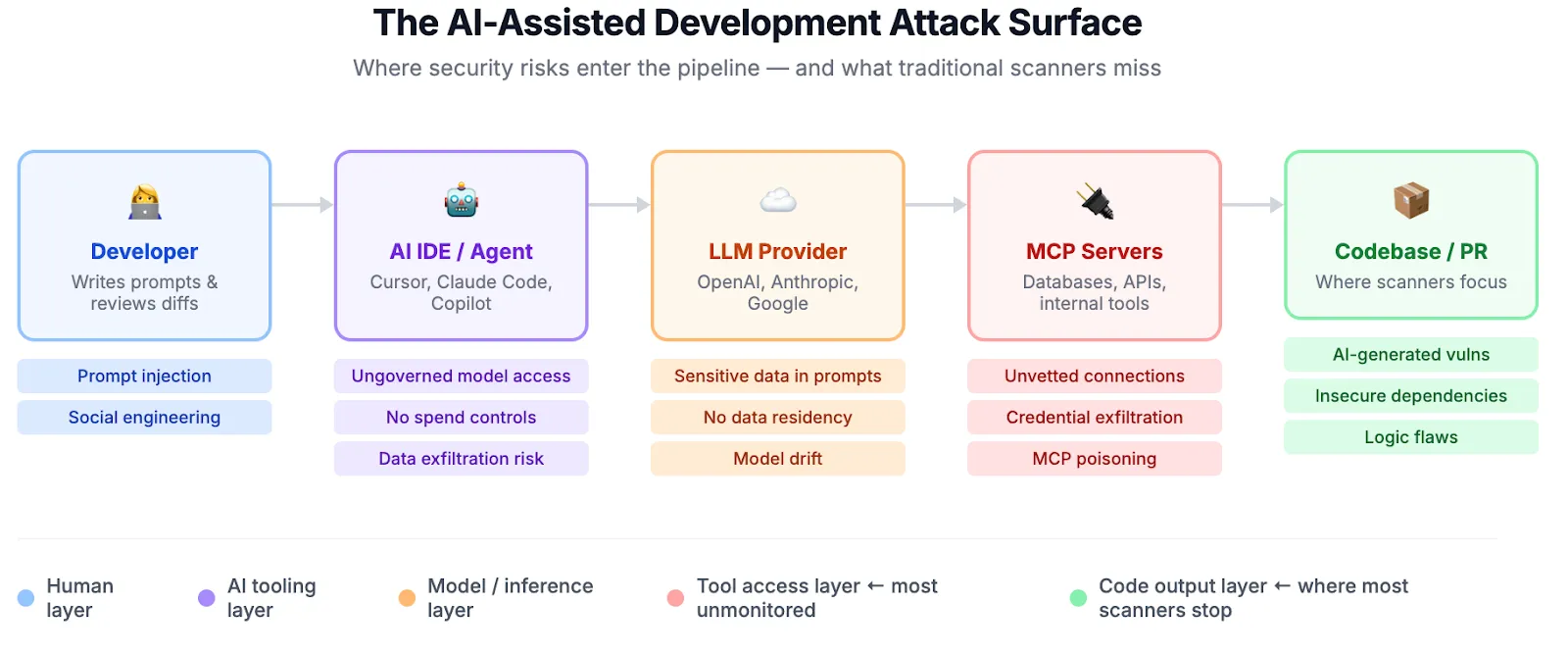

En 2026, sécuriser le développement assisté par l'IA implique de gérer l'ensemble du pipeline, et pas simplement d'exécuter un scan après l'arrivée du code dans une pull request.

Ce guide présente les meilleurs outils de sécurité du code d'IA qui aident réellement les équipes d'entreprise à y faire face.

Comparaison rapide des meilleurs outils de sécurité AI Code

1. TrueFoundry : meilleure plateforme globale de sécurité du code AI

La plupart des outils de sécurité utilisés dans cet espace sont des scanners. Ils examinent le code une fois qu'il existe et vous indiquent ce qui ne va pas. TrueFoundry fait quelque chose de différent. Il contrôle les conditions dans lesquelles le code est généré en premier lieu.

Au centre de celui-ci se trouve le Passerelle IA. Considérez-le comme un proxy inversé entre chaque développeur de votre équipe et chaque fournisseur de LLM qu'il touche. Claude Code, Cursor, un outil CLI aléatoire compatible avec OpenAI qu'un stagiaire a installé la semaine dernière. Tout passe par une seule couche. À partir de là, vous déterminez quels modèles sont disponibles, vous fixez des plafonds de dépenses par équipe, vous inspectez ce qui entre et sort et vous pouvez passer d'un fournisseur à l'autre sans modifier la configuration du client. La configuration prend environ cinq minutes : pointez ANTHROPIC_BASE_URL vers le point de terminaison de votre passerelle et vous avez terminé.

Là où les choses deviennent vraiment intéressantes, c'est Passerelle MCP. Les agents de codage IA communiquent désormais avec des bases de données, des API internes et des services tiers via des serveurs MCP. Cette catégorie de risque existait à peine il y a 18 mois, et la plupart des organisations n'ont aucune visibilité sur les serveurs auxquels leurs agents se connectent. Sécurité de l'IA agentic une exigence pratique plutôt qu'une préoccupation future. TrueFoundry vous permet de mettre en liste des serveurs approuvés, d'inspecter chaque appel d'outil et de supprimer les connexions non autorisées avant qu'elles ne soient terminées. Si vous avez déjà dû expliquer à un CISO pourquoi un agent d'IA interrogeait une base de données de production à 2 heures du matin, vous comprenez pourquoi c'est important.

Une autre chose qui tend à sceller la transaction pour les acheteurs professionnels : TrueFoundry se déploie sur votre propre compte cloud. AWS, GCP ou Azure. Le code, les instructions et les journaux ne quittent jamais votre VPC. Pour les secteurs réglementés où la résidence des données n'est pas négociable, c'est souvent la seule raison pour laquelle ils ont besoin d'être entendus.

Principales caractéristiques

- Passerelle IA avec gouvernance au niveau du modèle. Restreignez l'accès aux modèles par équipe, appliquez des limites de débit et des plafonds budgétaires, acheminez le trafic entre les fournisseurs grâce au basculement automatique. Un seul terminal, un contrôle total.

- Passerelle MCP pour le contrôle d'accès aux outils. Mettez sur liste des serveurs MCP approuvés, inspectez les appels d'outils en temps réel, appliquez des garde-fous avec des contrôles avant exécution et une validation après exécution, bloquez l'accès non autorisé aux données au niveau de la couche agent.

- SSO d'entreprise et contrôles d'identité. SAML 2.0 et OIDC avec Okta, Azure AD (Entra ID), Auth0, Google Workspace. La capture de domaine achemine automatiquement les e-mails professionnels vers votre espace de travail. Le mappage groupe-rôle IdP gère l'attribution automatique des rôles.

- Paramètres gérés via MDM. Transférez les configurations verrouillées via Jamf, Kandji, Mosyle ou Intune pour appliquer les URL de base, les restrictions de modèle et les politiques d'autorisation sur chaque machine de développement (oui, y compris les machines distantes). Le verrouillage des fichiers au niveau du système empêche les modifications par l'utilisateur sans root.

- Journalisation des audits avec exportation OpenTelemetry. Chaque demande LLM, chaque appel d'outil et chaque action d'un agent sont capturés avec une attribution utilisateur complète. Intégrez-le à Splunk, Datadog, Grafana ou à tout autre système que votre SOC exécute déjà. Conservation de plus de 90 jours pour la conformité au SOC 2.

- Déploiement sur site et hybride. Plateforme complète dans votre VPC avec prise en charge du routage AWS Bedrock et Google Vertex AI. Rend les conversations sur le SOC 2, l'HIPAA et la loi européenne sur l'IA beaucoup plus courtes.

Tarification

Basé sur l'utilisation. Évolue en fonction du volume des demandes et des fonctionnalités de gouvernance que vous activez. Comme tout fonctionne dans votre cloud, les coûts d'infrastructure restent transparents. Aucun engagement initial. Commencez avec une seule équipe et développez-vous à partir de là. Les détails des prix sont disponibles sur demande.

Idéal pour

- Les entreprises qui jonglent avec Claude Code, Cursor et Copilot en même temps et qui ont besoin d'un seul endroit pour les gérer toutes

- Des équipes chargées de la sécurité et de la plateforme qui sont responsables du contrôle d'accès à l'IA, de la gouvernance des coûts et de la conformité

- Les organisations des services financiers, de la santé ou du secteur public où le déploiement sur site n'est pas facultatif

- Les équipes en ont assez de rattraper leur retard face aux scanners qui souhaitent prévenir les incidents au lieu de simplement les détecter

Avis des clients

TrueFoundry est noté 4,6/5 sur G2 (début 2026). Les évaluateurs soulignent régulièrement la capacité de la plateforme à simplifier la gouvernance de l'IA sans ralentir les équipes. Les thèmes courants incluent une visibilité claire des coûts et de l'utilisation du LLM par les équipes, un déploiement rapide (plusieurs évaluateurs mentionnent une mise en ligne dans la semaine) et un support réactif qui permet de résoudre rapidement les problèmes techniques. Les équipes d'ingénierie des plateformes et du machine learning constituent la majeure partie des réviseurs, et les commentaires sont très positifs en ce qui concerne la facilité d'utilisation et le contrôle de l'infrastructure.

2. Snyk

Snyk était l'un des favoris des développeurs en matière de sécurité bien avant la génération de code d'IA, et l'entreprise s'est bien adaptée. Leur moteur d'IA DeepCode combine l'IA symbolique avec l'IA générative et l'analyse des flux de données dans plus de 25 millions de cas de flux de données afin de détecter et de corriger les vulnérabilités avec une grande précision.

L'histoire de l'IA prend de l'ampleur ici.

En mai 2025, Snyk a lancé sa plateforme AI Trust, qui traite spécifiquement de la sécurité du code généré par l'IA, de la sécurité des flux de travail des agents et de la protection de la chaîne d'approvisionnement par l'IA. Il s'agit d'une évolution significative par rapport à leurs racines traditionnelles en matière de numérisation.

Principales caractéristiques

- DeepCode IA pour une analyse statique contextuelle avec des suggestions de correction automatique entraînées sur des millions de correctifs réels

- La SCA couvre les vulnérabilités de dépendance à l'open source dans plus de 15 millions de packages, avec plus de 24 000 nouvelles vulnérabilités cataloguées rien qu'en 2024

- Analyse de conteneurs pour les images Docker/OCI et sécurité de l'infrastructure en tant que code pour les manifestes Terraform, CloudFormation et Kubernetes

- Feedback de sécurité en temps réel dans les IDE et les pull requests, ainsi que Snyk Agent Fix pour une correction autonome

Pros

- L'expérience des développeurs est vraiment bonne. La sécurité apparaît là où les ingénieurs travaillent déjà, et non dans un tableau de bord séparé qu'ils n'ouvriront jamais

- Couvre le code, les dépendances, les conteneurs et l'IaC sur une seule plateforme

- La base de données sur les vulnérabilités est mise à jour rapidement, ce qui est important lorsque de nouveaux CVE sont publiés chaque semaine

- La numérisation du référentiel public est gratuite pour tous les plans, ce qui facilite l'évaluation avant d'engager un budget

Les inconvénients

- Analyse le code qui existe déjà. Impossible de déterminer quels modèles l'ont produit ou quelles données ont été envoyées au LLM pendant la génération

- Aucune visibilité sur les connexions au serveur MCP ou le comportement des agents

- Si un développeur passe de Copilot à Claude Code en plein sprint, Snyk ne le sait pas et s'en fiche

3. GitHub Copilot + Sécurité avancée

Si l'ensemble de votre flux de développement se trouve sur GitHub, cette combinaison mérite d'être évaluée. Le hic : vous devez comprendre ce que vous achetez réellement, car il s'agit de produits distincts avec des étiquettes de prix distinctes.

GitHub Copilot gère le codage assisté par l'IA. L'agent de codage exécute des vérifications internes de CodeQL, une analyse des secrets et des analyses de dépendances sur son propre code généré avant d'ouvrir une pull request. Cette validation s'effectue automatiquement et ne nécessite pas de licence Advanced Security. La limite : elle ne couvre que le code écrit par l'agent. Tout ce que vos développeurs humains engagent ? C'est de ta faute.

GitHub Advanced Security (GHAS) est l'endroit où se trouve la couverture complète des scans. En avril 2025, GitHub a dégroupé GHAS en deux produits autonomes : Code Security à 30$ par participant actif par mois (scan CodeQL, Copilot Autofix pour toutes les alertes, campagnes de sécurité) et Protection secrète à 19$ par participant actif et par mois (analyse secrète sur les dépôts privés, protection push, détection des informations d'identification alimentée par l'IA). Les deux sont disponibles pour les comptes GitHub Team et Enterprise Cloud.

Principales caractéristiques

- Analyse statique CodeQL avec Copilot Autofix générant des correctifs ciblés (nécessite une licence Code Security)

- Analyse secrète avec protection push qui bloque les informations d'identification avant qu'elles n'atteignent le dépôt (nécessite une licence Secret Protection)

- Autovalidation de sécurité intégrée à l'agent de codage Copilot (incluse avec Copilot, aucune licence GHAS n'est requise)

- Examen des dépendances par rapport à la base de données consultative GitHub

- Contrôles d'entreprise pour l'accès aux modèles, la conservation des données et les politiques au niveau de l'organisation

Pros

- L'intégration la plus étroite entre le codage IA et l'analyse de sécurité disponible aujourd'hui

- Autofix ne se contente pas de signaler les problèmes. Il génère des correctifs qui fonctionnent souvent du premier coup

- L'autovalidation de l'agent de codage détecte les problèmes liés au code généré par l'agent sans frais supplémentaires

- Contrôles d'entreprise matures : SSO, journaux d'audit, indemnité IP, exclusions de contenu

Les inconvénients

- L'analyse de sécurité complète nécessite des achats GHAS séparés (30$ + 19$ par participant et par mois s'additionnent rapidement à grande échelle)

- Tout s'arrête à la limite de GitHub. Des développeurs utilisant Cursor ou Claude Code ? Totalement non gouverné

- Pas de passerelle MCP, pas de routage entre modèles d'outils, pas d'application budgétaire en dehors de GitHub

- Pour les organisations dotées d'une stratégie multi-outils (la plupart d'entre elles sont actuellement), vous avez toujours besoin d'autre chose

4. Cursor Enterprise

Il est difficile d'ignorer la croissance de Cursor. Les développeurs de plus de la moitié des entreprises du Fortune 500 l'utilisent désormais, une étape franchie environ deux ans après son lancement. Selon l'étude de cas publiée par Cursor, Stripe a déployé Cursor auprès de plus de 3 000 ingénieurs, dont plus de 70 % l'utilisent activement. Le plan Enterprise ajoute ce dont les équipes de sécurité ont réellement besoin : des contrôles de confidentialité renforcés, l'exécution des agents en mode sandbox et le système Hooks qui vous permet d'injecter une logique de gouvernance personnalisée directement dans la boucle des agents.

Principales caractéristiques

- Mode confidentialité, appliqué par défaut sur les forfaits Business et Enterprise, sans aucun accord de conservation des données entre les principaux fournisseurs de modèles, notamment OpenAI, Anthropic, Google Cloud Vertex et xAi

- Mode sandbox qui restreint l'accès au terminal de l'agent (réseau bloqué par défaut, accès aux fichiers limité à l'espace de travail et à /tmp/)

- SSO via SAML 2.0 et OIDC avec provisionnement SCIM 2.0 sur les forfaits Enterprise

- Hooks pour des contrôles de sécurité personnalisés avant exécution : les hooks BeforeShellExecution, BeforeMCPExecution et BeforeReadFile peuvent autoriser, avertir ou refuser des actions. Les partenaires incluent Snyk, 1Password, Endor Labs et Semgrep

- Les journaux d'audit suivent plus de 20 types d'événements couvrant l'accès, la modification des actifs et les mises à jour de configuration

Pros

- Probablement l'IDE d'IA le plus mature du marché, avec une prise en charge multimodèle approfondie et une adoption sérieuse par les entreprises

- Le mode Sandbox fonctionne réellement. Les agents ne peuvent pas accéder au réseau ou quitter l'espace de travail par défaut, et les administrateurs peuvent appliquer les listes d'autorisation réseau depuis le tableau de bord

- Les hooks sont puissants si votre équipe dispose de la bande passante nécessaire pour les créer et les gérer

- Certifié SOC 2 Type II (rapport disponible sur trust.cursor.com)

Les inconvénients

- Toute cette gouvernance s'applique uniquement à Cursor. Ouvrez Claude Code dans un terminal et rien de tout cela ne suit

- Les hooks nécessitent l'écriture de scripts par équipe. Il n'existe pas de moteur de politique centralisé qui impose des règles à l'échelle de l'organisation

- Aucune analyse de vulnérabilité intégrée, vous aurez donc toujours besoin que Snyk ou CodeQL s'exécutent séparément

- L'injection rapide et l'empoisonnement au MCP restent des vecteurs d'attaque documentés

5. Sécurité Claude Code

Anthropic a annoncé Claude Code Security le 20 février 2026, affirmant avoir découvert des vulnérabilités qui ont survécu à des décennies d'examen par des experts dans de grands projets open source. Il y a un réel fondement derrière cette affirmation. À l'aide de Claude Opus 4.6, l'équipe d'Anthropic a découvert plus de 500 vulnérabilités dans des bases de code open source de production. Une divulgation responsable est en cours et des correctifs ont déjà été mis en place : 22 vulnérabilités de Firefox (14 de gravité élevée) ont été corrigées dans Firefox 148, avec des découvertes supplémentaires dans Ghostscript, OpenSC et CGIF.

Qu'est-ce qui le différencie du SAST traditionnel ? Au lieu de faire correspondre les modèles à une base de données de règles, il lit la base de code de manière holistique. Il retrace les flux de données entre les composants, détermine comment les couches d'authentification interagissent avec la logique métier et signale les problèmes liés au contexte qu'un chercheur en sécurité humaine détecterait lors d'un audit approfondi mais qu'un scanner automatique passerait juste devant.

Principales caractéristiques

- Un raisonnement de code qui va au-delà de l'appariement de modèles pour comprendre le contexte architectural

- Processus de vérification en plusieurs étapes qui filtre les faux positifs avant de les signaler

- Résultats classés en termes de gravité avec suggestions de correctifs ciblées

- Modèle intégré à l'humain dans lequel chaque correctif nécessite l'approbation explicite des développeurs

- Disponible pour les clients Enterprise et Team en avant-première limitée, avec un accès accéléré gratuit pour les mainteneurs open source

Pros

- Détecte les classes de vulnérabilité que les outils d'analyse statique ignorent régulièrement : contrôle d'accès défaillant, failles logiques, contournements subtils d'authentification

- Le filtrage faussement positif est suffisamment agressif pour être utile, afin de ne pas vous noyer dans le bruit

- Les suggestions de correctifs permettent de gagner des heures de correction par découverte

- L'accès gratuit pour les responsables de l'open source constitue une contribution significative à l'écosystème

Les inconvénients

- Toujours en avant-première de recherche limitée. Vous ne pouvez pas simplement vous inscrire et commencer à l'utiliser dès aujourd'hui

- Cloud uniquement. Votre code est envoyé à l'infrastructure d'Anthropic à des fins d'analyse, ce qui est un échec pour certaines entreprises

- C'est purement un outil de recherche de vulnérabilités. Pas de modèle de gouvernance, pas de contrôle du MCP, pas d'application du budget

- Ne répond pas à la question en amont de savoir comment les outils d'IA accèdent à votre base de code en premier lieu

6. Sécurité du Codex OpenAI

L'entrée d'OpenAI dans la sécurité du code adopte l'approche la plus intéressante de tous les scanners de cette liste. Avant d'effectuer une seule vérification, Codex Security élabore un modèle de menace pour votre référentiel, en cartographiant l'architecture du système, les limites de confiance, les points d'exposition, les hypothèses d'authentification et les chemins de données sensibles. Les résultats sont ensuite classés par rapport à ce modèle, afin que vous puissiez voir ce qui est réellement important dans le contexte de votre système au lieu d'obtenir un score de gravité générique.

Lancé le 6 mars 2026 (initialement baptisé Aardvark), les premiers résultats sont solides. Quatorze CVE ont été assignés dans le cadre d'une divulgation responsable, notamment des bogues de sécurité de la mémoire dans GNUTL, notamment un double-free, une surlecture et un dépassement de mémoire tampon (CVE-2025-32988, CVE-2025-32989, CVE-2025-32990), un contournement 2FA dans GOGS (CVE-2025-64175) et des découvertes dans OpenSSH, libssh, PHP et Chromium.

Principales caractéristiques

- Modèles de menaces automatisés et modifiables générés par référentiel couvrant les points d'entrée, les limites de confiance et les domaines d'évaluation prioritaires

- Découverte de vulnérabilités basée sur le contexte du système spécifique au projet

- Résultats classés en fonction de leur impact dans le monde réel, et non selon des scores de gravité génériques

- Processus en trois étapes (identification, validation, remédiation) avec collecte de preuves basée sur un bac à sable

- Disponible en version préliminaire de recherche pour les clients de ChatGPT Pro, Enterprise, Business et Edu

Pros

- L'approche du modèle de menace permet de résoudre le problème des faux positifs qui affecte tous les autres scanners

- Nous produisons déjà de véritables CVE divulgués dans des logiciels de production, et pas seulement des chiffres de référence

- Gratuit pendant l'aperçu de la recherche

- S'intègre naturellement aux flux de travail existants de ChatGPT Enterprise

Les inconvénients

- Aperçu de la recherche avec accès restreint. Non disponible en dehors de l'écosystème OpenAI

- Aucune capacité de gouvernance. Impossible de contrôler le routage des modèles, l'accès au MCP ou les politiques relatives aux outils de développement

- Verrouillé sur la plateforme OpenAI. Si votre équipe utilise Claude Code ou Cursor, cet outil ne l'aidera pas

7. Cycode

Cycode se concentre sur la question qui empêche les RSSI de dormir la nuit : où se trouve exactement le code généré par l'IA dans notre base de code, et quelqu'un l'a-t-il réellement revu avant sa livraison ? Leur rapport sur l'état de la sécurité des produits en 2026 a interrogé 400 RSSI et responsables de la sécurité des applications et a révélé que 100 % des organisations utilisaient du code généré par l'IA en production. Seulement 19 % avaient une visibilité complète sur l'endroit et la manière dont l'IA était utilisée, tandis que 81 % n'avaient aucune supervision complète.

Principales caractéristiques

- Visibilité à l'échelle du SDLC, de la validation du code au déploiement dans le cloud, y compris la gestion de l'inventaire de l'IA entre les assistants de codage, les modèles et les serveurs MCP

- Détection et suivi du code généré par l'IA dans la base de code avec AI Bill of Materials (AIBOM)

- Sécurité de la chaîne d'approvisionnement logicielle avec contrôles de l'intégrité des pipelines et détection de la configuration du serveur MCP

- Flux de travail centralisés de détection et de correction des secrets

- Priorisation des alertes basée sur les risques

Pros

- Répond directement à la question de l'audit : « Montrez-moi où l'IA a écrit le code et si quelqu'un l'a revu »

- Reconnu dans le Magic Quadrant 2025 de Gartner pour les tests de sécurité des applications et classé #1 en matière de sécurité de la chaîne d'approvisionnement logicielle dans le rapport sur les capacités critiques 2025

- L'accent mis sur la chaîne d'approvisionnement est très important lorsque les outils d'IA créent des dépendances que personne n'a vérifiées

- Consolide les outils AST fragmentés en une seule vue ASPM

Les inconvénients

- La détection a lieu après coup. N'empêche pas la génération de code IA non sécurisé en premier lieu

- Pas de gouvernance des outils d'IA, de contrôles de routage des modèles ou de visibilité MCP au niveau de la couche de génération

- L'intégration dans l'ensemble du SDLC nécessite un réel effort d'ingénierie

8. Checkmarx 1

Checkmarx est dans l'AppSec d'entreprise depuis plus longtemps que la plupart des outils de cette liste n'existent. Ils sont titulaires pour une bonne raison.

En mars 2026, ils ont lancé la gamme d'agents d'IA agentiques Assist, notamment Developer Assist, Triage Assist et Remediation Assist, qui préviennent et corrigent de manière autonome les failles de sécurité tout au long du cycle de développement. Cela s'ajoute à leur couverture de numérisation déjà étendue.

Principales caractéristiques

- Numérisation des données SAST, SCA, DAST, sécurité des API, IaC et sécurité des conteneurs sur une seule plateforme, protection contre les paquets malveillants et détection des secrets

- Détection des menaces par IA agentic (famille Assist) avec Developer Assist, Triage Assist et Remediation Assist fonctionnant de manière autonome sur le SDLC

- ASPM d'entreprise avec priorisation des vulnérabilités basée sur les risques qui regroupe et met en corrélation les signaux provenant de tous les outils de test

- Déploiement sur site et à distance pour les secteurs réglementés avec un contrôle total de l'infrastructure

- Intégration CI/CD approfondie avec la plupart des principaux outils de pipeline

Pros

- La couverture de numérisation la plus large de toutes les plateformes ici. Si vous avez besoin d'un outil pour couvrir le code, les API, les conteneurs et l'infrastructure, c'est celui-ci

- Éprouvé à l'échelle de l'entreprise avec des portefeuilles d'applications complexes et multilingues

- L'option de déploiement aérospatial est importante pour la défense, les finances et les soins de santé

- Les nouveaux agents Assist apportent une solution autonome à une plateforme déjà complète

Les inconvénients

- Pour régler correctement Checkmarx au sein d'une grande organisation, il faut déployer des efforts dévoués. La complexité de la configuration est réelle

- C'est une plateforme de numérisation dans l'âme. Pas de gouvernance des outils d'IA, pas de routage de modèles, pas de contrôles MCP

- La tarification est basée sur des devis et, d'après ce que j'ai vu lors de conversations avec le secteur, elle reflète le montant qu'elle couvre. Il ne s'agit pas d'un outil que vous évaluez en un week-end

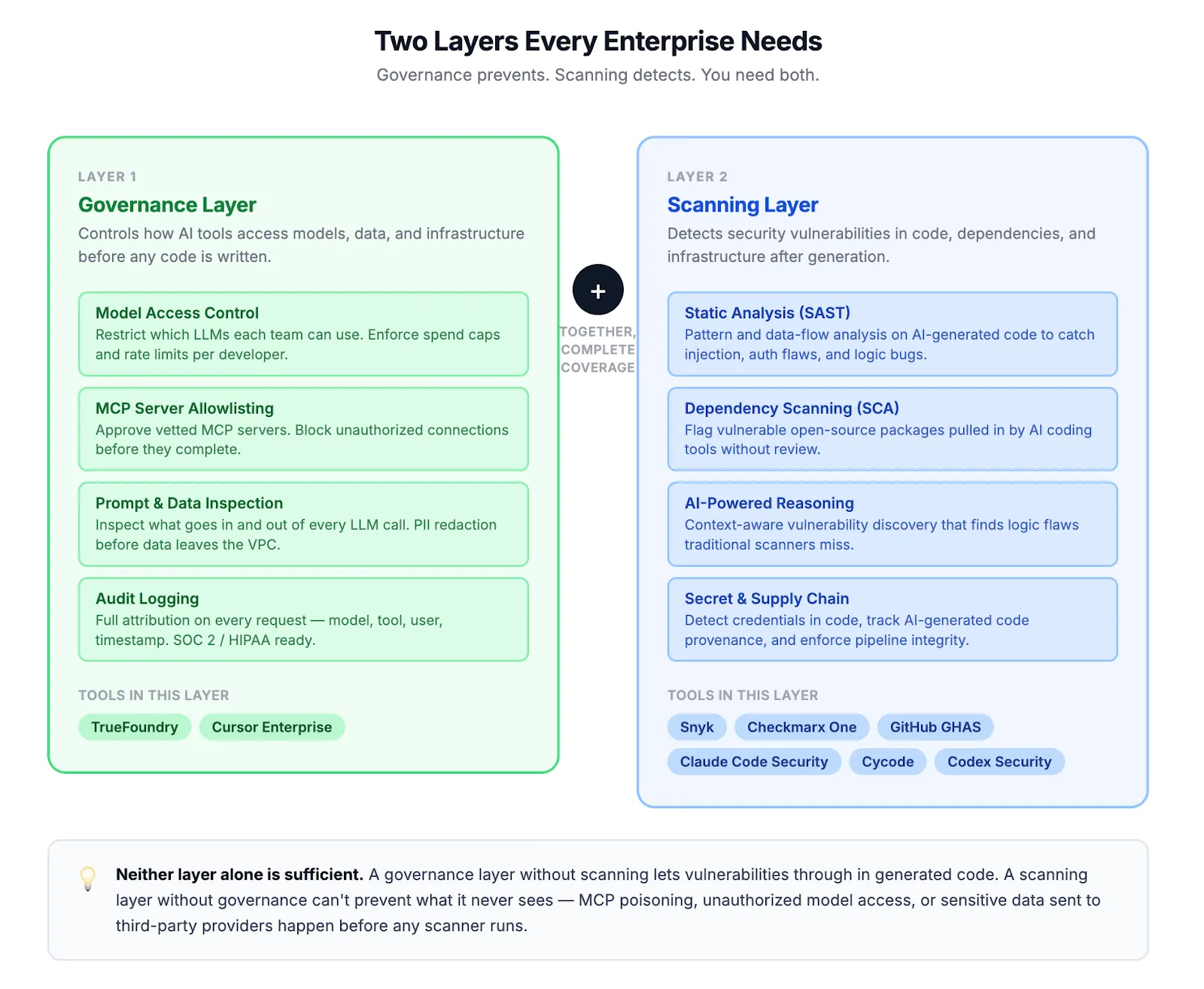

Comment choisir le bon outil de sécurité AI Code

Tous les outils de cette liste ne résolvent pas le même problème, et choisir le mauvais signifie soit scanner un code qui n'aurait pas dû être généré de cette façon au départ, soit régir l'accès aux outils alors que des vulnérabilités passent inaperçues. Votre équipe fait probablement face à une combinaison des deux. Voici une liste de contrôle rapide :

- Est-ce qu'il régit l'accès aux outils d'IA, ou est-ce qu'il scanne simplement les résultats ? Si vos ingénieurs utilisent Claude Code, Cursor et Copilot de manière interchangeable, vous avez besoin d'une gouvernance au niveau de la couche d'outils, et pas seulement de la numérisation au niveau de la couche PR.

- Peut-il contrôler les connexions au serveur MCP ? Les agents d'IA communiquent désormais avec des bases de données et des API internes via MCP. Si votre outil de sécurité ne connaît même pas l'existence du MCP, c'est qu'il ne dispose pas d'une surface d'attaque croissante.

- Cela fonctionne-t-il sur l'ensemble de votre chaîne d'outils ? Une solution qui ne couvre qu'un seul IDE ou un seul hôte de code laisse des lacunes partout où les développeurs changent d'outil.

- Peut-il faire respecter les limites budgétaires et tarifaires ? L'emballement des dépenses liées à l'IA constitue également un problème de sécurité. La gouvernance des coûts et la gouvernance des accès font souvent partie de la même plateforme.

- Est-ce qu'il prend en charge le déploiement sur site ou VPC ? Pour les secteurs réglementés, les outils dédiés au SaaS sont souvent un échec. Votre code et vos instructions ne doivent pas quitter votre infrastructure.

- Fournit-il des pistes d'audit ? Le SOC 2, la HIPAA et la loi européenne sur l'IA exigent tous une gouvernance démontrable des systèmes d'IA. Si vous ne pouvez pas indiquer qui a utilisé quel modèle et quelles données ont été envoyées, il y a un écart de conformité.

- Peut-il détecter spécifiquement des vulnérabilités dans le code généré par l'IA ? Les outils SAST traditionnels n'ont pas été conçus pour les modèles générés par l'IA. Les outils qui comprennent le comportement du codage de l'IA en détectent davantage.

- Est-il conçu pour la direction que prend l'industrie ? Les agents de codage basés sur l'IA gagnent en autonomie chaque trimestre. Vos outils de sécurité doivent suivre le rythme des agents qui exécutent des commandes shell, appellent des outils et ouvrent des PR sans examen humain.

Les équipes opérant à grande échelle ont généralement besoin des deux : une couche de gouvernance telle que TrueFoundry pour contrôler la façon dont les outils d'IA interagissent avec votre infrastructure, et des outils d'analyse tels que Snyk, Claude Code Security ou Checkmarx pour détecter ce qui se passe.

La sécurité du code AI n'est plus facultative

Voici la réalité de 2026 : l'IA ne contribue plus au développement. C'est lui qui le conduit. Les ingénieurs des plus grandes entreprises du monde ont confié une grande partie de leur flux de travail à des agents d'IA qui lisent les bases de code, exécutent des commandes et envoient du code de manière autonome. Ce n'est pas un ralentissement.

Les outils de sécurité n'ont pas suivi le rythme. La plupart des entreprises essaient toujours de sécuriser le code généré par l'IA à l'aide des mêmes outils d'analyse statique qu'ils utilisent depuis dix ans. Ces outils n'ont jamais été conçus pour un monde où un agent d'IA se connecte à un serveur MCP non approuvé, extrait une dépendance non vérifiée et commet un code qui semble correct mais dangereux.

Les organisations qui y parviendront seront celles qui combineront gouvernance et détection : en contrôlant la manière dont les outils d'IA accèdent aux modèles, à l'infrastructure et aux données à la source, tout en analysant les résultats pour détecter les vulnérabilités qui se glissent inévitablement.

Questions fréquemment posées

Que sont les outils de sécurité du code AI ?

Les outils de sécurité du code d'IA aident les entreprises à détecter et à prévenir les failles de sécurité introduites par le développement assisté par l'IA. Cela inclut l'analyse du code généré par l'IA pour détecter les failles, la gestion des modèles et outils d'IA auxquels les développeurs peuvent accéder, le contrôle de la façon dont les agents d'IA interagissent avec l'infrastructure via les serveurs MCP et la gestion de pistes d'audit pour la conformité. Certains outils se concentrent sur l'analyse (Snyk, Checkmarx), d'autres sur la gouvernance (TrueFoundry) et d'autres sur la découverte approfondie de vulnérabilités (Claude Code Security, Codex Security).

Quel est le meilleur outil de sécurité du code IA pour les entreprises ?

Cela dépend de votre plus grand risque. Pour les organisations utilisant plusieurs outils de codage d'IA et nécessitant une gouvernance centralisée, TrueFoundry fournit le contrôle le plus large via ses passerelles AI et MCP Gateway. Snyk et Checkmarx offrent une couverture solide si la numérisation du code généré par l'IA est votre principale préoccupation. En ce qui concerne la découverte des vulnérabilités, Claude Code Security et OpenAI Codex Security utilisent le raisonnement de l'IA pour identifier les problèmes que les scanners traditionnels ne détectent pas. La plupart des entreprises ont besoin d'une combinaison d'outils de gouvernance et d'analyse.

Comment les outils de codage IA introduisent-ils des risques de sécurité ?

Les outils de codage IA tels que Claude Code, Cursor et GitHub Copilot fonctionnent avec des privilèges de niveau développeur. Ils peuvent lire des fichiers, exécuter des commandes shell, se connecter à des bases de données et à des API via des serveurs MCP et valider du code dans des référentiels. Des risques de sécurité apparaissent lorsque ces outils se connectent à des serveurs MCP non approuvés, génèrent du code présentant des vulnérabilités, introduisent des dépendances non vérifiées ou envoient des données sensibles à des fournisseurs LLM tiers. Selon les recherches menées par Veracode en 2025, l'IA a introduit des vulnérabilités dans 45 % des tâches de codage testées. L'analyse statique traditionnelle ne permet pas de détecter la plupart de ces risques, car la menace réside dans le flux de travail, et pas seulement dans le code.

Comment TrueFoundry sécurise-t-il le développement assisté par l'IA ?

TrueFoundry déploie une passerelle AI et une passerelle MCP dans votre propre compte cloud (AWS, GCP ou Azure) pour intercepter et gérer tout le trafic de codage de l'IA. Il contrôle les modèles auxquels les développeurs peuvent accéder, applique les limites de budget et de débit par équipe, répertorie les serveurs MCP approuvés, applique des garde-fous avec des contrôles avant exécution et une validation après exécution, et capture des journaux d'audit complets exportables via OpenTelemetry. Comme tout s'exécute dans votre VPC, le code et les instructions ne quittent jamais votre infrastructure, ce qui la rend idéale pour les organisations soumises à des exigences strictes en matière de résidence des données et de conformité en vertu de la SOC 2, de la HIPAA et de la loi européenne sur l'IA.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)