Interopérabilité de l'IA : comment les passerelles IA résolvent le défi du multimodèle

Conçu pour la vitesse : latence d'environ 10 ms, même en cas de charge

Une méthode incroyablement rapide pour créer, suivre et déployer vos modèles !

- Gère plus de 350 RPS sur un seul processeur virtuel, aucun réglage n'est nécessaire

- Prêt pour la production avec un support complet pour les entreprises

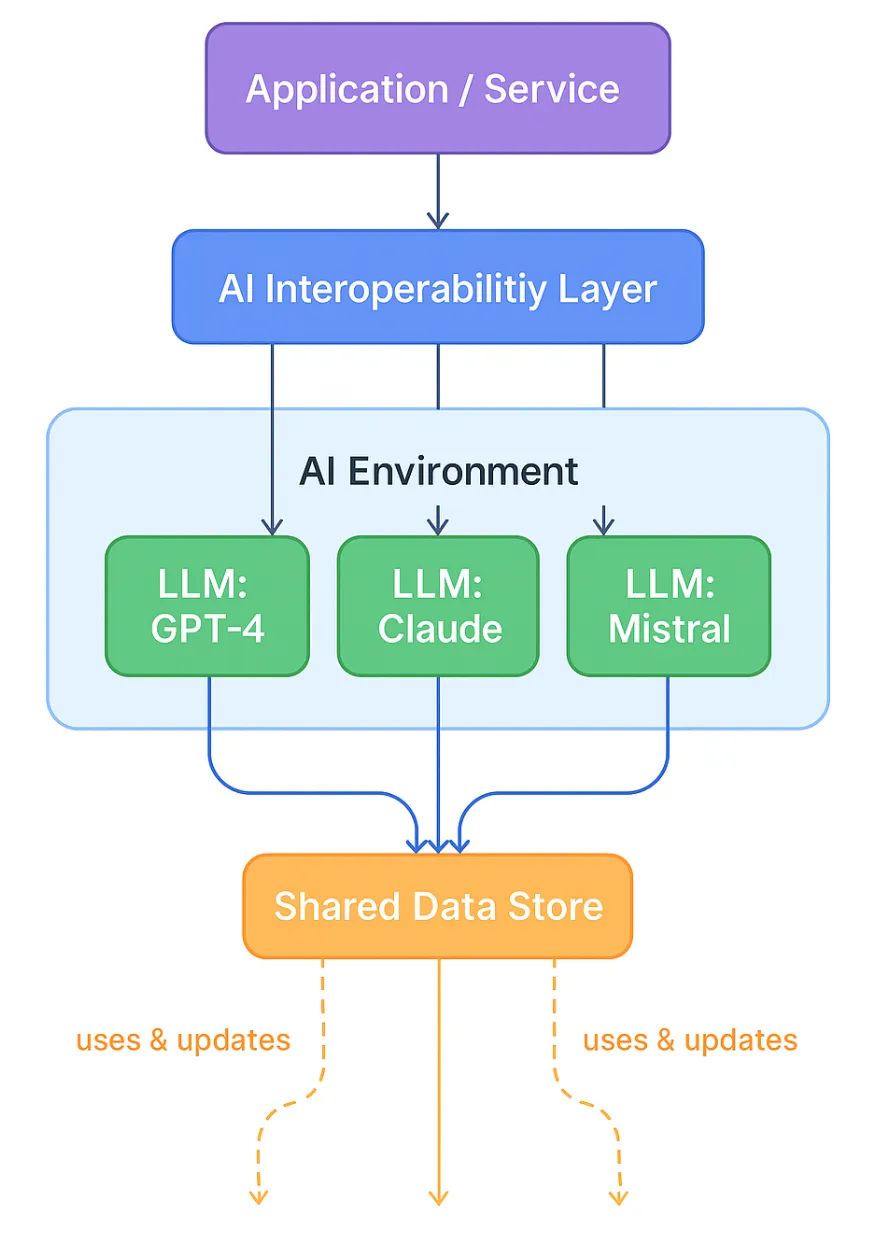

L'IA infra n'est plus un monolithe unique aujourd'hui, elle a évolué pour devenir un écosystème de modèles, d'agents, d'outils, de magasins de données et de plans de contrôle. L'infrastructure d'IA a évolué au-delà d'un modèle ou d'une plateforme unique. Le stack d'entreprise actuel est un écosystème tentaculaire de LLM, agents, bases de données vectorielles, cadres d'orchestration et plans de contrôle — chacun avec ses propres API, formats et règles de gouvernance. Au niveau de l'entreprise, cette hétérogénéité crée à la fois des opportunités et des problèmes. Les équipes peuvent choisir le meilleur modèle pour un travail, mais différents fournisseurs utilisent des API différentes, proposent des formes différentes et nécessitent une gouvernance différente.

Les entreprises veulent avoir la flexibilité nécessaire pour utiliser le meilleur modèle pour chaque tâche, mais chaque fournisseur utilise une API différente, renvoie un schéma différent et nécessite des informations d'identification différentes. Sans couche unificatrice, les équipes finissent par écrire des intégrations fragiles et gérer une observabilité et une conformité éparpillées.

La réponse est architecturale et non procédurale.

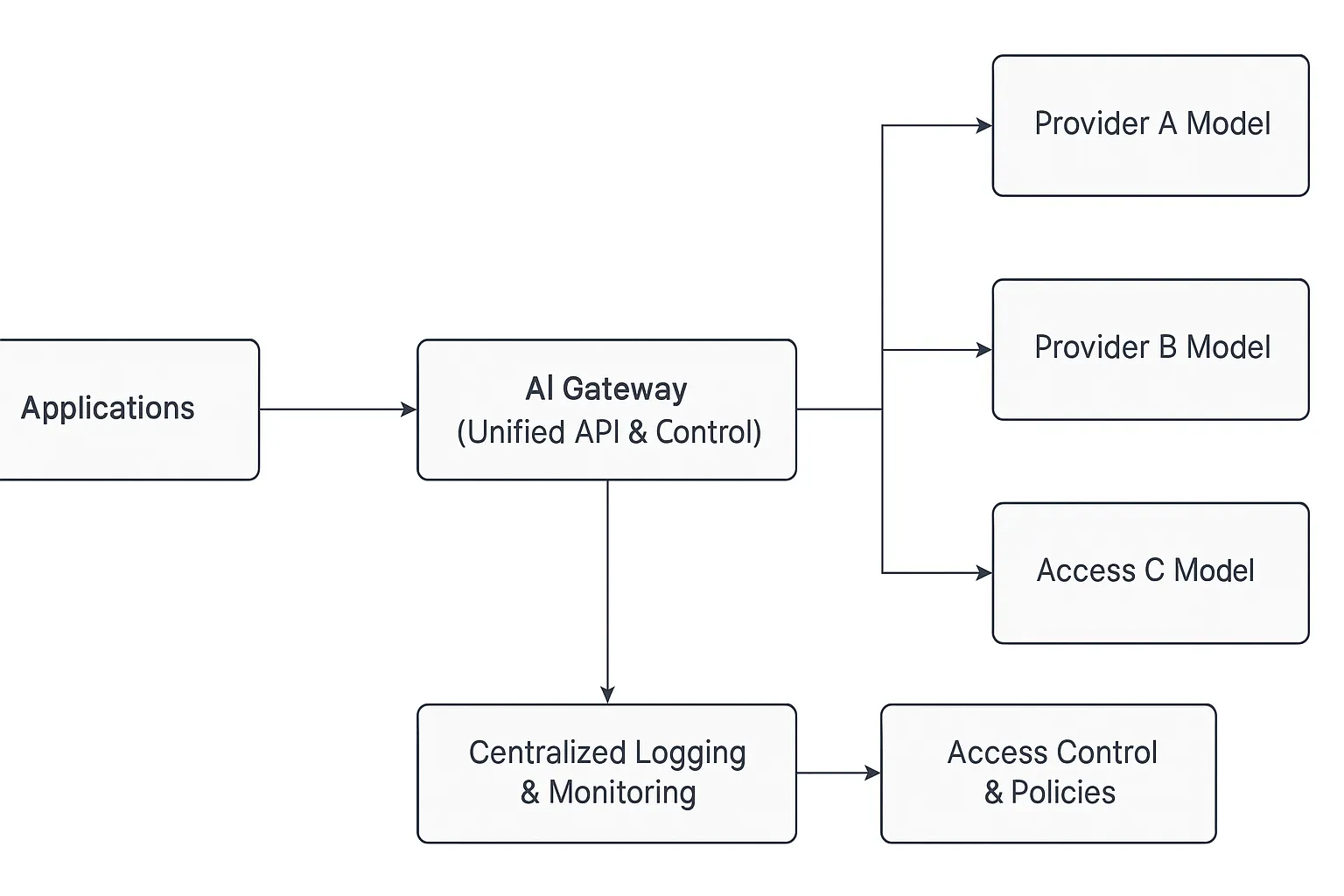

L'interopérabilité de l'IA doit être conçue et non corrigée. Et le principal moteur de cette conception est le Passerelle IA: une couche centrale qui normalise la façon dont les applications interagissent avec les modèles, les outils et les agents. Une passerelle d'IA agit comme le « langage commun » de votre écosystème d'IA. Il normalise les entrées et les sorties, applique les politiques de sécurité et de conformité, achemine le trafic de manière intelligente et fournit une observabilité unifiée. En bref, il transforme une infrastructure d'IA fragmentée en système régi et cohésif.

Qu'est-ce que l'interopérabilité de l'IA ?

En termes très simples, l'interopérabilité de l'IA est la capacité des systèmes d'IA à fonctionner et à s'intégrer de manière fluide. Cela signifie à son tour que votre pile suit des interfaces et des formats courants. Par exemple, le transfert d'une tâche du modèle A au modèle B ne devrait pas nécessiter de modifications au niveau du schéma ni de modification des configurations d'API. L'interopérabilité de l'IA permet « à différents modèles, API, formats de données et systèmes de fonctionner ensemble sans nécessiter de code personnalisé pour chaque intégration. En d'autres termes, vous pouvez passer d'un fournisseur à l'autre, combiner plusieurs LLM ou mettre à niveau des modèles, le tout sans interrompre votre infrastructure existante.

Un autre aspect de l'interopérabilité de l'IA est la création de »différents systèmes, modèles et agents d'IA fonctionnent ensemble, échangeant des données de manière fluide, prenant des décisions en collaboration et déclenchant des actions sur toutes les plateformes». Cela va au-delà des API : cela signifie que les agents d'IA partagent le contexte et le langage, coordonnent leurs tâches et réutilisent les résultats des uns et des autres. Imaginez-le comme les flux de travail connectés d'une organisation : votre messagerie, votre CRM et votre outil de suivi de projet ont chacun leur propre travail, mais lorsqu'ils partagent des données, ils constituent un processus automatisé fluide. L'interopérabilité de l'IA réduit également les silos en permettant aux modèles et aux outils de parler un langage commun.

L'interopérabilité de l'IA consiste à créer des systèmes flexibles et modulaires avec :

- API/SDK standardisés : interface unifiée qui masque les informations d'identification et de terminaison uniques de chaque modèle.

- Cohérence des données et des schémas : Utilisation de formats courants (par exemple, des schémas JSON ou des intégrations vectorielles) afin que toutes les parties du système comprennent les entrées/sorties.

- Outillage unifié : modèles d'invite partagés, normalisation des sorties et pipelines de surveillance/journalisation communs.

- Orchestration dynamique : plan de contrôle qui peut acheminer les tâches entre les modèles en fonction des performances, des coûts ou d'autres critères.

Pourquoi l'interopérabilité de l'IA est-elle importante ?

Les systèmes flexibles et modulaires sont une bonne chose à avoir mais difficiles à entretenir. Pourquoi avons-nous même besoin d'une interopérabilité avec l'IA ?

La réponse est courte et simple, et comprenons-la à l'aide d'un exemple simple. Supposons que vous souhaitiez utiliser 2 modèles différents Gemini et Claude pour une seule tâche. Gemini est spécialisé dans la gestion de très longues fenêtres de contexte, tandis que Claude est spécialisé dans les problèmes de raisonnement approfondi, avec une interface unifiée unique qui vous permet de changer facilement de modèle, d'éliminer les changements de niveau de code et de rendre votre application plus robuste grâce à la diversité des tâches qu'elle peut gérer. Un autre bon exemple est la façon dont certains petits modèles peuvent vous aider à gérer des requêtes plus simples et à économiser beaucoup d'argent, car les LLM à raisonnement complexe peuvent faire grimper vos coûts assez rapidement.

L'interopérabilité réduit :

- Verrouillage vis-à-vis d'un fournisseur : Vous pouvez changer de modèle ou en ajouter sans avoir à effectuer de grandes réécritures.

- Frais d'intégration : Les équipes consacrent moins de temps à la plomberie des API et davantage à la création de valeur.

- Coût : Acheminez les charges de travail à haut débit vers des modèles moins chers et réservez des charges de travail haut de gamme pour les tâches critiques.

- Risque opérationnel : Les modèles de basculement peuvent être configurés pour garantir la fiabilité et la continuité de la conformité.

Dans un monde où de nouveaux modèles apparaissent chaque semaine, l'interopérabilité garantit la pérennité de votre stack adaptatif, résilient et évolutif, améliore la productivité, la qualité des décisions, amplifie les forces de l'IA, accélère l'orchestration de l'IA et réduit les coûts d'intégration.

Composants essentiels des systèmes d'IA interopérables

L'interopérabilité au niveau de l'entreprise peut être comprise à trois niveaux :

Les éléments de base supplémentaires incluent :

- API et SDK standardisés pour un accès fluide aux fournisseurs.

- Normalisation rapide et de sortie pour un comportement prévisible du modèle.

- Observabilité unifiée à l'aide des intégrations OpenTelemetry ou Grafana.

- Routage et orchestration flexibles qui choisit dynamiquement le meilleur modèle.

- Sécurité et gouvernance pour appliquer les limites de débit, l'authentification et la conformité.

Un exemple simple :

Au lieu que les applications gèrent plusieurs connecteurs, la passerelle AI expose un point de terminaison d'API. Il gère la gestion des clés, la normalisation des schémas et la logique de routage en interne, permettant aux développeurs d'appeler n'importe quel modèle via la même interface.

Difficultés liées à l'interopérabilité

L'intégration de divers systèmes d'IA présente quelques défis majeurs. En voici quelques-unes expliquées :

- Portabilité rapide :Les modèles répondent différemment à la même invite. Un prompt réglé pour GPT-4 peut donner des résultats non pertinents sur Claude ou Mistral. Cela signifie que les instructions ont souvent besoin d'être repensées et de nouveaux tests approfondis lorsque les modèles changent. La surcharge liée à l'ajustement des instructions par modèle rend difficile la commutation fluide. Voici un exemple simple de la façon dont le code peut être écrit pour s'adapter à plusieurs modèles.

def normalize_prompt(template, vars, model_family):

prefix = {

"gpt": "SYSTEM: enterprise assistant; JSON_ONLY=true\n",

"claude": "Human: enterprise assistant\nAssistant:",

"mistral": "<s>[INST] enterprise assistant [/INST]"

}.get(model_family.lower(), "")

safe_vars = {k: str(v).replace("{", "{{").replace("}", "}}") for k,v in vars.items()}

return prefix + template.format(**safe_vars)

- Fragmentation de l'observabilité: Les outils de surveillance et les tableaux de bord sont généralement liés à des fournisseurs spécifiques. Lorsque plusieurs modèles sont utilisés, il existe un risque de fragmentation de la journalisation et des analyses. Sans indicateurs centralisés, il est difficile de comparer les performances ou de diagnostiquer les problèmes au sein du système. Voici un exemple de ce à quoi pourrait ressembler le code de journalisation des modèles.

from opentelemetry import trace

tracer = trace.get_tracer(__name__)

def log_call(model_name, request_meta, response_meta):

with tracer.start_as_current_span("model_call") as span:

span.set_attribute("model.name", model_name)

span.set_attribute("request.tokens", request_meta.get("tokens",0))

span.set_attribute("response.latency_ms", response_meta.get("latency_ms",0))

- Logique de routage complexe: Il peut être très complexe de définir quand et comment acheminer les requêtes entre les modèles. Les règles basées sur le type de tâche, les limites de coûts ou l'heuristique des performances peuvent se multiplier rapidement. Voici un exemple de logique de routage simple.

def route_request(task_type: str, cost_limit: float, latency_target: int):

routing_rules = {

"reasoning": "claude-3",

"summarization": "gpt-4o-mini",

"bulk_text": "mistral-7b",

}

# Select model based on task type

model = routing_rules.get(task_type.lower())

# Apply policy overrides (cost and latency aware)

if cost_limit < 0.01:

model = "mistral-7b" # cheapest

elif latency_target < 1000:

model = "gemini-flash" # fastest

elif not model:

model = "gpt-4o" # default fallback

return model

- Sécurité et conformité : Grâce à l'interopérabilité, vous augmentez la surface d'attaque et l'exposition des données. Plus de connexions et de flux de données signifient plus de points à sécuriser. Il est difficile de garantir la cohérence de la confidentialité, du chiffrement et de la conformité des données (par exemple, le RGPD) sur tous les modèles intégrés.

import hashlib, json

def secure_payload(data, key):

sanitized = {k:v for k,v in data.items() if k not in ("pii","secrets")}

encrypted = hashlib.sha256(json.dumps(sanitized).encode() + key.encode()).hexdigest()

return {"data_hash": encrypted, "meta": {"secured": True}}

Avantages de l'interopérabilité de l'IA

Si elle est bien menée, l'interopérabilité de l'IA apporte de grands avantages à la fois à la technologie et aux entreprises.

- Évolutivité: L'ajout de nouvelles fonctionnalités d'IA ou la mise à l'échelle de fonctionnalités existantes devient beaucoup plus facile.

- Explicabilité et auditabilité: Lorsque chaque composant utilise des formats standard et transmet des sorties traçables, il est plus facile d'auditer les décisions prises par l'IA. Les journaux et les schémas unifiés vous permettent de déterminer exactement quel modèle a produit un résultat particulier et pourquoi.

- Rentabilité: En utilisant chaque modèle là où il est le plus rentable, les organisations peuvent réduire leurs dépenses en matière d'IA. Par exemple, le fait d'envoyer un traitement de texte en masse à un modèle open source sur un cluster GPU (où l'inférence est peu coûteuse) tout en réservant des appels d'API coûteux pour des tâches critiques permet d'économiser de l'argent.

- Délai de mise sur le marché plus rapide : Les développeurs n'ont pas besoin de créer des intégrations personnalisées à partir de zéro. L'utilisation d'une interface unifiée permet d'assembler de nouvelles fonctionnalités à partir de modèles existants

- Synergie entre équipes: L'interopérabilité permet d'aligner les différents secteurs de l'entreprise. Différentes équipes (comme le marketing, les produits ou la R&D) peuvent créer ou utiliser des agents spécialisés sans réinventer la roue de l'intégration.

L'interopérabilité de l'IA transforme des capacités isolées en un système cohérent. Il fait passer votre IA d'un ensemble d'outils intelligents à un système intelligent.

Comment les passerelles IA permettent l'interopérabilité

Une passerelle IA est un intergiciel qui centralise les composants et rend l'interopérabilité pratique. La passerelle fournit un point d'entrée unique et gère la diversité des modèles et des outils en coulisse. Il fournit une point d'entrée unique et cohérent pour toutes les interactions avec l'IA et gère les bizarreries spécifiques aux fournisseurs en coulisse. En effet, il unifie l'écosystème de l'IA. La passerelle fait abstraction des particularités de chaque fournisseur (comme les différents points de terminaison, informations d'identification et formats), ce qui permet une interopérabilité fluide.

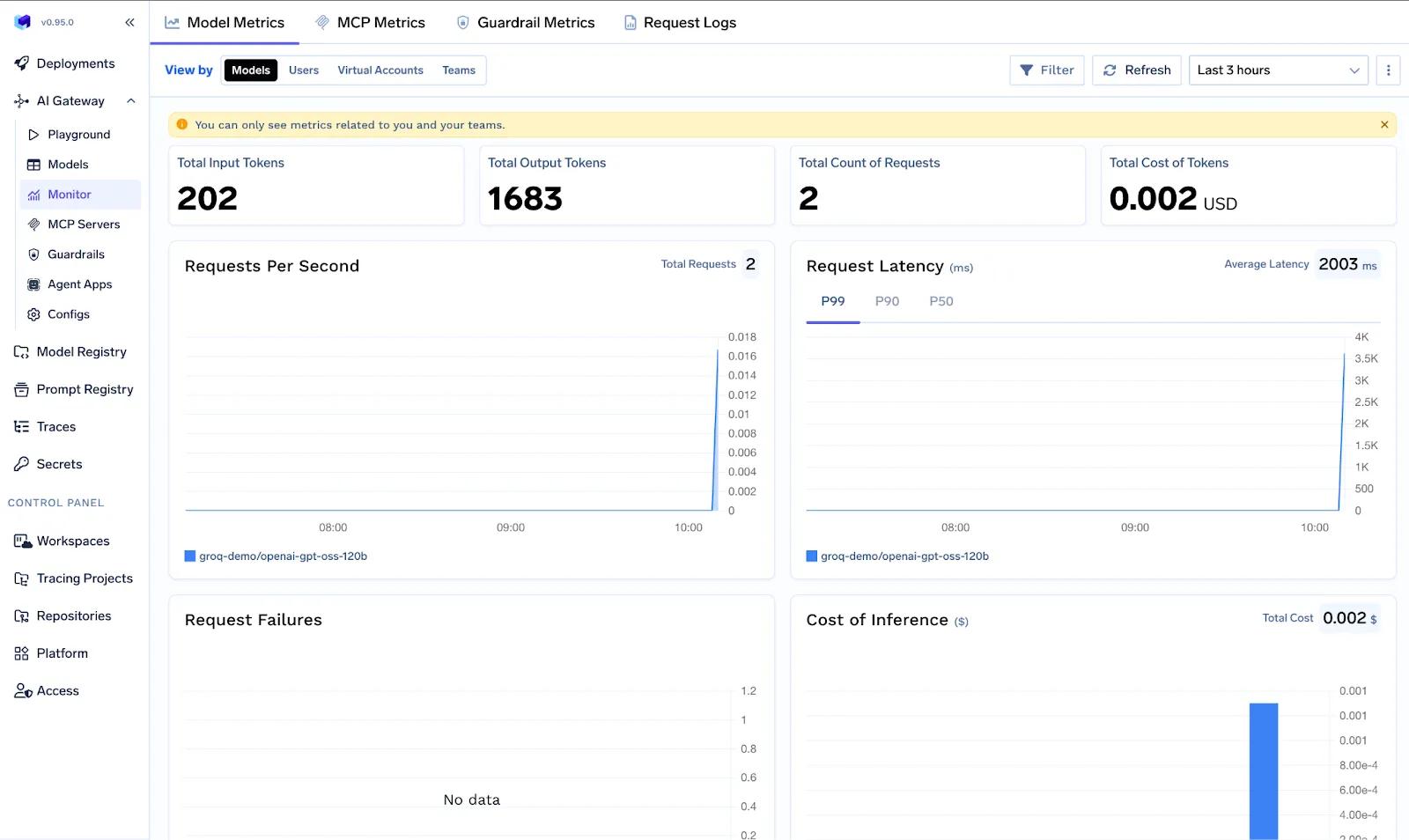

L'approche de TrueFoundry

TrueFoundry Passerelle IA est conçu précisément pour cela.

Il agit comme couche proxy entre vos applications et les fournisseurs de modèles ou les serveurs MCP, offrant un accès à plus de 1 000 modèles via une interface unique et unifiée.

Les fonctionnalités clés incluent :

- Accès unifié à l'API pour tous les modèles et fournisseurs

- Gestion centralisée des clés et contrôle d'accès précis

- Limitation des taux et budgétisation des coûts par utilisateur ou par modèle

- Routage multimodèle et basculement automatique

- Garde-corps relatifs au contenu pour un comportement responsable de l'IA

- Observabilité unifiée et journaux d'audit détaillés

En centralisant ces fonctions, TrueFoundry évite aux équipes de créer des connecteurs, d'écrire une logique de routage ou de gérer des tableaux de bord distincts. La passerelle devient système nerveux de votre infrastructure d'IA, en garantissant la cohérence, la sécurité et la fiabilité de tous les modèles et agents.

La plateforme TrueFoundry donne accès à plus de 1000 modèles via une interface unique et gère la sécurité et la gouvernance de manière centralisée. La liste des fonctionnalités de TrueFoundry met précisément en évidence les facteurs d'interopérabilité : appels d'API unifiés, gestion des clés d'API, contrôle d'accès précis, limitation du débit par utilisateur/modèle, équilibrage de charge entre les instances du modèle, budgétisation des coûts, garde-fous du contenu et observabilité consolidée. Ces fonctionnalités montrent comment une passerelle IA normalise le contrôle : tous les modèles sont désormais régis par un ensemble de politiques et de mesures.

En centralisant ces préoccupations, une passerelle d'IA simplifie considérablement l'interopérabilité. Au lieu de créer des connecteurs dans chaque application, vous configurez les modèles en un seul endroit. La passerelle peut acheminer les requêtes de manière dynamique (par exemple en ajustant les poids du trafic) et même basculer vers des modèles de sauvegarde en cas de panne de l'un d'entre eux. Il devient le plan de contrôle de l'IA d'entreprise, comme l'ont noté de nombreuses sources. Par exemple, une analyse sur les passerelles d'IA montre qu'elles introduisent des fonctionnalités allant au-delà des proxys d'API classiques : limitation du débit basée sur des jetons, révision du contenu des réponses, équilibrage de charge multi-backend et gestion du contexte de session.

En gérant ces tâches, les passerelles IA permettent une interopérabilité dès la conception. Il s'agit de l'interface qui donne à une pile d'IA polyglotte l'impression d'être une plate-forme unique.

Meilleures pratiques pour parvenir à l'interopérabilité de l'IA

L'adoption de l'interopérabilité de l'IA est un parcours. Les meilleures pratiques suivantes peuvent guider les équipes lors de la conception et de la mise en œuvre :

- Adoptez des normes ouvertes: Dans la mesure du possible, utilisez des protocoles et des formats ouverts. Par exemple, appliquez des schémas JSON cohérents, des formats d'intégration ou ONNX pour les entrées/sorties du modèle[9]. Envisagez des protocoles émergents tels que le Model Context Protocol (MCP) pour le partage des données de chat et d'outils entre les agents.

- Centralisez grâce à une passerelle IA: Déployez rapidement une passerelle API unifiée ou une couche intergicielle. Cela devient votre plan de contrôle pour toutes les interactions avec l'IA. Assurez-vous qu'il gère les clés d'API, l'authentification et le routage de manière uniforme. Le fait de disposer d'une passerelle signifie que les nouveaux modèles n'ont besoin que d'une configuration à un seul endroit, et non de modifications éparpillées dans chaque application.

- Normaliser les entrées et les sorties: définissez et appliquez des modèles d'invite et des formats de réponse cohérents. Utilisez une bibliothèque d'invites partagée et standardisez les conventions de dénomination. De même, convertissez les sorties du modèle en une structure commune.

- Mettre en œuvre une observabilité centralisée: dès le départ, enregistrez toutes les invocations de modèles, les jetons utilisés, les latences et les erreurs dans un système de surveillance commun. Cela vous permet de suivre les performances de tous les fournisseurs et de détecter rapidement les problèmes. Des outils tels qu'OpenTelemetry, Prometheus/Grafana ou Datadog peuvent ingérer des journaux depuis la passerelle pour fournir une vue unifiée de votre trafic multimodèle.

- Utiliser la conteneurisation et l'orchestration: empaquetez chaque modèle ou microservice d'IA dans un conteneur (par exemple Docker) et exécutez-les sur des plateformes d'orchestration (comme Kubernetes). L'orchestration des conteneurs « fournit intrinsèquement des niveaux de simplification pour répondre à des exigences clés telles que l'interopérabilité, la sécurité et la confidentialité », permettant à chaque équipe de se concentrer sur les fonctionnalités.

- Plan de sécurité et de conformité: Traitez la sécurité comme une préoccupation de premier ordre. Par exemple, adoptez un état d'esprit de confiance zéro : authentifiez chaque composant, utilisez le cryptage et enregistrez tous les accès aux données. Sachez que « plus de communication = plus de surface pour les menaces ». Intégrez donc des contrôles réseau, un chiffrement en transit et un nettoyage des données.

- Surveiller et itérer: définissez des indicateurs (par exemple, latence, coût par requête, taux de réussite) et observez leur évolution à mesure que vous ajoutez de nouveaux modèles ou outils. Si certaines intégrations ne fonctionnent pas, affinez vos règles d'orchestration ou envisagez différentes approches.

L'essentiel est de concevoir de manière proactive pour la connectivité plutôt que de moderniser les solutions ultérieurement. L'histoire montre que la standardisation précoce est payante : comme le note une analyse, attendre que les systèmes soient bien ancrés complique considérablement l'intégration.

Conclusion

L'interopérabilité de l'IA fait partie de l'infrastructure. Au fur et à mesure que les systèmes d'IA se multiplient en fonction des fournisseurs, des modalités et des plans de contrôle, la capacité à les faire communiquer clairement les uns avec les autres permet de décider si votre organisation évolue ou s'arrête. L'ancienne approche consistant à câbler chaque modèle manuellement ne tient pas la route lorsque de nouvelles API apparaissent chaque mois et que les règles de conformité ne cessent de se durcir.

C'est exactement là Passerelle IA change la donne. Des plateformes comme True Foundry transformer ce qui était autrefois cauchemar d'intégration dans un régi, observable, et enfichable couche de contrôle. Une API, une surface de politique, une piste d'audit — quel que soit le nombre de modèles ou d'agents que vous connectez. Au lieu que les équipes réinventent les connecteurs et enregistrent les données pour chaque nouveau fournisseur, la passerelle devient la structure opérationnelle de l'IA d'entreprise. Il achemine le trafic de manière intelligente, applique automatiquement la sécurité et les limites de débit et propose un plan de surveillance unifié qui fonctionne pour tous les fournisseurs.

C'est la base d'une adoption durable de l'IA, où l'innovation ne se fait pas au prix du chaos. L'interopérabilité, lorsqu'elle est intégrée à l'architecture, offre une véritable flexibilité : vous pouvez choisir le bon modèle pour chaque tâche, expérimenter plus rapidement et maintenir la prévisibilité des coûts sans perdre le contrôle.

Alors que les entreprises passent du déploiement d'un modèle unique à l'orchestration de dizaines de modèles, celles qui considèrent l'interopérabilité comme un objectif de conception de premier ordre et non comme une question secondaire agiront plus vite, dépenseront plus intelligemment et resteront à l'épreuve du temps. Les passerelles IA ne sont pas simplement des intergiciels ; elles constituent l'épine dorsale de l'ère multimodèle, transformant une pile d'IA fragmentée en un système cohésif et régi conçu pour durer.

TrueFoundry AI Gateway offre une latence d'environ 3 à 4 ms, gère plus de 350 RPS sur 1 processeur virtuel, évolue horizontalement facilement et est prête pour la production, tandis que LiteLM souffre d'une latence élevée, peine à dépasser un RPS modéré, ne dispose pas d'une mise à l'échelle intégrée et convient parfaitement aux charges de travail légères ou aux prototypes.

Le moyen le plus rapide de créer, de gérer et de faire évoluer votre IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)