Integración de TrueFoundry AI Gateway con New Relic

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Los sistemas LLM se comportan como servicios distribuidos. Llaman a varios proveedores de modelos. Se ejecutan en aplicaciones y agentes. Se envían rápidamente y cambian con frecuencia. Esto dificulta la depuración cuando un usuario informa de una respuesta incorrecta o lenta.

La pieza que falta es un límite de ejecución único que cruza cada solicitud. Una vez que tenga ese límite, puede aplicar la política. Puede estandarizar el enrutamiento. Puede capturar los rastros limpios de cada llamada.

TrueFoundry AI Gateway le brinda ese límite. New Relic le brinda un lugar para explorar esos rastros junto con el resto de la telemetría de su aplicación. Con OpenTelemetry como formato compartido, puedes exportar los rastros de las pasarelas a New Relic en unos minutos.

Puerta de enlace de IA TrueFoundry

Puerta de enlace de IA TrueFoundry se encuentra frente a tu modelo de tráfico. Las aplicaciones y los agentes envían solicitudes a la pasarela. La puerta de enlace reenvía al proveedor y modelo correctos. Esto crea un punto de entrada gobernado para el enrutamiento y los controles. También crea un punto coherente en el que se pueden generar y exportar los rastros.

Nueva reliquia

Nueva reliquia es una plataforma de observabilidad que admite el monitoreo completo y el monitoreo del rendimiento de las aplicaciones con análisis en tiempo real. Puede ingerir datos de OpenTelemetry. Esto lo convierte en un lugar natural para analizar las trazas de la LLM desde la puerta de enlace con los mismos flujos de trabajo que ya se utilizan para los servicios y la infraestructura.

Telemetría abierta

La integración se basa en OpenTelemetry. TrueFoundry AI Gateway exporta los rastros mediante los protocolos OpenTelemetry estándar. New Relic acepta la ingestión de OTLP. Esto mantiene la integración limpia y evita un acoplamiento apretado.

Aspecto de la integración

Puede configurar un exportador de trazas de OpenTelemetry en la interfaz de usuario de TrueFoundry AI Gateway. Lo diriges a un punto final de rastreo de OTLP de New Relic. Añades el encabezado de autenticación correcto con una clave de licencia de ingesta de New Relic generada a partir de la integración de OpenTelemetry en New Relic.

Una vez habilitada, la puerta de enlace continúa generando trazas para sus propias vistas de monitoreo. La exportación es aditiva. Envía los mismos rastros a New Relic para que también puedas analizarlos allí.

Guía de integración

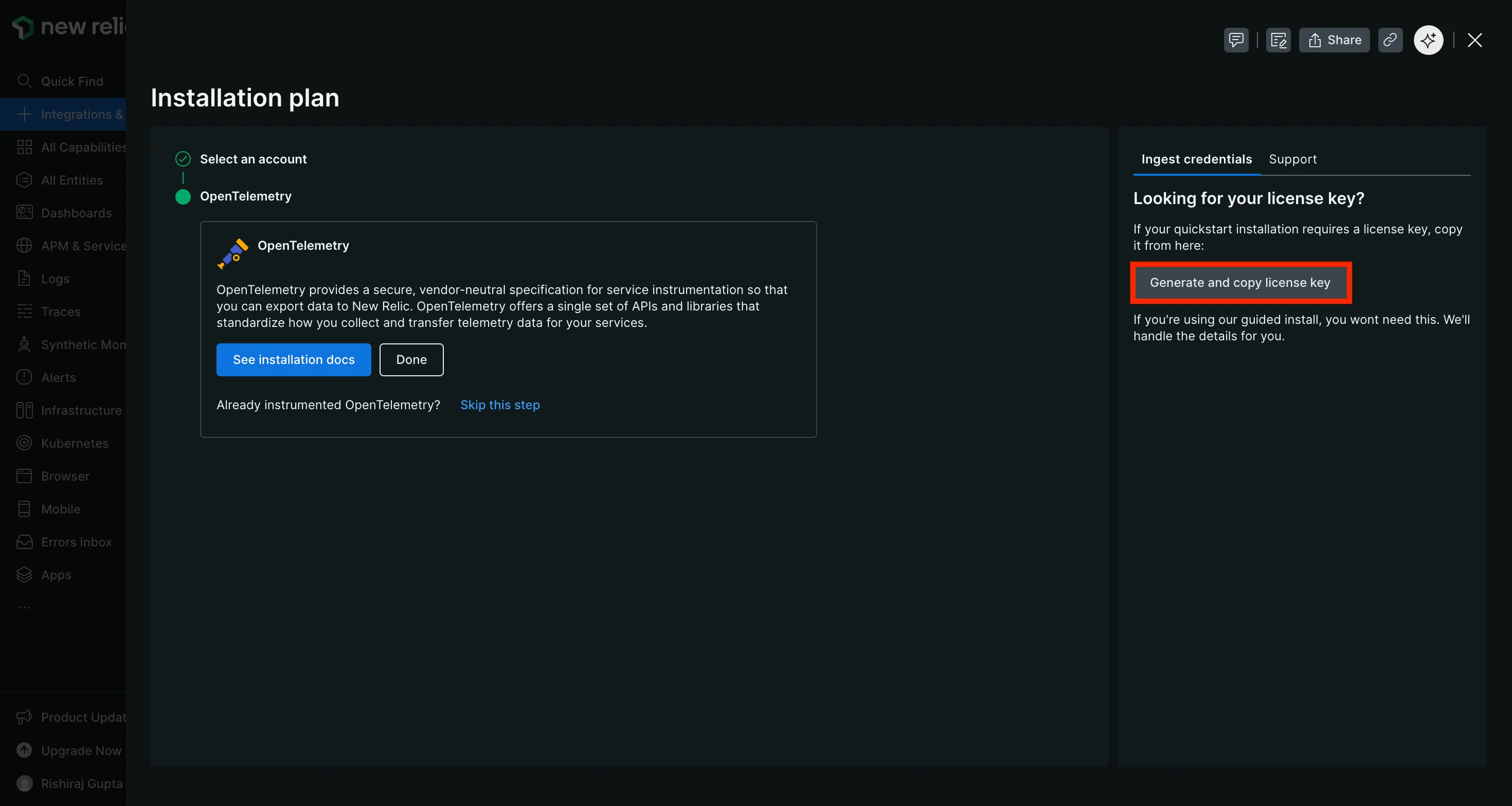

Paso 1. Obtenga su clave de licencia de New Relic Ingest

Abre tu panel de control de New Relic. Ve a Integraciones y agentes. Busque OpenTelemetry y abra esa integración. En el plan de instalación, busque el área de registro de credenciales y genere la clave de licencia.

Utilice la clave de licencia de ingesta de la página de integración de OpenTelemetry. Una clave de API normal de New Relic no funcionará para la ingesta de OTLP.

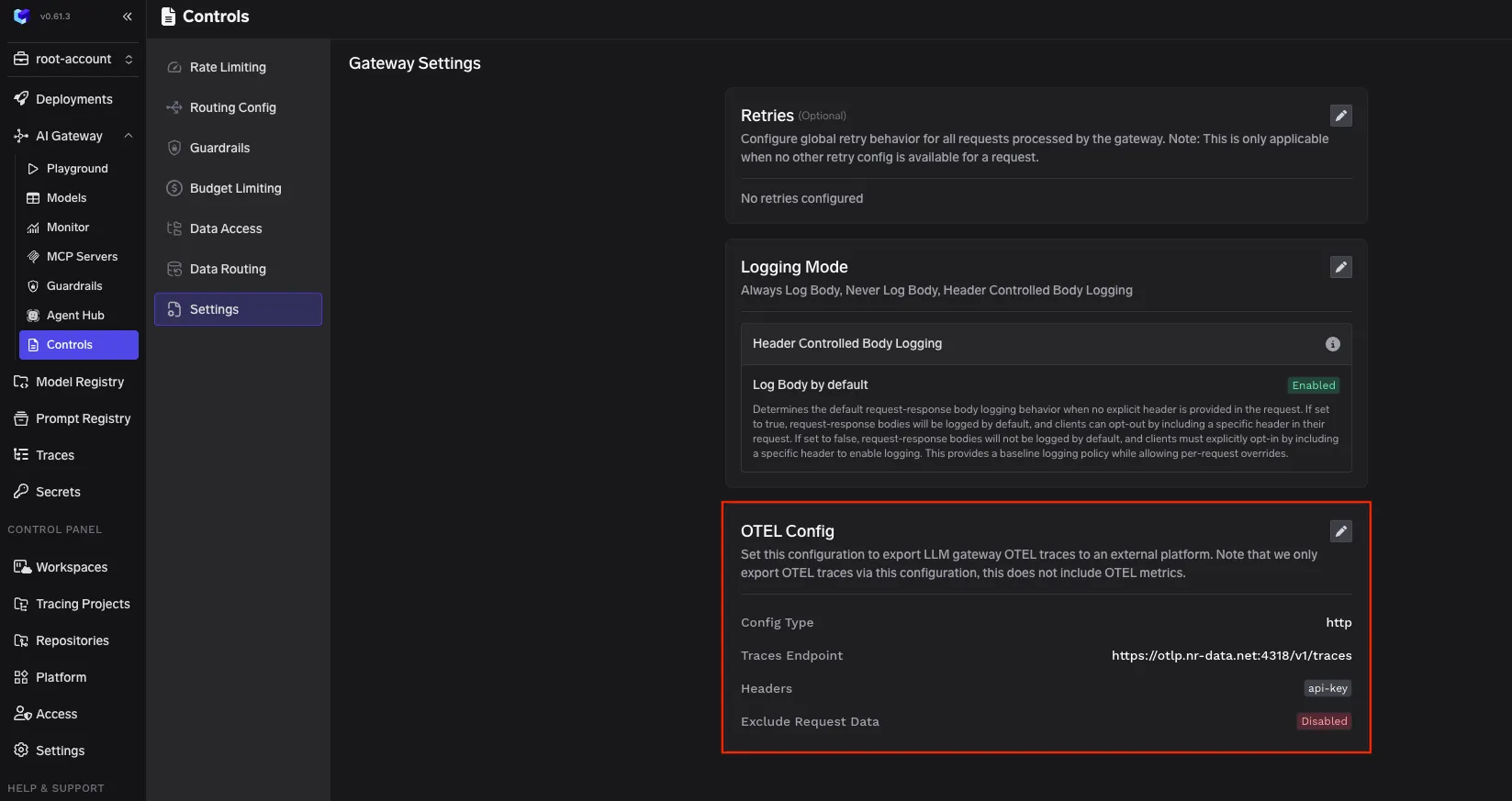

Paso 2. Habilita el exportador OpenTelemetry en TrueFoundry

En el panel de control de TrueFoundry, ve a AI Gateway, luego a Controles y luego a Configuración. Desplázate hasta la sección de configuración de OTEL y edita la configuración del exportador.

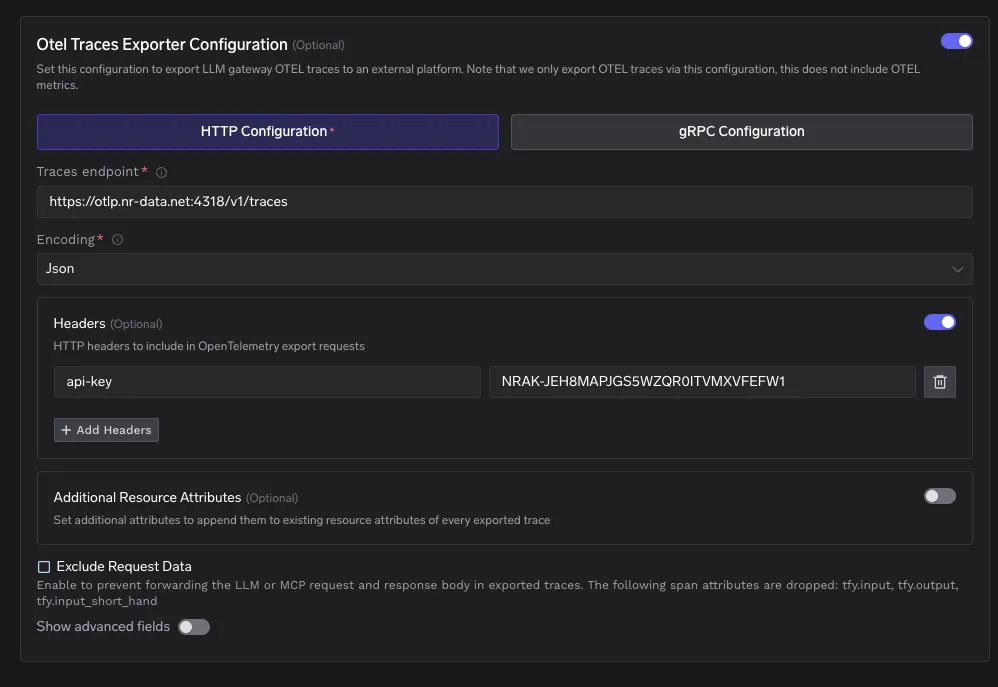

Paso 3. Configure el punto final y la codificación de New Relic Traces

Habilite el exportador de trazas y complete los campos principales.

Tipo de configuración

http

Traces endpoint para la región de EE. UU.

https://otlp.nr-data.net:4318/v1/traces

Codificación

Json

New Relic usa puntos finales regionales. Si tu cuenta está en la región de la UE, usa este punto final en su lugar.

https://otlp.eu01.nr-data.net:4318/v1/traces

Paso 4. Agregue el encabezado requerido

Agregue un encabezado con esta clave y su clave de licencia de ingesta como valor.

clave de API: <your New Relic ingest license key>

Paso 5. Guarda y envía algunas solicitudes

Guarde la configuración. A continuación, envíe algunas solicitudes de LLM a través de AI Gateway. Después de esto, la pasarela exportará los rastros a New Relic automáticamente.

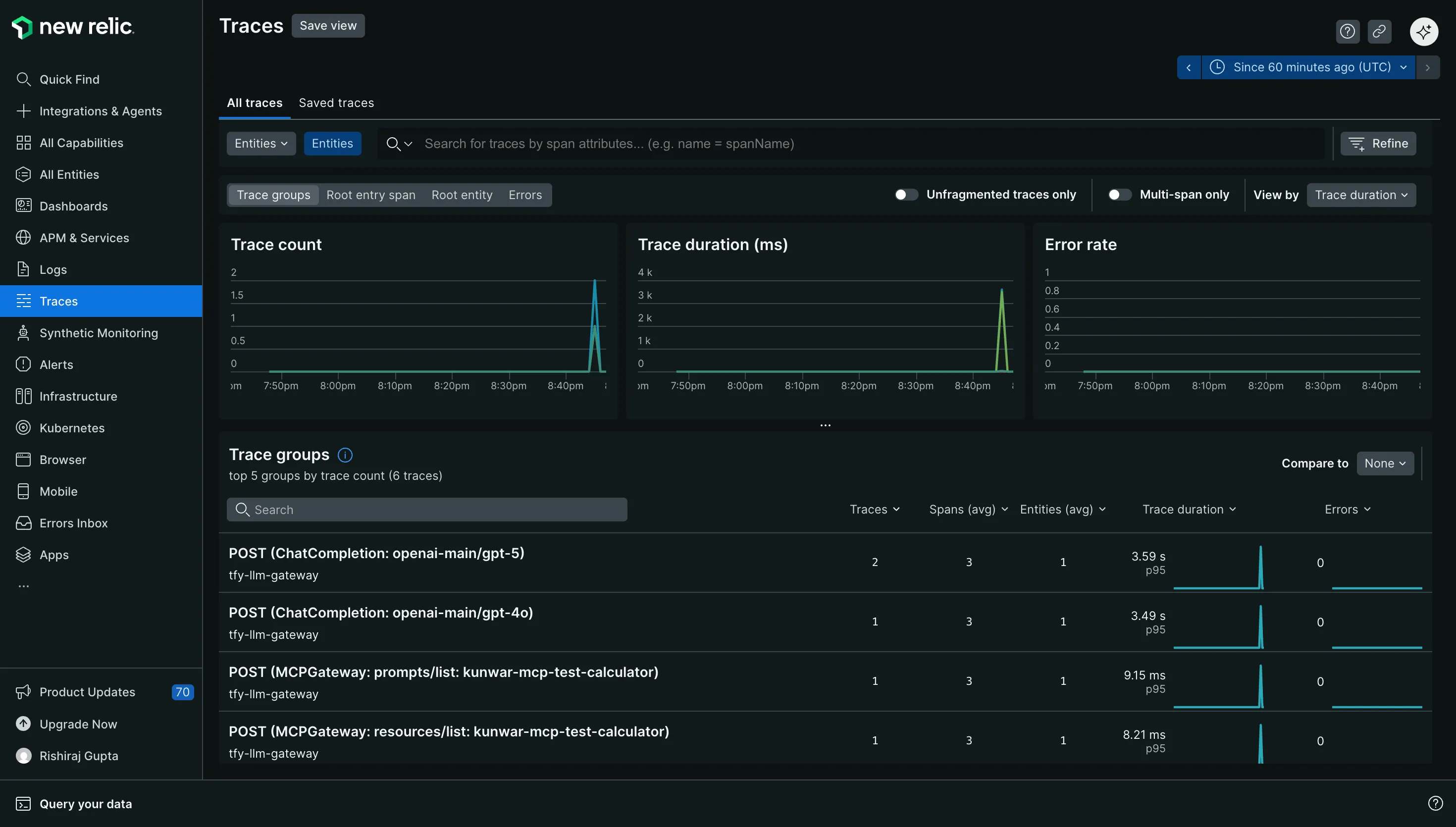

Paso 6. Ver rastros en New Relic

En New Relic, ve a Traces y busca rastros en el servicio de puerta de enlace. A continuación, abra un registro e inspeccione los intervalos para ver la ruta y el tiempo de la llamada modelo.

Ver trazas

Puede ver las trazas de LLM junto al resto de su telemetría. Esto ayuda cuando un problema de LLM es en realidad un pico de latencia ascendente. También ayuda cuando la ralentización de un proveedor de modelos es solo una parte de un incidente más amplio.

Puede crear paneles que rastreen la latencia y el volumen del tráfico de LLM. Puede crear alertas para detectar picos de latencia o tasas de error. Puede correlacionar el comportamiento del rastreo con los registros y las señales de la infraestructura durante un incidente.

Algunas notas de configuración importantes en la producción

Elige el punto final que coincida con tu región de New Relic. Esta es la causa más común de la falta de rastros. Si quieres un filtrado más completo en New Relic, agrega atributos de recursos adicionales en la configuración del exportador. Usa estos atributos para la agrupación a nivel de entorno y equipo.

New Relic admite HTTP y gRPC para la ingesta de OTLP. Si necesita un mayor rendimiento, puede considerar la posibilidad de utilizar gRPC. Si quieres una inspección más sencilla durante la configuración, HTTP con codificación JSON es un punto de partida sencillo.

Conclusión

Un sistema LLM confiable necesita un lugar confiable para hacer cumplir los controles y un lugar confiable para comprender el comportamiento. TrueFoundry AI Gateway proporciona un límite de ejecución único para todo el tráfico de modelos. New Relic proporciona un flujo de trabajo de observabilidad maduro para explorar los rastros y responder a los incidentes. OpenTelemetry conecta los dos con una ruta de exportación estándar.

Si ya usa New Relic para sus servicios, esta integración permite que su tráfico de LLM se una al mismo ciclo operativo con cambios mínimos en el código de su aplicación.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)