Arquitectura de transformadores en modelos de lenguaje de gran tamaño

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción a los transformadores

Los transformadores se han convertido en una tecnología innovadora que está remodelando la forma en que las computadoras entienden el lenguaje humano. A diferencia de los modelos tradicionales que procesan las palabras una tras otra, los Transformers pueden analizar una oración completa de una sola vez, lo que los hace increíblemente eficientes a la hora de captar los matices del lenguaje. El Transformer se introdujo por primera vez en la obra titulada La atención es todo lo que necesitas. Se desarrollaron principalmente para resolver cualquier tipo de tarea que transforme una secuencia de entrada en una secuencia de salida, como la traducción de voz, la transformación de texto a voz, etc.

La evolución de los modelos lingüísticos

Los modelos lingüísticos han avanzado mucho, pasando de algoritmos simples basados en reglas a redes neuronales sofisticadas. Inicialmente, estos modelos solo podían seguir reglas predefinidas o contar la frecuencia de las palabras. Luego aparecieron los modelos estadísticos, que predecían las palabras basándose en las palabras anteriores, pero tenían problemas con las oraciones más largas. La introducción de las redes neuronales, especialmente las RNN y las LSTM, supuso una mejora significativa, ya que permitió a los modelos recordar más el contexto. Sin embargo, seguían procesando el texto de forma secuencial, lo que limitaba su comprensión de estructuras lingüísticas complejas.

Por qué los Transformers cambian las reglas del juego

Los transformadores revolucionaron el procesamiento del lenguaje con su capacidad de manejar todas las partes de una oración simultáneamente. Esto no solo acelera el tiempo de procesamiento, sino que también permite una comprensión más profunda del contexto, independientemente de qué tan separadas estén las palabras en una oración. La idea principal detrás de Transformers es el «mecanismo de autoatención», que permite al modelo sopesar la importancia de cada palabra de una oración en relación con todas las demás. Este salto tecnológico ha impulsado los avances en la traducción automática, la generación de contenido e incluso la comprensión y la generación de textos similares a los humanos, estableciendo un nuevo estándar en el campo de la PNL.

En este blog, trataremos de explorar en detalle la arquitectura del Transformer estándar.

Concepto central de transformadores

Los Transformers, una novedosa arquitectura de IA, han establecido nuevos puntos de referencia en la forma en que las máquinas entienden y generan el lenguaje. En esencia, varios conceptos fundamentales hacen que sean excepcionalmente buenas para procesar grandes cantidades de datos de texto. Profundicemos en estos conceptos básicos, desglosando la arquitectura y los componentes clave que definen a los Transformers.

Comprensión de la arquitectura

Explicación del codificador y el decodificador

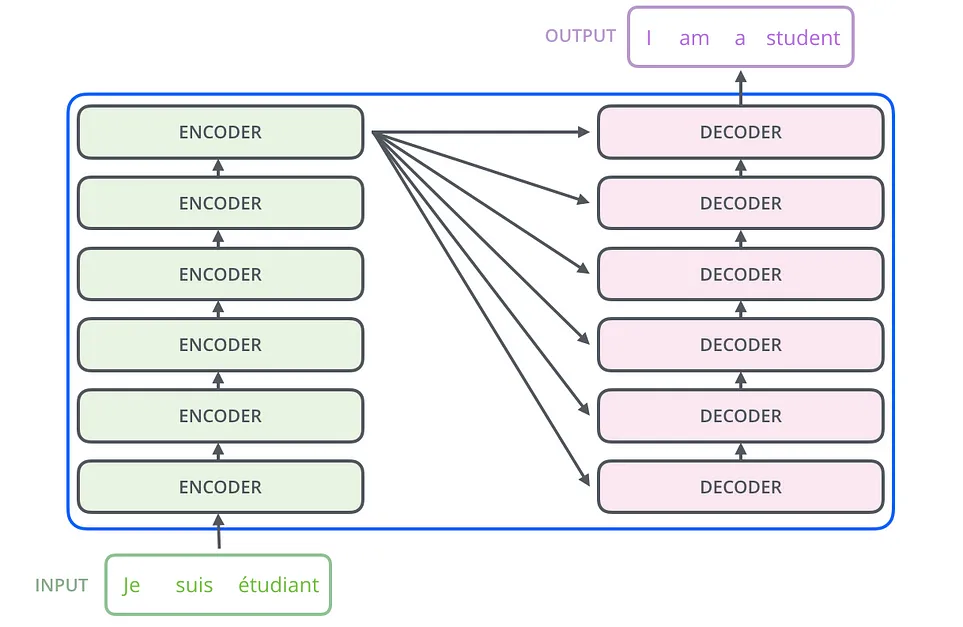

La arquitectura de Transformers se basa en dos pilares: el codificador y el decodificador. El codificador lee y procesa el texto de entrada, transformándolo en un formato que el modelo pueda entender. Imagínelo absorbiendo una oración y descomponiéndola en su esencia. Por otro lado, el decodificador toma esta información procesada y la revisa para producir el resultado, como traducir la oración a otro idioma. Este ir y venir es lo que hace que Transformers sea tan eficaz para tareas como la traducción, en las que la comprensión del contexto y la generación de respuestas precisas son fundamentales.

Componentes clave del modelo de transformador

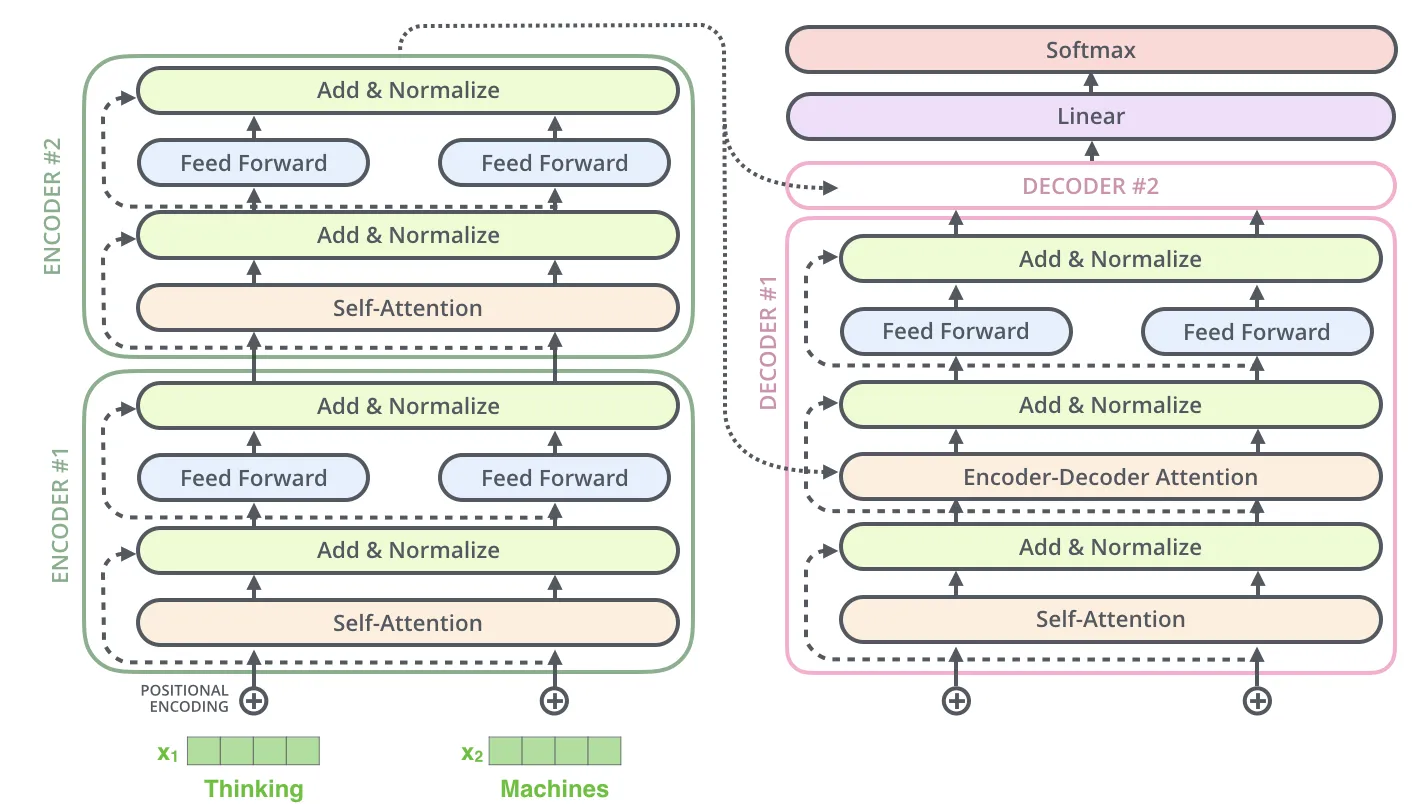

Mecanismo de autoatención

En el corazón del codificador y decodificador del Transformer se encuentra el mecanismo de autoatención. Esto permite al modelo sopesar la importancia de cada palabra de una oración en relación con cualquier otra palabra. Por lo tanto, a diferencia de los modelos más antiguos, que podían perder la noción de las palabras anteriores en una oración larga, los Transformers mantienen una comprensión integral de todo el contexto.

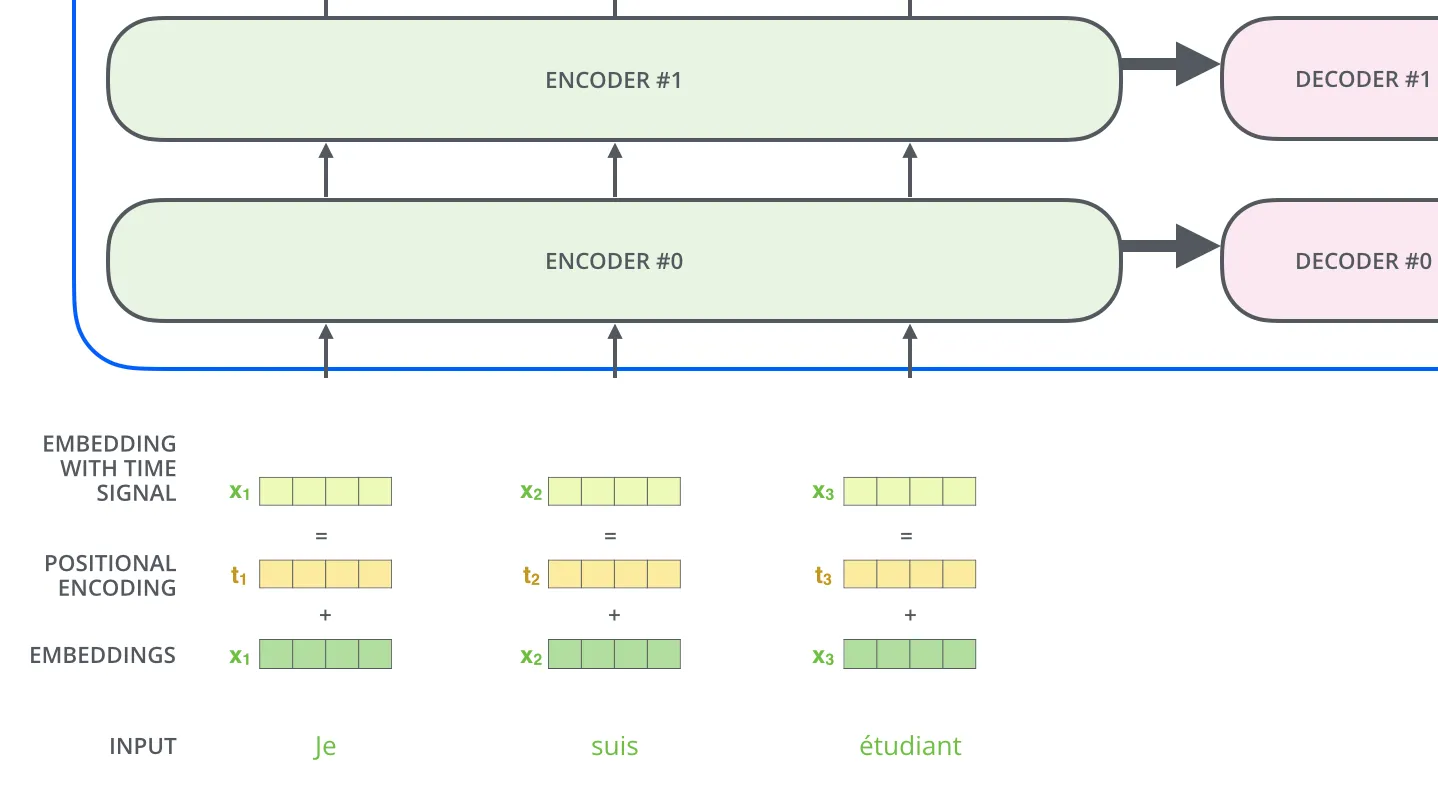

Codificación posicional

Como los Transformers procesan todas las palabras de una oración simultáneamente, necesitan una forma de entender el orden de las palabras; aquí es donde entra en juego la codificación posicional. A cada palabra se le asigna un código único que representa su posición en la oración, lo que garantiza que el modelo pueda captar el flujo y la estructura del lenguaje, algo crucial para entender el significado de las oraciones.

Atención multicabezal

Basándose en la idea de la autoatención, la atención multicabal permite al modelo observar la oración desde diferentes perspectivas. Al dividir el mecanismo de atención en varias «cabezas», los Transformers pueden procesar simultáneamente diversos aspectos del texto, como la gramática y la semántica, lo que permite comprender mejor la entrada.

Cómo funcionan los transformadores

Al profundizar en la mecánica de Transformers, se revela una arquitectura elegante diseñada para la comprensión y la generación de lenguajes complejos. Aquí, exploraremos las complejidades del codificador y el decodificador, así como la forma en que funcionan en conjunto para procesar y producir el lenguaje.

Una mirada más cercana al codificador

Procesamiento de la secuencia de entrada

La función principal del codificador es procesar la secuencia de entrada. Cada palabra de la oración de entrada se convierte en vectores, que son representaciones numéricas ricas ricas que contienen la esencia del significado de la palabra. Pero el trabajo del codificador no termina ahí. También necesita entender el contexto que rodea a cada palabra, es decir, cómo se relaciona con las palabras anteriores y posteriores.

Para lograr esto, el codificador utiliza una serie de capas, cada una compuesta por mecanismos de autoatención y redes neuronales de retroalimentación. El mecanismo de autoatención permite al codificador sopesar la importancia de otras palabras de la oración al considerar una palabra específica. Este proceso se representa matemáticamente mediante la generación de vectores Q (consulta), K (clave) y V (valor), lo que facilita una comprensión dinámica del contexto de la oración.

Decodificando el futuro

Cómo generan los decodificadores la salida

El decodificador toma el relevo del codificador, encargado de generar la secuencia de salida. Comienza con un símbolo especial que indica el principio de la salida y utiliza el contexto proporcionado por el codificador para generar una palabra a la vez. La capa de autoatención del decodificador garantiza que cada palabra generada sea apropiada en función de las palabras anteriores, mientras que la capa de atención del codificador-decodificador permite al decodificador centrarse en las partes relevantes de la secuencia de entrada.

Esta etapa del modelo Transformer es donde ocurre la generación real del idioma, ya sea traduciendo una oración a otro idioma, resumiendo un texto o incluso generando contenido creativo. La capacidad del decodificador de considerar tanto el contexto inmediato (las palabras anteriores de la salida) como el contexto más amplio (la secuencia de entrada procesada por el codificador) es crucial para producir un lenguaje coherente y relevante desde el punto de vista del contexto.

Sinergia entre el codificador y el decodificador

El verdadero poder de Transformers reside en la sinergia entre el codificador y el decodificador. Si bien el codificador proporciona una comprensión profunda de la oración de entrada, el decodificador aprovecha esta información para producir una salida precisa y relevante. Esta interacción está mediada por el mecanismo de atención entre el codificador y el decodificador, que permite al decodificador consultar la salida del codificador en cada paso del proceso de generación.

Este mecanismo de colaboración garantiza que la salida no solo tenga sentido desde el punto de vista lingüístico, sino que también sea una representación o transformación fiel de la entrada. Es esta sinergia entre el codificador y el decodificador lo que permite a Transformers sobresalir en una amplia gama de tareas de procesamiento del lenguaje, desde la traducción automática hasta la generación de contenido.

Aplicaciones prácticas de los transformadores

Los transformadores no solo han revolucionado el campo del procesamiento del lenguaje natural (PNL), sino que también han demostrado su versatilidad al extender su alcance a otros dominios. Así es como están teniendo un impacto:

Tareas de procesamiento del lenguaje natural (PNL)

Ejemplos de traducción y resumen de textos

Traducción: Los transformadores han mejorado significativamente la traducción automática, ofreciendo niveles de fluidez y comprensión casi humanos. Google Translate es un excelente ejemplo, en el que los modelos de Transformer, como BERT y GPT, han sido fundamentales para mejorar la calidad de la traducción en numerosos idiomas.

Resumen del texto: Las herramientas de resumen automatizadas, impulsadas por los modelos de Transformer, ahora pueden producir resúmenes concisos de artículos, informes y documentos largos, manteniendo el contexto y los matices del texto original. Herramientas como la serie GPT de OpenAI han sido fundamentales para avanzar en este campo, ya que proporcionan a los usuarios información rápida a partir de un contenido extenso.

Más allá de la PNL: transformadores en otros dominios

Transformadores de visión (ViT) para reconocimiento de imágenes

Rompiendo las barreras del texto, los Transformers se han aventurado en el mundo visual. Vision Transformers (ViT) aplica los principios de la autoatención a los píxeles de las imágenes, logrando resultados de última generación en las tareas de reconocimiento de imágenes. Este enfoque ha supuesto un desafío para las redes neuronales convolucionales (CNN) convencionales, ya que ofrece una nueva perspectiva sobre el procesamiento de la información visual.

Casos prácticos: historias de éxito del mundo real

Mejora de los motores de búsqueda con BERT

El motor de búsqueda de Google se ha enriquecido con BERT (Bidirectional Encoder Representations from Transformers), lo que le permite comprender mejor el contexto de las consultas de búsqueda. Esto ha mejorado considerablemente la relevancia de los resultados de búsqueda, haciendo que la recuperación de la información sea más precisa para los usuarios de todo el mundo.

Mejorar la experiencia del cliente con chatbots

Los chatbots impulsados por IA, que aprovechan la tecnología Transformer, ofrecen interacciones más atractivas y similares a las humanas. Las empresas han integrado estos chatbots avanzados en su servicio de atención al cliente para ofrecer un soporte inmediato y adaptado al contexto, lo que mejora la satisfacción del cliente y la eficiencia operativa.

Modelos lingüísticos de gran tamaño

GPT-3.5 y GPT-4 de OpenAI son un hito en modelos lingüísticos grandes, lo que demuestra una asombrosa habilidad para generar textos similares a los humanos, responder preguntas e incluso programar. Sus aplicaciones van desde la creación de contenido hasta la ayuda en las tareas de programación, lo que demuestra el enorme potencial de Transformers en varios sectores.

El futuro de los Transformers

A medida que navegamos por el cambiante panorama de la inteligencia artificial, los Transformers están a la vanguardia de este viaje, con un futuro lleno de promesas y potencial. Su rápido desarrollo e integración en varios campos sugieren un camino hacia innovaciones aún más revolucionarias. Aquí, profundizamos en los avances y las posibles direcciones, junto con los desafíos y las oportunidades que nos esperan.

Avances recientes y direcciones futuras

GPT-4 y más allá: la próxima frontera

La presentación del GPT-4 por parte de OpenAI representa un avance monumental en el ámbito de los grandes modelos lingüísticos, ya que amplía los límites de lo que la IA puede lograr en la comprensión y generación de idiomas. El GPT-4 no solo supera a sus predecesores en tamaño, sino también en sofisticación, ya que ofrece una generación de textos aún más matizada, capacidades de resolución de problemas y una mejor comprensión de los matices del lenguaje humano. El GPT-4 tiene como horizonte mejorar la interacción entre humanos e inteligencia artificial, automatizar tareas complejas y ofrecer soluciones innovadoras en innumerables aplicaciones. A medida que miramos más allá del GPT-4, nos centramos cada vez más en hacer que estos modelos sean más eficientes, interpretables y capaces de gestionar una gama aún más amplia de tareas, lo que supone un avance significativo hacia sistemas verdaderamente inteligentes.

Desafíos y oportunidades

Escalabilidad, interpretabilidad y consideraciones éticas

Al mirar hacia el futuro con modelos como el GPT-4, nos enfrentamos a desafíos y oportunidades esenciales en torno a la escalabilidad, la interpretabilidad y la ética. Hacer que estos potentes modelos sean más grandes y complejos requiere mucha potencia de cálculo y energía, lo que plantea dudas sobre los costos y el impacto ambiental. Al mismo tiempo, es importante que podamos entender cómo estos modelos toman decisiones, especialmente cuando se utilizan en áreas importantes como la atención médica o las finanzas. Además, debemos tener en cuenta el aspecto ético de las cosas, por ejemplo, cómo prevenir la difusión de información falsa y comprender los efectos de reemplazar puestos de trabajo por la IA. Abordar estos problemas requerirá el esfuerzo de todos los involucrados en la IA, desde los desarrolladores hasta los líderes gubernamentales, para garantizar que el crecimiento de los modelos Transformer sea responsable y beneficioso para la sociedad.

Conclusión

En resumen, los Transformers han remodelado significativamente el panorama de la inteligencia artificial y el procesamiento del lenguaje natural. Su arquitectura única, capaz de comprender el contexto y los matices del lenguaje, ha permitido avances notables en tareas como la traducción, el resumen de textos e incluso más allá del ámbito del reconocimiento de imágenes, entre otras.

Las principales conclusiones incluyen la importancia del mecanismo de autoatención que permite a los Transformers procesar secuencias completas de datos simultáneamente, y el uso innovador de codificaciones posicionales para mantener el orden de las secuencias en el procesamiento de datos. Además, la escalabilidad de estos modelos, junto con la necesidad de tener en cuenta la interpretabilidad y las consideraciones éticas, delinean la hoja de ruta para futuros desarrollos en este campo.

Los transformadores no son solo un avance tecnológico; representan un cambio en la forma en que concebimos las capacidades de la IA. Ofrecen una visión de un futuro en el que la IA pueda entender el lenguaje humano e interactuar con él con una profundidad y flexibilidad sin precedentes, lo que abre nuevas vías para la automatización, la creatividad y la eficiencia en todos los sectores. A medida que continuamos explorando y ampliando los límites de la tecnología Transformer, su papel en la configuración del futuro de la IA sigue siendo fundamental y promete un panorama en el que la asociación entre humanos y máquinas alcance nuevos niveles de colaboración e innovación.

Preguntas frecuentes

¿Qué es una arquitectura de transformadores en LLM?

La arquitectura del transformador llm es un diseño de red neuronal revolucionario que procesa secuencias de entrada completas simultáneamente. Aprovecha un mecanismo de autoatención para comprender profundamente el contexto de las palabras, a diferencia de los modelos anteriores. Esto permite que los modelos lingüísticos de gran tamaño comprendan y generen de manera eficiente textos similares a los humanos, lo que impulsa los avances en la traducción automática y la creación de contenido en los EE. UU.

¿Los LLM siguen usando transformadores?

Sí, los modelos de lenguaje grande (LLM) dependen en gran medida de la arquitectura transformadora en el desarrollo de LLM en la actualidad. Transformers revolucionó el procesamiento del lenguaje al gestionar frases completas de forma simultánea, lo que mejoró la comprensión del contexto y la velocidad de procesamiento. Esta innovación fundamental sigue siendo crucial para que los LLM modernos generen textos similares a los humanos y realicen tareas lingüísticas complejas de manera eficiente para los usuarios de EE. UU.

¿Qué es un transformador en LLM?

Un transformador en LLM es una arquitectura de IA que procesa oraciones completas simultáneamente. Utiliza un mecanismo de autoatención para comprender en profundidad las relaciones entre palabras y el contexto. Esta innovadora tecnología revolucionó la forma en que los grandes modelos lingüísticos aprenden y generan textos similares a los humanos, algo crucial para las aplicaciones avanzadas y la comprensión eficiente del lenguaje.

¿En qué arquitectura se basa un LLM?

La arquitectura detrás de los modelos de lenguaje grande (LLM) se conoce como arquitectura transformadora llm. Este ingenioso diseño les ayuda a entender y generar textos similares a los humanos al procesar la información de una manera única. Les permite aprender patrones complejos a partir de enormes cantidades de datos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)