Las 8 principales alternativas y competidores de Amazon Bedrock para 2026 [Revisión detallada]

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Amazon Bedrock es un punto de partida viable para los equipos estrictamente vinculados al ecosistema de AWS, ya que ofrece una capa de API gestionada para los modelos básicos (FM) sin una administración inmediata de la infraestructura. Sin embargo, a medida que las cargas de trabajo de IA alcancen la fase de producción en 2026, los equipos de ingeniería se enfrentarán inevitablemente al «muro de plataformas». Esta barrera se manifiesta en tres puntos de fricción principales:

- Impuesto sobre los ecosistemas de AWS: Tarifas de salida y costos de transferencia de datos sustanciales cuando las canalizaciones interactúan con servicios externos. Como se indica en el Precios bajo demanda de AWS EC2, la transferencia de datos a Internet puede costar hasta 0,09 USD por GB. Para aplicaciones multimodales de gran volumen, estas tarifas de salida pueden erosionar significativamente la economía de la unidad.

- Control del ciclo de vida: Los servicios gestionados aplican sus propios programas de obsolescencia. Esto puede crear fricción para tuberías de producción que requieren estabilidad a largo plazo en versiones de modelos específicos.

- Escalado lineal de costos: Los servicios gestionados suelen utilizar modelos de precios por token que se escalan de forma lineal con el uso. Si bien es rentable para la creación de prototipos, esta estructura suele diferir de la economía unitaria del hardware aprovisionado en grandes volúmenes. Puntos de referencia del sector indican que, para cargas de trabajo específicas de alto rendimiento o por lotes, pasar de las API administradas a una infraestructura autohospedada optimizada puede generar ganancias de eficiencia de múltiplos significativos, especialmente cuando se utilizan instancias puntuales o capacidad reservada.

Para los arquitectos que diseñan a largo plazo, el objetivo pasa del simple acceso a la API a la creación de una «estrategia de migración y nube múltiple». Esta guía evalúa las ventajas técnicas, la economía unitaria y la realidad operativa de las principales alternativas a Bedrock. Si bien los servicios gestionados ofrecen comodidad, plataformas como TrueFoundry se están convirtiendo en el plano de control preferido para las empresas que requieren la facilidad de uso de Bedrock combinada con el control económico y operativo que supone la implementación en su propia infraestructura de nube.

Las 8 mejores alternativas de AWS Bedrock para 2026

En esta sección, analizamos el mérito de ingeniería y el ajuste arquitectónico de los siguientes competidores:

- True Foundry

- Inteligencia artificial de Google Vertex

- Servicio Azure OpenAI

- Inteligencia artificial generativa de Oracle Cloud Infrastructure (OCI)

- IA de Mosaic de Databricks

- Botpress

- Runpod

- Estudio Altair AI

TrueFoundry: una puerta de enlace de IA y una capa de orquestación independientes de la nube

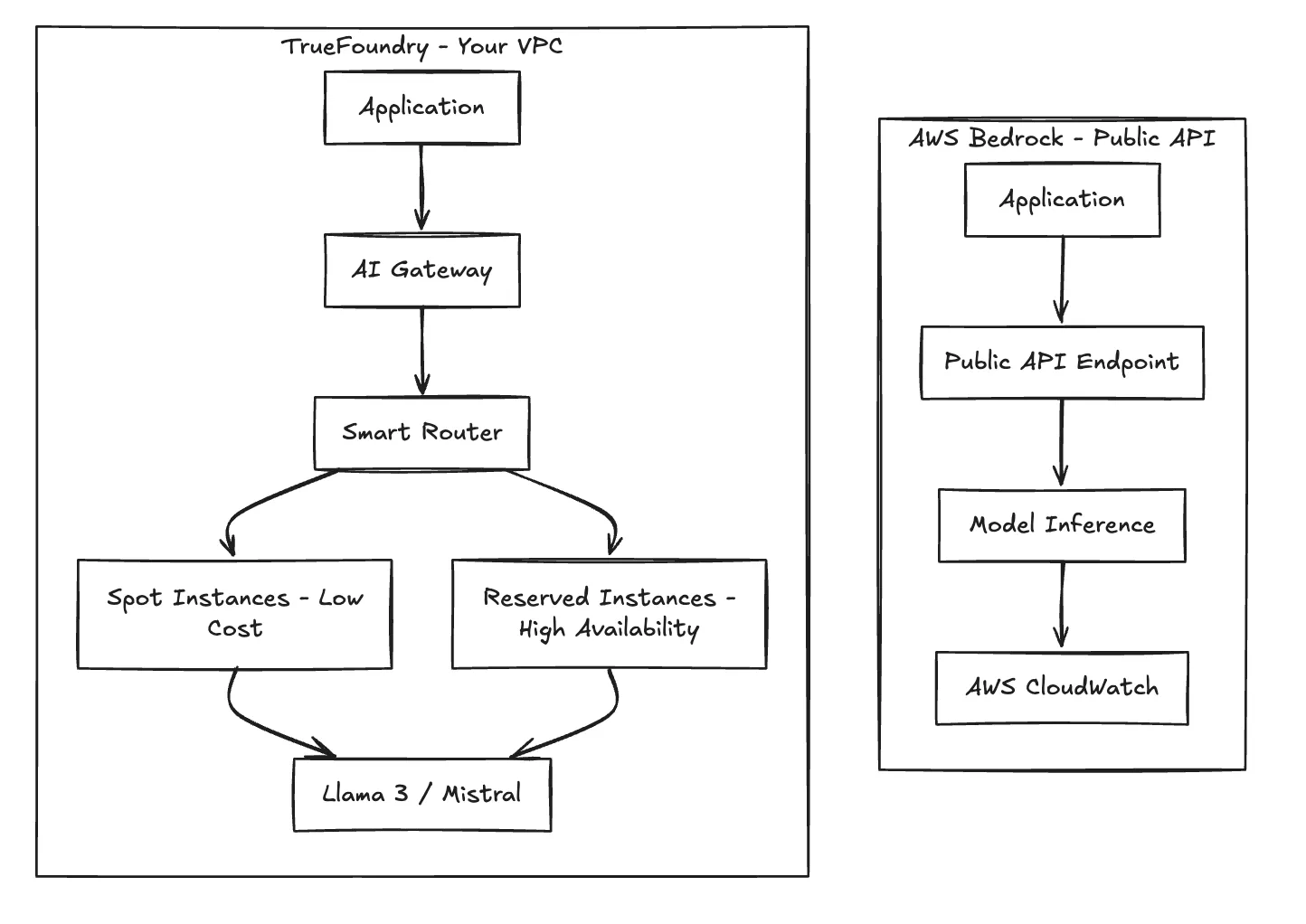

TrueFoundry funciona como un plano de control independiente de la plataforma en lugar de un ecosistema propietario. A diferencia de Bedrock, que es un API gestionada donde la inferencia se produce en una infraestructura compartida, TrueFoundry organiza las capas de cálculo e inferencia directamente dentro de sus propios clústeres de VPC o Kubernetes (EKS, GKE, AKS o bare metal).

Esta arquitectura desvincula la experiencia del desarrollador de la infraestructura subyacente.

Características principales de TrueFoundry:

- Despliegue de Kubernetes: Implementa cargas de trabajo de IA en sus propios clústeres con escalado automático y comprobaciones de estado configuradas automáticamente.

- Puerta de enlace de IA: Una superficie de API unificada (compatible con OpenAI) que gestiona el equilibrio de carga, los reintentos y los retrocesos. Puede dirigir el tráfico a Azure OpenAI si AWS Bedrock alcanza los límites de velocidad.

- Orquestación de instancias puntuales: Permite el uso fiable de instancias puntuales para la inferencia, lo que puede reducir los costos de procesamiento entre un 50 y un 60% en comparación con los precios bajo demanda.

- Gestión rápida del ciclo de vida: Las solicitudes se tratan como código, y el control de versiones y las pruebas se integran en la canalización de CI/CD.

Por qué TrueFoundry es una mejor opción:

True Foundry no cobra una prima en los tokens de inferencia cuando alojas tus propios modelos de código abierto. Usted paga el costo de la infraestructura subyacente directamente a su proveedor de nube. Para cargas de trabajo de gran volumen, este coste de procesamiento fijo es significativamente más económico que el escalado lineal de los precios basados en fichas.

Planes de precios de TrueFoundry:

- Desarrollador: Nivel gratuito para desarrolladores individuales.

- Arrancador: Cuota mensual fija por puesto para equipos pequeños.

- Pro/Enterprise: Precios personalizados que incluyen SSO, RBAC y soporte dedicado.

Qué dicen los clientes sobre TrueFoundry

Los usuarios de G2 califican constantemente a TrueFoundry 4,85, destacando la capacidad de la plataforma para abstraer la complejidad de Kubernetes para los ingenieros de backend. Una reseña señala: «Convirtió a nuestro equipo de backend en ingenieros de MLOps de la noche a la mañana sin la curva de aprendizaje de Kubeflow».

Acción: Inscríbase en la capa gratuita de TrueFoundry para probar el AI Gateway.

Inteligencia artificial de Google Vertex

Características

La IA de Vertex se integra profundamente con el ecosistema de Google Cloud. Proporciona acceso nativo a la familia Gemini y es compatible con AutoML. Se destaca en la operacionalización de modelos con almacenes de funciones integrados y búsquedas vectoriales que se integran directamente con BigQuery.

Fijación

Los precios están segmentados según la operación. Por ejemplo, el Gemini 1.5 Pro tiene un precio por cada 1000 caracteres o imágenes. Fundamentalmente, la predicción en modelos entrenados a medida conlleva costes por hora de nodo. Consulte los precios de Vertex AI para ver el desglose específico de los tipos de máquinas (por ejemplo, la n1-standard-4 frente a la TPU v5e).

Casos de uso únicos

Vertex es ideal para las organizaciones que utilizan BigQuery para canalizaciones de RAG (generación aumentada de recuperación) debido al acceso a los datos de baja latencia dentro de la red troncal de GCP.

Servicio Azure OpenAI

Características

El servicio Azure OpenAI proporciona acceso de nivel empresarial a GPT-4o y DALL-E 3. Agrega capas de cumplimiento (SOC2, HIPAA) y redes privadas a través de Azure Private Link de las que carecen las API OpenAI estándar.

Fijación

Azure utiliza un modelo de «pago por uso» y «unidades de rendimiento aprovisionadas» (PTU). Las PTU proporcionan una latencia garantizada, pero requieren un compromiso inicial importante. Según los precios de Azure OpenAI, los modelos GPT-4 estándar pueden costar mucho más por token que las alternativas de código abierto alojadas en máquinas virtuales autoadministradas.

Casos de uso únicos

Opción predeterminada para empresas con acuerdos empresariales de Microsoft existentes que requieren un RBAC estricto a través de Microsoft Entra ID.

Infraestructura de nube de Oracle (OCI)

Características

La IA generativa de OCI se basa en una arquitectura de «superclúster» con redes RDMA, diseñada para un entrenamiento de alto rendimiento. Cuenta con una asociación con Cohere para la búsqueda vectorial integrada.

Fijación

El OCI es agresivo en la computación. Según los precios de Oracle Cloud, sus instancias de GPU suelen ser inferiores a las de AWS y Azure, lo que las hace atractivas para los trabajos de formación básica.

Casos de uso únicos

Ideal para cargas de trabajo de computación de alto rendimiento (HPC) y para entrenar modelos fundamentales masivos desde cero, donde la eficiencia informática bruta por dólar es el KPI principal.

IA de Mosaic de Databricks

Características

La IA de Mosaic permite a las empresas capacitar previamente y ajustar los LLM utilizando datos patentados dentro del «Data Lakehouse». La arquitectura garantiza que los datos de formación nunca superen los límites de gobierno del cliente.

Fijación

Los precios se expresan en unidades de Databricks (DBU) más los costos subyacentes de la nube. Este modelo desacoplado ofrece transparencia, pero requiere la supervisión de los tipos de instancias.

Casos de uso únicos

Ideal para las organizaciones que ven los datos privados como un foso competitivo y necesitan capacitar modelos más pequeños y específicos de dominio (SLM).

Botpress

Características

Botpress es una herramienta de orquestación con poco código en la capa de aplicación. Cuenta con un generador de flujo visual y conectores para WhatsApp y Slack, y se centra en la gestión de los diálogos más que en el alojamiento de modelos.

Fijación

Modelo de facturación basado en el uso por mensaje entrante.

Casos de uso únicos

Ideal para equipos de productos que crean bots de atención al cliente que no necesitan administrar la infraestructura de GPU.

Runpod

Características

Runpod ofrece contenedores (Pods) de «GPU sin servidor». Permite a los desarrolladores crear instancias con plantillas preconfiguradas para vLLM o Stable Diffusion en cuestión de segundos.

Fijación

Runpod compite con tarifas brutas por hora. Por ejemplo, los precios de Runpod suelen incluir las GPU A100 a precios significativamente más bajos que los de las hiperescaladoras, a veces tan bajas como 1,69 dólares/hora para instancias de nube comunitaria.

Casos de uso únicos

Dirigido a empresas emergentes que necesitan computación GPU rentable y bajo demanda para el procesamiento por lotes o el ajuste preciso sin contratos a largo plazo.

Estudio Altair AI

Características

Se centra en la ciencia de datos industriales y proporciona un entorno sin código para la preparación de datos y la implementación del aprendizaje automático, integrado con los flujos de trabajo de simulación.

Fijación

Utiliza un modelo de unidades de licenciamiento (Altair Units) agrupado en su cartera de software.

Casos de uso únicos

Diseñado para los sectores aeroespacial y de fabricación que implican simulaciones basadas en la física.

Alternativas de código abierto a AWS Bedrock para la IA generativa

Marcos notables de código abierto

- Cara abrazada: El eje central de los modelos. El Tabla de clasificación de Open LLM rastrea el rendimiento de los mejores modelos como Llama 3 y Mistral.

- VLLM: Un motor de servicio de alto rendimiento que utiliza PageDAttention para administrar la memoria y, a menudo, ofrece un rendimiento de 2 a 4 veces mayor que los Hugging Face Transformers estándar.

Beneficios y desafíos

- Ventajas: Privacidad total de los datos, cero dependencia de un proveedor y capacidad de cuantificar los modelos (por ejemplo, AWQ) para que se ejecuten en hardware de consumo.

- Desafíos: Carga operativa. Usted es responsable de las actualizaciones de los controladores, la compatibilidad con CUDA y la alta disponibilidad.

Comparación de los competidores de AWS Bedrock

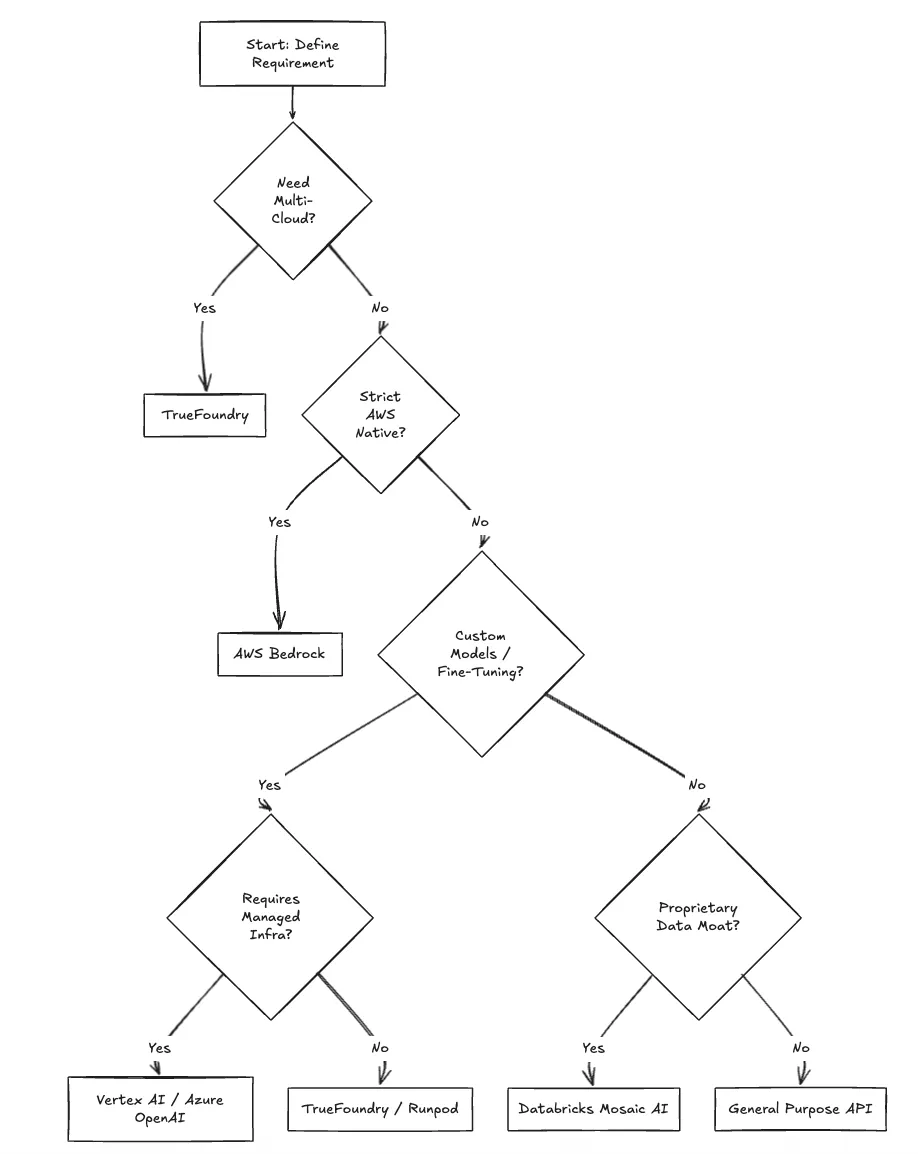

Cómo elegir una alternativa a AWS Bedrock

La selección de la alternativa correcta requiere un marco de decisiones basado en la madurez de la infraestructura y los objetivos arquitectónicos.

¿Está planificando una arquitectura multinube?

Si su estrategia implica evitar la dependencia de un solo proveedor, es esencial contar con un plano de control unificado. True Foundry le permite realizar la implementación en cualquier clúster de AWS, GCP y Azure desde un único panel.

¿La previsibilidad de los costos es fundamental para la presupuestación?

Los precios basados en fichas son difíciles de pronosticar. Si necesita un gasto mensual estable, ser propietario del procesamiento a través de True Foundry (en instancias reservadas o puntuales) permite una presupuestación determinista. Como se cita en Planes de ahorro de AWS, comprometerse con el uso de la computación puede generar ahorros de hasta 72% en comparación con los precios bajo demanda: ahorros que no puede obtener con los precios de las API de Bedrock.

¿Necesita soberanía de datos y aislamiento de VPC?

Las industrias reguladas a menudo no pueden enviar datos a un punto final de API multiusuario público. True Foundry implementa el punto final de inferencia interno su VPC, garantizando que los datos nunca abandonen su perímetro.

¿Está preparado para escalar más allá de AWS?

AWS Bedrock es una solución funcional para equipos que crean prototipos dentro del ecosistema de AWS. Sin embargo, para los equipos de ingeniería que crean productos de IA rentables y de múltiples nubes, el modelo «empaquetador de API» se convierte en una limitación. TrueFoundry ofrece el puente necesario: la propiedad de la infraestructura y la flexibilidad de una creación personalizada sin la sobrecarga operativa que supone gestionar los manifiestos de Kubernetes sin procesar.

Preguntas frecuentes

¿Vale la pena Amazon Bedrock?

Para la creación inicial de prototipos, Bedrock es eficiente. Sin embargo, en el caso de las aplicaciones de producción, el margen de beneficio de los tokens suele hacer que sea menos rentable que alojar modelos en tu propia infraestructura. Utilizar una plataforma de IA como Puerta de enlace de IA TrueFoundry que está diseñado para la creación rápida de prototipos de modelos de IA, garantiza evitar altos gastos y logra importantes ahorros de costos.

¿Cuáles son las limitaciones de Amazon Bedrock?

Las limitaciones incluyen la dependencia del ecosistema, los costos impredecibles a escala (precios basados en tokens) y las restricciones a la implementación de modelos cuantificados personalizados (como los formatos GGUF) que podrían ahorrar en computación. Los equipos suelen necesitar una integración perfecta con varias fuentes de datos para realizar tareas complejas y, al mismo tiempo, gestionar diferentes versiones de sus modelos de aprendizaje automático.

¿Amazon Bedrock es similar a ChatGPT?

No. ChatGPT es una aplicación SaaS. Bedrock es una PaaS (plataforma como servicio) que se utiliza para crear aplicaciones como ChatGPT. Se trata de un servicio totalmente gestionado en el que puede acceder a los modelos lingüísticos de gran tamaño de OpenAI mediante sencillas instrucciones de texto.

¿Qué tan seguro es Amazon Bedrock?

Bedrock sigue el modelo de responsabilidad compartida de AWS. Si bien ofrece cifrado, sus datos se procesan en una infraestructura administrada por AWS. El autoalojamiento mediante TrueFoundry dentro de su propia VPC ofrece un mayor aislamiento. Implementamos estrictas medidas de seguridad y control de acceso para proteger el desarrollo de la IA en todas las arquitecturas.

¿Cuál es el equivalente de AWS Bedrock en GCP?

Vertex AI es similar a Amazon Bedrock con API administradas, pero incluye herramientas de MLOps más sólidas para una formación personalizada.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)