Servidores MCP en Claude Code

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Qué es MCP

El MCP se define como «USB-C para aplicaciones de IA». El MCP proporciona un protocolo uniforme para vincular los modelos de IA con herramientas externas.

Con MCP, las aplicaciones de IA como Claude o ChatGPT no se limitan a generar texto. Pueden conectarse directamente a fuentes de datos (como archivos o bases de datos locales), herramientas (como motores de búsqueda o calculadoras) y flujos de trabajo estructurados (automatizaciones o indicaciones especializadas).

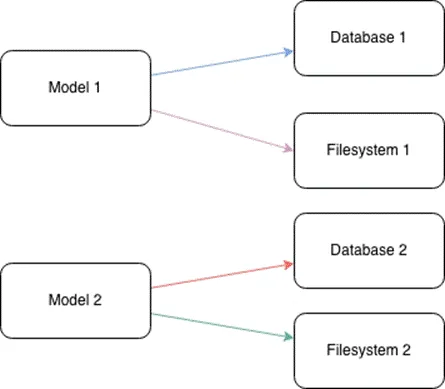

Cuando MCP aún no está disponible.

Cuando no existe un protocolo como el MCP, cada aplicación de IA tiene que integrarse con cada herramienta externa por separado. Esto hace que el proceso sea muy complejo, lento y costoso

Cuando tenemos varias aplicaciones de IA y muchas herramientas, la cantidad de integraciones necesarias es extremadamente grande.

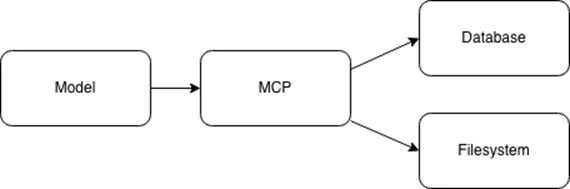

Cuando MCP esté disponible

MCP resuelve el problema de integración M × N transformándolo en un modelo M + N mediante un protocolo de conexión estandarizado. Cada aplicación de IA se integra una vez en el lado del cliente de MCP, y cada herramienta o fuente de datos se integra una vez en el Servidor MCP lado.

Terminología clave de MCP

Componentes

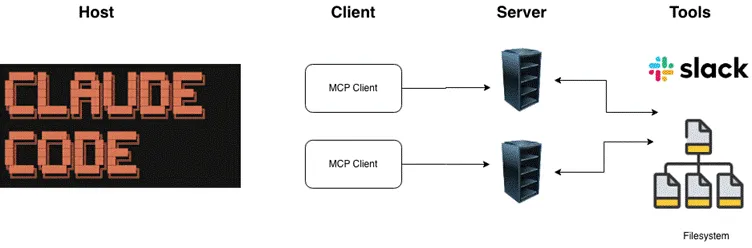

Al igual que el modelo cliente-servidor del protocolo HTTP, MCP también sigue una arquitectura cliente-servidor.

- Anfitrión: el entorno en el que el usuario interactúa directamente con la aplicación de IA (por ejemplo, Claude Desktop, Cursor).

- Cliente: un componente del host responsable de establecer y administrar la conexión con el servidor MCP.

- Servidor: una aplicación o servicio externo que proporciona capacidades (como herramientas, recursos e indicaciones) a través del protocolo MCP.

Capacidades

Aunque MCP puede conectarse a muchas herramientas diferentes, hay herramientas comunes que se comparten entre varias aplicaciones de IA. A continuación se detallan las principales categorías de herramientas que se utilizan habitualmente en los sistemas de IA:

- Herramientas: funciones ejecutables a las que un modelo de IA puede llamar para realizar acciones o cálculos (por ejemplo, una herramienta calculate_summary).

- Recursos: fuentes de datos de solo lectura que proporcionan información contextual sin requerir un cálculo significativo (por ejemplo, páginas de documentación de la empresa).

- Indicaciones: plantillas o flujos de trabajo predefinidos que guían las interacciones entre los usuarios, los modelos de IA y las herramientas externas.

Componentes de la arquitectura MCP

Tras entender los conceptos clave y la terminología de MCP, ahora podemos analizar su arquitectura.

El Protocolo de contexto modelo (MCP) se basa en una arquitectura cliente-servidor que permite a los modelos de IA interactuar con herramientas y servicios externos.

Anfitrión

El Anfitrión es el entorno en el que los usuarios finales interactúan directamente con la aplicación de IA (por ejemplo, Claude Desktop, Cursor).

El anfitrión es responsable de:

- Gestión de las interacciones y los permisos de los usuarios

- Inicio de conexiones a servidores MCP a través de clientes MCP

- Procesar las solicitudes de los usuarios y dirigirlas a las herramientas externas apropiadas

- Devolver los resultados al usuario

Cliente

El Cliente es un componente dentro del host que administra la conexión a un servidor MCP específico.

Características principales:

- Cada cliente mantiene una conexión 1:1 con un único servidor

- Maneja la comunicación a nivel de protocolo MCP

- Actúa como intermediario entre el host y el servidor

Servidor

El Servidor es un programa o servicio externo que proporciona capacidades al modelo de IA a través del protocolo MCP.

El servidor es responsable de:

- Proporcionar acceso a herramientas, fuentes de datos o servicios externos

- Se ejecuta de forma local (en la misma máquina que el host) o de forma remota (a través de la red)

- Exponer las interfaces estandarizadas para que los clientes puedan interactuar con sus capacidades

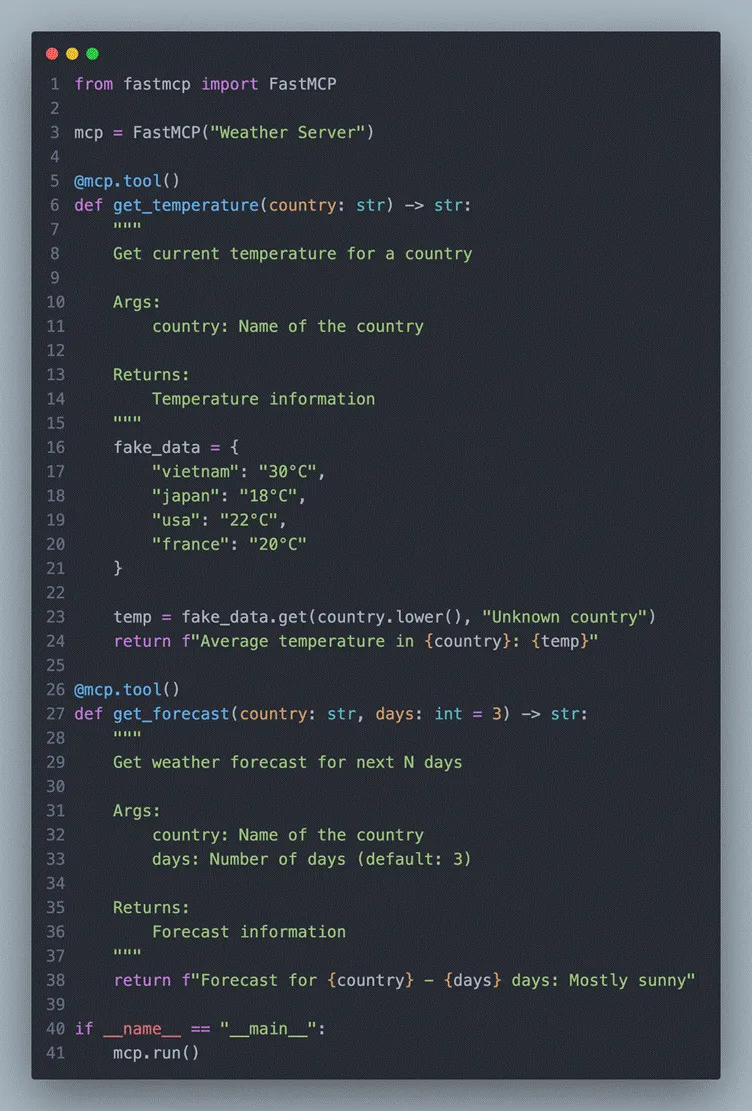

Creación de un servidor MCP sencillo

Instalar fastmcp

pip install fastmcp

Servidor MCP básico: Weather Tool

¡Eso es! FastMCP se encarga de todo, incluyendo:

- Protocolo JSON-RPC

- Registro de herramientas

- Validación de tipos

- Gestión de errores

Conectarse a Claude Code

claude mcp agregar clima --command python --args /full/path/to/get_weather.py

Reinicie Claude Code → los servidores MCP se conectarán automáticamente.

Ahora puedes preguntarle a Claude cosas como:

- «¿Cuál es la temperatura en Japón?»

- «Lea el archivo en ~/documents/report.txt»

Claude invocará automáticamente las herramientas de sus servidores MCP sin problemas.

Configuración de MCP con Claude Code

Basado en los documentos de Claude (https://code.claude.com/docs/en/mcp), configurar

McPin Claude Code es bastante sencillo: solo tienes que ejecutar

claude mcp añadir

y gestiona la configuración automáticamente

Para enumerar y verificar todos los servidores MCP configurados en Claude Code, intente ejecutar:

lista claude mcp

Claude Code & MCP: Mejores prácticas

1. Serena MCP

Enlace: https://github.com/oraios/serena

He estado experimentando con un flujo de trabajo impulsado por la IA y me he conectado Serena MCP directamente (solo con Sonet 4.5).

Honestamente, se siente como «guau». En lugar de cargar un montón de archivos en la IA y esperar a que esta resuelva las cosas, lee el código base como un desarrollador sénior del equipo.

¿Por qué funciona tan bien?

- TRAPO: Indexa todo el código base, utiliza la búsqueda semántica para extraer solo las partes más relevantes y proporciona un contexto limpio al modelo → menos ruido, mejores respuestas.

- Construido sobre Protocolo de servidor de idiomas, por lo que entiende el código estructuralmente, no solo como texto sin procesar.

- Memoria profunda: Recuerda el código base indexado, por lo que no tienes que seguir recargando los tokens cada vez.

- Búsqueda semántica es: pregunte «¿Dónde se gestiona la autenticación?» y encuentra funciones/clases relacionadas incluso si el nombre es extraño. En grandes proyectos, eso es un salvavidas.

En general: menos tokens, contexto más limpio, comprensión del código mucho más profunda.

Si estás creando agentes de codificación, deberías probarlo. Empieza a parecer que la IA es tu compañera de equipo.

2. Pensamiento secuencial (MCP).

Enlace: https://github.com/modelcontextprotocol/servers/tree/main/src/sequentialthinking

Aspectos más destacados

- Razonamiento estructurado: Claude Code resuelve problemas complejos utilizando un pensamiento lógico paso a paso.

- Maneja tareas complejas: Optimizado para tareas de varias etapas, como el diseño de sistemas o la refactorización arquitectónica.

- Escalabilidad: Soporta la planificación y el análisis paso a paso de bases de código a gran escala.

Casos de uso

- Refactorización de arquitecturas de microservicios

- Planificación de tareas por fases para grandes proyectos

- Optimización del diseño del sistema y los flujos de trabajo de depuración

3. Uso de subagentes especializados

Enlace: https://github.com/wshobson/agents

Se trata de un sistema completo y listo para la producción, diseñado para integrarse con Claude Code y ampliar significativamente sus capacidades.

Combina:

- 112 agentes de IA especializados

- 16 orquestadores de flujo de trabajo multiagente

- 146 habilidades de agente

- 79 herramientas de desarrollo

- Organizado en 72 complementos enfocados y de un solo propósito para Claude Code

Cada agente tiene una función claramente definida, como el diseño de la arquitectura de backend, el desarrollo de la interfaz, la optimización de la infraestructura de la nube, las pruebas automatizadas, los MLOP y más, todas configuradas siguiendo las mejores prácticas modernas.

Instalación:

git clone https://github.com/wshobson/agents.git ~/.claude/agents

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)