True ML Talks #1: Flujo de trabajo de aprendizaje automático @ Gong

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Hoy, True Foundry lanza una serie de análisis profundo sobre aprendizaje automático en la que hablamos con líderes de aprendizaje automático y ciencia de datos de todas las empresas que utilizan el aprendizaje automático para profundizar en los casos de uso y los flujos de trabajo del aprendizaje automático en sus organizaciones. Como parte de esta serie, presentaremos y profundizaremos en el modelo de aprendizaje automático de empresas como Gong, StichFix, Fuerza de ventas, Gusto, Sencillo, y muchos más.

📌

En esta serie, nos adentramos en el mundo del aprendizaje automático para desvelar el espectro de aplicaciones de aprendizaje automático y configuraciones de infraestructura en todos los sectores.

Nuestras conversaciones girarán en torno a cuatro temas clave:

1. Casos de uso del aprendizaje automático para la empresa

2. ¿Cómo han creado su sistema de aprendizaje automático, incluido el proceso de formación y experimentación, la implementación y el servicio, la supervisión y la optimización de los costes y la latencia a lo largo del proceso

3. Los desafíos a los que se enfrenta la creación del aprendizaje automático van acompañados de desafíos específicos relacionados con la industria

4. Una descripción general de las innovaciones de vanguardia aplicadas durante el proceso de creación y escalado de la infraestructura de aprendizaje automático.

Para iniciar la primera discusión de la serie, hablamos con Noam Lotner de Gong. Gong es una plataforma de inteligencia de ingresos. Permite a los equipos de ingresos aprovechar al máximo su potencial al revelar la realidad de los clientes a partir de las conversaciones del equipo de ingresos. Gong analiza las interacciones con los clientes a través del teléfono, el correo electrónico, la web, etc., para ofrecer la mejor información a los equipos de ingresos para que puedan utilizarla para cerrar más negocios.

Noam Lotner es el líder del equipo de operaciones de investigación en Gong. Está creando la plataforma operativa para el grupo de investigación de inteligencia artificial y aprendizaje automático: automatiza los procesos de publicación de modelos, la gestión de experimentos y las pruebas de rendimiento, crea herramientas de etiquetado y creación de conjuntos de datos y permite un acceso seguro a las fuentes de datos de producción.

Consulta nuestra conversación a continuación:

Por qué el aprendizaje automático es importante para Gong: una plataforma de inteligencia de ventas

Gong analiza las interacciones con los clientes a través del teléfono, el correo electrónico, la web, etc. El aprendizaje automático se vuelve aún más esencial para analizar las interacciones de ventas y proporcionar información a los equipos de ingresos. Los algoritmos de aprendizaje automático pueden automatizar tareas que antes se realizaban de forma manual, como el análisis de las videollamadas, la transcripción y el análisis de las llamadas telefónicas de ventas. Esto ahorra tiempo y mejora la eficiencia del proceso de ventas.

- Canalización de análisis de videollamadas → Para analizar las llamadas, el equipo procesa el vídeo, clasifica los fotogramas y procesa ciertos tipos de segmentos de vídeo.

- Proceso de análisis de transcripciones de audio → De hecho, la voz se transcribe automáticamente junto con otro proceso que implica bastantes modelos, comprobando dónde está el discurso, detectando qué hablante habla y cuándo, junto con el contenido de la conversación.

- Canalización de texto basada en NLP → Hay una canalización para extraer información de las diapositivas y las notas de presentación. En el caso de los correos electrónicos, se utiliza un proceso diferente de procesamiento, mensajería y comentarios de la PNL.

¿Cómo se segmentan estos modelos entre los clientes?

Si bien esta es una pregunta que le hicimos a Gong, vemos que invariablemente todas las empresas de SaaS:

- Modelos que son comunes a todos los clientes: Hay algunos modelos, como los modelos ASR, que realizan el reconocimiento automático de voz. Esto ayuda a estandarizar el servicio y a mantener la coherencia en toda la plataforma

- Modelos que son únicos para cada cliente: En el caso de las startups de SaaS, especialmente en el caso de una plataforma de inteligencia de ventas como Gong, cada modelo tiene que ser único. Esto se hace para garantizar la privacidad y la seguridad de los datos, así como para ofrecer opciones de personalización o personalización mediante el entrenamiento del modelo en función del conjunto de datos del cliente. Esto conlleva dos desafíos: el servicio y la privacidad de los datos. Dado que Gong permite a los clientes capacitarse sobre los modelos basándose en sus propios datos, tienen que utilizar las interfaces de aprendizaje automático en su plataforma, por lo que la segregación de datos para cada cliente se convierte en un desafío.

📌

Número de modelos: Número de clientes X Tipos de modelos

📌

«Usamos el mismo modelo base para todos. También permitimos que los clientes se capaciten sobre modelos específicos para su propio contenido».

Para optimizar los costos, Gong utiliza el servicio multimodelo en la capa de inferencia, ya que ejecutar modelos separados en máquinas separadas implicaría un sistema de alto costo.

Aquí hay un blog detallado de Gong que habla sobre el uso del aprendizaje automático en las ventas B2B

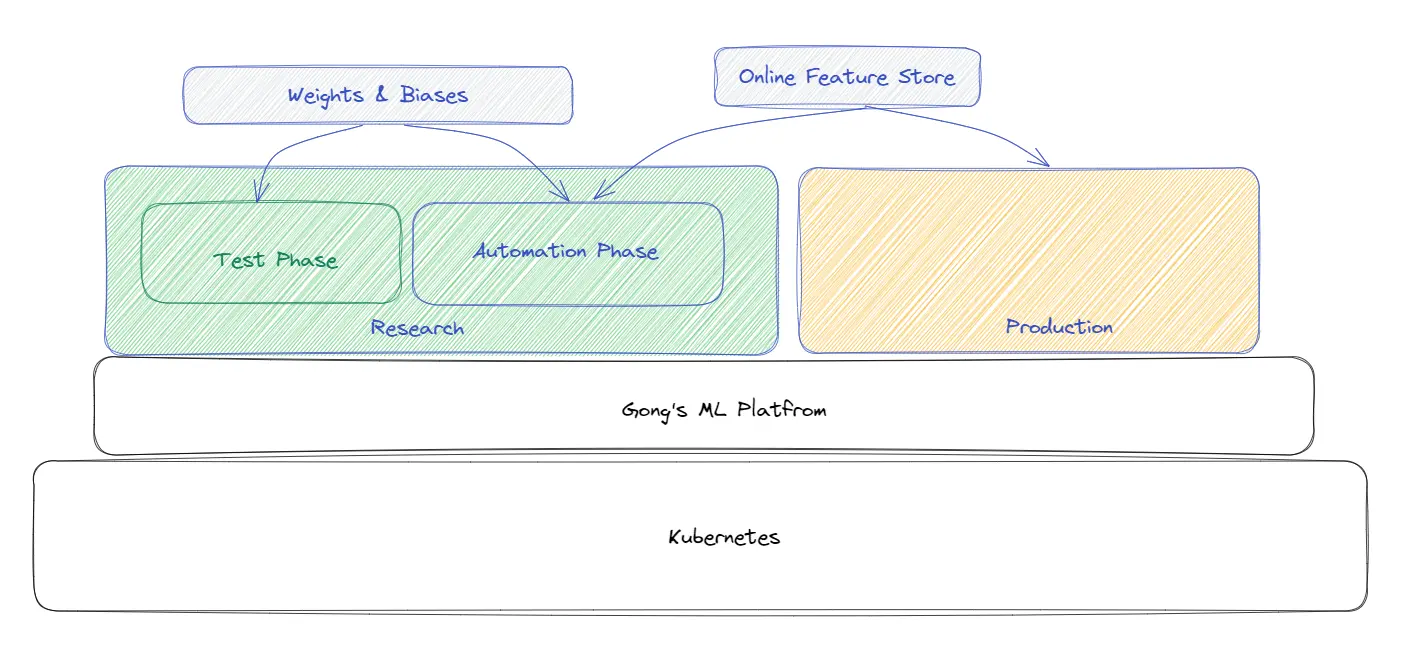

Flujo de trabajo del sistema ML en Gong

En Gong, el sistema ML está estructurado según la organización ML.

- Investigación: Hay un entorno independiente para la investigación. El equipo trabaja por separado: obtiene los datos, realiza la capacitación, finaliza la capacitación, publica el modelo y, a continuación, el modelo se envía al proceso de implementación, donde se encarga el departamento de ingeniería.

- Despliegue de producción (parte de la ingeniería): El equipo de ingeniería implementa el modelo entrenado en producción.

En este blog (así como en la serie de charlas), profundizaremos en los desafíos de Research Side infra for Gong

¿Cómo se configura el flujo de trabajo de ML Researcher en Gong?

- Fase de prueba básica: Los investigadores toman los datos y se entrenan en sus propias máquinas o mediante máquinas virtuales extrayendo los datos de la producción a sus máquinas

- Fase de automatización: Una vez finalizado el modelo, se crea una canalización automática para procesar los datos y poner la gran cantidad de datos en manos del investigador.

Para que los investigadores puedan hacer funcionar las máquinas con facilidad, toda la pila está configurada sobre Kubernetes para Research Infra. La mayoría de los modelos del equipo de investigación no utilizan funciones en línea.

Nube: La mayor parte de la infraestructura está en AWS y también funciona con otros proveedores de nube con una capacidad algo menor.

Administración de la infraestructura: en realidad, los oleoductos utilizan los modelos específicos para cada cliente. Aparece una máquina que atiende todas las llamadas de esa empresa

Otros desafíos que hacen del aprendizaje automático un problema complejo de resolver en Gong

- Coste: También lo mencionamos anteriormente, el costo es un desafío importante para Gong, ya que se requiere una enorme cantidad de datos para entrenar y luego volver a entrenar el modelo. Los conjuntos de datos de voz son muy grandes (unos pocos cientos de horas de voz se traducen en unos cientos de gigabytes de datos). Los conjuntos de datos de PNL son más pequeños, pero pueden tener muchas filas. Dado que la investigación está separada de la producción, el equipo de investigación puede ser flexible en cuanto a la cantidad de datos que se utilizarán en el entrenamiento de modelos. El equipo de investigación está trabajando para poder optimizar la cantidad de datos que se utilizarán en la capacitación.

- Simplificación de la plataforma ML: Un aspecto importante de la simplificación del proceso es ocultar realmente la complejidad de seleccionar el tipo de datos que se utilizará para la formación con el control de acceso adecuado detrás de las herramientas.

Se hace de manera diferente para diferentes fuentes de datos. En el caso de un gran número de bases de datos (cada una contiene un tipo de información diferente y el acceso a cada una es diferente), se trabaja mucho para crear canales que sean seguros y que solo permitan a las personas autorizadas usar los datos y crear un registro de quién accedió a los datos y con qué propósito. También incluye permitir a los investigadores mezclar y combinar los resultados de diferentes fuentes de datos. - Seguridad y privacidad de los datos: Una de las principales preocupaciones de Gong es la seguridad y la privacidad, es decir, asegurarse de que no haya filtraciones y asegurarse de que nadie que no tenga autoridad pueda acceder a los datos, y que ningún cliente reciba los datos de otro cliente. Esto es muy complicado debido a la gran cantidad de datos.

Cómo lo resolvió Gong: almacenar los datos en ubicaciones seguras, anotar cada punto de datos y tener derechos de acceso, de acuerdo con la identificación del inquilino del cliente. Se accede a los mecanismos de credenciales controlados y se automatiza todo lo que se puede automatizar - Garantizar que no haya forma de que los datos de un cliente pasen a otro modelo - Al utilizar un modelo lingüístico amplio, es posible deducir algo de un cliente y otro cliente obtiene la información privada. Esto es algo que hay que tener en cuenta.

- El reentrenamiento automático no es fácil: El readiestramiento solo se realiza cuando existe un método muy versado para realizar todas las etapas del proceso. Es muy poco frecuente. Los esfuerzos de readiestramiento dependen del tipo de modelo, por ejemplo, en el caso de un modelo de reconocimiento de voz para un idioma específico, es bastante fácil volver a capacitarlo con los mismos parámetros en datos nuevos.

La actualización de los datos también cambia gran parte del contenido y también requiere que un investigador vuelva a investigar un poco para asegurarse de que el nuevo modelo realmente funciona mejor que el que teníamos antes.

Reflexiones adicionales de Noam

Kubernetes es el camino a seguir

Todo lo que se hace en el equipo de investigación ahora se está trasladando a Kubernetes. Una parte del trabajo de Noam consiste en ayudar a su equipo a acceder automáticamente a los recursos desde la nube de Kubernetes. Actualmente se trata de un esfuerzo continuo.

📌

«Yo recomendaría a cualquiera que se esté dedicando a esto que, desde una fase muy temprana, tenga que pensar en la escala y en cómo va a funcionar su grupo»

«Creo que la mayoría de los sistemas MLOps requieren Kubernetes para administrar los recursos. No veo ninguna plataforma en el futuro que pueda hacer nada relacionado con MLOps sin usar Kubernetes»

Algunas cosas importantes a tener en cuenta:

- La escalabilidad a cero es muy importante en términos de gestión de costes. Tener máquinas que funcionan sin hacer nada supone una enorme reducción de costes.

- El sistema debe ser ágil para gestionar los problemas de seguridad y privacidad de manera eficiente. Los datos deben permanecer donde están y tú debes llevar tu código allí.

MLOps: Construir frente a comprar

📌

«Mi perspectiva es que At Gong necesitaba construir esta plataforma»

- Mientras crea, comience con Kubernetes, que es una plataforma escalable y flexible.

- Configure todos los sistemas de manera que esté preparado para la separación de inquilinos y para aplicar el GDPR, y si alguien quiere eliminar los datos, usted debe eliminarlos.

- Es muy importante pensar en la escala desde el principio. Haga que su infraestructura sea ágil y flexible, asegúrese de que dispone de capacidades de escalado y de que puede implementar y poner en marcha tantas máquinas como desee cuando las necesite. Pero haz que acaben con ellos tan pronto como sea su ídolo.

Seguridad, seguridad, seguridad

Nada puede ser más importante para una empresa de SaaS que la seguridad. ML Pipeline debe priorizar la seguridad debido a la privacidad de los datos al gestionar los datos confidenciales de los clientes, así como controlar el acceso no autorizado.

Espero que la primera serie de blogs de las charlas sobre TrueML haya podido brindarle información valiosa sobre cómo puede pensar en crear su infraestructura de investigación de aprendizaje automático para impulsar sus equipos de aprendizaje automático. #MLOps #MachineLearning #DataScience #DevOps #ModelOps #AIInfrastructure

Lea nuestros nuevos blogs de la serie

Dirígete a nuestro segundo episodio de las charlas de TrueML en las que hablamos con el líder de plataforma de Stitch. Sigue viendo el TrueML serie youtube y encuentra todos los episodios de la serie de blogs TrueML aquí -

True Foundry es un PaaS de implementación de aprendizaje automático sobre Kubernetes para acelerar los flujos de trabajo de los desarrolladores y, al mismo tiempo, permitirles una flexibilidad total a la hora de probar e implementar modelos, al tiempo que garantiza una seguridad y un control totales para el equipo de Infra. A través de nuestra plataforma, permitimos a los equipos de aprendizaje automático implementar y supervisar modela en 15 minutos con un 100% de confiabilidad, escalabilidad y la capacidad de revertirse en segundos, lo que les permite ahorrar costos y lanzar los modelos a la producción más rápido, lo que permite obtener un verdadero valor empresarial.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)