Integración de LangChain con Truefoundry

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Potencie sus aplicaciones LangChain con la plataforma lista para la producción de TrueFoundry

LangChain se ha convertido en un marco poderoso para crear aplicaciones innovadoras impulsadas por grandes modelos lingüísticos (LLM). Su modularidad y sus amplias integraciones permiten a los desarrolladores crear sofisticadas herramientas de análisis de datos, inteligencia artificial conversacional y mucho más. Sin embargo, la implementación y la administración de estas aplicaciones de LangChain en un entorno de producción presentan complejidades en torno a la escalabilidad, la observabilidad, la administración de costos y el soporte de múltiples LLM.

Esta entrada de blog lo guiará para aprovechar TrueFoundry con sus proyectos de LangChain para desbloquear un flujo de trabajo del desarrollo a la producción eficiente y sin interrupciones.

¿Por qué usar TrueFoundry para sus aplicaciones de LangChain?

TrueFoundry aborda los desafíos críticos de ejecutar aplicaciones de LangChain a escala:

- Acceso unificado a LLM: Conéctese con varios proveedores líderes de LLM (OpenAI, Anthropic y más próximamente) a través de un punto final de API único y coherente, lo que simplifica las integraciones y permite una fácil experimentación.

- Despliegue de modelos sin esfuerzo: Implemente y sirva sus modelos impulsados por Langchain con escalado automático, lo que garantiza una alta disponibilidad y una utilización óptima de los recursos sin la complejidad de Kubernetes.

- Observabilidad profunda con LLM Tracing: Obtenga una visibilidad sin precedentes de las interacciones de LLM de su aplicación LangChain. Supervise, depure y optimice cada paso de sus cadenas y agentes en producción.

- Seguimiento de costes y rendimiento: Vigile de cerca sus gastos de LLM y las métricas de rendimiento en diferentes modelos, lo que permite tomar decisiones basadas en datos para optimizar los costos y mejorar la experiencia del usuario.

- Fiabilidad de nivel de producción: Implemente mecanismos inteligentes de respaldo y reintento sin esfuerzo, garantizando que sus aplicaciones de LangChain sean resistentes y confiables en escenarios del mundo real.

Inicio rápido: Conexión de LangChain a TrueFoundry

Comenzar con TrueFoundry y LangChain es increíblemente sencillo debido a la compatibilidad de firmas OpenAI de TrueFoundry. Puede integrarse sin problemas simplemente configurando su Chat Open AI interfaz.

Instalación

Primero, asegúrese de tener instalada la integración de LangChain OpenAI:

pip install langchain-openaiConfiguración básica

Conecte su aplicación LangChain a la pasarela de LLM unificada de TrueFoundry actualizando su Chat Open AI modelo:

from langchain_openai import ChatOpenAI

TRUEFOUNDRY_PAT = "YOUR_TRUEFOUNDRY_PERSONAL_ACCESS_TOKEN"

TRUEFOUNDRY_BASE_URL = "YOUR_TRUEFOUNDRY_UNIFIED_ENDPOINT"

llm = ChatOpenAI(api_key=TRUEFOUNDRY_PAT,base_url=TRUEFOUNDRY_BASE_URL,model="openai-main/gpt-4o")

response = llm.invoke("What's the weather like today in Bengaluru?")

print(response.content)Puntos clave:

- Reemplazar

«SU_TRUEFOUNDRY_PERSONAL_ACCESS_TOKEN»con tu TrueFoundry actual Token de acceso personal (PAT). - Set

«SU_TRUEFOUNDRY_UNIFIED_ENDPOINT»a la URL base proporcionada por su configuración de TrueFoundry. - Utilice la convención de nomenclatura de modelos de TrueFoundry:

proveedor-principal/nombre-modelo. Por ejemplo,openai-main/gpt-4opara GPT-4o de OpenAI.

Con esta configuración mínima, todas las solicitudes realizadas a través del llm el objeto se enrutará automáticamente a través de su puerta de enlace de IA de TrueFoundry, beneficiándose de la autenticación, el equilibrio de carga y el registro completo.

Integración perfecta con LangGraph

TrueFoundry se integra perfectamente con LangGraph, el marco de LangChain para crear flujos de trabajo con múltiples agentes y comprender LangChain frente a LangGraph ayuda a los equipos a elegir el patrón de orquestación correcto para los sistemas de IA de producción. Simplemente configure sus nodos de LLM dentro de su LangGraph para usar TrueFoundry Chat Open AI cliente, y TrueFoundry gestionará automáticamente la infraestructura subyacente y la observabilidad.

from langchain_openai import ChatOpenAI

from langgraph.graph import StateGraph, MessagesState

from langchain_core.messages import HumanMessage

TRUEFOUNDRY_PAT = "YOUR_TRUEFOUNDRY_PERSONAL_ACCESS_TOKEN"

TRUEFOUNDRY_BASE_URL = "YOUR_TRUEFOUNDRY_UNIFIED_ENDPOINT"

def call_model(state: MessagesState):

model = ChatOpenAI(api_key=TRUEFOUNDRY_PAT,base_url=TRUEFOUNDRY_BASE_URL,model="openai-main/gpt-4o")

response = model.invoke(state["messages"])

return {"messages": [response]}

workflow = StateGraph(MessagesState)

workflow.add_node("agent", call_model)

workflow.set_entry_point("agent")

workflow.set_finish_point("agent")

app = workflow.compile()

result = app.invoke({"messages": [HumanMessage(content="Tell me a short story.")]})

print(result)Desbloqueando la observabilidad y los conocimientos

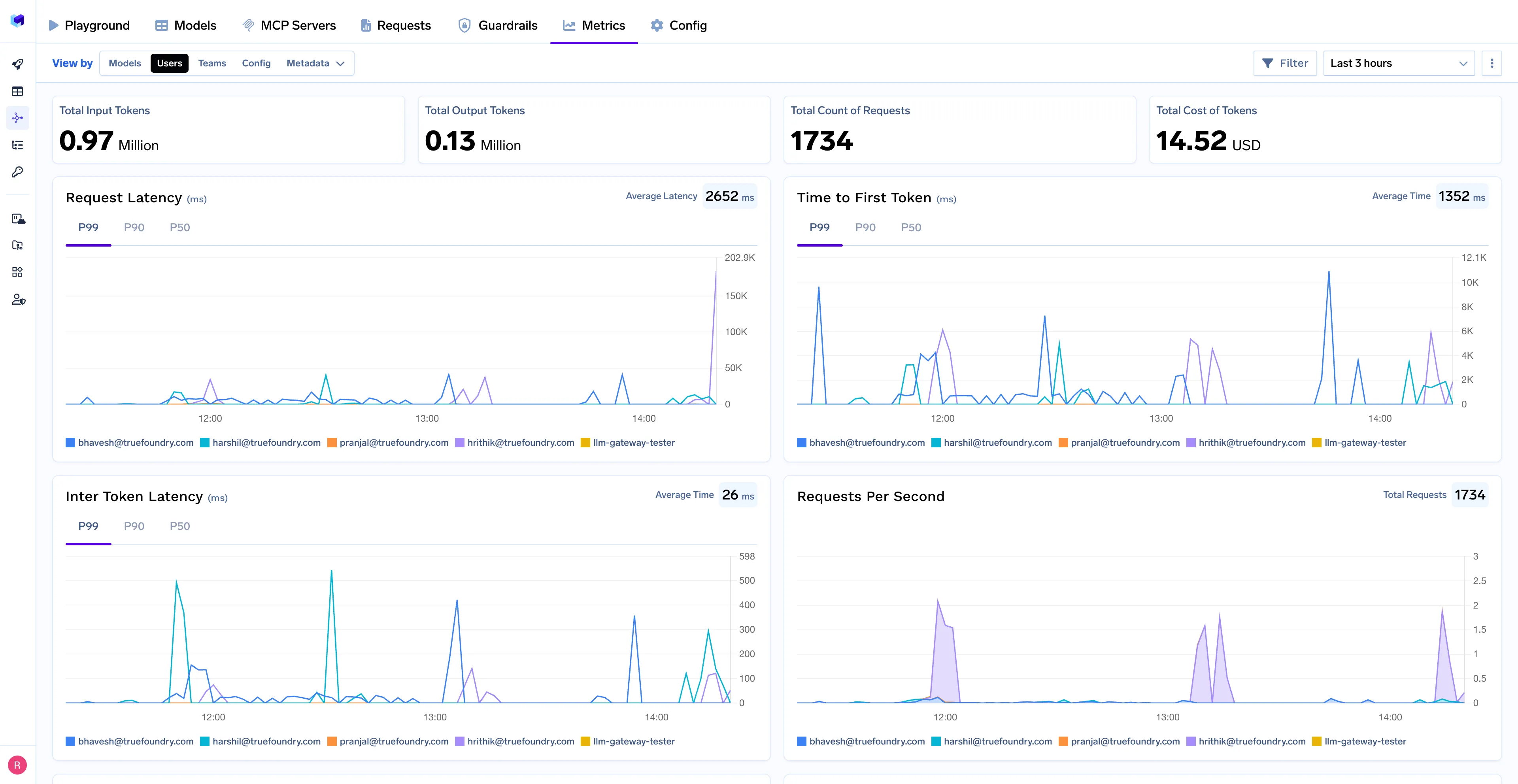

Una de las ventajas más importantes de usar TrueFoundry con LangChain son sus capacidades integradas de monitoreo y observabilidad. Todas las solicitudes que pasan por la puerta de enlace de IA de TrueFoundry pasan automáticamente a:

- Explotación: Proporcionar información detallada sobre las solicitudes y respuestas.

- Rastreo: Le permite seguir el flujo de ejecución en los componentes de LangChain.

- Monitorización: Seguimiento de los indicadores clave de rendimiento y los costos.

Acceda a su panel de control intuitivo en la plataforma TrueFoundry para obtener una visibilidad completa del comportamiento de su aplicación LangChain en producción. Explore los registros de solicitudes, analice las métricas de rendimiento, como la latencia y el uso de tokens, realice un seguimiento de los costos por modelo e identifique los patrones de error para una depuración más rápida.

¡Comience con TrueFoundry y LangChain hoy mismo!

TrueFoundry proporciona la infraestructura y las herramientas esenciales para llevar sus aplicaciones innovadoras de LangChain del desarrollo a la producción con confianza y eficiencia. Al simplificar la integración de la LLM, automatizar las implementaciones y proporcionar una capacidad de observación profunda, TrueFoundry permite a su equipo centrarse en crear soluciones de inteligencia artificial de vanguardia en lugar de enfrentarse a las complejidades de la infraestructura.

¿Está listo para experimentar el poder de TrueFoundry para sus proyectos de LangChain?

- Visite el Sitio web de TrueFoundry para obtener más información y suscribirse a una prueba gratuita.

- Explore la completa Documentación de TrueFoundry para obtener guías detalladas y referencias de API.

- Sumérjase más en Rastreo de LLM y Rastreo LangGraph con TrueFoundry.

Si tienes alguna pregunta o necesitas ayuda, no dudes en ponerte en contacto con el equipo de TrueFoundry en support@truefoundry.com

¡Libere todo el potencial de sus aplicaciones LangChain con TrueFoundry y construya el futuro de la IA hoy mismo!

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)