Las 5 mejores alternativas de Kong AI

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

La inteligencia artificial está transformando la forma en que las organizaciones desarrollan, implementan y escalan las aplicaciones. Con el rápido auge de los grandes modelos lingüísticos (LLM) y la IA generativa, los desarrolladores necesitan cada vez más plataformas que ofrezcan acceso confiable a los modelos, observabilidad y operaciones rentables.

Kong AI se ha convertido en una solución destacada que ofrece gestión, supervisión y optimización del flujo de trabajo de API impulsadas por la IA para optimizar el rendimiento de las aplicaciones de IA. Sin embargo, no hay una plataforma única que se adapte a las necesidades de todas las organizaciones. Flexibilidad de implementación, seguridad de nivel empresarial, observabilidad e integración con la infraestructura existente son factores críticos que influyen en la elección de la plataforma.

Encontrar una alternativa fiable a Kong ayuda a los desarrolladores a descubrir soluciones que se alinean mejor con sus requisitos operativos, su oferta tecnológica y sus ambiciones de crecimiento. Desde pasarelas de código abierto hasta plataformas completas de IA empresarial, como TrueFoundry, existen diversas alternativas de puertas de enlace a Kong para optimizar el enrutamiento, la gobernanza y la escalabilidad de los modelos.

En este artículo, analizaremos cómo funciona Kong AI, sus funciones principales y las principales alternativas disponibles en 2026.

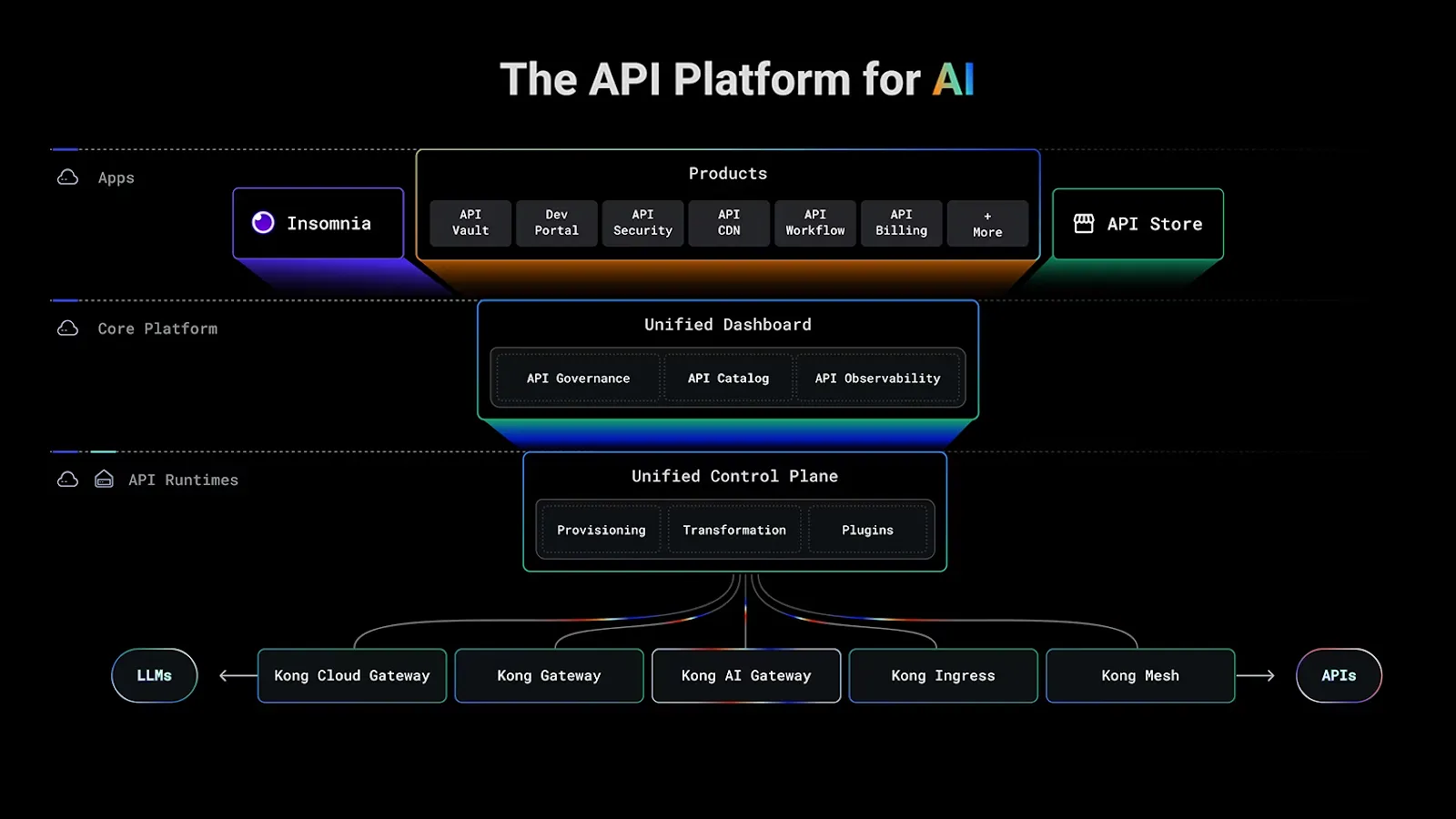

¿Qué es Kong AI?

Kong AI es una puerta de enlace de IA de nivel empresarial construida sobre Kong Gateway, diseñada para simplificar la integración, la administración y la gobernanza de los modelos de IA dentro de las organizaciones. Proporciona una plataforma de API unificada que permite a las empresas exponer, enrutar y supervisar de forma segura los servicios de IA de varios proveedores, incluidos OpenAI, Azure AI, AWS Bedrock y GCP Vertex.

Al centralizar la gestión del tráfico de IA, Kong AI ayuda a las organizaciones a acelerar las iniciativas de IA y, al mismo tiempo, a mantener el control sobre la seguridad, el cumplimiento y el rendimiento operativo.

La plataforma es especialmente adecuada para las empresas que necesitan implementar flujos de trabajo avanzados de inteligencia artificial, gestionar modelos de varios idiomas y hacer cumplir las políticas de gobierno a escala. Sus funciones están diseñadas para agilizar el desarrollo de la IA, reducir los gastos operativos y mejorar la rentabilidad, al tiempo que garantizan un acceso fiable y seguro a los recursos de IA.

Características principales:

Soporte multiLLM: Kong AI permite una integración perfecta con múltiples proveedores de IA, lo que permite a las organizaciones cambiar de modelo de manera eficiente para cumplir con diferentes casos de uso o mantener una alta disponibilidad.

Tuberías RAG automatizadas: La plataforma puede crear automáticamente canales de generación aumentada y recuperación, lo que mejora la precisión de las respuestas de la IA y reduce las alucinaciones en los resultados generados.

Saneamiento de la PII y seguridad inmediata: Kong AI refuerza la seguridad y el cumplimiento del contenido al desinfectar los datos confidenciales e implementar reglas de seguridad rápidas en todas las interacciones de la IA.

Integraciones de IA sin código: Los desarrolladores pueden enriquecer, transformar o aumentar el tráfico de API mediante LLM compatibles sin escribir ningún código, lo que permite un despliegue rápido de las capacidades de IA en todas las aplicaciones.

Gestión avanzada del tráfico: El almacenamiento en caché semántico, el enrutamiento y el equilibrio de carga optimizan el tráfico de IA, reducen las llamadas redundantes a la API y controlan los costos, mientras que las funciones de observabilidad brindan información útil sobre el rendimiento y el uso.

Kong AI también es compatible con los protocolos de control de modelos (MCP), lo que permite una implementación segura, confiable y escalable de los servidores de IA. Sus herramientas de análisis y observabilidad permiten a los equipos realizar un seguimiento del consumo de IA, optimizar los costes y supervisar el rendimiento de todas las cargas de trabajo de IA.

Lea también: Kong contra LitellM

¿Cómo funciona Kong AI?

Kong AI se basa en la arquitectura central de Kong Gateway y añade capas y complementos específicos de la IA a administre, proteja y optimice el tráfico hacia modelos lingüísticos de gran tamaño (LLM). Kong AI actúa como una puerta de enlace inteligente entre sus aplicaciones y los modelos lingüísticos de gran tamaño (LLM), gestionando las solicitudes, haciendo cumplir las políticas y optimizando el rendimiento. En lugar de enviar las solicitudes directamente a un proveedor de modelos, Kong AI las intercepta, aplica reglas y dirige el tráfico de manera eficiente, a la vez que captura las métricas y hace un seguimiento del uso.

Aprovecha un marco basado en complementos que puede:

- Valide y desinfecte las indicaciones para garantizar el cumplimiento y la seguridad de los datos.

- Inyecte el contexto relevante de las bases de datos vectoriales de forma dinámica, mejorando la confiabilidad del modelo.

- Dirija las solicitudes a través de varios modelos en función de la latencia, el costo o la similitud semántica.

- Guarde en caché las solicitudes repetidas para reducir las llamadas redundantes y ahorrar costos.

Además, Kong AI proporciona observabilidad y análisis, incluidos el uso de tokens, la latencia, el seguimiento de errores y los paneles de rendimiento. Esta combinación de enrutamiento, gobierno, almacenamiento en caché y monitoreo permite a los desarrolladores implementar aplicaciones de IA de manera confiable y, al mismo tiempo, mantener los costos bajo control.

¿Por qué explorar las alternativas de Kong AI?

Si bien Kong AI Gateway ofrece funciones sólidas para administrar y proteger el tráfico de IA, es posible que no se adapte a las necesidades específicas de todas las organizaciones. Algunos equipos requieren una integración más profunda con los marcos de trabajo de las agencias, una capacidad de observación más flexible o un control más preciso sobre la orquestación de los modelos más allá de la administración a nivel de API. Es posible que otros prefieran las plataformas de código abierto que permiten una mayor personalización o libertad de autohospedaje sin restricciones de licencias empresariales.

Además, la fortaleza de Kong AI radica en la gobernanza de las API y el cumplimiento empresarial, lo que puede resultar complejo o excesivo para los equipos más pequeños que se centran únicamente en la experimentación de LLM o en cargas de trabajo ligeras.

Las consideraciones de costo y los gastos generales de implementación también pueden llevar a los equipos a evaluar las LLMOP o las herramientas de infraestructura de IA diseñadas específicamente para proporcionar una configuración más rápida y una compatibilidad más amplia con los ecosistemas.

La exploración de alternativas garantiza que las organizaciones elijan la plataforma que mejor se adapte a su sistema de IA, ya sea que la prioridad sea la escalabilidad, la agilidad de los desarrolladores, la rentabilidad o la observabilidad integral del modelo.

Las 4 mejores alternativas de Kong AI

Si bien Kong AI ofrece una gobernanza y una capacidad de observación sólidas, varias plataformas ahora ofrecen funciones de puerta de enlace y orquestación de IA más avanzadas. Estas alternativas ofrecen una mayor flexibilidad, un enrutamiento multimodelo y un control más completo de las cargas de trabajo de la IA. A continuación se muestran las cuatro plataformas principales que lideran esta evolución.

1. True Foundry

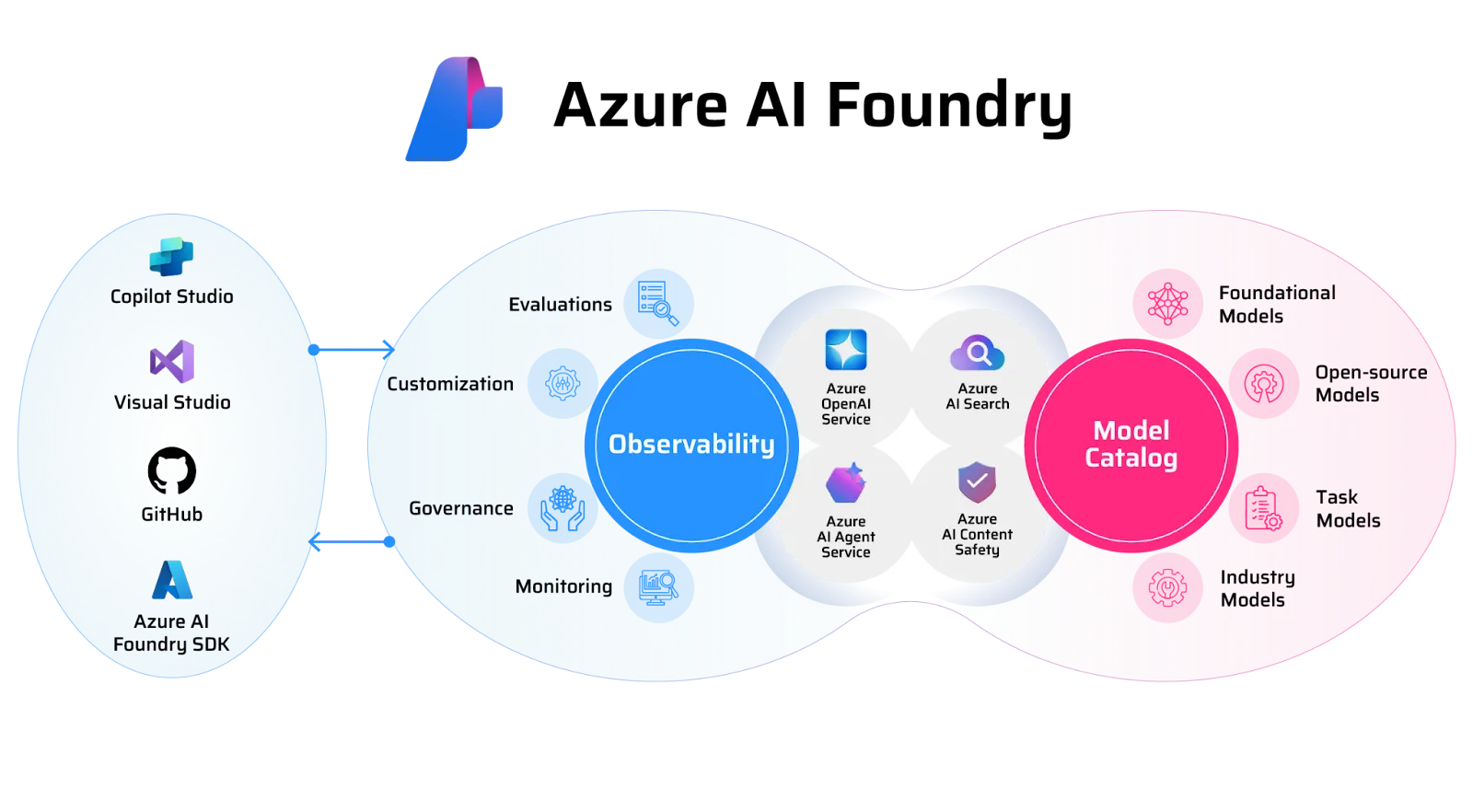

True Foundry permite a las empresas gobernar, implementar, escalar y observar la IA de las agencias mediante una plataforma unificada de extremo a extremo. A diferencia de las soluciones puntuales que solo gestionan la orquestación o el alojamiento de modelos, TrueFoundry crea un paquete completo que admite una IA segura, compatible y de alto rendimiento a escala. Es nativo de Kubernetes y está diseñado para satisfacer las necesidades empresariales en entornos híbridos, de VPC, locales o aislados.

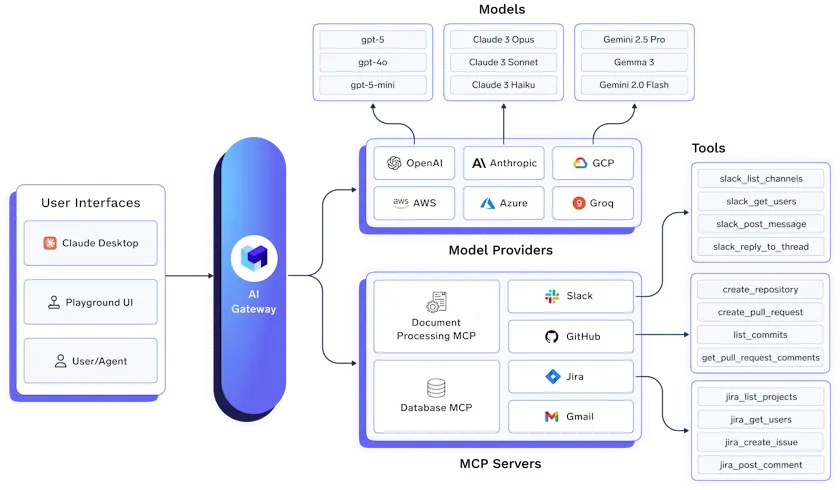

Organice con AI Gateway

La puerta de enlace de IA de TrueFoundry proporciona un protocolo centralizado para los flujos de trabajo de los agentes. Gestiona la memoria, la organización de las herramientas y el razonamiento en varios pasos, lo que permite a los agentes planificar acciones, recurrir a herramientas externas y mantener el estado del contexto con total visibilidad y control.

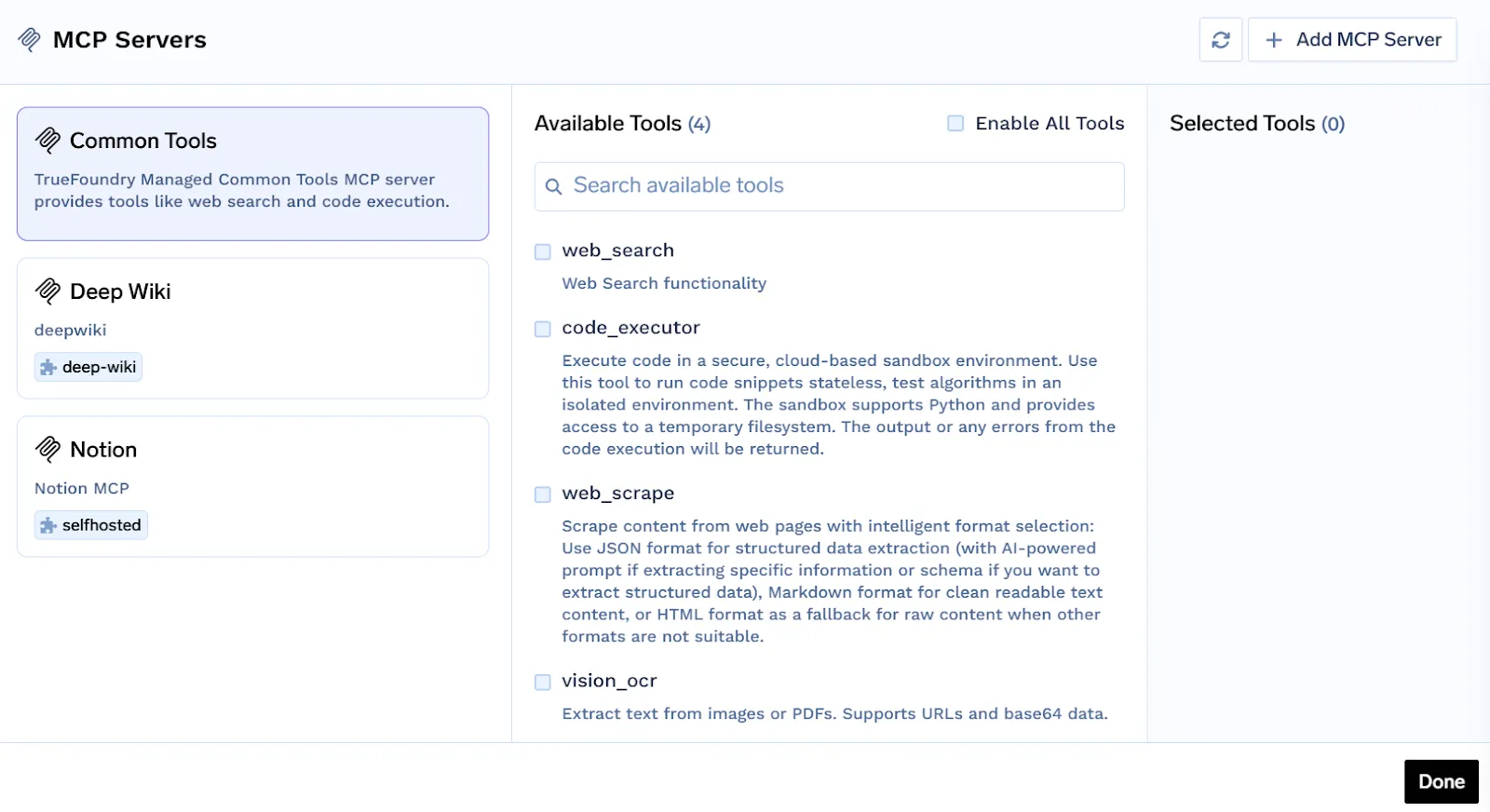

MCP y gestión rápida del ciclo de vida

El Registro de MCP y agentes mantiene una biblioteca estructurada de herramientas y API con validación de esquemas y controles de acceso detallados. En combinación con la gestión inmediata del ciclo de vida, los equipos pueden versionar, probar y supervisar las indicaciones para garantizar un comportamiento de los agentes coherente y auditable.

Para conocer el funcionamiento interno de un registro de agentes de IA, lee nuestra guía detallada sobre qué es un registro de agentes de IA.

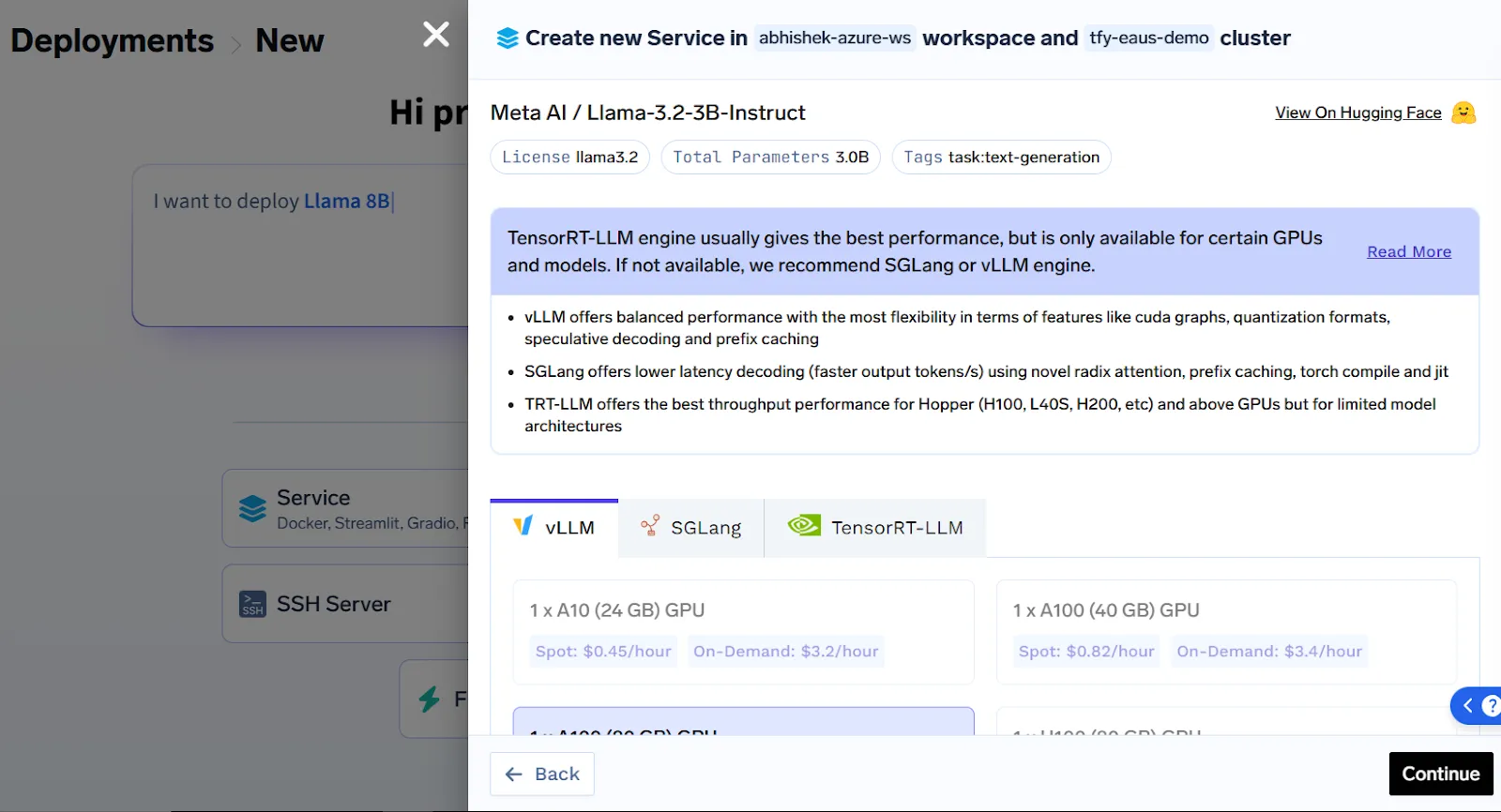

Implemente cualquier modelo, cualquier marco

Las empresas pueden alojar cualquier modelo de LLM o de incrustación mediante backends optimizados, como vLLM, TGI o Triton. La optimización está integrada en el flujo de trabajo para capacitarse con datos propios e implementar puntos de control actualizados. Los agentes basados en LangGraph, CrewAI, AutoGen o marcos personalizados son totalmente compatibles y se almacenan en contenedores para la producción.

Cumplimiento y observabilidad de nivel empresarial

TrueFoundry puede ejecutarse en entornos de VPC, locales, híbridos o aislados, lo que garantiza un control total de los datos. Cumple con SOC 2, HIPAA y GDPR y admite el SSO, el RBAC y el registro de auditoría inmutable. La observabilidad incluye el seguimiento completo de los agentes, la supervisión del uso de la GPU y la CPU, el estado de los nodos y el comportamiento de escalado. Las métricas se pueden integrar con Grafana, Prometheus o Datadog.

Optimizado para la escala y el costo

La plataforma proporciona Orquestación de GPU, compatibilidad con GPU fraccionadas y escalado automático en tiempo real para maximizar la utilización y minimizar los costos. Empresas como NVIDIA reportan una mejora de hasta un 80 por ciento en la eficiencia de los clústeres de GPU gracias a los flujos de trabajo automatizados y agenciales de TrueFoundry.

Al unificar la orquestación, el despliegue, el cumplimiento y la observabilidad, TrueFoundry ofrece una plataforma empresarial completa para crear y escalar la IA agencial con confianza.

Mientras que Kong AI gobierna el tráfico de la API, TrueFoundry gobierna el ciclo de vida completo de la IA , desde la prestación de modelos hasta la supervisión de agentes, lo que lo hace ideal para despliegues de nivel empresarial.

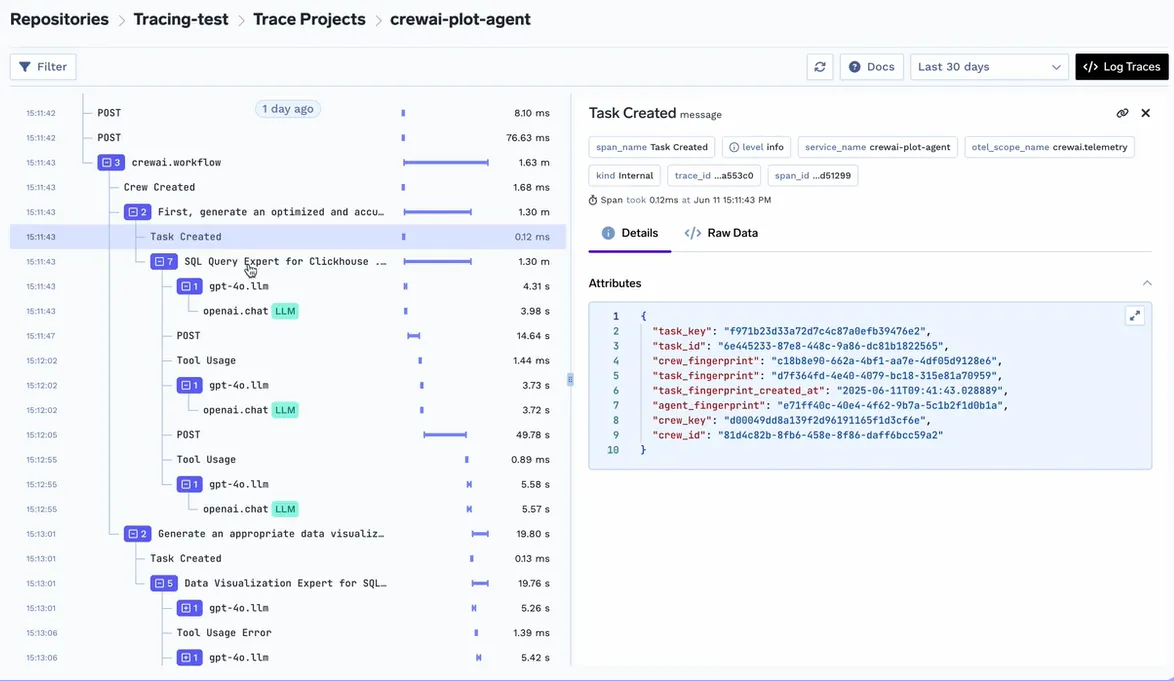

2. Litell M

LitellM es una plataforma ligera que permite a los desarrolladores gestionar, supervisar y optimizar las solicitudes de LLM en entornos de producción. Se centra en el almacenamiento en caché semántico y en el uso eficiente de los tokens para reducir los costos operativos. LitellM proporciona una observabilidad detallada, que incluye el registro de solicitudes, el seguimiento de la latencia y las métricas de rendimiento.

Es compatible con varios proveedores de LLM, como OpenAI, Anthropic y Google Gemini, y ofrece flexibilidad para aplicaciones multimodelo. Su arquitectura apta para contenedores permite un despliegue y un escalado rápidos sin necesidad de administrar una infraestructura pesada. La plataforma es ideal para los equipos que buscan una forma sencilla pero eficaz de estandarizar las operaciones de IA.

Características principales:

- API unificada para varios proveedores de LLM

- Almacenamiento en caché semántico para reutilizar las respuestas y reducir los costos

- Registro de solicitudes y seguimiento de métricas de rendimiento

- Despliegue sencillo en entornos contenerizados

- Soporta OpenAI, Anthropic, Google Gemini y otros

Si necesita diferentes características o escalas, puede explorar algunas alternativas a LitellM.

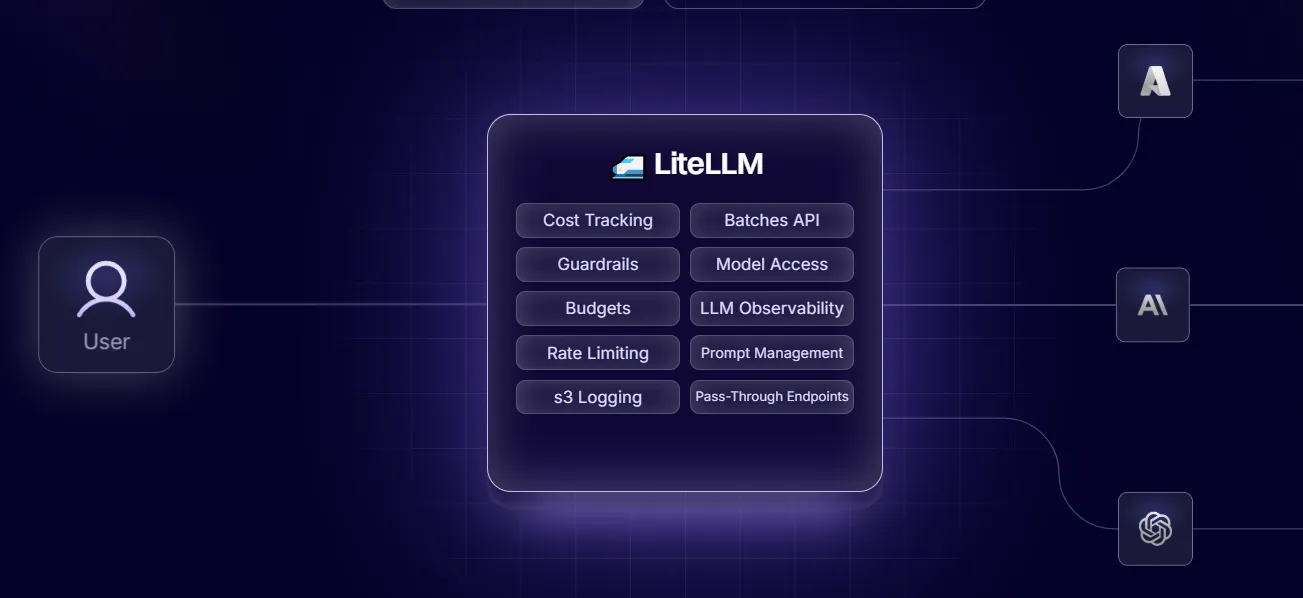

3. AWS Bedrock

AWS Bedrock es un servicio de inteligencia artificial totalmente administrado diseñado para ayudar a las empresas a crear aplicaciones utilizando modelos básicos sin tener que administrar la infraestructura subyacente. Proporciona acceso a varios modelos, incluidos Anthropic, AI21 y Amazon Titan. La plataforma garantiza la seguridad y la conformidad de nivel empresarial, al integrarse a la perfección con las herramientas de identidad y supervisión de AWS. Bedrock simplifica la experimentación con varios modelos al proporcionar enrutamiento, registro y monitoreo de costos centralizados. Está optimizado para cargas de trabajo e implementaciones de producción a gran escala, lo que permite a los desarrolladores centrarse en el desarrollo de aplicaciones de inteligencia artificial en lugar de en la gestión de la infraestructura.

Características principales:

- Acceso a los modelos básicos de Anthropic, AI21, Amazon Titan y más

- Infraestructura totalmente gestionada para cargas de trabajo de IA

- Administración integrada de seguridad, cumplimiento e identidad

- Experimentación multimodelo con información sobre costos y rendimiento

- Integración sencilla con el ecosistema y las herramientas de análisis de AWS

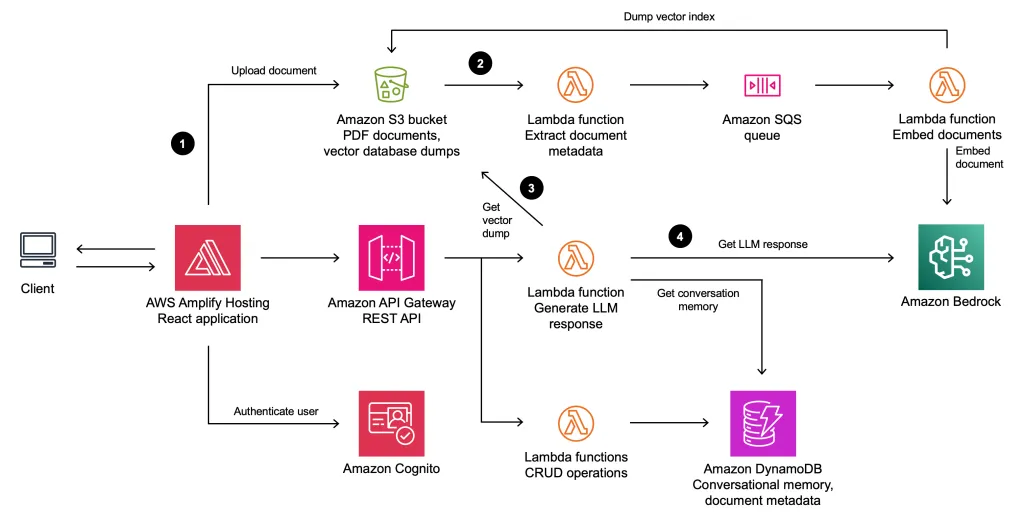

4. Azure AI Foundry

Azure AI Foundry es la plataforma nativa de la nube de Microsoft para implementar, supervisar y administrar aplicaciones de IA. Proporciona acceso seguro al servicio Azure OpenAI y a los modelos personalizados, al tiempo que ofrece un control centralizado de las cargas de trabajo de IA. La plataforma garantiza el cumplimiento empresarial de los estándares SOC 2, HIPAA y GDPR.

Azure AI Foundry incluye funciones de observabilidad, como el seguimiento rápido y por token, la supervisión de la latencia y el análisis de uso. Las opciones de implementación híbrida permiten a las organizaciones ejecutar cargas de trabajo de forma local, en la nube o en varias regiones. Es ideal para las empresas que necesitan una infraestructura de IA segura, escalable y preparada para la gobernanza.

Características principales:

- Soporta Azure OpenAI Service y LLM personalizados

- Gobernanza y control de acceso centralizados para las cargas de trabajo de IA

- Observabilidad y telemetría para modelos e indicaciones

- Soporte de implementación híbrida y multinube

- Cumplimiento empresarial con SOC 2, HIPAA y GDPR

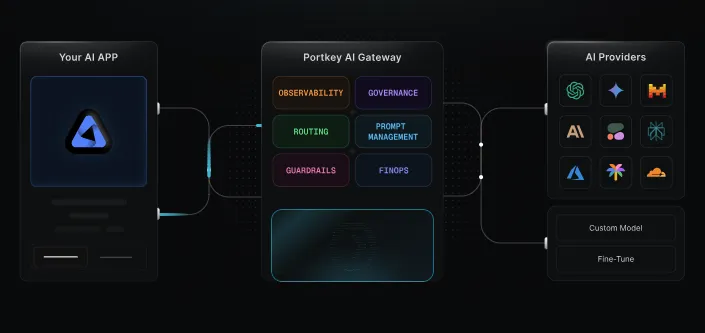

5. Portkey

Portkey es una puerta de enlace de inteligencia artificial dedicada diseñada para preparar la producción de modelos de lenguaje grande (LLM) al centrarse en el enrutamiento «inteligente» y la observabilidad profunda. Si bien Kong AI aborda el problema desde una perspectiva tradicional de administración de API, Portkey está diseñado de forma nativa para la capa de aplicación, lo que brinda a los desarrolladores un control detallado sobre las solicitudes, los tokens y el comportamiento de los modelos.

Para los equipos que necesitan optimizar los costos sin sacrificar el rendimiento, el almacenamiento en caché semántico y el equilibrio de carga de solicitudes de Portkey ofrecen una alternativa ligera pero potente a las puertas de enlace empresariales más pesadas.

Características principales:

- Enruta las solicitudes de forma dinámica en función de la latencia, el costo, el nivel de usuario o la complejidad inmediata

- Reduce los costos y la latencia al almacenar en caché las respuestas para consultas semánticamente similares

- Garantiza una alta disponibilidad con reintentos y conmutaciones por error automatizados para los proveedores que fallan

- Proporciona una observabilidad detallada del uso, los costos y la latencia de los tokens para cada solicitud

¿Cómo elegir la puerta de enlace de IA adecuada?

La elección de una alternativa a Kong AI depende de su infraestructura específica y de la complejidad de sus aplicaciones de IA. Usa estas tres preguntas para enmarcar tu decisión:

1. ¿Dónde deben estar sus datos?

- Cumplimiento estricto (VPC/local): Si maneja datos confidenciales (como la atención médica o las finanzas) y exige cumplir con el GDPR/HIPAA, priorice las plataformas que ofrecen un despliegue autohospedado o «trae tu propia nube».

- Velocidad y facilidad (SaaS/nativo de la nube): Si su prioridad es un desarrollo rápido y no tiene restricciones estrictas de residencia de datos, las soluciones de nube gestionada o las pasarelas de SaaS ligeras le permitirán avanzar más rápido con menos mantenimiento.

2. ¿Administra las API o los agentes?

- Enrutamiento API básico: Si solo necesita enviar mensajes de texto a modelos como el GPT-4, busque pasarelas centradas en la latencia, el almacenamiento en caché y el control de costos.

- Flujos de trabajo de agencia: Si está creando agentes autónomos que utilizan herramientas, memoria y razonamiento de varios pasos, necesita una plataforma que ofrezca un «rastreo de agentes» y una capacidad de observación profundos, no solo un simple registro de API.

3. ¿Qué importancia tiene la neutralidad de los proveedores?

- Flexibilidad multimodelo: Si quieres cambiar entre los modelos OpenAI, Anthropic y de código abierto para encontrar el mejor precio, elige una puerta de enlace independiente que agrupe a estos proveedores en una sola API.

- Integración de ecosistemas: Si todo su paquete ya está en un proveedor de nube importante (como AWS o Azure), el uso de su puerta de enlace de IA nativa puede reducir los problemas de integración, incluso si limita sus opciones de modelo.

Conclusión

Kong AI Gateway es una potente solución para gestionar el tráfico de IA, garantizar la seguridad y proporcionar observabilidad en entornos de varios LLM. Sin embargo, las organizaciones tienen necesidades diversas, desde un enrutamiento ligero y multimodelo hasta la orquestación y el cumplimiento de nivel empresarial.

Plataformas como TrueFoundry, LitellM, AWS Bedrock y Azure AI Foundry ofrecen alternativas que abordan brechas específicas, como el rastreo de agentes, la administración rápida del ciclo de vida y la optimización de la GPU. La elección de la plataforma adecuada depende de la escala, la flexibilidad de la implementación y los requisitos de gobierno. La exploración de estas alternativas garantiza que los equipos puedan crear aplicaciones de inteligencia artificial confiables, eficientes y seguras que se adapten a sus objetivos operativos y comerciales.

¿Está listo para ir más allá de las pasarelas de API básicas? Cambie a TrueFoundry para obtener una plataforma unificada que gobierne todo el ciclo de vida de la IA, desde la implementación eficiente de modelos y la organización de la GPU hasta la observabilidad integral por parte de los agentes. Reserva una demostración hoy mismo para escalar las operaciones de IA de su empresa con confianza.

Preguntas frecuentes sobre las alternativas de Kong AI

¿Cuál es la mejor alternativa a Kong AI?

Si está buscando una alternativa sólida a Kong, TrueFoundry ofrece una plataforma unificada para grandes empresas. A diferencia de una herramienta de administración de API estándar, gestiona los modelos de aprendizaje automático y el enrutamiento del tráfico con opciones de implementación flexibles, lo que mejora la gestión del ciclo de vida de la IA mucho mejor que las simples pasarelas.

¿Kong es una buena puerta de entrada a la IA?

Si bien la puerta de enlace de API de Kong proporciona políticas sólidas de control del tráfico, limitación de velocidad y seguridad, muchos buscan una alternativa a KongHQ para la IA. Mientras que Kong AI controla el tráfico de las API, TrueFoundry controla todo el ciclo de vida de la IA, desde la entrega de modelos hasta la supervisión de los agentes, por lo que es ideal para despliegues de nivel empresarial.

¿Qué es similar a Kong Gateway?

Al evaluar las alternativas de Kong Gateway, encontrará opciones de código abierto como Apache APISIX y Gloo Edge. Para los usuarios de la nube, AWS API Gateway (en Amazon Web Services) y Azure API Management (en Microsoft Azure) ofrecen seguridad de API y administración de acceso, pero TrueFoundry simplifica todo el ciclo de vida de la IA.

¿Quiénes son los competidores de Kong AI Gateway?

Entre los principales competidores de Kong se encuentran Red Hat y Google Cloud, que impulsan la transformación digital. Plataformas como la plataforma Anypoint de MuleSoft se centran en la monetización y el análisis de las API. Sin embargo, para las complejas necesidades de integración en el mundo de la gestión del ciclo de vida de la IA, TrueFoundry proporciona una plataforma superior de nivel empresarial.

¿Gloo Gateway es equivalente a Kong Gateway?

Gloo es un fuerte competidor de KongHQ que ofrece funciones de seguridad y aplicación de políticas para las claves de API. Si bien Gloo cuenta con características únicas, Kong prioriza la facilidad de uso. TrueFoundry equilibra ambas, ya que evita una curva de aprendizaje pronunciada y, al mismo tiempo, apoya las mejores prácticas para un uso de nivel empresarial.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)