Del navegador al mensaje: creación de infraestructura para la Internet de las agencias

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Los agentes de IA están cambiando la forma en que los humanos interactúan con la web. Hace dos años, trabajar en línea significaba abrir un navegador, navegar a sitios web y completar las tareas manualmente. En la actualidad, los agentes de IA se encargan de ello de forma autónoma basándose en instrucciones en lenguaje natural.

En lugar de abrir Chrome para reservar un vuelo, le dices a un agente: «Encuéntrame el vuelo más barato a Tokio el viernes que viene» y él se encarga de todo. Este paso de la navegación guiada por humanos a la ejecución rápida lo denominamos internet agencial.

La mayoría de las organizaciones no están preparadas para ello. Estudio 2025 de Deloitte descubrió que solo el 14% tiene soluciones de IA de agencia listas para la producción. La brecha no es un problema de capacidad del modelo; es un problema de infraestructura.

¿Qué significa «Browser to Prompt»?

La interacción web tradicional sigue un patrón predecible. Un humano abre un navegador, navega hasta una URL, interpreta visualmente la página y realiza acciones.

Considere un flujo de trabajo empresarial típico. Abre Salesforce y busca un registro de clientes. Revisa su historial de pedidos y, a continuación, abre Zendesk en otra pestaña para crear un ticket de soporte. Copias manualmente la información entre sistemas y abres Slack para avisar a un colega. Pasan diez minutos. Ocurren quince clics. Permanecen abiertas tres pestañas del navegador.

Ejecución rápida

Con la ejecución rápida, escribes: «Crea un ticket de soporte para Acme Corp sobre el retraso en el envío e incluye sus tres últimos pedidos».

El agente se conecta a Salesforce mediante MCP, recupera los datos de los clientes, abre Zendesk a través de otro servidor MCP, crea el ticket y rellena todos los campos automáticamente. Un mensaje reemplaza docenas de clics. Sin embargo, para que esto funcione en la producción se requiere una infraestructura que los sistemas tradicionales no proporcionan.

Por qué la infraestructura tradicional se queda corta

La ejecución de agentes de IA a escala introduce requisitos para los que los sistemas existentes nunca se diseñaron.

Administración de sesiones y estados

La automatización tradicional de los navegadores funciona sin estado: cada ejecución de script comienza de cero. Los agentes requieren lo contrario. Un agente de IA que complete un flujo de trabajo de varios pasos debe mantener el contexto en las múltiples interacciones del sistema, autenticarse una vez y realizar docenas de llamadas a herramientas para esa sesión.

Detección de antibots

Todos los sitios web importantes implementan medidas para bloquear el acceso automatizado, incluidos los desafíos de CAPTCHA, la toma de huellas dactilares del navegador y el análisis del comportamiento. Herramientas de automatización estándar, como Titiritero y dramaturgo se detectan de inmediato porque dejan firmas de automatización obvias.

Complejidad de la orquestación de herramientas

Un agente de IA llama a las API, consulta las bases de datos, envía mensajes de Slack, crea tickets de Jira y actualiza los registros de CRM. Tradicionalmente, cada integración requiere flujos de autenticación personalizados, un formato de solicitud/respuesta, gestión de errores y lógica de reintento. Sin la estandarización, los equipos dedican el 80% de su tiempo a la integración.

Desafíos de observabilidad

Cuando un agente de IA falla, la causa puede estar en cualquier parte. Es posible que el modelo haya malinterpretado la tarea. Es posible que el diseño de la página web haya cambiado. Es posible que una API haya devuelto una respuesta inesperada. Es posible que un token de autenticación haya caducado. Sin un rastreo de extremo a extremo, la depuración resulta casi imposible.

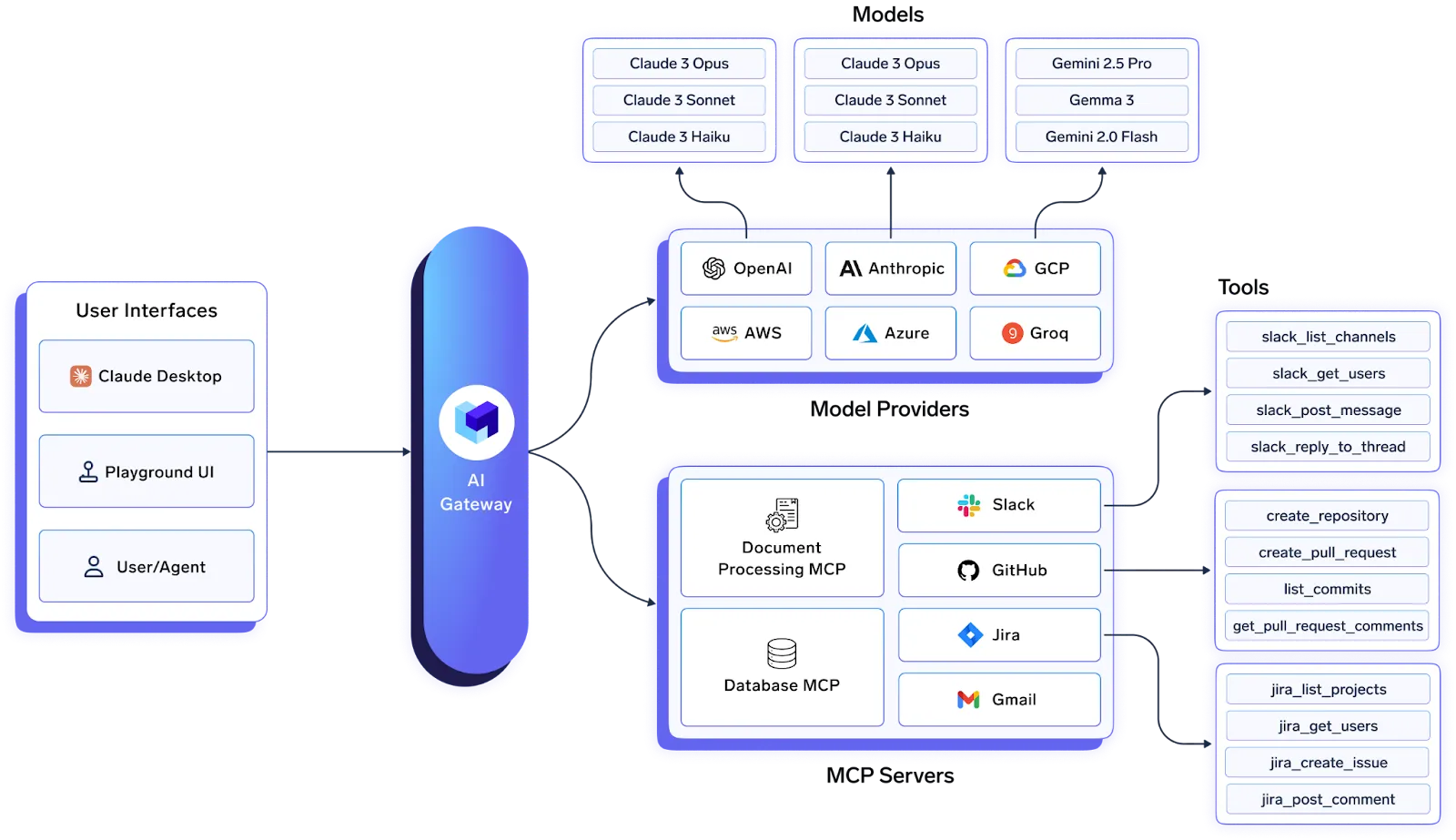

MCP: el protocolo estándar para la comunicación entre agente y herramienta

Anthropic presentó el Protocolo de contexto modelo (MCP) para resolver el problema de integración de herramientas. En lugar de escribir código personalizado para cada sistema, los desarrolladores empaquetan herramientas en servidores MCP que exponen las capacidades a través de una interfaz JSON-RPC estandarizada.

Cómo funciona el MCP

Cuando un agente se conecta a un servidor MCP, realiza un protocolo de enlace de detección. El agente envía una solicitud de «inicialización» y el servidor responde con las capacidades y la versión del protocolo. A continuación, el agente llama a `tools/list` para descubrir las herramientas disponibles y el servidor devuelve los esquemas de herramientas con parámetros y descripciones.

El agente aprende qué herramientas están disponibles en tiempo de ejecución, sin necesidad de programar. Los principales proveedores de IA, incluidos Anthropic, OpenAI y Microsoft, han adoptado MCP.

Sin embargo, el MCP solo maneja solo la capa de protocolo. Los sistemas de producción necesitan una infraestructura adicional para la autenticación, controles de acceso, límite de velocidad, y registro de auditoría.

El patrón Gateway para la IA de las agencias de producción

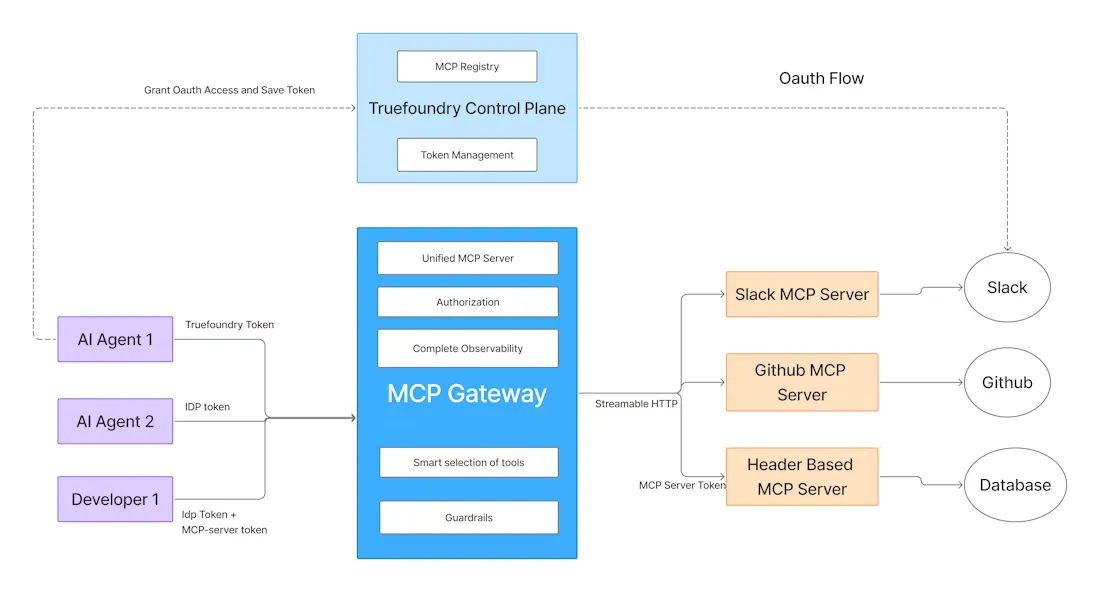

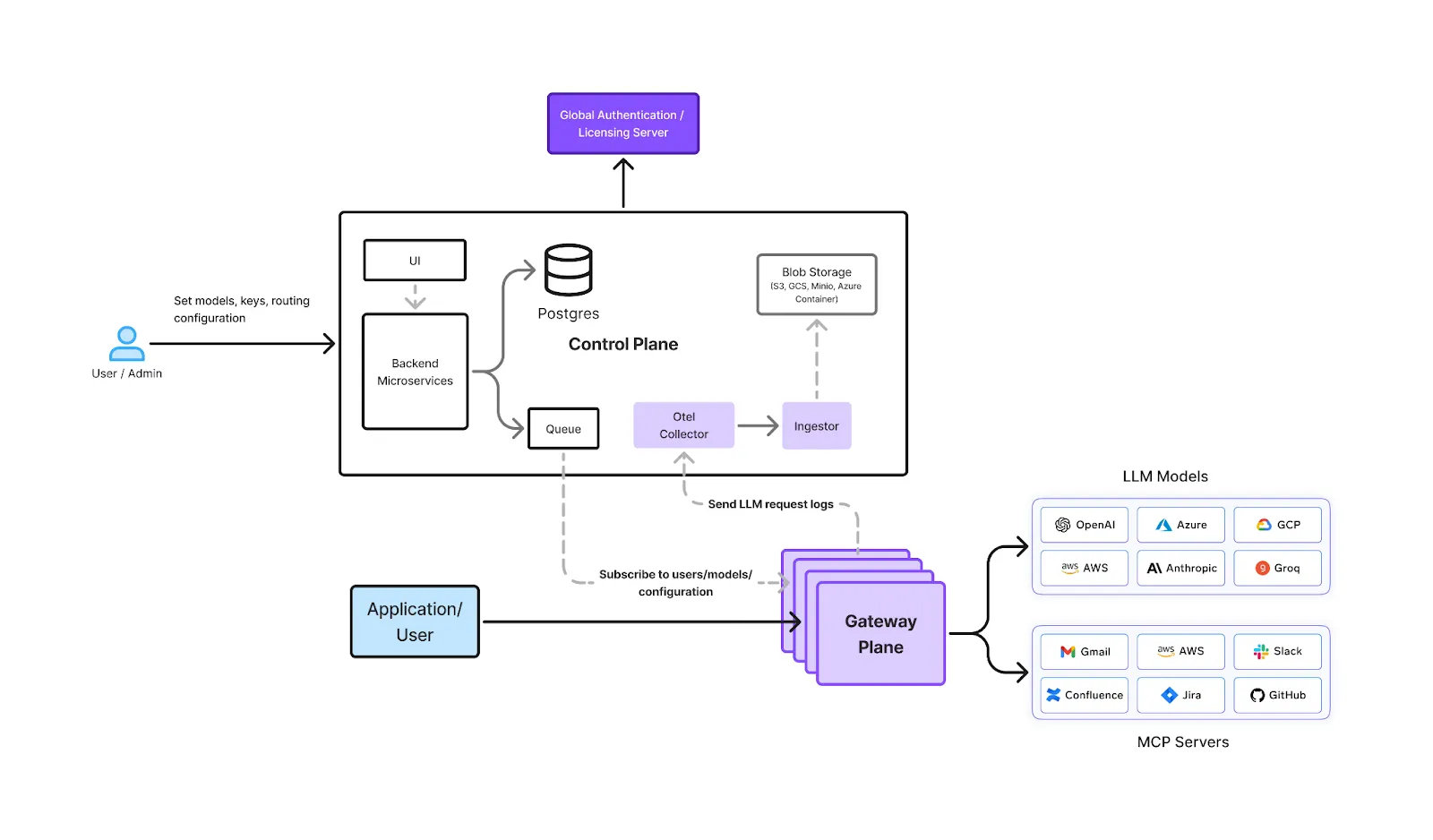

Las implementaciones de producción requieren una puerta de enlace entre los agentes de IA y las herramientas de backend. La puerta de enlace proporciona un plano de control centralizado para gestionar todas las interacciones entre el agente y la herramienta.

Capacidades principales de gateway

Una puerta de enlace diseñada correctamente gestiona la autenticación unificada, en la que los agentes se autentican una vez y la puerta de enlace administra todas las credenciales de backend. Proporciona una aplicación centralizada de las políticas mediante límites de velocidad, RBAC y barandas. La puerta de enlace garantiza la confiabilidad mediante la conmutación por error automática, los reintentos con un retroceso exponencial y equilibrio de carga. También ofrece observabilidad a través de trazas completas Telemetría abierta y atribución de costos por equipo.

Cómo permite TrueFoundry la ejecución rápida

La puerta de enlace de IA de TrueFoundry proporciona la capa de infraestructura para la IA de las agencias de producción. Combina el enrutamiento de la LLM, la administración de servidores MCP y el gobierno de los agentes en un plano de control unificado.

Registro MCP centralizado

El Puerta de enlace MCP ofrece un registro centralizado para todos los servidores MCP: herramientas internas, servicios de terceros, aplicaciones locales o alojadas en la nube. Puede organizar los servidores en grupos como `dev-mcps`, `staging-mcps` y `prod-mcps` con reglas de RBAC independientes para cada entorno. Los agentes se autentican una vez y descubren automáticamente todas las herramientas disponibles. La pasarela almacena las credenciales en su almacén secreto y gestiona la actualización de los tokens.

Integraciones prediseñadas

TrueFoundry incluye integraciones de servidores MCP para Slack, GitHub, Confluence, Sentry y Datadog. También puedes registrar API internas personalizadas en cuestión de minutos. Consulte el Documentación de los servidores MCP para obtener detalles sobre la implementación.

Área de juegos AI Gateway

El Área de juegos AI Gateway permite a los desarrolladores crear prototipos de flujos de trabajo antes de la implementación. Puede agregar servidores MCP, seleccionar herramientas específicas, ejecutar instrucciones en lenguaje natural y observar cada llamada y respuesta de cada herramienta en tiempo real. El campo de juego también genera fragmentos de código listos para la producción en NodeJS, cURL y más.

Observabilidad empresarial

Incrustaciones de TrueFoundry Rastreo compatible con OpenTelemetry en toda la puerta de entrada. Todas las solicitudes incluyen detalles a nivel de solicitud, con metadatos de rango, seguimientos paso a paso de la ejecución de los agentes, métricas de latencia de 50, 95 y 99, y un desglose de los costos con atribución por equipo o aplicación. La puerta de enlace gestiona más de 350 RPS en una sola vCPU con una latencia inferior a 3 ms mediante el procesamiento de la autenticación y la limitación de la velocidad en memoria.

Seguridad y cumplimiento

La plataforma proporciona RBAC a nivel de herramienta mediante Configuración de control de acceso, barandas de validación de entrada/salida para una inyección rápida, PII y toxicidad, y OAuth 2.0 integración con Okta, Azure AD o IdP personalizados. TrueFoundry admite la implementación en entornos de VPC, locales, aislados y multinube, al tiempo que cumple con el SOC 2, la HIPAA y la Ley de Inteligencia Artificial de la UE.

La brecha de infraestructura es real

Gartner predice más del 40% de los proyectos de IA de agencia se cancelarán en 2027 porque la infraestructura no está lista. Informes de IBM que el 99% de los desarrolladores empresariales están explorando los agentes de IA, pero la mayoría sigue incorporando la IA a sistemas que nunca se diseñaron para una ejecución autónoma. Los equipos que tienen éxito tratan la infraestructura como una inversión en plataformas, no como una preocupación específica de un proyecto. Primero construyen el plano de control y luego escalan.

Conclusión

El cambio del navegador al indicador cambia radicalmente la forma IA agencial en la empresa ejecutará el trabajo en todos los sistemas. En lugar de navegar fácilmente por las interfaces, los agentes de IA ejecutan flujos de trabajo complejos basándose en instrucciones en lenguaje natural.

Construir la infraestructura para esta transición requiere resolver problemas para los que los sistemas tradicionales nunca fueron diseñados. Se necesita la administración de sesiones para que los flujos de trabajo estén en estado, la orquestación de herramientas sin código personalizado, la capacidad de observación del comportamiento no determinista y los controles de seguridad para los sistemas autónomos.

La puerta de enlace de IA de TrueFoundry aborda estos desafíos a través de un plano de control unificado que combina el enrutamiento LLM, Administración de servidores MCP, y gobierno de los agentes. Los equipos de ingeniería pueden pasar de los flujos de trabajo basados en el navegador a la automatización rápida sin tener que reconstruir toda su infraestructura.

Preguntas frecuentes

1. ¿Cuál es la diferencia entre la automatización del navegador y la navegación por agencia?

Las herramientas como Puppeteer requieren instrucciones explícitas para cada acción. La navegación por agencias utiliza la inteligencia artificial para interpretar los objetivos del lenguaje natural y determinar las acciones de forma autónoma en función de la comprensión visual.

2. ¿Por qué los agentes de IA necesitan una puerta de enlace?

Las conexiones directas crean una proliferación de credenciales, una lógica de reintento duplicada y no hay visibilidad del comportamiento de los agentes. Una puerta de enlace centraliza la autenticación, aplica las políticas y rastrea cada interacción.

3. ¿Qué es MCP?

El protocolo de contexto modelo define la forma en que los agentes de IA descubren e invocan las herramientas a través de una interfaz JSON-RPC coherente. Los agentes aprenden las herramientas disponibles en tiempo de ejecución sin integraciones codificadas.

4. ¿En qué se diferencia MCP Gateway de TrueFoundry de las integraciones personalizadas?

TrueFoundry proporciona conectores prediseñados, registro unificado, RBAC centralizado, observabilidad de OpenTelemetry y un campo de juego interactivo. La construcción de una infraestructura equivalente lleva meses.

5. ¿Qué controles de seguridad se necesitan para la IA de las agencias de producción?

Las implementaciones de producción requieren un RBAC a nivel de herramienta, barreras de entrada para una rápida inyección y PII, validación de salida, integración de IdP empresariales y un registro de auditoría completo.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)