Las 6 mejores pasarelas de LLM en 2026

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

La IA en 2026 avanza rápidamente. Demasiado rápido. Los modelos son más rápidos cada trimestre. Semanalmente aparecen nuevos proveedores. Los precios oscilan como las criptomonedas. Y si no tienes cuidado, tu pila de IA se convierte en un desastre frágil y caro.

Es por eso que los equipos más inteligentes ya no se conectan directamente a los modelos; lo gestionan todo a través de una pasarela de LLM. Considéralo tu centro de mando de inteligencia artificial: una capa que unifica a los proveedores, reduce drásticamente la latencia, impone el cumplimiento y te brinda la capacidad de observación que necesitas para dormir por la noche.

Esta es la verdad: la pasarela que elija decidirá qué tan rápido puede enviar, qué tan confiables son sus sistemas y cuánto termina pagando. Elige la derecha y avanzarás con la velocidad de la frontera. Elige mal y te quedarás atrapado apagando incendios.

Así que la verdadera pregunta no es «¿Necesito una pasarela de LLM?» Es «¿Cuál me permitirá llegar hasta 2026?»

¿Por qué necesita Best LLM Gateway?

Construir con inteligencia artificial en 2026 ya no consiste en elegir el mejor modelo. La realidad es confusa: diferentes proveedores destacan en diferentes áreas, los modelos de precios cambian constantemente y ningún LLM domina todos los casos de uso. Lo que funciona para el chat hoy puede no ser suficiente para la generación de código del mañana. Aquí es donde un Puerta de enlace LLM marca la diferencia.

Una pasarela de LLM actúa como una capa intermedia inteligente entre sus aplicaciones y el mundo de los proveedores de modelos, que cambia rápidamente. En lugar de conectar su sistema directamente a cada API y ocuparse de integraciones personalizadas, problemas de rendimiento o la dependencia de un proveedor, se conecta a una puerta de enlace. A partir de ahí, obtiene flexibilidad, confiabilidad y control.

El rendimiento mejora porque la puerta de enlace puede enrutar automáticamente las solicitudes a la opción más rápida o rentable. La observabilidad viene integrada con información en tiempo real sobre los costos, la latencia y la calidad, a menudo impulsada por sistemas integrados Herramientas de observabilidad de LLM. El cumplimiento se vuelve más fácil, ya que los estándares de gobierno y seguridad de los datos se aplican de manera consistente. Y lo que es más importante, las pasarelas están preparadas para el futuro. Cuando llegue un nuevo modelo o proveedor, puede adoptarlo al instante sin tener que volver a crear su oferta.

En resumen, una pasarela de LLM mantiene ágil su estrategia de IA. Le permite experimentar sin problemas, escalar sin cuellos de botella y optimizar los costos sin comprometer el rendimiento.

A medida que se acelere la adopción de la IA, los verdaderos ganadores no solo serán quienes usen los LLM, sino también quienes los administren de manera inteligente. La puerta de entrada es donde reside esa sabiduría.

Cómo elegir la mejor pasarela de LLM

No todas las pasarelas se crean de la misma manera. Elegir la adecuada depende menos de funciones sofisticadas y más de qué tan bien se adapte a los objetivos, la escala y el flujo de trabajo de tu equipo. Piensa en ello como si estuvieras sentando las bases de tu pila de IA: la elección equivocada te ralentizará, mientras que la correcta potenciará silenciosamente todo lo que construyas.

Lo primero que hay que tener en cuenta es el rendimiento. Una buena puerta de enlace debe poder enrutar las solicitudes de manera inteligente, equilibrando la velocidad, la confiabilidad y el costo sin tener que realizar microgestiones. La latencia y el tiempo de actividad son importantes, especialmente cuando los usuarios esperan recibir respuestas en tiempo real.

Luego vienen la integración y la flexibilidad. Su puerta de enlace debe admitir varios proveedores, abrir API y facilitar la conmutación. Si te encierra en un solo ecosistema, volverás al punto de partida: dependerás del proveedor.

La observabilidad y el monitoreo son igualmente críticos. Busque paneles de control, seguimiento de costos e información sobre el uso. Sin ellos, está volando a ciegas y tendrá dificultades para optimizar o justificar el gasto.

La seguridad y el cumplimiento no pueden ser una idea de último momento. Ya sea que se trate del SOC2, el RGPD o el cifrado de nivel empresarial, la pasarela debe aplicar políticas coherentes en todos los proveedores.

En resumen, estos son los factores clave:

- Rendimiento: latencia, tiempo de actividad y eficiencia de enrutamiento

- Flexibilidad: soporte para múltiples proveedores e integración sencilla

- Observabilidad: información clara sobre los costos y el uso

- Seguridad: cumplimiento y protección de datos

La mejor pasarela de LLM es la que desaparece en segundo plano y te permite concentrarte en la construcción.

Las 6 mejores pasarelas de LLM en 2026

El mercado de pasarelas LLM se está calentando rápidamente. Están entrando nuevos jugadores, los ya establecidos evolucionan, y cada uno de ellos promete ser la capa más inteligente entre tú y el mundo de las modelos. Sin embargo, no todos ofrecen el mismo valor. Algunos se centran en la velocidad, otros en el control de los costos y algunos se inclinan en gran medida por el cumplimiento empresarial.

La puerta de enlace adecuada para usted depende de su caso de uso, ya sea que esté escalando un producto emergente, ejecutando cargas de trabajo empresariales o experimentando con modelos vanguardistas. A continuación se muestran seis de las puertas de enlace más destacadas de 2026, cada una de las cuales aporta un nivel diferente de rendimiento, flexibilidad y control.

1. True Foundry

TrueFoundry se destaca como una de las principales pasarelas de LLM en 2026, diseñada para empresas que necesitan una IA lista para la producción sin la complejidad habitual. Combina la orquestación, la gobernanza y la escalabilidad en una única plataforma, lo que facilita la implementación, la gestión y la optimización de los flujos de trabajo de LLM a gran escala.

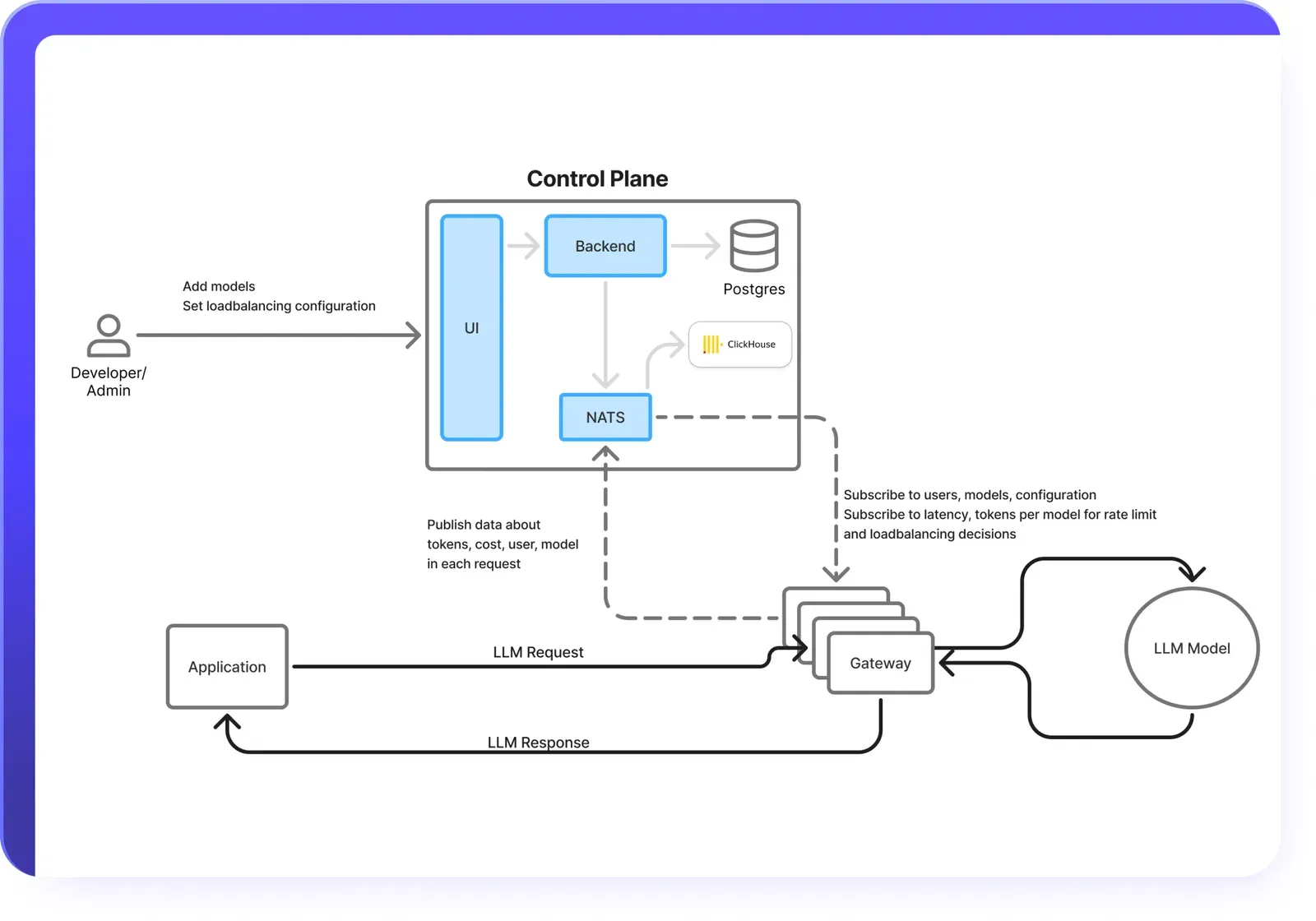

Orquestación inteligente: El LLM Gateway de TrueFoundry coordina los flujos de trabajo de los agentes en varios pasos, gestionando la memoria, la integración de herramientas y el razonamiento en todas las tareas. Esto garantiza que los agentes puedan planificar, actuar y adaptarse sin problemas, al tiempo que brinda a los equipos una visibilidad y un control totales.

Herramientas y gestión rápida del ciclo de vida: Con su MCP y su registro de agentes, TrueFoundry ofrece una biblioteca centralizada de API y herramientas con controles de acceso y validación de esquemas. La administración inmediata del ciclo de vida añade el control de versiones, las pruebas y la supervisión, lo que permite a las empresas mantener un comportamiento de los agentes coherente y auditable.

Despliegue flexible de modelos: TrueFoundry admite cualquier modelo de LLM o de incrustación, con backends optimizados como vLLM, TGI y Triton. También se integra con marcos como LangGraph, CrewAI y AutoGen, lo que permite ajustar con precisión los datos propios y desplegar agentes personalizados listos para la producción.

Cumplimiento y escalabilidad de nivel empresarial: La plataforma funciona en entornos seguros de VPC, locales, híbridos o aislados, y cumple con los estándares SOC 2, HIPAA y GDPR. La orquestación de la GPU, la compatibilidad con GPU fraccionadas y el escalado automático garantizan la rentabilidad, y algunas empresas afirman que utilizan la GPU hasta un 80% más.

TrueFoundry es una opción de primer nivel para las organizaciones que desean una puerta de enlace que equilibre la flexibilidad, la seguridad y la eficiencia operativa, lo que la hace ideal para despliegues de IA serios.

2. Helicone

Helicone es una puerta de enlace de inteligencia artificial de código abierto diseñada para desarrolladores que desean una solución ligera y de alto rendimiento para administrar varios proveedores de LLM. Construido en Rust y optimizado para despliegues periféricos, Helicone ofrece una API unificada que simplifica la integración y mejora la observabilidad.

Características principales

API unificada para varios modelos: Helicone proporciona una única API que funciona en docenas de LLM, incluidos GPT, Claude y Gemini, lo que elimina la necesidad de varios SDK o claves.

Enrutamiento y conmutación por error inteligentes: la puerta de enlace puede cambiar automáticamente de modelo, optimizar los costos y equilibrar la carga, lo que garantiza un rendimiento confiable en los diferentes proveedores.

Observabilidad integrada: los desarrolladores pueden supervisar en tiempo real las solicitudes y respuestas, el uso de los tokens, la latencia y los costos a través de un panel centralizado.

Límite de velocidad personalizado: los límites de velocidad específicos de la aplicación permiten un control preciso del uso y los gastos.

Rendimiento optimizado para bordes: Helicone está optimizado para despliegues periféricos, lo que minimiza la latencia y ofrece una sobrecarga muy baja incluso con cargas pesadas.

Limitaciones

Características empresariales limitadas: Helicone carece de controles de acceso avanzados basados en roles, registros de auditoría y una aplicación estricta de políticas, que pueden ser necesarios para los entornos regulados.

Soporte de integración básico: si bien es compatible con varios proveedores, aún no ofrece ecosistemas de modelos extensos ni integraciones avanzadas para configuraciones empresariales complejas.

Para los equipos que necesitan funciones empresariales adicionales, como un control de acceso avanzado o integraciones más amplias, considerar un Alternativa a Helicone puede ayudar a llenar esas brechas sin comprometer la simplicidad fácil de usar para los desarrolladores.

3. OpenRouter

OpenRouter es una puerta de enlace de inteligencia artificial centrada en los desarrolladores que proporciona acceso a varios modelos lingüísticos de gran tamaño a través de una sola API, lo que hace OpenRouter frente a puerta de enlace AI un punto de evaluación común para los equipos que prioriza la flexibilidad. Simplifica la integración y la administración, por lo que es ideal para los equipos que buscan flexibilidad y eficiencia.

Características principales

Acceso unificado a la API: Se conecta a múltiples LLM de proveedores como OpenAI, Anthropic y Google, lo que reduce la complejidad de administrar varios SDK.

Enrutamiento y respaldo automáticos: Las solicitudes se dirigen al mejor modelo en función del rendimiento, el costo y la disponibilidad, con respaldo automático en caso de errores.

Precios y facturación transparentes: Los precios claros por token y la facturación unificada simplifican la administración de costos.

Traiga su propia llave (BYOK): Permite usar claves de API personales para tener un mayor control sobre la autenticación y los costos.

Limitaciones

Límites de tarifa en los modelos gratuitos: Los modelos de nivel gratuito tienen límites estrictos, que pueden restringir las pruebas o el desarrollo.

Latencia bajo carga pesada: Los tiempos de respuesta pueden aumentar según el modelo y el tráfico.

Lea también: Requesty frente a OpenRouter

4. Portkey

Portkey es una pasarela de IA de código abierto diseñada para agilizar el acceso a más de 1600 modelos de IA, incluidos los modelos de lenguaje grande (LLM) y los modelos de visión, audio e imagen. Ofrece una API unificada que simplifica la integración y la administración, lo que la convierte en la opción ideal para los desarrolladores que buscan flexibilidad y eficiencia.

Características principales

Acceso unificado a la API: Portkey proporciona un único punto final de API que se conecta a numerosos modelos de IA de varios proveedores, lo que reduce la complejidad de administrar varios SDK y credenciales.

Enrutamiento y conmutación por error inteligentes: La plataforma dirige las solicitudes de forma inteligente al modelo más adecuado en función de factores como el costo, el rendimiento y la disponibilidad. En caso de fallas, recurre automáticamente a modelos alternativos, lo que garantiza una alta confiabilidad.

Observabilidad avanzada: Portkey ofrece monitoreo en tiempo real de las cargas útiles de solicitud/respuesta, el uso de tokens, las métricas de latencia y los costos, todo ello accesible a través de un panel centralizado.

Integración de barandas: La puerta de enlace se integra con Prisma AIRS y proporciona seguridad de inteligencia artificial en tiempo real para proteger las aplicaciones, los modelos y los datos de una amplia gama de amenazas.

Almacenamiento en caché y optimización de costos: Portkey implementa un almacenamiento en caché simple y semántico para reducir la latencia y ahorrar costos, lo que mejora la eficiencia de las operaciones de IA.

Limitaciones

Límites de tarifa en los modelos gratuitos: Los modelos de nivel gratuito están sujetos a límites de velocidad estrictos, lo que puede restringir el desarrollo y las pruebas para los usuarios que confían en los modelos gratuitos.

Complejidad para aplicaciones a pequeña escala: Si bien son ricas en funciones, las amplias capacidades de Portkey pueden ser más adecuadas para aplicaciones a gran escala, lo que podría introducir una complejidad innecesaria para proyectos más pequeños e incitar a los equipos a explorar alternativas a Portkey.

5. Litell M

LitellM es una puerta de enlace de IA de código abierto diseñada para simplificar el acceso a más de 100 modelos lingüísticos grandes (LLM) y otros servicios de IA. Ofrece una API unificada que permite a los desarrolladores integrar varios modelos de IA sin problemas, lo que la convierte en una opción atractiva para los equipos que buscan flexibilidad y eficiencia.

Características principales

Acceso unificado a la API: LitellM proporciona un único punto final de API para conectarse con múltiples LLM de proveedores como OpenAI, Azure, AWS Bedrock, Hugging Face y Google Vertex AI. Esta estandarización reduce la complejidad de administrar varios SDK y credenciales.

Gestión del presupuesto y de los límites de tarifas: La plataforma permite establecer presupuestos y límites de tarifas por usuario, equipo o clave de API. Esta función ayuda a controlar los costos y a garantizar un uso justo entre los diferentes usuarios y equipos.

Soporte de streaming: LitellM admite la transmisión de respuestas de los modelos, lo que permite la interacción en tiempo real y mejora la experiencia del usuario.

Registro y observabilidad: Se integra con herramientas como Prometheus, Datadog y S3/GCS para el registro y la supervisión, y proporciona información sobre los patrones de uso y las métricas de rendimiento.

Integración de barandas: LitellM admite la integración de barreras de protección para garantizar un uso seguro y compatible de la IA, con opciones para la aplicación de llamadas antes, después o durante la ejecución del modelo de llamadas.

Limitaciones

Control de acceso básico en versión de código abierto: La versión de código abierto ofrece funciones básicas de control de acceso. Las funciones avanzadas, como la autenticación de JWT y los registros de auditoría, están disponibles en la versión empresarial.

Posibles cuellos de botella en el rendimiento con cargas elevadas: Algunos usuarios han informado de una degradación del rendimiento debido a las altas tasas de solicitud, lo que indica posibles desafíos de escalabilidad en ciertos escenarios.

Explore también: Los 5 mejores Alternativas a LitellM en 2026

6. Unifique la IA

Unify AI es una pasarela de IA de código abierto diseñada para simplificar el acceso a una amplia gama de modelos lingüísticos grandes (LLM) y otros servicios de IA. Ofrece una API unificada que permite a los desarrolladores integrar varios modelos de IA sin problemas, lo que la convierte en una opción atractiva para los equipos que buscan flexibilidad y eficiencia.

Características principales

Acceso unificado a la API: Unify AI proporciona un único punto final de API para conectarse con varios LLM de proveedores como OpenAI, Anthropic y Google Vertex AI. Esta estandarización reduce la complejidad de administrar varios SDK y credenciales.

Enrutamiento de modelo dinámico: La plataforma dirige las solicitudes de manera inteligente al modelo más adecuado en función de factores como el costo, el rendimiento y la disponibilidad, lo que garantiza una utilización óptima de los recursos.

Observabilidad en tiempo real: Unify AI ofrece monitoreo en tiempo real de las cargas útiles de solicitud/respuesta, el uso de los tokens, las métricas de latencia y los costos, todo ello accesible a través de un panel centralizado.

Integración de barandas: La puerta de enlace se integra con Prisma AIRS y proporciona seguridad de inteligencia artificial en tiempo real para proteger las aplicaciones, los modelos y los datos de una amplia gama de amenazas.

Almacenamiento en caché y optimización de costos: Unify AI implementa un almacenamiento en caché simple y semántico para reducir la latencia y ahorrar costos, lo que mejora la eficiencia de las operaciones de IA.

Limitaciones

Límites de tarifa en los modelos gratuitos: Los modelos de nivel gratuito están sujetos a límites de velocidad estrictos, lo que puede restringir el desarrollo y las pruebas para los usuarios que confían en los modelos gratuitos.

Complejidad para aplicaciones a pequeña escala: Si bien son ricas en funciones, las amplias capacidades de Unify AI pueden ser más adecuadas para aplicaciones a gran escala, lo que podría introducir una complejidad innecesaria para proyectos más pequeños.

Cómo encontrar la mejor opción para sus necesidades

Elegir la pasarela de LLM adecuada no consiste solo en elegir la opción más popular, sino también en adaptar la plataforma a los objetivos, la escala y el flujo de trabajo de su equipo. Cada portal que hemos analizado tiene sus puntos fuertes, y la «mejor opción» depende de tus prioridades.

Si es una empresa emergente o un equipo pequeño, las opciones ligeras y de código abierto como Helicone o LitellM pueden resultar atractivas. Ofrecen bajos gastos generales, una integración rápida y una gran capacidad de observación sin requerir una infraestructura extensa o una gestión del cumplimiento normativo.

Para las empresas con flujos de trabajo complejos, TrueFoundry o Portkey proporcionan una sólida orquestación, un control de acceso detallado y funciones de cumplimiento. Permiten gestionar los agentes, versionar las solicitudes de información y aplicar barreras de seguridad, a la vez que optimizan los costes a gran escala.

Si su prioridad es la flexibilidad de los desarrolladores y el acceso multimodelo, las pasarelas como OpenRouter y Unify AI simplifican las integraciones con una sola API y un enrutamiento inteligente. Facilitan la experimentación con varios LLM y, al mismo tiempo, controlan la latencia y el uso.

En última instancia, la puerta de enlace adecuada equilibra el rendimiento, el costo, el cumplimiento y la escalabilidad para su caso de uso específico. Comience por mapear sus requisitos técnicos, la base de usuarios y el tráfico esperado, y luego evalúe cómo cada puerta de enlace se alinea con esas necesidades. La opción ideal es la que respalda el crecimiento, mantiene la infraestructura administrable y permite que su equipo se concentre en construir, no en combatir incendios.

Conclusión

La selección de la pasarela de LLM adecuada puede hacer que su estrategia de IA triunfe o fracase en 2026. Ya sea que priorice la velocidad, la rentabilidad, el cumplimiento o el acceso multimodelo, las pasarelas que hemos cubierto ofrecen soluciones para cada necesidad. TrueFoundry y Portkey destacan en cuanto a orquestación y seguridad de nivel empresarial, mientras que Helicone, LitellM, OpenRouter y Unify AI proporcionan una flexibilidad fácil de usar y una integración ligera para los desarrolladores. La clave es alinear su elección con su flujo de trabajo, escala y objetivos. Una puerta de enlace cuidadosamente elegida no solo simplifica la administración de modelos, sino que también permite a su equipo innovar más rápido, optimizar los recursos y ofrecer aplicaciones de inteligencia artificial con confianza.

Preguntas frecuentes

¿Qué pasarela de LLM es la mejor?

TrueFoundry es la mejor puerta de enlace de LLM para los equipos de IA empresariales que necesitan una infraestructura de LLM segura, escalable y lista para la producción. A diferencia de los proxies básicos, el AI Gateway de TrueFoundry está diseñado para la gobernanza, la confiabilidad y los despliegues a gran escala, lo que lo hace ideal para las organizaciones que ejecutan aplicaciones de IA de misión crítica.

¿Qué características debe buscar en la mejor pasarela de LLM?

Al elegir una pasarela de LLM, busque soporte para múltiples proveedores, enrutamiento y respaldo inteligentes, limitación de velocidad, almacenamiento en caché, análisis de uso detallados, seguimiento de costos, RBAC, administración segura de claves y una sólida capacidad de observación. Los equipos empresariales también deben priorizar los registros de auditoría, el control de acceso a nivel ambiental y la alta disponibilidad.

¿Cómo mejoran las pasarelas LLM el rendimiento y el costo de las aplicaciones de IA?

Las pasarelas LLM mejoran el rendimiento mediante el enrutamiento inteligente, los reintentos automáticos y el almacenamiento en caché de respuestas. Reducen los costos al permitir la selección de modelos en función de las compensaciones entre precio y rendimiento, imponiendo límites de tarifas y proporcionando visibilidad del uso en tiempo real para evitar gastos excesivos.

¿Qué hace que TrueFoundry sea la mejor pasarela de LLM?

TrueFoundry se destaca como la mejor puerta de enlace de LLM al proporcionar un plano de control unificado para la orquestación y la seguridad de los modelos. Integra la observabilidad en tiempo real con la conmutación por error automatizada, lo que garantiza una alta disponibilidad entre los proveedores. Su compatibilidad nativa con GPU y su RBAC de nivel empresarial permiten a las organizaciones ampliar la IA de producción y, al mismo tiempo, mantener una estricta residencia de datos y un cumplimiento estrictos.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)