Integración de Arize con TrueFoundry

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

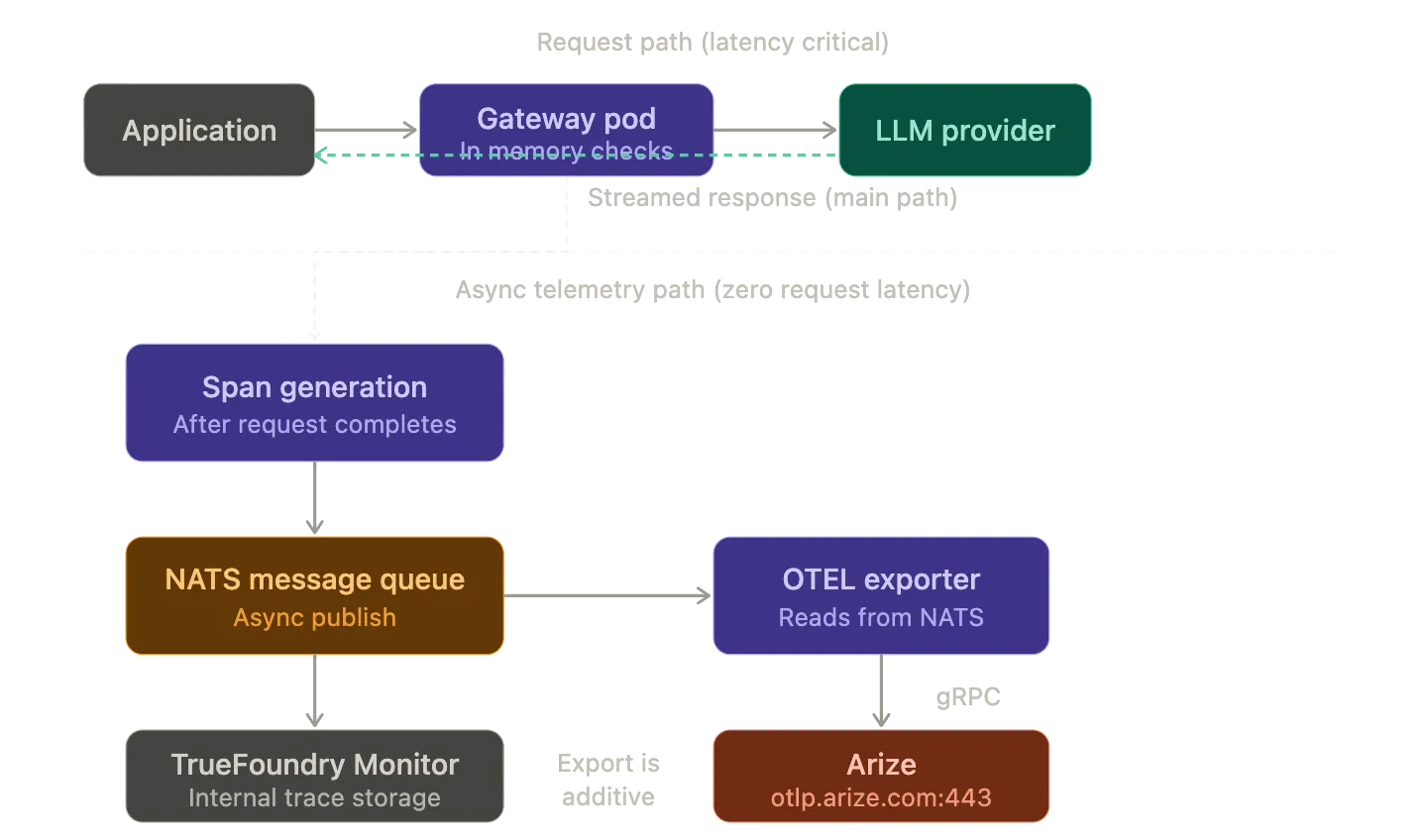

Cada solicitud de LLM que pasa por TrueFoundry AI Gateway genera un seguimiento. Ese rastreo captura el árbol completo de la solicitud: la gestión de la pasarela y la validación y autorización de JWT, la resolución y el enrutamiento del proveedor, y el modelo saliente de la llamada y la respuesta transmitida. Estos rastros se almacenan internamente para la interfaz de usuario de TrueFoundry Monitor. Pero también se pueden exportar a través de los protocolos estándar de OpenTelemetry a servidores de observabilidad externos. Arize es uno de esos backend.

Esta publicación explica cómo funciona la exportación de trazas a nivel de arquitectura: qué primitivas de OTEL están involucradas y cómo la puerta de enlace emite rastreos sin agregar latencia a la ruta de solicitud y qué hace Arize con los datos de rastreo una vez que llegan. También aborda el aspecto de la configuración y los controles de privacidad de los datos que permiten eliminar el contenido del mensaje antes de que abandone la infraestructura.

Observabilidad de OpenTelemetry y LLM

OpenTelemetry define un formato de cable independiente del proveedor para los seguimientos distribuidos. Una traza es un árbol de tramos conectados por relaciones entre padres e hijos. Cada intervalo representa una unidad de trabajo discreta: un controlador HTTP, una llamada de LLM o la invocación de una herramienta. Los intervalos contienen atributos de valores clave escritos que codifican el contexto operativo, como los códigos de latencia y estado y el recuento de tokens.

Las convenciones semánticas estándar de OTEL cubren bien los sistemas distribuidos de uso general, pero no se diseñaron para cargas de trabajo de LLM. Las llamadas de LLM incluyen entradas estructuradas (matrices de mensajes de varios turnos con indicaciones del sistema y definiciones de herramientas y contenido multimodal) y salidas estructuradas (finalizaciones con motivos de finalización y llamadas a funciones). La economía de los tokens es una métrica operativa de primera clase: los tokens rápidos y los tokens de finalización, así como los tokens almacenados en caché y los tokens de razonamiento, deben rastrearse por intervalo. Un solo valor de entrada el atributo de cadena es insuficiente.

Aquí es donde entran en juego las convenciones semánticas específicas de LLM. Arize mantiene la especificación OpenInference, que define un esquema de atributos concreto y una taxonomía de tipos de tramo además de los intervalos OTEL. Cada rastreo de OpenInference es un rastreo de OTLP válido. Las convenciones dan a los nombres de los atributos su significado específico para la IA. Tipos de Span como LLM y CADENA y PERRO PERDIGUERO y HERRAMIENTA y INCRUSTACIÓN clasifique las operaciones para que las plataformas de observabilidad puedan generar trazas con visualizaciones y agregaciones compatibles con la IA.

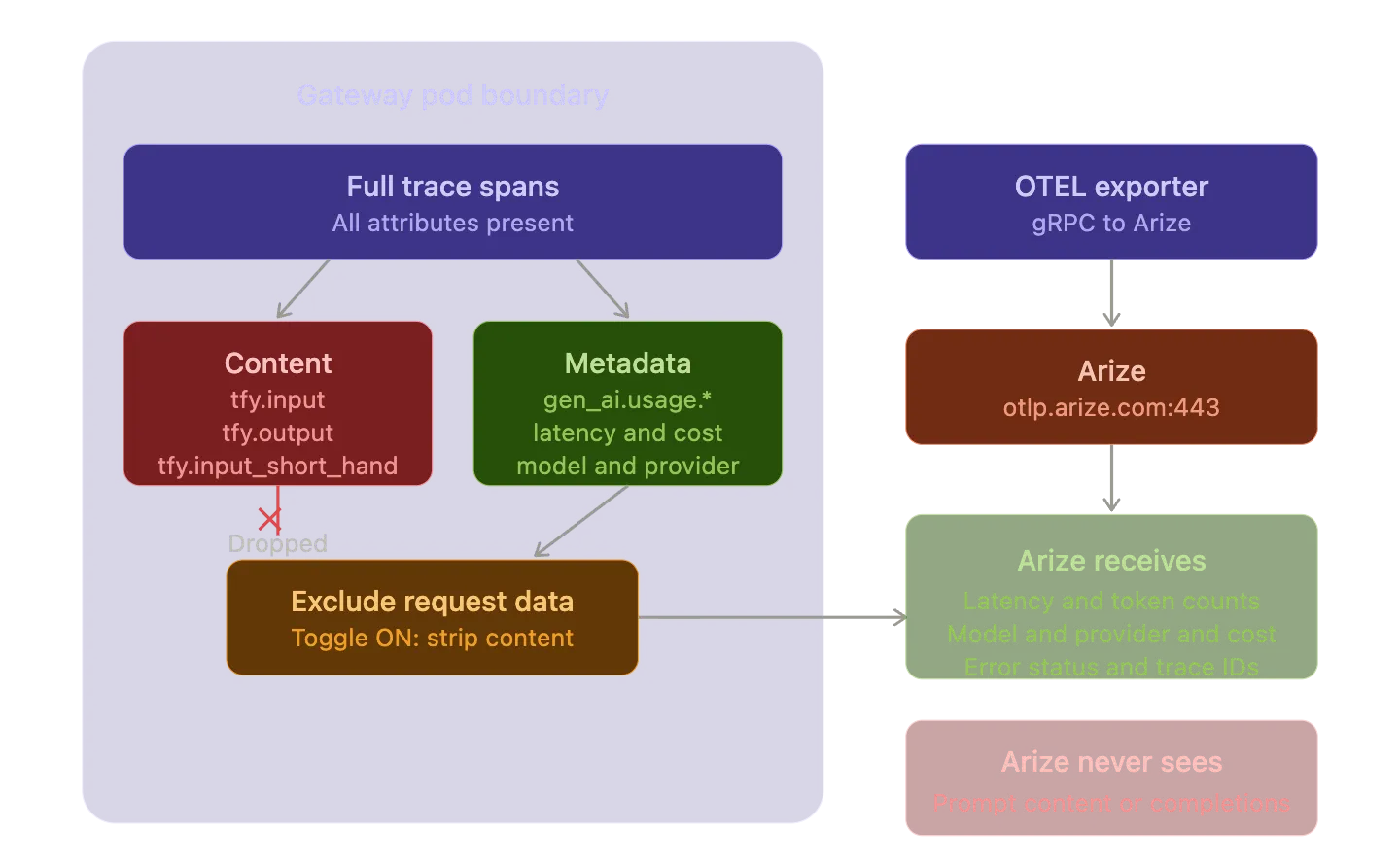

TrueFoundry AI Gateway emite trazas utilizando su propio espacio de nombres de atributos (entrada tfy. y tfy.output y tfy.input_short_hand junto con el estándar gen_ai. * atributos para el recuento de tokens y los metadatos del modelo y la finalización (motivos de finalización). Arize los ingiere como trazas OTLP válidas y asigna los atributos a su interfaz de usuario de rastreo.

Cómo la puerta de enlace genera trazas

TrueFoundry AI Gateway utiliza una arquitectura dividida: un plano de control que administra la configuración y un plano de puerta de enlace que procesa las solicitudes de inferencia. El plano de puerta de enlace se basa en el marco Hono, que es un tiempo de ejecución HTTP ultrarrápido y optimizado. Un único pod de puerta de enlace con 1 vCPU y 1 GB de RAM gestiona más de 250 solicitudes por segundo con aproximadamente 3 ms de latencia adicional.

El principio fundamental del diseño es que no hay llamadas externas en la ruta de solicitud, excepto la llamada real del proveedor de LLM. Cuando una solicitud llega a un pod de puerta de enlace, ocurre lo siguiente en su totalidad en la memoria:

- El pod valida el token JWT comparándolo con las claves públicas almacenadas en caché descargadas de tu IdP. Sin llamada de autenticación externa.

- Comprueba el mapa de autorización en memoria (sincronizado desde el plano de control mediante NATS) para verificar que el usuario tiene acceso al modelo solicitado.

- Resuelve el identificador del modelo en un punto final de proveedor específico. Si el modelo es un modelo virtual con reglas de enrutamiento, la pasarela aplica aquí una lógica de selección basada en la prioridad, el peso o la latencia.

- Un adaptador traduce la solicitud del formato compatible con OpenAI al formato nativo del proveedor de destino.

- La solicitud se reenvía al proveedor y la respuesta se devuelve al cliente.

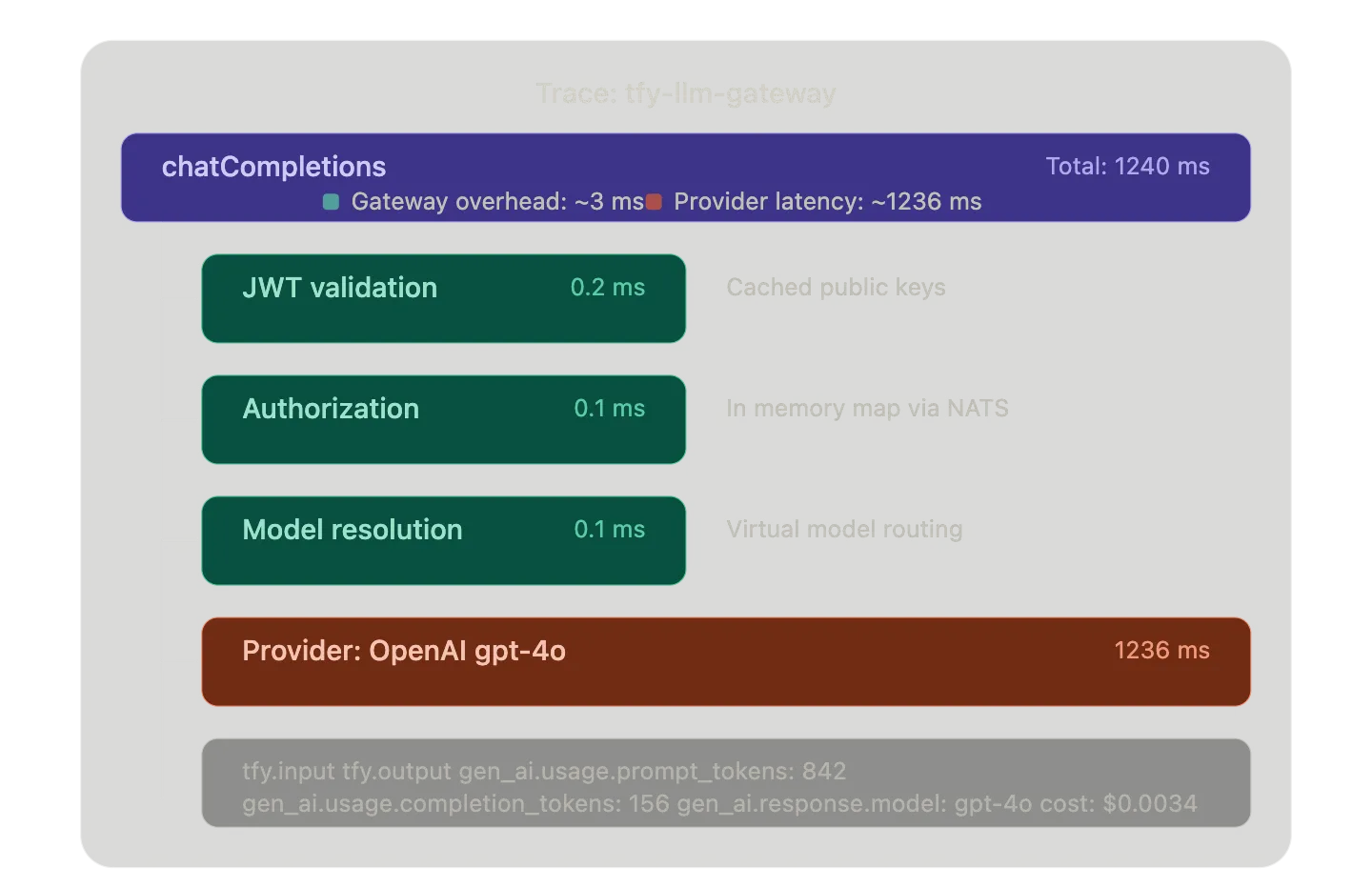

La generación de trazas se produce de forma asincrónica junto con este flujo. La pasarela crea intervalos OTEL para cada etapa del ciclo de vida de la solicitud: el controlador HTTP entrante y la comprobación de la autenticación, la resolución del modelo, la llamada saliente del proveedor y la respuesta de streaming. Estos intervalos incluyen atributos que capturan el uso y la latencia de los tokens, así como el nombre del modelo y el proveedor, así como la estimación del costo y los metadatos de la solicitud. Una vez finalizada la solicitud, la pasarela publica los datos de seguimiento en una cola de mensajes de NATS. Este es el mismo bus NATS que gestiona la sincronización de la configuración entre el plano de control y los módulos de la puerta de enlace.

El exportador OTEL recoge los datos de seguimiento de esta ruta asíncrona y los reenvía al punto final externo configurado. Como la exportación de trazas está desacoplada de la ruta de solicitud, no añade latencia a las solicitudes de inferencia. La puerta de enlace nunca falla en una solicitud, incluso si no se puede acceder al punto final externo de OTEL.

Qué hace Arize con las huellas

Arize es una plataforma de evaluación y observabilidad de IA creada específicamente para cargas de trabajo de agentes y LLM. Acepta trazas de OTEL sobre gRPC en otlp.arize.com: 443 y proporciona varias capas de análisis además de los datos de rastreo sin procesar.

Visualización de trazas. Arize representa cascadas con trazos completos que muestran el árbol de envergadura de cada solicitud. Puede inspeccionar los intervalos individuales para ver el uso de los tokens y el desglose de la latencia, así como el contenido de entrada y salida y los metadatos del modelo. En el caso de los flujos de trabajo de los agentes en los que una solicitud de un solo usuario desencadena varias llamadas de LLM e invocaciones de herramientas, esta vista en cascada permite leer la ruta de ejecución.

Análisis de rendimiento. Arize calcula métricas agregadas en todo su flujo de rastreo: distribuciones de latencia por modelo y por proveedor y tasas de error según el tiempo y las tendencias de rendimiento. Puede configurar reglas de alerta para que se activen cuando aparezcan anomalías en estas distribuciones. Esto es útil para detectar la degradación de los proveedores antes de que afecte a los usuarios finales.

Evaluación del LLM. Más allá del rastreo sin procesar, Arize admite procesos de evaluación automatizados. Puede ejecutar flujos de trabajo de LLM como juez, que puntúan las finalizaciones en función de dimensiones como la relevancia, la coherencia y la factibilidad. También puedes incorporar flujos de trabajo de anotación humana para una evaluación de la calidad más matizada. Las trazas proporcionan los datos sin procesar (entradas y salidas y parámetros del modelo) que alimentan estos ciclos de evaluación.

El diferenciador clave es que Arize entiende la semántica específica de LLM de forma nativa. Analiza los recuentos de tokens y los identificadores de modelos y muestra el contenido de atributos desfasados y los muestra en vistas diseñadas específicamente, en lugar de tratarlos como pares genéricos de claves y valores de cadenas.

La superficie de integración

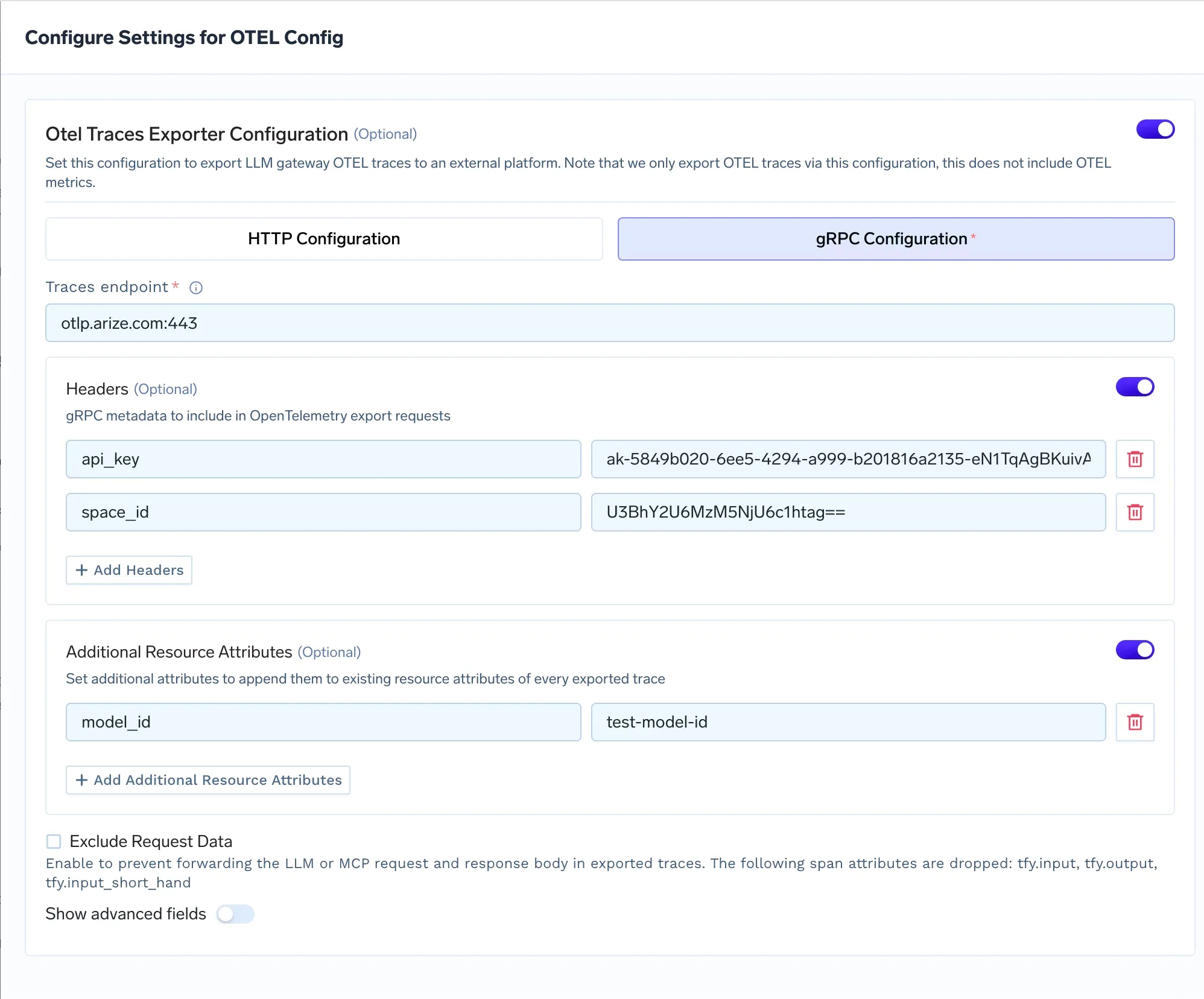

La integración es una exportación directa de gRPC desde la puerta de enlace a Arize. No se necesita un sidecar de coleccionista. No se trata de ningún SDK personalizado. Usted configura el exportador OTEL en el panel de control de TrueFoundry y los rastros comienzan a fluir.

Puedes seguir los pasos de integración aquí: https://www.truefoundry.com/docs/ai-gateway/arize

Atributos de recursos

Puede adjuntar atributos de recursos adicionales a cada seguimiento exportado. Se trata de pares de valores clave que se anexan a nivel de seguimiento y son útiles para filtrar y agrupar en Arize.

El atributo más común para establecer es id_modelo. Arize lo usa para agrupar los rastros por modelo en sus vistas de tablero. Si está dirigiendo el tráfico de producción a través de un modelo de Llama ajustado, puede configurar id_modelo a producción afinada de llama-3. También puedes añadir versión_modelo si está ejecutando despliegues paralelos y desea comparar el rendimiento entre las versiones de Arize.

Controles de privacidad de datos

Hay escenarios de implementación en los que el contenido rápido y el contenido de finalización no deben salir de la infraestructura. Los requisitos de cumplimiento pueden prohibir el envío de los organismos de solicitud a servicios de terceros. La información de identificación personal incluida en las solicitudes puede hacer que la exportación externa no sea un éxito.

TrueFoundry gestiona esto con la opción Excluir datos de solicitud en la configuración del exportador de OTEL. Cuando está habilitada, la puerta de enlace elimina tres atributos de intervalo antes de la exportación: entrada tfy. y tfy.output y tfy.input_short_hand. Arize sigue recibiendo los datos de seguimiento estructural (la latencia y el recuento de tokens y los metadatos del modelo y el estado de los errores), pero nunca ve el contenido real de las solicitudes o finalizaciones.

Se trata de un detalle arquitectónico importante. El filtrado se produce a nivel de puerta de enlace antes de que los datos de seguimiento lleguen al exportador de gRPC. El contenido nunca sale del pod de la puerta de enlace. Obtiene una visibilidad total del rendimiento, el costo y la confiabilidad sin exponer el contenido confidencial a una plataforma externa.

Verificación de la integración

Después de guardar la configuración de OTEL, envíe algunas solicitudes de LLM a través de la puerta de enlace. A continuación, abre el panel de control de Arize y navega hasta Traces. Busque rastros en el puerta de enlace tfy-llm servicio. Cada seguimiento debe mostrar el árbol de tramos completo con los intervalos de gestión de la puerta de enlace y el intervalo de llamadas salientes del proveedor de LLM. Haga clic en los intervalos individuales para comprobar que el uso de los tokens, la latencia y los metadatos del modelo se rellenan correctamente.

Si configuró los atributos de los recursos, debería verlos reflejados en los metadatos de seguimiento. Utilice el id_modelo atributo para filtrar la lista de trazas y verificar que las trazas se agrupan correctamente por modelo.

Resumen de arquitectura

El flujo de datos es sencillo. Las aplicaciones envían solicitudes de LLM a TrueFoundry AI Gateway. La pasarela procesa la solicitud en la memoria (autenticación y autorización y enrutamiento y limitación de velocidad) y la reenvía al proveedor del modelo configurado. Paralelamente, la pasarela genera intervalos OTEL para el ciclo de vida de la solicitud y los publica de forma asincrónica en la cola de mensajes de NATS. El exportador de OTEL lee esta cola y envía los rastros a través de gRPC a otlp.arize.com: 443. Arize ingiere las trazas de OTLP y las pone a disposición para su visualización, análisis y evaluación.

No se agrega ninguna llamada externa a la ruta de inferencia. No es necesario instalar ningún sidecar colector. No es necesario cambiar el código de la aplicación. La puerta de enlace es el único punto de instrumentación y la exportación OTEL se suma al almacenamiento de rastreo interno de la puerta de enlace. Puede exportar a Arize sin dejar de utilizar la interfaz de usuario de Monitor integrada de TrueFoundry para los mismos datos de rastreo.

Este es el patrón que hace que OTEL sea valiosa como opción de protocolo. La puerta de enlace emite trazas OTLP estándar. Arize acepta las trazas OTLP estándar. Si mañana decides cambiar de servidor de observabilidad, cambias el punto final y los encabezados en la configuración de la puerta de enlace y apunta a un receptor OTLP diferente. El código de su aplicación, la configuración de su puerta de enlace y su instrumentación de rastreo permanecen exactamente iguales.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)