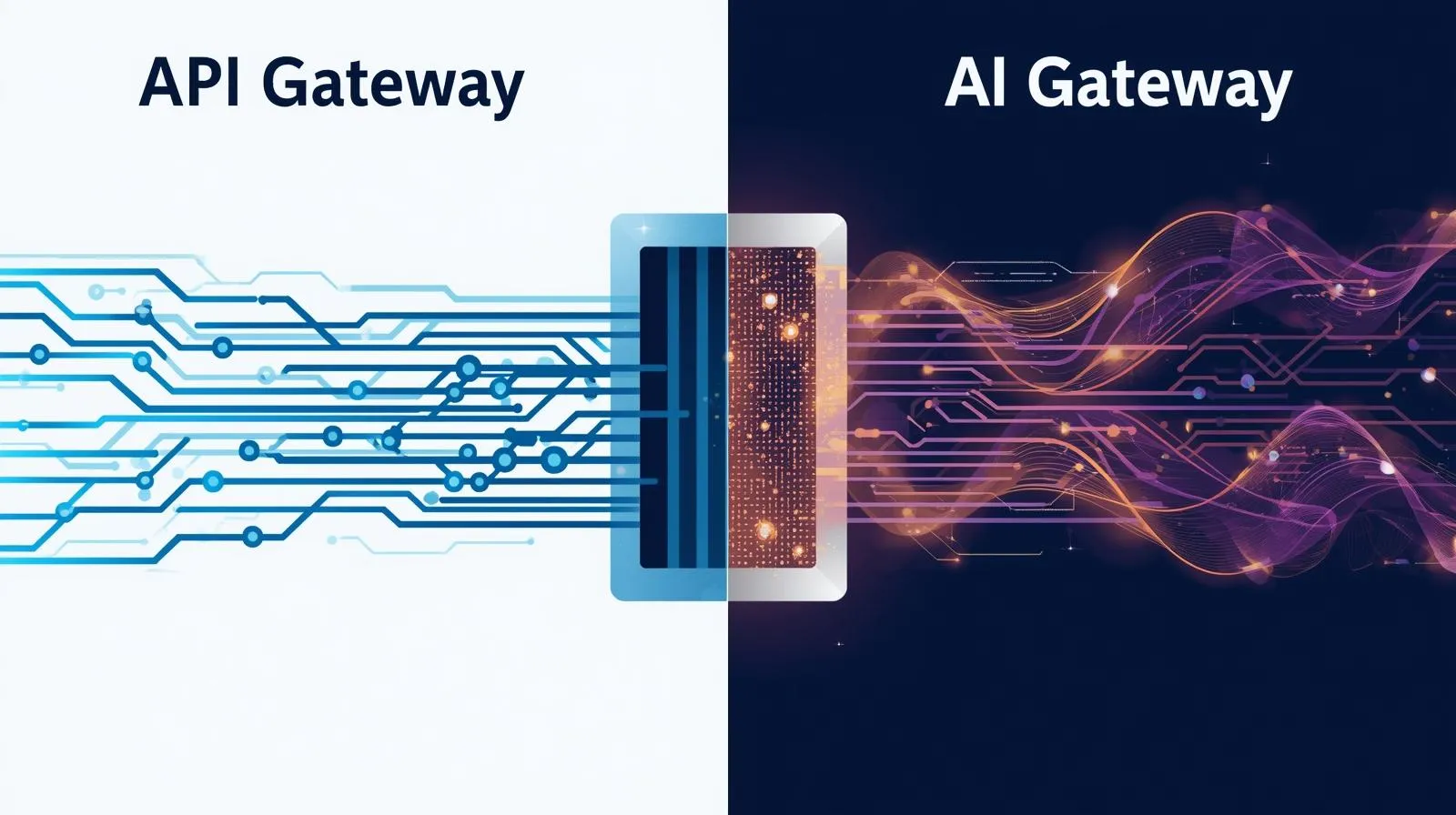

AI Gateway frente a API Gateway: explicación de las diferencias clave

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

La adopción de la IA empresarial ha llegado a un punto de inflexión en el que los enfoques de infraestructura tradicionales ya no son suficientes. Si bien las pasarelas de API han sido útiles para las empresas a la hora de gestionar las API y los microservicios de REST, la aparición de cargas de trabajo de IA, en particular de modelos lingüísticos de gran tamaño, presenta desafíos únicos que exponen limitaciones críticas. Los precios basados en tokens, la latencia variable, el enrutamiento rápido y complejo y los requisitos de seguridad específicos de la IA exigen una infraestructura especializada. Las organizaciones que intentan canalizar el tráfico de IA a través de pasarelas de API convencionales suelen encontrarse con cuellos de botella en el rendimiento, sobrecostos y brechas de cumplimiento que ponen en peligro sus iniciativas de IA. Saber cuándo aprovechar las pasarelas de IA frente a las pasarelas de API tradicionales se ha convertido en algo esencial para una implementación exitosa de la IA empresarial.

¿Qué es AI Gateway?

Un Puerta de enlace de IA es un componente de infraestructura especializado diseñado específicamente para gestionar las cargas de trabajo de inteligencia artificial y aprendizaje automático, en particular los modelos de lenguaje de gran tamaño y las aplicaciones de IA generativa. A diferencia de las pasarelas de API tradicionales, las pasarelas de IA comprenden las características únicas del tráfico de IA, incluido el procesamiento basado en tokens, los tiempos de respuesta variables y los requisitos de enrutamiento específicos del modelo.

Las funciones principales de AI Gateway abordan los desafíos específicos de la IA mediante modelos inteligentes de enrutamiento, seguimiento de costos a nivel de token y administración rápida. Las pasarelas de IA proporcionan un acceso unificado a varios proveedores de LLM a través de interfaces estandarizadas, lo que permite cambiar sin problemas entre los modelos OpenAI, Anthropic, Cohere y autohospedados. En el nivel de integración, esto a menudo lleva a los equipos a MCP frente a API decisiones, en las que las API exponen puntos finales fijos, pero MCP permite que los modelos y los agentes descubran herramientas y capacidades de forma dinámica en todos los sistemas. Las funciones avanzadas incluyen el almacenamiento semántico en caché para solicitudes similares, la conmutación automática por error entre los proveedores de modelos y la optimización de costos en tiempo real basada en los patrones de uso de los tokens.

¿Qué es un API Gateway?

.webp)

Una puerta de enlace de API sirve como punto de entrada centralizado para administrar, proteger y enrutar el tráfico a los servicios de backend en arquitecturas distribuidas. Al actuar como un proxy inverso, se encuentra entre las aplicaciones del cliente y los microservicios, y proporciona capacidades empresariales esenciales, como la autenticación, la autorización, la limitación de velocidad, el equilibrio de carga y la transformación de solicitudes y respuestas.

Las funciones principales de API Gateway incluyen la gestión del tráfico mediante un enrutamiento inteligente basado en rutas URL, métodos HTTP y encabezados. La pasarela se ocupa de cuestiones transversales como la terminación del SSL, la limitación de solicitudes y el almacenamiento en caché para optimizar el rendimiento. Los mecanismos de autenticación verifican las credenciales de los clientes, mientras que las políticas de autorización garantizan un control de acceso adecuado. Las capacidades de transformación de solicitudes y respuestas permiten la traducción de protocolos y la conversión de formatos de datos.

Puerta de enlace API frente a puerta de enlace de IA

Aumento de la popularidad de AI Gateway

El mercado de pasarelas de IA está experimentando un crecimiento explosivo impulsado por la rápida adopción empresarial de tecnologías de IA generativa y las limitaciones de la infraestructura tradicional a la hora de gestionar las cargas de trabajo específicas de la IA.

El impulso del mercado y la inversión reflejan una demanda empresarial sin precedentes. Según un análisis reciente del sector, la adopción de pasarelas de IA ha crecido un 400% año tras año, y el gasto en IA empresarial ha alcanzado los 50 000 millones de dólares en todo el mundo. Los principales proveedores de tecnología, como Microsoft, Google y AWS, han lanzado servicios de puerta de enlace dedicados a la IA, mientras que proveedores especializados como TrueFoundry, LangChain y otros han recaudado una importante cantidad de fondos para satisfacer las necesidades de infraestructura de IA de las empresas.

Los problemas empresariales impulsan la adopción a medida que las organizaciones descubren que las herramientas de administración de API tradicionales son inadecuadas para las cargas de trabajo de IA. Los primeros usuarios de la IA suelen registrar sobrecostes que superan el 300% de las previsiones iniciales cuando se dirige el tráfico de IA a través de pasarelas convencionales. Los problemas de rendimiento se deben a la ineficacia de los mecanismos de almacenamiento en caché, que no reconocen las solicitudes semánticamente similares, mientras que las brechas de seguridad se deben a una protección inadecuada contra los ataques de inyección rápida y a la falta de una supervisión del cumplimiento específica para la IA.

Las presiones regulatorias y de cumplimiento aceleran la adopción de pasarelas de IA en los sectores regulados. La Ley de IA de la UE, los marcos de gobernanza de la IA emergentes y las regulaciones específicas del sector requieren pistas de auditoría detalladas, monitoreo de sesgos y capacidades de filtrado de contenido que las pasarelas de API tradicionales no pueden ofrecer. Las organizaciones sanitarias que implementan aplicaciones de inteligencia artificial necesitan una gestión rápida que cumpla con la HIPAA, mientras que los servicios financieros requieren funciones especializadas de detección de fraudes y transparencia algorítmica.

La madurez tecnológica y la innovación impulsan la sofisticación de las soluciones. Las pasarelas de IA modernas ofrecen capacidades avanzadas, como el almacenamiento en caché semántico, que reduce los costos hasta en un 70%, el enrutamiento inteligente que optimiza el rendimiento en varios proveedores de modelos y la optimización de costos en tiempo real, que evita los excesos presupuestarios. Estas capacidades abordan los requisitos empresariales de costos predecibles, rendimiento confiable y una gobernanza integral que la infraestructura tradicional no puede ofrecer.

La validación del sector proviene de las implementaciones de Fortune 500 que demuestran un ROI cuantificable. Tras implementar soluciones de pasarelas de IA especializadas, las organizaciones informan de que han reducido los costes entre un 40 y un 60%, han mejorado el rendimiento de las aplicaciones de IA y la seguridad.

¿Cuándo usar AI Gateway?

Las organizaciones deberían considerar la posibilidad de implementar pasarelas de IA cuando sus iniciativas de IA pasen de las fases experimentales a entornos de producción en los que los requisitos empresariales se vuelvan críticos. El punto de transición suele producirse cuando las organizaciones despliegan varias aplicaciones de IA, integran varios proveedores de modelos o se enfrentan a crecientes presiones en materia de costes y cumplimiento que la infraestructura tradicional no puede abordar de forma eficaz.

Los entornos multimodelo representan el caso de uso más convincente para la adopción de pasarelas de IA. Cuando las organizaciones utilizan varios proveedores de LLM, que combinan OpenAI para tareas generales, Anthropic para aplicaciones críticas para la seguridad y modelos autohospedados para datos propietarios, una puerta de enlace de IA se vuelve esencial para la administración unificada. Las pasarelas de API tradicionales se enfrentan a la complejidad de las decisiones de enrutamiento basadas en las capacidades del modelo, los límites de los tokens y la optimización de los costos en los distintos proveedores. Las pasarelas de IA permiten cambiar sin problemas entre modelos en función de las métricas de rendimiento en tiempo real, los costos y los requisitos específicos de los casos de uso.

Las preocupaciones por el control de costos llevan a muchas organizaciones a optar por soluciones de puerta de enlace de IA a medida que el uso de la IA se amplía en toda la empresa. Las organizaciones que procesan millones de tokens al mes suelen descubrir que sus costes de IA superan con creces las previsiones presupuestarias. Las pasarelas de IA proporcionan un seguimiento detallado de los costos, mecanismos inteligentes de almacenamiento en caché que reconocen indicaciones semánticamente similares y enrutamiento automatizado hacia modelos rentables, cuando es apropiado. Estas capacidades pueden reducir los costos de la infraestructura de IA entre un 40 y un 70% y, al mismo tiempo, mantener el rendimiento de las aplicaciones y la experiencia del usuario.

Los requisitos de cumplimiento normativo hacen que las pasarelas de IA sean esenciales para las organizaciones de los sectores regulados. Las organizaciones sanitarias que gestionan datos de pacientes, las instituciones financieras que procesan información confidencial de los clientes y las agencias gubernamentales que gestionan material clasificado necesitan capacidades especializadas de seguimiento de auditorías, filtrado de contenido y control de sesgos. Las pasarelas de API tradicionales carecen de las funciones de gobierno específicas para la IA que se requieren para el cumplimiento de la normativa, mientras que las pasarelas de IA proporcionan herramientas diseñadas específicamente para la desinfección rápida, la supervisión de los resultados y el registro de auditorías completo que cumplen con los requisitos reglamentarios.

¿Realmente necesita una puerta de enlace de inteligencia artificial? Vamos a evaluar

No todas las organizaciones necesitan una puerta de enlace de IA de inmediato, y una autoevaluación honesta evita la complejidad y la inversión innecesarias en la infraestructura. En última instancia, la decisión depende de la madurez, la escala y los requisitos empresariales específicos de la IA, en lugar de seguir las tendencias tecnológicas o las recomendaciones de los proveedores.

Comience con escenarios simples que tal vez no justifiquen la inversión en pasarelas de IA. Las organizaciones que utilizan aplicaciones de IA únicas con un solo proveedor modelo, procesan menos de 100 000 tokens al mes u operan en fases piloto, a menudo pueden gestionarla de forma eficaz con conexiones de API directas o herramientas ligeras de administración de API. Los equipos pequeños que experimentan con la integración de ChatGPT, la elaboración de resúmenes de documentos básicos o la implementación sencilla de chatbots no suelen necesitar una infraestructura de puerta de enlace especializada. Del mismo modo, las organizaciones con requisitos mínimos de cumplimiento y estructuras de costes sencillas pueden encontrar soluciones tradicionales adecuadas para sus necesidades actuales.

Evalúe los indicadores de escala y complejidad que indican la necesidad de una puerta de enlace de IA. Los principales factores desencadenantes incluyen el consumo mensual de más de un millón de fichas, el uso por parte de varios proveedores de modelos, la implementación de aplicaciones de IA de nivel productivo para clientes externos o los requisitos de atribución detallada de los costos entre los equipos y proyectos. La complejidad técnica aumenta considerablemente cuando las organizaciones necesitan un enrutamiento inteligente entre modelos, un almacenamiento en caché semántico para optimizar los costos o mecanismos de conmutación por error automatizados para garantizar la confiabilidad. Estos escenarios suelen surgir a medida que las iniciativas de IA maduran, pasando de la experimentación a las operaciones críticas para la empresa.

Tenga en cuenta los requisitos de cumplimiento y gobierno que a menudo exigen una infraestructura especializada. Las organizaciones de los sectores sanitario, financiero, gubernamental u otros sectores regulados suelen necesitar capacidades de seguimiento de auditoría, filtrado de contenido y supervisión de sesgos específicas para la IA, que no pueden ofrecer las pasarelas de API de uso general. Incluso las aplicaciones de IA aparentemente simples se vuelven complejas cuando deben cumplir con la HIPAA, el SOC 2 u otros marcos regulatorios. Además, las organizaciones con requisitos estrictos de soberanía de datos o aquellas que gestionan propiedad intelectual confidencial suelen necesitar las funciones avanzadas de seguridad y gobierno que ofrecen las pasarelas de IA especializadas.

Evalúe la estrategia a largo plazo y las proyecciones de crecimiento para evitar costosas migraciones de infraestructura en el futuro. Las organizaciones que planifiquen una expansión significativa de la IA, se anticipen a los requisitos de cumplimiento normativo o creen productos basados en la IA para clientes externos deberían considerar la posibilidad de adoptar una pasarela de IA en una fase más temprana de su proceso para evitar las complejidades de la migración y la deuda técnica.

Solución de puerta de enlace de IA TrueFoundry

.webp)

TrueFoundry AI Gateway ofrece una gestión del tráfico de IA de nivel empresarial a través de una plataforma especialmente diseñada que aborda los desafíos únicos de las cargas de trabajo de IA de producción. La plataforma, que procesa más de un millón de llamadas de LLM al día para organizaciones como NVIDIA, CVS Health y Siemens, combina una arquitectura de alto rendimiento con funciones integrales específicas para la IA.

.webp)

Unified Model Access proporciona una integración perfecta con más de 1000 LLM a través de una única interfaz API compatible con OpenAI. La pasarela es compatible con proveedores externos, incluidas las plataformas OpenAI, Anthropic, Cohere y en la nube, además de modelos autohospedados y optimizados mediante la función «Agregar a Gateway» con un solo clic. Este enfoque unificado elimina la dependencia de un solo proveedor y, al mismo tiempo, permite a las organizaciones aprovechar los mejores modelos para casos de uso específicos sin cambiar el código.

El rendimiento de nivel empresarial ofrece una sobrecarga de latencia mínima de menos de 5 ms a través de una arquitectura optimizada para las cargas de trabajo de producción. Basada en la estructura Hono para una gestión ultrarrápida de las solicitudes, la pasarela pasa de 250 RPS en 1 CPU/1 GB de RAM a miles de RPS mediante el escalado horizontal. La ausencia de llamadas externas en la ruta de solicitud y la aplicación de todas las políticas en memoria garantizan tiempos de respuesta inferiores a los milisegundos para las decisiones de autenticación, autorización y enrutamiento.

Las capacidades avanzadas de administración del tráfico incluyen un equilibrio de carga inteligente con estrategias de enrutamiento basadas en el peso y en la latencia. La pasarela monitorea continuamente las solicitudes por minuto, los tokens por minuto y las tasas de error para mantener un estado óptimo del modelo. La conmutación automática por error a los modelos de respaldo garantiza la disponibilidad continua de los servicios, mientras que el almacenamiento en caché semántico reduce los costos hasta en un 70% al reconocer las solicitudes similares en lugar de requerir coincidencias exactas.

Las funciones integrales de seguridad y gobierno proporcionan un control de acceso de nivel empresarial mediante la integración de RBAC con proveedores de identidad, incluidos Okta y Azure AD. La gestión detallada de los permisos, la gestión centralizada de las claves de API y los registros de auditoría exhaustivos respaldan los requisitos de cumplimiento normativo. Las barreras integradas ofrecen filtrado de contenido, detección de sesgos y prevención inmediata de inyecciones, diseñadas específicamente para aplicaciones de inteligencia artificial.

.webp)

El soporte de IA multimodal y agencial permite flujos de trabajo de IA de próxima generación a través de la integración nativa de la puerta de enlace MCP (Model Context Protocol) para la orquestación de herramientas empresariales. La plataforma admite entradas de texto, imágenes y audio, al tiempo que proporciona una infraestructura dedicada para los flujos de trabajo de los agentes de IA con seguridad y capacidad de observación de nivel empresarial.

Conclusión

La elección entre pasarelas de API y pasarelas de IA representa una decisión de infraestructura estratégica que repercute en el éxito de las iniciativas empresariales de IA. Si bien las pasarelas de API tradicionales son excelentes a la hora de gestionar los servicios web convencionales, las cargas de trabajo de la IA exigen capacidades especializadas que solo las pasarelas de IA diseñadas específicamente pueden ofrecer. Los modelos de precios basados en tokens, los patrones de latencia variable, el procesamiento multimodal y los requisitos de seguridad específicos de la IA crean desajustes fundamentales con las arquitecturas de puerta de enlace tradicionales. Las organizaciones que reconocen estas diferencias en una fase temprana e implementan soluciones de pasarela de IA adecuadas se posicionan para alcanzar el éxito sostenible de la IA, evitando los cuellos de botella en el rendimiento, los sobrecostos y las brechas de cumplimiento que afectan a las iniciativas de IA basadas en infraestructuras inadecuadas.

Preguntas frecuentes

¿Qué es una puerta de enlace de IA y API?

Una puerta de enlace de API enruta y protege el tráfico de servicios de back-end estándar. Una pasarela de IA se especializa en gestionar las interacciones entre los modelos de IA, como las LLM, optimizar los costes y enrutar de forma inteligente las cargas de trabajo de IA. En conjunto, satisfacen necesidades de infraestructura diferentes pero complementarias: las pasarelas de API gestionan el tráfico de servicios generales, mientras que las pasarelas de IA gestionan la complejidad específica de las interacciones entre los modelos de IA.

¿Cuál es la diferencia entre una puerta de enlace de IA y una puerta de enlace de API?

Una puerta de enlace de API administra el tráfico general de API para microservicios, gestionando el enrutamiento y la seguridad. Sin embargo, una puerta de enlace de IA está diseñada específicamente para cargas de trabajo de IA y aprendizaje automático, como las LLM, ya que permite gestionar las solicitudes, los costos y las interacciones complejas entre modelos. Para optimizar las implementaciones modernas de IA, es fundamental comprender la relación entre la pasarela de IA y la puerta de enlace de API.

¿La API y la IA son lo mismo?

No, la API (interfaz de programación de aplicaciones) y la IA (inteligencia artificial) son distintas. Una API es una interfaz de comunicación, mientras que la IA es la inteligencia artificial en sí misma. En términos de infraestructura, esta distinción es importante: una puerta de enlace de API expone y administra las API (incluidas las API de modelos de IA), mientras que una puerta de enlace de IA es una capa especializada creada específicamente para gestionar la complejidad de la interacción con los modelos de IA, como los presupuestos simbólicos, los modelos alternativos y el control rápido.

¿Puede una puerta de enlace de API gestionar las cargas de trabajo de IA?

Una pasarela de API puede gestionar cargas de trabajo básicas de IA debido a desafíos únicos, como los precios basados en tokens y el complejo enrutamiento rápido. Carece de las capacidades propias de la IA necesarias para los sistemas de IA de producción: no tiene el concepto de facturación basada en tokens ni de limitación de tarifas, no almacena en caché semántica, no tiene una lógica alternativa multimodelo, no tiene un control rápido de versiones y no tiene una capacidad de observación específica para el LLM. Para cualquier cosa que vaya más allá del simple reenvío de solicitudes a un proveedor de inteligencia artificial, la herramienta adecuada es una puerta de enlace de inteligencia artificial dedicada.

¿Las pasarelas de IA reemplazan a las pasarelas de API?

Las puertas de enlace de IA no sustituyen a las puertas de enlace de API; tienen distintos propósitos. Las pasarelas de API gestionan las API de REST estándar, mientras que las pasarelas de IA se especializan en cargas de trabajo de IA y aprendizaje automático, como las LLM, y abordan desafíos únicos, como los precios basados en tokens. Comprender la diferencia entre una puerta de enlace de IA y una puerta de enlace de API le ayuda a aprovechar ambas de manera eficaz.

¿Se puede usar una puerta de enlace de API como puerta de enlace de IA?

Si bien una puerta de enlace de API gestiona la autenticación básica y el enrutamiento del tráfico, carece de inteligencia específica para LLM. No puede rastrear el uso de los tokens, gestionar la conmutación por error del proveedor de modelos ni realizar el almacenamiento en caché semántico. Para admitir aplicaciones de IA de nivel de producción, necesita la orquestación y la capacidad de observación especializadas que solo ofrece una puerta de enlace de IA dedicada.

¿Cuándo debo usar la puerta de enlace de IA y la puerta de enlace de API juntas?

Utilice ambos cuando opere un ecosistema de IA a escala de producción. La puerta de enlace de API sirve como defensa perimetral para todos los servicios corporativos, mientras que la puerta de enlace de IA se encuentra detrás de ella para gestionar las tareas específicas de la LLM. Esta combinación garantiza una gestión segura del acceso y, al mismo tiempo, optimiza el enrutamiento, los costos y la capacidad de observación de los modelos para sus equipos de ingeniería.

¿Qué es mejor para las aplicaciones de IA: puerta de enlace API o puerta de enlace de IA?

Una puerta de enlace de IA es significativamente mejor para las aplicaciones de IA porque está diseñada específicamente para los desafíos únicos de los LLM. Ofrece soporte nativo para la transmisión, la limitación de velocidad basada en los tokens y la conmutación por error automatizada de modelos. Estas funciones garantizan una mayor confiabilidad y menores costos en comparación con el uso de una puerta de enlace de API genérica que no esté compatible con la IA.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)