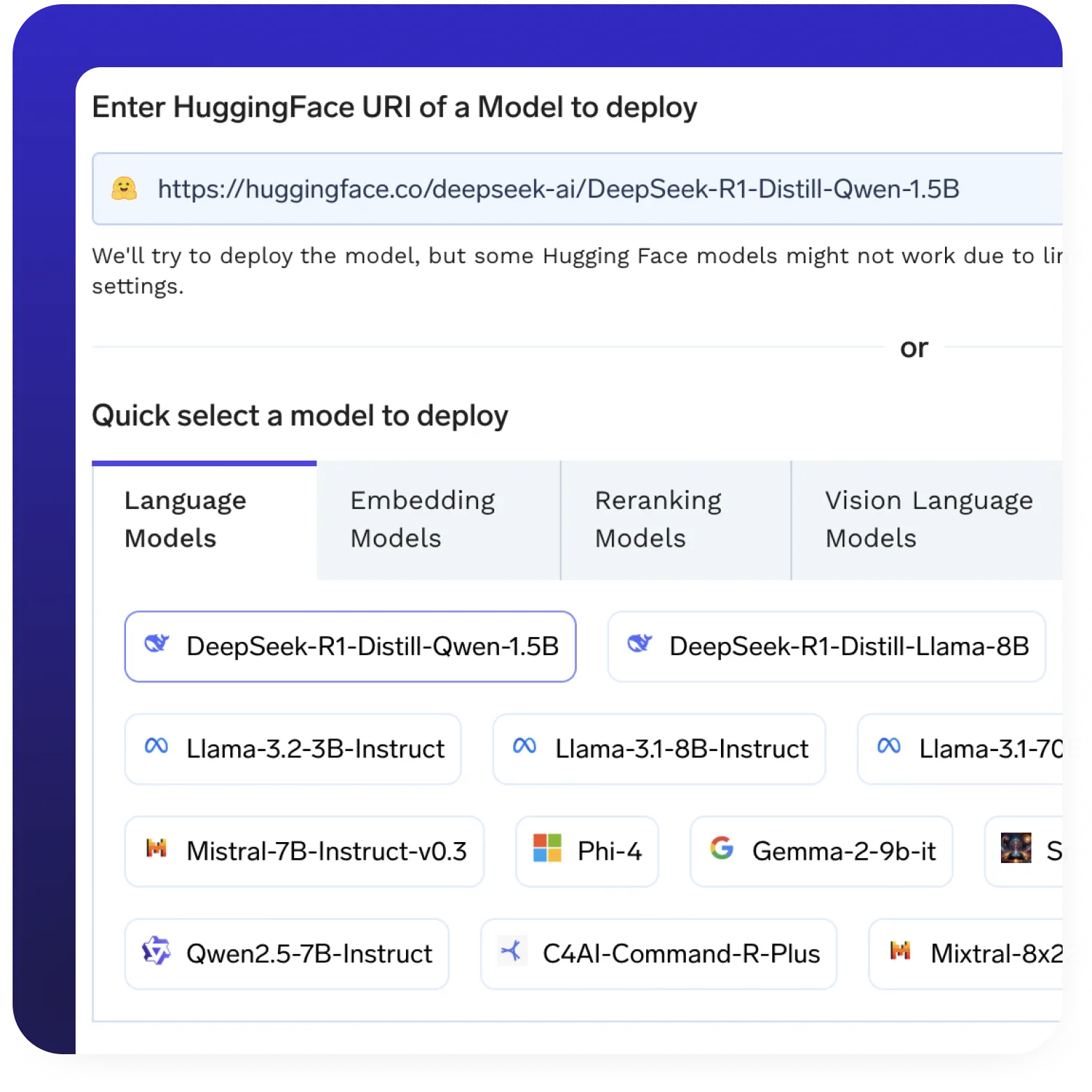

Servicio e inferencia de modelos

- Sin esfuerzo implemente cualquier LLM de código abierto con optimizaciones preconfiguradas.

- Conéctate a Hugging Face o al registro de tu modelo preferido con facilidad.

- Aproveche los modelos de servidores de primer nivel, como VLLm y SGLang para inferencias de alto rendimiento.

- Escalado automático y aprovisionamiento inteligente de infraestructuras

Pruébalo ahora

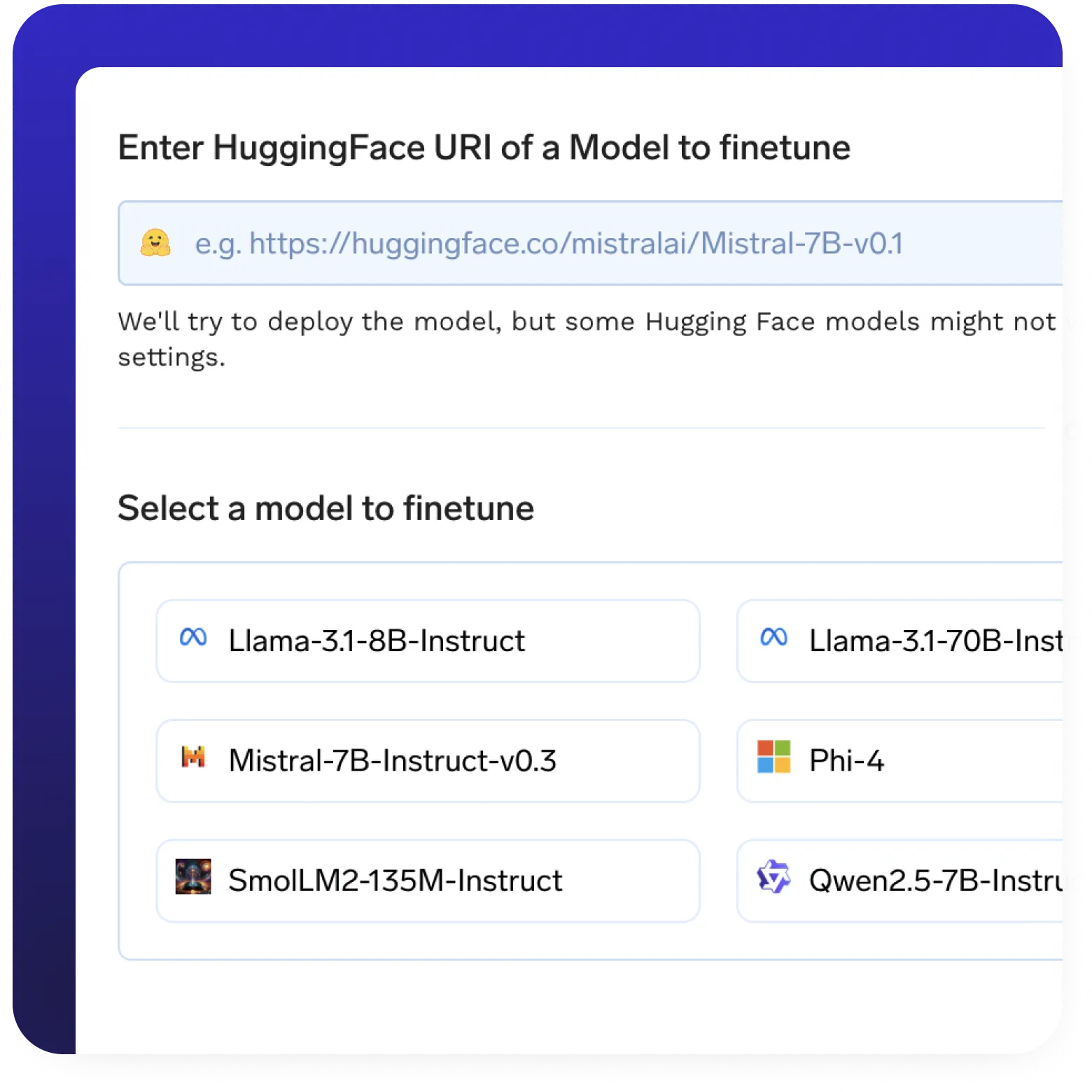

Modelo Finetuning

- Soporte de ajuste fino sin código y de código completo en conjuntos de datos personalizados.

- LoRa y QLoRa para una adaptación eficiente de rango bajo.

- Puntos de control soporte para una reanudación fluida del entrenamiento.

- Despliegue de modelos ajustados con un solo clic con los mejores modelos de servidores de su clase.

- Canalizaciones de formación automatizadas con funciones integradas seguimiento de experimentos.

- Soporte de capacitación distribuido para una optimización de modelos más rápida y a gran escala.

Pruébalo ahora

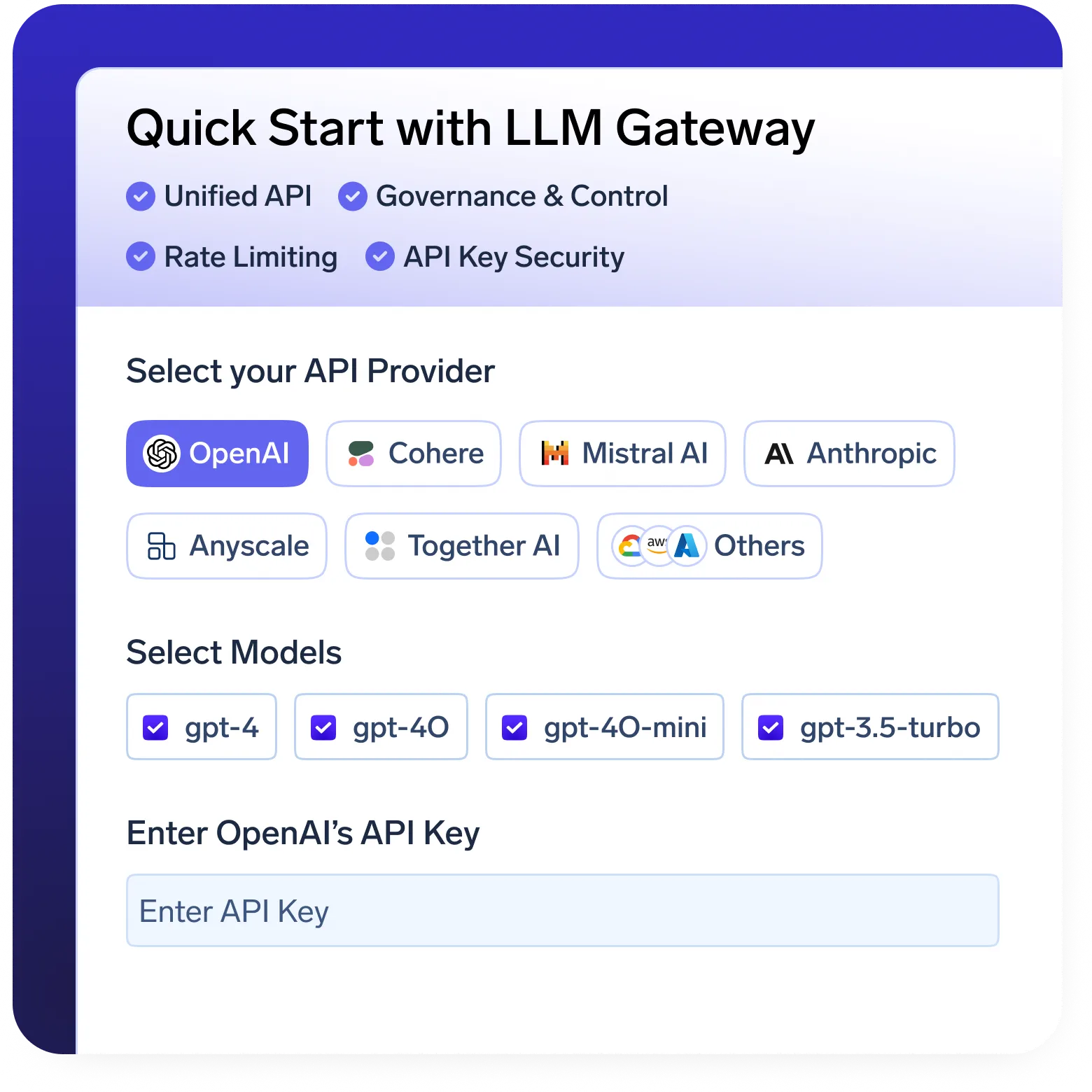

Puerta de enlace de IA

- Capa de API unificada para servir y administrar modelos en OpenAI, Llama, Gemini, etc.

- Limitación de velocidad y control de acceso integrados para gestionar el uso de forma segura.

- Métricas de uso y costos en tiempo real para una mejor supervisión y optimización.

- Retroceso y reintentos automáticos para garantizar una alta disponibilidad y confiabilidad.

Pruébalo ahora

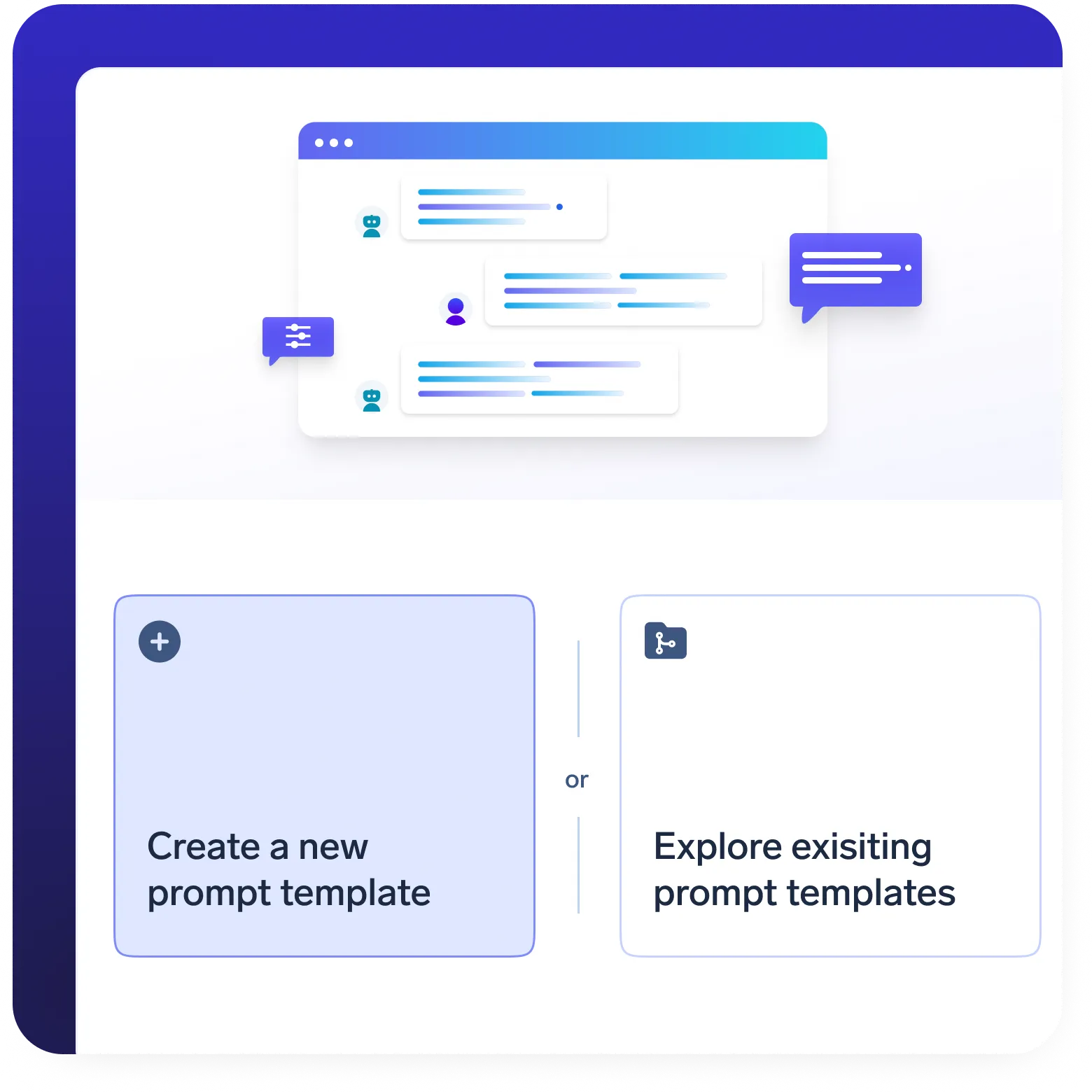

Gestión rápida

- Experimente y repita las instrucciones con un marco de pruebas estructurado

- Ingeniería rápida controlada por versiones

Pruébalo ahora

Rastreo y barandillas

- Capture y analice cada aviso, respuesta y uso de tokens para garantizar la transparencia y la trazabilidad.

- Registra la latencia, las tasas de finalización y las llamadas a la API para optimizar el rendimiento del modelo.

- Intégralo con barreras de protección personalizadas o herramientas externas para la detección de PII, la moderación de contenido, etc.

Pruébalo ahora

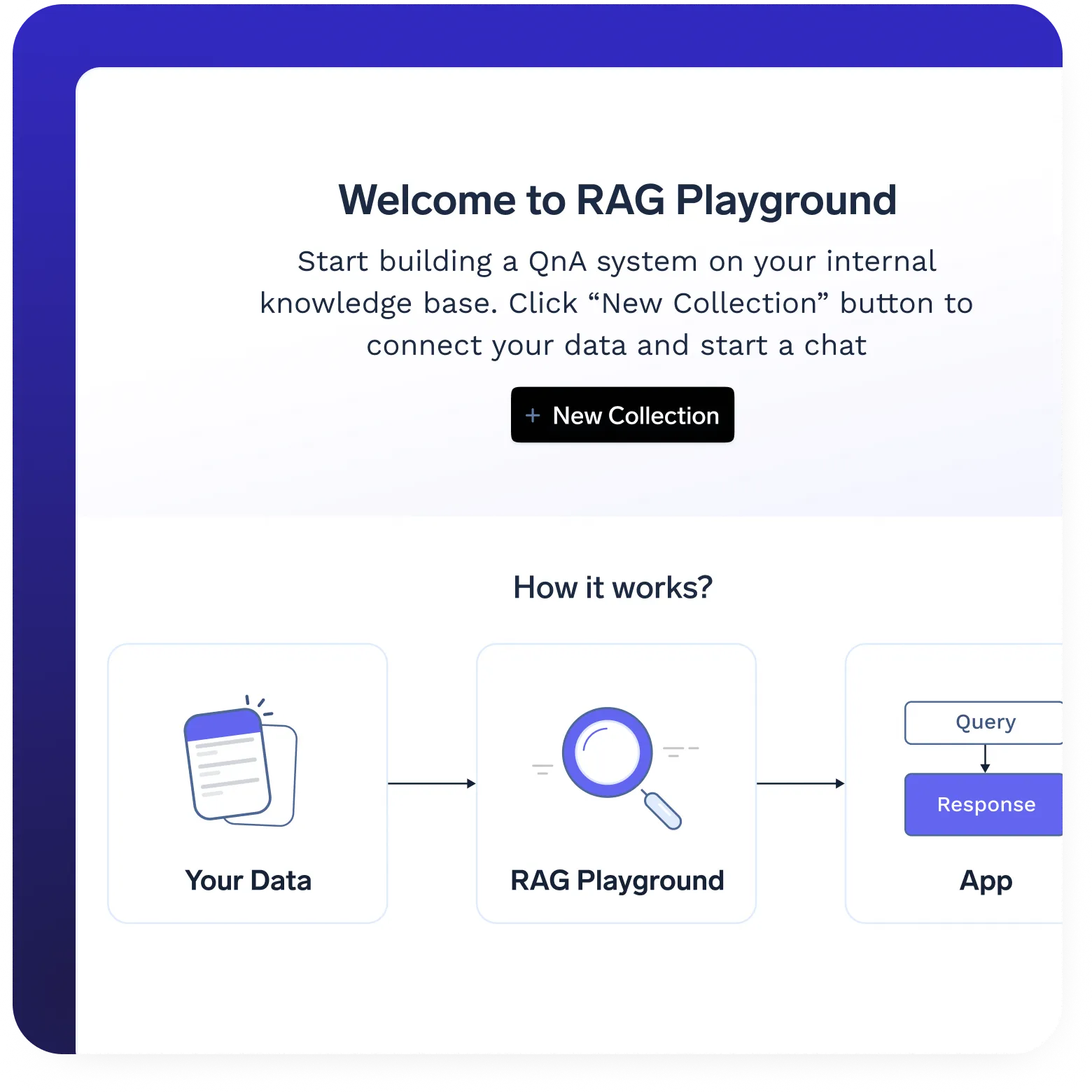

Despliegue de RAG con un clic

- Implementa todos los componentes RAG con un solo clic, incluidos VectorDB, los modelos de incrustación, el frontend y el backend.

- Infraestructura configurable para optimizar el almacenamiento, la recuperación y el procesamiento de consultas.

- Arquitectura escalable para soportar bases de conocimiento dinámicas y en crecimiento.

Pruébalo ahora

Implemente cualquier marco de agentes

- Implemente y gestione agentes de IA en varios marcos, incluidos LangChain, AutoGen, CrewAI y agentes personalizados.

- Implementación independiente del marco, que garantiza la compatibilidad con cualquier arquitectura basada en agentes.

- Soporte para la colaboración entre múltiples agentes, lo que permite a los agentes interactuar, compartir contexto y ejecutar tareas de forma autónoma.

Pruébalo ahora

Preparado para la empresa

Sus datos y modelos se alojan de forma segura en su infraestructura local o en la nube.

Sistemas totalmente modulares

Se integra con su pila existente y la complementaCumplimiento verdadero

Estándares SOC 2, HIPAA y GDPR para garantizar una protección de datos sólidaSeguro por diseño

Registros de auditoría y control de acceso flexibles basados en rolesAutenticación estándar del sector

Integración de SSO mediante OIDC o SAML

Respaldado por inversores de clase mundial

.webp)

Testimonios TrueFoundry hace que tu equipo de ML sea 10 veces más rápido

.webp)

Deepanshi S

Científico de datos principal

TrueFoundry simplifica la implementación de modelos de aprendizaje automático complejos con una interfaz de usuario fácil de usar, lo que libera a los científicos de datos de las preocupaciones relacionadas con la infraestructura. Mejora la eficiencia, optimiza los costos y resuelve sin esfuerzo los desafíos de DevOps, lo que nos ha demostrado ser inestimable.

Mathieu Perrinel

Director de ML

Los ahorros en costos de computación que logramos como resultado de la adopción de TrueFoundry fueron superiores al costo del servicio (y eso sin contar el tiempo y los dolores de cabeza que nos ahorra).

Soma Dhavala

Director de aprendizaje automático

TrueFoundry nos ayudó a ahorrar entre un 40 y un 50% de los costos de la nube. La mayoría de las empresas te dan una herramienta y te abandonan, pero TrueFoundry nos ha brindado un excelente soporte siempre que lo necesitábamos.

Rajesh Chagantí

CTO

Con la plataforma TrueFoundry, pudimos reducir nuestros costos en la nube de manera significativa. Pudimos pasar sin problemas de un sistema basado en AMI a una arquitectura basada en Docker-Kubernetes en unas pocas semanas.

Sumit Rao

Vicepresidente ejecutivo de ciencia de datos

TrueFoundry ha sido fundamental en nuestros casos de uso de aprendizaje automático. Han ayudado a nuestro equipo a obtener valor más rápido a partir del aprendizaje automático.

Vivek Suyambu

Ingeniero de software sénior

TrueFoundry facilita la implementación y el ajuste de LLM de código abierto. Su plataforma intuitiva, enriquecida con un panel repleto de funciones para la gestión de modelos, se complementa con un equipo de soporte que va más allá.

9,9

Calidad del soporte

GenAI infra: simple, más rápido y más barato

Con la confianza de más de 30 empresas y empresas de Fortune 500

.webp)