Prevención del bloqueo de proveedores con AI Gateway de TrueFoundry

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Introducción

A medida que las empresas amplían sus iniciativas de IA, uno de los mayores riesgos arquitectónicos a los que se enfrentan es dependencia de un proveedor—estar demasiado vinculado a un único proveedor de modelos o plataforma en la nube. En un ecosistema de IA en rápida evolución, en el que aparecen nuevos modelos básicos y API casi todas las semanas, esta dependencia puede limitar rápidamente la innovación y la flexibilidad. Los equipos que se comprometen desde el principio con un ecosistema a menudo se ven incapaces de adoptar modelos más nuevos, mejores o más rentables sin tener que reescribir gran parte de su oferta. Por lo tanto, evitar el confinamiento no es solo una cuestión de adquisición, sino un desafío central de diseño técnico.

El riesgo de dependencia de un proveedor es una preocupación fundamental a la hora de diseñar sistemas de IA empresariales. Si sus aplicaciones de IA están estrechamente vinculadas a las API de un único proveedor, es posible que le resulte difícil adaptarse cuando cambien las necesidades de tecnología, precios o cumplimiento. Una pasarela de modelos de IA resuelve este problema al actuar como una capa de abstracción entre sus aplicaciones y varios proveedores de modelos. En la práctica, esto significa que su código se comunica con la interfaz unificada de la puerta de enlace y no con cada proveedor directamente. Luego, la puerta de enlace dirige y traduce las solicitudes al modelo subyacente óptimo (OpenAI, Anthropic, Gemini, un LLama autohospedado, etc.) sin que el código de la aplicación necesite ningún cambio específico del proveedor. De TrueFoundry Puerta de enlace de IA ejemplifica este enfoque: ofrece una única API compatible con OpenAI para acceder Más de 1000 LLM y modelos de visión, al tiempo que refuerza la seguridad, la gobernanza y la observabilidad empresariales. Por diseño, True Foundry evita el bloqueo: usted mantiene el control total sobre la implementación y los formatos de datos, y el código de su aplicación permanece independiente del proveedor.

Comprender la dependencia de un proveedor en los sistemas de IA

La dependencia de un proveedor se produce cuando el sistema queda tan vinculado a un proveedor que el cambio a otro es poco práctico o costoso. En la inteligencia artificial y el aprendizaje automático, esto suele significar escribir código directamente en el SDK o la API de un proveedor. Si bien usar un solo proveedor (por ejemplo, OpenAI) puede resultar sencillo al principio, crea dependencias peligrosas. Por ejemplo, si tu integración utiliza llamadas a la API patentadas de OpenAI, tendrás dificultades para migrar si el servicio de OpenAI no está disponible, cambia las condiciones o un modelo nuevo (como Gemini de Google o un modelo de código abierto de última generación) pasa a ser superior.

El equipo de TrueFoundry destaca esto «Trampa de bloqueo de vendedores»: una integración codificada te obliga a esforzarte cada vez que los proveedores cambian los precios, dejan de usar los modelos o dejan de usarlo por mantenimiento. En términos más generales, la dependencia se manifiesta como los altos costos de cambio: técnicos (reescribir el código para nuevas API), contractuales (romper compromisos a largo plazo), procesales (volver a capacitar a los equipos) o formatos de datos (transferir datos propietarios).

Evaluar el riesgo de bloqueo del software implica preguntarse: ¿Podemos cambiar fácilmente de proveedor si es necesario? y ¿Estamos obligados a usar SDK o formatos de datos propietarios? Como señala Progress Software, el bloqueo tiene menos que ver con la conveniencia inicial y más con la flexibilidad a largo plazo. Debe pensar en el bloqueo como en cualquier deuda técnica: planifique su arquitectura para mantener abiertas las opciones. En la práctica, esto significa favorecer los estándares abiertos (por ejemplo, la API de OpenAI, los datos de Parquet), las implementaciones en contenedores y las capas de abstracción (como las pasarelas) que permiten que los componentes subyacentes se intercambien.. El AI Gateway de TrueFoundry garantiza que el código de la aplicación nunca contenga llamadas específicas de un proveedor, por lo que no estará limitado a un solo proveedor de IA.

¿Qué es una pasarela de modelos de IA?

Un Puerta de enlace modelo AI (también llamada puerta de enlace de LLM o IA) es una capa de middleware que se encuentra entre su aplicación y cualquier número de proveedores de modelos de IA. Funciona como un controlador de tráfico aéreo o un traductor: tu aplicación envía una única solicitud de API a la puerta de enlace, y la puerta de enlace decide qué instancia modelo o proveedor usar. A continuación, la puerta de enlace estandariza los formatos de entrada y salida y gestiona la seguridad y el enrutamiento entre bastidores. Gracias a esta interfaz unificada, nunca escribirás código específico para un modelo en tu aplicación.

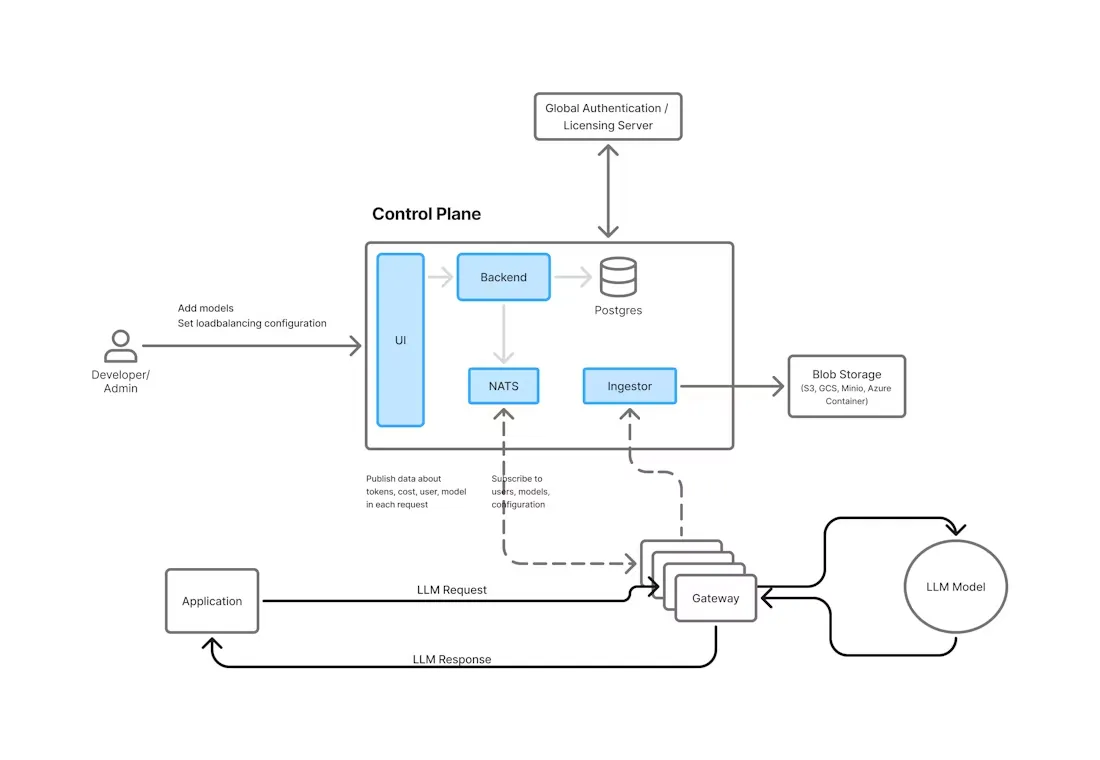

Figura: Arquitectura TrueFoundry AI Gateway (capa de proxy entre aplicaciones y varios proveedores de LLM).

Por ejemplo, La pasarela de TrueFoundry acepta solicitudes en un formato compatible con OpenAI; luego, puede enrutar la consulta a OpenAI, Anthropic, un modelo autohospedado o cualquier otro proveedor integrado sin cambiar el código.

En esencia, una pasarela de IA proporciona abstracción de modelos, aplicación de políticas y orquestación multimodelo en un solo lugar. También agrega capacidades empresariales (como RBAC, límites de velocidad, controles de costos y registros de auditoría) a cada solicitud, y trata los modelos de IA como servicios gestionados. Al desvincular la aplicación de las API específicas del proveedor, las pasarelas reducen drásticamente la carga de ingeniería cuando se trabaja con varios LLM.

Cómo ayudan las pasarelas de modelos de IA a prevenir la dependencia de un proveedor

Puertas de enlace de IA evitar el bloqueo mediante abstraer los detalles del proveedor. Como su aplicación solo se comunica con la API unificada de la puerta de enlace, nunca codifica de forma rígida los puntos finales específicos del proveedor. Por ejemplo, La puerta de enlace de TrueFoundry admite cualquier Compatible con OpenAI modelo, por lo que si escribes tu código en la API de estilo OpenAI de TrueFoundry, puedes cambiar entre OpenAI, Azure OpenAI, Anthropic o tus propios modelos con un cambio de configuración, sin necesidad de reescribir el código. Este desacoplamiento es fundamental.

True Foundry utiliza deliberadamente el formato estándar de la API de OpenAI para todas las solicitudes, lo que significa que puede seguir utilizando el conocido SDK de OpenAI o las bibliotecas cliente. Solo tienes que enviar las solicitudes a la pasarela de TrueFoundry en lugar de enviarlas directamente a un proveedor. En principio, la puerta de enlace traduce esas llamadas en las llamadas a la API del proveedor correspondientes, según sea necesario.

TrueFoundry también evita introducir su propio SDK personalizado. En su lugar, los desarrolladores utilizan las herramientas y los SDK existentes como antes, ya sean de OpenAI u otro cliente de código abierto, y los dirigen al punto final de la puerta de enlace. En efecto, no se crea ningún «bloqueo» nuevo al usar TrueFoundry, porque nunca tienes que «aceptar» una interfaz propietaria. Además, todos los formatos de datos y registros de TrueFoundry son de estándar abierto: por ejemplo, los registros se almacenan en Apache Parquet en un S3 administrado por el cliente y las métricas utilizan OpenTelemetry. Esto significa que puede exportar y analizar datos con cualquier herramienta que desee, lo que evita que los proveedores de datos se enreden aún más. En resumen, actuando como traductor y plano de control, Las pasarelas de IA como la de TrueFoundry garantizan que pueda intercambiar proveedores de modelos, mover cargas de trabajo a otro entorno o incluso autohospedar modelos sin tener que volver a escribir el código de la aplicación.

Descripción general de la arquitectura: cómo funciona

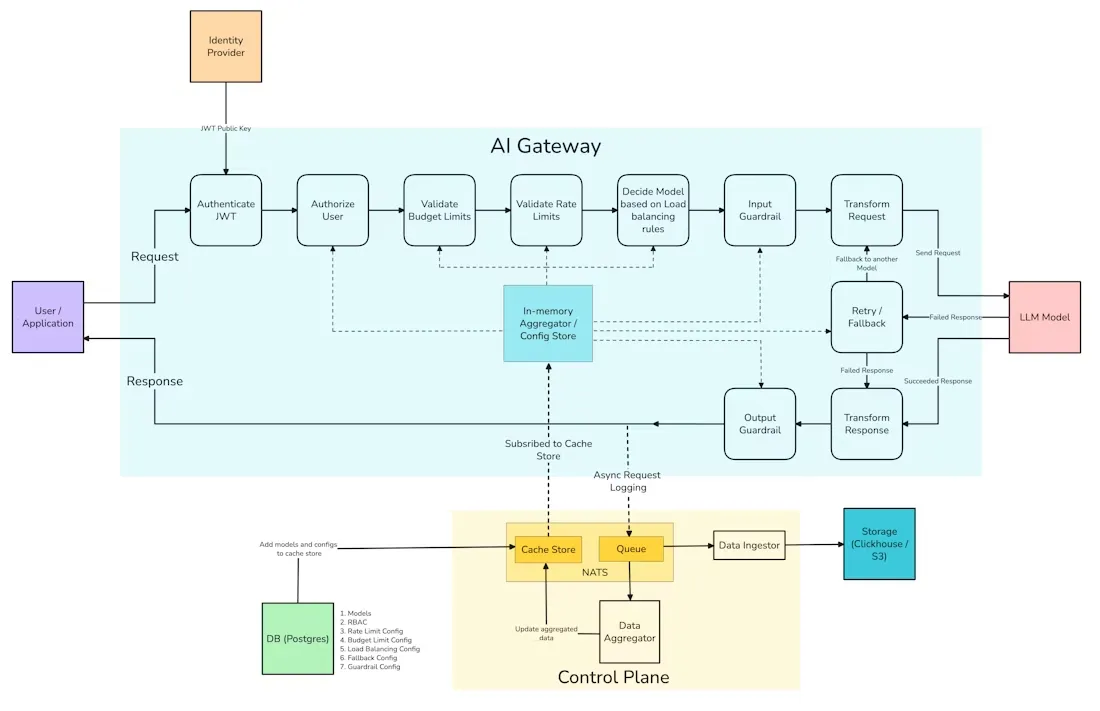

True Foundry Puerta de enlace de IA está diseñado para ofrecer una alta disponibilidad y una latencia mínima, al tiempo que aplica las políticas a escala. Su núcleo es una división plano de control/plano de datos arquitectura. En esencia, el plano de control (un servicio central) administra la configuración, los modelos, los usuarios y las políticas, mientras que los módulos de puerta de enlace livianos procesan las solicitudes de inferencia. Estos módulos de puerta de enlace están escritos en un marco de alto rendimiento basado en eventos (Hono) y son Vinculado a la CPU para mayor eficiencia.

Cuando llega una solicitud, la puerta de enlace funciona todo compruebas en la memoria: valida tu token y tus permisos de JWT, aplica límites de tarifas o límites presupuestarios y determina qué modelo usar. Es importante destacar que la solicitud se introduce en el formato JSON estándar compatible con OpenAI. Luego, la pasarela usa sus reglas de enrutamiento configuradas para elegir un proveedor modelo (por ejemplo, el más rápido o el más barato). Un incorporado adaptador el componente traduce la solicitud al formato específico esperado por la API de ese proveedor. Por ejemplo, si el modelo elegido está en AWS Bedrock o Anthropic, la puerta de enlace convierte la solicitud al estilo de OpenAI de forma adecuada. Esto significa que el código de la aplicación nunca cambia, aunque los distintos proveedores puedan esperar parámetros diferentes.

Una vez que el modelo responde, la puerta de enlace devuelve el resultado a la aplicación. Simultáneamente, registra de forma asincrónica la solicitud y la respuesta (tokens, latencia, costo, etc.) en un almacén central. Estos registros fluyen al backend de análisis de su propia nube (TrueFoundry los escribe como Parquet en S3 o en una tienda compatible con S3). En resumen, el diseño de TrueFoundry garantiza sin llamadas externas se necesitan en la ruta de solicitud (aparte del almacenamiento en caché), todas las decisiones políticas están en la memoria y los registros de solicitudes están desacoplados y son duraderos. El resultado es una puerta de enlace de IA que solo agrega ~3—5 ms de gastos generales por llamada, incluso con cientos de solicitudes por segundo. Su implementación agrupada en Kubernetes (mediante gráficos de Helm) le brinda la libertad de ejecutarlo en cualquier lugar (nube pública, centro de datos privado o perimetral) sin cambiar la capa de aplicación.

Figura: Arquitectura de alta disponibilidad de AI Gateway de TrueFoundry (plano de control y módulos de puerta de enlace).

Internamente, TrueFoundry usa una base de datos central (por ejemplo, PostgreSQL) y una cola de mensajes NATS para la distribución de la configuración. Todos los pods de gateway se suscriben a actualizaciones en tiempo real (usuarios, modelos, cuotas, métricas) a través de NATS, por lo que los cambios en las políticas se propagan al instante. Si un proveedor principal no está disponible, la puerta de enlace puede volver a intentarlo automáticamente o realizar una conmutación por error a un modelo alternativo. Este modelo modular, Diseño nativo de Kubernetes , combinado con un enfoque basado en API, garantiza que nunca estará atrapado en la infraestructura de TrueFoundry. Obtiene los manifiestos y las tablas de control, y conserva el control total sobre los detalles de la implementación.

Ventajas del uso de pasarelas de modelos de IA

1. Agnosticismo y flexibilidad de los proveedores: Por diseño, una puerta de enlace de IA hace que su pila de IA sea independiente del proveedor. La API unificada de TrueFoundry te permite conectarte sin problemas a ninguna Punto final compatible con OpenAI o más de 1000 modelos de visión y LLM compatibles. Puede cambiar los modelos subyacentes (por ejemplo, GPT, Claude, LLama, Mistral, Gemini, etc.) sin tocar el código de la aplicación, lo que constituye una defensa directa contra el bloqueo.

2. Interfaz unificada y soporte multimodelo: Un punto final de puerta de enlace reemplaza a numerosas API de proveedores. Esto simplifica el desarrollo (hay que mantener una integración) y permite la orquestación inteligente de varios modelos. Obtiene funciones como el enrutamiento inteligente (envía las solicitudes al modelo más rápido o económico) y la gestión alternativa de forma automática.

3. Controles empresariales: Las pasarelas gestionan de forma nativa las necesidades empresariales. La puerta de enlace de TrueFoundry aplica la autenticación (claves de API, OAuth, etc.), el RBAC detallado, la limitación de velocidad y las barreras de protección del contenido en cada llamada. También captura los registros de auditoría para garantizar su cumplimiento. Estas medidas de seguridad se aplican de manera uniforme en todos los modelos y proveedores, a diferencia de las integraciones personalizadas.

4. Gestión de costos y uso: Como las pasarelas de IA ven todas las solicitudes, pueden rastrear el uso de los tokens y los presupuestos. TrueFoundry proporciona un seguimiento de los costos en tiempo real y límites presupuestarios por equipo o modelo, lo que ayuda a evitar cargos desorbitados. Este control de costos centralizado es mucho más fácil que hacer agujeros en la consola de cada proveedor.

5. Observabilidad y estándares abiertos: El registro y la telemetría centrados en las pasarelas brindan una visibilidad sin igual de las cargas de trabajo de IA. Los registros de TrueFoundry cumplen con los requisitos de Otel y están en formatos abiertos, por lo que puedes enviarlos a cualquier herramienta de observabilidad (por ejemplo, Datadog o Grafana). Como los datos se encuentran en tus propios cubos de S3 como Parquet, realmente propio sus análisis; esto evita cualquier bloqueo de datos oculto.

6. Escalabilidad y confiabilidad: Una puerta de enlace bien construida reduce los gastos generales. Los puntos de referencia de TrueFoundry muestran solo entre 3 y 4 ms de latencia adicional a aproximadamente 250 RPS en un solo núcleo de CPU. La puerta de enlace se escala horizontalmente y su diseño (sin un punto único de error en la ruta de solicitud) garantiza una alta disponibilidad. En resumen, se obtiene una confiabilidad de nivel empresarial sin sacrificar el rendimiento.

7. Integración de ecosistemas: TrueFoundry expone un 100% impulsado por API plataforma. Puedes integrarla en CI/CD (GitOps), usar su proveedor Terraform o Helm Charts y conectarla a herramientas externas. Por ejemplo, los resultados o las métricas de TrueFoundry pueden utilizarse en SIEM o en las herramientas de gobernanza mediante OpenTelemetry. Esta apertura significa que usted conserva la posibilidad de elegir sus herramientas.

Mejores prácticas para prevenir el bloqueo de proveedores

Para evitar el bloqueo, aplique estos principios:

- Desacople la lógica de la aplicación: Interactúe siempre con los modelos a través de una abstracción (como una puerta de enlace de IA) en lugar de llamar directamente a las API de los proveedores. Esto mantiene el código específico del proveedor fuera de la lógica empresarial.

- Utilice estándares abiertos: Favorezca a los proveedores y plataformas que utilizan protocolos/formatos abiertos. El uso por parte de TrueFoundry de las especificaciones de la API de OpenAI y de los formatos de datos estándar (Parquet, Otel) es un ejemplo. De esta forma, puede cambiar a nuevas herramientas o proveedores sin obstáculos de propiedad.

- Contenerizar y autohospedarse: Implemente su pila de IA en infraestructuras comunes (por ejemplo, Kubernetes) para poder moverla entre las nubes o de forma local. TrueFoundry proporciona los manifiestos de Kubernetes para que tengas el control total de la implementación.

- Mantenga la portabilidad de los datos: Almacene modelos y registros en formatos neutros bajo su control. TrueFoundry garantiza que los registros vayan al almacenamiento administrado por el cliente e incluso admite el alojamiento de sus propios servidores modelo (servidores MCP) detrás de la puerta de enlace.

- Planifique las rutas de migración: Pruebe con regularidad los componentes móviles. La filosofía de TrueFoundry facilita explícitamente la migración: el código permanece igual y las especificaciones de implementación están abiertas.

- Evalúe las licencias y los precios: Evite los modelos de proveedores que penalizan las salidas. Los precios de TrueFoundry se basan en los asientos (en lugar de tarifas por uso) y están diseñados para que no te sorprendan los cambios en los costos a la hora de escalar.

- Documente y limite las extensiones específicas del proveedor: Si debe usar funciones exclusivas de proveedores, aíslelas para que el sistema principal siga siendo general. Lo ideal es reducirlas con el tiempo.

Al desarrollar estos hábitos (abstracción, estandarización y control), se reduce drásticamente el riesgo de quedarse atrapado.

Comparación: integración entre Gateway y Direct API

Como se muestra en la tabla, la integración directa puede ser la más sencilla para una prueba de concepto pequeña de un solo modelo, pero rápidamente se vuelve frágil durante la producción. El portal de IA de TrueFoundry supone un coste de rendimiento mínimo y predecible (solo unos pocos milisegundos) a cambio de enormes ganancias en flexibilidad y control. En la mayoría de los escenarios empresariales, vale la pena hacer esa compensación para evitar la dependencia de un solo proveedor y obtener funciones de nivel empresarial listas para usar.

Evaluación de las pasarelas de modelos de IA para prevenir el bloqueo de proveedores

Al elegir una puerta de enlace de IA (o cualquier plataforma de IA), tenga en cuenta estos factores de bloqueo:

- Soporte de múltiples proveedores: ¿La solución es compatible con todos los principales proveedores de LLM y permite modelos autohospedados? La pasarela de TrueFoundry se integra con cientos de modelos y permite añadir fácilmente modelos compatibles con OpenAI. Una puerta de enlace estrecha significa más capacidad de bloqueo.

- API y SDK abiertos: ¿Existe un SDK propietario o se pueden usar bibliotecas estándar de la industria? La compatibilidad de TrueFoundry con la API de OpenAI te permite usar los SDK existentes tal cual. Evita las herramientas que fuerzan el cierre de un SDK.

- Portabilidad de datos: ¿Puede exportar sus registros, datos de modelos y métricas en formatos abiertos? TrueFoundry escribe los registros como Parquet en su S3 y usa OpenTelemetry para las métricas. Las pasarelas que mantienen los datos atrapados en bases de datos propietarias aumentan el riesgo de bloqueo.

- Libertad de despliegue: ¿Está vinculado a una región de nube o puede ejecutar en las instalaciones? TrueFoundry ofrece opciones de SaaS y autohospedadas en cualquier entorno de Kubernetes. Una puerta de enlace que solo se ejecuta en la nube del proveedor crea una dependencia a largo plazo.

- Modelo de precios: ¿La estructura de costos penaliza el crecimiento o el cambio? Los precios basados en los asientos de TrueFoundry están diseñados para mantener su productividad sin tener que pagar tarifas de báscula sorprendentes. Examine cómo cambian los precios de un proveedor si amplía o migra.

- Integración de ecosistemas: ¿La pasarela puede funcionar con su cadena de herramientas actual (CI/CD, monitoreo, seguridad)? TrueFoundry cuenta con API, compatibilidad con GitOps y conectores para los marcos de aprendizaje automático más populares (LangChain, etc.). Si una puerta de enlace te obliga a adoptar un flujo de trabajo completamente nuevo, es una señal de alerta.

En resumen, busque diseños abiertos y modulares (como los módulos de plano dividido y basados en complementos de TrueFoundry), datos portátiles y visibilidad total del funcionamiento del sistema. El enfoque de TrueFoundry (modular, nativo de Kubernetes y que utiliza estándares abiertos) cumple con estos requisitos para minimizar la dependencia. Su filosofía es clara: «no depender de ningún proveedor» para que puedas migrar o hacer evolucionar tu sistema de IA según tus propias condiciones.

Conclusión

La dependencia de los proveedores es un coste oculto del desarrollo de la IA que puede dejar a las organizaciones vulnerables a las subidas de precios, las interrupciones y el estancamiento. El uso de un modelo de pasarela de IA es una de las maneras más eficaces de evitar estas dificultades. Al canalizar todas las solicitudes del modelo a través de una interfaz unificada e independiente, las pasarelas eliminan las dependencias codificadas de un solo proveedor. La pasarela de IA de TrueFoundry encarna este enfoque: desvincula su aplicación de las API de LLM específicas, adopta estándares abiertos y garantiza que mantenga el control total sobre la infraestructura y los datos. El resultado es una mayor agilidad: puede evaluar nuevos modelos, cambiar las cargas de trabajo de una nube a otra o implementarlas en las instalaciones sin tener que volver a escribir el código principal.

En resumen, piense en una puerta de enlace de IA como póliza de seguro contra bloqueo. True Foundry la implementación va aún más allá al ofrecer funciones de nivel empresarial (RBAC, observabilidad, controles de costos) y portabilidad abierta, de modo que sus sistemas de IA siguen siendo flexibles, escalables y preparados para el futuro.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)