Integración de TrueFoundry AI Gateway con Last9

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

A medida que la IA generativa avanza hacia los recorridos críticos de los usuarios, la búsqueda, el soporte para la toma de decisiones y la automatización, desaparece la tolerancia a la confiabilidad basada en el «máximo esfuerzo». Los equipos de plataforma y SRE ahora necesitan el mismo nivel de observabilidad del tráfico de LLM que el que ya esperan de los microservicios principales:

- ¿Cuál es la latencia de extremo a extremo para cada ruta de solicitud?

- ¿Qué modelos, inquilinos o regiones generan errores en los presupuestos?

- ¿Cómo correlacionamos el comportamiento de LLM con el resto de la pila?

La integración entre Puerta de enlace de IA TrueFoundry y Últimos 9 aborda exactamente este problema. Al exportar los rastros de OpenTelemetry (OTEL) de Gateway a Last9, los equipos obtienen una capacidad de observación profunda y rentable de todo el tráfico de LLM, sin tener que reescribir las aplicaciones ni dispersar los SDK entre los servicios.

En este artículo se explica:

- Qué ofrecen Last9 y TrueFoundry AI Gateway

- Cómo funciona la integración a nivel arquitectónico

- Una vista práctica y paso a paso de la configuración

- Los beneficios concretos para los equipos de SRE, plataforma e IA

Last9: Observabilidad diseñada para sistemas de alta cardinalidad

Últimos 9 es una plataforma de observabilidad moderna centrada en la administración de telemetría de alto rendimiento en registros, métricas y rastreos. Está diseñada específicamente para entornos en los que la cardinalidad y la escala no son negociables

Las capacidades clave relevantes para las cargas de trabajo de LLM incluyen:

- Gestión de alta cardinalidad: Last9 puede ingerir y consultar telemetría etiquetada con dimensiones enriquecidas, como usuario, inquilino, ruta, proveedor, modelo y versión inmediata, sin penalizaciones prohibitivas en cuanto a rendimiento ni costes.

- Telemetría unificada: los registros, las métricas y los rastreos se encuentran en una sola plataforma, lo que permite a los equipos pasar sin problemas de una infracción de SLO o un pico de latencia al seguimiento y el intervalo exactos que lo provocaron.

- Diseño nativo de OpenTelemetry: Last9 se basa en OTEL, lo que facilita la integración de cualquier componente que hable con Otel.

Esto hace Últimos 9 una opción natural para las empresas que están estandarizando el OTEL en toda su infraestructura y desean que la observabilidad de la LLM se incorpore a esa misma estrategia.

TrueFoundry AI Gateway: plano de control unificado para el tráfico de LLM

Puerta de enlace de IA TrueFoundry actúa como una capa de proxy entre las aplicaciones y los proveedores de LLM o servidores MCP. Proporciona una interfaz unificada y compatible con OpenAI para cientos de modelos, al tiempo que centraliza la gobernanza, la seguridad, el enrutamiento y la observabilidad.

Las capacidades principales incluyen:

- Acceso unificado a las API en más de 250 modelos y proveedores

- Enrutamiento de baja latencia y equilibrio de carga sofisticado

- Seguridad empresarial: RBAC, registro de auditoría, controles de cuotas y costos

- Observabilidad nativa con registro de solicitudes/respuestas, métricas y seguimientos

Fundamentalmente, AI Gateway puede exportar las trazas de OTEL a sistemas externos, por lo que la telemetría de su LLM pasa a formar parte del mismo tejido de observabilidad que el resto de su infraestructura.

Descripción general de la integración: cómo funcionan juntos TrueFoundry y Last9

En un nivel alto, la integración es sencilla:

- Las aplicaciones envían todo el tráfico de LLM a TrueFoundry AI Gateway en lugar de enviarlo directamente a los proveedores de modelos.

- AI Gateway dirige la solicitud al modelo configurado (OpenAI, Claude, Gemini, autohospedado, etc.) y aplica enrutamiento, límites de velocidad y barandas según sea necesario.

- Para cada solicitud, AI Gateway emite trazas de OpenTelemetry que capturan los intervalos para el manejo de la puerta de enlace, las llamadas de modelo salientes, las operaciones de MCP y más.

- Estos rastreos OTEL se exportan a través de HTTP al punto final OTLP de Last9.

- En Last9, los rastreos se visualizan en la interfaz de usuario de Traces, con mapas térmicos de duración, listas de seguimiento detalladas y datos a nivel de intervalo para

puerta de enlace tfy-llmservicio.

No hay cambios de código en la lógica de la aplicación. Una vez configurado el exportador OTEL de Gateway, todas las solicitudes de LLM pasan a ser observables automáticamente en Last9.

Prerrequisitos

Para habilitar la integración, necesitarás:

- Cuenta de TrueFoundry con AI Gateway configurada y al menos un proveedor de modelos configurado. Puedes seguir el Gateway Guía de inicio rápido en los documentos de TrueFoundry.

- Cuenta de Last9 con acceso al panel de control de Last9.

Una vez implementadas, el resto de la configuración se realiza completamente a través de las interfaces de usuario respectivas.

Guía de integración paso a paso

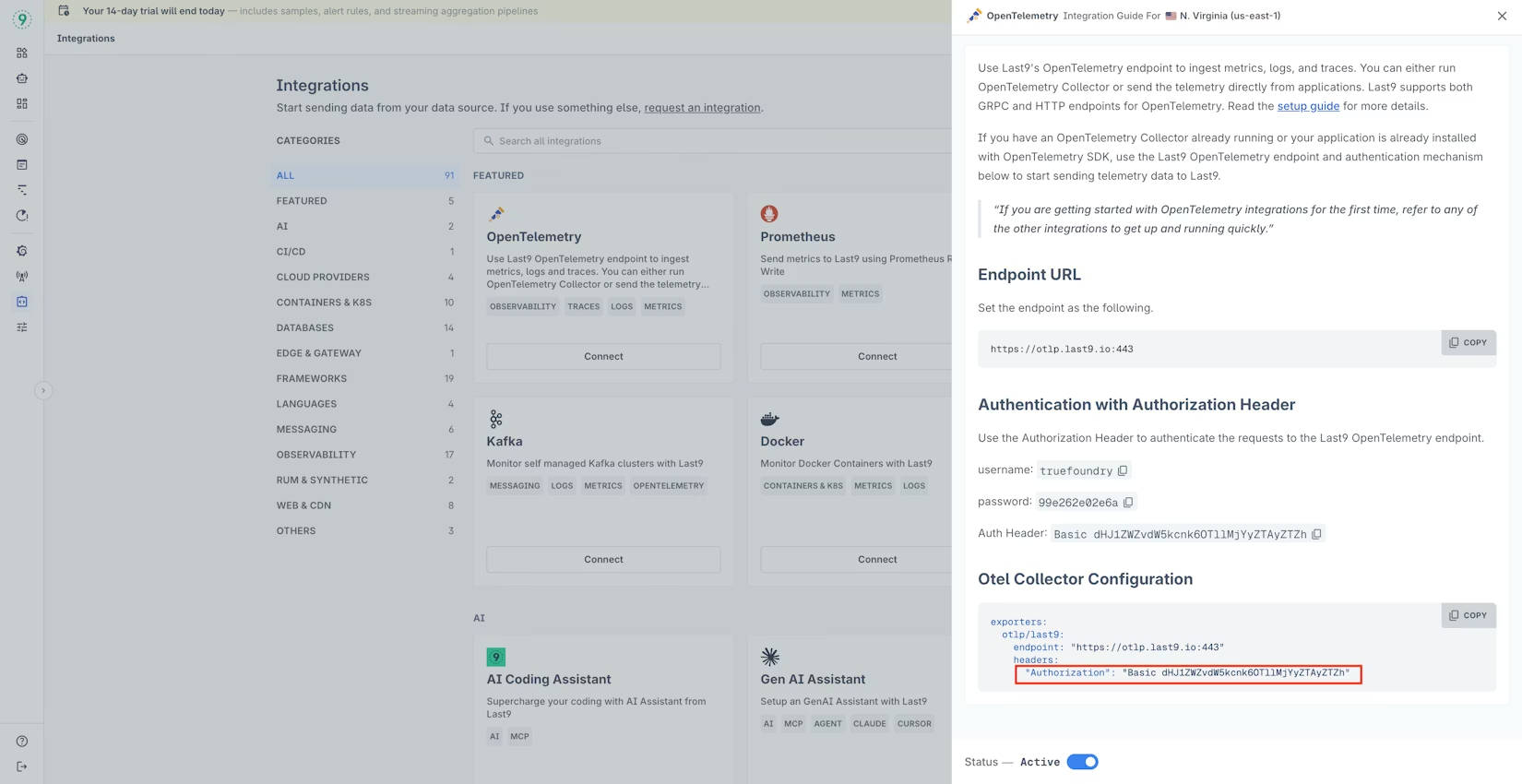

1. Recupera el encabezado de autorización de Last9

Desde el panel de control de Last9:

- Inicia sesión en Last9.

- Navega hasta Integraciones en la barra lateral izquierda.

- Haga clic en Conectar en la tarjeta de integración de OpenTelemetry.

- En la guía de integración, busca «Autenticación con encabezado de autorización».

- Copie el valor del encabezado de autenticación proporcionado, que ya está formateado, por ejemplo:

DHJ1zwzvdw5kcnk6 básico...

Este encabezado se pasará directamente de TrueFoundry a Last9 para la autenticación OTEL.

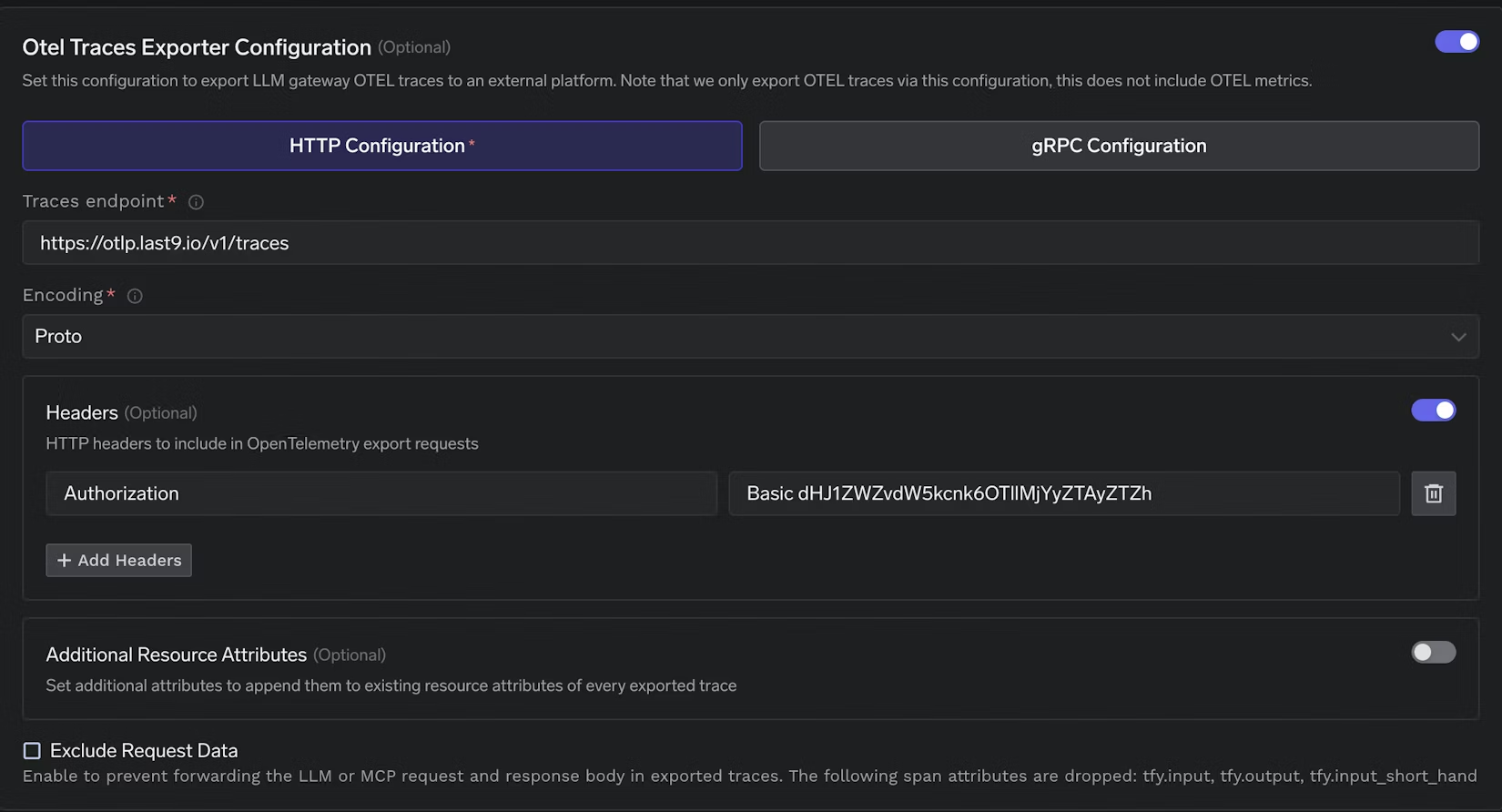

2. Configure la exportación de OTEL en TrueFoundry AI Gateway

En la consola de TrueFoundry:

- Ve a AI Gateway → Controles → Configuración OTEL.

- Active la opción Configuración del exportador de Otel Traces.

- Seleccione la pestaña Configuración HTTP.

3. Configure el punto final de Last9 OTLP

En la configuración HTTP, proporcione los valores siguientes:

- Punto final de rastreo

https://otlp.last9.io/v1/traces- Codificación

Proto

Este es el punto final de ingestión de OTLP de Last9 para los rastros.

4. Agregue el encabezado de autorización requerido

En la misma pantalla de configuración, haga clic en «+ Agregar encabezados» y añada: Pegue el encabezado de autenticación exactamente como lo copió de la interfaz de usuario de Last9 (por ejemplo, DHJ1zwzvdw5kcnk6 básico...). No se requiere ningún formato adicional.

5. Guarde la configuración

Haga clic en Guardar para aplicar la configuración de exportación de OTEL. A partir de este momento, todos los rastros de LLM del TrueFoundry AI Gateway se exportarán a Last9.

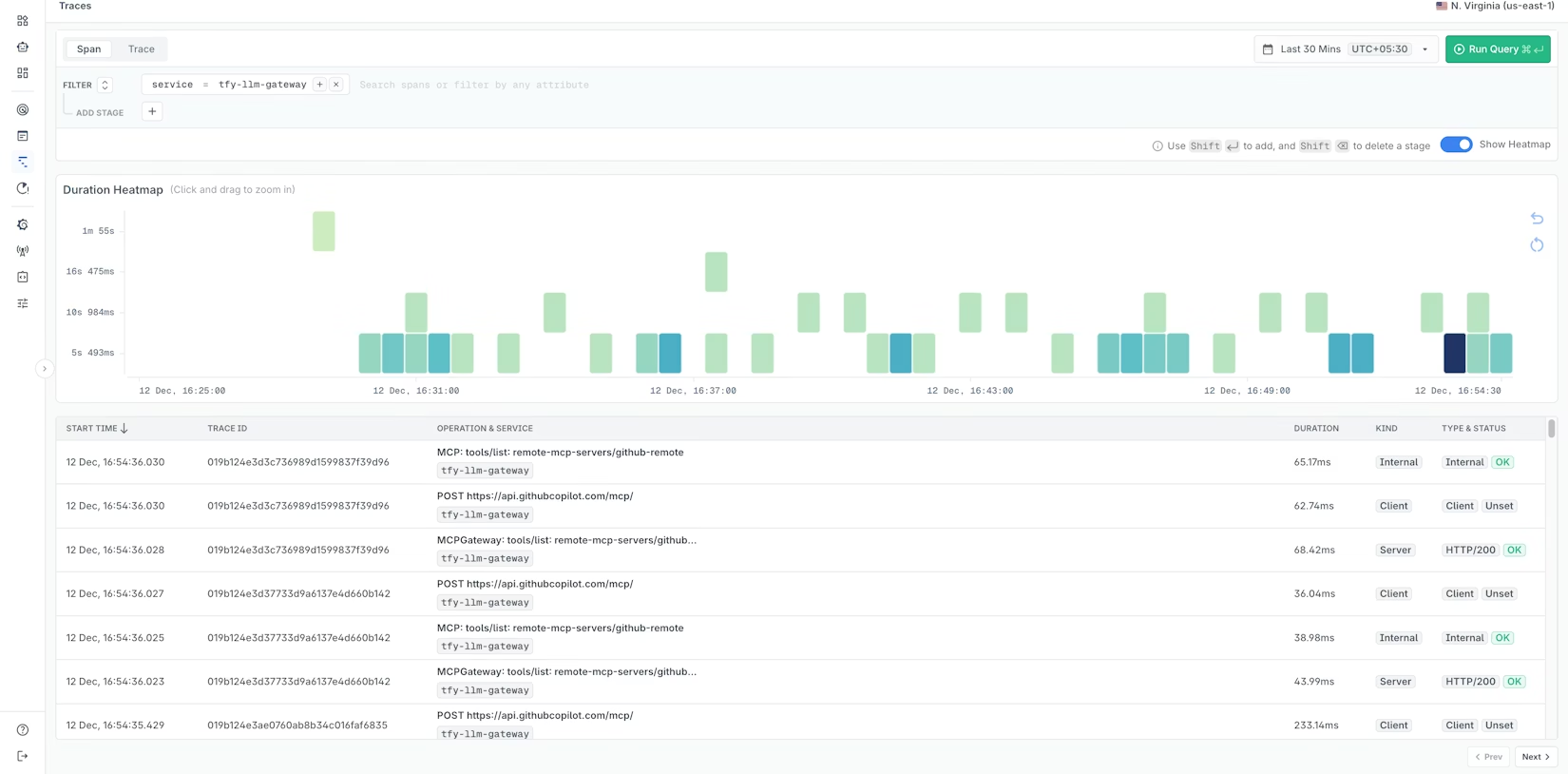

6. Ver LLM Traces en Last9

Una vez que el tráfico de LLM pase por la puerta de enlace, abra el panel de control de Last9:

- Navega hasta la sección Rastros.

- Filtrar por nombre de servicio:

puerta de enlace tfy-llm- Explore:

- Mapa térmico de duración: visualice las tendencias de latencia y los valores atípicos a lo largo del tiempo.

- Detalles del seguimiento: consulte los seguimientos individuales con los nombres de las operaciones, las duraciones y los códigos de estado.

- Información de intervalos: inspeccione los intervalos en busca de llamadas HTTP, operaciones de MCP y solicitudes de LLM subyacentes.

Esto le brinda una visión integral de cómo se comportan los proveedores de Gateway y descendentes en condiciones de producción reales.

Configuración avanzada: enriquecimiento de las trazas con atributos de recursos

La configuración OTEL de TrueFoundry admite atributos de recursos adicionales, lo que le permite adjuntar metadatos personalizados a cada rastreo exportado. Esto es particularmente potente cuando se combina con las capacidades de alta cardinalidad de Last9.

Entre los atributos típicos que puede querer agregar se incluyen los siguientes:

env=prod,env=puesta en escenaregión=Estados Unidos-Este-1,región=eu-west-1equipo=plataforma,equipo=buscartenant_id=cliente-empresarial a

En Last9, estos atributos se pueden usar para:

- Compare las tasas de latencia o error entre regiones y entornos

- Aísle los incidentes que afectan a la superficie de un inquilino o producto específico

- Cree paneles por equipo o unidad de negocio sin duplicar la telemetría

Si planifica su estrategia de atributos por adelantado, permite realizar consultas más completas y analizar la causa raíz con mayor rapidez en el futuro.

Qué aporta esta integración a sus equipos

For platforms Engineering and SRE

- Visibilidad del nivel de producción del tráfico de LLM: identifique los picos de latencia, los puntos críticos de error y la saturación en tiempo real, con un contexto de seguimiento completo detrás de cada evento.

- Respuesta más rápida a los incidentes: pase de un SLO fallido al seguimiento y el intervalo precisos que lo causan, ya sea un servicio ascendente, un proveedor de modelos específico o una ruta mal configurada.

- Herramientas consistentes: mantenga la observabilidad de la LLM dentro de los mismos flujos de trabajo y paneles basados en Otel que utiliza para el resto de sus microservicios.

For IA equipment and Applications

- Experimentación segura con modelos e indicaciones: implemente nuevas versiones de modelos, reglas de enrutamiento o estrategias rápidas a través de TrueFoundry y observe el impacto directamente en las trazas y mapas térmicos de Last9.

- Conciencia del rendimiento y los costos: correlacione las interacciones lentas o fallidas con rutas, inquilinos o modelos específicos, e incorpore esa información a las políticas de enrutamiento y almacenamiento en caché del Gateway.

- Separación más clara de las preocupaciones: los desarrolladores se centran en la lógica de las aplicaciones y en el comportamiento de los agentes; Gateway y Last9 gestionan conjuntamente el enrutamiento, la gobernanza y la observabilidad.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)