Las 9 principales alternativas y competidores de IA de Cloudflare para 2026

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Cloudflare La IA se ha convertido rápidamente en una opción popular para los desarrolladores que desean ejecutar inferencias de IA ligeras en la periferia. Para casos de uso como la generación de texto con baja latencia, el procesamiento básico de imágenes o la experimentación cerca de los usuarios, Cloudflare ofrece una experiencia de desarrollador excelente con una configuración mínima.

Sin embargo, a medida que las cargas de trabajo de IA evolucionan hacia Requisitos de escala para 2026 - los flujos de trabajo de las agencias, el enrutamiento multimodelo, las enormes canalizaciones de RAG y una gobernanza empresarial estricta: muchos equipos comienzan a encontrar limitaciones reales con el enfoque de Cloudflare.

Los puntos de fricción más comunes incluyen:

- Bloqueo de proveedor: Estás limitado al catálogo de modelos seleccionados de Cloudflare, con un control limitado sobre las versiones, los ajustes o los modelos personalizados.

- Privacidad y control de los datos: La inferencia se ejecuta dentro del entorno gestionado de Cloudflare, lo que crea una «caja negra» para los equipos que necesitan un aislamiento total a nivel de VPC o garantías reglamentarias.

- Coste a escala: Los precios por solicitud sin servidor pueden resultar caros e impredecibles en comparación con los clústeres de GPU optimizados o las instancias puntuales.

- Soporte de ciclo de vida limitado: Cloudflare se centra principalmente en la inferencia, dejando el entrenamiento, el ajuste y la orquestación más profunda a sistemas externos.

A medida que los sistemas de IA maduran, los equipos buscan cada vez más Alternativas a Cloudflare AI que ofrecen más control, mejor rentabilidad y una flexibilidad de modelo más amplia sin sacrificar la velocidad de los desarrolladores.

En esta guía, clasificamos los principales alternativas y competidores de IA de Cloudflare para 2026, con un enfoque especial en las plataformas que equilibran la facilidad de uso con la propiedad de la infraestructura. También destacaremos por qué True Foundry se perfila como la mejor opción para las empresas que desean lo mejor de ambos mundos: la simplicidad de Cloudflare, combinada con el control y la escalabilidad de ejecutar la IA en su propia nube.

¿Cómo evaluamos las alternativas de Cloudflare?

No todos los «competidores de Cloudflare» resuelven el mismo problema. Algunas plataformas se optimizan para la experimentación, otras para el acceso sin procesar a la GPU, y solo unas pocas están diseñadas para sistemas de IA de nivel de producción a escala. Para crear una comparación justa y práctica, evaluamos cada alternativa utilizando los siguientes criterios:

1. Control de infraestructura

¿La plataforma puede ejecutarse en tu propia cuenta de AWS, GCP o Azure o estás bloqueado en un entorno administrado por un proveedor? La propiedad de la infraestructura es cada vez más importante para la privacidad de los datos, el cumplimiento y la optimización de costos a largo plazo.

2. Flexibilidad del modelo

¿La plataforma le permite implementar cualquier modelo incluyendo Llama 3, Mistral, incrustaciones personalizadas o modelos patentados, ¿o está limitado a un catálogo fijo?

3. Eficiencia de costos a escala

Comparamos los precios del margen de beneficio sin servidor con las opciones que admiten:

- Acceso sin procesar a la GPU

- Instancias puntuales

- Escalado automático de clústeres de Kubernetes

Las plataformas que ofrecen estructuras de costes transparentes y predecibles obtienen una puntuación más alta para las cargas de trabajo a gran escala.

4. Soporte para cargas de trabajo de IA modernas

¿La plataforma gestiona:

- Flujos de trabajo de agencia

- Tuberías RAG de gran tamaño

- Enrutamiento multimodelo

- Ejecución basada en herramientas y MCP

- La inferencia solo perimetral ya no es suficiente para muchos equipos.

5. Experiencia de desarrollador

¿Qué tan rápido pueden los desarrolladores pasar del código a la producción? Evaluamos los problemas de incorporación, las API, los SDK y la complejidad operativa desde el segundo día.

6. Preparación para la producción

Evaluamos la observabilidad, el monitoreo, la gobernanza y los controles operativos, áreas que se vuelven críticas una vez que los sistemas de IA van más allá de los prototipos. Con estos criterios, clasificamos las Las 9 mejores alternativas de IA de Cloudflare que están mejor posicionados para los equipos que crean productos de IA serios en 2026.

Las 9 mejores alternativas de IA de Cloudflare para 2026

A medida que los sistemas de IA van más allá de la simple inferencia perimetral hacia flujos de trabajo de agencia, canalizaciones de RAG a gran escala y orquestación multimodelo, los equipos necesitan plataformas que ofrezcan mucho más que solo API de inferencia sin servidor.

Las siguientes alternativas se seleccionaron en función de su capacidad de entrega:

- Propiedad o flexibilidad de la infraestructura

- Modele la libertad más allá de los catálogos seleccionados

- Eficiencia de costes a escala

- Preparación de la producción para las cargas de trabajo de IA modernas

Comenzamos con la alternativa global más sólida para los equipos que desean escalar la IA de manera seria en 2026.

TrueFoundry (la mejor alternativa general)

True Foundry es una plataforma de IA completa diseñada para equipos que desean ejecutar cargas de trabajo de IA de nivel de producción en su propia nube o VPC, sin renunciar a la velocidad de los desarrolladores. A diferencia de Cloudflare Workers AI, que abstrae por completo la infraestructura, TrueFoundry ofrece a los equipos controle donde importa - sin dejar de ofrecer una experiencia de alto nivel similar a la de PaaS.

TrueFoundry es compatible con todo el ciclo de vida de la IA, desde el entrenamiento y el ajuste hasta la implementación, la inferencia y la observabilidad. En esencia, permite a los equipos implementar cualquier modelo, ya sea de código abierto o propietario, en Kubernetes en AWS, GCP o Azure, con escalado, controles de costos y gobernanza integrados. Esto lo hace especialmente adecuado para las empresas que crean sistemas de IA de larga duración en lugar de demostraciones avanzadas ligeras.

Características principales

- Implemente cargas de trabajo de IA en su propia nube o VPC

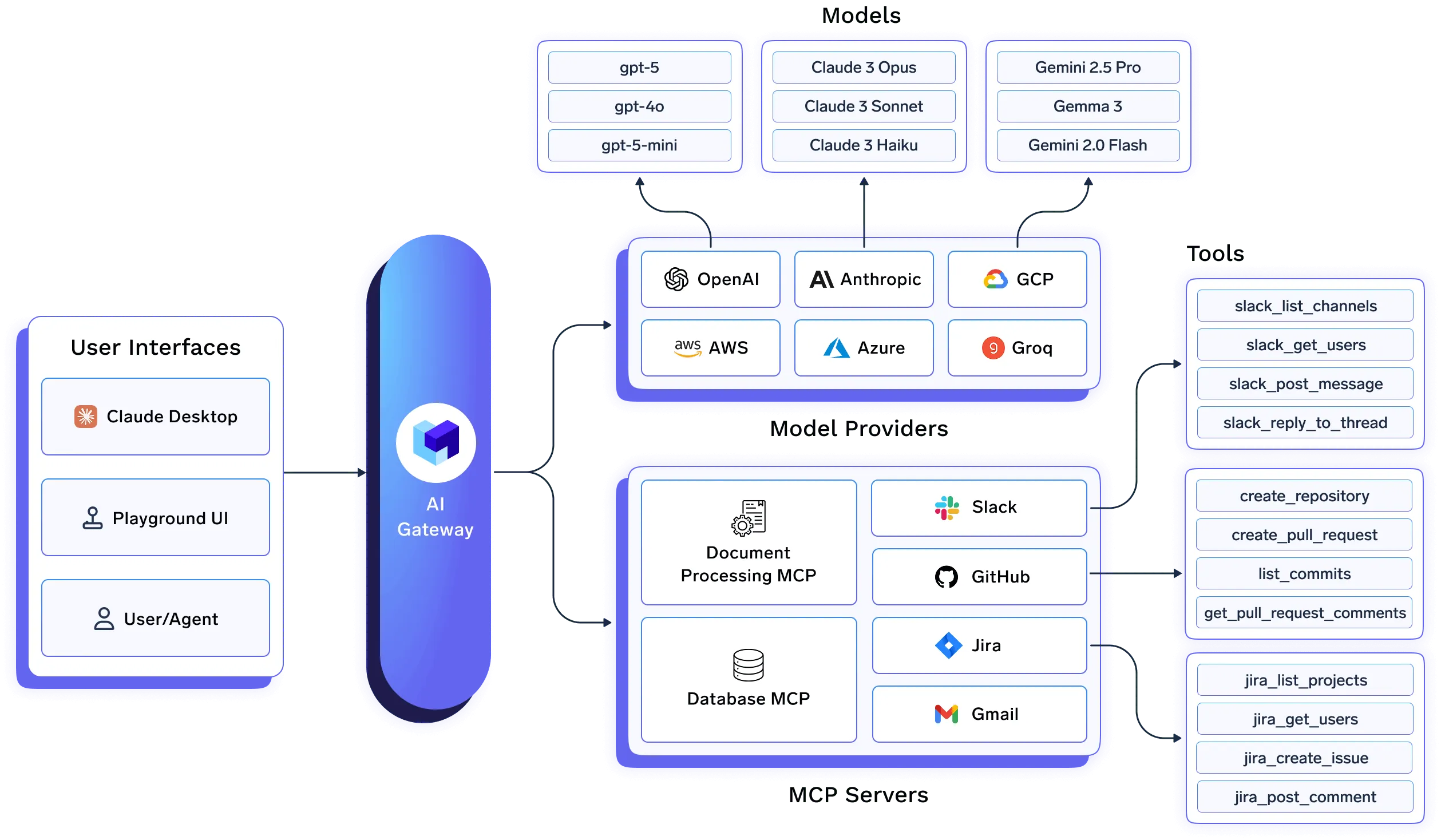

Ejecute cargas de trabajo de inferencia y entrenamiento directamente en su cuenta de AWS, GCP o Azure en Kubernetes, garantizando la propiedad total de los datos, el cumplimiento y el aislamiento de la red. - Puerta de enlace con IA para enrutamiento y control multimodelo

Dirija el tráfico entre varios proveedores de LLM y modelos autohospedados, aplique los presupuestos, los límites de tarifas y las políticas, y evite la dependencia de un solo proveedor. - Registro de MCP y agentes

Gestione las herramientas, los servidores MCP y la ejecución de agentes de forma centralizada, lo que permite flujos de trabajo de agencia seguros y escalables más allá de la simple inferencia. - Gestión rápida del ciclo de vida

Las solicitudes de versión, prueba e implementación de forma sistemática en lugar de tratarlas como código de aplicación sin seguimiento. - Observabilidad y visibilidad de costos incorporadas

Realice un seguimiento de los tokens, la latencia, los errores y el gasto a nivel de solicitud, en todos los modelos, equipos y entornos. - Escalado automático y optimización de GPU a nivel de producción

Usa el escalado automático, las instancias puntuales y la programación optimizada de GPU para reducir significativamente los costos de inferencia en comparación con los modelos de precios sin servidor.

Por qué TrueFoundry es una mejor opción que la IA de Cloudflare Workers

Cloudflare se destaca en la inferencia basada en bordes, pero TrueFoundry está diseñado para propiedad, escala y flexibilidad:

- Sin necesidad de depender de un modelo, implemente cualquier modelo personalizado o de código abierto

- Privacidad de datos total a nivel de VPC

- Costos predecibles mediante procesamiento optimizado en lugar de precios por solicitud

- Soporte para agentes, canalizaciones de RAG y flujos de trabajo complejos

- Cubre todo el ciclo de vida de la IA, no solo la inferencia

Planes de precios

TrueFoundry sigue a modelo de precios transparente y basado en el uso, alineado con la forma en que los equipos consumen realmente la infraestructura.

- Nivel gratuito: Ideal para la experimentación y los equipos pequeños

- Nivel de crecimiento: Para cargas de trabajo de producción con necesidades de escalabilidad y observabilidad

- Nivel empresarial: Gobernanza avanzada, seguridad e implementaciones personalizadas

Dado que las cargas de trabajo se ejecutan en su propia nube, los costos de infraestructura permanecen visibles y optimizables, a diferencia de los precios opacos de los sistemas sin servidor.

Qué dicen los clientes sobre TrueFoundry

TrueFoundry tiene una alta calificación en plataformas como G2 y Capterra, con elogios constantes por:

- Facilidad de implementación de la IA en entornos de nube privada

- Sólida visibilidad y control de costos

- Soporte confiable para sistemas de IA de producción

Muchos clientes destacan cómo TrueFoundry les ayudó a pasar de los prototipos a plataformas de IA escalables y compatibles sin tener que reconstruir su oferta.

AWS Bedrock

Amazon Web Services Bedrock es el servicio gestionado de AWS para acceder a modelos básicos como Anthropic Claude, Amazon Titan y algunos modelos de terceros. Está diseñado para equipos que ya han invertido mucho en el ecosistema de AWS y desean una forma nativa de consumir las LLM sin tener que gestionar directamente la infraestructura.

Si bien Bedrock elimina los gastos operativos, sigue siendo modelo gestionado que prioriza las API eso limita la flexibilidad a medida que las cargas de trabajo se vuelven más complejas.

Características principales

- Acceso gestionado a los modelos básicos (Claude, Titan, etc.)

- Integración nativa de AWS IAM

- API de inferencia sin servidor

- Barandas integradas y monitoreo básico

Planes de precios

- Precios de pago por solicitud o basados en fichas

- Precios separados por proveedor de modelos

- Costos adicionales de AWS para el registro, el almacenamiento y las redes

Pros

- Estrecha integración con los servicios de AWS

- No se requiere administración de infraestructura

- Valores predeterminados de seguridad aptos para empresas

Contras

- Soporte limitado para modelos de código abierto personalizados o ajustados

- Los precios se vuelven caros a gran escala

- Centrado principalmente en la inferencia, no en el ciclo de vida completo de la IA

- Encerrados en el ecosistema de AWS

Por qué TrueFoundry es mejor que AWS Bedrock

TrueFoundry permite a los equipos implementar cualquier modelo en su propia infraestructura, que incluyen modelos de código abierto perfeccionados, al tiempo que ofrecen una mejor previsibilidad de los costos mediante instancias puntuales y escalado automático. A diferencia de Bedrock, TrueFoundry es independiente de la nube y es compatible con todo el ciclo de vida de la IA más allá de las API de inferencia gestionadas.

Runpod

RunPod es una plataforma de GPU en la nube popular entre los desarrolladores que desean acceder a las GPU a bajo costo para inferencias o experimentos. Suele utilizarse como una alternativa a Cloudflare cuando los equipos superan los precios de la tecnología sin servidor y quieren tener el control directo de la computación.

Runpod se centra en acceso sin procesar a la GPU, dejando la orquestación, el escalado y la gobernanza en gran medida en manos del usuario.

Características principales

- Instancias de GPU puntuales y bajo demanda

- Soporte para contenedores personalizados

- GPU de menor costo en comparación con los hiperescaladores

- Flujos de trabajo de despliegue sencillos

Planes de precios

- Precios de GPU por hora

- Reduzca los costos mediante instancias puntuales

- Pague solo por la computación utilizada

Pros

- Acceso rentable a la GPU

- Bueno para experimentación y modelos personalizados

- Despliegue flexible basado en contenedores

Contras

- Observabilidad y gobernanza integradas limitadas

- Sin puerta de enlace de IA nativa ni gestión del tráfico

- Requiere un esfuerzo significativo de DevOps para la producción

- No está diseñado para sistemas de agentes complejos

Por qué TrueFoundry es mejor que Runpod

TrueFoundry ofrece orquestación, observabilidad y gobernanza listas para la producción además de Kubernetes, sin dejar de permitir la optimización de costos mediante instancias puntuales. Los equipos obtienen los beneficios de una eficiencia informática sin tener que crear y mantener su propia capa de plataforma.

Replicar

Replicar es una popular plataforma basada en API que facilita la ejecución de modelos de código abierto sin administrar la infraestructura. Los desarrolladores pueden implementar modelos con una configuración mínima y pagar por segundo de ejecución, lo que hace que Replicate sea atractivo para la creación de prototipos y la producción a pequeña escala.

Sin embargo, la conveniencia de Replicate implica desventajas a medida que las cargas de trabajo se escalan y los requisitos en torno a la privacidad, la previsibilidad de los costos y la personalización aumentan.

Características principales

- Inferencia alojada para modelos populares de código abierto

- API REST sencillas para la invocación de modelos

- Escalado automático y alojamiento de modelos

- Catálogo de modelos impulsado por la comunidad

Planes de precios

- Precios basados en el uso (por segundo de ejecución)

- Diferentes tarifas por modelo y tipo de hardware

- Sin planes mensuales fijos

Pros

- Empezar es extremadamente fácil

- Sin sobrecarga de infraestructura ni de DevOps

- Buena selección de modelos comunitarios

Contras

- Control limitado sobre la infraestructura y las redes

- Los costos pueden volverse impredecibles a gran escala

- Observabilidad y gobernanza mínimas

- Modelo de implementación solo para SaaS

Por qué TrueFoundry es mejor que Replicate

TrueFoundry permite a los equipos ejecutan los mismos modelos de código abierto dentro de su propia nube, con total observabilidad, gobernanza y optimización de costos. A diferencia de la ejecución automática de Replicate, TrueFoundry ofrece a los equipos de plataforma visibilidad y control sobre el rendimiento, los datos y los gastos.

Inteligencia artificial de Google Vertex

Inteligencia artificial de Google Vertex es la plataforma integral de Google Cloud para entrenar, implementar y ofrecer modelos de aprendizaje automático y LLM. Es compatible con los modelos Gemini de Google, así como con la formación personalizada y los procesos gestionados, lo que la convierte en una buena opción para los equipos estandarizados en GCP.

Si bien es potente, la IA de Vertex sigue estrechamente vinculada a Google Cloud y sigue un enfoque de servicio gestionado que limita la flexibilidad de las estrategias híbridas o de múltiples nubes.

Características principales

- Canalizaciones gestionadas de formación e inferencia

- Acceso a modelos Gemini y de terceros

- MLOps y seguimiento de experimentos integrados

- Integración nativa de IAM y seguridad de GCP

Planes de precios

- Precios basados en el uso para la formación y la inferencia

- Costos separados para procesamiento, almacenamiento y canalizaciones

- Precios premium para servicios gestionados

Pros

- Herramientas completas de ML e IA

- Sólida integración con el ecosistema de GCP

- Escalabilidad de nivel empresarial

Contras

- Bloqueado en Google Cloud

- Modelo de precios complejo

- Menor flexibilidad para la optimización personalizada de la infraestructura

- Peso pesado para equipos centrados principalmente en la inferencia

Por qué TrueFoundry es mejor que Google Vertex AI

TrueFoundry ofrece una plataforma más ligera e independiente de la nube que se centra en el despliegue, la inferencia y la gobernanza sin confinar a los equipos en un único hiperescalador. Proporciona más flexibilidad para optimizar los costos y ejecutar la IA de manera uniforme en AWS, GCP o Azure.

Modal

Modal es una plataforma sin servidor que da prioridad a los desarrolladores y que facilita la ejecución de cargas de trabajo de IA basadas en Python sin gestionar la infraestructura. Es popular para la experimentación rápida, las herramientas internas y los canales de inferencia ligeros.

Modal prioriza la velocidad de los desarrolladores, pero su capa de abstracción puede volverse limitante a medida que los sistemas de IA crecen en complejidad y escala.

Características principales

- Ejecución de Python sin servidor

- Escalado automático para cargas de trabajo de inferencia

- Soporte de GPU sin administración de infraestructura

- APIs sencillas para desarrolladores

Planes de precios

- Precios basados en el uso

- Los cargos se basan en el tiempo de procesamiento y los recursos

- No hay niveles de precios empresariales fijos que se publiquen

Pros

- Excelente experiencia para desarrolladores

- Tiempo de producción muy rápido

- Gastos generales mínimos de DevOps

Contras

- Control de infraestructura limitado

- Menos adecuado para flujos de trabajo de agentes complejos y de larga duración

- Implementación exclusiva de SaaS

- Gobernanza limitada y previsibilidad de costos a escala

Por qué TrueFoundry es mejor que Modal

TrueFoundry ofrece propiedad total de la infraestructura y control del ciclo de vida manteniendo una sólida experiencia de desarrollador. Es más adecuado para sistemas de IA de producción de larga duración que requieren gobernanza, costes predecibles y soporte para procesos complejos que van más allá de la simple ejecución sin servidores.

Puntos finales de inferencia de Hugging Face

Cara abrazada Los puntos finales de inferencia permiten a los equipos implementar modelos de Hugging Face como API administradas con una configuración mínima. Se usa ampliamente para ofrecer modelos de código abierto de forma rápida e integrarlos en las aplicaciones.

Si bien es conveniente, la naturaleza gestionada del servicio limita la flexibilidad para los equipos con requisitos estrictos de costos, redes o cumplimiento.

Características principales

- Alojamiento gestionado para modelos Hugging Face

- Soporte para arquitecturas populares de código abierto

- Escalado automático de los puntos finales de inferencia

- Fácil integración con el ecosistema Hugging Face

Planes de precios

- Precios por hora según el tipo de instancia

- Costos separados para la computación y el escalado automático

- Costos más altos para GPU más grandes

Pros

- Fácil acceso a los modelos de código abierto

- Ecosistema y comunidad sólidos

- Baja fricción de configuración

Contras

- Control limitado sobre la infraestructura subyacente

- Los costos aumentan rápidamente con la escala

- Menos adecuado para despliegues híbridos o de múltiples nubes

- La observabilidad y la gobernanza son básicas

Por qué TrueFoundry es mejor que abrazar los puntos finales de inferencia facial

TrueFoundry permite a los equipos implementan los mismos modelos de Hugging Face en su propia nube, con una mayor capacidad de observación, controles de costos y soporte para flujos de trabajo avanzados, como agentes y canalizaciones de RAG, sin depender de un modelo SaaS administrado.

Cualquier escala (Ray)

Cualquier escala es la plataforma comercial detrás de Ray, un marco de código abierto para cargas de trabajo de IA y computación distribuida. La utilizan con frecuencia los equipos que crean sistemas de inferencia, entrenamiento y agentes distribuidos y a gran escala que necesitan un control minucioso de la ejecución.

Anyscale es potente, pero supone un alto nivel de experiencia en plataformas y sistemas distribuidos, lo que puede ralentizar a los equipos que desean acelerar la producción.

Características principales

- Clústeres Ray gestionados

- Inferencia y entrenamiento distribuidos

- Soporte nativo para cargas de trabajo paralelas y de agentes

- Se adapta a grandes clústeres de GPU

Planes de precios

- Precios basados en el uso

- Costos relacionados con el tamaño y el tiempo de ejecución del clúster

- Precios empresariales para servicios gestionados

Pros

- Extremadamente flexible y potente

- Ideal para sistemas de IA complejos y distribuidos

- Sólida base de código abierto

Contras

- Curva de aprendizaje empinada

- Requiere experiencia específica de Ray

- Tiene menos opiniones sobre la gobernanza y los controles de costos

- Incorporación más lenta para equipos más pequeños

Por qué TrueFoundry es mejor que cualquier escala

TrueFoundry ofrece abstracciones listas para la producción encima de Kubernetes sin obligar a los equipos a crear todo con primitivas de Ray. Ofrece una incorporación más rápida, una capacidad de observación integrada y controles de costes, a la vez que admite flujos de trabajo complejos.

Laboratorios Lambda

Laboratorios Lambda proporciona una infraestructura de nube de GPU optimizada para las cargas de trabajo de aprendizaje automático. Se utiliza habitualmente como una alternativa rentable a los hiperescaladores para el entrenamiento y la inferencia.

Lambda Labs se centra en infraestructura sin procesar, dejando la orquestación, el escalado y la gobernanza exclusivamente en manos del usuario.

Características principales

- Instancias de GPU bajo demanda

- Precios competitivos para GPU de gama alta

- Implementaciones sin sistema operativo y basadas en máquinas virtuales

- Adecuado para entrenamiento e inferencia

Planes de precios

- Precios por hora por tipo de GPU

- Sin paquetes de servicios de plataforma

- Menor costo en comparación con los principales proveedores de nube

Pros

- Acceso rentable a la GPU

- Buen rendimiento para las cargas de trabajo de formación

- Modelo de infraestructura simple

Contras

- Sin funciones de plataforma de IA gestionada

- Requiere un esfuerzo significativo de DevOps

- Observabilidad y gobernanza limitadas

- No está optimizado para entornos de producción con varios equipos

Por qué TrueFoundry es mejor que Lambda Labs

TrueFoundry ofrece una capa completa de plataforma de IA - orquestación, observabilidad, escalamiento y gobierno, además de la infraestructura de nube. Los equipos obtienen los beneficios económicos de una computación optimizada sin necesidad de ensamblar y mantener su propia plataforma.

Una comparación detallada entre TrueFoundry y Cloudflare

Si bien ambas plataformas ayudan a los equipos a implementar modelos de IA, TrueFoundry y Cloudflare Workers AI están diseñados para etapas fundamentalmente diferentes de madurez de la IA. La siguiente tabla muestra cómo se comparan entre las dimensiones más importantes para las cargas de trabajo de IA a escala de 2026.

Por qué TrueFoundry es la opción estratégica para 2026

A medida que los sistemas de IA se vuelven más importantes para los productos y las operaciones, los equipos se están replanteando dónde y cómo se ejecuta la inferencia. Hay tres tendencias principales que explican por qué plataformas como TrueFoundry están ganando terreno frente a las soluciones exclusivas.

El cambio híbrido hacia la IA soberana

Para 2026, muchas organizaciones quieren son dueños de su pila de inferencias en lugar de confiar exclusivamente en las API administradas. La ejecución de modelos en su propia nube ofrece garantías más sólidas en cuanto a la residencia de los datos, el cumplimiento y la flexibilidad a largo plazo. TrueFoundry está diseñado para esta realidad híbrida, mientras que Cloudflare sigue optimizada para una ejecución perimetral centralizada.

Previsibilidad de costos a escala

La inferencia sin servidor es práctica, pero los costos pueden aumentar de manera impredecible a medida que aumentan el tráfico y la complejidad de los modelos. De TrueFoundry Funciones de FinOps y visibilidad de costos—combinados con instancias puntuales y escalado automático— ayudan a evitar la «factura excesiva» a la que suelen enfrentarse los equipos con proveedores sin servidor, como Cloudflare o Replicate.

Más allá de la inferencia

Cloudflare Workers AI es principalmente una capa de inferencia. TrueFoundry, por otro lado, admite la ciclo de vida completo de la IA desde la capacitación y el ajuste hasta el despliegue, la inferencia, la observabilidad y la gobernanza. Esto la convierte en una mejor plataforma a largo plazo para los equipos que desarrollan la IA como una capacidad básica, no solo como una función complementaria.

¿Está listo para escalar? Elija el socio de infraestructura adecuado

Cloudflare Workers AI es una excelente opción para aplicaciones periféricas, experimentación rápida e inferencias fáciles de usar para los desarrolladores cerca de los usuarios. Para proyectos de afición, prototipos y casos de uso extremos sensibles a la latencia, ofrece una experiencia rápida y elegante.

Sin embargo, a medida que los equipos avanzan hacia sistemas de IA de nivel de producción con flujos de trabajo de agencia, grandes canalizaciones de RAG, modelos personalizados y una gobernanza de datos estricta, muchos superan las limitaciones de un modelo sin servidor totalmente administrado. En esa etapa, la propiedad de la infraestructura, la previsibilidad de los costos y la flexibilidad del modelo pasan a ser decisivos.

Aquí es donde True Foundry se destaca. Al permitir a los equipos ejecutar cargas de trabajo de IA en su propia nube o VPC y, al mismo tiempo, preservar una experiencia de desarrollador similar a la de PaaS, TrueFoundry ofrece la flexibilidad necesaria para escalar la IA de manera responsable en 2026.

👉 Si está creando productos de IA serios y desea un control a largo plazo sobre los costos, los datos y los modelos, reserve una demostración de forma gratuita para ver cómo se compara TrueFoundry con las implementaciones del mundo real.

Preguntas frecuentes

¿Cuáles son las alternativas a Cloudflare?

Entre las alternativas populares de IA de Cloudflare se encuentran TrueFoundry, AWS Bedrock, Runpod, Replicate, Google Vertex AI, Modal, Hugging Face Inference Endpoints, Anyscale y Lambda Labs. Cada plataforma apunta a diferentes etapas de madurez de la IA, desde la experimentación rápida hasta el despliegue de producción a gran escala.

¿Por qué Cloudflare es una mala puerta de enlace?

Cloudflare no es intrínsecamente «malo», pero puede llegar a ser limitante para las cargas de trabajo de IA avanzadas. Los equipos suelen enfrentarse a desafíos relacionados con el bloqueo de modelos, la privacidad de los datos, la previsibilidad de los costos y el soporte para sistemas de agencia complejos cuando confían únicamente en Cloudflare como puerta de enlace de inteligencia artificial.

¿Qué hace que TrueFoundry sea una mejor alternativa a la IA de Cloudflare?

TrueFoundry proporciona propiedad total de la infraestructura, soporte para cualquier modelo, optimización de costos predecible y administración integral del ciclo de vida. A diferencia de Cloudflare Workers AI, permite a los equipos ir más allá de la inferencia perimetral y crear sistemas de IA escalables y compatibles en su propia nube.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)