El complicado punto medio: sobrevivir a la transición del IVR basado en reglas a los sistemas agentic

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

1. El problema de la transición: por qué los sistemas antiguos fallan y los LLM no están «ahí todavía»

Durante décadas, las empresas han confiado en Sistemas de respuesta de voz interactiva (IVR) basados en reglas para gestionar las llamadas de los clientes. Estos sistemas se diseñaron para ofrecer eficiencia: hacen que las personas que llaman recorran los menús, reconocen un puñado de palabras clave y las dirigen al equipo o guion correctos. A pequeña escala, esto funcionó. Pero en un manejo empresarial cientos de millones de llamadas al año, estas limitaciones se vuelven dolorosamente claras. Los clientes no siguen los guiones. Hablan en un lenguaje natural, fluido e impredecible, a veces emocional, a veces técnico, a veces impaciente. Los sistemas basados en reglas simplemente no se crearon para gestionar solicitudes tan diversas.

¿El resultado? Altas tasas de abandono de llamadas, clientes frustrados e importantes daños a la marca. Las empresas que intentan colocar las conversaciones humanas en rígidos árboles de decisiones se quedan con tiempos de resolución más largos, tasas de transferencia de agentes más altas y costos operativos crecientes. Peor aún, la experiencia del cliente se ve afectada de manera que afecta directamente a la retención y a los ingresos. Los análisis del sector indican que, en 2021, la calificación global de Csat del autoservicio de IVR fue del 75%, ¡y la calificación general de Csat de IVR Navigation fue solo del 53%! [eslabón]

A diferencia de los sistemas basados en reglas, Sistemas agentic basados en LLM puede analizar la intención, adaptarse al contexto y responder en un lenguaje natural similar al humano. En teoría, pueden gestionar la fluidez de las conversaciones reales a gran escala. Representan el cambio radical tan esperado: no solo automatizan el enrutamiento de las llamadas, sino que también atraen a los clientes de una manera personalizada y empática.

Pero el problema es: los LLM estándar no están capacitados para los procesos operativos específicos de la industria de las grandes empresas, ni están reforzados para cumplir con los estándares de nivel empresarial en cuanto a privacidad, confiabilidad e implementación de los datos. A pesar de sus promesas, los LLM actuales siguen presentando modos de fallo que ponen nerviosos a los directores de TI y a los responsables de cumplimiento. Pueden «alucinar» las respuestas, malinterpretar las consultas delicadas desde el punto de vista normativo o variar en el tono de una interacción a otra. Aún no se pueden garantizar la fiabilidad, la coherencia y el cumplimiento, aspectos que no son negociables para un equipo de servicio al cliente de la lista Fortune 500.

Esto deja a las empresas atrapadas en problema transicional: El sistema anterior puede gestionar técnicamente el volumen de llamadas, pero esto se traduce en un gran número de clientes insatisfechos debido a los casos de uso poco compatibles y a las crecientes expectativas de los usuarios modernos. Mientras tanto, los nuevos sistemas, aunque están más alineados con las necesidades actuales de los usuarios, todavía no son lo suficientemente fiables como para reemplazar completamente a los antiguos.

Para los líderes tecnológicos, este momento se define por una delicada tensión: dependen demasiado de los sistemas heredados y corren el riesgo de aumentar la insatisfacción de los clientes; adoptar los LLM con demasiada rapidez y correr el riesgo de cometer errores costosos que erosionan la confianza.

2. Por qué las empresas no pueden esperar: el costo de la inacción y la urgencia de adoptar la IA

Para muchos ejecutivos, la opción más segura podría parecer ser esperando a que los LLM «maduren». Pero en la práctica, esa no es una opción. Las presiones competitivas son demasiado altas y el costo de la inacción es elevado.

En primer lugar, las expectativas de los clientes han cambiado irreversiblemente. Los consumidores interactúan a diario con chatbots, asistentes inteligentes y motores de recomendación basados en inteligencia artificial. Cuando llaman a una empresa multimillonaria, esperan el mismo nivel de fluidez, personalización y capacidad de respuesta de sus experiencias de IVR. Ofrecer algo menos parece anticuado. En sectores como la banca, los seguros y las telecomunicaciones, esa brecha no solo es un inconveniente, sino que es suficiente para que los clientes se decanten por competidores que ya están invirtiendo en IA.

En segundo lugar, la economía de los centros de llamadas es brutal. Manipulación 500 millones de llamadas al año solo con agentes humanos es inviable. Incluso el aumento gradual de la eficiencia se traduce en ahorros de decenas de millones al año. No adoptar la IA ahora no solo significa quedarse a la zaga, sino también fijar estructuras de costes innecesarias que erosionan los márgenes.

En tercer lugar, los competidores se mueven. En todos los sectores, ya estamos viendo a los líderes del mercado experimentar con una experiencia de cliente basada en la inteligencia artificial. Es posible que algunos tropiecen, pero la señal para los clientes y los inversores es clara: la innovación está en marcha y las marcas que lideran con la IA van a diferenciarse. Si se quedan al margen, no solo se corre el riesgo de perder clientes, sino también de dañar la reputación de las empresas que «adoptan con lentitud».

Por último, está el curva de aprendizaje organizacional. Implementar la IA de manera responsable en un entorno de Fortune 500 lleva tiempo: alinear los equipos legales, capacitar al personal, integrar con los sistemas heredados y establecer marcos de observabilidad. No se trata de capacidades que puedan activarse de la noche a la mañana. Incluso si las LLM llegaran a ser totalmente confiables mañana, las empresas que aún no hayan desarrollado la fuerza necesaria para adoptar la IA tendrán años de retraso.

En resumen, las empresas no pueden darse el lujo de esperar. Los riesgos de la inacción (aumento de los costos, pérdida de clientes, disminución de la competitividad) superan con creces los riesgos de una adopción cuidadosamente gestionada. El desafío no consiste en adoptar o no, sino cómo adoptar responsablemente durante un período intermedio desordenado.

3. Caso de uso en el mundo real: equilibrar los LLM con los sistemas basados en reglas

Al reconocer que ni los IVR basados en reglas ni las soluciones de LLM disponibles en el mercado podían satisfacer las necesidades de una empresa de la lista Fortune 500 por sí solas, TrueFoundry trabajó con una de las cadenas de farmacias más grandes de EE. UU. para diseñar un agente de IA de voz híbrido. El objetivo era ambicioso: replicar la eficacia de un farmacéutico humano cualificado en millones de llamadas rutinarias que abarcaban el estado de las recetas, las recargas, la información de las tiendas, las comprobaciones del inventario y otras necesidades diarias de los clientes.

En el corazón de este diseño se encuentra un enfoque de optimización híbrida: combinando el eficiencia de los sistemas deterministas basados en reglas con el flexibilidad de la conversación impulsada por la IA. Las consultas comunes y repetitivas, como comprobar el horario de la tienda o las recargas listas para su recogida, se redirigen a procesamiento rápido basado en reglas. Esto maneja 90— 95% de las solicitudes rutinarias, evitando llamadas de LLM innecesarias, reduciendo la latencia y los costos de procesamiento.

Cuando un cliente presenta una solicitud más compleja o ambigua, un sistema de enrutamiento inteligente toma el relevo. Utilizando clasificadores de reconocimiento de intenciones que teniendo en cuenta también el contexto en segundo plano, que se agrega automáticamente a la solicitud del cliente desde una conversación anterior, el administrador de intenciones determina si la solicitud puede resolverse mediante reglas o debe escalarse a un flujo de conversación impulsado por LLM. Esto garantiza el equilibrio adecuado: respuestas predecibles cuando la precisión es importante e interacciones naturales cuando la flexibilidad es fundamental.

Para interacciones matizadas, como los flujos de recarga, agilización y cancelación, creamos agentes conversacionales utilizando Gráfico de largo. Estos agentes se integran con los sistemas de backend a través de llamada de herramientas, lo que les permite procesar de forma segura las solicitudes de recarga en tiempo real. Los clientes pueden preguntar con naturalidad («¿Podrían acelerar mi recarga?») , y el sistema interpreta la intención mientras ejecuta las acciones de backend necesarias.

Para mantener una sensación similar a la humana incluso durante las operaciones de backend, implementamos respuestas de texto de relleno («Espere un momento mientras busco sus datos»). Estos detalles sutiles refuerzan la confianza de los clientes al hacer que el sistema parezca responsivo en lugar de robótico.

Como la solución es útil para las farmacias, la precisión en la interpretación de las recetas no era negociable. Nos integramos modelos de conversión de voz a texto específicos de la industria ajustado al vocabulario farmacéutico, garantizando el correcto reconocimiento de los nombres complejos de los medicamentos. Esto reduce significativamente los errores de transcripción que, de otro modo, podrían frustrar a los clientes o poner en riesgo la seguridad de los pacientes.

Todas las interacciones de LLM se canalizan a través de un servicio de puerta de enlace respaldado por un servicio de gestión rápida. Esto permite la administración centralizada de las solicitudes y garantías respuestas consistentes y preconfiguradas que cumplen tanto con los requisitos reglamentarios como con la voz de la marca. Las actualizaciones se pueden implementar rápidamente sin afectar a docenas de servicios, lo que mantiene la agilidad del sistema y garantiza el cumplimiento.

Para proteger la experiencia del cliente, el agente Voice AI incluye análisis de sentimientos en tiempo real. Si se detecta frustración o insatisfacción, como respuestas negativas repetidas o un aumento de la intensidad emocional, el sistema puede desencadenar un escalamiento a un agente humano. Esto garantiza que las situaciones delicadas se manejen con empatía, evitando que las experiencias negativas de los clientes aumenten vertiginosamente.

Supervisión del rendimiento está a cargo de Analytics AI, un servicio de agencia creado para analizar eventos de todo el sistema. Mejora el funcionamiento empresarial al:

- Evaluación de las tendencias de sentimiento en millones de conversaciones para detectar clientes frustrados o insatisfechos.

- Generación automática de consultas SQL en todos los dominios empresariales (operaciones de farmacia, inventario, métricas de centros de llamadas).

- Consultas de enrutamiento de forma inteligente al conjunto de datos correcto para realizar un análisis específico de cada categoría.

- Medición del rendimiento del nivel de servicio, destacando los puntos débiles o los cuellos de botella emergentes.

Esto cierra el círculo entre la tecnología y los negocios, proporcionando transparencia y conocimientos prácticos.

El sistema ya está utilizado en aproximadamente 2000 de las 10 000 tiendas, que atiende a miles de clientes a diario. El modelo híbrido garantiza la escalabilidad sin comprometer la confianza: las LLM mejoran las interacciones con los clientes cuando es necesario, mientras que las normas garantizan la fiabilidad y la velocidad en la mayoría de los casos. Las primeras implementaciones muestran mejoras significativas en la eficiencia, la resolución de llamadas y la satisfacción del cliente.

En resumen, el diseño híbrido no es un compromiso, es un puente estratégico. Permite a las empresas adoptar la IA de manera responsable en la actualidad, al tiempo que allana el camino para un futuro en el que los LLM puedan asumir una parte aún mayor de la carga.

4. Las ventajas y desventajas: transparencia sobre la complejidad y el mantenimiento

Si bien el enfoque híbrido de IA de voz resuelve el problema de la transición, también presenta su propio conjunto de ventajas y desventajas. Para empresas que gestionan cientos de millones de llamadas de clientes, estas ventajas y desventajas no son detalles menores: determinan el costo total de propiedad, la preparación organizacional y la sostenibilidad a largo plazo.

1. Mayor complejidad arquitectónica

En un sistema basado exclusivamente en reglas, la lógica es determinista y relativamente fácil de rastrear. En un sistema LLM puro, la arquitectura podría, en teoría, simplificarse y convertirse en un motor conversacional más integraciones de back-end. A El sistema híbrido, sin embargo, requiere ambos. Esto significa mantener infraestructuras paralelas:

- Flujos deterministas para la gran mayoría de las consultas comunes.

- Flujos impulsados por la IA para interacciones matizadas y de alto valor.

- Una capa de enrutamiento inteligente que decide qué ruta activar.

El beneficio es la flexibilidad y la resiliencia, pero la contrapartida es arquitectura más compleja eso requiere que los equipos multifuncionales diseñen, supervisen y ajusten continuamente.

2. Mayor carga de mantenimiento

Los IVR tradicionales requieren actualizaciones ocasionales del script. Por el contrario, un sistema híbrido necesita mantenimiento continuo en múltiples frentes:

- Reentrenamiento de clasificadores: Mantener la precisión de los modelos de enrutamiento a medida que surgen nuevos patrones de llamadas.

- Modelos de dominio específico: Mantener los motores de conversión de voz a texto ajustados al vocabulario farmacéutico u otras necesidades de la industria.

- Monitorización de tuberías: Garantizar que las herramientas de monitoreo capturen los eventos correctos y revelen información procesable.

Esto introduce nuevos ritmos de mantenimiento más cercanos a gestión del ciclo de vida del producto de software que el soporte de telefonía tradicional.

3. Equilibrio entre rentabilidad y rendimiento

Si bien las rutas rápidas basadas en reglas se mantienen Entre el 90 y el 95% de las llamadas con una sola intención simple y eficiente, el híbrido sigue incurriendo en costes derivados de:

- Ejecución de LLM para flujos complejos.

- Operar infraestructuras duales.

- Invertir en sistemas especializados de monitorización y análisis.

Las empresas deben sopesar si el mejora de la experiencia del cliente justifica el coste añadido. En muchos casos, sí, pero el cálculo del ROI depende de los márgenes del sector, riesgos regulatorios, y las expectativas de los clientes.

4. Complejidad de la gobernanza y el cumplimiento

Las empresas, especialmente en los sectores de la salud, la banca y los seguros, deben hacer cumplir estrictamente las normas. Un sistema híbrido introduce más partes móviles:

- Las respuestas basadas en reglas ofrecen cumplimiento desde el diseño.

- Los flujos basados en LLM requieren barandas, auditoría y monitoreo en tiempo real para alucinaciones o lenguaje fuera de marca.

- El enrutamiento inteligente debe demostrar explicabilidad: ¿por qué una llamada determinada se destinó a un LLM en lugar de a una regla?

Esto aumenta la complejidad de la gobernanza, pero también brinda una oportunidad: el sistema híbrido se puede instrumentar para mayor transparencia que cualquiera de los dos enfoques de forma aislada.

5. Cambio de habilidad organizacional

Por último, la adopción híbrida requiere nuevos conjuntos de habilidades. Las empresas no solo necesitan diseñadores de IVR, sino también:

- Científicos de datos para clasificadores de enrutamiento.

- Ingenieros rápidos para los flujos de LLM.

- Equipos de operaciones de IA para gestionar el monitoreo en tiempo real, el análisis de sentimientos y los desencadenantes de escalamiento.

Este cambio de talento no es una consideración trivial para las empresas con equipos de TI de centros de llamadas tradicionales.

El resultado final

El enfoque híbrido de Voice AI no consiste en «configurar y olvidar». Es un sistema vivo eso exige un diseño cuidadoso, un monitoreo continuo y una inversión organizacional. La recompensa es un puente resiliente que permite a las empresas aprovechar la IA sin sacrificar la fiabilidad. Sin embargo, la contrapartida es real: mayor complejidad, mayor mantenimiento y necesidades de gobierno continuo.

Para los líderes que toman decisiones en la actualidad, reconocer abiertamente estas desventajas es clave para generar confianza entre las partes interesadas en los ámbitos técnico, operativo y de cumplimiento.

5. Perspectivas futuras: equilibrar las curvas de lo viejo y lo nuevo

La evolución de las tecnologías de interacción con los clientes no sigue una línea recta, sino ciclos. Las nuevas innovaciones surgen con grandes promesas, sufren reveses inevitables y, finalmente, encuentran su lugar en el conjunto de herramientas empresariales. Al mismo tiempo, las tecnologías tradicionales no desaparecen sin más; corrigen, estabilizan y siguen aportando valor en nichos en los que sus puntos fuertes son incomparables.

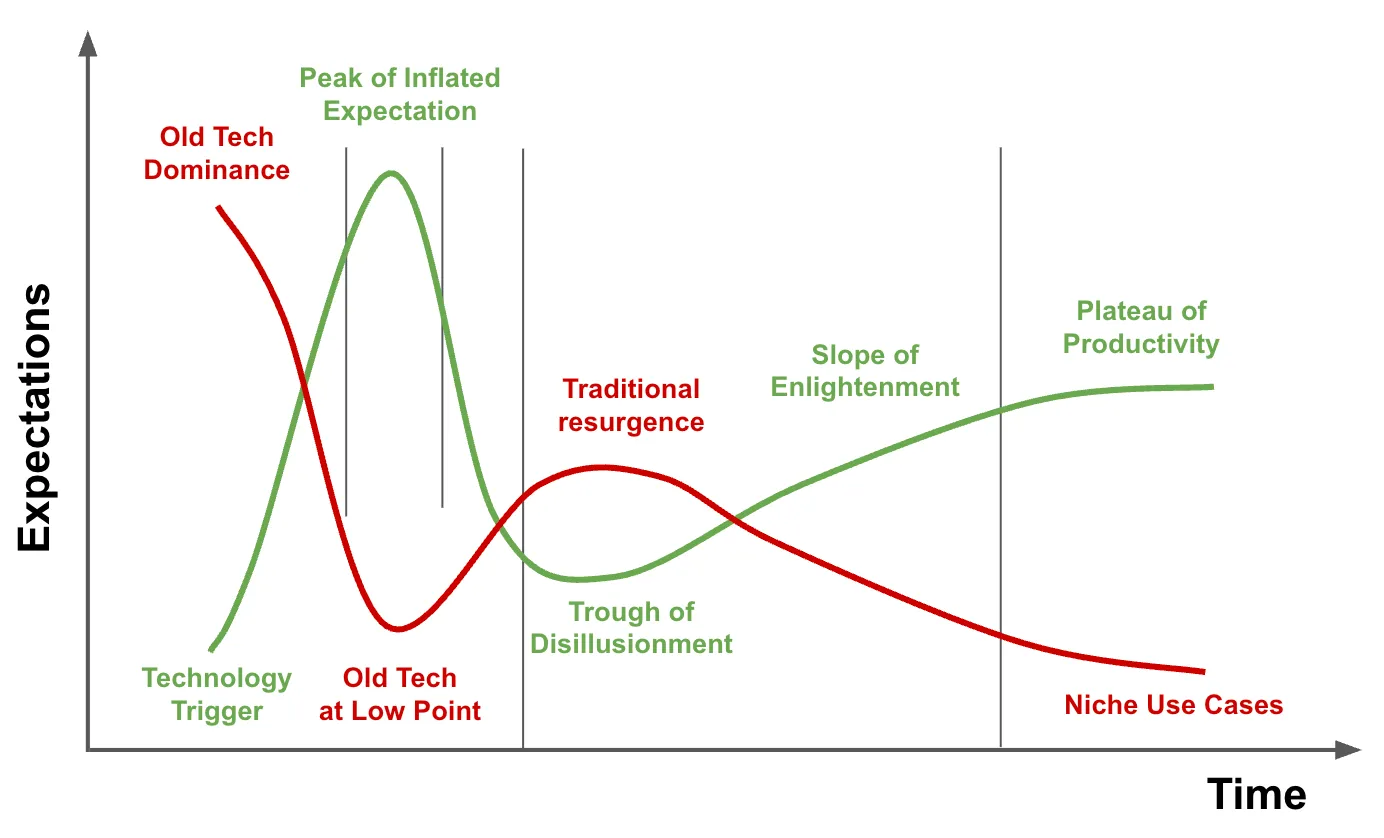

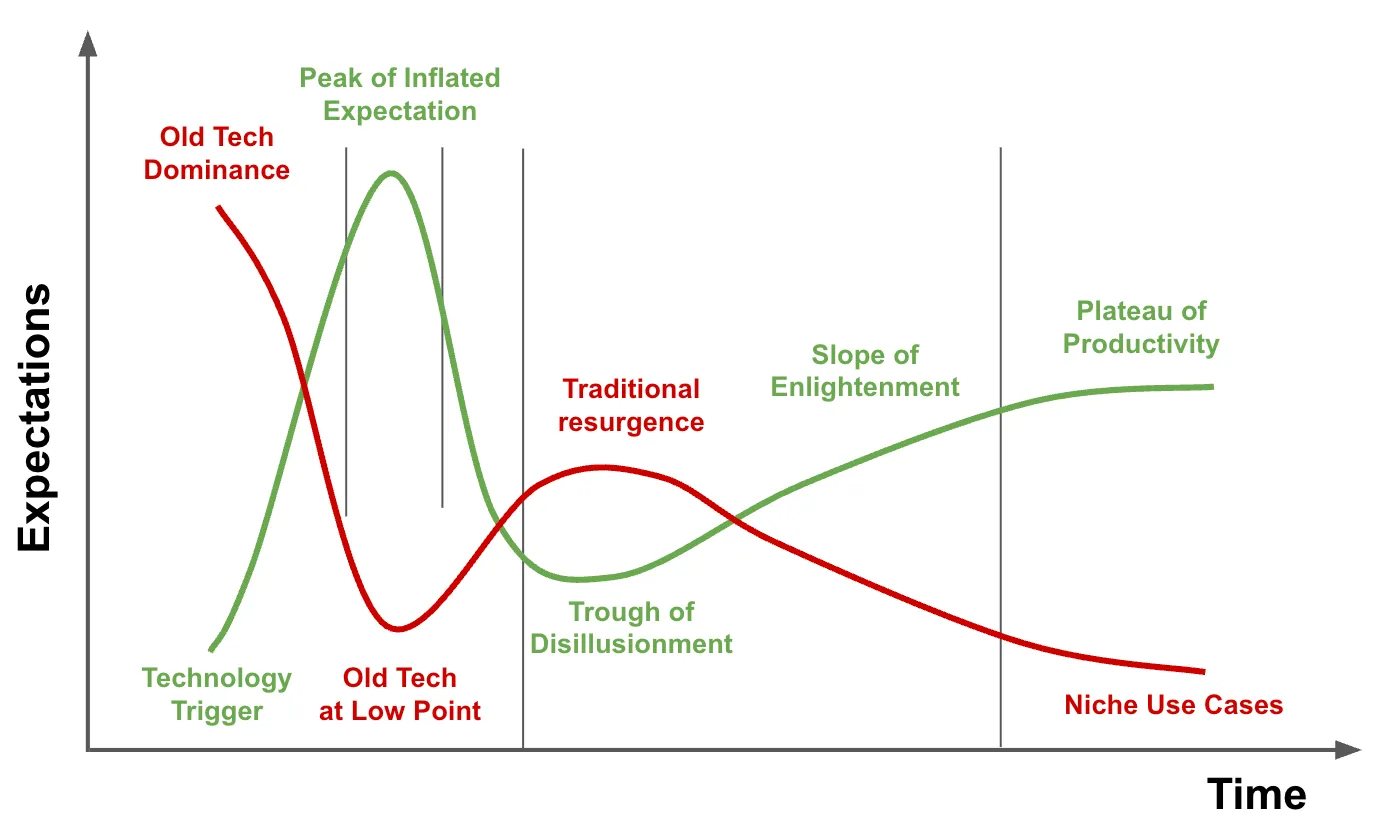

Una forma de pensar en esto es amplíe el ciclo de publicidad de Gartner, que muestra cómo las nuevas tecnologías pasan de ser el «factor desencadenante de la innovación» al «pico de expectativas infladas», el «punto más bajo de la desilusión» y, finalmente, al «estancamiento de la productividad». A lo largo de esta curva, podemos dibujar una imagen especular: la curva de «supervivencia» de la tecnología tradicional.

- En la cima de las expectativas infladas:

Cuando aumenta el entusiasmo por la nueva tecnología, la antigua se declara prematuramente obsoleta. En nuestro espacio, esto sucede con IVR basados en reglas. El revuelo en torno a la IA conversacional ha creado la percepción de que los flujos de llamadas deterministas ya son irrelevantes, a pesar de que siguen siendo muy eficientes para tareas predecibles y repetitivas. - En el abismo de la desilusión:

A medida que las limitaciones de la nueva tecnología se hacen evidentes (altos costos, brechas de confiabilidad, riesgos de cumplimiento), los sistemas tradicionales suelen resurgir. Las empresas redescubren la estabilidad y la previsibilidad de los sistemas basados en reglas y valoran sus rentabilidad y precisión. Durante esta fase, las organizaciones se apoyan más en los híbridos para estabilizar las operaciones y, al mismo tiempo, siguen experimentando con la IA. - En la meseta de la productividad:

Con el tiempo, la nueva tecnología madura, sus casos de uso se comprenden bien y los marcos de implementación la hacen segura y escalable. En este punto, el la tecnología antigua no desaparece, pero se convierte en muy casos de uso específicos e indiscutibles. Para el IVR, esto significará que las reglas seguirán siendo la mejor herramienta cuando el cumplimiento exija un control absoluto sobre la redacción, o cuando el costo de incluso una pequeña mala interpretación sea inaceptable.

Figura 1: El ciclo de exageración de la nueva tecnología y la resistencia de la tecnología antigua

Dónde estamos hoy

Según la mayoría de los indicadores, Los agentes de voz impulsados por la inteligencia artificial siguen acercándose al pico de las expectativas exageradas. Las empresas están entusiasmadas con su potencial transformador, pero también están empezando a darse cuenta de su fragilidad a gran escala. La verdad es que todavía estamos en proceso de encontrar el equilibrio correcto: donde la IA mejora la experiencia y donde las reglas proporcionan barreras.

Este equilibrio no es un compromiso; es un puente estratégico a través de las curvas. Al adoptar ahora enfoques híbridos, las empresas se posicionan para aprovechar los beneficios de la innovación de la IA sin descartar la confiabilidad de los sistemas comprobados. Con el tiempo, a medida que la IA avance hacia su nivel de productividad, el rol de la IVR tradicional se reducirá, pero nunca desaparecerá, sino que persistirá en ellos contextos especializados y de misión crítica en los que la previsibilidad sigue siendo la reina.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)