Alternativas a la IA de Obot: las 6 mejores herramientas que puede considerar en 2026

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Hoy en día, crear IA es más que simplemente determinar qué modelo le gustaría usar.

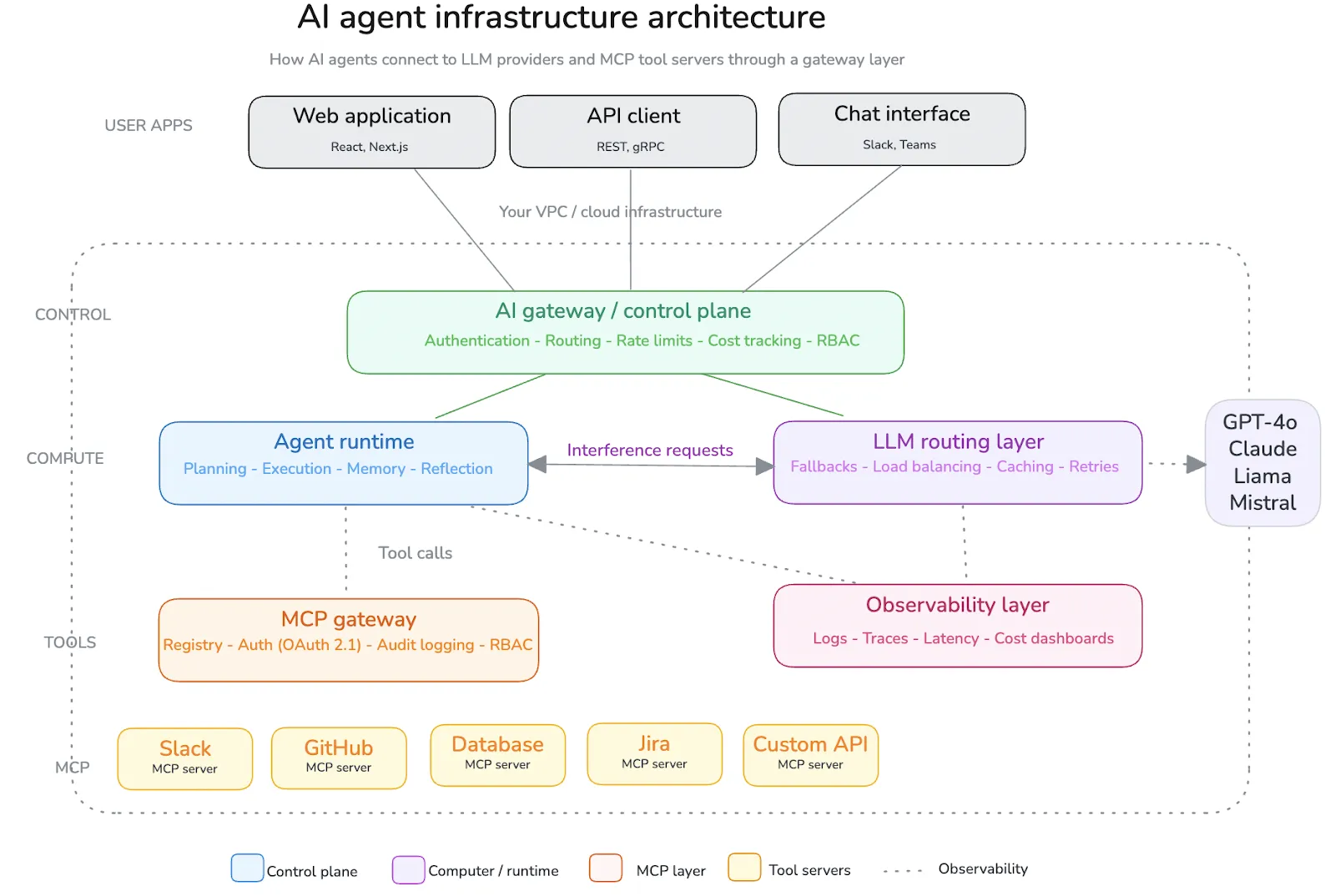

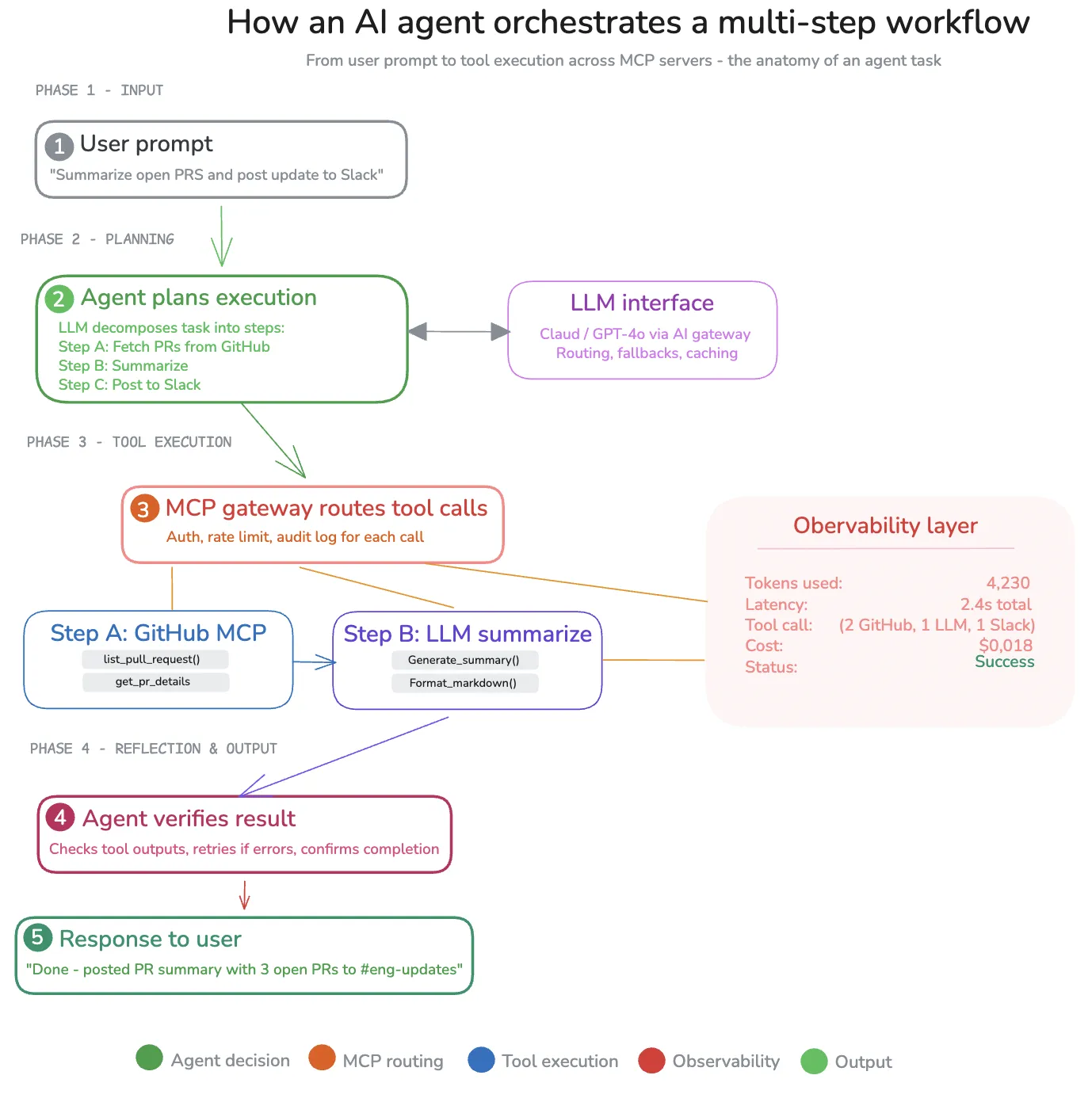

La creación de agentes de IA consiste en varios pasos, es decir, la conexión a las distintas herramientas, la gestión del acceso, el seguimiento del uso y la prevención de que las cosas se estropeen una vez en producción; aquí es donde los equipos aprovechan servicios como MCP, y los ejemplos más recientes serían Obot AI.

Obot AI proporciona un marco estructurado de código abierto para ayudar a los equipos a gestionar su infraestructura de protocolo de contexto modelo (MCP); esto es eficaz para la gobernanza de las herramientas.

Sin embargo, a medida que los equipos pasan a la fase de producción, muchas veces sus requisitos aumentan, como una mayor capacidad de observación, la capacidad de trabajar con varios modelos o el control de la implementación y la seguridad del modelo.

Por lo general, es cuando los equipos comienzan a explorar Alternativas a Obot AI. En esta guía, analizaremos las principales opciones disponibles en 2026 para que puedas encontrar la que mejor se adapte a tu oferta tecnológica.

¿Qué es Obot AI?

Obot AI, anteriormente conocida como Acorn Labs, proporciona una plataforma de código abierto para que las empresas administren sus sistemas basados en el Model Context Protocol (MCP).

Las funcionalidades principales de Obot AI incluyen:

- Alojamiento MCP

- Registro MCP

- Puerta de enlace MCP

- Cliente de chat compatible con MCP

La puerta de enlace MCP actúa como el punto de control centralizado donde los equipos de TI pueden incorporar, administrar y monitorear los servidores MCP mediante una interfaz de usuario (UI) administrativa moderna o mediante un flujo de trabajo basado en GitOps, incluido el mantenimiento de un registro de auditoría completo de cada acción tomada en relación con un servidor MCP.

La IA de Obot se puede implementar para autohospedarse en Docker o Kubernetes, lo que permite a los usuarios mantener el control y la soberanía totales sobre sus datos e infraestructura.

¿Por qué los equipos buscan alternativas a Obot AI?

Si bien Obot AI es una base sólida para la administración de servidores de MCP, existen limitaciones para los equipos que buscan un uso más extenso de su infraestructura de IA.

- Enfoque limitado en MCP — Diseñado estrictamente para la gobernanza de MCP. Si una organización quiere llevar a cabo funciones de gestión modélicas de servicio o almacenamiento intermedio, afinación o creación de puestos, o de LLMOP completas, debe buscar un proveedor independiente.

- Sin capa de inferencia o servidor de modelos integrada — Obot administra las conexiones de herramientas; sin embargo, los propios modelos se administran mediante una pila independiente que aún no se ha creado y que administrará dónde se alojan las instancias de LLM, cómo se enruta la inferencia y cómo se administra el procesamiento de la GPU.

- Despliegue de Kubernetes — Sin embargo, es la opción de implementación ideal para los equipos que tienen una infraestructura nativa de la nube; esto podría ser un obstáculo importante para las organizaciones que no poseen los recursos necesarios o la experiencia en ingeniería de plataformas.

- Capacidades limitadas de visibilidad y administración de costos — Si bien existe un registro de auditoría, no hay [Atribución de costos] (2) [Panel de latencia] ni (3) [Monitoreo de la producción] basado en tokens (1), que están presentes en las pasarelas de IA dedicadas.

Criterios de evaluación

¿Cómo evaluamos estas alternativas de IA para robots?

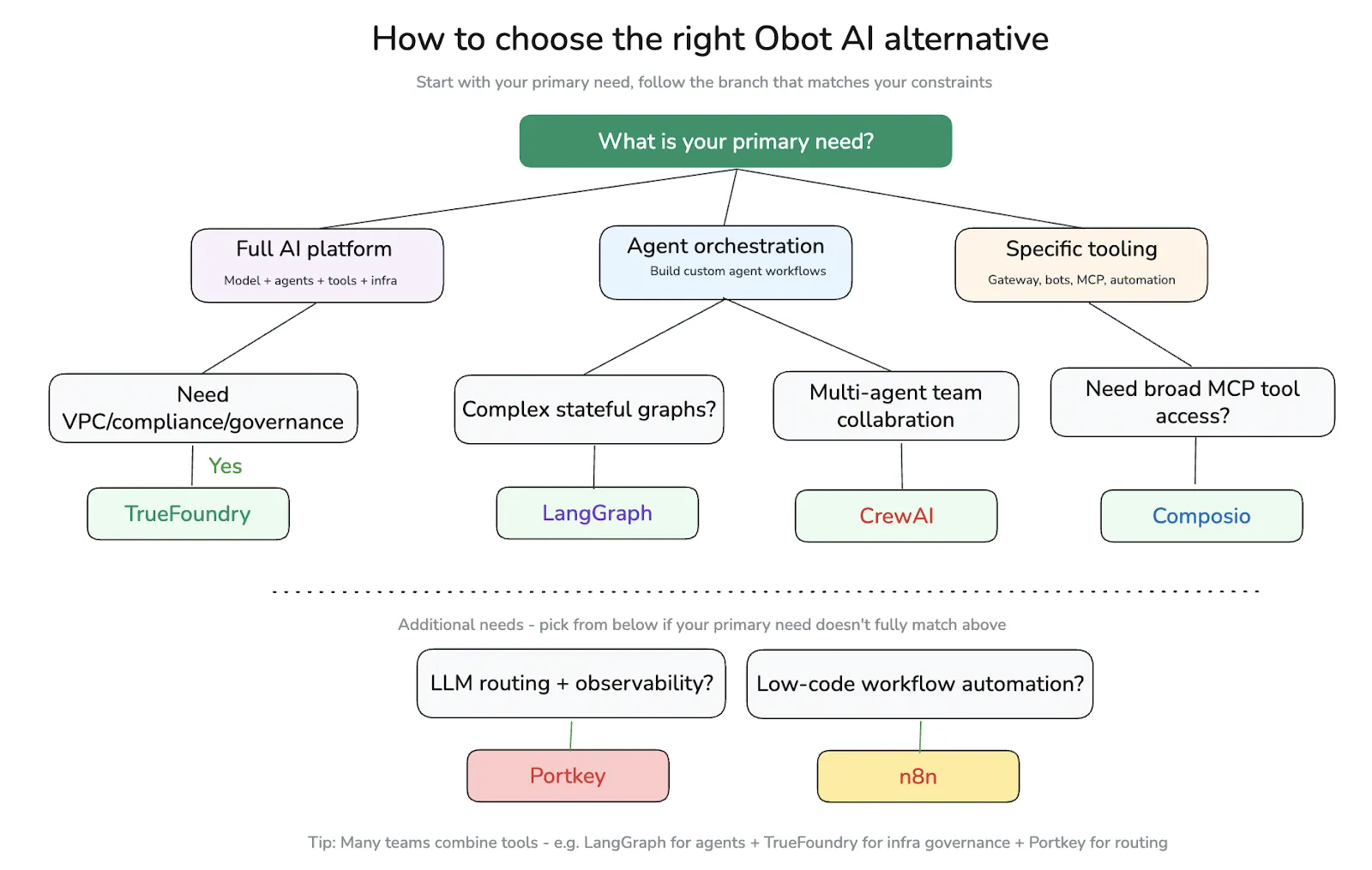

No todas las alternativas a Obot AI intentan resolver el mismo problema; por ejemplo, algunas pueden centrarse únicamente en el MCP, mientras que otras buscan la infraestructura de IA en un sentido más completo.

Evaluamos cada una de las soluciones alternativas basándonos en varios aspectos prácticos:

- Agentes de MCP e IA: ¿La solución proporciona soporte nativo para MCP o solo se integra con MCP?

- Propiedad de la infraestructura: ¿Tiene la capacidad de ejecutar la solución en su propia nube privada virtual (VPC) o la solución solo se ofrece como software como servicio (SaaS)?

- Flexibilidad del modelo: ¿La solución ofrece soporte para modelos autohospedados y basados en proveedores?

- Observabilidad y gobernanza: ¿La solución proporciona políticas sólidas de control de acceso basado en roles (RBAC), auditorías y seguimiento de costos para garantizar que pueda usar la solución de manera confiable en la producción?

- Experiencia de desarrollador: ¿Qué tan rápido puede un equipo de desarrollo pasar de una idea a una solución funcional?

Ninguna solución alternativa es claramente ganadora cuando se evalúa en todas estas áreas, y ese es el propósito general de la evaluación.

Las alternativas de IA de Obot de un vistazo:

Las mejores alternativas de IA para robots en 2026

1. TrueFoundry: lo mejor para los equipos de IA empresarial que necesitan un control total

TrueFoundry es una plataforma de IA que se entrega como cargas de trabajo administradas por Kubernetes en las instalaciones o como servicios en la nube dentro de su VPC en las tres plataformas de nube principales (AWS/Azure/GCP).

TrueFoundry aborda todos los aspectos de la gestión y el control del ciclo de vida de la IA, como la implementación de modelos, el enrutamiento de las inferencias hacia ellos, la organización de los agentes y la gestión de las implementaciones de múltiples nubes, a través de un único plano de control.

Reconocida por su integridad por Gartner en su Guía de mercado para pasarelas de IA de 2025 y por su reciente junta directiva de Carolina del Norte, TrueFoundry proporciona la gestión de los modelos, los agentes, las herramientas y los recursos informáticos, mientras que Obot solo gestiona los agentes alojados y las solicitudes transferidas.

La plataforma ha sido adoptada por empresas como Siemens Healthineers, Resmed, Automation Anywhere y NVIDIA.

Características principales:

- Acceda a la puerta de enlace unificada de IA: API compatible con OpenAI (más de 250 LLM que utilizan LLM de código abierto o propietario); enrutamiento inteligente, conmutación por error, equilibrio de carga y presupuestación de tokens a través de una sola API para los LLM

- Servidores MCP virtuales: Combine herramientas de varios servidores MCP en un único punto final seleccionado con filtrado a nivel de herramienta. La autenticación centralizada (OAuth2, PAT, VAT), el RBAC y el registro de auditoría se gestionan mediante la puerta de enlace de IA

- Puerta de enlace MCP con registro centralizado: Servidores MCP registrados públicos y autohospedados disponibles a través del plano de control de AI Gateway; aprovisionamiento de tokens de OAuth usuario por usuario y capacidad de actualización automática de tokens; compatibilidad con proveedores de identidad federados (IDP) como Okta y Azure AD

- Orquestación apta para agentes: Independiente del marco; compatible con Agent Frameworks, LangGraph, CrewAI y AutoGen personalizados; área de juegos integrada para probar las indicaciones con las herramientas de MCP con transmisión en tiempo real de datos de bucle de agencia

- Observabilidad incorporada: Latencia, uso de tokens, atribución de costos, paneles de control específicos para cada equipo y registro completo de las solicitudes/respuestas de los clientes sin necesidad de usar sidecars

- Gestión rápida del ciclo de vida: Control de versiones de mensajes gestionados por IA, soporte multiversión de mensajes gestionados por IA e integración de CI/CD con CLI o API.

Ideal para:

Organizaciones de ingeniería de plataformas, empresas que buscan una plataforma de IA gobernada por una plataforma de IA independiente de la nube (no simplemente una puerta de enlace MCP) con un control total del modelo, los agentes, las herramientas y la infraestructura (la más adecuada para quienes transforman 1 o 2 casos de uso de LLM).

Las organizaciones que pasan de casos de uso limitados de LLM a implementaciones amplias de LLM suelen tener problemas para comprender bien el tamaño de su entorno actual, cómo será el futuro y cómo planificar la escalabilidad a largo plazo.

2. LangGraph (de LangChain)

LangGraph es un marco que ofrece una forma de código abierto de crear gráficos dirigidos de flujos de trabajo de agentes de varios pasos con estado. LangGraph se basa en LangChain añadiendo funciones que incluyen la gestión explícita del estado, los ciclos y los patrones interpersonales.

Características principales:

- Un método basado en gráficos para crear servicios complejos con soporte para sucursales, ciclos, enrutamiento condicional y procesamiento paralelo

- Una plataforma para la implementación gestionada (autohospedada o gestionada por LangGraph)

- Compatible con cualquier proveedor de modelos (incluidos Claude, OpenAI, Gemini, Bedrock, Open Source)

Ventajas:

- Plataforma flexible para crear agentes complejos de varios pasos con licencia MIT

- Ecosistema robusto con otras herramientas (LangChain, LangSmith, LangServe)

Contras:

- Marco en lugar de plataforma; requiere un diseño inicial del esquema de estado; no proporciona un servicio de modelo predeterminado, una puerta de enlace MCP ni una orquestación de procesamiento

Ideal para:

Equipos de ingeniería que crean flujos de trabajo de agentes complejos y con estado que están listos para administrar su infraestructura.

3. Tripulación AI

CrewAI es un marco de Python diseñado para colaborar con equipos de agentes de IA al permitirles completar las tareas según las funciones asignadas dentro de los objetivos y métodos de delegación específicos.

Características principales:

- Definir funciones para los agentes con objetivos, antecedentes y herramientas que se asignan a cada función. Esto permite modelar las tareas como equipos con habilidades especializadas.

- Ofrece un control unificado sobre los agentes con la plataforma CrewAI Enterprise AMP. Esta plataforma incluye una capacidad de rastreo en tiempo real, un control de acceso basado en roles (RBAC) y una gestión de las implementaciones en la nube o en las instalaciones.

- CrewAI Studio es una herramienta de edición gráfica sin código que permite al usuario crear agentes sin necesidad de saber programar.

Ventajas:

- Agentes colaborativos fáciles de modelar: Crear equipos de agentes con la API es la forma más fácil de usar de crear un prototipo funcional de un equipo de varios agentes en menos de un día.

- Creación rápida de prototipos: El núcleo de CrewAI es de código abierto y, por lo tanto, se puede usar independientemente de cualquier otro marco (por ejemplo, LangChain).

Contras:

- Observabilidad limitada: La capa de abstracción de CrewAI a veces puede parecer menos intuitiva que la capa de abstracción de LangGraph, lo que hace que el diagnóstico de fallos de los agentes lleve mucho tiempo. La capacidad de observación y el seguimiento de los costes en el ecosistema CrewAI también son inferiores a los de LangSmith.

- Costo de CrewAI Enterprise: El costo de usar CrewAI Enterprise (AMP) es de aproximadamente 99 dólares al mes, aunque si se consulta más a fondo se puede obtener un precio preciso.

Ideal para:

CrewAI es una excelente herramienta de colaboración entre múltiples agentes para equipos interesados en el desarrollo rápido de flujos de trabajo con múltiples agentes a través de métodos sin código.

4. Composio

Composio, como plataforma de integración de herramientas y pasarela MCP gestionada, cuenta con más de 500 herramientas prediseñadas para conectarse a sus agentes de IA (y está aprobada por la empresa). El Universal MCP Gateway de la empresa se lanzó en agosto de 2025 para dar soporte a más de 100 000 desarrolladores y eliminar la necesidad de disponer de numerosos servidores MCP independientes al permitir una sola instalación.

Características principales:

- Más de 500 integraciones de MCP administradas (incluidos Slack, GitHub, Salesforce, Google Workspace, Notion, Jira, etc.) con OAuth unificado y actualizaciones automáticas de tokens

- Agnosticismo marco: Soporta LangChain, CrewAI, OpenAI Agents SDK, Claude Code, Cursor, etc.

- Enrutamiento de herramientas impulsado por IA: Comprende la intención, selecciona herramientas y envía parámetros, sin necesidad de realizar búsquedas manuales en los documentos de la API.

- Opciones de alojamiento en la nube o instalación privada/autohospedada

Ventajas:

- El catálogo de herramientas prediseñadas más grande (reduciendo el tiempo de integración de semanas a menos de 5 minutos)

- Experiencia de desarrollador que da prioridad a los desarrolladores: Conexión API de una línea por herramienta y plantillas de recetas completas.

Contras:

- El SaaS administrado de forma predeterminada significa menos control de la infraestructura que las opciones de autohospedaje como Obot

- La calidad de los conectores puede variar: la rápida expansión significa que algunas de sus integraciones son menos probadas en batalla.

- Los precios no están muy claros (según la cantidad de veces que se ha llamado a una herramienta); los precios empresariales requieren ponerse en contacto directamente con el departamento de ventas de Composio.

Ideal para:

Los equipos de desarrollo crean agentes que necesitan un acceso rápido a una gran cantidad de herramientas de MCP sin el retraso asociado con el desarrollo de integraciones personalizadas, cuando la velocidad de integración es clave.

5. Portkey

Portkey es una plataforma confiable y observable que puede ayudar a gestionar los costos relacionados con el uso del Sistema de Gestión del Aprendizaje (Edición) a gran escala y, por lo tanto, su objetivo principal es proporcionar una «puerta de entrada a más de 1600 leyes, en más de 40 empresas diferentes, cada una con un retraso de menos de un milisegundo» a la hora de generar contenido nuevo para recursos empresariales a gran escala.

Características principales:

- Generación inteligente de rutas: admite capacidades de reintento automático, funcionalidades de almacenamiento en caché de base semántica, operaciones de equilibrio de carga, capacidades de disyuntores y opciones de respaldo multimodelo

- Cumple con todos los estándares de cumplimiento de seguridad aplicables de la siguiente manera: SOC 2: Tipo 2; ISO 27001; GDPR; HIPAA; y los métodos adicionales para proteger el control de acceso incluyen: emplear un control de acceso basado en roles; utilizar el inicio de sesión único y SCIM; y mantener registros de auditoría.

- La puerta de enlace Portkey sirve como un repositorio centralizado para almacenar todos los datos relevantes en cada una de sus muchas aplicaciones diferentes.

Ventajas:

- De alto rendimiento, compactos y eficientes en comparación con los sistemas tradicionales de tipo heredado y con un historial comprobado en empresas de gran escala.

- Solución de puerta de enlace de código abierto con una versión basada en la nube o una solución gestionada en la nube.

Contras:

- Portkey es estrictamente un producto de puerta de enlace que no admite modelos ni infraestructuras informáticas alojadas por desarrolladores; las capacidades de MCP son limitadas en comparación con otras puertas de enlace MCP dedicadas (por ejemplo, Composio o TrueFoundry).

Ideal para:

Portkey es más útil para los ingenieros que ya han creado su estructura organizativa y sus procesos y disponen de una amplia red que se utiliza para enviar documentos, supervisar el uso y desarrollar modelos de costes.

6. n8n

n8n es una herramienta de automatización del flujo de trabajo de código abierto (OS) con capacidades de agentes de IA nativos integradas y compatibilidad con MCP bidireccional, que conecta los dos métodos tradicionales de automatización: webhooks, API y bases de datos con flujos de trabajo de agentes impulsados por LLM a través de Visual Builder.

Características principales:

- Un diseñador visual de flujos de trabajo que proporciona un medio para conectar más de 500 nodos de integración (tanto de automatización determinista como de agente) para una transición perfecta entre los dos tipos de automatizaciones.

- Un nodo de agente de IA que proporciona capacidades de agente de IA nativas mediante la llamada a otras herramientas, que también incluye memoria (dos formas de almacenarla) (mediante Redis o una base de datos simple), así como soporte para diferentes modelos que utilizan OpenAI (y Anthropic) en el nodo de agente de IA.

- Protección automática (se requiere la aprobación humana explícita) para que los agentes ejecuten cualquier herramienta de alto impacto (se agregó en enero de 2026).

Ventajas:

- Nivel de dificultad más bajo para las personas que no son ingenieros de aprendizaje automático para crear automatizaciones con IA.

- Excelentes opciones de alojamiento propio con una próspera comunidad de código abierto (para documentación y recursos del sistema operativo) y un acuerdo de licencia justo.

Contras:

- No está diseñado específicamente para funcionar con la IA, por lo que no se utiliza la memoria para mantener un agente, solo funcionará durante cada ejecución del flujo de trabajo, a menos que los datos se almacenen en otro lugar.

- No cuenta con los niveles de gobierno, el control de acceso basado en roles (RBAC), la contención de costos o las funciones de cumplimiento empresarial integradas para las soluciones de software de IA dedicadas.

- Los límites de rendimiento limitados están presentes cuando hay muchas cargas de trabajo de gran volumen y urgentes que utilizan agentes.

Ideal para:

Si su equipo se encuentra en un área relacionada con las operaciones o la automatización y busca aumentar sus soluciones de automatización existentes con capacidades impulsadas por agentes de IA sin una solución completa basada en ML.

Cómo elegir la alternativa correcta de IA para robots

La elección de la mejor alternativa de IA para robots requiere una consideración que se adapte a las necesidades de su equipo

Su equipo no se beneficiará del mismo reemplazo de Obot AI debido a las diferencias en el tamaño de su equipo, la cantidad de infraestructura que desea administrar y la tarea/función que desea completar primero.

Recomendaciones basadas en escenarios:

- ¿Crear agentes de investigación de varios pasos que necesitan utilizar herramientas para funcionar? Use LangGraph y Portkey o seleccione TrueFoundry como la solución de automatización integral.

- ¿Necesita controles automatizados o acceso reglamentario de VPC al servidor MCP con numerosos miembros del equipo? Diseñe con TrueFoundry sobre la base de colocar servidores MCP virtuales en la VPC con un RBAC central.

- ¿Estás añadiendo inteligencia artificial a tu estilo actual de Zapier? Busca en n8n para incorporarlo a tu flujo de trabajo actual.

- ¿Necesita registros de auditoría y VPC de su equipo de cumplimiento para cualquiera o todas las partes de los sistemas generales instalados? Elija TrueFoundry como su opción de implementación.

Preguntas frecuentes

Pregunta: ¿Para qué se usa la IA de Obot?

- Diseñado principalmente para administrar la infraestructura basada en el Protocolo de contexto modelo (MCP), específicamente cómo los agentes de IA interactúan y se conectan a sistemas y herramientas externos.

- Proporciona la gestión de la autenticación de usuarios para los agentes de IA, el enrutamiento de solicitudes a través de un registro centralizado y el registro de auditoría para todas las interacciones entre el agente y el sistema.

- Funciona como una capa de gobierno (control) para los agentes de IA que interactúan con sistemas y herramientas externos, no como un sistema operativo de IA completo o una plataforma de IA de extremo a extremo.

Pregunta: ¿Por qué los equipos buscan alternativas a la IA de los robots?

- Sus necesidades superan el alcance de una capa de gobierno de MCP, ya que requieren un servicio de modelos, un enrutamiento de inferencias, un seguimiento de los costos y una implementación de producción de nivel empresarial.

- Necesitan acceder a funciones empresariales maduras y que se actualizan con frecuencia sin tener que esperar a que llegue la fase inicial del ciclo de lanzamiento.

Prefieren una plataforma unificada que consolide los modelos, los agentes, las herramientas y la automatización operativa en un solo sistema, en lugar de administrar varias capas independientes.

Pregunta: ¿Cuáles son las mejores plataformas de agentes de IA en 2026?

La mejor plataforma de agentes de inteligencia artificial (IA) para sus necesidades en 2026 dependerá de las partes que necesite poseer:

True Foundry - Esta es la plataforma preferida por las grandes organizaciones para controlar el modelo de gobierno de principio a fin. TrueFoundry ofrece todos los componentes del modelo de gobierno integral, incluidos: la prestación de modelos, la organización de agentes, la administración de las herramientas de MCP y el control de la infraestructura para la administración de modelos.

Si necesita una plataforma que brinde cumplimiento a nivel de producción, atribución de costos de modelos por departamento o equipo y gobierno a nivel escalable en muchos departamentos o equipos, entonces TrueFoundry sería la mejor plataforma.

Gráfico de largo - Este es el marco elegido por los equipos de ingeniería que están creando aplicaciones complejas y con estado basadas en agentes con ramificaciones, ciclos o flujos de trabajo personalizados de tipo humano.

Tripulación AI - Esta es la mejor plataforma para diseñar sistemas de colaboración entre varios agentes con delegación basada en roles y coordinación de tareas.

Composio - Esta es la mejor plataforma cuando el acceso rápido a más de 500 integraciones de herramientas multiplataforma gestionadas (MCP) es más importante que ser propietario de la infraestructura.

Si está buscando una plataforma que tenga la mayor superficie para proporcionarle una solución de gobierno, control de costos y cumplimiento en varios departamentos o equipos, entonces TrueFoundry sería, con mucho, la mejor opción.

Pregunta: ¿Cómo se comparan las herramientas de agentes de IA con las herramientas de automatización tradicionales?

Un agente de IA difiere en gran medida de las aplicaciones de automatización tradicionales/heredadas (por ejemplo, N8n/Zapier) en que estas aplicaciones se ejecutan de forma muy determinista (es decir, la misma estructura de código produce siempre el mismo resultado).

Por lo general, son apropiados para tareas muy bien definidas (es decir, garantizadas), como: sincronizar datos, enviar notificaciones y ejecutar el trabajo programado.

Por otro lado, los agentes de IA utilizan la toma de decisiones basada en el LLM, seleccionando dinámicamente las herramientas en función de los requisitos del entorno inmediato y realizando un razonamiento de varios pasos, lo que le da al agente de IA cierta discreción a la hora de determinar su próxima tarea.

Pregunta: ¿Qué debe buscar en una plataforma de orquestación de IA?

Gestión de modelos: La capacidad de utilizar una variedad de modelos lingüísticos de gran tamaño (LLM) ofrecidos por proveedores de nube externos (OpenAI, Anthropic, de código abierto) y de alojar modelos autohospedados (no en la nube).

Opciones de implementación: Opciones para ejecutar cargas de trabajo de IA en una nube privada virtual (VPC), in situ o en un entorno aislado para garantizar la privacidad de los datos.

Observabilidad: La capacidad de monitorear la latencia, asignar un costo de token para cada LLM y proporcionar análisis de uso por equipo.

Gestión de herramientas y agentes: La capacidad de gestionar de forma centralizada el registro y la auditoría de las conexiones de datos entre modelos, herramientas y agentes.

Cumplimiento de RBAC: La capacidad de crear un acceso basado en roles y aplicar estándares para el cumplimiento del SOC 2 y los registros de auditoría empresarial a todos los que tengan acceso al conjunto de herramientas.

Experiencia de desarrollador: La velocidad con la que los desarrolladores pueden escribir, probar e implementar su código en producción, la calidad del SDK y los marcos compatibles con el SDK

La diferencia principal es si está desarrollando una aplicación o dando soporte a una capa de infraestructura. Las plataformas como TrueFoundry son utilizadas principalmente por los equipos de plataformas para gestionar modelos, agentes y herramientas en múltiples unidades de negocio durante la transición de la IA de la experimentación a la producción.

Conclusión

Si está buscando una solución de código abierto para el alojamiento y el gobierno de los servidores MCP de su equipo, Obot debería seguir siendo uno de los principales candidatos. Sin embargo, a medida que la empresa pasa de probar la IA a producir e implementar soluciones basadas en la IA a gran escala, descubrirá que la mayoría de los equipos necesitan funcionalidades adicionales más allá del alojamiento y la gestión de sus modelos

Aquí es donde TrueFoundry ocupa una posición única, ya que es el único proveedor de esta lista que ha fusionado con éxito la gobernanza del MCP con el equivalente a gestionar todo el ciclo de vida de la IA desde la implementación de modelos, tener una puerta de enlace de IA conectada que proporciona enrutamiento inteligente, almacenar registros de agentes, proporcionar paneles de observabilidad y proporcionar una ejecución nativa de la VPC, todo ello sin vincularlo a un solo proveedor de nube.

Si tu equipo está pensando en utilizar alternativas a la IA de Obot y necesita una plataforma para hacer crecer el uso de la IA en varios equipos y comunidades de usuarios, te recomendamos solicitar una demostración de los productos de TrueFoundry y una descripción general de cómo respaldan tu oferta tecnológica.

Preguntas frecuentes

1. ¿Cuál es la diferencia entre una puerta de enlace MCP y una puerta de enlace de IA?

Una puerta de enlace MCP está diseñada para administrar la forma en que los agentes de IA interactúan con herramientas ajenas a su sistema a través del Protocolo de contexto modelo. La puerta de enlace de IA se encuentra en un nivel superior, donde se gestionan las solicitudes para varios modelos. La pasarela es responsable de hacer cumplir las políticas, así como de supervisar la latencia, el uso y los costos. En un entorno de producción, ambas pasarelas deberán funcionar juntas. Aquí es donde resulta útil TrueFoundry, ya que reúne las pasarelas de MCP e IA en una sola plataforma.

2. ¿Necesito tanto la infraestructura MCP como la infraestructura LLM para ejecutar los agentes de IA en producción?

Sí, un entorno de producción para agentes de IA requerirá tanto una infraestructura MCP como una infraestructura LLM. MCP gestionará la forma en que los agentes de IA interactúan con herramientas ajenas a su sistema. LLM gestionará la forma en que se alojan los agentes de IA. Obot AI es una herramienta diseñada para MCP, pero un entorno de producción requerirá tanto MCP como LLM. TrueFoundry reúne tanto a MCP como a LLM en una sola plataforma, lo que simplifica mucho la administración de los entornos de producción para los agentes de IA.

3. ¿Cuándo debe un equipo ir más allá de Obot AI?

Un equipo tendrá que alejarse de Obot AI cuando sus necesidades superen el MCP. Es entonces cuando necesitan pasar a un entorno de producción. Es entonces cuando necesitan trabajar con varios modelos, hacer un seguimiento de sus costos y tener una mejor visión de sus agentes de inteligencia artificial. La necesidad de un entorno de producción surgirá cuando muchos equipos utilicen la IA. En este punto, es complicado administrar diferentes herramientas para diferentes niveles. En este punto, un equipo necesitará una plataforma como TrueFoundry, en la que tanto el MCP como la IA puedan gestionarse en una sola plataforma.

4. ¿Cuáles son las características clave que le gustaría tener una alternativa a Obot AI?

Cuando desee elegir alternativas de Obot AI, debe asegurarse de elegir aquellas que tengan las funciones necesarias para la preparación de la producción. Esto significa que quieres que admitan varios modelos, tanto alojados como autohospedados. Además, quieres que tengan una buena observabilidad con funciones como la latencia y el uso de fichas. Además, quieres que tengan buenas funciones de seguridad, como el RBAC y los registros de auditoría. Por último, desea que admitan la implementación en entornos locales o de VPC. Otra característica importante es la experiencia del desarrollador, especialmente en lo que respecta a la rapidez con la que quieres pasar del prototipo a la producción. TrueFoundry suele ser una consideración a este respecto, ya que admite estas funciones tanto a nivel de MCP como de modelo.

5. ¿Pueden las herramientas de MCP, como Obot AI, respaldar la supervisión del nivel de producción y el control de costos?

Las herramientas de MCP, como Obot AI, se diseñaron principalmente con el propósito de administrar las herramientas por sí mismas. No se diseñaron con el propósito de respaldar el monitoreo del nivel de producción. Aunque admiten funciones como los registros de auditoría, carecen de funciones como el control de costes a nivel de fichas o la capacidad de supervisar el rendimiento de los modelos y los agentes. Esta es la razón por la que querrías usar TrueFoundry, ya que permite la supervisión a nivel de producción.

6. ¿Cuál es la mejor manera de empezar con la infraestructura de agentes de IA en 2026?

La forma más sencilla de empezar varía según el nivel de desarrollo. Por ejemplo, los equipos que aún están experimentando con agentes pueden querer usar un marco o una herramienta de flujo de trabajo para crear casos de uso iniciales. Sin embargo, a medida que aumenta el nivel de complejidad, es posible que los equipos deseen añadir sistemas MCP para ayudar a gestionar el acceso a las herramientas, seguidos de una infraestructura que gestione el enrutamiento y la supervisión. Sin embargo, con el tiempo podría resultar difícil administrar estas capas por separado, y aquí es donde surge la necesidad de usar un sistema más unificado. TrueFoundry facilita este logro al admitir tanto la experimentación como la infraestructura en el mismo entorno.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)