Despliegue de ML como servicio

.webp)

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Si bien el desarrollo de modelos se ha simplificado, la implementación, el escalado y la administración de modelos de aprendizaje automático en producción siguen siendo un obstáculo importante. Los equipos de plataformas son responsables de garantizar que los modelos de aprendizaje automático se puedan implementar, monitorear, escalar y optimizar sin problemas en múltiples entornos, al tiempo que se minimizan los costos de infraestructura y se mantiene la confiabilidad.

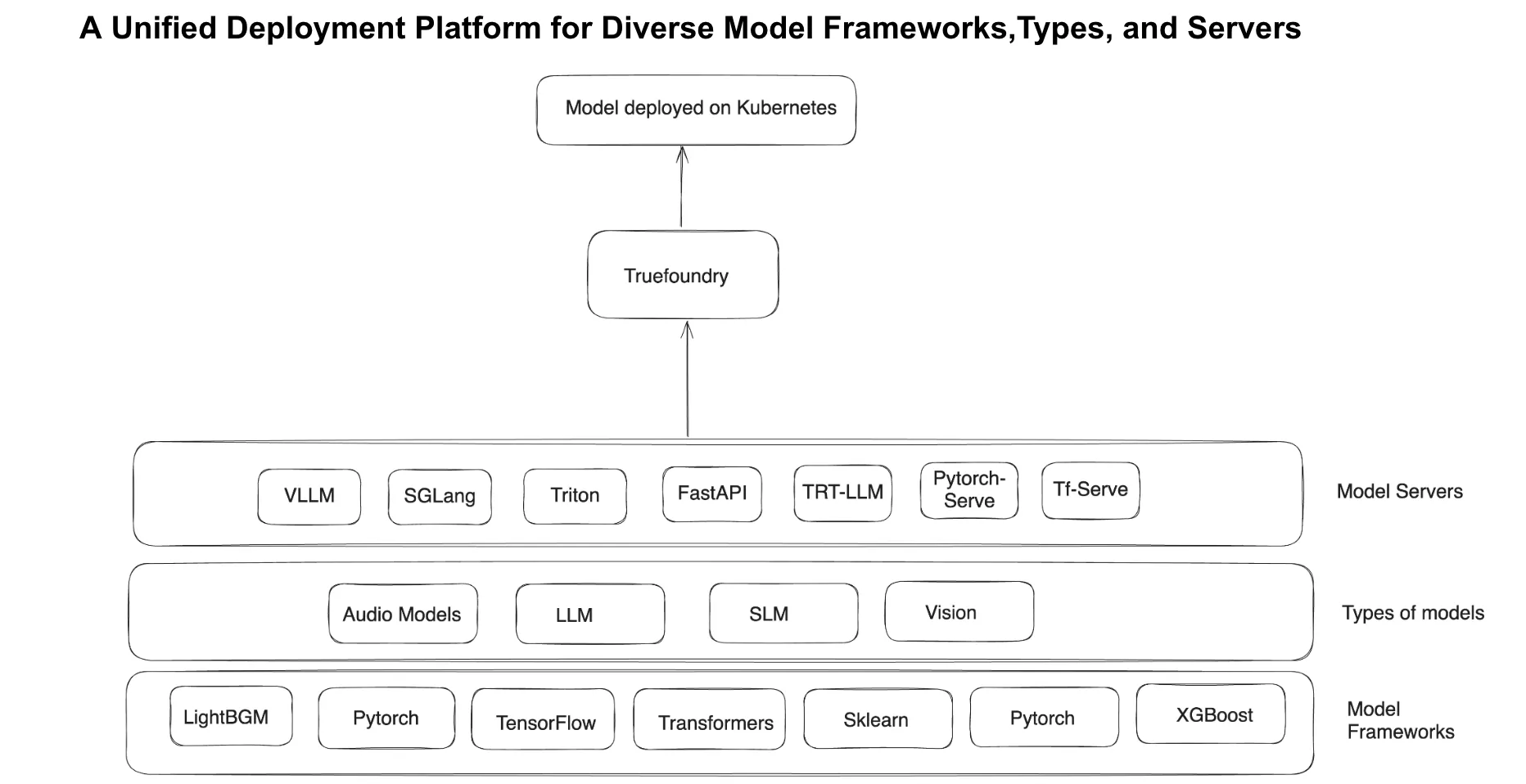

Los enfoques tradicionales de implementación de ML suelen requerir una amplia experiencia en Kubernetes, una administración manual de los recursos de la GPU y mecanismos de escalado ineficientes, lo que genera una gran sobrecarga operativa para los equipos de plataforma. En respuesta a estos desafíos, TrueFoundry ofrece una solución de implementación de aprendizaje automático como servicio, diseñada para automatizar la selección de infraestructuras, simplificar la implementación, optimizar el rendimiento y mejorar la observabilidad.

Desafíos a los que se enfrentan los equipos de plataforma en la implementación de ML

1. Configuración y selección manuales de la infraestructura

La implementación de modelos de aprendizaje automático requiere seleccionar las instancias de GPU, los servidores modelo y las configuraciones de Kubernetes correctas. Sin una automatización inteligente, los equipos de plataformas deben asignar los recursos de forma manual, lo que conduce a despliegues lentos y propensos a errores.

2. Alta sobrecarga operativa

El proceso actual a menudo implica múltiples transferencias entre científicos de datos, ingenieros de aprendizaje automático y equipos de DevOps. Los ingenieros de plataformas intervienen con frecuencia para ayudar a configurar, escalar y supervisar Kubernetes, lo que genera ineficiencias y cuellos de botella.

3. Falta de escalado automático basado en GPU

Las implementaciones de ML tradicionales carecen de mecanismos de escalado automático de GPU integrados. Sin un escalado dinámico basado en las solicitudes por segundo (RPS), la utilización o los desencadenantes basados en el tiempo, la infraestructura se subutiliza (lo que genera un desperdicio de gastos) o se aprovisiona en exceso (lo que provoca cuellos de botella en el rendimiento).

4. Servicio y selección de modelos complejos

Elegir el más eficiente modelo de servicio El enfoque, junto con el modelo de servidor correcto (por ejemplo, vLLM, SGLang, Triton, FastAPI, TensorFlow Serving) requiere una amplia experiencia en la evaluación comparativa del rendimiento, la optimización de la memoria y el equilibrio de carga.

5. Desafíos de depuración y observabilidad

Las implementaciones de ML generan registros, métricas y eventos en varias plataformas. La solución de problemas o fallos de rendimiento es tediosa, ya que los registros suelen estar dispersos, lo que dificulta que los equipos de plataformas identifiquen y resuelvan rápidamente los problemas.

6. Sobrecostos y escalamiento ineficiente

Sin una optimización automatizada de los recursos, los equipos de la plataforma deben supervisar y gestionar manualmente los modelos inactivos, lo que genera gastos innecesarios en la nube. Los métodos tradicionales de implementación del aprendizaje automático no admiten el apagado automático ni el escalado dinámico.

7. Estrategias de implementación y actualizaciones de modelos

Las empresas requieren actualizaciones del modelo sin tiempo de inactividad, pero los métodos tradicionales carecen de actualizaciones continuas, lanzamientos canarios e implementaciones azul-verdes. Esto aumenta el riesgo de interrupciones del servicio al implementar nuevas versiones de modelos.

Cómo TrueFoundry simplifica la implementación del aprendizaje automático

TrueFoundry elimina estos desafíos al proporcionar un plataforma de implementación de ML totalmente gestionada, habilitando despliegues de autoservicio, selección inteligente de recursos, optimización de costos y observabilidad mejorada. Así es como:

1. Despliegue de modelos automatizado e inteligente

TrueFoundry permite a los equipos de plataforma implementar modelos de aprendizaje automático con un solo clic, lo que elimina la necesidad de contar con experiencia en Kubernetes. La plataforma selecciona de forma inteligente las mejores configuraciones de infraestructura, seleccionando los tipos de instancias de GPU, los servidores modelo y las estrategias de escalado óptimos en función de los requisitos de carga de trabajo.

Además, la integración de GitOps garantiza que todas las implementaciones sean automatizadas y reproducibles, con la generación de YAML integrada para facilitar los flujos de trabajo de CI/CD. Al abstraer las complejidades de la infraestructura, TrueFoundry permite a los científicos de datos y a los ingenieros de aprendizaje automático implementar modelos de forma independiente, lo que reduce la carga operativa de los equipos de la plataforma.

2. Optimización de costos y rendimiento

El escalado automático avanzado basado en GPU de TrueFoundry ajusta los recursos de forma dinámica en función de la demanda en tiempo real. Los modelos se escalan hacia arriba y hacia abajo en función del RPS, el uso de la GPU o los activadores programados, lo que garantiza un rendimiento y una rentabilidad óptimos. La plataforma también ofrece:

- Apagado automático para modelos inactivos: reduce el consumo innecesario de GPU.

- Almacenamiento inteligente de modelos en caché: mejora la velocidad de inferencia y reduce los cálculos redundantes.

Además, TrueFoundry admite estrategias de implementación avanzadas, que incluyen actualizaciones continuas, lanzamientos canarios e implementaciones azul-verdes, lo que permite a los equipos de plataforma implementar nuevas versiones de modelos sin tiempo de inactividad.

3. Observabilidad y depuración para cargas de trabajo de aprendizaje automático

TrueFoundry proporciona una observabilidad centralizada y ofrece registros, métricas y eventos en un solo lugar, lo que mejora significativamente la eficiencia de la solución de problemas. Este panel unificado ayuda a los equipos de la plataforma a:

- Analice los patrones de uso y la utilización de la infraestructura.

- Depure las fallas del modelo más rápido con registros detallados y seguimiento de eventos.

El enrutamiento fijo para las LLM mejora aún más el rendimiento en un 50%, lo que garantiza una gestión eficiente de las solicitudes, mientras que la compatibilidad con el catálogo de modelos (actualmente integrada con Hugging Face) proporciona una manera fácil de administrar las versiones y los registros de los modelos.

Además, las sugerencias de infraestructura automatizadas de TrueFoundry optimizan las configuraciones de la CPU, la memoria y el escalado automático en función de los patrones de tráfico, lo que agiliza aún más la administración de la implementación.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)