MCP vs API: ¿Cuál es la diferencia?

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Los sistemas de IA evolucionan rápidamente, pero conseguir que funcionen sin problemas con herramientas y datos del mundo real sigue siendo un gran obstáculo. El Model Context Protocol (MCP) es un nuevo estándar que promete hacer que la integración de la IA sea más fluida y segura al brindar a los modelos un acceso estructurado a datos y servicios externos.

¿Te suena familiar?

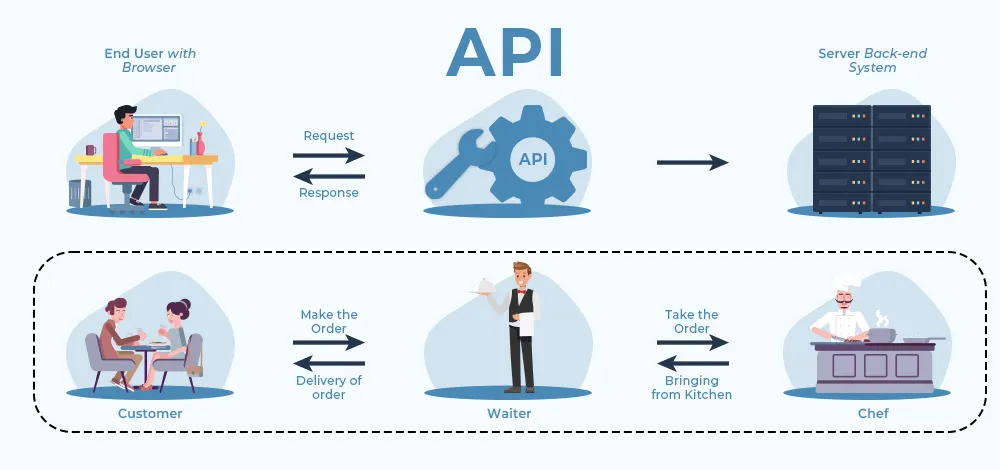

Esto se debe a que las API han estado haciendo algo similar durante décadas, ya que actúan como la columna vertebral de la forma en que los sistemas de software se comunican entre sí. A primera vista, MCP y las API pueden parecer dos versiones de la misma idea. Pero, en realidad, operan en diferentes niveles y resuelven problemas diferentes.

En este artículo sobre MCP y API, analizaremos qué es realmente MCP, cómo se compara con las API, dónde brilla cada una y qué significa todo esto para los desarrolladores, las empresas y el futuro de la integración de la IA.

¿Qué es el Protocolo de contexto modelo (MCP)?

Una interfaz estándar que permite a los modelos de IA acceder de forma dinámica a las herramientas y los datos y organizarlos para lograr flujos de trabajo seguros y sensibles al contexto.

El Model Context Protocol (MCP) es un estándar abierto que permite a los modelos de IA conectarse con herramientas, fuentes de datos y servicios externos de forma segura y estructurada. En lugar de programar integraciones o confiar en conectores personalizados, MCP define un protocolo coherente para intercambiar contexto entre un modelo y su entorno.

Esto facilita a los desarrolladores ampliar las capacidades del modelo, garantizar el acceso seguro a los datos confidenciales y estandarizar la forma en que la IA interactúa con los sistemas externos.

Características clave de MCP

Comunicación estandarizada: MCP establece un protocolo abierto y estandarizado para comunicar el contexto entre los modelos de IA y otras herramientas externas. Esto elimina la necesidad de lidiar con el complicado panorama de conectores patentados e integraciones codificadas. Todas las herramientas, fuentes de datos o servicios se comunican entre sí mediante un lenguaje común. Esto reduce en gran medida el esfuerzo de ingeniería necesario para integrar la IA con otras herramientas empresariales. El MCP Gateway de TrueFoundry sirve como punto final único para que los agentes llamen a cualquier servidor MCP registrado, que puede ser una API interna, un servicio en la nube o una integración prediseñada, como Slack, Confluence o Datadog.

Seguridad y gobierno: MCP permite el acceso controlado y autorizado a todas las herramientas y servicios. Con la implementación de TrueFoundry, esto incluye la identidad federada con IdP empresariales como Okta o Azure AD, OAuth 2.0 con detección dinámica de tokens y el control de acceso basado en roles (RBAC) por servidor MCP o por herramienta. Un agente solo puede llamar a las herramientas para las que se le haya concedido acceso de forma explícita. Por lo tanto, un agente con privilegios excesivos no puede actuar como «superusuario» en todo el panorama de herramientas de la empresa. Además, toda la actividad se registra en un registro de auditoría, lo que hace que los flujos de trabajo basados en MCP sean intrínsecamente aptos para sectores muy regulados, como los de la salud o las finanzas.

Extensibilidad: MCP se ha diseñado para permitir que nuevas herramientas o nuevas fuentes de datos se conecten fácilmente sin tener que cambiar el modelo subyacente o el código de la aplicación. En TrueFoundry, esto significa que puede usar servidores MCP prediseñados para plataformas empresariales populares listos para usar, o puede incorporar fácilmente cualquier servicio interno (una API REST patentada, una aplicación heredada o una base de datos personalizada) como un servidor MCP en cuestión de minutos. Una vez registrado, cualquier agente puede descubrirlo y llamarlo de inmediato.

Descubrimiento unificado: Un registro de servidores MCP unificado permite a los agentes (y desarrolladores) descubrir todas las herramientas y servicios disponibles. En lugar de tener que codificar las herramientas que puede utilizar un agente, ahora podemos aprovechar el registro unificado para exponer al agente, en tiempo de ejecución, el catálogo completo de servidores MCP autorizados en línea.

Observabilidad: Todas las llamadas al servidor MCP, las invocaciones de herramientas y las decisiones de los agentes ahora se pueden rastrear de principio a fin. TrueFoundry captura una gran cantidad de telemetría (latencia, errores, uso, costo) que se puede filtrar por usuario, herramienta, equipo o entorno. Esto transforma de manera eficaz lo que tradicionalmente ha sido una caja negra (¿qué hacía el agente?) en una actividad completamente auditable y depurable.

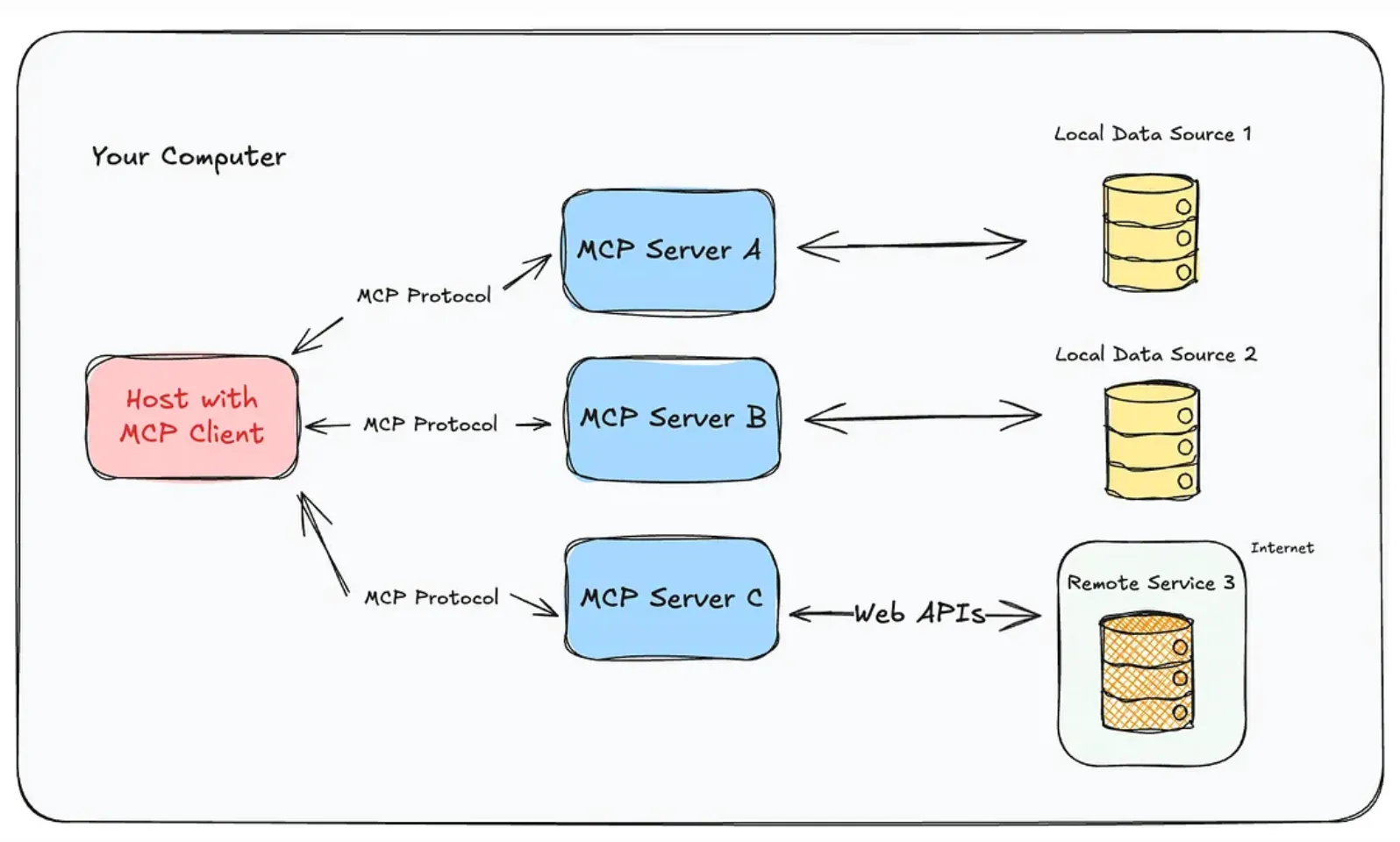

¿Cómo funciona el MCP?

La arquitectura de MCP está diseñada para equilibrar la flexibilidad con los estrictos controles de seguridad. Sigue un diseño en capas que separa el modelo, los servicios externos y el canal de comunicación. Esta separación garantiza responsabilidades claras, reduce la complejidad y facilita la ampliación o ampliación del sistema sin interrumpir los flujos de trabajo existentes.

- Capa de cliente: El modelo o agente de IA que inicia las solicitudes.

- Capa de servidor: herramientas, API o bases de datos externas que proporcionan datos o funciones.

- Capa de transporte: El canal de comunicación, a menudo basado en JSON-RPC, que garantiza un intercambio de mensajes estructurado y fiable.

- Controles de permisos: Reglas que rigen a qué puede acceder el modelo, protegiendo los recursos confidenciales o privados.

Este enfoque por capas garantiza que los modelos puedan interactuar con entornos externos sin dejar de ser seguros, escalables y fáciles de ampliar.

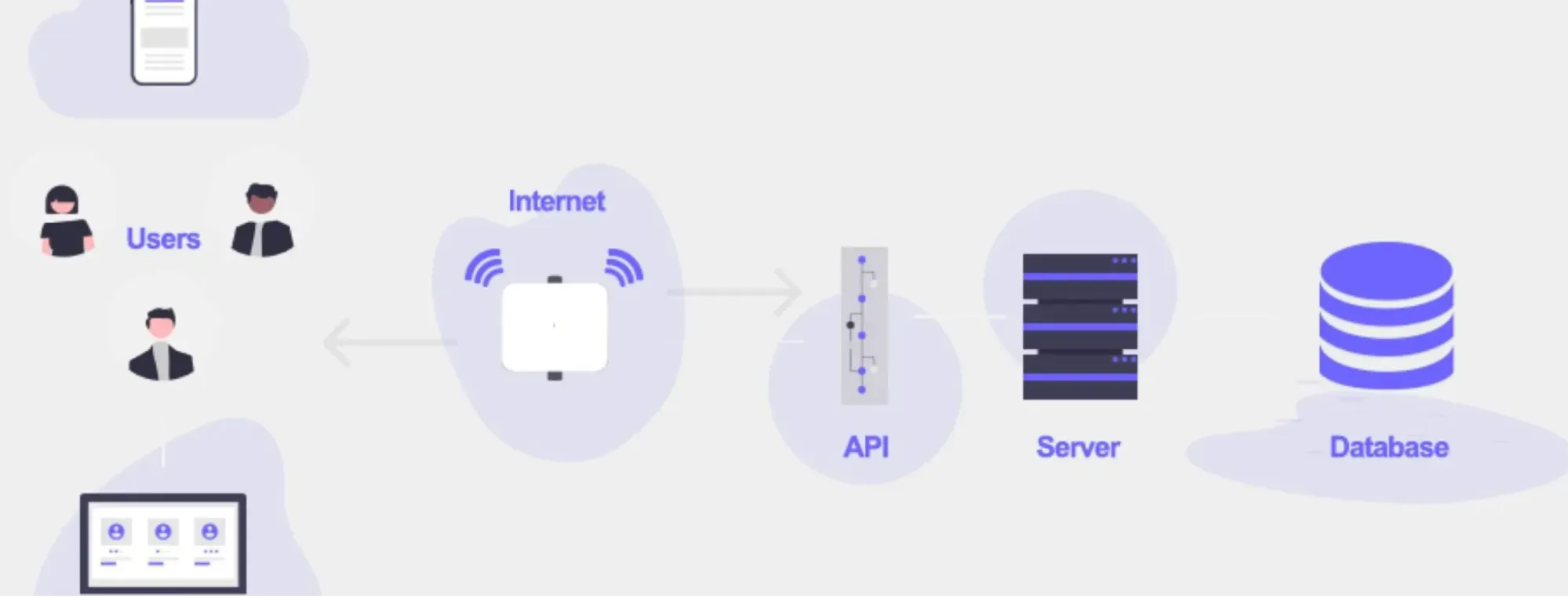

¿Qué es la interfaz de programación de aplicaciones (API)?

Una interfaz de programación de aplicaciones (API) es un conjunto definido de reglas que permite que dos aplicaciones de software se comuniquen entre sí. En lugar de acceder directamente al código o la base de datos de un sistema, los desarrolladores utilizan las API para solicitar servicios o datos específicos de forma estructurada y confiable.

Las API son la columna vertebral del desarrollo de software moderno y lo impulsan todo, desde aplicaciones móviles y plataformas web hasta integraciones empresariales.

Características clave de la API

- Acceso estandarizado: Proporciona una forma coherente de interactuar con los componentes de software sin exponer la lógica interna.

- Reutilización: Permite a los desarrolladores crear una sola vez y reutilizar la misma API en múltiples aplicaciones o servicios.

- Interoperabilidad: Hace posible que diversos sistemas, a menudo basados en diferentes tecnologías, trabajen juntos sin problemas.

¿Cómo funciona la API?

La arquitectura API se desarrolla con el objetivo de facilitar la comunicación entre dos o más sistemas y, al mismo tiempo, garantizar que el proceso sea confiable y seguro. La mayoría de las API modernas utilizan los protocolos REST o GraphQL. Sin embargo, los principios subyacentes siguen siendo los mismos en ambos. Por lo tanto, la siguiente es una descripción de los conceptos clave utilizados en la arquitectura de API:

- Cliente: una aplicación que envía una solicitud al servidor. En este caso, el cliente podría ser una aplicación móvil que solicita el saldo de la cuenta de un usuario. En el mundo moderno, donde el uso de la IA es cada vez más común, el cliente podría ser el agente de IA que solicita el uso de una herramienta para realizar una acción determinada. En cualquier caso, el cliente es quien envía la solicitud. Por lo tanto, el cliente no recibe ninguna información que no se solicite.

- Servidor: Un servidor es el que recibe la solicitud del cliente y envía una respuesta. En el caso de la IA empresarial, el servidor es el servidor MCP. El MCP es el servidor estandarizado que se utiliza como contenedor de la API interna o de la herramienta. Por lo tanto, el servidor es el que envía la respuesta una vez procesada la solicitud.

- Puntos finales: Estas son las URL definidas que el cliente usa para acceder al servidor. Por lo tanto, los puntos finales definen las funciones que el servidor puede gestionar.

- Protocolos: Los protocolos de comunicación como HTTP o WebSockets definen los estándares de comunicación para la transferencia de datos. HTTP es la base de la mayoría de las API REST, donde la solicitud consiste en un método (GET, POST, PUT, DELETE), encabezados y un cuerpo opcional, y la respuesta consiste en un cuerpo y un código de estado. Los WebSockets proporcionan una conexión persistente para la comunicación en tiempo real, como la salida de un agente o la transcripción de la IA de voz. Otros protocolos, como los eventos enviados por el servidor (SSE), también están ganando terreno, especialmente en la arquitectura MCP, donde el servidor necesita enviar actualizaciones al cliente sin la sobrecarga que supone una conexión a WebSocket.

- Autenticación y autorización: La base de toda comunicación mediante API es el mecanismo de seguridad que controla qué usuarios pueden acceder a la API y qué pueden hacer con ella. Las formas más comunes de autenticación y autorización incluyen el uso de una clave de API, OAuth 2.0 o JWT.

- Ciclo de solicitud-respuesta: El patrón de solicitud-respuesta de una API es cuando el cliente envía una solicitud a través del protocolo, que el servidor recibe en el punto final. A continuación, el servidor recibe y procesa la solicitud, donde se verifica, se ejecuta la lógica y se devuelve la respuesta en el formato deseado, como JSON o XML. El patrón de solicitud-respuesta no tiene estado en el caso de la arquitectura REST, lo que significa que la solicitud es autónoma y el servidor no almacena el estado de la solicitud ni del cliente.

- Limitación y limitación de velocidad: Las API tienen sus propios mecanismos de seguridad que limitan la cantidad de solicitudes que envía un cliente. Limitan el abuso de sus recursos y los costos de los recursos. En el contexto de la pasarela de inteligencia artificial, la limitación de velocidad incluye límites basados en fichas. En el caso del TrueFoundry AI Gateway, el límite de velocidad incluye los límites de la cantidad de tokens que un usuario o una aplicación pueden usar a diario.

Esta estructura hace que las API sean flexibles, escalables y esenciales para construir ecosistemas conectados

¿Cuál es la diferencia entre MCP y API?

Tanto el MCP como las API están diseñados para conectar sistemas, pero abordan la integración desde ángulos muy diferentes. MCP se centra en ofrecer a los modelos de IA una forma segura y estandarizada de acceder a herramientas y datos externos, mientras que las API están diseñadas para permitir que las aplicaciones se comuniquen entre sí mediante solicitudes y respuestas definidas.

Al decidir entre los dos, es importante ver cómo se comparan en aspectos como la arquitectura, la escalabilidad, la seguridad y la experiencia del desarrollador.

En la siguiente tabla se destacan diez diferencias clave:

MCP permite que los modelos de IA accedan a herramientas y datos de forma segura, mientras que las API conectan las aplicaciones de software de forma fiable. Comprender sus diferencias le ayuda a elegir la integración adecuada para cada escenario. Juntos, pueden complementarse para crear sistemas escalables, seguros y eficientes.

Comparación de arquitecturas principales

Comprender la diferencia fundamental entre las arquitecturas de API y MCP es crucial para crear sistemas escalables, seguros y eficientes. Si bien ambas tienen como objetivo facilitar la comunicación entre los componentes, sus filosofías de diseño e implementaciones técnicas difieren sustancialmente.

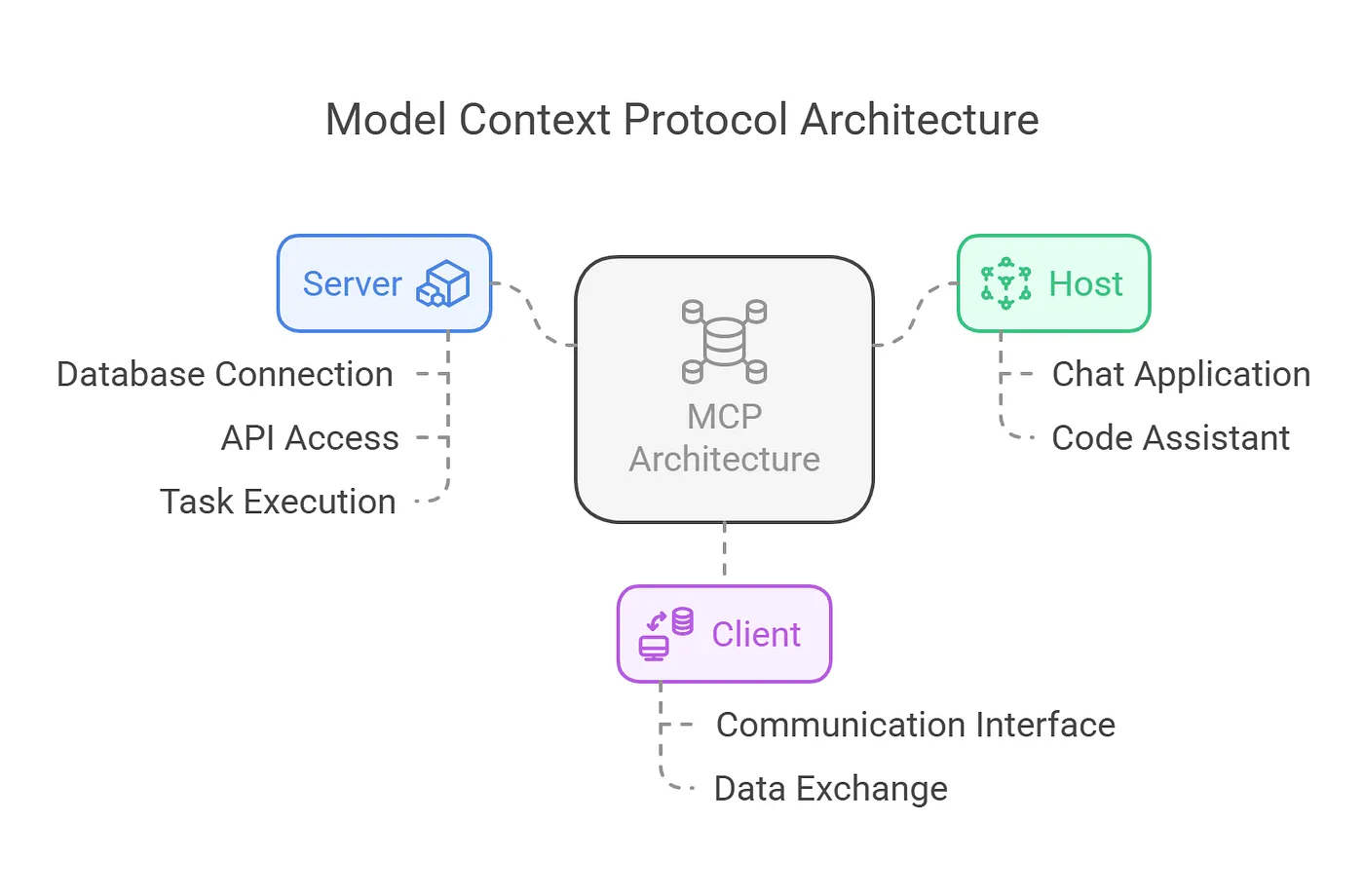

MCP (Protocolo de contexto modelo)

MCP está diseñado para flujos de trabajo impulsados por IA y LLM, lo que permite a los modelos interactuar de manera segura y eficiente con herramientas, fuentes de datos y servicios externos de una manera estructurada y estandarizada. Su arquitectura en capas, modular y sensible al contexto lo hace ideal para los agentes de IA autónomos actuales, las aplicaciones empresariales en tiempo real y las tareas de razonamiento en varios pasos.

Componentes clave:

- Capa de cliente: Los modelos o agentes de IA inician solicitudes, interpretan las capacidades de las herramientas y determinan los flujos de ejecución. Los clientes administran el contexto local y generan consultas estructuradas compatibles con los esquemas del servidor. Esto favorece la toma de decisiones adaptativas y en tiempo real, algo crucial para los asistentes de IA autónomos y los agentes de IA empresariales.

- Capa de servidor: Expone herramientas, conjuntos de datos o servicios con esquemas legibles por máquina. Los servidores permiten el descubrimiento dinámico de las capacidades, lo que permite que los modelos se adapten sin cambiar el código. Esto es esencial para las implementaciones de IA en la nube híbrida y para la orquestación bajo demanda de múltiples API o servicios.

- Capa de control de acceso y transporte: La comunicación se produce mediante transportes JSON-RPC, HTTP o stdio. Los anfitriones aplican controles estrictos de autorización, aislamiento de sesión y permisos. Esto garantiza el manejo seguro de los datos confidenciales o regulados, lo que reduce los riesgos en los flujos de trabajo de IA de nivel empresarial.

- Registro de esquemas y capacidades: MCP usa esquemas estructurados para definir las entradas, salidas y restricciones de las herramientas. Esto permite a los LLM razonar sobre el uso de las herramientas de forma segura, respaldando el cumplimiento, las acciones autónomas seguras y los flujos de trabajo eficientes de varios pasos en las aplicaciones de inteligencia artificial modernas.

API (interfaz de programación de aplicaciones)

Las API están diseñadas para la integración de aplicaciones de uso general, haciendo hincapié en los patrones predecibles de solicitud-respuesta, la escalabilidad y la interoperabilidad en diversos sistemas. Siguen siendo la piedra angular del software empresarial, los servicios en la nube y las aplicaciones a escala web, y proporcionan conectividad confiable para los flujos de trabajo basados en la IA tradicionales y modernos.

Componentes clave:

- Capa de cliente: Las aplicaciones o los servicios inician solicitudes a los puntos finales del servidor y administran los tokens de autenticación, los límites de velocidad, los reintentos y el almacenamiento en caché local. Esto garantiza un rendimiento y una fiabilidad sólidos en entornos empresariales o de nube de gran volumen.

- Capa de servidor: Aloja los puntos finales y define los contratos de recursos o acciones. Los servidores se encargan del análisis de las solicitudes, la validación de los datos, el procesamiento y el formato de las respuestas y, por lo general, devuelven cargas útiles de JSON, XML o específicas de un protocolo. Esta capa admite flujos de trabajo predecibles y estandarizados que son fundamentales para los sistemas de misión crítica.

- Terminales y protocolos: REST, GraphQL, SOAP o WebSockets rigen la comunicación y admiten operaciones sincrónicas o asincrónicas. Los terminales estructurados proporcionan patrones de acceso consistentes, lo que permite una integración fluida con los sistemas antiguos, las plataformas SaaS y las aplicaciones nativas de la nube.

- Nivel de seguridad y gobierno: Implementa claves de API, OAuth, autenticación JWT, limitación y políticas CORS. El registro y la limitación de la velocidad garantizan el cumplimiento, la auditabilidad y la protección contra el uso indebido, lo que es cada vez más importante en los sectores regulados y en las implementaciones multinube

Análisis de casos de uso

En las aplicaciones del mundo real, API y MCP cumplen funciones diferentes pero complementarias. MCP permite a los modelos de IA interactuar con múltiples herramientas y conjuntos de datos de forma dinámica, mientras que las API proporcionan una conectividad confiable y estandarizada entre los sistemas de software. Comprender sus aplicaciones prácticas ayuda a las organizaciones a elegir la estrategia de integración adecuada.

-las aplicaciones mundiales, MCP y API cumplen funciones diferentes pero complementarias. MCP permite a los modelos de IA interactuar con múltiples herramientas y conjuntos de datos de forma dinámica, mientras que las API proporcionan una conectividad confiable y estandarizada entre los sistemas de software. Comprender sus aplicaciones prácticas ayuda a las organizaciones a elegir la estrategia de integración adecuada.

MCP es ideal para flujos de trabajo de IA dinámicos y sensibles al contexto, mientras que las API destacan por su integración de software estructurada y predecible. Al aprovechar ambas a la vez, las organizaciones pueden crear sistemas en los que los modelos de IA utilicen de forma inteligente los datos y servicios impulsados por las API para ofrecer soluciones más inteligentes y en tiempo real.

Seguridad y gobierno

La seguridad y la gobernanza son consideraciones fundamentales tanto para MCP como para las API, pero abordan diferentes desafíos en función de su diseño y casos de uso.

El MCP (Model Context Protocol) se centra en las interacciones seguras con los modelos de IA. Su arquitectura incluye controles de acceso gestionados por el host, aislamiento de sesiones y seguridad a nivel de transporte. MCP permite a los anfitriones definir a qué herramientas, conjuntos de datos o servicios puede acceder un modelo, lo que reduce el riesgo de acciones no autorizadas o filtraciones de datos. Las descripciones de las herramientas basadas en esquemas ayudan a los modelos a comprender las restricciones de entrada y salida, lo que evita el uso indebido accidental o los ataques por inyección. El registro y la auditoría de las interacciones entre modelos y herramientas permiten el seguimiento de la gobernanza y el cumplimiento en los entornos empresariales. El modelo de seguridad de MCP es especialmente adecuado para las aplicaciones de IA basadas en agencias, en las que los LLM ejecutan flujos de trabajo de varios pasos en fuentes de datos confidenciales.

La seguridad y el gobierno de las API hacen hincapié en la protección y la estandarización a nivel de las aplicaciones. Las API implementan mecanismos de autenticación y autorización, como las claves de API, los tokens OAuth y JWT, además de limitar y regular la velocidad para evitar el uso indebido o la sobrecarga. Las políticas de registro, supervisión y control de versiones garantizan el cumplimiento, la trazabilidad y la compatibilidad con versiones anteriores en todos los sistemas. Las empresas pueden aplicar políticas de gobierno a nivel de puerta de enlace de API, controlando quién puede acceder a qué puntos finales y en qué condiciones.

MCP prioriza la seguridad sensible al contexto y específica de la IA, mientras que las API proporcionan una seguridad y un gobierno de aplicaciones amplios y estandarizados. El uso conjunto de ambas permite a las organizaciones mantener una seguridad sólida en los flujos de trabajo impulsados por la IA y en las integraciones de software tradicionales.

Experiencia de desarrollador

La experiencia de los desarrolladores desempeña un papel crucial en la adopción y la productividad tanto de MCP como de las API. El MCP (Model Context Protocol) está diseñado para agilizar la integración del modelo de IA con herramientas externas, y ofrece SDK, servidores de referencia y bibliotecas cliente en varios lenguajes de programación.

Los desarrolladores pueden configurar rápidamente hosts y servidores, definir esquemas de herramientas y conectar los LLM a los servicios sin necesidad de un extenso código repetitivo. Sus funciones estructuradas de transporte JSON-RPC, validación de esquemas y descubrimiento dinámico reducen los errores y simplifican la depuración en los complejos flujos de trabajo de IA.

MCP:

- SDK e implementaciones de referencia en varios idiomas

- Descubrimiento dinámico de herramientas y validación de esquemas para LLM

- Soporte integrado de gestión de errores y depuración para flujos de trabajo de IA

Las API, por el contrario, ofrecen un ecosistema maduro para la integración general de software. Los desarrolladores se benefician de especificaciones estandarizadas, como OpenAPI/Swagger, bibliotecas de clientes y pasarelas de API, que simplifican la autenticación, el control de versiones y la supervisión. Los contratos claros de terminales y la amplia documentación hacen que la incorporación y el mantenimiento sean predecibles. Las herramientas para probar, simular y supervisar las API mejoran la productividad de los desarrolladores y, al mismo tiempo, garantizan que las integraciones se mantengan estables y seguras.

APIs:

- Especificaciones estandarizadas (OpenAPI/Swagger) y contratos de punto final

- Bibliotecas cliente, puertas de enlace y herramientas de supervisión para una integración fluida

- Amplia documentación y marcos de pruebas para garantizar la confiabilidad

En general, MCP optimiza el desarrollo centrado en la IA, lo que facilita la orquestación de múltiples herramientas, mientras que las API brindan un soporte sólido y estandarizado para desarrolladores en todas las aplicaciones de software generales.

Rendimiento y escalabilidad

El rendimiento y la escalabilidad son esenciales tanto para MCP como para las API, pero sus enfoques de diseño difieren debido a sus casos de uso objetivo

Comunicación de baja latencia

MCP está optimizado para flujos de trabajo impulsados por IA, lo que permite interacciones de baja latencia entre clientes de LLM y varios servidores de herramientas mediante JSON-RPC a través de HTTP o stdio. Los esquemas estructurados reducen la sobrecarga de procesamiento y garantizan respuestas rápidas para las tareas de IA de varios pasos. Las API, por otro lado, se basan en REST, GraphQL o WebSockets, lo que proporciona una latencia predecible para las solicitudes generales de las aplicaciones. Si bien las API son altamente confiables, es posible que no se adapten dinámicamente a los flujos de trabajo de IA complejos y con múltiples herramientas en tiempo real.

Escalado horizontal y concurrencia

MCP admite el escalado horizontal a través de varias instancias de servidor que gestionan solicitudes de modelos simultáneas. El aislamiento de la sesión evita los conflictos de flujo de trabajo y garantiza un rendimiento uniforme. Las API también se escalan horizontalmente en servidores distribuidos e infraestructuras de nube, y gestionan grandes volúmenes de solicitudes de clientes con equilibrio de carga, almacenamiento en caché y limitación. Si bien el escalado de las API es un proceso avanzado y bien entendido, el escalado de MCP se centra específicamente en las operaciones de IA paralelas con acceso dinámico a las herramientas.

Eficiencia y optimización del flujo de trabajo

El diseño basado en esquemas de MCP permite a los modelos de IA razonar sobre las capacidades de las herramientas y ejecutar las tareas de manera eficiente, minimizando los cálculos redundantes y la obtención de datos. Las API logran la eficiencia a través de terminales optimizados, estrategias de almacenamiento en caché y herramientas de monitoreo que mantienen el rendimiento y la confiabilidad. A diferencia de MCP, la eficiencia de las API se centra en patrones de solicitud-respuesta predecibles y de uso general, más que en el razonamiento dinámico de la IA.

MCP garantiza operaciones de baja latencia optimizadas para la IA, mientras que las API proporcionan un rendimiento sólido y escalable para la comunicación de software tradicional, sobresaliendo en sus respectivos dominios.

MCP frente a API: ¿Cuándo usar cada uno de estos?

La elección entre MCP y API depende del flujo de trabajo, las necesidades de la aplicación y el nivel de integración de la IA requerido:

Use MCP cuando:

- Necesita flujos de trabajo de IA dinámicos y sensibles al contexto que puedan acceder a múltiples herramientas o fuentes de datos en tiempo real.

- Los agentes de LLM o IA deben razonar, orquestar y adaptarse a los cambios de entrada sin necesidad de scripts predefinidos.

- La seguridad, el aislamiento de las sesiones y la gobernanza para las operaciones de IA autónomas son fundamentales.

- Estás creando sistemas de IA para agencias, asistentes inteligentes o canales de toma de decisiones de varios pasos.

Utilice las API cuando:

- Necesita una integración fiable y predecible entre las aplicaciones o los servicios tradicionales.

- Los flujos de trabajo implican patrones de solicitud-respuesta estructurados y predefinidos, en lugar de un razonamiento dinámico de IA.

- La escalabilidad, la supervisión y el cumplimiento de los sistemas de software de nivel empresarial son prioridades.

- Está conectando sistemas heredados, plataformas SaaS o servicios en la nube que exponen los puntos finales a datos o acciones.

¿Cómo se relacionan MCP y API?

MCP y las API son tecnologías complementarias que a menudo funcionan juntas en los ecosistemas modernos de software e IA. Si bien las API proporcionan puntos finales estables y estandarizados para acceder a los servicios, las bases de datos y las aplicaciones, MCP permite a los modelos y agentes de IA descubrir, razonar y orquestar de forma dinámica estas herramientas en tiempo real.

Básicamente, MCP aprovecha las API como interfaz subyacente, añadiendo el conocimiento del contexto, la toma de decisiones adaptativa y la orquestación del flujo de trabajo en varios pasos, además de la funcionalidad predecible que proporcionan las API.

Esta combinación permite a las organizaciones crear sistemas en los que los modelos de IA puedan interactuar de forma inteligente con los servicios impulsados por API, lo que garantiza tanto la flexibilidad como la confiabilidad.

En 2026, estas arquitecturas MCP-API híbridas son cada vez más estándar en la IA empresarial, ya que admiten agentes autónomos, flujos de trabajo seguros y toma de decisiones en tiempo real sin comprometer la interoperabilidad o el rendimiento.

El futuro de MCP y API

A medida que la IA continúa evolucionando, el MCP y las API están configurando la forma en que los sistemas inteligentes interactúan con las herramientas y los datos. Comprender sus funciones futuras ayuda a las organizaciones a crear flujos de trabajo basados en la IA que sean adaptables, seguros y eficientes.

MCP como interfaz de IA estandarizada: MCP está evolucionando como una interfaz universal e independiente del modelo, a veces denominada «USB-C para IA». Permite a los agentes de IA conectarse sin problemas con una amplia gama de aplicaciones y servicios sin necesidad de integraciones personalizadas y codificadas para cada herramienta.

Descubrimiento y uso dinámicos de herramientas: A diferencia de las API tradicionales, que requieren puntos finales predefinidos y codificación manual para cada interacción, MCP permite a los modelos de IA descubrir nuevas herramientas e interactuar con ellas de forma dinámica. Esto hace que los flujos de trabajo de la IA sean más adaptables y capaces de responder a las cambiantes necesidades empresariales en tiempo real.

Del acceso a los datos a las acciones controladas: Si bien las API proporcionan principalmente datos estructurados y sin procesar para sistemas confiables, MCP permite a los agentes de IA ejecutar tareas de forma segura, interpretar respuestas complejas y gestionar comentarios de errores enriquecidos y estructurados. Esto permite operaciones de IA más seguras y autónomas en entornos empresariales.

Arquitectura híbrida: API de empaquetado: MCP no reemplaza a las API, sino que las complementa al actuar como una capa que hace que los datos y servicios basados en API sean utilizables para la IA. Las API siguen gestionando puntos finales fiables y estandarizados, mientras que MCP añade capacidades de inteligencia, reconocimiento del contexto y organización.

Expansión rápida del ecosistema: El ecosistema MCP está creciendo rápidamente, con cientos de servidores y servicios creados por la comunidad que brindan a los modelos de IA la capacidad de interactuar con aplicaciones y herramientas del mundo real. Esto acelera la adopción de la IA mediante agencias, lo que permite flujos de trabajo más inteligentes y autónomos que combinan el razonamiento en tiempo real con un acceso a los datos seguro y confiable.

Conclusión

El MCP y las API cumplen funciones distintas pero complementarias en los ecosistemas modernos de software e IA. MCP se destaca en los flujos de trabajo basados en la inteligencia artificial y sensibles al contexto, lo que permite a los LLM acceder de forma dinámica a múltiples herramientas y conjuntos de datos y, al mismo tiempo, mantener interacciones seguras y estructuradas.

Las API proporcionan una comunicación sólida y estandarizada entre aplicaciones, microservicios y plataformas externas, lo que garantiza un rendimiento y una escalabilidad predecibles. Comprender las diferencias en la arquitectura, los casos de uso, la seguridad, la experiencia de los desarrolladores y el rendimiento permite a las organizaciones elegir la estrategia de integración adecuada.

Al combinar las capacidades centradas en la inteligencia artificial de MCP con la conectividad de uso general de las API, los equipos pueden crear sistemas inteligentes, eficientes y seguros que satisfagan las necesidades de software tradicional y de inteligencia artificial.

Preguntas frecuentes

¿Cuándo usar MCP frente a API?

Utilice las API tradicionales para conexiones fijas y codificadas por el desarrollador entre sistemas de software. Elija MCP para permitir que los agentes de IA interactúen con varias herramientas de forma dinámica. MCP es ideal para entornos de producción en los que los modelos necesitan descubrir recursos y buscar el contexto sin necesidad de configurar manualmente los terminales para cada nueva integración.

¿MCP reemplazará a la API?

No, MCP funciona como un contenedor estandarizado en lugar de reemplazar las API tradicionales. Abstrae los puntos finales de las API existentes en un esquema legible por máquina que los LLM pueden entender. Al combinar el MCP y la API, las empresas aprovechan su infraestructura existente y la hacen accesible a los agentes de IA autónomos a través de una interfaz universal.

¿Cuándo es mejor MCP que API?

En el contexto de MCP frente a API, MCP es mejor para los flujos de trabajo de agencia que requieren una orquestación con múltiples herramientas. Se destaca cuando los modelos de IA deben elegir entre varias fuentes de datos de forma dinámica. El uso de una puerta de enlace centralizada como TrueFoundry para administrar estas conexiones de MCP proporciona la gobernanza, la seguridad y la auditoría de las que carecen las integraciones básicas de API.

¿MCP es lo mismo que una API?

No, MCP y las API no son lo mismo. Las API proporcionan puntos finales fijos y estandarizados para la integración del software, mientras que MCP está diseñada para los flujos de trabajo de IA y LLM, lo que permite el descubrimiento dinámico de herramientas, la orquestación en función del contexto y el razonamiento estructurado. MCP suele utilizar las API como interfaces subyacentes, pero añade inteligencia, adaptabilidad y una ejecución segura en varios pasos.

¿MCP es más rápido que API?

MCP no es intrínsecamente más rápido que las API en la transferencia de datos sin procesar. Por el contrario, está optimizado para los flujos de trabajo de la IA, lo que reduce la sobrecarga que supone el razonamiento en varios pasos y la orquestación de herramientas. Las API proporcionan una latencia predecible para las solicitudes estándar, mientras que MCP prioriza las interacciones dinámicas y la toma de decisiones en función del contexto, lo que mejora la eficiencia en las tareas complejas impulsadas por la IA.

¿Cómo convertir la API en un servidor MCP?

Para convertir una API en un servidor MCP, defina esquemas legibles por máquina para los puntos finales, las entradas y las salidas de la API. Implemente una capa de servidor que exponga estas herramientas mediante los protocolos de transporte de MCP (JSON-RPC/HTTP). Añada controles de acceso, aislamiento de sesiones y metadatos para el razonamiento de la IA, lo que permitirá a los LLM descubrir y utilizar la API de forma dinámica y segura.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)