Comprensión de los precios de LitELLM para 2026

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

LitellM es un proxy de código abierto de uso gratuito y mantenido por la comunidad. Ideal para equipos con una sólida experiencia en DevOps que desean un control total de la infraestructura y pueden gestionar la complejidad del autohospedaje sin SLA empresariales ni soporte dedicado.

¿Qué es LitellM AI Gateway?

LitELLM AI Gateway es un servidor proxy y SDK de Python de código abierto que proporciona una interfaz unificada para llamar a más de 100 API de LLM mediante un formato compatible con OpenAI. El proyecto comenzó como una simple biblioteca contenedora para estandarizar las llamadas de LLM en diferentes proveedores de LLM, como OpenAI, Anthropic, Azure, Vertex AI, Bedrock y otros.

A diferencia de las pasarelas de IA administradas que ofrecen infraestructura alojada y soporte empresarial, la pasarela de IA LitELLM funciona con un modelo fundamentalmente diferente. Usted descarga el código fuente abierto, lo implementa en su propia infraestructura y lo mantiene usted mismo. La propia pasarela LitellM AI no impone tarifas basadas en el uso, límites de registro ni cuotas de solicitud.

Sin embargo, este enfoque «gratuito» conlleva costos ocultos que muchos equipos subestiman durante la evaluación.

Cómo LitellM aborda los precios en general

La filosofía de precios de LitELLM es sencilla: el software es gratuito (con licencia del MIT), pero usted asume toda la carga operativa.

Las tres capas de costos

1. Licencia de software LitellM

El software del servidor proxy en sí cuesta 0 dólares. Puede bifurcarlo, modificarlo y usarlo comercialmente sin pagar ninguna tarifa de licencia. Esto suele llevar a los equipos a comparar el gasto en infraestructura con el gasto en infraestructura más amplio Licencias LLM, especialmente a la hora de decidir entre pasarelas de código abierto y plataformas comerciales de IA que combinan el software, el soporte y la gobernanza en un solo contrato.

2. Costos de infraestructura

Usted paga por los servidores, las bases de datos, las herramientas de monitoreo, el equilibrio de carga y toda la infraestructura de soporte. En el caso de una implementación de producción que gestione un tráfico moderado, los costos de infraestructura típicos oscilan entre 200 y 500 dólares al mes, según el volumen de tráfico, los requisitos de redundancia y el proveedor de la nube.

3. Costos de los proveedores de LLM

Usted paga a los proveedores de LLM (OpenAI, Anthropic, etc.) directamente según sus tarifas de API estándar. LitellM no añade ningún recargo ni comisión por transacción.

Nivel empresarial opcional

En 2024, LitellM presentó ofertas empresariales comerciales para equipos que desean funciones y soporte adicionales:

- Enterprise Basic: 250 USD al mes con métricas de Prometheus, barreras de LLM, autenticación de JWT, SSO y registros de auditoría

- Enterprise Premium: 30 000 USD al año para organizaciones con un uso sustancial de tokens o requisitos de cumplimiento estrictos

La mayoría de los equipos que evalúan LitellM están considerando la versión gratuita de código abierto, no estos niveles empresariales.

Los costos ocultos de los proxies de código abierto «gratuitos»

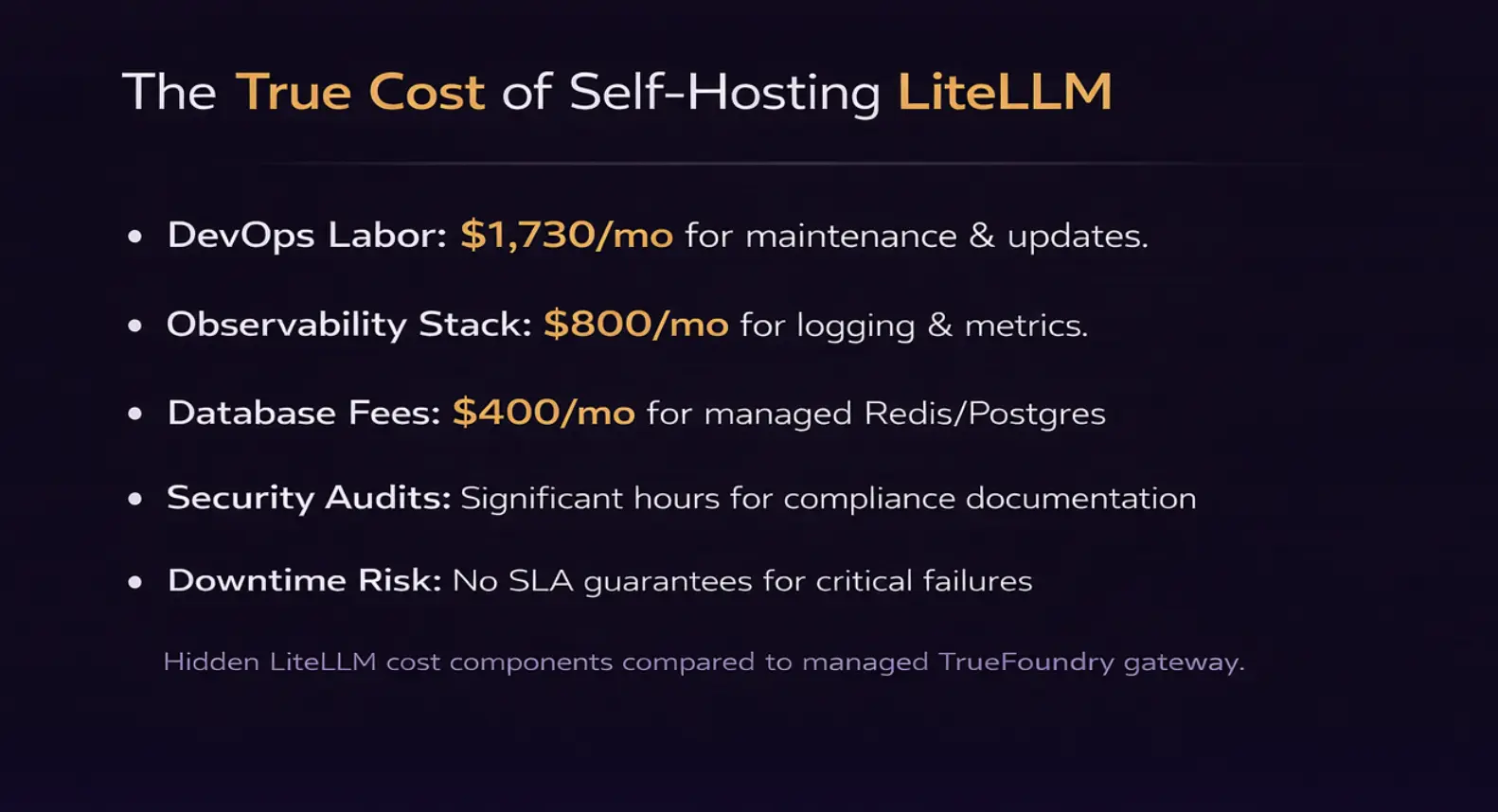

Cuando los equipos de ingeniería evalúan los precios de LitellM, con frecuencia se centran en el precio de 0 USD sin tener en cuenta el costo total de propiedad (TCO). Estos son los costos ocultos que surgen en la producción:

1. DevOps y administración de infraestructuras

La ejecución de LitellM Gateway en producción requiere tiempo de ingeniería dedicado para:

- Despliegue inicial: La configuración de clústeres de Kubernetes, la configuración de los balanceadores de carga, el establecimiento de canalizaciones de CI/CD y la integración con los sistemas de monitoreo generalmente requieren de 2 a 4 semanas de tiempo para DevOps sénior

- Mantenimiento continuo: Los parches de seguridad, las actualizaciones de dependencias, los ajustes de escalado y la solución de problemas de infraestructura requieren de 10 a 20 horas al mes

- Respuesta a incidentes: Cuando el servidor proxy deja de funcionar a las 2 de la mañana, su ingeniero de guardia se encarga de ello, no el equipo de soporte del proveedor.

Para un ingeniero sénior de DevOps con un salario anual de 150 000 dólares, 20 horas mensuales de mantenimiento se traducen en aproximadamente 1730 dólares en costes laborales al mes.

2. Pila de monitoreo y observabilidad

Las funciones de puerta de enlace de LitELLM en la versión de código abierto no incluyen una observabilidad de nivel de producción lista para usar. Es necesario integrar:

- Infraestructura de registro: ELK stack, Splunk o CloudWatch para registros centralizados

- Recopilación de métricas: Prometheus + Grafana para la supervisión del rendimiento

- Sistemas de alerta: PagerDuty o similar para la gestión de incidentes

- Rastreo: Seguimiento distribuido con OpenTelemetry para depurar flujos de trabajo multimodelo

La configuración y el mantenimiento de esta pila de observabilidad añaden otros 200 a 800 dólares mensuales en costos de infraestructura, además de tiempo de ingeniería para la configuración y el ajuste.

3. Administración de bases de datos y estados

El proxy LitellM requiere una base de datos (normalmente PostgreSQL o Redis) para:

- Administración de claves virtuales (administración de todas las claves de API).

- Seguimiento del presupuesto por clave/usuario para un seguimiento preciso de los costes.

- Administración estatal de límites de tarifas.

- Solicita registros y análisis.

Para las implementaciones de LLM de producción, necesita servicios de bases de datos administradas con copias de seguridad, replicación y alta disponibilidad. Espere entre 100 y 400 dólares al mes, según la escala.

4. Gastos generales de seguridad y cumplimiento

Sin un proveedor que gestione las actualizaciones de seguridad, su equipo es responsable de:

- Análisis de vulnerabilidades: Auditorías de dependencias periódicas con herramientas como Snyk o Dependabot.

- Administración de parches: Probar e implementar las actualizaciones de seguridad con prontitud.

- Documentación de cumplimiento: Para las auditorías de SOC 2, HIPAA o ISO 27001, debes documentar los controles de seguridad de tu proxy autohospedado.

- Controles de acceso: Implementación y mantenimiento del RBAC, el SSO y el registro de auditoría.

Para las empresas con requisitos de cumplimiento, la falta de certificaciones de seguridad y SLA proporcionados por el proveedor crea una importante fricción en las auditorías.

5. Limitaciones del soporte comunitario

La IA de LitellM es mantenida por la comunidad, lo que significa:

- Ningún SLA garantiza: Si el proxy tiene un error crítico que afecta a tu tráfico de producción, confías en los problemas de GitHub y en los colaboradores de la comunidad para solucionarlo.

- Lagunas en la documentación: Los documentos de la comunidad suelen estar incompletos o desactualizados para los casos extremos.

- Solicitudes de funciones: Las nuevas capacidades dependen de las prioridades del mantenedor, no de las necesidades de su empresa.

- Cambios importantes: Los proyectos de código abierto a veces introducen cambios importantes que requieren refactorizar el código de integración.

Para las empresas emergentes y los equipos pequeños, este modelo impulsado por la comunidad puede funcionar bien. Para las empresas que utilizan aplicaciones de inteligencia artificial de misión crítica para millones de usuarios, la falta de soporte dedicado es un riesgo importante.

Desglose del plan de precios de LitELLM

Código abierto (gratuito)

Precio: 0$ por licencia de software | Infraestructura: De 200 a 500$ al mes, lo normal

Ideal para: Equipos con sólidas capacidades de DevOps que necesitan un control total de la infraestructura y pueden gestionar la complejidad del autohospedaje.

La versión de código abierto incluye acceso API unificado a más de 100 proveedores de LLM, administración de claves virtuales, seguimiento del presupuesto por clave/usuario, equilibrio de carga y enrutamiento alternativo, limitación de velocidad (RPM/TPM) e integraciones con el registro de Langfuse, LangSmith y OpenTelemetry.

Qué administras:

- Aprovisionamiento y escalado de servidores.

- Configuración y mantenimiento de bases de datos.

- Configuración de monitoreo y alertas.

- Parches y actualizaciones de seguridad.

- Respaldo y recuperación ante desastres.

- Respuesta a incidentes y de guardia.

Ejemplo de TCO en el mundo real:

Para un equipo de tamaño mediano que ejecuta LitellM Gateway en producción en AWS con un tráfico moderado (de 1 a 5 millones de solicitudes al mes), los costos mensuales típicos son los siguientes:

Esto no incluye el tiempo de configuración inicial (de 2 a 4 semanas) ni los costos de respuesta a los incidentes.

Enterprise Basic (250 USD al mes)

Precio: 250 USD al mes | Despliegue: en la nube o autohospedado

Ideal para: equipos que desean funciones empresariales pero que aun así administran la infraestructura

Enterprise Basic añade métricas de Prometheus y devoluciones de llamadas personalizadas, barreras de LLM para el filtrado de contenido, autorización de JWT para la seguridad de las API, integración de SSO (Okta, Azure AD) y registros de auditoría para garantizar el cumplimiento.

Lo que aún administras:

- Aprovisionamiento y escalado de toda la infraestructura.

- Administración de bases de datos.

- Respuesta a incidentes y de guardia.

- Despliegue de parches de seguridad.

La cuota de 250$ al mes cubre las licencias de software y el acceso a las funciones de puerta de enlace de LitELLM, pero usted se encarga de todos los aspectos operativos. El coste total de propiedad es de 250$, más los costes de infraestructura (entre 300 y 700$) más el tiempo de DevOps (1 730$) = aproximadamente 2 280$ al mes.

Enterprise Premium (30 000 dólares/año)

Precio: 30 000$ al año (2500$ al mes) | Despliegue: en la nube o autohospedado

Ideal para: grandes organizaciones con un uso sustancial de tokens que necesitan funciones de cumplimiento avanzadas y soporte prioritario

Enterprise Premium incluye todas las funciones de Enterprise Basic, además de soporte prioritario con tiempos de respuesta más rápidos, administración de cuentas dedicada, desarrollo de funciones personalizadas y asistencia con las certificaciones de cumplimiento (SOC 2, HIPAA).

Lo que aún administras:

- Aprovisionamiento y escalado de infraestructuras.

- Mantenimiento operativo diario.

- Respuesta a incidentes (aunque con soporte prioritario).

El TCO total es de 2500 USD más los costes de infraestructura (entre 300 y 700 USD) y la reducción del tiempo de DevOps (de 10 a 15 horas, aproximadamente entre 865 y 1300 USD) = aproximadamente entre 3.665 y 4.500 USD al mes.

Precios de LitellM frente a la competencia (2026)

Así es como se comparan los precios de LitellM con las alternativas de pasarelas de IA gestionadas en función de los modelos de precios y la carga operativa:

Diferencias filosóficas fundamentales

Comparación de costos en diferentes escalas

Perspectiva clave: El costo total de propiedad de LitellM se mantiene relativamente estable porque los costos laborales predominan. Con volúmenes bajos (menos de 500 000 solicitudes al mes), la IA de LitELLM es, de hecho, más cara que las alternativas gestionadas si se tiene en cuenta el tiempo dedicado a DevOps. Con volúmenes bajos (50 millones de solicitudes al mes), donde el TCO mensual de entre 2500 y 3500 dólares es significativamente inferior al precio empresarial de los proveedores gestionados.

¿Cuándo tienen sentido los precios de LitELLM AI Gateway?

El modelo autohospedado de puerta de enlace LitELLM es ideal para casos de uso específicos en los que el control operativo justifica la carga de DevOps:

1. Tiene una sólida experiencia interna en DevOps

Si su equipo ya administra una infraestructura compleja (Kubernetes, pilas de observabilidad, canalizaciones de CI/CD) y tiene equipos de plataforma dedicados, el costo incremental de administrar LitellM AI Gateway es relativamente bajo. Su equipo de DevOps puede integrar LitELLM en los flujos de trabajo existentes de infraestructura como código sin una sobrecarga significativa.

Perfil ideal:

- ✅ Equipo de ingeniería de plataformas dedicado (más de 3 ingenieros)

- ✅ Clústeres de Kubernetes existentes con capacidad sobrante

- ✅ Conjunto de observabilidad maduro (Prometheus, Grafana, ELK)

- ✅ Se estableció la rotación de guardia para los incidentes de infraestructura

2. Necesita un control completo de la infraestructura

Para los equipos con requisitos estrictos de residencia de datos, entornos aislados o restricciones reglamentarias que prohíben a los proveedores de SaaS de terceros, el autoalojamiento suele ser la única opción. LitellM AI proporciona un proxy listo para la producción que puede implementar por completo en su entorno controlado.

Casos de uso:

- Contratistas gubernamentales o de defensa con requisitos de FedRAMP.

- Servicios financieros con mandatos de residencia de datos.

- Organizaciones de atención médica bajo interpretaciones estrictas de la HIPAA.

- Empresas que operan en China, Rusia u otras jurisdicciones con leyes de soberanía de datos.

3. Está creando una plataforma multiinquilino

Si está creando una plataforma de aplicaciones de IA que sirva a otras empresas (modelo B2B2C), es posible que desee administrar la infraestructura de puerta de enlace usted mismo para:

- Personalice la lógica de facturación y cuotas por cliente

- Implemente algoritmos de limitación de velocidad patentados

- Cree paneles de observabilidad de marca blanca

- Intégrese profundamente con la arquitectura de su plataforma existente

La puerta de enlace LitellM con alojamiento automático le brinda un control total para modificar el código de proxy según los requisitos específicos de su plataforma.

4. Está operando a gran escala (más de 50 millones de solicitudes/mes)

Con volúmenes de solicitudes extremadamente altos, los costos fijos de la mano de obra de DevOps representan un porcentaje menor del gasto total. Un coste total de propiedad de 3.500$ al mes para infraestructura y mantenimiento resulta atractivo cuando los precios gestionados por proveedores alcanzan entre 20 000 y 50 000$ al mes a una escala equivalente.

Análisis del punto de equilibrio:

- Menos de 5 millones de solicitudes al mes: Las soluciones gestionadas suelen ser más baratas si se tiene en cuenta la mano de obra.

- De 5 a 20 millones de solicitudes al mes: Su costo es competitivo en función de los requisitos de las funciones.

- Más de 50 millones de solicitudes al mes: El TCO de LitELLM se reduce considerablemente en comparación con los proveedores gestionados.

5. No necesita funciones empresariales

Si su caso de uso es sencillo (equilibrio de carga básico, enrutamiento alternativo simple, observabilidad mínima), las características de la puerta de enlace LitellM en el conjunto de código abierto pueden ser suficientes. Los equipos que no requieren almacenamiento en caché semántico, registros rápidos, RBAC avanzado o certificaciones de cumplimiento pueden evitar tener que pagar por funciones empresariales que no van a utilizar.

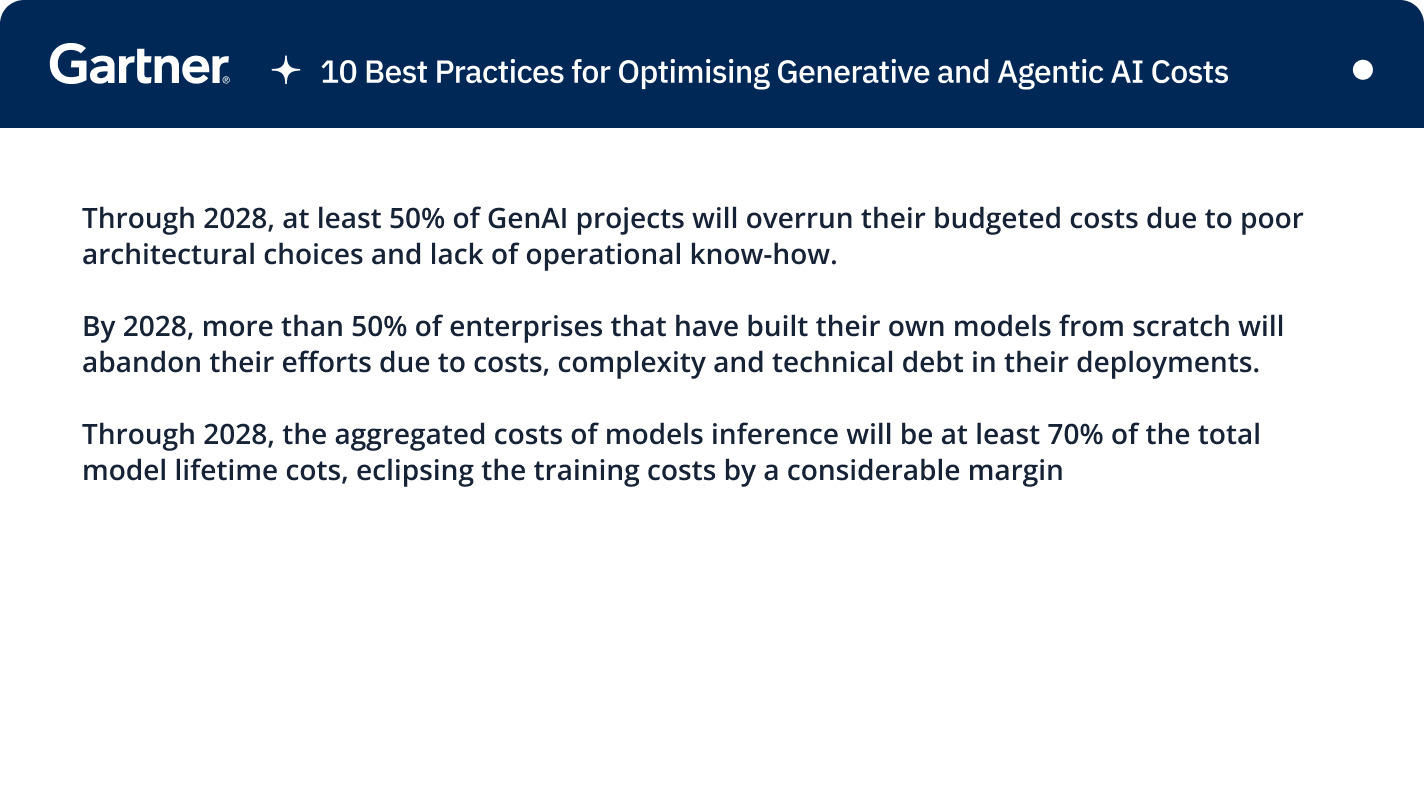

Por qué los equipos de gran escala miran más allá de LitellM

A pesar de la licencia de software de 0 dólares, muchas empresas y empresas emergentes de alto crecimiento eligen pasarelas de IA gestionadas en lugar de LitellM por varios motivos:

1. Presión en el tiempo de comercialización

La implementación y la configuración de LitellM para la producción requieren de 2 a 4 semanas de ingeniería. Para las empresas emergentes que se apresuran a lanzar nuevas funciones de inteligencia artificial o para las empresas con planes de trabajo agresivos, este tiempo de preparación representa un coste de oportunidad. Las pasarelas gestionadas, como TrueFoundry o Portkey, ofrecen una implementación instantánea con una infraestructura de nivel de producción en cuestión de minutos, no de semanas.

Escenario de ejemplo: una startup de tecnología financiera está lanzando un chatbot de asesoría financiera impulsado por IA. Retrasar tres semanas el lanzamiento para configurar la infraestructura de LitELLM significa una pérdida de ingresos, una desventaja competitiva y un incumplimiento de los hitos de los inversores. El equipo opta por la pasarela gestionada de TrueFoundry para lanzarla en 2 días en lugar de 3 semanas.

2. Enfoque de ingeniería en el producto principal

Cada hora que su equipo de DevOps dedica a administrar la infraestructura de LitellM es una hora que no dedica a crear funciones de productos que diferencien a su empresa. Para la mayoría de las empresas, la pasarela de inteligencia artificial es una infraestructura crítica, pero no una ventaja competitiva en sí misma.

Cálculo del costo de oportunidad:

- 20 horas al mes administrando LitellM × 150 USD por hora de carga = 3000 USD al mes en mano de obra.

- Esas mismas 20 horas podrían crear de 1 a 2 nuevas funciones de producto por mes.

- En una empresa de SaaS con ARR de 10 millones de dólares, 2 funciones adicionales al mes podrían impulsar un crecimiento de los ingresos entre un 5 y un 10% más rápido.

3. Falta de garantías de SLA

Los proyectos de código abierto mantenidos por la comunidad no proporcionan SLA de tiempo de actividad ni compromisos de soporte legalmente vinculantes. Si un error crítico en LitellM hace que tu aplicación de IA de producción falle, dependerás de los problemas de GitHub y de los tiempos de respuesta de la comunidad.

Escenario de riesgo: su chatbot de atención al cliente de IA (que atiende a 100 000 usuarios al día) deja de funcionar debido a un error de proxy de LitellM. Sin los compromisos del SLA con el proveedor, no tiene ningún recurso por daños y perjuicios, no puede garantizar un plazo de reparación ni contar con un ingeniero de soporte especializado que investigue. Su reputación y la confianza de los clientes se ven afectadas.

Los proveedores gestionados ofrecen SLA con un tiempo de actividad del 99,9% con sanciones financieras si no cumplen sus compromisos.

4. Faltan funciones empresariales para la IA de agencia

LitellM se centra en la funcionalidad básica del proxy (API unificada, equilibrio de carga, limitación de velocidad). Carece de las capacidades avanzadas que necesitan las aplicaciones de IA modernas:

- Protocolo de contexto modelo (MCP): LitellM no admite MCP para los flujos de trabajo de IA de agencia en los que los modelos interactúan con herramientas y API externas.

- Registro rápido: No hay un repositorio centralizado para el control de versiones, las pruebas y la implementación de las instrucciones en todos los equipos.

- Almacenamiento en caché semántico: No hay almacenamiento en caché inteligente que reconozca consultas semánticamente similares para reducir los costos de LLM.

- Observabilidad avanzada: La observabilidad desde el bricolaje requiere una configuración y herramientas adicionales significativas.

Para los equipos que crean aplicaciones sofisticadas de inteligencia artificial para agencias, estas funciones faltantes obligan a realizar trabajos de ingeniería adicionales o empujan a los equipos a optar por plataformas administradas.

5. Fricción de cumplimiento y auditoría

Durante las auditorías de SOC 2, ISO 27001 o HIPAA, la infraestructura autohospedada genera una sobrecarga de documentación. Debe demostrar:

- Procesos de parches de seguridad y tiempos de respuesta

- Procedimientos de gestión de vulnerabilidades

- Implementación de control de acceso

- Integridad del registro de auditoría

- Pruebas de recuperación ante desastres

Los proveedores gestionados proporcionan infraestructura precertificada y soporte de auditoría, lo que reduce significativamente la carga de cumplimiento.

Cómo ofrece TrueFoundry una alternativa gestionada de nivel de producción

TrueFoundry ofrece una puerta de enlace de IA totalmente gestionada que elimina la carga operativa de LitELLM y, al mismo tiempo, proporciona funciones de nivel empresarial para las aplicaciones de IA de agencia.

Ventajas clave sobre LitellM autohospedado

1. Gestión cero de la infraestructura

TrueFoundry se encarga de todo el aprovisionamiento, el escalado, la supervisión, los parches de seguridad y la respuesta a incidentes de los servidores. Su equipo implementa aplicaciones de IA en cuestión de minutos sin tocar Kubernetes, bases de datos o contenedores Docker.

2. Creado para la IA de agencia con MCP

TrueFoundry admite de forma nativa el Model Context Protocol (MCP), lo que permite flujos de trabajo de agencia sofisticados en los que los modelos de IA interactúan con herramientas, bases de datos y API externas. Esto es fundamental para las aplicaciones de IA modernas que van más allá de las simples interfaces de chat.

3. Mejor estructura de costos para el crecimiento

Si bien el TCO de LitellM se mantiene estable entre 2000 y 3500 dólares al mes, independientemente del uso, TrueFoundry ofrece:

- Nivel gratuito: 50 000 solicitudes/mes (10 veces los registros del nivel gratuito de Portkey)

- Nivel Pro: 499 USD al mes para hasta 1 millón de solicitudes con todas las funciones empresariales incluidas

- Escalado predecible: no sorprende que DevOps genere costos laborales a medida que aumenta el tráfico

4. Gobierno empresarial desde el primer día

A diferencia de LitellM, que requiere Enterprise Premium (30 000$ al año) para las funciones de cumplimiento, TrueFoundry Pro (499$ al mes) incluye:

- RBAC granular con controles de acceso basados en equipos

- Registro de auditoría completo para los requisitos de cumplimiento

- Barreras y filtrado de contenido

- Infraestructura certificada SOC 2 tipo II

- Soporte dedicado 24/7 con tiempos de respuesta de menos de 4 horas

5. Implementación local y de VPC Para las empresas con requisitos de residencia de datos, TrueFoundry ofrece la implementación local y de VPC a nivel empresarial (similar a Portkey), pero sin necesidad de administrar la infraestructura subyacente. Obtiene las ventajas de control que ofrece el autohospedaje sin la carga operativa.

Cuando TrueFoundry triunfa sobre Litellm

Escenario 1: Startup de IA de rápido crecimiento

Una empresa emergente de la serie A que cree un asistente de codificación de IA debe lanzarse rápidamente, escalar de manera impredecible y centrar los recursos de ingeniería en la diferenciación de productos en lugar de en la gestión de la infraestructura. La plataforma gestionada de TrueFoundry les permite pasar de cero a la fase de producción en 2 días, con funciones integradas de observabilidad, protección y compatibilidad con MCP para los flujos de trabajo de las agencias.

Escenario 2: Empresa con requisitos de cumplimiento

Una empresa de atención médica que crea un soporte para la toma de decisiones clínicas basado en la IA necesita cumplir con la HIPAA, registros de auditoría y SLA de tiempo de actividad garantizado. El autohospedaje de LitellM genera una sobrecarga de auditoría y un riesgo de soporte significativos. TrueFoundry proporciona una infraestructura precertificada con BaaS (acuerdos de asociación empresarial) y un soporte de cumplimiento dedicado.

Escenario 3: Aplicación de agencia multimodelo

Una empresa de tecnología financiera está creando un asesor financiero de IA que utiliza varios modelos (GPT-4 para la conversación, Claude para el análisis, Gemini para el multimodal y modelos de código abierto para tareas especializadas) y necesita organizar las llamadas a las herramientas, mantener el contexto de la conversación e implementar el almacenamiento en caché semántico. LitellM proporciona un equilibrio de carga básico, pero carece de soporte para MCP y de almacenamiento en caché semántico. La plataforma de IA para agencias especialmente diseñada por TrueFoundry gestiona la complejidad de forma nativa.

Conclusión

Los precios de LitELLM y su promesa de «código abierto y gratuito» son convincentes, pero la realidad es más matizada. Si bien la licencia de software cuesta 0 dólares, el coste total de propiedad (infraestructura, mano de obra, supervisión y soporte) suele oscilar entre 2000 y 3500 dólares al mes en el caso de las implementaciones de producción. Esto hace que LitellM sea más caro que las alternativas gestionadas para volúmenes de solicitudes bajos o medianos (menos de 5 millones de solicitudes al mes).

LitellM tiene sentido para los equipos con una sólida experiencia en DevOps que necesitan un control total de la infraestructura para la residencia de datos, los entornos aislados o los requisitos de plataforma altamente personalizados. También puede resultar rentable a gran escala (más de 50 millones de solicitudes al mes), donde los costos fijos de DevOps representan un porcentaje menor del gasto total.

Sin embargo, para la mayoría de los equipos que evalúan las pasarelas de IA en 2026, la carga operativa del autohospedaje de LitELLM supera los ahorros en los costos de licencias. Entre las principales desventajas se incluyen las siguientes:

- De 2 a 4 semanas de tiempo de configuración que retrasan el tiempo de comercialización

- El trabajo continuo de DevOps (de 10 a 20 horas al mes) desvía el enfoque de ingeniería del desarrollo de productos

- Sin garantías de SLA ni soporte dedicado para incidentes de producción

- Faltan funciones empresariales como MCP para la IA de agencia, el almacenamiento en caché semántico y los registros rápidos

- Gastos generales de cumplimiento para las auditorías SOC 2, HIPAA o ISO 27001

TrueFoundry ofrece una alternativa gestionada que elimina la carga operativa y, al mismo tiempo, ofrece capacidades superiores para las aplicaciones de IA modernas. Con la compatibilidad nativa con MCP para los flujos de trabajo de las agencias, el almacenamiento en caché semántico, la capacidad de observación integral y las funciones de gobierno empresarial del nivel Pro (499$ al mes), TrueFoundry ofrece una mejor relación calidad-precio a los equipos que se centran en crear productos de IA en lugar de en gestionar la infraestructura.

Si su equipo cuenta con ingenieros de plataforma dedicados, opera en entornos estrictamente regulados que requieren alojamiento propio o tiene un tráfico que supera los 50 millones de solicitudes al mes, vale la pena evaluar LitellM. Para todos los demás, las plataformas gestionadas como TrueFoundry ofrecen un despliegue más rápido, un coste total de propiedad más bajo en las escalas habituales y capacidades empresariales que LitellM no ofrece.

La elección correcta depende de los puntos fuertes de tu equipo. Si las operaciones de infraestructura son una competencia fundamental y una ventaja competitiva, autohospede LitellM. Si su objetivo es el desarrollo de productos de IA, elija una plataforma gestionada e invierta tiempo de ingeniería en las funciones que diferencian a su empresa.

Preguntas frecuentes

¿LitellM es realmente gratuito si lo hospedo yo mismo?

La licencia de software es gratuita, pero el costo total de propiedad incluye la infraestructura (entre 200 y 500 dólares al mes), la mano de obra de DevOps (entre 1500 y 2000 dólares al mes), las herramientas de monitoreo (entre 200 y 800 dólares al mes) y los costos de respuesta a incidentes. El coste total de propiedad real de las implementaciones de producción suele oscilar entre 2000 y 3500 dólares al mes, un importe superior al de las alternativas gestionadas con volúmenes de solicitudes bajos o medianos.

¿LitellM puede gestionar el tráfico de producción a escala empresarial?

Sí, LitellM puede escalar para gestionar grandes volúmenes de solicitudes si se diseña la infraestructura correctamente con equilibrio de carga, replicación de bases de datos y escalado horizontal. Sin embargo, usted es responsable de toda la planificación de la capacidad, el ajuste del rendimiento y la respuesta a los incidentes. Los proveedores gestionados gestionan esta complejidad por usted.

¿LitELLM admite el Protocolo de contexto modelo (MCP) para la IA de agencia?

No, LitellM actualmente no admite MCP de forma nativa. Se centra en enviar por proxy las solicitudes a los proveedores de LLM con un enrutamiento y una capacidad de observación básicos. Para flujos de trabajo sofisticados de IA entre agencias, necesita una plataforma como TrueFoundry compatible con MCP de forma nativa.

¿Cómo se compara la seguridad de LitellM con la de las pasarelas administradas?

El código fuente abierto de LitellM es auditable, lo que supone una ventaja de seguridad para los equipos que pueden realizar revisiones exhaustivas del código. Sin embargo, usted es responsable de todas las operaciones de seguridad: la aplicación de parches a las vulnerabilidades, las actualizaciones de dependencias, los controles de acceso, la administración de secretos y el registro de auditorías. Los proveedores gestionados proporcionan una infraestructura certificada por el SOC 2, equipos de seguridad dedicados y una administración automatizada de parches, lo que reduce significativamente la carga operativa de seguridad.

¿Qué ocurre si LitellM tiene un error crítico en la producción?

Confías en la respuesta de la comunidad a través de los problemas de GitHub. No hay un cronograma de solución garantizado, no hay un ingeniero de soporte dedicado ni un compromiso de SLA. En el caso de las aplicaciones de misión crítica, este riesgo de soporte puede ser inaceptable. LitellM Enterprise Premium (30 000 dólares al año) brinda soporte prioritario, pero aun así requiere que usted administre la infraestructura. Los proveedores gestionados brindan soporte ininterrumpido con tiempos de respuesta garantizados.

¿Puedo migrar de LitellM a una puerta de enlace gestionada más adelante?

Sí, pero la complejidad de la migración depende de la profundidad con la que haya personalizado LitELLM. Si utiliza funciones estándar (API unificada, enrutamiento básico), la migración a TrueFoundry o Portkey es sencilla, ya que ofrecen API compatibles con OpenAI. Si ha modificado en gran medida el código de LitellM o ha creado integraciones personalizadas, la migración requiere más esfuerzo de ingeniería. Comenzar con una plataforma gestionada reduce el riesgo de migración futura.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)