Langfuse vs Portkey: principales diferencias y características

Diseñado para la velocidad: ~ 10 ms de latencia, incluso bajo carga

¡Una forma increíblemente rápida de crear, rastrear e implementar sus modelos!

- Gestiona más de 350 RPS en solo 1 vCPU, sin necesidad de ajustes

- Listo para la producción con soporte empresarial completo

Una aplicación de LLM de producción falla de manera que incomodaría a los ingenieros de software tradicionales. Tu chatbot empieza a hacer alucinaciones con la información del producto, tu sistema RAG devuelve documentos irrelevantes o tu asistente de inteligencia artificial empieza a realizar costosas llamadas a la API en un bucle sin fin. A diferencia de los servidores web que fallan visiblemente o de las bases de datos que arrojan mensajes de error claros, los errores de LLM suelen aparecer como una sutil degradación de la calidad de respuesta que puede persistir durante horas sin que nadie se dé cuenta.

Este desafío fundamental de observabilidad afecta a todas las organizaciones que utilizan IA en producción. A diferencia del software tradicional, en el que se puede rastrear cada consulta a la base de datos y cada llamada a la API, las aplicaciones de LLM funcionan en una caja negra en la que una sola solicitud de usuario puede activar docenas de llamadas modelo, operaciones de recuperación complejas y cadenas de razonamiento de varios pasos. Cuando algo sale mal, los equipos se encuentran haciendo tareas de depuración en la oscuridad.

El mercado de la observabilidad de la LLM ha respondido con docenas de soluciones, pero dos plataformas se han hecho muy populares en los últimos tiempos: Langfuse, la favorita del código abierto con 15.500 estrellas en GitHub, y Portkey, la plataforma integral que procesa más de 2,5 billones de tokens. Cada una de ellas adopta un enfoque fundamentalmente diferente para resolver el mismo problema crítico: ¿cómo ves lo que está haciendo realmente tu IA?

¿Qué es Langfuse?

Langfuse es una plataforma de análisis y observabilidad de código abierto para aplicaciones impulsadas por LLM. Le permite supervisar las solicitudes, las respuestas, los costos y los comentarios de los usuarios en un solo lugar. Con Langfuse, los equipos pueden comprender, depurar y optimizar mejor sus flujos de trabajo de IA.

Langfuse se ha convertido en la opción ideal para los equipos que desean una observabilidad integral de la LLM sin depender de un proveedor. Creada por un equipo en Berlín tras pasar por Y Combinator, la plataforma ha atraído a más de 40 000 usuarios activos y ha recaudado 4,5 millones de dólares en financiación, algo impresionante para un proyecto de código abierto.

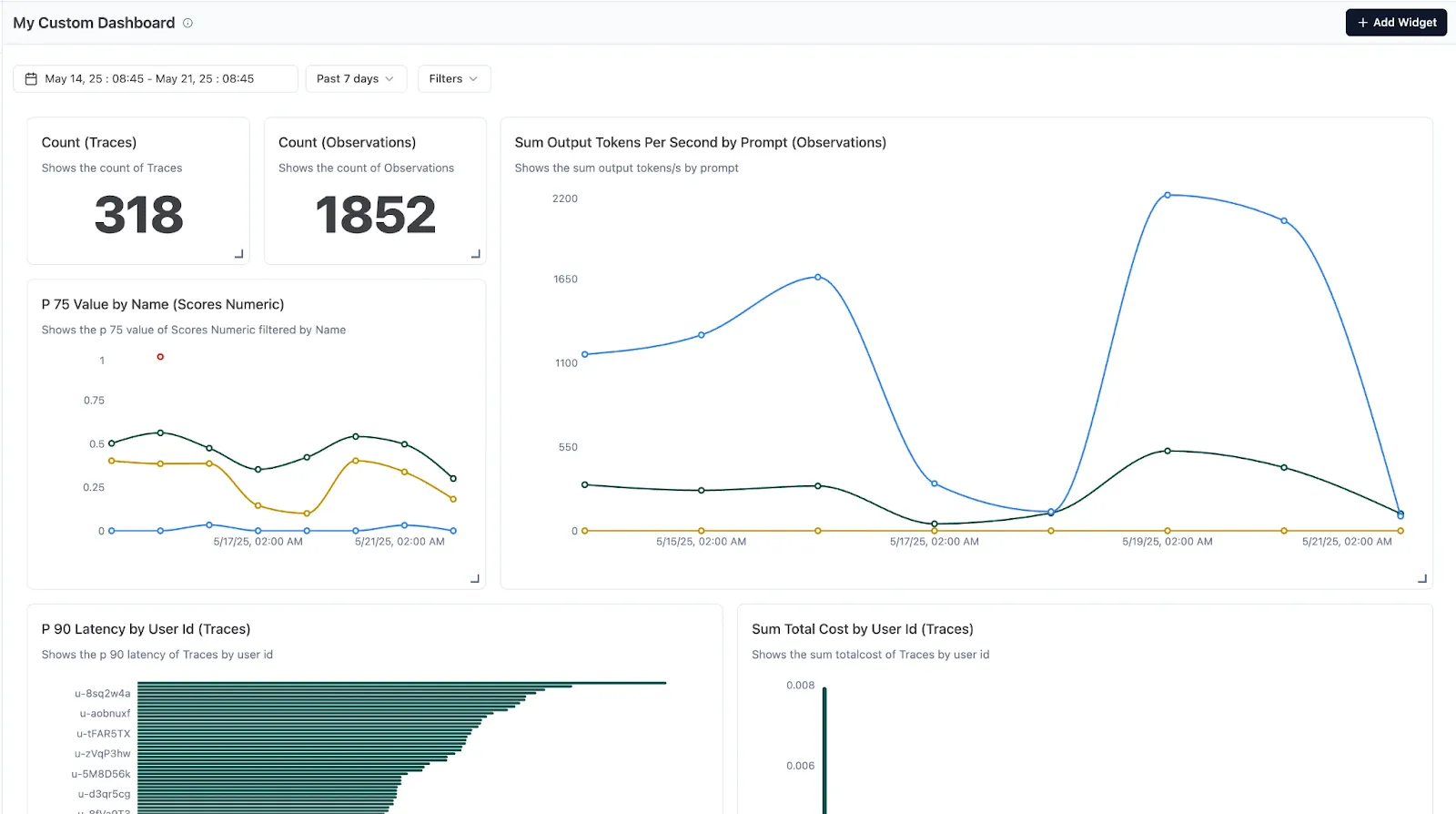

Arquitectura de trazabilidad avanzada

El sistema de rastreo jerárquico de Langfuse crea un mapa completo de cada interacción dentro de su pila de aplicaciones de LLM. Cada rastreo representa una sesión de usuario o un flujo de trabajo completos, con intervalos anidados que capturan operaciones individuales, como las llamadas a modelos, las recuperaciones, las ejecuciones de funciones y las transformaciones de datos. Esta estructura en forma de árbol refleja el flujo de ejecución real de las aplicaciones de IA complejas.

Arquitectura técnica escalable

La nueva arquitectura basada en Clickhouse de Langfuse está diseñada para ofrecer rendimiento y escalabilidad, ya que ofrece un procesamiento mucho más rápido para la mayoría de las consultas y gestiona más de mil millones de filas y decenas de gigabytes de datos por servidor por segundo. Esto permite a los clientes empresariales, como Twilio y Khan Academy, ejecutar cargas de trabajo de producción a gran escala. Khan Academy cuenta con más de 100 usuarios distribuidos en 7 equipos de infraestructura y 7 productos.

Seguridad de nivel empresarial

Para un proyecto de código abierto, Langfuse se toma la seguridad muy en serio. Han obtenido las certificaciones SOC 2 de tipo II e ISO 27001, y las aplicaciones sanitarias cumplen con la HIPAA. La plataforma admite despliegues en la nube y autohospedados, lo que brinda a las organizaciones preocupadas por la seguridad un control total sobre sus datos.

La ventaja del código abierto

Lo que diferencia a Langfuse es su compromiso con la apertura. Toda la base de código está disponible en GitHub, las API de exportación de datos no tienen restricciones y no hay funciones artificiales que separen entre los niveles gratuitos y de pago. Esta filosofía tiene un gran eco en los equipos de ingeniería que se han quedado sin trabajo debido a la dependencia de un solo proveedor.

La comunidad ha respondido con entusiasmo. La documentación incluye integraciones para todos los principales marcos de LLM: LangChain, LlamaIndex, OpenAI SDK, Anthropic SDK y docenas de otros. Los conectores aportados por la comunidad resuelven los casos extremos que las plataformas propietarias suelen ignorar.

Limitaciones en el mundo real

A pesar de sus puntos fuertes, Langfuse se enfrenta a desafíos que surgen a gran escala. La curva de aprendizaje es empinada. Los equipos informan que dedican semanas a comprender el conjunto completo de funciones antes de ver el valor. La interfaz puede resultar abrumadora en casos de uso sencillos en los que los equipos solo desean una supervisión básica de los costos y el rendimiento.

Los requisitos de recursos aumentan rápidamente con el uso. Si bien las especificaciones mínimas parecen razonables, las implementaciones de producción suelen necesitar mucha más memoria y procesamiento de lo que se anuncia. El requisito de ClickHouse, si bien es poderoso, añade una complejidad operativa que no todos los equipos desean gestionar.

Lo más importante es que Langfuse es puramente una plataforma de observabilidad. Los equipos necesitan soluciones independientes para el enrutamiento de la LLM, la gestión de las alternativas, la limitación de tarifas y los controles de costos. Esto funciona bien para las organizaciones con equipos de infraestructura sólidos, pero crea desafíos de integración para otras.

¿Qué es Portkey?

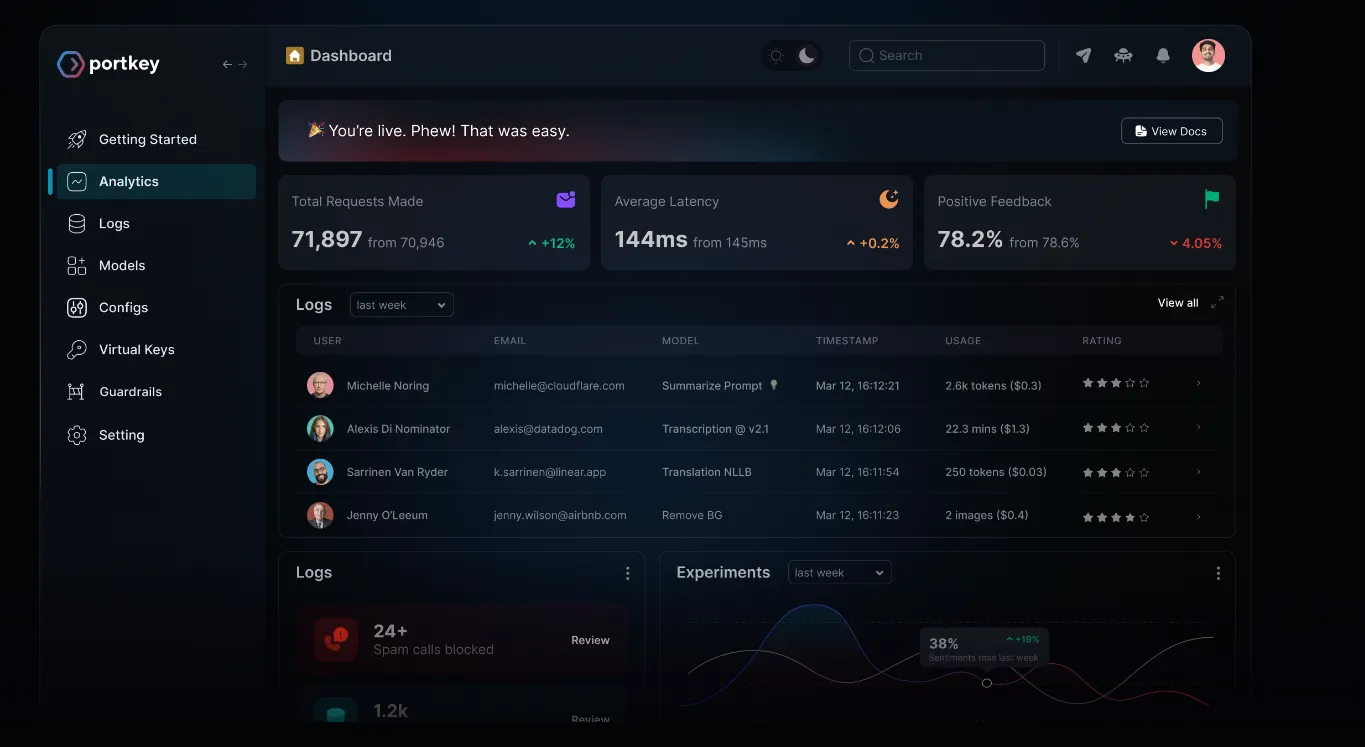

Portkey es una plataforma que ayuda a administrar y optimizar el uso de LLM en diferentes proveedores. Ofrece funciones como el almacenamiento en caché, el respaldo, la limitación de velocidad y la capacidad de observación para que las aplicaciones de inteligencia artificial sean más confiables y rentables. Los equipos utilizan Portkey para optimizar su infraestructura de IA y escalar con confianza.

Portkey ha creado una plataforma integral de infraestructura de IA que va mucho más allá de la observabilidad y se extiende al ámbito de las operaciones de LLM de producción. Portkey, que presta servicios a más de 650 organizaciones y procesa más de 2,5 billones de tokens, se posiciona como una solución para los equipos de IA empresariales.

Cobertura integral de funciones

A diferencia de las plataformas de observabilidad pura, Portkey proporciona la gama completa de capacidades de infraestructura de LLM (una infraestructura completa de AI Gateway). El enfoque basado en la configuración de la plataforma permite a los equipos definir complejas lógicas de enrutamiento, estrategias alternativas y políticas de gobierno sin cambiar el código. Esto resulta atractivo para las organizaciones que necesitan operaciones sofisticadas de LLM pero carecen de los recursos de ingeniería para crear todo desde cero.

Diseño centrado en la empresa

El enfoque empresarial de Portkey se refleja en sus completas certificaciones de cumplimiento: SOC 2 Tipo II, ISO 27001, HIPAA y GDPR. La plataforma admite modelos de implementación que van desde SaaS hasta instalaciones locales totalmente independientes.

El control de acceso basado en roles se integra con los proveedores de identidad empresariales, el registro de auditoría cumple con los requisitos reglamentarios y la plataforma proporciona una atribución de costos detallada entre equipos, proyectos y centros de costos. Estas capacidades son muy importantes para las grandes organizaciones, donde el uso de la LLM puede volverse ingobernable rápidamente.

Verificación de la realidad del rendimiento

Aquí es donde el enfoque integral de Portkey revela sus costos. Las evaluaciones comparativas independientes muestran que Portkey tiene un rendimiento significativamente más lento que las pasarelas especializadas, con una latencia un 228% mayor que la de Kong AI Gateway en las pruebas estandarizadas. Incluso las propias afirmaciones de Portkey sobre una latencia adicional de 20 a 40 ms pueden resultar problemáticas para las aplicaciones sensibles a la latencia.

La pérdida de rendimiento se debe a la arquitectura rica en funciones de Portkey. Cada solicitud pasa por varios niveles: la lógica de enrutamiento, la evaluación de las barreras, la gestión rápida, la recopilación de datos de observabilidad y el cálculo de costos. Si bien cada función agrega valor, en conjunto genera una sobrecarga sustancial.

El consumo de recursos refleja esta complejidad. Las implementaciones de Production Portkey requieren mucho más procesamiento y memoria que las soluciones de puerta de enlace puras. Los equipos informan de que tienen dificultades para optimizar el rendimiento de las aplicaciones de alto rendimiento.

Complejidad de precios

El modelo de precios de Portkey refleja su naturaleza integral, pero crea desafíos de previsibilidad. La plataforma ofrece varios niveles:

- Motor de arranque: 49 €/mes para las funciones básicas

- Producción: precios basados en el uso con varios complementos

- Empresarial: precios personalizados con acceso a todas las funciones

El modelo basado en el uso puede crear sorpresas presupuestarias a gran escala, lo que empuja a muchas organizaciones a analizar alternativas a portkey. A diferencia de los precios simples por solicitud, los costos de Portkey varían según el uso de las funciones, los períodos de retención de datos y los requisitos de cumplimiento. Los equipos informan que tienen dificultades para predecir los costos mensuales, especialmente durante las fases de desarrollo con patrones de tráfico impredecibles.

El enfoque de la plataforma en la orquestación de API externas también limita la flexibilidad. Las organizaciones que desean implementar modelos autohospedados o implementar una lógica de enrutamiento personalizada pueden verse limitadas por las decisiones de arquitectura de Portkey.

Langfuse vs Portkey: diferencias clave

Al comparar Langfuse y Portkey, las principales diferencias se reducen al enfoque y el alcance. Langfuse se creó como una capa de evaluación y observabilidad de código abierto, que brinda a los desarrolladores información detallada sobre las indicaciones, los costos y el rendimiento del modelo.

Portkey, por su parte, se posiciona como una puerta de entrada de IA completa, que combina la observabilidad con funciones avanzadas como el enrutamiento multimodelo, el almacenamiento en caché, las barreras y la gobernanza. En esencia, Langfuse se centra más en la transparencia y la depuración, mientras que Portkey se centra en la fiabilidad y la escalabilidad de las cargas de trabajo de producción.

Estas son las principales diferencias entre las dos plataformas:

Tanto Langfuse como Portkey aportan puntos fuertes únicos al desarrollo de LLM. Langfuse es el más adecuado para los equipos que desean la capacidad de observación de código abierto, una evaluación detallada y un control total de sus flujos de trabajo. Portkey, por otro lado, es la mejor opción para las organizaciones que se centran en la escalabilidad, la confiabilidad y la administración de la infraestructura multimodelo a nivel de producción.

Langfuse frente a Portkey: cuándo usar Portkey

Portkey está diseñado para equipos que van más allá de la experimentación y pasan a la producción con LLM. Sirve como puerta de enlace universal para la IA, capa de observabilidad y herramienta de gobierno, por lo que es ideal cuando la fiabilidad, la escalabilidad y la flexibilidad con varios proveedores son importantes.

Acceso multimodelo y multiproveedor: Si tu aplicación necesita funcionar en varios LLM (modelos OpenAI, Anthropic, Cohere, Mistral o de código abierto), la API unificada de Portkey elimina la dependencia de un proveedor. Puedes intercambiar o enrutar entre más de 250 modelos sin tener que volver a escribir el código, lo cual es fundamental para la optimización del rendimiento y la resiliencia.

Fiabilidad a escala: Para las cargas de trabajo de producción, Portkey ofrece reintentos automáticos, conmutación por error, disyuntores y enrutamiento condicional. Estas funciones garantizan un tiempo de actividad y un rendimiento constante incluso en situaciones de mucho tráfico o cuando un proveedor tiene picos de latencia.

Optimización de costos y latencia: El almacenamiento en caché simple y semántico incorporado reduce las solicitudes redundantes, reduce los costos de inferencia y acelera las respuestas. Esto es especialmente útil para aplicaciones con consultas repetidas o bases de usuarios con mucho tráfico.

Seguridad y gobernanza: Portkey administra las credenciales de la API a través de claves virtuales, aplica límites de tarifas y aplica los controles presupuestarios. También incluye más de 50 barreras de protección para filtrar las salidas inseguras o que no cumplan con las normas, lo que la hace apta para empresas.

Flujos de trabajo complejos y de agencia: Al crear agentes de IA o sistemas multiagente, Portkey proporciona la capa de orquestación que gestiona el enrutamiento, la observabilidad y las barreras entre los agentes, manteniendo los flujos de trabajo estables a medida que se escalan.

Use Portkey cuando necesite escalar las aplicaciones de LLM de manera confiable, optimizar los costos, administrar varios proveedores y aplicar una gobernanza de nivel empresarial, todo desde un solo plano de control.

Langfuse frente a Portkey: cuándo usar Langfuse

Langfuse está diseñado para equipos que desean una visibilidad profunda del comportamiento de sus aplicaciones de LLM. Es una plataforma de observación y evaluación de código abierto, lo que la hace ideal cuando la depuración, la supervisión y la mejora del rendimiento de los modelos son las principales prioridades.

Rastreo y observabilidad: Utilice Langfuse cuando necesite realizar un seguimiento detallado de cada interacción, indicaciones, respuestas, llamadas a herramientas, reintentos y latencia. Ayuda a los desarrolladores a ver el recorrido completo de una solicitud, lo que facilita la identificación de los cuellos de botella o los errores en los flujos de trabajo complejos de LLM.

Gestión y experimentación rápidas: Si su aplicación depende en gran medida de una ingeniería rápida, Langfuse tiene un valor incalculable. Es compatible con el control de versiones, las pruebas en áreas de juego y los experimentos simultáneos con indicaciones. Esto facilita la iteración rápida y, al mismo tiempo, hace un seguimiento de lo que funciona mejor.

Circuitos de evaluación y retroalimentación: Langfuse viene con canales de evaluación integrados, desde la puntuación automatizada de LLM como juez hasta el etiquetado manual y los conjuntos de datos estructurados. Úselo cuando desee medir la precisión, la confiabilidad o la satisfacción del usuario de manera sistemática.

De código abierto y autohospedable: Si tu equipo valora la transparencia y el control, Langfuse es totalmente de código abierto y se puede alojar automáticamente. Esto lo hace especialmente atractivo para empresas emergentes y empresas con requisitos estrictos de gobierno de datos.

Depuración y mejora continua: Langfuse sobresale cuando se centra en mejorar la calidad y no solo en escalar. Actúa como la «caja negra» de su sistema de inteligencia artificial, ya que le ayuda a comprender los fallos, refinar las instrucciones y ofrecer mejores experiencias. Elija Langfuse cuando necesite información detallada, evaluación y flexibilidad de código abierto para mejorar continuamente sus aplicaciones de LLM.

TrueFoundry: capacidad empresarial integral

El panorama actual de la infraestructura de LLM está fragmentado: los equipos suelen hacer malabares con herramientas independientes para la observabilidad, las pasarelas y la implementación de modelos, lo que lleva a concesiones en cuanto al rendimiento y la funcionalidad. TrueFoundry resuelve este problema al ofrecer un plataforma unificada que combina velocidad, capacidades de nivel empresarial y optimización de costos.

En esencia, TrueFoundry logra latencia inferior a 3 ms a la vez que ofrece funciones completas de puerta de enlace y observabilidad. Diseñado para empresas desde cero, gestiona la autenticación, la autorización y la limitación de velocidad en la memoria, lo que garantiza el rendimiento incluso cuando los agentes realizan cientos de llamadas a herramientas por conversación. El enrutamiento inteligente mejora aún más la eficiencia al seleccionar dinámicamente el mejor modelo para cada solicitud en función de las necesidades de costo, rendimiento y cumplimiento.

La plataforma también admite modelos de implementación flexibles(nativo de la nube, local, aislado o híbrido) respaldado por las certificaciones SOC 2 de tipo 2 e HIPAA. Su diseño nativo de Kubernetes garantiza una integración fluida con la infraestructura empresarial.

Por el lado de los costos, TrueFoundry va más allá del cambio de proveedor con almacenamiento en caché semántico, escalado automático y administración de recursos con conciencia del tráfico, lo que ayuda a las organizaciones a reducir los costos y, al mismo tiempo, a mantener la confiabilidad.

Un diferenciador clave es su excelencia en modelos autohospedados. TrueFoundry es compatible con los principales marcos de servicio, la optimización de GPU y las API unificadas para los modelos locales y en la nube. Esto permite a las organizaciones implementar modelos patentados de forma segura, reducir la dependencia de un proveedor y cumplir con los requisitos de soberanía de los datos, todo ello en una plataforma optimizada.

Conclusión

La elección entre Langfuse y Portkey depende de las capacidades técnicas y los requisitos de rendimiento de su organización. Langfuse es ideal para los equipos que priorizan la flexibilidad del código abierto y pueden gestionar la complejidad operativa. Portkey se adapta a las organizaciones que necesitan capacidades integrales de LLMOP, ya que aceptan un equilibrio entre rendimiento y riqueza de funciones.

TrueFoundry elimina esta elección fundamental al ofrecer sub-3 ms latencia junto con observabilidad de nivel empresarial, implementación de modelos unificados y gobernanza integral. En lugar de obligar a los equipos a trabajar en infraestructuras complejas con múltiples herramientas, la arquitectura unificada de TrueFoundry proporciona el rendimiento, la seguridad y la profundidad operativa necesarios para las implementaciones de IA de misión crítica. A medida que las capacidades de la IA se convierten rápidamente en productos básicos, la infraestructura que permite un despliegue fiable, observable y rentable se convierte en el verdadero diferenciador.

Preguntas frecuentes

¿Cuál es la diferencia entre Langfuse y Portkey?

Al comparar Langfuse con Portkey, la principal diferencia radica en su enfoque funcional: Langfuse es una plataforma especializada de observación y rastreo, mientras que Portkey es principalmente una puerta de enlace de IA. Langfuse se destaca en la depuración de resultados complejos de LLM mediante marcos de seguimiento y evaluación exhaustivos, mientras que Portkey prioriza la confiabilidad del sistema mediante la automatización de las soluciones alternativas, el equilibrio de carga y la administración de proveedores para garantizar una alta disponibilidad.

¿Qué hace que TrueFoundry sea una alternativa ideal a Langfuse vs Portkey?

TrueFoundry sirve como una alternativa integral a Langfuse frente a Portkey al unificar la observabilidad y la gestión de la infraestructura en un único plano de control. A diferencia de los proxies independientes o las herramientas de rastreo, TrueFoundry se implementa de forma nativa dentro de su VPC privada, lo que garantiza que los datos confidenciales nunca abandonen su perímetro. Proporciona las funciones de rastreo y evaluación de Langfuse, junto con el enrutamiento de alto rendimiento de Portkey, a la vez que gestiona la organización de la GPU subyacente.

¿Qué plataforma es mejor para Agentic AI: Langfuse o Portkey?

Al evaluar Langfuse frente a Portkey para los flujos de trabajo de agencia, con frecuencia se prefiere Langfuse para visualizar «cadenas de pensamiento» de varios pasos, mientras que Portkey se elige para evitar que los agentes fallen durante las interrupciones de los proveedores. TrueFoundry mejora estas arquitecturas de agencia al proporcionar soporte nativo para el Model Context Protocol (MCP), lo que permite a los agentes interactuar de forma segura con las herramientas internas. Esto proporciona un entorno más seguro para que los agentes puedan razonar y ejecutar las tareas con una seguridad y un control de costes centralizados.

¿Langfuse o Portkey son mejores para el seguimiento de costos?

Ninguno de los dos está totalmente dedicado a la gestión de costos. Langfuse calcula los costos en función del uso de los tokens, mientras que Portkey proporciona análisis del uso de las pasarelas. Para una gestión de costes y una presupuestación sólidas, se recomiendan herramientas especializadas, como AI Cost Board, que ofrecen información detallada, informes y detección de anomalías para gestionar eficazmente los gastos operativos de LLM.

¿Puedo hospedar Langfuse por mi cuenta?

Sí, Langfuse es de código abierto y admite el autohospedaje, lo que brinda un control total sobre la implementación, la seguridad y la configuración. Portkey, por el contrario, es principalmente un servicio gestionado con opciones empresariales, lo que significa que el autohospedaje requiere licencias empresariales o soluciones alternativas. TrueFoundry admite la implementación privada de forma nativa, combinando el control autohospedado con la confiabilidad empresarial.

¿Qué es mejor para los flujos de trabajo de evaluación?

Langfuse se destaca en los flujos de trabajo de evaluación, ya que ofrece procesos de rastreo, puntuación de resultados y depuración a nivel de token. Portkey se centra en la confiabilidad operativa, el enrutamiento y los mecanismos de respaldo, lo que lo hace menos adecuado para una evaluación profunda. TrueFoundry cubre ambas necesidades y proporciona una capacidad de observación y evaluación integrales con un despliegue de alto rendimiento y una gestión automatizada del flujo de trabajo mediante inteligencia artificial.

¿Cómo gestionan Langfuse y Portkey los modelos de múltiples proveedores?

Portkey administra el enrutamiento de múltiples proveedores con balanceo de carga, conmutaciones por error y selección de proveedores automatizados. Langfuse, por su parte, rastrea los resultados y el rendimiento en varios modelos, pero no organiza el enrutamiento. TrueFoundry combina ambos, monitoriza los resultados del LLM y distribuye de manera inteligente las solicitudes entre los proveedores para lograr eficiencia y confiabilidad.

¿Puede TrueFoundry reducir la latencia en comparación con Langfuse o Portkey?

Sí. TrueFoundry integra motores de inferencia optimizados, orquestación de GPU y enrutamiento inteligente para minimizar los tiempos de respuesta. A diferencia de Langfuse, que se centra en la observabilidad, y Portkey, que garantiza la fiabilidad, TrueFoundry equilibra la velocidad, la escalabilidad y la supervisión, proporcionando respuestas de IA de baja latencia en los entornos de producción.

TrueFoundry AI Gateway ofrece una latencia de entre 3 y 4 ms, gestiona más de 350 RPS en una vCPU, se escala horizontalmente con facilidad y está listo para la producción, mientras que LitellM presenta una latencia alta, tiene dificultades para superar un RPS moderado, carece de escalado integrado y es ideal para cargas de trabajo ligeras o de prototipos.

La forma más rápida de crear, gobernar y escalar su IA

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)

.webp)